Peranti teknologi

Peranti teknologi

AI

AI

WizardLM-2, yang 'sangat hampir dengan GPT-4', telah ditarik balik dengan segera oleh Microsoft.

WizardLM-2, yang 'sangat hampir dengan GPT-4', telah ditarik balik dengan segera oleh Microsoft.

WizardLM-2, yang 'sangat hampir dengan GPT-4', telah ditarik balik dengan segera oleh Microsoft.

Beberapa masa lalu, Microsoft membuat kesilapan sendiri: WizardLM-2 yang bersumberkan terbuka besar, dan kemudian menarik baliknya dengan bersih tidak lama kemudian.

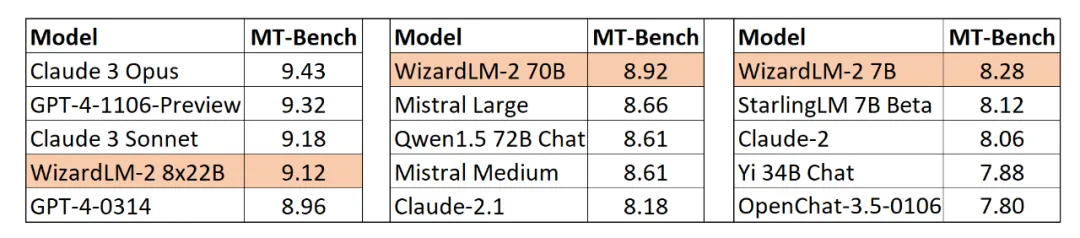

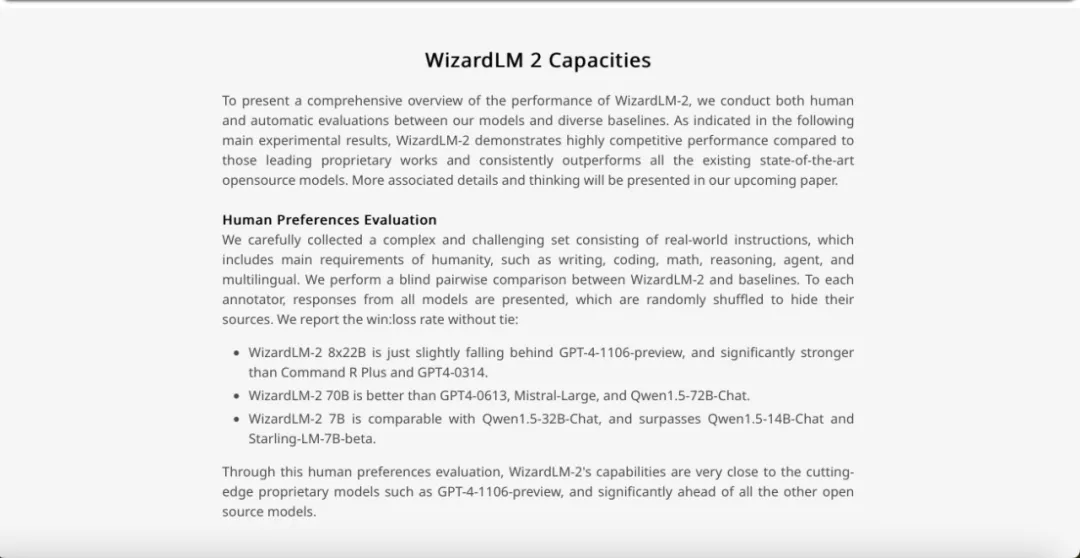

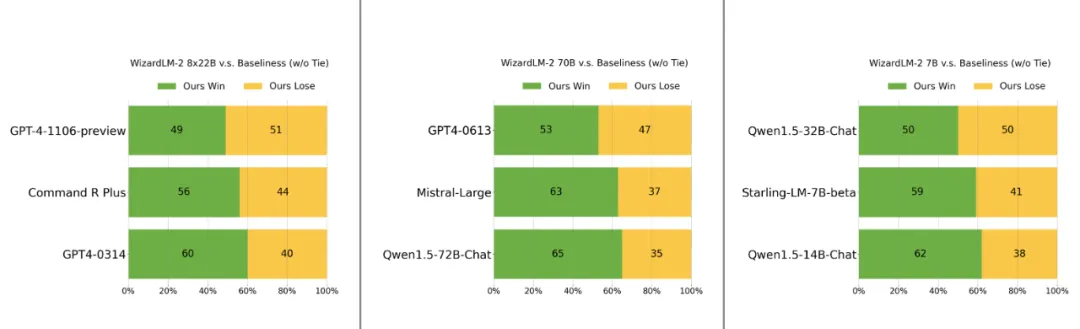

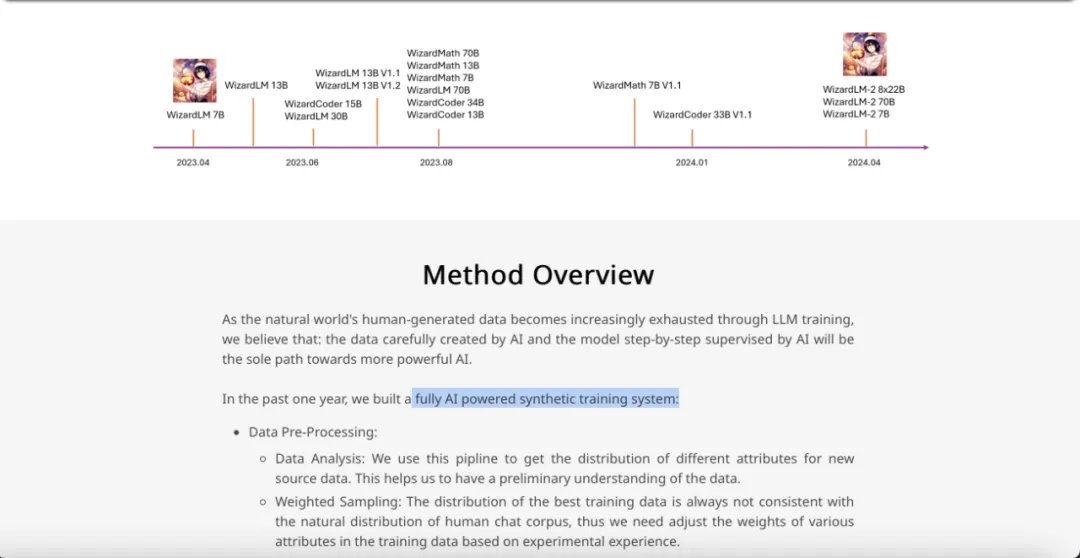

Maklumat keluaran yang tersedia pada masa ini untuk WizardLM-2, model besar sumber terbuka "benar-benar setanding dengan GPT-4" dengan prestasi yang dipertingkatkan dalam sembang kompleks, berbilang bahasa, inferens dan agensi.

Siri ini termasuk tiga model: WizardLM-2 8x22B, WizardLM-2 70B dan WizardLM-2 7B. Antaranya:

- WizardLM-2 8x22B ialah model paling maju dan LLM sumber terbuka terbaik berdasarkan penilaian dalaman untuk tugasan yang sangat kompleks.

- WizardLM-2 70B mempunyai keupayaan inferens peringkat teratas dan merupakan pilihan pertama pada skala ini

- WizardLM-2 7B adalah yang terpantas, dengan prestasi setanding dengan model terkemuka sumber terbuka sedia ada yang 10 kali lebih besar.

Selain itu, melalui penilaian keutamaan manusia, keupayaan WizardLM-28x22B "hanya sedikit di belakang pratonton GPT-4-1106, tetapi jauh lebih kuat daripada CommandRPlus dan GPT4-0314.🜎

Adakah ia akan menjadi satu lagi pencapaian sumber terbuka seperti LLaMa 3?

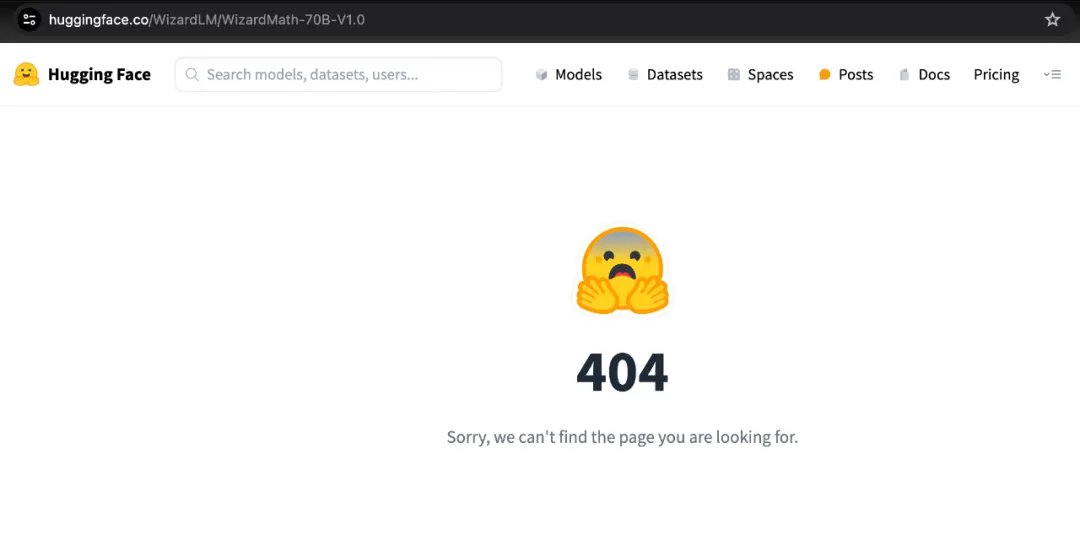

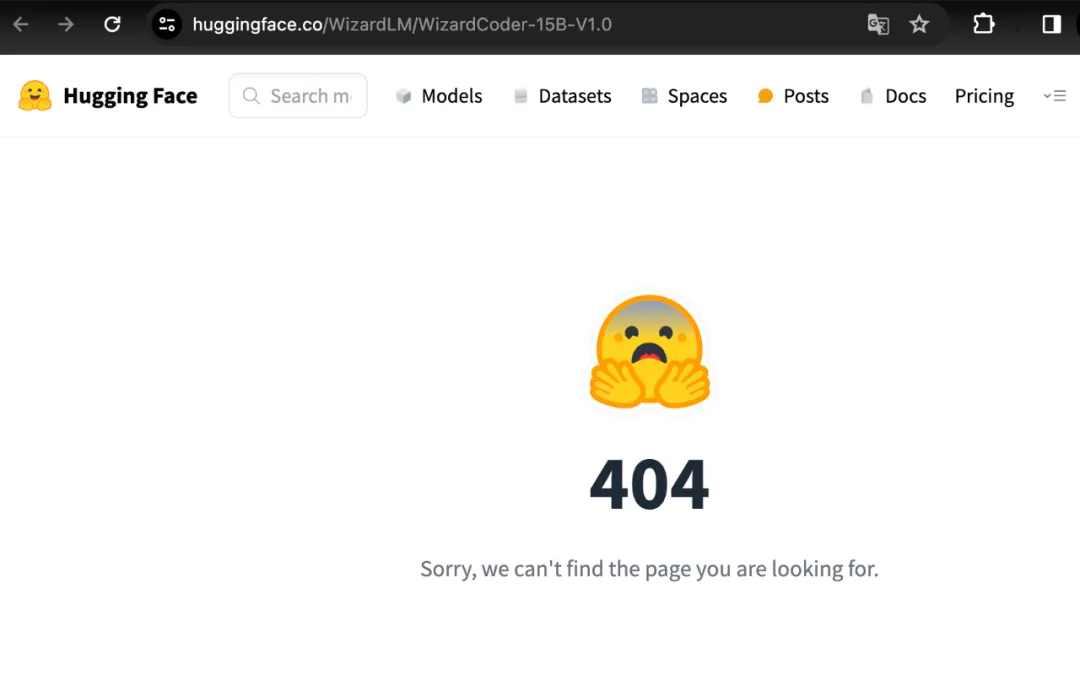

Semasa semua orang sibuk memuat turun model, pasukan tiba-tiba menarik balik segala-galanya: blog, GitHub, HuggingFace semuanya mendapat 404.

Sumber imej: https://wizardlm.github.io/WizardLM2/

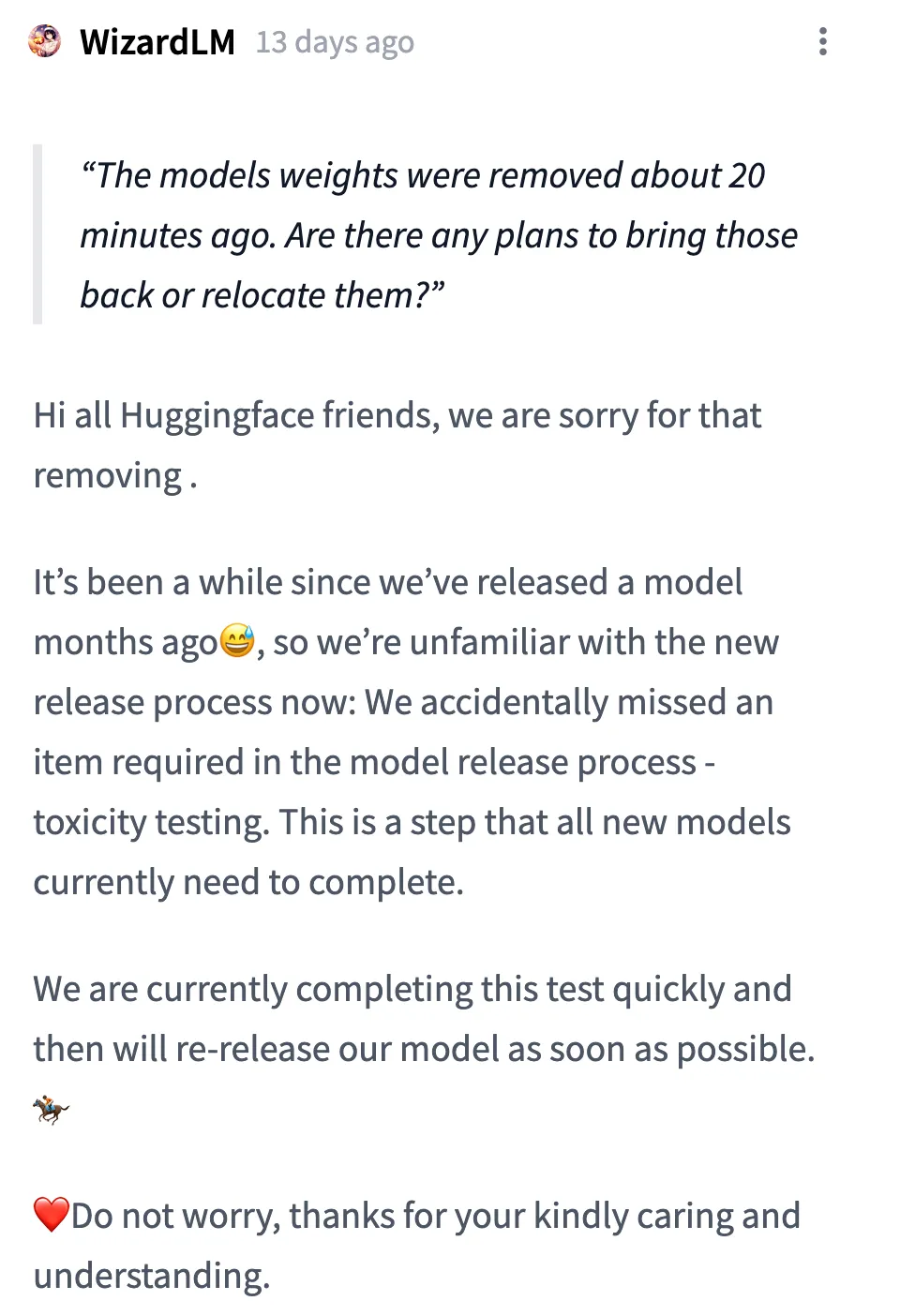

Penjelasan pasukan ialah:

Salam kepada semua rakan Huggingface! Maaf, kami mengalih keluar model itu. Sudah agak lama sejak kami mengeluarkan model dari beberapa bulan yang lalu, jadi kami tidak biasa dengan proses keluaran baharu sekarang: kami secara tidak sengaja meninggalkan item yang diperlukan dalam proses keluaran model - ujian ketoksikan. Ini adalah langkah yang perlu diselesaikan oleh semua model baharu pada masa ini.

Kami sedang menyelesaikan ujian ini dengan cepat dan akan mengeluarkan semula model kami secepat mungkin. Jangan risau, terima kasih atas keprihatinan dan pemahaman anda. . pasukan Semua kerja siri Wizard telah hilang, termasuk WizardMath dan WizardCoder sebelumnya.

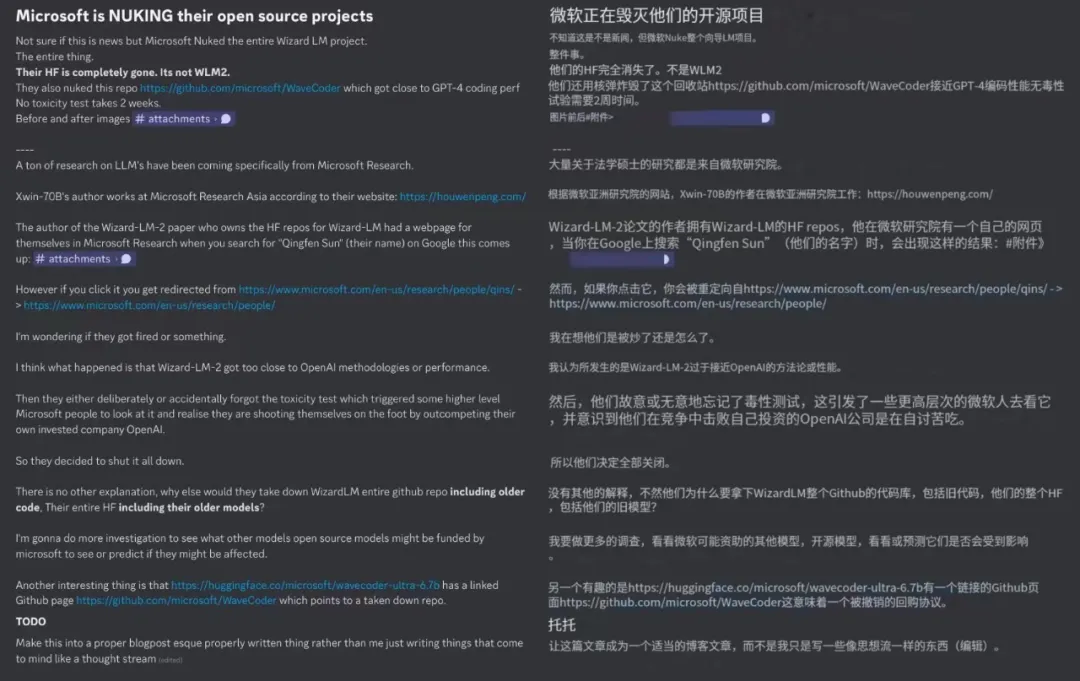

Kedua, ada yang mempersoalkan kenapa blog itu turut dipadamkan sedangkan pemberat model dipadamkan? Jika ia hanya kehilangan bahagian ujian, tidak perlu menarik balik sepenuhnya.

Penjelasan pasukan ialah: "Mengikut peraturan yang berkaitan." Apakah peraturan khusus? Belum ada yang tahu.

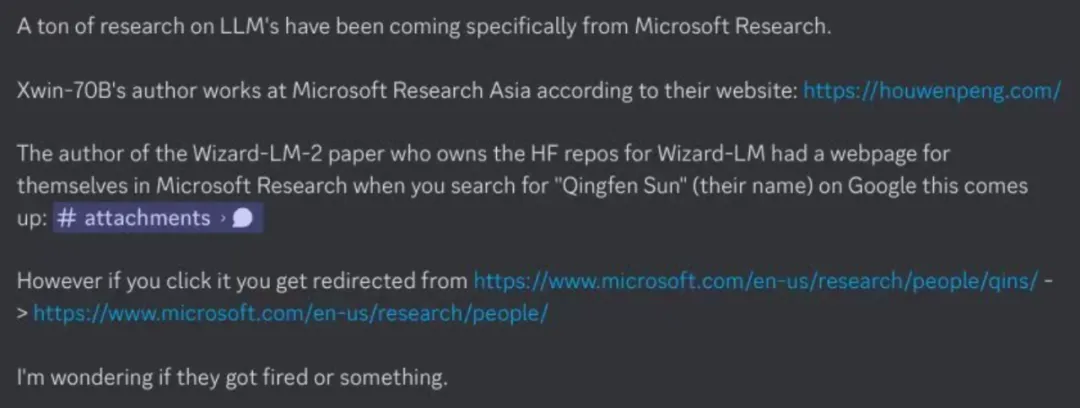

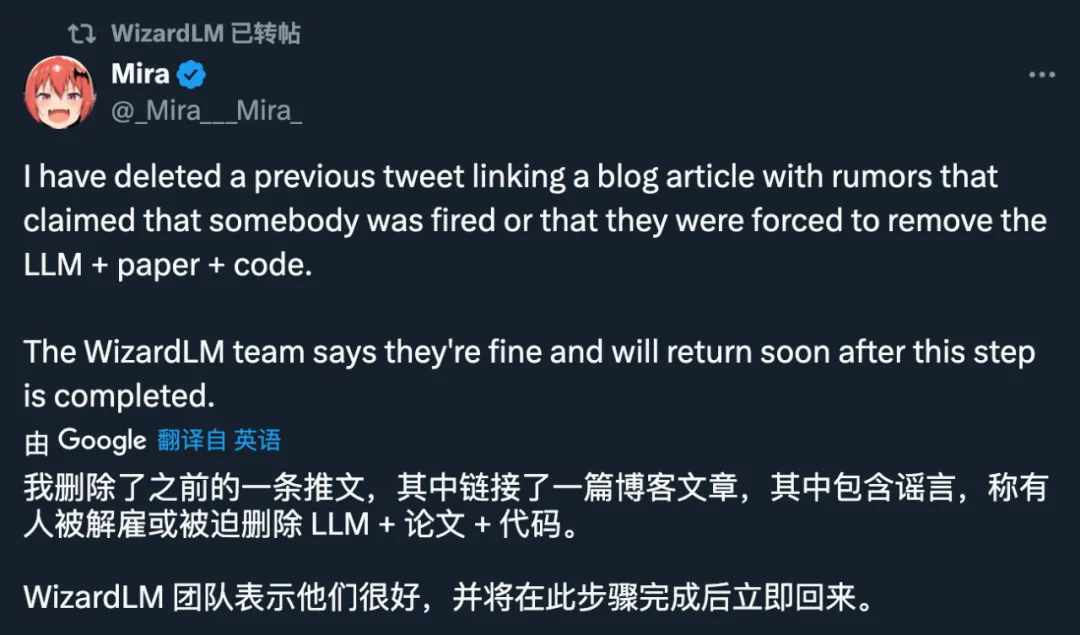

Ketiga, terdapat juga spekulasi bahawa pasukan di belakang WizardLM telah dipecat, dan penarikan balik projek siri Wizard juga dipaksa.

Namun spekulasi ini dinafikan oleh pasukan:

Sumber: https://x.com/_Mira___Mira_/status/42763

Dan kini kami mencari nama pengarang, dan ia tidak hilang sepenuhnya daripada laman web rasmi Microsoft:

www

.microsoft.com/en-us/research/people/qins/

Keempat, sesetengah orang membuat spekulasi bahawa Microsoft menarik balik model sumber terbuka ini, pertama kerana prestasinya terlalu hampir dengan GPT-4, dan kedua kerana teknikal peta jalan dengan OpenAI " Crash".

Apakah laluan khusus? Kita boleh melihat butiran teknikal halaman blog asal.

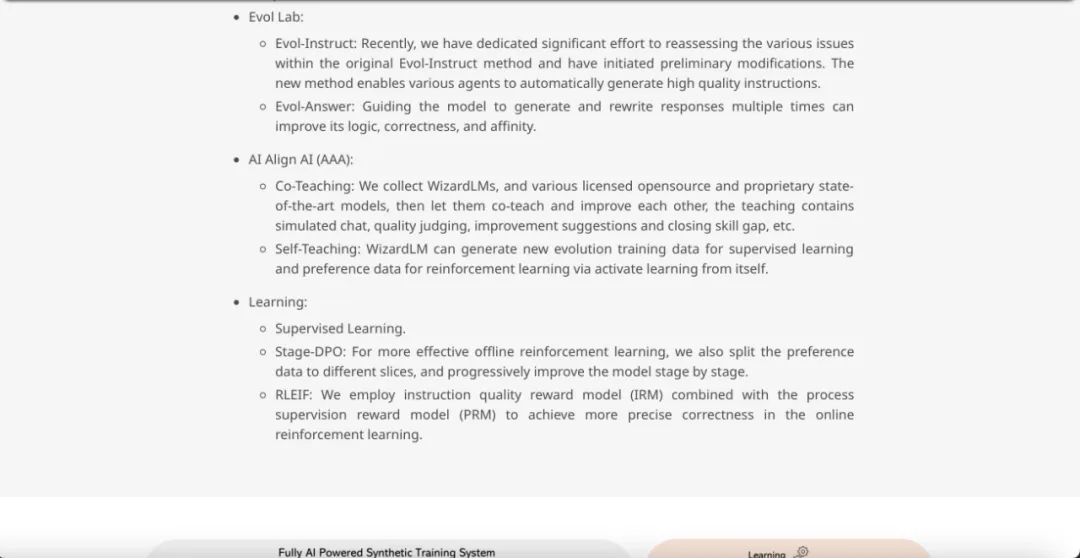

Pasukan menyatakan bahawa melalui latihan LLM, data yang dijana manusia secara semula jadi semakin kehabisan, dan data yang dicipta dengan teliti oleh AI dan model yang diselia Langkah demi Langkah AI akan menjadi satu-satunya cara untuk mendapatkan AI yang lebih berkuasa.

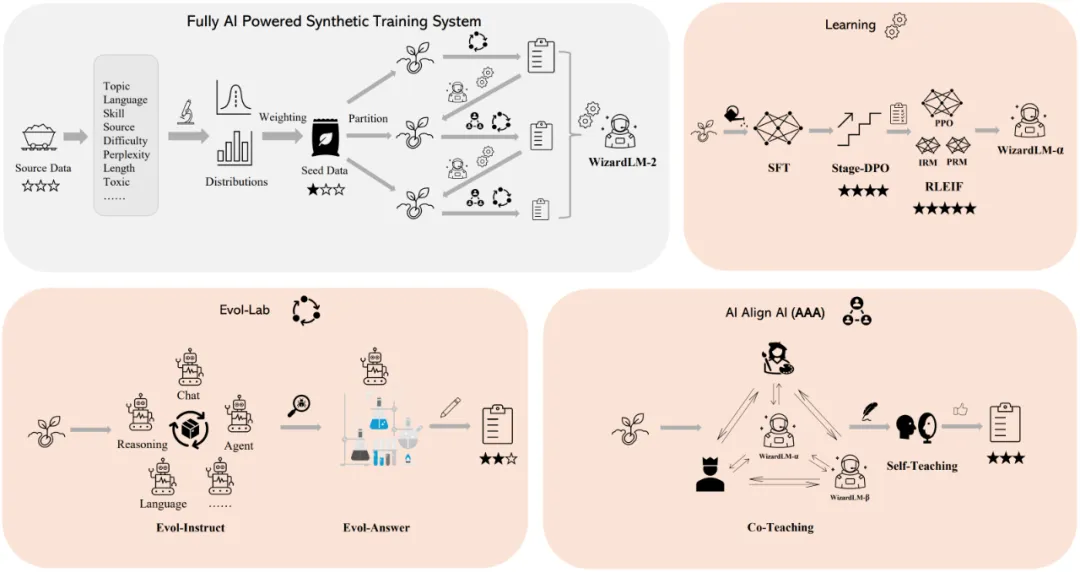

Sepanjang tahun lalu, pasukan Microsoft telah membina sistem latihan sintetik yang dikuasakan sepenuhnya oleh kecerdasan buatan, seperti yang ditunjukkan dalam rajah di bawah.

kira -kira dibahagikan kepada beberapa bahagian:

Processing:

- Data Analisis: Gunakan saluran paip ini untuk mendapatkan pengedaran atribut yang berbeza dari data sumber baru, yang Ia membantu untuk mempunyai pemahaman awal tentang data.

- Pensampelan berwajaran: Pengagihan data latihan yang optimum selalunya tidak konsisten dengan pengedaran semula jadi korpus sembang manusia Ia adalah perlu untuk melaraskan berat setiap atribut dalam data latihan berdasarkan pengalaman percubaan. Evol Lab:

Pengubahsuaian awal, kaedah baharu membolehkan pelbagai ejen menjana arahan berkualiti tinggi secara automatik. Evol-Jawapan: Bimbing model untuk menjana dan menulis semula respons berbilang kali, yang boleh meningkatkan logik, ketepatan dan pertaliannya. . lain. Kandungan pengajaran termasuk Sembang simulasi, ulasan kualiti, cadangan untuk penambahbaikan, menutup jurang kemahiran dan banyak lagi.

- Pengajaran Kendiri: WizardLM boleh menjana data latihan evolusi baharu untuk pembelajaran diselia dan data keutamaan untuk pembelajaran pengukuhan melalui pembelajaran pengaktifan.

- Pembelajaran:

Pembelajaran diselia.

- Fasa - DPO: Untuk melaksanakan pembelajaran peneguhan luar talian dengan lebih berkesan, data pilihan dibahagikan kepada serpihan yang berbeza dan model dipertingkatkan langkah demi langkah.

- RLEIF: Menggunakan kaedah yang menggabungkan model ganjaran kualiti arahan (IRM) dan model ganjaran penyeliaan proses (PRM) untuk mencapai ketepatan yang lebih tepat dalam pembelajaran pengukuhan dalam talian.

Perkara terakhir yang saya ingin katakan ialah sebarang spekulasi adalah sia-sia, mari kita nantikan kemunculan semula WizardLM-2.

Atas ialah kandungan terperinci WizardLM-2, yang 'sangat hampir dengan GPT-4', telah ditarik balik dengan segera oleh Microsoft.. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

Ramalan Harga Worldcoin (WLD) 2025-2031: Adakah WLD akan mencapai $ 4 menjelang 2031?

Apr 21, 2025 pm 02:42 PM

Ramalan Harga Worldcoin (WLD) 2025-2031: Adakah WLD akan mencapai $ 4 menjelang 2031?

Apr 21, 2025 pm 02:42 PM

Worldcoin (WLD) menonjol dalam pasaran cryptocurrency dengan mekanisme pengesahan biometrik dan perlindungan privasi yang unik, menarik perhatian banyak pelabur. WLD telah melakukan yang luar biasa di kalangan altcoin dengan teknologi inovatifnya, terutamanya dalam kombinasi dengan teknologi kecerdasan buatan terbuka. Tetapi bagaimanakah aset digital akan berkelakuan dalam beberapa tahun akan datang? Mari kita meramalkan harga masa depan WLD bersama -sama. Ramalan harga WLD 2025 dijangka mencapai pertumbuhan yang signifikan di WLD pada tahun 2025. Analisis pasaran menunjukkan bahawa harga WLD purata boleh mencapai $ 1.31, dengan maksimum $ 1.36. Walau bagaimanapun, dalam pasaran beruang, harga mungkin jatuh ke sekitar $ 0.55. Harapan pertumbuhan ini disebabkan terutamanya oleh WorldCoin2.

Apakah yang dimaksudkan dengan transaksi rantaian rantaian? Apakah urus niaga salib?

Apr 21, 2025 pm 11:39 PM

Apakah yang dimaksudkan dengan transaksi rantaian rantaian? Apakah urus niaga salib?

Apr 21, 2025 pm 11:39 PM

Pertukaran yang menyokong urus niaga rantaian: 1. Binance, 2. Uniswap, 3 Sushiswap, 4. Kewangan Curve, 5. Thorchain, 6. 1 inci Pertukaran, 7.

'Black Monday Sell' adalah hari yang sukar untuk industri cryptocurrency

Apr 21, 2025 pm 02:48 PM

'Black Monday Sell' adalah hari yang sukar untuk industri cryptocurrency

Apr 21, 2025 pm 02:48 PM

Jatuh di pasaran cryptocurrency telah menyebabkan panik di kalangan pelabur, dan Dogecoin (Doge) telah menjadi salah satu kawasan terkena paling sukar. Harganya jatuh dengan ketara, dan jumlah nilai kunci kewangan yang terdesentralisasi (DEFI) (TVL) juga menyaksikan penurunan yang ketara. Gelombang jualan "Black Monday" menyapu pasaran cryptocurrency, dan Dogecoin adalah yang pertama dipukul. Defitvlnya jatuh ke tahap 2023, dan harga mata wang jatuh 23.78% pada bulan lalu. Defitvl Dogecoin jatuh ke tahap rendah $ 2.72 juta, terutamanya disebabkan oleh penurunan 26.37% dalam indeks nilai SOSO. Platform defi utama lain, seperti DAO dan Thorchain yang membosankan, TVL juga menurun sebanyak 24.04% dan 20.

Aavenomics adalah cadangan untuk mengubah suai token protokol AAVE dan memperkenalkan pembelian semula token, yang telah mencapai bilangan kuorum orang.

Apr 21, 2025 pm 06:24 PM

Aavenomics adalah cadangan untuk mengubah suai token protokol AAVE dan memperkenalkan pembelian semula token, yang telah mencapai bilangan kuorum orang.

Apr 21, 2025 pm 06:24 PM

Aavenomics adalah cadangan untuk mengubah token protokol AAVE dan memperkenalkan repos token, yang telah melaksanakan kuorum untuk Aavedao. Marc Zeller, pengasas Rantaian Projek AAVE (ACI), mengumumkan ini pada X, dengan menyatakan bahawa ia menandakan era baru untuk perjanjian itu. Marc Zeller, pengasas Inisiatif Rantaian AAVE (ACI), mengumumkan pada X bahawa cadangan aavenomik termasuk mengubah token protokol AAVE dan memperkenalkan repos token, telah mencapai kuorum untuk Aavedao. Menurut Zeller, ini menandakan era baru untuk perjanjian itu. Ahli -ahli Aavedao mengundi untuk menyokong cadangan itu, yang 100 seminggu pada hari Rabu

Kedudukan pertukaran leverage dalam lingkaran mata wang Cadangan terkini sepuluh pertukaran leverage dalam lingkaran mata wang

Apr 21, 2025 pm 11:24 PM

Kedudukan pertukaran leverage dalam lingkaran mata wang Cadangan terkini sepuluh pertukaran leverage dalam lingkaran mata wang

Apr 21, 2025 pm 11:24 PM

Platform yang mempunyai prestasi cemerlang dalam perdagangan, keselamatan dan pengalaman pengguna yang dimanfaatkan pada tahun 2025 adalah: 1. Okx, sesuai untuk peniaga frekuensi tinggi, menyediakan sehingga 100 kali leverage; 2. Binance, sesuai untuk peniaga berbilang mata wang di seluruh dunia, memberikan 125 kali leverage tinggi; 3. Gate.io, sesuai untuk pemain derivatif profesional, menyediakan 100 kali leverage; 4. Bitget, sesuai untuk orang baru dan peniaga sosial, menyediakan sehingga 100 kali leverage; 5. Kraken, sesuai untuk pelabur mantap, menyediakan 5 kali leverage; 6. Bybit, sesuai untuk penjelajah altcoin, menyediakan 20 kali leverage; 7. Kucoin, sesuai untuk peniaga kos rendah, menyediakan 10 kali leverage; 8. Bitfinex, sesuai untuk bermain senior

Apakah platform perdagangan blockchain hibrid?

Apr 21, 2025 pm 11:36 PM

Apakah platform perdagangan blockchain hibrid?

Apr 21, 2025 pm 11:36 PM

Cadangan untuk memilih pertukaran cryptocurrency: 1. Untuk keperluan kecairan, keutamaan adalah Binance, Gate.io atau Okx, kerana kedalaman pesanannya dan rintangan volatilitas yang kuat. 2. Pematuhan dan Keselamatan, Coinbase, Kraken dan Gemini mempunyai sokongan pengawalseliaan yang ketat. 3. Fungsi inovatif, reka bentuk derivatif Kucoin yang lembut dan Bybit sesuai untuk pengguna lanjutan.

Sepuluh cadangan platform percuma untuk data masa nyata mengenai pasaran bulatan mata wang dikeluarkan

Apr 22, 2025 am 08:12 AM

Sepuluh cadangan platform percuma untuk data masa nyata mengenai pasaran bulatan mata wang dikeluarkan

Apr 22, 2025 am 08:12 AM

Platform data cryptocurrency yang sesuai untuk pemula termasuk coinmarketcap dan sangkakala bukan kecil. 1. CoinMarketCap menyediakan harga masa nyata global, nilai pasaran, dan kedudukan volum perdagangan untuk keperluan analisis pemula dan asas. 2. Petikan bukan kecil menyediakan antara muka yang mesra Cina, sesuai untuk pengguna Cina untuk cepat menyaring projek berpotensi berisiko rendah.

Platform Pertukaran Cryptocurrency Top 10 senarai pertukaran mata wang digital terbesar di dunia

Apr 21, 2025 pm 07:15 PM

Platform Pertukaran Cryptocurrency Top 10 senarai pertukaran mata wang digital terbesar di dunia

Apr 21, 2025 pm 07:15 PM

Pertukaran memainkan peranan penting dalam pasaran cryptocurrency hari ini. Mereka bukan sahaja platform untuk pelabur untuk berdagang, tetapi juga sumber kecairan pasaran dan penemuan harga. Pertukaran mata wang maya terbesar di dunia di kalangan sepuluh teratas, dan pertukaran ini bukan sahaja jauh ke hadapan dalam jumlah dagangan, tetapi juga mempunyai kelebihan mereka sendiri dalam pengalaman pengguna, perkhidmatan keselamatan dan inovatif. Pertukaran yang atas senarai biasanya mempunyai pangkalan pengguna yang besar dan pengaruh pasaran yang luas, dan jumlah dagangan dan jenis aset mereka sering sukar dicapai oleh bursa lain.