Peranti teknologi

Peranti teknologi

AI

AI

Cabar OpenAI, senjata rahsia yang dibangunkan sendiri oleh Microsoft dengan 500 bilion parameter terdedah! Bekas eksekutif Google DeepMind mengetuai pasukan

Cabar OpenAI, senjata rahsia yang dibangunkan sendiri oleh Microsoft dengan 500 bilion parameter terdedah! Bekas eksekutif Google DeepMind mengetuai pasukan

Cabar OpenAI, senjata rahsia yang dibangunkan sendiri oleh Microsoft dengan 500 bilion parameter terdedah! Bekas eksekutif Google DeepMind mengetuai pasukan

Tanpa OpenAI, Microsoft juga boleh menjadi peneraju dalam AI!

Maklumat media asing mengumumkan bahawa Microsoft sedang membangunkan model berskala besar pertamanya secara dalaman dengan 500 bilion parameter, MAl-1.

Ini kebetulan adalah masa untuk Nadella mengetuai pasukan untuk membuktikan dirinya.

Selepas melabur lebih daripada 10 bilion dolar AS dalam OpenAI, Microsoft memperoleh hak untuk menggunakan model termaju GPT-3.5/GPT-4, tetapi selepas semua, ia bukan penyelesaian jangka panjang.

Malah, terdapat khabar angin bahawa Microsoft telah dikurangkan kepada jabatan IT OpenAI.

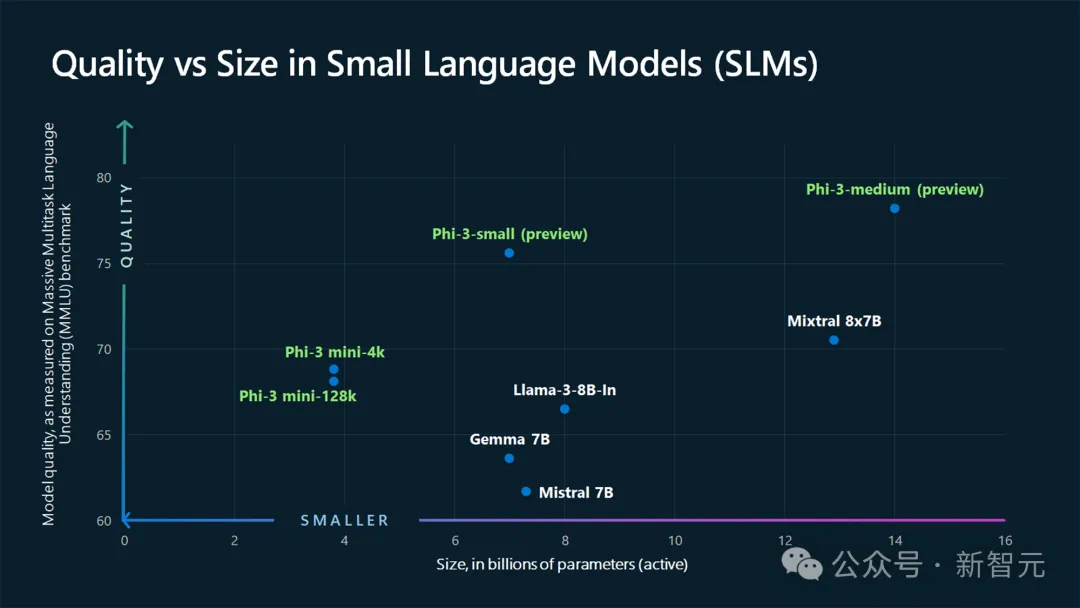

Pada tahun lalu, seperti yang semua orang tahu, penyelidikan Microsoft terhadap LLM telah tertumpu terutamanya pada kemas kini phi berskala kecil, seperti sumber terbuka Phi-3.

Mengenai pengkhususan dalam model besar, kecuali untuk siri Turing, Microsoft tidak mendedahkan sebarang berita dalaman.

Baru hari ini, Ketua Pegawai Teknologi Microsoft Kevin Scott mengesahkan bahawa model besar MAI itu memang sedang dibangunkan.

Jelas sekali, rancangan rahsia Microsoft untuk menyediakan model besar adalah untuk membangunkan LLM baharu yang boleh bersaing dengan model teratas OpenAI, Google dan Anthropic.

Lagipun, Nadella pernah berkata, "Tak kisahlah OpenAI hilang esok."

"Kami mempunyai bakat, kuasa pengkomputeran dan data. Kami tidak kekurangan apa-apa. Kami berada di bawah mereka, di atas mereka dan di sekeliling mereka."

Nampaknya keyakinan Microsoft itu sendiri.

Dibangunkan sendiri 500 bilion MAI-1 model besar

Menurut laporan, model besar MAI-1 diselia oleh Mustafa Suleyman, bekas ketua Google DeepMind.

Perlu dinyatakan bahawa sebelum menyertai Microsoft, Suleyman adalah pengasas dan Ketua Pegawai Eksekutif AI Inflection AI.

diasaskan pada 2022. Dalam masa satu tahun, beliau mengetuai pasukan untuk melancarkan model besar Inflection (kini dikemas kini kepada versi 2.5), dan pembantu AI EQ tinggi Pi dengan lebih satu juta pengguna harian.

Namun, kerana mereka tidak menemui model perniagaan yang sesuai, Suleyman, seorang lagi Lianchuang, dan kebanyakan pekerja menyertai Microsoft pada bulan Mac.

Dalam erti kata lain, Suleyman dan pasukan bertanggungjawab untuk projek baharu MAI-1 ini, dan akan membawa lebih banyak pengalaman dalam model besar yang canggih untuk ini.

Saya masih perlu menyebut bahawa model MAI-1 dibangunkan sendiri oleh Microsoft dan tidak diwarisi daripada model Inflection.

Menurut dua pekerja Microsoft, "MAI-1 berbeza daripada model yang dikeluarkan oleh Inflection sebelum ini." Walau bagaimanapun, data dan teknik latihannya boleh digunakan dalam proses latihan.

Dengan 500 bilion parameter, skala parameter MAI-1 akan jauh melebihi mana-mana model sumber terbuka berskala kecil yang dilatih oleh Microsoft pada masa lalu.

Ini juga bermakna ia memerlukan lebih banyak kuasa dan data pengkomputeran, dan kos latihan juga tinggi.

Untuk melatih model baharu ini, Microsoft telah menempah sejumlah besar pelayan yang dilengkapi dengan GPU NVIDIA dan telah menyusun data latihan untuk mengoptimumkan model.

Termasuk teks yang dijana daripada GPT-4, serta pelbagai set data daripada sumber luaran (data awam Internet).

Saya mahukan kedua-dua model besar dan kecil

Sebagai perbandingan, GPT-4 telah didedahkan mempunyai 1.8 trilion parameter, dan syarikat AI seperti Meta dan Mistral telah mengeluarkan model sumber terbuka yang lebih kecil dengan 70 bilion parameter.

Sudah tentu, Microsoft mengamalkan strategi pelbagai serampang, iaitu model besar dan kecil dibangunkan bersama.

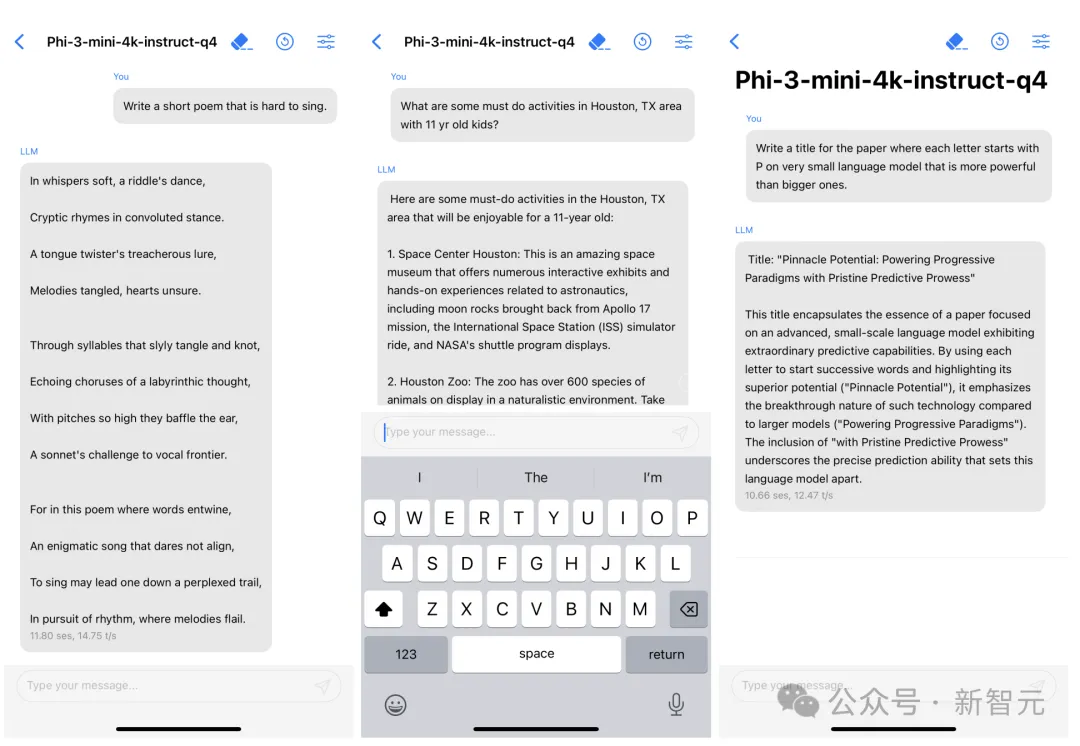

Antaranya, yang paling klasik ialah Phi-3 - model kecil yang boleh dimasukkan ke dalam telefon bimbit, dan saiz minimumnya 3.8B menghancurkan prestasi GPT-3.5.

Phi-3 mini hanya menggunakan kira-kira 1.8GB memori apabila dikuantisasi kepada 4bit, dan boleh menjana 12 token sesaat dengan iPhone14.

Selepas netizen membangkitkan soalan "Bukankah lebih baik untuk melatih AI pada kos yang lebih rendah?", Kevin Scott menjawab:

Ini bukan hubungan sama ada. Dalam banyak aplikasi AI, kami menggunakan gabungan model canggih yang besar dan model yang lebih kecil dan lebih disasarkan. Kami telah melakukan banyak kerja untuk memastikan SLM berfungsi dengan baik pada peranti dan dalam awan. Kami telah mengumpul banyak pengalaman dalam melatih SLM, malah kami telah membuka beberapa kerja ini untuk dipelajari dan digunakan oleh orang lain. Saya fikir gabungan besar dan kecil ini akan berterusan untuk masa hadapan.

Ini menunjukkan bahawa Microsoft bukan sahaja harus membangunkan SLM kos rendah yang boleh disepadukan ke dalam aplikasi dan dijalankan pada peranti mudah alih, tetapi juga membangunkan model AI yang lebih besar dan lebih maju.

Pada masa ini, Microsoft menamakan dirinya sebagai "Syarikat Copilot". Bot sembang Copilot yang dikuasakan oleh AI boleh menyelesaikan tugas seperti menulis e-mel dan meringkaskan dokumen dengan cepat.

Dan pada masa hadapan, di manakah peluang seterusnya?

Mengambil kira kedua-dua model besar dan kecil, ini mencerminkan bahawa Microsoft, yang penuh dengan tenaga inovatif, lebih bersedia untuk meneroka laluan baharu dalam AI.

Tidakkah anda mahu menjadi "IT" untuk OpenAI?

Sekali lagi, MAI-1 yang dibangunkan sendiri tidak bermakna Microsoft akan meninggalkan OpenAI.

Dalam jawatannya pagi ini, Ketua Pegawai Teknologi Kevin Scott pertama kali mengesahkan "persahabatan" yang kukuh antara Microsoft dan OpenAI selama lima tahun.

Kami telah membina superkomputer berskala besar untuk rakan kongsi kami OpenAI untuk melatih model AI termaju. Kemudian, kedua-dua syarikat akan menggunakan model tersebut pada produk dan perkhidmatan mereka sendiri untuk memberi manfaat kepada lebih ramai orang.

Selain itu, setiap generasi baru superkomputer akan lebih berkuasa daripada generasi sebelumnya, jadi setiap model canggih yang dilatih oleh OpenAI akan lebih maju daripada yang terakhir.

Kami akan meneruskan perjalanan ini - membina komputer super yang lebih berkuasa secara berterusan supaya OpenAI boleh melatih model yang menerajui seluruh industri. Kerjasama kami akan memberi impak yang semakin meningkat.

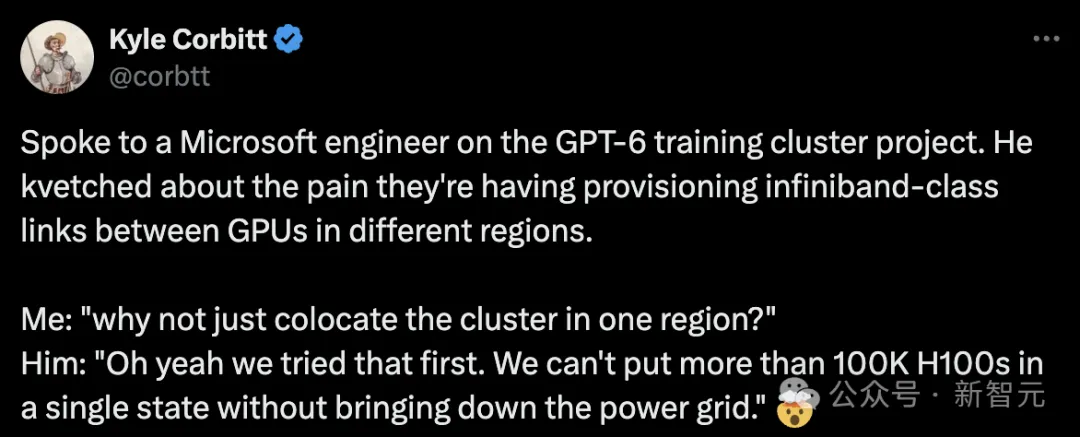

Beberapa masa lalu, media asing mendedahkan bahawa Microsoft dan OpenAI telah bergabung tenaga untuk membina superkomputer AI "Stargate" dan akan membelanjakan sehingga 115 bilion dolar AS.

Dikatakan superkomputer akan dilancarkan seawal 2028 dan diperluaskan lagi sebelum 2030.

Termasuk sebelum ini, jurutera Microsoft menyampaikan berita kepada usahawan Kyle Corbitt bahawa Microsoft sedang membina 100,000 H100 secara intensif untuk OpenAI untuk melatih GPT-6.

Terdapat pelbagai tanda bahawa kerjasama antara Microsoft dan OpenAI hanya akan menjadi lebih kukuh.

Selain itu, Scott juga berkata, "Selain kerjasama dengan OpenAI, Microsoft telah membenarkan MSR dan pelbagai pasukan produk membangunkan model AI selama bertahun-tahun."

Model AI telah menembusi hampir semua produk, perkhidmatan dan operasi Microsoft. Pasukan juga kadangkala perlu melakukan kerja penyesuaian, sama ada melatih model dari awal atau memperhalusi model sedia ada.

Akan ada lebih banyak situasi serupa pada masa hadapan.

Sesetengah model ini dinamakan Turing, MAI, dsb., dan ada yang dinamakan Phi, dan kami telah menjadikannya sumber terbuka.

Walaupun ekspresi saya mungkin tidak begitu dramatik, ia adalah realiti. Bagi kami geeks, ini adalah realiti yang sangat menarik memandangkan betapa kompleksnya semuanya dalam amalan.

Menyahsulit model "Turing"

Selain model siri MAI dan Phi, nama kod "Turing" ialah pelan yang dimulakan secara dalaman oleh Microsoft pada 2017, bertujuan untuk mencipta model besar dan menggunakannya kepada semua barisan produk tengah.

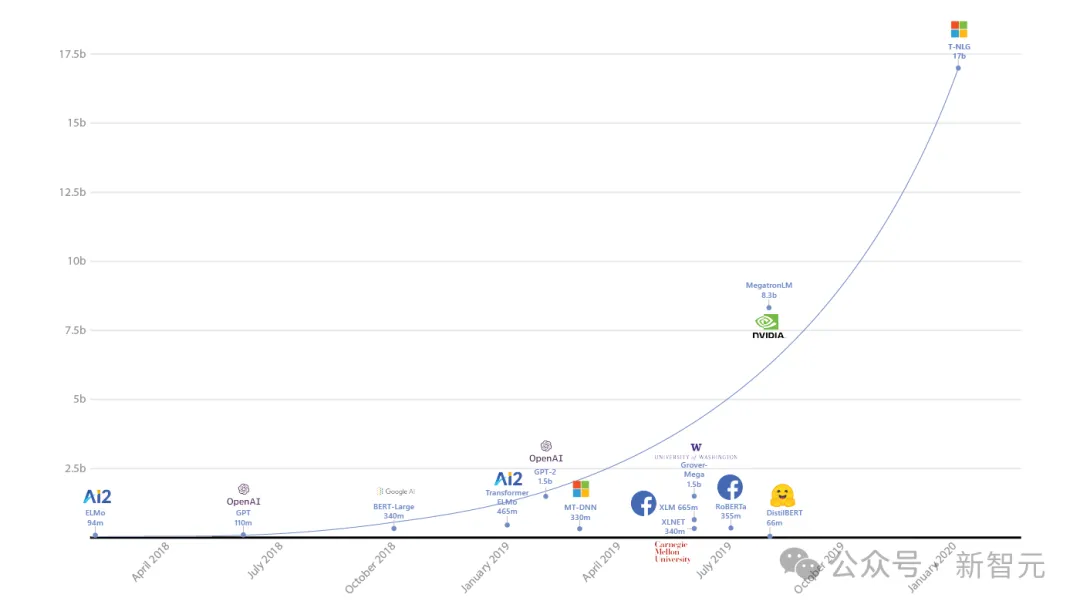

Selepas 3 tahun penyelidikan dan pembangunan, mereka mengeluarkan 17 bilion parameter model T-NLG buat kali pertama pada 2020, mencatatkan rekod untuk skala parameter terbesar LLM dalam sejarah pada masa itu.

Pada tahun 2021, Microsoft bekerjasama dengan NVIDIA untuk mengeluarkan 530 bilion parameter Megatron-Turing (MT-NLP), yang telah menunjukkan ketepatan "tak tertandingi" dalam pelbagai tugas bahasa semula jadi.

Pada tahun yang sama, model bahasa visual Turing Bletchley mula dikeluarkan.

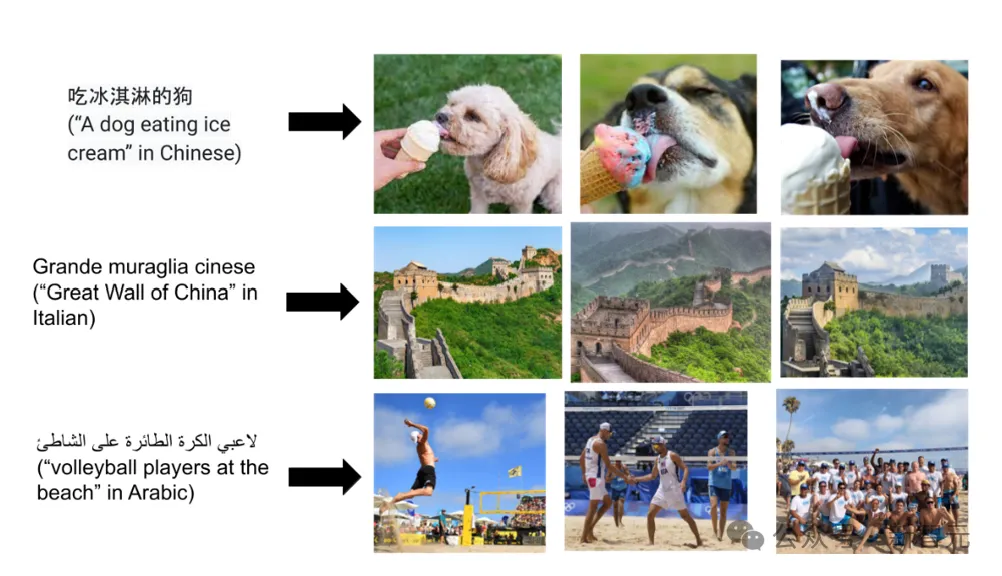

Pada Ogos tahun lalu, model berbilang modal ini telah diulang kepada versi V3, dan telah disepadukan ke dalam produk berkaitan seperti Bing untuk memberikan pengalaman carian imej yang lebih baik.

Selain itu, Microsoft turut mengeluarkan "Model Perwakilan Bahasa Universal Turing" pada tahun 2021 dan 2022 - versi T-ULRv5 dan T-ULRv6.

Pada masa ini, model "Turing" telah digunakan dalam SmartFind dalam Word dan Question Matching dalam Xbox.

Terdapat juga model resolusi super imej Turing Image Super-Resolution (T-ISR) yang dibangunkan oleh pasukan, yang telah digunakan dalam Peta Bing dan boleh meningkatkan kualiti imej udara untuk pengguna global.

Pada masa ini, aplikasi khusus model MAI-1 baharu masih belum ditentukan dan bergantung kepada prestasinya.

Dengan cara ini, maklumat lanjut tentang MAI-1 mungkin ditunjukkan buat kali pertama di Persidangan Pembangun Microsoft Build dari 21 hingga 23 Mei.

Langkah seterusnya ialah menunggu keluaran MAI-1.

Atas ialah kandungan terperinci Cabar OpenAI, senjata rahsia yang dibangunkan sendiri oleh Microsoft dengan 500 bilion parameter terdedah! Bekas eksekutif Google DeepMind mengetuai pasukan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

AI Hentai Generator

Menjana ai hentai secara percuma.

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

iPhone 16 Pro dan iPhone 16 Pro Max rasmi dengan kamera baharu, A18 Pro SoC dan skrin yang lebih besar

Sep 10, 2024 am 06:50 AM

iPhone 16 Pro dan iPhone 16 Pro Max rasmi dengan kamera baharu, A18 Pro SoC dan skrin yang lebih besar

Sep 10, 2024 am 06:50 AM

Apple akhirnya telah menanggalkan penutup model iPhone mewah baharunya. iPhone 16 Pro dan iPhone 16 Pro Max kini hadir dengan skrin yang lebih besar berbanding dengan model generasi terakhir mereka (6.3-in pada Pro, 6.9-in pada Pro Max). Mereka mendapat Apple A1 yang dipertingkatkan

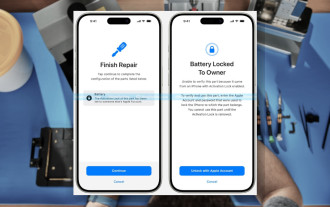

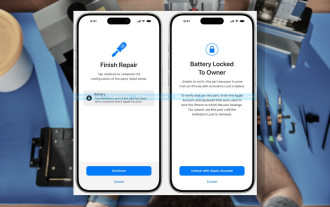

Kunci Pengaktifan bahagian iPhone dikesan dalam iOS 18 RC — mungkin merupakan pukulan terbaharu Apple ke kanan untuk dibaiki dijual di bawah nama perlindungan pengguna

Sep 14, 2024 am 06:29 AM

Kunci Pengaktifan bahagian iPhone dikesan dalam iOS 18 RC — mungkin merupakan pukulan terbaharu Apple ke kanan untuk dibaiki dijual di bawah nama perlindungan pengguna

Sep 14, 2024 am 06:29 AM

Awal tahun ini, Apple mengumumkan bahawa ia akan mengembangkan ciri Kunci Pengaktifannya kepada komponen iPhone. Ini memautkan komponen iPhone individu secara berkesan, seperti bateri, paparan, pemasangan FaceID dan perkakasan kamera ke akaun iCloud,

Kunci Pengaktifan bahagian iPhone mungkin merupakan pukulan terbaharu Apple ke kanan untuk dibaiki dijual dengan berselindung di bawah perlindungan pengguna

Sep 13, 2024 pm 06:17 PM

Kunci Pengaktifan bahagian iPhone mungkin merupakan pukulan terbaharu Apple ke kanan untuk dibaiki dijual dengan berselindung di bawah perlindungan pengguna

Sep 13, 2024 pm 06:17 PM

Awal tahun ini, Apple mengumumkan bahawa ia akan mengembangkan ciri Kunci Pengaktifannya kepada komponen iPhone. Ini memautkan komponen iPhone individu secara berkesan, seperti bateri, paparan, pemasangan FaceID dan perkakasan kamera ke akaun iCloud,

Platform Perdagangan Platform Perdagangan Rasmi dan Alamat Pemasangan Rasmi

Feb 13, 2025 pm 07:33 PM

Platform Perdagangan Platform Perdagangan Rasmi dan Alamat Pemasangan Rasmi

Feb 13, 2025 pm 07:33 PM

Artikel ini memperincikan langkah -langkah untuk mendaftar dan memuat turun aplikasi terkini di laman web rasmi Gate.io. Pertama, proses pendaftaran diperkenalkan, termasuk mengisi maklumat pendaftaran, mengesahkan nombor e -mel/telefon bimbit, dan menyelesaikan pendaftaran. Kedua, ia menerangkan cara memuat turun aplikasi Gate.io pada peranti iOS dan peranti Android. Akhirnya, petua keselamatan ditekankan, seperti mengesahkan kesahihan laman web rasmi, membolehkan pengesahan dua langkah, dan berjaga-jaga terhadap risiko phishing untuk memastikan keselamatan akaun pengguna dan aset.

LCD iPhone menjadi sejarah! Apple akan ditinggalkan sepenuhnya: penghujung era

Sep 03, 2024 pm 09:38 PM

LCD iPhone menjadi sejarah! Apple akan ditinggalkan sepenuhnya: penghujung era

Sep 03, 2024 pm 09:38 PM

Menurut laporan media yang memetik sumber, Apple akan meninggalkan sepenuhnya penggunaan skrin LCD (paparan kristal cecair) dalam iPhone, dan semua iPhone yang dijual tahun depan dan seterusnya akan menggunakan paparan OLED (diod pemancar cahaya organik). Apple pertama kali menggunakan paparan OLED pada iPhoneX pada tahun 2017. Sejak itu, Apple telah mempopularkan paparan OLED dalam model pertengahan hingga tinggi, tetapi siri iPhone SE masih menggunakan skrin LCD. Walau bagaimanapun, iPhone dengan skrin LCD akan menjadi sejarah Orang yang biasa dengan perkara itu berkata bahawa Apple telah mula memesan paparan OLED daripada BOE dan LG untuk iPhone SE generasi baharu. Samsung kini memegang kira-kira separuh daripada pasaran paparan OLED iPhone, LG

Bagaimana cara memasang dan mendaftarkan aplikasi untuk membeli duit syiling maya?

Feb 21, 2025 pm 06:00 PM

Bagaimana cara memasang dan mendaftarkan aplikasi untuk membeli duit syiling maya?

Feb 21, 2025 pm 06:00 PM

Abstrak: Artikel ini bertujuan untuk membimbing pengguna tentang cara memasang dan mendaftarkan aplikasi perdagangan mata wang maya pada peranti Apple. Apple mempunyai peraturan yang ketat mengenai aplikasi mata wang maya, jadi pengguna perlu mengambil langkah khas untuk menyelesaikan proses pemasangan. Artikel ini akan menghuraikan langkah -langkah yang diperlukan, termasuk memuat turun aplikasi, membuat akaun, dan mengesahkan identiti anda. Berikutan panduan artikel ini, pengguna boleh dengan mudah menyediakan aplikasi perdagangan mata wang maya pada peranti Apple mereka dan mula berdagang.

Anbi App Rasmi Muat turun v2.96.2 Pemasangan versi terkini ANBI Versi Android Rasmi

Mar 04, 2025 pm 01:06 PM

Anbi App Rasmi Muat turun v2.96.2 Pemasangan versi terkini ANBI Versi Android Rasmi

Mar 04, 2025 pm 01:06 PM

Langkah Pemasangan Rasmi Binance: Android perlu melawat laman web rasmi untuk mencari pautan muat turun, pilih versi Android untuk memuat turun dan memasang; Semua harus memberi perhatian kepada perjanjian melalui saluran rasmi.

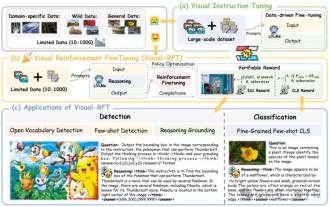

Melampaui SFT, rahsia di belakang O1/DeepSeek-R1 juga boleh digunakan dalam model besar multimodal

Mar 12, 2025 pm 01:03 PM

Melampaui SFT, rahsia di belakang O1/DeepSeek-R1 juga boleh digunakan dalam model besar multimodal

Mar 12, 2025 pm 01:03 PM

Penyelidik dari Universiti Shanghai Jiaoto, Shanghai Ailab dan Universiti Cina Hong Kong telah melancarkan projek sumber terbuka Visual-RFT (Visual Fine Fine Tuning), yang hanya memerlukan sedikit data untuk meningkatkan prestasi model bahasa besar visual (LVLM). Visual-RFT bijak menggabungkan pendekatan pembelajaran tetulang berasaskan peraturan DeepSeek-R1 dengan paradigma penalaan Fine-Penalaan Terbuka (RFT) OpenAI, berjaya memperluaskan pendekatan ini dari medan teks ke medan visual. Dengan merancang ganjaran peraturan yang sepadan untuk tugas-tugas seperti subkategori visual dan pengesanan objek, Visual-RFT mengatasi batasan kaedah DeepSeek-R1 yang terhad kepada teks, penalaran matematik dan bidang lain, menyediakan cara baru untuk latihan LVLM. Vis