solr4.4.0 集成 carrot2 支持中文和添加自己的中文分词器的方法

默认 carrot2中是支持中文的,但是需要一个参数进行指定 carrot.lang= CHINESE_SIMPLIFIED carrot2支持的语言可以参考http://doc.carrot2.org/#div.attribute.lingo.MultilingualClustering.defaultLanguage 但是默认, carrot2使用的分词类是org.apache.luc

默认 carrot2中是支持中文的,但是需要一个参数进行指定

carrot.lang=CHINESE_SIMPLIFIED

carrot2支持的语言可以参考http://doc.carrot2.org/#div.attribute.lingo.MultilingualClustering.defaultLanguage

但是默认,carrot2使用的分词类是 org.apache.lucene.analysis.cn.smart.SentenceTokenizer,这是看 carrot源代码找到的源码如下(在org.apache.solr.handler.clustering.carrot2.LuceneCarrot2TokenizerFactory类中)

private ChineseTokenizer() throws Exception {

this.tempCharSequence = new MutableCharArray(new char[0]);

// As Smart Chinese is not available during compile time,

// we need to resort to reflection.

final Class> tokenizerClass = ReflectionUtils.classForName(

"org.apache.lucene.analysis.cn.smart.SentenceTokenizer", false);

this.sentenceTokenizer = (Tokenizer) tokenizerClass.getConstructor(

Reader.class).newInstance((Reader) null);

this.tokenFilterClass = ReflectionUtils.classForName(

"org.apache.lucene.analysis.cn.smart.WordTokenFilter", false);

}

如果,没有这个类,carrot2默认就会使用一个 ExtendedWhitespaceTokenizer 使用空格进行切词,所以如果要使用carrot2自己的中文切词,需要加入 lucene-analyzers-smartcn-4.4.0.jar

当然也可以使用自己的分词包,比如IK等等,把上述源码替换成相应的类即可。

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

使命召喚戰區手遊怎麼設定中文

Mar 22, 2024 am 08:41 AM

使命召喚戰區手遊怎麼設定中文

Mar 22, 2024 am 08:41 AM

使命召喚戰區作為全新上線的一款手遊,有很多的玩家都非常的好奇要怎麼樣才能夠將這款遊戲的語言設定為中文,其實非常的簡單,玩家只需要下載中文的語言包,隨後進行使用就可以進行修改了,詳細的內容可以在這篇中文設定方法介紹之中進行了解,讓我們一起來看看吧。使命召喚戰區手遊怎麼設定中文1、先進入遊戲,點選介面右上角的設定圖示。 2.在出現的選單列中,找到【Download】這個選項並且點選。 3.在這個頁面中選擇【SIMPLIFIEDCHINESE】(簡體中文),就可以對簡體中文的安裝包進行下載了。 4.回到設

如何在PHP Dompdf中正確顯示中文字符

Mar 05, 2024 pm 01:03 PM

如何在PHP Dompdf中正確顯示中文字符

Mar 05, 2024 pm 01:03 PM

如何在PHPDompdf中正確顯示中文字元在使用PHPDompdf產生PDF檔案時,遇到中文字元顯示亂碼的問題是一個常見的挑戰。這是因為Dompdf預設使用的字體庫中不包含中文字元集。為了正確顯示中文字符,我們需要手動設定Dompdf的字體,並確保選擇支援中文字符的字體。以下是一些具體的步驟和程式碼範例來解決這個問題:第一步:下載中文字體檔案首先,我們需要

VSCode 設定中文:完全指南

Mar 25, 2024 am 11:18 AM

VSCode 設定中文:完全指南

Mar 25, 2024 am 11:18 AM

VSCode設定中文:完整指南在軟體開發中,VisualStudioCode(簡稱VSCode)是一個常用的整合開發環境。對於使用中文的開發者來說,將VSCode設定為中文介面可以提升工作效率。本文將為大家提供一個完整的指南,詳細介紹如何將VSCode設定為中文介面,並提供具體的程式碼範例。第一步:下載安裝語言包開啟VSCode後,點選左

修復PHP Dompdf中文亂碼的有效途徑

Mar 05, 2024 pm 04:45 PM

修復PHP Dompdf中文亂碼的有效途徑

Mar 05, 2024 pm 04:45 PM

標題:修復PHPDompdf中文亂碼的有效途徑在使用PHPDompdf產生PDF文件時,中文字元出現亂碼是一個常見的問題。這問題通常源自於Dompdf預設不支援中文字元集,導致中文內容無法正確顯示。為了解決這個問題,我們需要採取一些有效的途徑來修復PHPDompdf中文亂碼的問題。 1.使用自訂字型檔案一個解決Dompdf中文亂碼問題的有效方法是使用

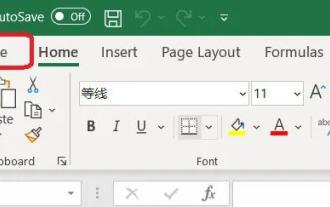

Excel表格怎麼設定顯示中文? Excel切換中文操作教學

Mar 14, 2024 pm 03:28 PM

Excel表格怎麼設定顯示中文? Excel切換中文操作教學

Mar 14, 2024 pm 03:28 PM

Excel表格是現在很多人都在使用的辦公室軟體之一,有些使用者因為電腦是win11系統,因此顯示的是英文介面,想要切換成中文介面,但是不知道該怎麼操作,針對這個問題,本期小編就來為廣大用戶們回答,一起來看看今日軟體教學所分享的內容。 Excel切換中文操作教學: 1、進入軟體,點選頁面上方工具列左側的「File」選項。 2、在下方給出的選項中選擇「options」。 3、進入新介面後,點選左側的「language」選項

米家怎麼加電視

Mar 25, 2024 pm 05:00 PM

米家怎麼加電視

Mar 25, 2024 pm 05:00 PM

許多用戶在現代生活中越來越青睞小米智慧家庭互聯的電子生態,那麼連接米家APP後,你就可以輕鬆用手機來控制連接設備,但是很多用戶們還不知如何將自己的家居添加米家app中,那麼這篇教學攻略將為大家帶來具體連接方法步驟攻略,希望能幫助到各位有需要的小夥伴們。 1.下載米家APP後,建立或登入小米帳號。 2.添加方法:當全新的設備通電後,將手機靠近設備並打開小米電視,正常情況下會彈出連接提示,選擇“確定”即進入設備連接流程。若無提示彈出,也可以手動新增設備,方法是:進入智慧型家庭APP後,點選左下方第1

wwe2k24會有中文嗎

Mar 13, 2024 pm 04:40 PM

wwe2k24會有中文嗎

Mar 13, 2024 pm 04:40 PM

《WWE2K24》乃由VisualConcepts傾力打造的競速運動遊,已於2024年3月9日正式問世。此款遊戲倍受讚譽,許多玩家熱切關注其是否設有中文版。遺憾的是,迄今為止,《WWE2K24》尚未推出中文語言版本。 wwe2k24會有中文嗎答:目前不支援中文。 WWE2K24在Steam國區的標準版售價為199元,豪華版為329元,紀念版為395元。遊戲的配置需求較高,無論處理器、顯示卡或運行記憶體等方面,均有一定標準。官方推薦配置以及最低配置介紹:

balatro設定中文方法

Mar 07, 2024 pm 09:10 PM

balatro設定中文方法

Mar 07, 2024 pm 09:10 PM

balatro這款遊戲的預設語言是英語,但玩家可以在Steam中設定語言為中文,有些玩家還不知道要怎麼設置,下面就帶給大家balatro設定為中文的方法。 balatro怎麼設定中文1、先開啟Steam,點選庫,找到balatro,右鍵選擇屬性。 2.在屬性介面中可以看到語言,點選進入語言設定介面。 3.玩家可以將遊戲的語言設定為簡體中文,也可以設定成其他語言。 4.之後玩家需要重啟Steam,然後進入遊戲就可以看到已經是中文了。以上就是balatro設定中文的方法,還是比較簡單的,玩家可以嘗試