C++在金融人工智慧中的神經網路模型實現

C++適合實現神經網絡,因其效能優異且提供記憶體管理。使用神經網路庫(如TensorFlow或Eigen)可以建立神經網路模型,包括輸入層、隱藏層和輸出層。神經網路透過反向傳播演算法訓練,涉及前向傳播、計算損失、反向傳播和權重更新。在股票價格預測的實戰案例中,可以定義輸入和輸出數據,創建神經網絡,並使用預測函數預測新的股票價格。

C++ 在金融人工智慧中的神經網路模型實作

引言

神經網路是金融人工智慧的重要組成部分,用於預測市場趨勢、優化投資組合和偵測詐欺。本文介紹如何使用 C++ 實作和訓練神經網路模型,並提供一個實戰案例。

C++ 和神經網路庫

C++ 憑藉其高效能和記憶體管理能力非常適合實現神經網路。有多種C++ 神經網路函式庫可用,例如:

- TensorFlow

- #PyTorch

- Eigen

神經網路模型建構

一個基本的神經網路模型包括輸入層、隱藏層和輸出層。每個層由神經元組成,應用權重和偏差對輸入執行線性變換。然後將結果傳遞給激活函數,例如 ReLU 或 sigmoid。

訓練神經網路

神經網路透過反向傳播演算法進行訓練。此過程涉及:

- 前向傳播:輸入通過模型,計算輸出。

- 計算損失:將模型輸出與預期輸出進行比較,計算損失函數的值。

- 反向傳播:計算損失相對於權重和偏差的梯度。

- 更新權重:使用梯度下降演算法更新權重,以最小化損失。

實戰案例:股價預測

考慮一個使用神經網路模型預測股票價格的實戰案例。以下是如何實現:

#include <eigen3/Eigen/Dense>

#include <iostream>

using namespace Eigen;

int main() {

// 定义输入数据

MatrixXd inputs = MatrixXd::Random(100, 10);

// 定义输出数据

MatrixXd outputs = MatrixXd::Random(100, 1);

// 创建和训练神经网络

NeuralNetwork network;

network.AddLayer(10, "relu");

network.AddLayer(1, "linear");

network.Train(inputs, outputs);

// 预测新股票价格

MatrixXd newInput = MatrixXd::Random(1, 10);

MatrixXd prediction = network.Predict(newInput);

std::cout << "Predicted stock price: " << prediction << std::endl;

return 0;

}以上是C++在金融人工智慧中的神經網路模型實現的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

GNN的基礎、前沿和應用

Apr 11, 2023 pm 11:40 PM

GNN的基礎、前沿和應用

Apr 11, 2023 pm 11:40 PM

近年來,圖神經網路(GNN)取得了快速、令人難以置信的進展。圖神經網路又稱為圖深度學習、圖表徵學習(圖表示學習)或幾何深度學習,是機器學習特別是深度學習領域成長最快的研究主題。本次分享的題目為《GNN的基礎、前沿和應用》,主要介紹由吳凌飛、崔鵬、裴健、趙亮幾位學者牽頭編撰的綜合性書籍《圖神經網絡基礎、前沿與應用》中的大致內容。一、圖神經網路的介紹1、為什麼要研究圖?圖是一種描述和建模複雜系統的通用語言。圖本身並不複雜,它主要由邊和結點構成。我們可以用結點表示任何我們想要建模的物體,可以用邊表示兩

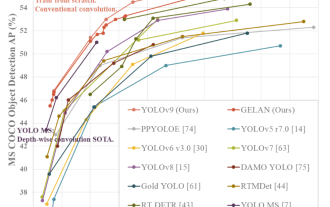

YOLO不死! YOLOv9出爐:性能速度SOTA~

Feb 26, 2024 am 11:31 AM

YOLO不死! YOLOv9出爐:性能速度SOTA~

Feb 26, 2024 am 11:31 AM

如今的深度學習方法專注於設計最適合的目標函數,以使模型的預測結果與實際情況最接近。同時,必須設計一個合適的架構,以便為預測取得足夠的資訊。現有方法忽略了一個事實,當輸入資料經過逐層特徵提取和空間變換時,大量資訊將會遺失。本文將深入探討資料透過深度網路傳輸時的重要問題,即資訊瓶頸和可逆函數。基於此提出了可編程梯度資訊(PGI)的概念,以應對深度網路實現多目標所需的各種變化。 PGI可以為目標任務提供完整的輸入訊息,以計算目標函數,從而獲得可靠的梯度資訊以更新網路權重。此外設計了一種新的輕量級網路架

一文通覽自動駕駛三大主流晶片架構

Apr 12, 2023 pm 12:07 PM

一文通覽自動駕駛三大主流晶片架構

Apr 12, 2023 pm 12:07 PM

目前主流的AI晶片主要分為三類,GPU、FPGA、ASIC。 GPU、FPGA皆是前期較成熟的晶片架構,屬於通用型晶片。 ASIC屬於為AI特定場景定制的晶片。業界已經確認CPU不適用於AI計算,但在AI應用領域也是不可或缺。 GPU方案GPU與CPU的架構比較CPU遵循的是馮諾依曼架構,其核心是儲存程式/資料、序列順序執行。因此CPU的架構中需要大量的空間去放置儲存單元(Cache)和控制單元(Control),相較之下運算單元(ALU)只佔據了很小的一部分,所以CPU在進行大規模平行運算

'B站UP主成功打造全球首個基於紅石的神經網絡在社交媒體引起轟動,得到Yann LeCun的點贊讚賞'

May 07, 2023 pm 10:58 PM

'B站UP主成功打造全球首個基於紅石的神經網絡在社交媒體引起轟動,得到Yann LeCun的點贊讚賞'

May 07, 2023 pm 10:58 PM

在我的世界(Minecraft)中,紅石是一種非常重要的物品。它是遊戲中獨特的材料,開關、紅石火把和紅石塊等能對導線或物體提供類似電流的能量。紅石電路可以為你建造用於控製或激活其他機械的結構,其本身既可以被設計為用於響應玩家的手動激活,也可以反複輸出信號或者響應非玩家引發的變化,如生物移動、物品掉落、植物生長、日夜更替等等。因此,在我的世界中,紅石能夠控制的機械類別極其多,小到簡單機械如自動門、光開關和頻閃電源,大到佔地巨大的電梯、自動農場、小遊戲平台甚至遊戲內建的計算機。近日,B站UP主@

1.3ms耗時!清華最新開源行動裝置神經網路架構 RepViT

Mar 11, 2024 pm 12:07 PM

1.3ms耗時!清華最新開源行動裝置神經網路架構 RepViT

Mar 11, 2024 pm 12:07 PM

论文地址:https://arxiv.org/abs/2307.09283代码地址:https://github.com/THU-MIG/RepViTRepViT在移动端ViT架构中表现出色,展现出显著的优势。接下来,我们将探讨本研究的贡献所在。文中提到,轻量级ViTs通常比轻量级CNNs在视觉任务上表现得更好,这主要归功于它们的多头自注意力模块(MSHA)可以让模型学习全局表示。然而,轻量级ViTs和轻量级CNNs之间的架构差异尚未得到充分研究。在这项研究中,作者们通过整合轻量级ViTs的有效

多路徑多領域通吃! GoogleAI發布多領域學習通用模型MDL

May 28, 2023 pm 02:12 PM

多路徑多領域通吃! GoogleAI發布多領域學習通用模型MDL

May 28, 2023 pm 02:12 PM

面向視覺任務(如影像分類)的深度學習模型,通常使用單一視覺域(如自然影像或電腦生成的影像)的資料進行端到端的訓練。一般情況下,一個為多個領域完成視覺任務的應用程式需要為每個單獨的領域建立多個模型,分別獨立訓練,不同領域之間不共享數據,在推理時,每個模型將處理特定領域的輸入資料。即使是面向不同領域,這些模型之間的早期層的有些特徵都是相似的,所以,對這些模型進行聯合訓練的效率更高。這能減少延遲和功耗,降低儲存每個模型參數的記憶體成本,這種方法稱為多領域學習(MDL)。此外,MDL模型也可以優於單

扛住強風的無人機?加州理工用12分鐘飛行資料教會無人機禦風飛行

Apr 09, 2023 pm 11:51 PM

扛住強風的無人機?加州理工用12分鐘飛行資料教會無人機禦風飛行

Apr 09, 2023 pm 11:51 PM

當風大到可以把傘吹壞的程度,無人機卻穩穩噹噹,就像這樣:禦風飛行是空中飛行的一部分,從大的層面來講,當飛行員駕駛飛機著陸時,風速可能會給他們帶來挑戰;從小的層面來講,陣風也會影響無人機的飛行。目前來看,無人機要么在受控條件下飛行,無風;要么由人類使用遙控器操作。無人機被研究者控制在開闊的天空中編隊飛行,但這些飛行通常是在理想的條件和環境下進行的。然而,要讓無人機自主執行必要但日常的任務,例如運送包裹,無人機必須能夠即時適應風況。為了讓無人機在風中飛行時具有更好的機動性,來自加州理工學院的一組工

對比學習演算法在轉轉的實踐

Apr 11, 2023 pm 09:25 PM

對比學習演算法在轉轉的實踐

Apr 11, 2023 pm 09:25 PM

1 什麼是對比學習1.1 對比學習的定義1.2 對比學習的原理1.3 經典對比學習演算法系列2 對比學習的應用3 對比學習在轉轉的實踐3.1 CL在推薦召回的實踐3.2 CL在轉轉的未來規劃1什麼是對比學習1.1 對比學習的定義對比學習(Contrastive Learning, CL)是近年來AI 領域的熱門研究方向,吸引了眾多研究學者的關注,其所屬的自監督學習方式,更是在ICLR 2020 被Bengio和LeCun 等大佬點名稱為AI 的未來,後陸續登陸NIPS, ACL,