編輯 | X

英偉達(NVIDIA)正與學術研究人員合作,研究手術機器人。

NVIDIA 聯合多倫多大學、加州大學柏克萊分校、蘇黎世聯邦理工學院和喬治亞理工學院的研究人員開發了ORBIT-Surgical,一個訓練機器人的模擬框架,可以提高技術團隊的技能,同時減少外科醫生的認知負擔。 ORBIT-Surgical 是一種基於人工智慧的模擬框架,透過虛擬手術環境和智慧教練系統,實現了高度真實的手術模擬。醫生可以透過與這個系統互動,模擬真實手術的各種情況和複雜性。這種模擬技術不僅可以幫助訓練

「受腹腔鏡手術(又稱為微創手術)訓練課程的啟發,它支援十多種操作,例如抓住像針頭這樣的小物體,從一隻手臂傳遞到另一隻手臂,並高精度地放置它們。模擬平台。

研究人員在NVIDIA GPU上進行訓練強化學習和模仿學習演算法,並使用NVIDIA Omniverse——一個用於開發和部署基於通用場景描述(OpenUSD)的高級3D應用程式和管道的平台,來實現照片級真實感渲染。

ORBIT-Surgical 將在 IEEE 國際機器人與自動化會議 (ICRA) 2024 上發表。

GitHub 開源程式碼:

GitHub 開源程式碼:

ORBIT-Surgical是基於Isaac Orbit建構的機器人學習模組化架構。 Orbit支援各種強化學習和模仿學習庫,其中人工智慧代理人經過訓練可以模仿真實的專家示範。透過使用Orbit,專家可以設計並優化手術程序,並將其轉化為可執行的機器人操作序列。

Isaac Orbit的核心理念是將專家知識轉化為可以自動執行的機器人行為。系統包含以下組件:

1. 資料收集:使用專家進行手術,並記錄其操作過程和決策,以建立訓練資料集。

2. 資料預處理:對採集到的資料進行預處理和特

ORBIT-Surgical是基於Isaac Orbit建構的機器人學習模組化架構。 Orbit支援各種強化學習和模仿學習庫,其中人工智慧代理人經過訓練可以模仿真實的專家示範。透過使用Orbit,專家可以設計並優化手術程序,並將其轉化為可執行的機器人操作序列。

Isaac Orbit的核心理念是將專家知識轉化為可以自動執行的機器人行為。系統包含以下組件:

1. 資料收集:使用專家進行手術,並記錄其操作過程和決策,以建立訓練資料集。

2. 資料預處理:對採集到的資料進行預處理和特此手術框架使開發人員能夠訓練達文西研究套件(da Vinci Research Kit,dVRK)等機器人,使用在NVIDIA RTX GPU 上運行的強化學習和模仿學習框架來操縱剛性和軟物體。

ORBIT-Surgical 引入了十多項外科訓練基準任務,包括單手任務,例如拿起一塊紗布、將分流器插入血管或將縫合針舉到特定位置。它還包括雙手任務,例如將針從一隻手臂遞到另一隻手臂,將螺紋針穿過環形桿,以及將兩隻手臂伸到特定位置,同時避開障礙物。

通过开发利用 GPU 加速和并行化的手术模拟器,该团队能够将机器人的学习速度比现有手术框架提高一个数量级。他们发现,经过训练,机器人数字孪生可以在单个 NVIDIA RTX GPU 上在两小时内完成插入分流器和提起缝合针等任务。

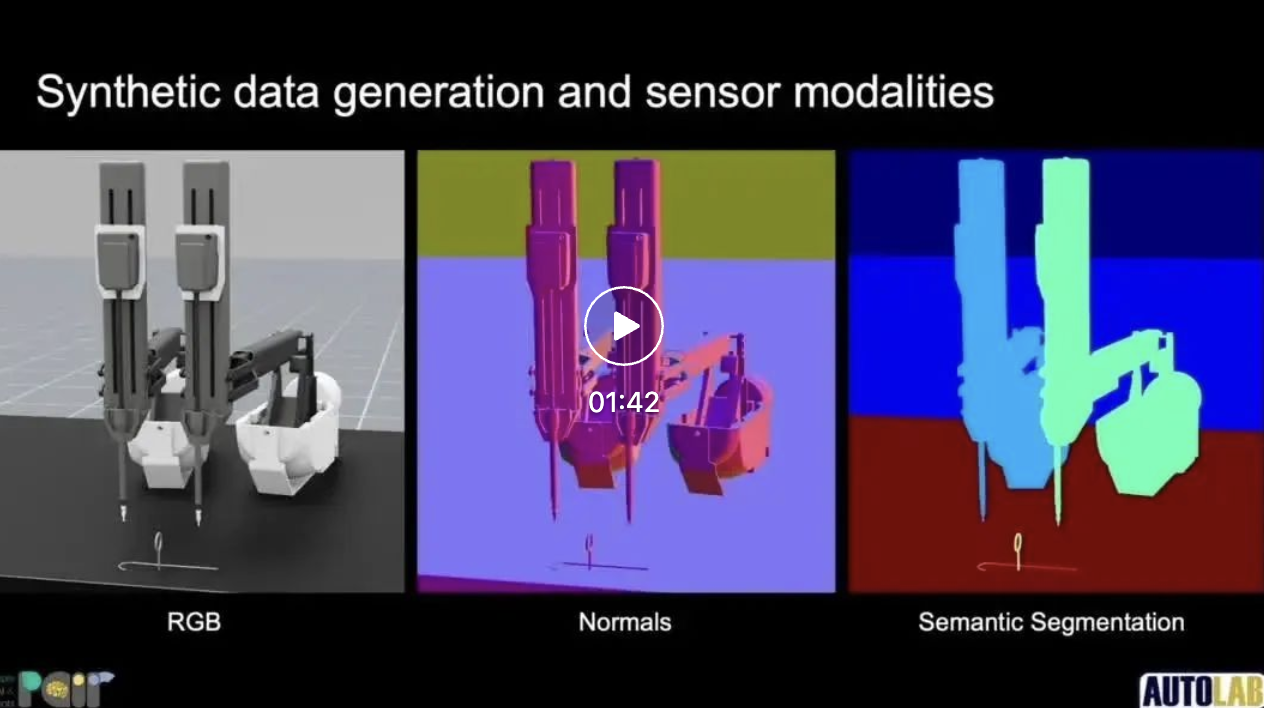

借助 Omniverse 渲染实现的视觉真实感,ORBIT-Surgical 还允许研究人员生成高保真合成数据,这有助于训练 AI 模型执行感知任务,例如在手术室捕获的真实视频中分割手术工具。

该团队的概念验证表明,将模拟和真实数据相结合显著提高了人工智能模型从图像中分割手术针的准确性,有助于减少训练此类模型时对大型、昂贵的现实数据集的需求。

参考内容:https://blogs.nvidia.com/blog/orbit-surgical-robotics-research-icra/

以上是拿紗布、抓針頭,英偉達與多所大學合作,開發手術機器人的詳細內容。更多資訊請關注PHP中文網其他相關文章!