全球首篇!研究近400篇文獻,鵬城實驗室&中大深度解析具身智能

AIxiv專欄是本站發布學術、技術內容的欄位。過去數年,本站AIxiv專欄接收通報了2,000多篇內容,涵蓋全球各大專院校與企業的頂尖實驗室,有效促進了學術交流與傳播。如果您有優秀的工作想要分享,歡迎投稿或聯絡報道。投稿信箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com

論文地址: https://arxiv.org/pdf/2407.06886 -

具身智能Paper List: https://github.com/HCPLab-SYSU/Embed_AI_Paper List: https://github.com/HCPLab-SYSU/Embed_AI_Paperper_List 1. 具身智能的前世今生

具身智能的概念最初由艾倫・圖靈在1950 年建立的具身圖靈測試中提出,旨在確定智能體是否能顯示出不僅限於解決虛擬環境(數位空間)中抽象問題的智慧(智能體是具身智慧的基礎,存在於數位空間和實體世界中,並以各種實體的形式具象化,這些實體不僅包括機器人,還包括其他設備。因此,具身智能的發展被視為一條實現通用人工智慧的基本途徑。深入探討具身智能的複雜性、評估其當前的發展現狀並思考其未來的發展軌跡顯得尤為重要。如今,具身智慧涵蓋了電腦視覺、自然語言處理和機器人技術等多個關鍵技術,其中最具代表性的是

—— 高效且安全地訓練具身智能體的數位空間;(3) 具身感知

具身感知

星” 是以具身為中心的視覺推理和社會智能。如下圖所示,有別於僅僅辨識影像中的物體,具有具身感知能力的智能體必須在物理世界中移動並與環境互動,這需要對三維空間和動態環境有更透徹的理解。具身感知需要具備視覺感知和推理能力,理解場景中的三維關係,並基於視覺訊息預測和執行複雜任務。本綜述從主動視覺感知、3D 視覺定位、視覺語言導航、非視覺感知(觸覺感測器)等方面進行介紹。

具身互動指的是智能體在實體或模擬空間中與人類和環境互動的場景。典型的具身互動任務包括具身問答和具身抓取。如下圖所示,在具身問答任務中,智能體需要從第一人稱視角探索環境,以收集回答問題所需的資訊。具有自主探索和決策能力的智能體不僅要考慮採取哪些行動來探索環境,還需決定何時停止探索以回答問題,如下圖所示。

中對身體進行問答時進行互動互動也涉及基於人類指令執行操作,例如抓取和放置物體,從而完成智能體、人類和物體之間的互動。如圖所示,具身抓取需要全面的語意理解、情境感知、決策和穩健的控制規劃。具身抓取方法將傳統的機器人運動學抓取與大型模型(如大語言模型和視覺語言基礎模型)結合,使智能體能夠在多感官感知下執行抓取任務,包括視覺主動感知、語言理解和推理。

(2)透過有效利用具身感知和具身互動模型,或利用基礎模型的策略功能,逐步實施這些子任務,稱為低層次的具身行動規劃。

(2)透過有效利用具身感知和具身互動模型,或利用基礎模型的策略功能,逐步實施這些子任務,稱為低層次的具身行動規劃。

儘管具身智能發展迅速,但它面臨著一些挑戰,並呈現出令人興奮的未來方向:

。獲取足夠的真實世界機器人數據仍然是一項重大挑戰。收集這些數據既耗時又耗費資源。單純依靠模擬資料會加劇模擬到現實的差距問題。創建多樣化的真實世界機器人資料集需要各個機構之間緊密且廣泛的合作。此外,開發更真實和高效的模擬器對於提高模擬數據的品質至關重要。為了建構能夠在機器人領域實現跨場景和跨任務應用的通用具身模型,必須建立大規模資料集,利用高品質的模擬環境資料來輔助真實世界的資料。

(2)

(3)

(4)

(5)

(6)

(7)

以上是全球首篇!研究近400篇文獻,鵬城實驗室&中大深度解析具身智能的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

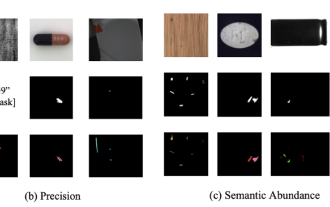

突破傳統缺陷檢測的界限,\'Defect Spectrum\'首次實現超高精度豐富語意的工業缺陷檢測。

Jul 26, 2024 pm 05:38 PM

突破傳統缺陷檢測的界限,\'Defect Spectrum\'首次實現超高精度豐富語意的工業缺陷檢測。

Jul 26, 2024 pm 05:38 PM

在現代製造業中,精準的缺陷檢測不僅是確保產品品質的關鍵,更是提升生產效率的核心。然而,現有的缺陷檢測資料集常常缺乏實際應用所需的精確度和語意豐富性,導致模型無法辨識特定的缺陷類別或位置。為了解決這個難題,由香港科技大學廣州和思謀科技組成的頂尖研究團隊,創新地開發了「DefectSpectrum」資料集,為工業缺陷提供了詳盡、語義豐富的大規模標註。如表一所示,相較於其他工業資料集,「DefectSpectrum」資料集提供了最多的缺陷標註(5438張缺陷樣本),最細緻的缺陷分類(125個缺陷類別

數百萬晶體資料訓練,解決晶體學相位問題,深度學習方法PhAI登Science

Aug 08, 2024 pm 09:22 PM

數百萬晶體資料訓練,解決晶體學相位問題,深度學習方法PhAI登Science

Aug 08, 2024 pm 09:22 PM

編輯|KX時至今日,晶體學所測定的結構細節和精度,從簡單的金屬到大型膜蛋白,是任何其他方法都無法比擬的。然而,最大的挑戰——所謂的相位問題,仍然是從實驗確定的振幅中檢索相位資訊。丹麥哥本哈根大學研究人員,開發了一種解決晶體相問題的深度學習方法PhAI,利用數百萬人工晶體結構及其相應的合成衍射數據訓練的深度學習神經網絡,可以產生準確的電子密度圖。研究表明,這種基於深度學習的從頭算結構解決方案方法,可以以僅2埃的分辨率解決相位問題,該分辨率僅相當於原子分辨率可用數據的10%到20%,而傳統的從頭算方

英偉達對話模式ChatQA進化到2.0版本,上下文長度提到128K

Jul 26, 2024 am 08:40 AM

英偉達對話模式ChatQA進化到2.0版本,上下文長度提到128K

Jul 26, 2024 am 08:40 AM

開放LLM社群正是百花齊放、競相爭鳴的時代,你能看到Llama-3-70B-Instruct、QWen2-72B-Instruct、Nemotron-4-340B-Instruct、Mixtral-8x22BInstruct-v0.1等許多表現優良的模型。但是,相較於以GPT-4-Turbo為代表的專有大模型,開放模型在許多領域仍有明顯差距。在通用模型之外,也有一些專精關鍵領域的開放模型已被開發出來,例如用於程式設計和數學的DeepSeek-Coder-V2、用於視覺-語言任務的InternVL

GoogleAI拿下IMO奧數銀牌,數學推理模型AlphaProof面世,強化學習 is so back

Jul 26, 2024 pm 02:40 PM

GoogleAI拿下IMO奧數銀牌,數學推理模型AlphaProof面世,強化學習 is so back

Jul 26, 2024 pm 02:40 PM

對AI來說,奧數不再是問題了。本週四,GoogleDeepMind的人工智慧完成了一項壯舉:用AI做出了今年國際數學奧林匹克競賽IMO的真題,並且距拿金牌僅一步之遙。上週剛結束的IMO競賽共有六道賽題,涉及代數、組合學、幾何和數論。谷歌提出的混合AI系統做對了四道,獲得28分,達到了銀牌水準。本月初,UCLA終身教授陶哲軒剛剛宣傳了百萬美元獎金的AI數學奧林匹克競賽(AIMO進步獎),沒想到7月還沒過,AI的做題水平就進步到了這種水平。 IMO上同步做題,做對了最難題IMO是歷史最悠久、規模最大、最負

PRO | 為什麼基於 MoE 的大模型更值得關注?

Aug 07, 2024 pm 07:08 PM

PRO | 為什麼基於 MoE 的大模型更值得關注?

Aug 07, 2024 pm 07:08 PM

2023年,幾乎AI的每個領域都在以前所未有的速度進化,同時,AI也不斷地推動著具身智慧、自動駕駛等關鍵賽道的技術邊界。在多模態趨勢下,Transformer作為AI大模型主流架構的局面是否會撼動?為何探索基於MoE(專家混合)架構的大模型成為業界新趨勢?大型視覺模型(LVM)能否成為通用視覺的新突破? ……我們從過去的半年發布的2023年本站PRO會員通訊中,挑選了10份針對以上領域技術趨勢、產業變革進行深入剖析的專題解讀,助您在新的一年裡為大展宏圖做好準備。本篇解讀來自2023年Week50

為大模型提供全新科學複雜問答基準與評估體系,UNSW、阿貢、芝加哥大學等多家機構共同推出SciQAG框架

Jul 25, 2024 am 06:42 AM

為大模型提供全新科學複雜問答基準與評估體系,UNSW、阿貢、芝加哥大學等多家機構共同推出SciQAG框架

Jul 25, 2024 am 06:42 AM

編輯|ScienceAI問答(QA)資料集在推動自然語言處理(NLP)研究中發揮著至關重要的作用。高品質QA資料集不僅可以用於微調模型,也可以有效評估大語言模型(LLM)的能力,尤其是針對科學知識的理解和推理能力。儘管目前已有許多科學QA數據集,涵蓋了醫學、化學、生物等領域,但這些數據集仍有一些不足之處。其一,資料形式較為單一,大多數為多項選擇題(multiple-choicequestions),它們易於進行評估,但限制了模型的答案選擇範圍,無法充分測試模型的科學問題解答能力。相比之下,開放式問答

準確率達60.8%,浙大基於Transformer的化學逆合成預測模型,登Nature子刊

Aug 06, 2024 pm 07:34 PM

準確率達60.8%,浙大基於Transformer的化學逆合成預測模型,登Nature子刊

Aug 06, 2024 pm 07:34 PM

編輯|KX逆合成是藥物發現和有機合成中的關鍵任務,AI越來越多地用於加快這一過程。現有AI方法性能不盡人意,多樣性有限。在實踐中,化學反應通常會引起局部分子變化,反應物和產物之間存在很大重疊。受此啟發,浙江大學侯廷軍團隊提出將單步逆合成預測重新定義為分子串編輯任務,迭代細化目標分子串以產生前驅化合物。並提出了基於編輯的逆合成模型EditRetro,該模型可以實現高品質和多樣化的預測。大量實驗表明,模型在標準基準資料集USPTO-50 K上取得了出色的性能,top-1準確率達到60.8%。

現場削黃瓜、摺衣服,曾爆火的刮鬍子機器人再進化,穹徹的具身智慧大腦來了!

Jul 11, 2024 pm 12:42 PM

現場削黃瓜、摺衣服,曾爆火的刮鬍子機器人再進化,穹徹的具身智慧大腦來了!

Jul 11, 2024 pm 12:42 PM

7月4日,在2024世界人工智慧大會上,具身智慧公司穹徹智慧Noematrix(展位號:H1-A715)宣布推出圓頂具身大腦NoematrixBrain,加速具身智慧大模型落地。結合實體機器人,穹徹在完全開放的環境中向現場觀眾近距離展示了「隨手一扔就能疊的衣物折疊」(無限自由度物體操作,複雜物體理解堪比人類)和「削完就能吃的黃瓜削皮」(不規則曲面操作,精細度甚至超越人類水平)等突破性技術,以及家庭地面整理等落地應用。透過這些即時示範和真實互動,穹徹具身大腦的