整合 200 多項相關研究,大模型「終身學習」最新綜述來了

AIxiv專欄是本站發布學術、技術內容的欄位。過去數年,本站AIxiv專欄接收通報了2,000多篇內容,涵蓋全球各大專院校與企業的頂尖實驗室,有效促進了學術交流與傳播。如果您有優秀的工作想要分享,歡迎投稿或聯絡報道。投稿信箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com

論文標題:Towards Lifelong Learning of Large Language Models: A Survey - 機構::大學

- 論文網址:https://arxiv.org/abs/2406.06391

- 專案網址:https://github.com/ qianlima-lab/awesome-lifelong-learning-methods-for-llm

新穎分類:引進了一個詳細的結構化框架,將大量有關終身學習的文獻分為12 個場景; 通用技術:確定了所有終身學習情況下的通用技術,並將現有文獻分為每個場景中不同的技術組; 未來方向:強調了一些新興技術,如模型擴展和數據選擇,這些技術在前LLM 時代探索較少。

內部知識是指透過完全或部分訓練將新知識吸收到模型參數中,包括連續預訓練和連續微調。 -

外部知識是指在不更新模型參數的情況下,將維基百科或應用程式介面等外部資源中的新知識納入模型,包括基於檢索的終身學習和基於工具的終身學習。

- 連續垂直領域預先訓練(Continual Vertical Domain Pretraining):針對特定垂直領域(如金融、醫療保健等)進行的連續預訓練。

- 連續語言領域預訓練(Continual Language Domain Pretraining):針對自然語言和程式語言進行的連續預訓練。

- 連續時間領域預訓練(Continual Temporal Domain Pretraining):針對時間相關資料(如時間序列資料)的連續預訓練。

特定任務(Task Specific):

連續文字分類(Continual Text Classification):針對文字分類任務進行的連續微調。 連續命名實體辨識(Continual Named Entity Recognition):針對命名實體辨識任務進行的連續微調。 連續關係抽取(Continual Relation Extraction):針對關係抽取任務進行的連續微調。 連續機器翻譯(Continual Machine Translation):針對機器翻譯任務進行的連續微調。

任務無關(Task Agnostic):

- 連續知識編輯(Continual Knowledge Editing):針對知識更新進行的連續學習。

- 連續對齊(Continual Alignment):針對模型與新任務對齊進行的連續學習。

外部知識(External Knowledge)

- 整體表現(Overall Measurement):包括平均準確率(AA)和平均增量準確率(AIA)。 AA 是指模型在學習所有任務後的平均表現,而 AIA 則考慮了每個任務學習後的歷史變化。

- 穩定性測量(Stability Measurement):包括遺忘測量(FGT)和向後轉移(BWT)。 FGT 評估舊任務的平均表現下降,而 BWT 評估舊任務的平均表現變化。

- 適應性測量(Plasticity Measurement):包含向前轉移(FWD),即模型在新任務上表現的平均提升。

意義:這種方法透過在訓練新任務時重播先前任務的數據,來鞏固模型對舊任務的記憶。通常,重播的資料會被儲存在一個緩衝區(Buffer)中,並與目前任務的資料一起用於訓練。主要包括:

–經驗重播(Experience Replay):透過保存一部分舊任務的資料樣本,並在訓練新任務時將這些資料重新用於訓練,從而減少遺忘的發生。

–生成重播(Generative Replay):不同於保存舊數據,這種方法利用生成模型來創建偽樣本,從而在新任務的訓練中引入舊任務的知識。

圖示:圖3 顯示了從Task t-1 到Task t 的過程,模型在訓練Task t 時,使用了緩衝區中的舊資料(Input t-1 )。

- 意義:這種方法透過對模型參數施加正規化約束,來防止模型在學習新任務時對舊任務參數的過度調整。正則化約束可以幫助模型保留對舊任務的記憶。主要包括:

–權重正則化(Weight Regularization):透過對模型參數施加額外的約束,限制新任務訓練時對重要權重的修改,以此保護舊任務的知識。例如,L2 正規化和彈性權重鞏固(Elastic Weight Consolidation,EWC)就是常見的技術。 –特徵正則化(Feature Regularization):正則化不僅可以作用於權重,還可以透過限制模型在特徵空間中的表現,確保新舊任務之間的特徵分佈保持穩定。 圖示:圖3 顯示了從Task t-1

的過程,模型在訓練Task

的效能。

- (c) 以架構為基礎的方法(Architecture-Based Methods):

圖示:圖3 中顯示了從Task t-1 到Task t 的過程,模型在學習新任務時,部分參數被凍結(Frozen),而新增的模組用於訓練新任務(Trainable)。

–從新數據蒸餾(Distillation from New Data):學生模型在教師模型的指導下學習新任務,透過蒸餾舊模型的知識來減少對舊知識的遺忘。

–從舊數據蒸餾(Distillation from Old Data):利用教師模型在舊數據上的表現來引導學生模型對新任務的學習,從而達到保留舊知識的效果。

–從偽舊資料蒸餾(Distillation from Pseudo-Old Data):透過產生偽舊資料(Pseudo-Old Data),讓學生模型在學習新任務時保持對舊知識的記憶。

t-1

1. 參數高效率微調(Parameter-Efficient Fine-Tuning): - 範例:CorpusBrain++ 採用骨幹- 適配器架構和經驗重播策略來應對現實世界中的知識密集型語言任務。

- 2. 模型擴展(Model Expansion):

- 範例:ELLE 採用功能保留的模型擴展策略,透過靈活擴展現有預訓練語言模型的寬度和深度來提高知識獲取和整合的效率。

- 3. 再預熱(Re-warming):

範例:EcomGPT-CT 透過半結構化電子商務資料增強模型在領域特定任務中的表現。

3.2 連續語言領域預訓練領域預訓練(Continual Language Domain Pretraining)旨在使語言模型能夠不斷整合新數據,並適應不斷變化的語言領域而不遺忘先前的知識。 主要方法:1. 架構調整方法(Architecture-Based Methods):範例:Yadav 等透過引入教師強制機制改進提示調優,創建一組提示引導模型在新任務上的微調。 範例:ModuleFormer 和 Lifelong-MoE 使用專家混合(MoE)方法,透過模組化和動態增加模型容量來增強 LLM 的效率和適應性。

範例:連續文字分類任務透過逐步引入新的分類類別(如Intent: Transfer -> Intent: Credit Score -> Intent: Fun Fact)來訓練模型,使其能夠適應不斷變化的分類需求。

例如:連續命名實體辨識任務展示如何在識別特定實體的同時,逐步引入新的實體類型(如Athlete -> Sports Team -> Politician),使模型能夠在識別新的實體時仍保持對舊實體的識別能力。

連續關係抽取任務透過不斷引入新的關係類型(如Relation: Founded By -> Relation: State or Province of Birth -> Relation: Country of Headquarters),展示了模型如何逐步擴展其關係抽取能力。

(e) 連續機器翻譯

(f) 連續指令微調

(g) 連續對齊

Introduction: With the continuous increase of information in the world Scaling up and evolving rapidly, static models trained on historical data quickly become outdated and unable to understand or generate content about new developments. Retrieval-based lifelong learning addresses the critical need for large language models to acquire and assimilate the latest knowledge from external sources, and the model supplements or updates its knowledge base by retrieving these external resources when needed. These external resources provide a large current knowledge base, providing an important complementary asset for enhancing the static properties of pretrained LLMs. Example: These external resources in the diagram are accessible and retrievable by the model. By accessing external information sources such as Wikipedia, books, databases, etc., the model is able to update its knowledge and adapt when encountering new information.

Introduction: Tool-based lifelong learning arises from the necessity to extend its functionality beyond static knowledge and enable it to dynamically interact with the environment. In real-world applications, models are often required to perform tasks that involve operations beyond direct text generation or interpretation. Example: The model in the figure uses these tools to extend and update its own capabilities, enabling lifelong learning through interaction with external tools. For example, models can obtain real-time data through application programming interfaces, or interact with the external environment through physical tools to complete specific tasks or acquire new knowledge.

Catastrophic Forgetting: This is one of the core challenges of lifelong learning, and the introduction of new information may Will overwrite what the model has learned previously. Plasticity-Stability Dilemma: It is very critical to find a balance between maintaining the learning ability and stability of the model, which directly affects the model's ability to acquire new knowledge. while retaining its broad general capabilities. Expensive Computation Cost: The computational requirements for fully fine-tuning a large language model can be very high. Unavailability of model weights or pre-trained data: Due to privacy, proprietary restrictions, or commercial licenses, raw training data or model weights are often unavailable for further improvements.

From specific tasks to general tasks: Research gradually shifts from focusing on specific tasks (such as text classification, named entity recognition) to a wider range of general tasks, such as instruction tuning, knowledge editing, etc. From full fine-tuning to partial fine-tuning: In view of the high resource consumption of full fine-tuning, partial fine-tuning strategies (such as Adapter layer, Prompt tuning, LoRA) are becoming more and more popular. From internal knowledge to external knowledge: In order to overcome the limitations of frequent internal updates, more and more strategies use external knowledge sources, such as Retrieval-Augmented Generation and tools Learning enables models to dynamically access and exploit current external data.

Multimodal lifelong learning: Integrate multiple modalities beyond text (such as images, videos, audios, time series data, knowledge graphs) into lifelong learning to develop more comprehensive and adaptive sexual model. Efficient lifelong learning: Researchers are working on developing more efficient strategies to manage the computational requirements of model training and updates, such as model pruning, model merging, model expansion and other methods. Universal lifelong learning: The ultimate goal is to enable large language models to actively acquire new knowledge and learn through dynamic interaction with the environment, no longer relying solely on static data sets.

以上是整合 200 多項相關研究,大模型「終身學習」最新綜述來了的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

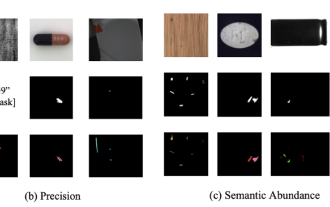

突破傳統缺陷檢測的界限,\'Defect Spectrum\'首次實現超高精度豐富語意的工業缺陷檢測。

Jul 26, 2024 pm 05:38 PM

突破傳統缺陷檢測的界限,\'Defect Spectrum\'首次實現超高精度豐富語意的工業缺陷檢測。

Jul 26, 2024 pm 05:38 PM

在現代製造業中,精準的缺陷檢測不僅是確保產品品質的關鍵,更是提升生產效率的核心。然而,現有的缺陷檢測資料集常常缺乏實際應用所需的精確度和語意豐富性,導致模型無法辨識特定的缺陷類別或位置。為了解決這個難題,由香港科技大學廣州和思謀科技組成的頂尖研究團隊,創新地開發了「DefectSpectrum」資料集,為工業缺陷提供了詳盡、語義豐富的大規模標註。如表一所示,相較於其他工業資料集,「DefectSpectrum」資料集提供了最多的缺陷標註(5438張缺陷樣本),最細緻的缺陷分類(125個缺陷類別

數百萬晶體資料訓練,解決晶體學相位問題,深度學習方法PhAI登Science

Aug 08, 2024 pm 09:22 PM

數百萬晶體資料訓練,解決晶體學相位問題,深度學習方法PhAI登Science

Aug 08, 2024 pm 09:22 PM

編輯|KX時至今日,晶體學所測定的結構細節和精度,從簡單的金屬到大型膜蛋白,是任何其他方法都無法比擬的。然而,最大的挑戰——所謂的相位問題,仍然是從實驗確定的振幅中檢索相位資訊。丹麥哥本哈根大學研究人員,開發了一種解決晶體相問題的深度學習方法PhAI,利用數百萬人工晶體結構及其相應的合成衍射數據訓練的深度學習神經網絡,可以產生準確的電子密度圖。研究表明,這種基於深度學習的從頭算結構解決方案方法,可以以僅2埃的分辨率解決相位問題,該分辨率僅相當於原子分辨率可用數據的10%到20%,而傳統的從頭算方

英偉達對話模式ChatQA進化到2.0版本,上下文長度提到128K

Jul 26, 2024 am 08:40 AM

英偉達對話模式ChatQA進化到2.0版本,上下文長度提到128K

Jul 26, 2024 am 08:40 AM

開放LLM社群正是百花齊放、競相爭鳴的時代,你能看到Llama-3-70B-Instruct、QWen2-72B-Instruct、Nemotron-4-340B-Instruct、Mixtral-8x22BInstruct-v0.1等許多表現優良的模型。但是,相較於以GPT-4-Turbo為代表的專有大模型,開放模型在許多領域仍有明顯差距。在通用模型之外,也有一些專精關鍵領域的開放模型已被開發出來,例如用於程式設計和數學的DeepSeek-Coder-V2、用於視覺-語言任務的InternVL

GoogleAI拿下IMO奧數銀牌,數學推理模型AlphaProof面世,強化學習 is so back

Jul 26, 2024 pm 02:40 PM

GoogleAI拿下IMO奧數銀牌,數學推理模型AlphaProof面世,強化學習 is so back

Jul 26, 2024 pm 02:40 PM

對AI來說,奧數不再是問題了。本週四,GoogleDeepMind的人工智慧完成了一項壯舉:用AI做出了今年國際數學奧林匹克競賽IMO的真題,並且距拿金牌僅一步之遙。上週剛結束的IMO競賽共有六道賽題,涉及代數、組合學、幾何和數論。谷歌提出的混合AI系統做對了四道,獲得28分,達到了銀牌水準。本月初,UCLA終身教授陶哲軒剛剛宣傳了百萬美元獎金的AI數學奧林匹克競賽(AIMO進步獎),沒想到7月還沒過,AI的做題水平就進步到了這種水平。 IMO上同步做題,做對了最難題IMO是歷史最悠久、規模最大、最負

PRO | 為什麼基於 MoE 的大模型更值得關注?

Aug 07, 2024 pm 07:08 PM

PRO | 為什麼基於 MoE 的大模型更值得關注?

Aug 07, 2024 pm 07:08 PM

2023年,幾乎AI的每個領域都在以前所未有的速度進化,同時,AI也不斷地推動著具身智慧、自動駕駛等關鍵賽道的技術邊界。在多模態趨勢下,Transformer作為AI大模型主流架構的局面是否會撼動?為何探索基於MoE(專家混合)架構的大模型成為業界新趨勢?大型視覺模型(LVM)能否成為通用視覺的新突破? ……我們從過去的半年發布的2023年本站PRO會員通訊中,挑選了10份針對以上領域技術趨勢、產業變革進行深入剖析的專題解讀,助您在新的一年裡為大展宏圖做好準備。本篇解讀來自2023年Week50

為大模型提供全新科學複雜問答基準與評估體系,UNSW、阿貢、芝加哥大學等多家機構共同推出SciQAG框架

Jul 25, 2024 am 06:42 AM

為大模型提供全新科學複雜問答基準與評估體系,UNSW、阿貢、芝加哥大學等多家機構共同推出SciQAG框架

Jul 25, 2024 am 06:42 AM

編輯|ScienceAI問答(QA)資料集在推動自然語言處理(NLP)研究中發揮著至關重要的作用。高品質QA資料集不僅可以用於微調模型,也可以有效評估大語言模型(LLM)的能力,尤其是針對科學知識的理解和推理能力。儘管目前已有許多科學QA數據集,涵蓋了醫學、化學、生物等領域,但這些數據集仍有一些不足之處。其一,資料形式較為單一,大多數為多項選擇題(multiple-choicequestions),它們易於進行評估,但限制了模型的答案選擇範圍,無法充分測試模型的科學問題解答能力。相比之下,開放式問答

準確率達60.8%,浙大基於Transformer的化學逆合成預測模型,登Nature子刊

Aug 06, 2024 pm 07:34 PM

準確率達60.8%,浙大基於Transformer的化學逆合成預測模型,登Nature子刊

Aug 06, 2024 pm 07:34 PM

編輯|KX逆合成是藥物發現和有機合成中的關鍵任務,AI越來越多地用於加快這一過程。現有AI方法性能不盡人意,多樣性有限。在實踐中,化學反應通常會引起局部分子變化,反應物和產物之間存在很大重疊。受此啟發,浙江大學侯廷軍團隊提出將單步逆合成預測重新定義為分子串編輯任務,迭代細化目標分子串以產生前驅化合物。並提出了基於編輯的逆合成模型EditRetro,該模型可以實現高品質和多樣化的預測。大量實驗表明,模型在標準基準資料集USPTO-50 K上取得了出色的性能,top-1準確率達到60.8%。

Nature觀點,人工智慧在醫學上的測試一片混亂,該怎麼做?

Aug 22, 2024 pm 04:37 PM

Nature觀點,人工智慧在醫學上的測試一片混亂,該怎麼做?

Aug 22, 2024 pm 04:37 PM

編輯|ScienceAI基於有限的臨床數據,數百種醫療演算法已被批准。科學家們正在討論由誰來測試這些工具,以及如何最好地進行測試。 DevinSingh在急診室目睹了一名兒科患者因長時間等待救治而心臟驟停,這促使他探索AI在縮短等待時間中的應用。 Singh利用了SickKids急診室的分診數據,與同事們建立了一系列AI模型,用於提供潛在診斷和推薦測試。一項研究表明,這些模型可以加快22.3%的就診速度,將每位需要進行醫學檢查的患者的結果處理速度加快近3小時。然而,人工智慧演算法在研究中的成功只是驗證此