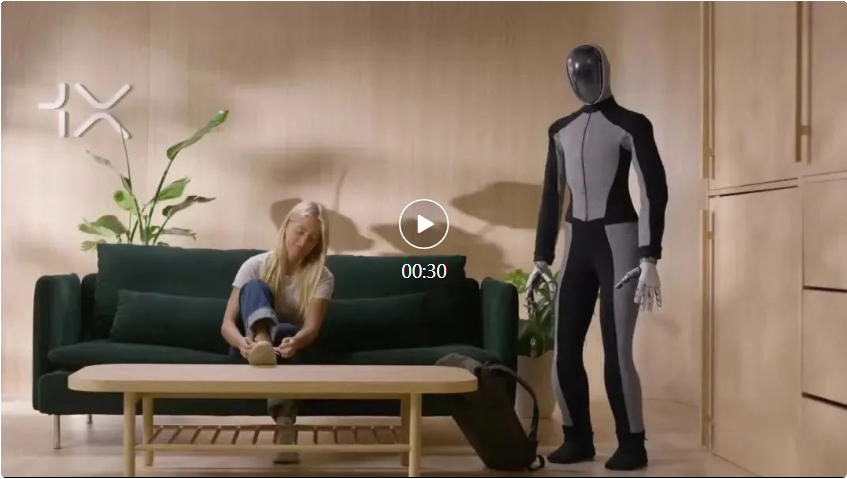

通常機器人動起來,渾身的關節都會發出咔嗒聲,但被OpenAI 看到的創業公司1X 卻能做到不一樣的事情,他們上週公開的新款人形機器人NEO 可以做到安靜且實用。如果我們把影片的音量調高,才能聽到它彎腰撿起背包時馬達發出的輕微嗡嗡聲。  看完這個視頻,真想問一句,這真不是個穿著皮套的人類嗎? 如今的工業機器人可以把動作做得很快,但它在與東西接觸之前,需要把速度減到極慢。為確保安全,這些機器人往往需要被關在安全籠中,而 NEO 卻能輕柔地摟住影片中的女生,自然流暢地把書包遞給她。這是如何做到的呢? 1X Technologies 的 AI 副總裁 Eric Jang 寫了一篇博客,公開了 NEO 背後的技術。

看完這個視頻,真想問一句,這真不是個穿著皮套的人類嗎? 如今的工業機器人可以把動作做得很快,但它在與東西接觸之前,需要把速度減到極慢。為確保安全,這些機器人往往需要被關在安全籠中,而 NEO 卻能輕柔地摟住影片中的女生,自然流暢地把書包遞給她。這是如何做到的呢? 1X Technologies 的 AI 副總裁 Eric Jang 寫了一篇博客,公開了 NEO 背後的技術。

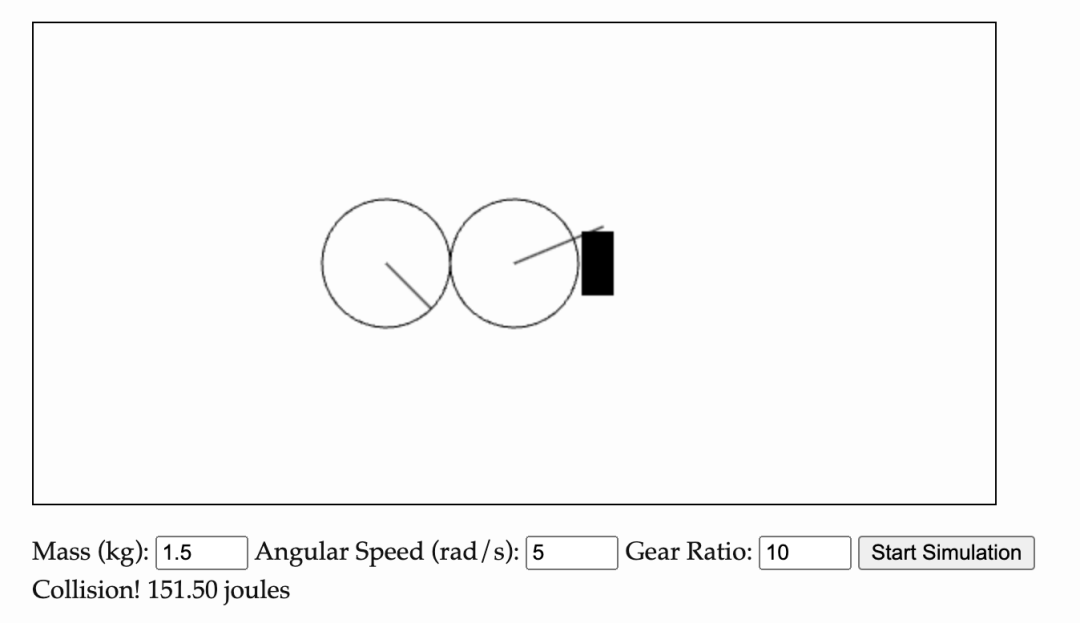

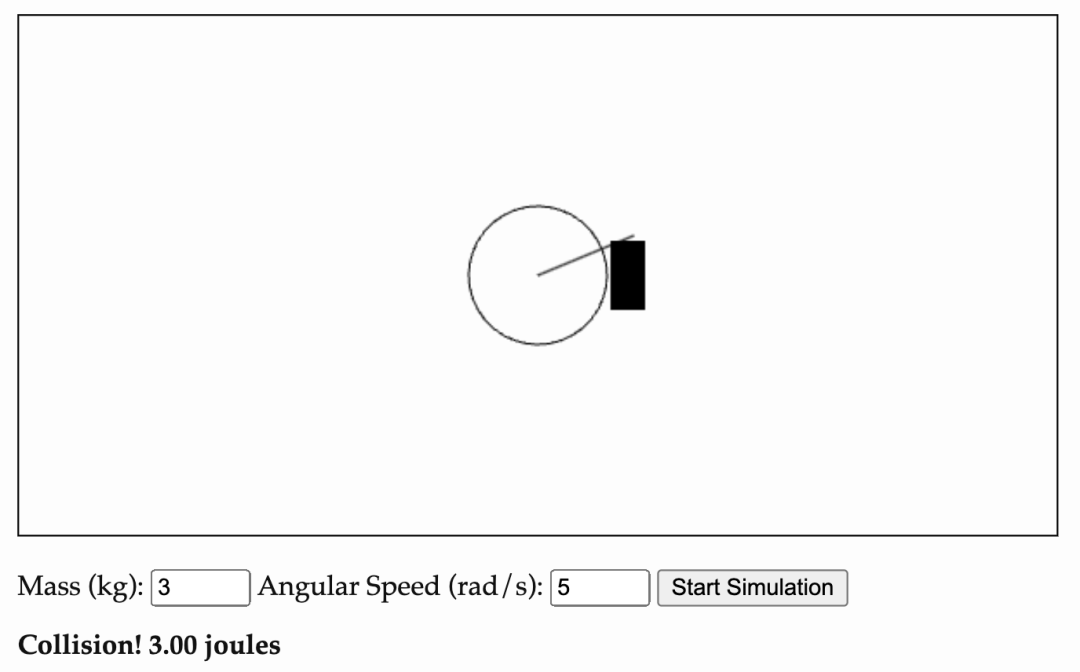

他稱這篇部落格為馬達慣量和齒輪系統的教學。在加入 1X Technologies 之前,Eric Jang 曾在Google的機器人研究部門任職 6 年,但他坦言,直到加入 1X Technologies,他才深刻領悟到這些概念有多重要。 透過親自進行實體計算,Eric Jang 更堅定地認為,輕質且具有高扭矩的馬達是打造具有學習能力的通用機器人的關鍵。 設想有一個重量為 3 公斤、半徑為 0.4 公尺的輪子,它以每秒 5 弧度的速度旋轉。從輪子上延伸出一根槓桿,這根槓桿將與一個固定不動的木塊發生碰撞。假設這次碰撞完全是非彈性的,這意味著輪子在碰撞後將停止旋轉,不會在木塊上反彈。為了簡化計算,我們假設槓桿臂沒有質量,僅用於阻止輪子的旋轉。 依照旋轉動能公式 ,其中 I 是轉動慣量,ω 是角速度。因為假設槓桿沒有質量,系統的慣性相當於一個固定的圓柱體:

,其中 I 是轉動慣量,ω 是角速度。因為假設槓桿沒有質量,系統的慣性相當於一個固定的圓柱體: 。代入數值可以算出 I = 0.24 kg⋅m^2。因此,可以進一步計算出這個系統的旋轉動能為 3 焦耳。 在現實環境的非彈性碰撞中,輪子和木塊的總動量守恆,而它們的總動能則不會。因此,系統的旋轉動能將小於 3 焦耳。 答案是,部分動能轉化為了運動,剩餘的動能則以熱能、聲音和內部材料變形的形式消耗掉了。當你聽到機器人在移動時發出巨響,那是因為動能的傳動效率低下,將機械功轉化為了聲音,能量被浪費了。 由於木塊阻止了槓桿的移動,導致輪子的新速度降為零,相應的動能也降至零。這意味著要使輪子停止旋轉,必須將全部的動能轉換為其他形式的能量。幸運的是,3 焦耳並不是很大的能量,這相當於一隻小狗以 1 公尺 / 秒的速度小跑著撞向你並停下來。 把上面的系統稍作修改:現在我們有兩個輪子,每個輪子的質量為1.5 公斤,半徑為0.4 公尺。這兩個輪子分別以 5 弧度 / 秒和 50 弧度 / 秒(即第一個輪子速度的 10 倍)的速度旋轉,並與一個固定的木塊發生碰撞。第二個輪子的旋轉速度是第一個輪子的 10 倍,透過齒輪裝置驅動第一個輪子。這種設定相當於一個 10:1 的齒輪減速比,它降低了槓桿的最終速度。 系統的動能是兩個輪子旋轉動能的總和。和上一個例子一樣,系統在碰撞後會靜止,所有動能必須以熱、噪音和材料變形等形式耗散。 雖然槓桿接觸木塊的速度與之前相同,但總動能(150 焦耳)卻是原來單輪系統的 50 倍!如果依照機器人齒輪箱的標準,將齒輪比增加到 100,那麼需要耗散的總動能將達到 15,000 焦耳。 這大致相當於一個棒球以每小時 1000 英里的速度與你相撞。在這種速度下,槓桿碰撞到的任何物體,都會被徹底摧毀。當然,齒輪系統本身也將無法倖免。 這可能有點反直覺,因為齒輪連動裝置往往是出於安全設計的。如果槓桿的最終速度保持不變,輪子的總質量也不變,也不設置木塊阻止槓桿的運動,把兩組裝置的運動分別錄下來觀察,那麼光看視頻,看不出區別。但是,一旦涉及到碰撞 —— 尤其是那些意料之外的碰撞 —— 情況就會大不相同。旋轉馬達的物理原理,對於人形機器人安全地與世界發生接觸至關重要。大多數人形機器人公司選擇將機器人部署在工廠而不是家庭中,是因為它們依賴僵硬的高速齒輪傳動系統。 正如前文中那個棒球「毀天滅地」的動能,這種系統在人身邊並不安全,因此,需要用防護籠把他們圍起來。 🎜>試想,如果想讓機器人快速地端來一杯咖啡,那麼需要它肢體的末端執行器快速移動,這意味著在機器人的肢體和齒輪的另一側,必須有一個轉速遠遠超過末端執行器的馬達在運轉。由於動能與角速度的平方成正比,機器人的動作實際上是由高速旋轉的齒輪的慣性控制著,而非機器人的肢體連結本身。 MIT 的 Russ Tedrake 教授在他的課堂上,對這些違反直覺的機器人動力學現象進行了精彩的詮釋。 Course link: https://manipulation.csail.mit.edu/robot.html Why use gearboxes if they consume energy and are unsafe?

。代入數值可以算出 I = 0.24 kg⋅m^2。因此,可以進一步計算出這個系統的旋轉動能為 3 焦耳。 在現實環境的非彈性碰撞中,輪子和木塊的總動量守恆,而它們的總動能則不會。因此,系統的旋轉動能將小於 3 焦耳。 答案是,部分動能轉化為了運動,剩餘的動能則以熱能、聲音和內部材料變形的形式消耗掉了。當你聽到機器人在移動時發出巨響,那是因為動能的傳動效率低下,將機械功轉化為了聲音,能量被浪費了。 由於木塊阻止了槓桿的移動,導致輪子的新速度降為零,相應的動能也降至零。這意味著要使輪子停止旋轉,必須將全部的動能轉換為其他形式的能量。幸運的是,3 焦耳並不是很大的能量,這相當於一隻小狗以 1 公尺 / 秒的速度小跑著撞向你並停下來。 把上面的系統稍作修改:現在我們有兩個輪子,每個輪子的質量為1.5 公斤,半徑為0.4 公尺。這兩個輪子分別以 5 弧度 / 秒和 50 弧度 / 秒(即第一個輪子速度的 10 倍)的速度旋轉,並與一個固定的木塊發生碰撞。第二個輪子的旋轉速度是第一個輪子的 10 倍,透過齒輪裝置驅動第一個輪子。這種設定相當於一個 10:1 的齒輪減速比,它降低了槓桿的最終速度。 系統的動能是兩個輪子旋轉動能的總和。和上一個例子一樣,系統在碰撞後會靜止,所有動能必須以熱、噪音和材料變形等形式耗散。 雖然槓桿接觸木塊的速度與之前相同,但總動能(150 焦耳)卻是原來單輪系統的 50 倍!如果依照機器人齒輪箱的標準,將齒輪比增加到 100,那麼需要耗散的總動能將達到 15,000 焦耳。 這大致相當於一個棒球以每小時 1000 英里的速度與你相撞。在這種速度下,槓桿碰撞到的任何物體,都會被徹底摧毀。當然,齒輪系統本身也將無法倖免。 這可能有點反直覺,因為齒輪連動裝置往往是出於安全設計的。如果槓桿的最終速度保持不變,輪子的總質量也不變,也不設置木塊阻止槓桿的運動,把兩組裝置的運動分別錄下來觀察,那麼光看視頻,看不出區別。但是,一旦涉及到碰撞 —— 尤其是那些意料之外的碰撞 —— 情況就會大不相同。旋轉馬達的物理原理,對於人形機器人安全地與世界發生接觸至關重要。大多數人形機器人公司選擇將機器人部署在工廠而不是家庭中,是因為它們依賴僵硬的高速齒輪傳動系統。 正如前文中那個棒球「毀天滅地」的動能,這種系統在人身邊並不安全,因此,需要用防護籠把他們圍起來。 🎜>試想,如果想讓機器人快速地端來一杯咖啡,那麼需要它肢體的末端執行器快速移動,這意味著在機器人的肢體和齒輪的另一側,必須有一個轉速遠遠超過末端執行器的馬達在運轉。由於動能與角速度的平方成正比,機器人的動作實際上是由高速旋轉的齒輪的慣性控制著,而非機器人的肢體連結本身。 MIT 的 Russ Tedrake 教授在他的課堂上,對這些違反直覺的機器人動力學現象進行了精彩的詮釋。 Course link: https://manipulation.csail.mit.edu/robot.html Why use gearboxes if they consume energy and are unsafe?

The reason is that the gearbox provides critical mechanical leverage: many motors cannot provide enough torque when working alone, so engineers install gears on high-speed motors. Speed is sacrificed for necessary torque.

This kind of gear system is "rigid" and cannot be "reverse driven". Once the gears start to rotate, they will bite together tightly and it will be difficult to Turn back. So at the other end of the gearbox, more force needs to be exerted to resist the rotational force generated by the high-speed motor.

Based on the above considerations, 1X Technologies has been committed to manufacturing high-torque, low-speed motors for the past ten years to maximize the safety of the transmission system. Thanks to the motor and drive system used by the NEO robot with smaller gear ratios and lighter weight, it has become the first truly domestic robot that can be safely integrated into the home environment. Redefining the significance of real-life videos for robot training

In addition to collecting from robots Researchers can also use first-person perspective videos of real people performing tasks to train robots. The idea is as follows:

1. Data is the basis for the progress of general robots. bottleneck". Robotic hardware is expensive, and hiring human remote operators to perform tasks using bulky hardware is equally expensive. Moreover, the efficiency of remote operation is very low, far lower than the speed at which humans can directly complete tasks.

2. If we strap head-mounted cameras to people and have them wear large rubber gloves that cover their flesh, we can quickly collect A large dataset of people performing various chores and tasks. Ordinary people unconsciously complete a large number of different actions and operational tasks in their daily lives. Although there are difficulties in directly perceiving the raw motion output, we can infer actions by analyzing pose changes in videos. This type of data collection could help break down barriers to the development of general-purpose robots until more advanced hardware becomes available.

3. There are many first-person and third-person videos on the Internet, which can train robots to recognize and learn various activities people perform in videos, thereby further expanding our Data size.

Before scaling up this type of data collection, it is also important to note that there are no fast-rotating parts in our bodies. Compared to a motor rotating at 5000 RPM, the kinetic energy of muscles Very low, the effective mass we carry when moving is also much smaller, so you will find that while a robot's joint angles may be roughly the same as a human's, the effective mass provided by its rotating motors may be too large to perform the task dexterously .

Even if we develop efficient motion control strategies, robots still cannot reach human speed and fluency when performing actions such as easily turning lights on and off or running gracefully. This is because the forces exerted by robots when touching objects are significantly different from humans.

So if you want to quickly convert human videos into robot movement strategies, you need the following methods:

1. A very compliant and flexible robot like NEO

2. Let the robot track the motion trajectory of the video at a speed slower than 1x, instead of directly copying " "Human Hardware" dynamics. However, this is only suitable for static operation tasks, and is not suitable for tasks that require contact with many objects, such as folding clothes and preparing food in the kitchen.

3. Decouple motion planning and dynamic planning, allowing motion planning to focus on reaching the target position, while dynamic planning focuses on controlling the force when a collision occurs. 以上是機器人把握好手上的力道,安全做家事有多難? 1X人工智慧副總裁撰文詳解的詳細內容。更多資訊請關注PHP中文網其他相關文章!

,其中 I 是轉動慣量,ω 是角速度。因為假設槓桿沒有質量,系統的慣性相當於一個固定的圓柱體:

,其中 I 是轉動慣量,ω 是角速度。因為假設槓桿沒有質量,系統的慣性相當於一個固定的圓柱體: 。代入數值可以算出 I = 0.24 kg⋅m^2。因此,可以進一步計算出這個系統的旋轉動能為 3 焦耳。

。代入數值可以算出 I = 0.24 kg⋅m^2。因此,可以進一步計算出這個系統的旋轉動能為 3 焦耳。