js中parseFloat(參數1,參數2)定義與用法及注意事項_基礎知識

今天在看jquery的時候裡面用到了parseFloat(第一個參數,10),一直不懂第二個參數是什麼意思,於是上網查了一下,怕以後忘記就記下來。

定義與用法:parseFloat() 函數可解析一個字串,並傳回一個浮點數。

語法:parseFloat(string),參數string是必須的,表示要被解析的字串

傳回值:傳回解析後的數字

注意事項:

1.開頭和結尾的空格是允許的。

2.如果字串的第一個字元不能轉換為數字,那麼 parseFloat() 會傳回 NaN

3.如果只想解析數字的整數部分,請使用 parseInt() 方法。

4.只有字串中的第一個數字會被回傳。

附上範例:

複製程式碼

複製碼>

document.write(parseFloat("34 45 66")) document.write(parseFloat(" 60 ")) document.write(parseFloat("40 years )

document.write(parseFloat("He was 40"))

依序輸出

:

10 依序輸出10.33 34 60 40 NaN 下面講第二個問題:parseFloat(第一個參數,10)中的10是什麼意思parseFloat的第二個參數表示轉換的進制,10就表示轉為10進制

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

PHP 5.4版本新功能:如何使用callable類型提示參數接受可呼叫的函數或方法

Jul 29, 2023 pm 09:19 PM

PHP 5.4版本新功能:如何使用callable類型提示參數接受可呼叫的函數或方法

Jul 29, 2023 pm 09:19 PM

PHP5.4版本新功能:如何使用callable類型提示參數接受可呼叫的函數或方法引言:PHP5.4版本引入了一個非常便利的新功能-可以使用callable類型提示參數來接受可呼叫的函數或方法。這個新功能使得函數和方法可以直接指定對應的可呼叫參數,而無需進行額外的檢查和轉換。在本文中,我們將介紹callable類型提示的使用方法,並提供一些程式碼範例,

產品參數是什麼意思

Jul 05, 2023 am 11:13 AM

產品參數是什麼意思

Jul 05, 2023 am 11:13 AM

產品參數是指產品屬性的意思。例如服裝參數有品牌、材質、型號、大小、風格、布料、適應人群和顏色等;食品參數有品牌、重量、材質、衛生許可證號碼、適應人群和顏色等;家電參數有品牌、尺寸、顏色、產地、適應電壓、訊號、介面和功率等。

C++ 函式參數型別安全檢查

Apr 19, 2024 pm 12:00 PM

C++ 函式參數型別安全檢查

Apr 19, 2024 pm 12:00 PM

C++參數類型安全檢查透過編譯時檢查、執行時間檢查和靜態斷言確保函數只接受預期類型的值,防止意外行為和程式崩潰:編譯時類型檢查:編譯器檢查類型相容性。運行時類型檢查:使用dynamic_cast檢查類型相容性,不符則拋出異常。靜態斷言:在編譯時對型別條件進行斷言。

PHP Warning: in_array() expects parameter的解決方法

Jun 22, 2023 pm 11:52 PM

PHP Warning: in_array() expects parameter的解決方法

Jun 22, 2023 pm 11:52 PM

在開發過程中,我們可能會遇到這樣一個錯誤提示:PHPWarning:in_array()expectsparameter。這個錯誤提示會在使用in_array()函數時出現,有可能是因為函數的參數傳遞不正確所導致的。以下我們來看看這個錯誤提示的解決方法。首先,需要明確in_array()函數的作用:檢查一個值是否在陣列中存在。此函數的原型為:in_a

C++程式以給定值為參數,找出雙曲正弦反函數的值

Sep 17, 2023 am 10:49 AM

C++程式以給定值為參數,找出雙曲正弦反函數的值

Sep 17, 2023 am 10:49 AM

雙曲函數是使用雙曲線而不是圓定義的,與普通三角函數相當。它從提供的弧度角傳回雙曲正弦函數中的比率參數。但要做相反的事,或者換句話說。如果我們想要根據雙曲正弦值計算角度,我們需要像雙曲反正弦運算一樣的反雙曲三角運算。本課程將示範如何使用C++中的雙曲反正弦(asinh)函數,並使用雙曲正弦值(以弧度為單位)計算角度。雙曲反正弦運算遵循下列公式-$$\mathrm{sinh^{-1}x\:=\:In(x\:+\:\sqrt{x^2\:+\:1})},其中\:In\:是\:自然對數\:(log_e\:k)

i9-12900H參數評測大全

Feb 23, 2024 am 09:25 AM

i9-12900H參數評測大全

Feb 23, 2024 am 09:25 AM

i9-12900H是14核心的處理器,使用的架構和工藝都是全新的,線程也很高,整體的工作都是很優秀的,一些參數都有提升特別的全面,是可以給用戶們帶來極佳體驗的。 i9-12900H參數評測大全評測:1、i9-12900H是14核心的處理器,採用了q1架構以及24576kb的製程工藝,提升到了20個執行緒。 2.最大的CPU頻率是1.80!5.00ghz,整體主要取決於工作的負載。 3.相比較價位來說還是特別合適的,性價比很不錯,對於一些需要正常使用的伙伴來說非常的合適。 i9-12900H參數評測大全性能跑分

100億參數的語言模型跑不動? MIT華人博士提出SmoothQuant量化,記憶體需求直降一半,速度提升1.56倍!

Apr 13, 2023 am 09:31 AM

100億參數的語言模型跑不動? MIT華人博士提出SmoothQuant量化,記憶體需求直降一半,速度提升1.56倍!

Apr 13, 2023 am 09:31 AM

大型語言模型(LLM)雖然性能強勁,但動輒幾百上千億的參數量,對計算設備還是內存的需求量之大,都不是一般公司能承受得住的。量化(Quantization)是常見的壓縮操作,透過降低模型權重的精度(如32bit降為8bit),犧牲一部分模型的效能來換取更快的推理速度,更少的記憶體需求。但對於超過1000億參數量的LLM來說,現有的壓縮方法都無法維持模型的準確率,也無法在硬體上有效率地運作。最近,麻省理工學院和英偉達的研究人員聯合提出了一個通用後訓練的量化(GPQ, general-purpose po

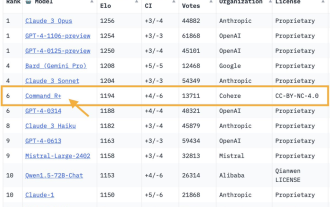

開源模型首勝GPT-4!競技場最新戰報引熱議,Karpathy:這是我唯二信任的榜單

Apr 10, 2024 pm 03:16 PM

開源模型首勝GPT-4!競技場最新戰報引熱議,Karpathy:這是我唯二信任的榜單

Apr 10, 2024 pm 03:16 PM

能打得過GPT-4的開源模型出現了!大模型競技場最新戰報:1040億參數開源模型CommandR+攀升至第6位,與GPT-4-0314打成平手,超過了GPT-4-0613。圖片這也是第一個在大模型競技場上擊敗GPT-4的開放權重模型。大模型競技場,可是大神Karpathy口中唯二信任的測試基準之一。圖片CommandR+來自AI獨角獸Cohere。這家大模型新創公司的共同創辦人兼CEO,正是Transformer最年輕作者AidanGomez(簡稱割麥子)。圖片這份戰報一出,又掀起了一波大模型社