序

本文主要內容:以最短的時間寫一個最簡單的爬蟲,可以抓取論壇的貼文標題和貼文內容。

本文受眾:沒寫過爬蟲的萌新。

入門

0.準備工作

需要準備的東西:什麼編輯、scrapyscrapy、什麼文字編輯工具。

1.技術部已經研究決定了,你來寫爬蟲。

隨便建立一個工作目錄,然後用命令列建立一個工程,工程名為miao,可以替換為你喜歡的名字。

scrapy startproject miao

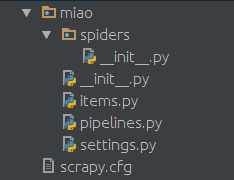

隨後你會得到如下的一個由scrapy建立的目錄結構

在spiders資料夾中建立一個python檔案,例如miao.py,來作為爬蟲的腳本。內容如下:

import scrapy

class NgaSpider(scrapy.Spider):

name = "NgaSpider"

host = "http://bbs.ngacn.cc/"

# start_urls是我们准备爬的初始页

start_urls = [

"http://bbs.ngacn.cc/thread.php?fid=406",

]

# 这个是解析函数,如果不特别指明的话,scrapy抓回来的页面会由这个函数进行解析。

# 对页面的处理和分析工作都在此进行,这个示例里我们只是简单地把页面内容打印出来。

def parse(self, response):

print response.body2.跑一個試試?

如果用命令行的話就這樣:

cd miao scrapy crawl NgaSpider

你可以看到爬蟲君已經把你壇星際區第一頁打印出來了,當然由於沒有任何處理,所以混雜著html標籤和js腳本都一併列印出來了。

解析

接下來我們要把剛剛抓下來的頁面進行分析,從這htmlhtml和js堆裡把這一頁的貼文標題提煉出來。其實解析頁面是個體力活,方法多的是,這裡只介紹xpath。

0.為什麼不試試神奇的xpath呢

看一下剛才抓下來的那東西,或者用chrome瀏覽器手動打開那個頁面然後按F12可以看到頁面結構。每個標題其實都是由這麼一個html標籤包裹著的。舉個例子:

<a href='/read.php?tid=10803874' id='t_tt1_33' class='topic'>[合作模式] 合作模式修改设想</a>

可以看到href就是這個帖子的地址(當然前面要拼上論壇地址),而這個標籤包裹的內容就是帖子的標題了。

於是我們用xpath的絕對定位方法,把class='topic'的部分摘出來。

1.看看xpath的效果

在最上面加上引用:

from scrapy import Selector

把parse函數改成:

def parse(self, response):

selector = Selector(response)

# 在此,xpath会将所有class=topic的标签提取出来,当然这是个list

# 这个list里的每一个元素都是我们要找的html标签

content_list = selector.xpath("//*[@class='topic']")

# 遍历这个list,处理每一个标签

for content in content_list:

# 此处解析标签,提取出我们需要的帖子标题。

topic = content.xpath('string(.)').extract_first()

print topic

# 此处提取出帖子的url地址。

url = self.host + content.xpath('@href').extract_first()

print url再次運行就可以看到輸出你壇星際區第一頁所有帖子的標題和url了。

遞歸

接下來我們要抓取每個貼文的內容。這裡需要用到python的yield。

yield Request(url=url, callback=self.parse_topic)

此處會告訴scrapy去抓取這個url,然後把抓回來的頁面用指定的parse_topic函數進行解析。

至此我們需要定義一個新的函數來分析一個貼文裡的內容。

完整的程式碼如下:

import scrapy

from scrapy import Selector

from scrapy import Request

class NgaSpider(scrapy.Spider):

name = "NgaSpider"

host = "http://bbs.ngacn.cc/"

# 这个例子中只指定了一个页面作为爬取的起始url

# 当然从数据库或者文件或者什么其他地方读取起始url也是可以的

start_urls = [

"http://bbs.ngacn.cc/thread.php?fid=406",

]

# 爬虫的入口,可以在此进行一些初始化工作,比如从某个文件或者数据库读入起始url

def start_requests(self):

for url in self.start_urls:

# 此处将起始url加入scrapy的待爬取队列,并指定解析函数

# scrapy会自行调度,并访问该url然后把内容拿回来

yield Request(url=url, callback=self.parse_page)

# 版面解析函数,解析一个版面上的帖子的标题和地址

def parse_page(self, response):

selector = Selector(response)

content_list = selector.xpath("//*[@class='topic']")

for content in content_list:

topic = content.xpath('string(.)').extract_first()

print topic

url = self.host + content.xpath('@href').extract_first()

print url

# 此处,将解析出的帖子地址加入待爬取队列,并指定解析函数

yield Request(url=url, callback=self.parse_topic)

# 可以在此处解析翻页信息,从而实现爬取版区的多个页面

# 帖子的解析函数,解析一个帖子的每一楼的内容

def parse_topic(self, response):

selector = Selector(response)

content_list = selector.xpath("//*[@class='postcontent ubbcode']")

for content in content_list:

content = content.xpath('string(.)').extract_first()

print content

# 可以在此处解析翻页信息,从而实现爬取帖子的多个页面到此為止,這個爬蟲可以爬取你壇第一頁所有的帖子的標題,並爬取每個帖子裡第一頁的每一層樓的內容。爬取多個頁面的原理相同,注意解析翻頁的url位址、設定終止條件、指定好對應的頁面解析函數即可。

Pipelines——管道

此處是對已抓取、解析後的內容的處理,可以透過管道寫入本地文件、資料庫。

0.定義一個Item

在miao資料夾中建立一個items.py檔案。

from scrapy import Item, Field

class TopicItem(Item):

url = Field()

title = Field()

author = Field()

class ContentItem(Item):

url = Field()

content = Field()

author = Field()此處我們定義了兩個簡單的class來描述我們爬取的結果。

1. 寫一個處理方法

在miao資料夾下面找到那個pipelines.py文件,scrapy之前應該已經自動生成好了。

我們可以在此建立一個處理方法。

class FilePipeline(object):

## 爬虫的分析结果都会由scrapy交给此函数处理

def process_item(self, item, spider):

if isinstance(item, TopicItem): ## 在此可进行文件写入、数据库写入等操作

pass

if isinstance(item, ContentItem): ## 在此可进行文件写入、数据库写入等操作

pass

## ...

return item2.在爬蟲中呼叫這個處理方法。

要呼叫這個方法我們只需在爬蟲中呼叫即可,例如原先的內容處理函數可改為:

def parse_topic(self, response):

selector = Selector(response)

content_list = selector.xpath("//*[@class='postcontent ubbcode']") for content in content_list:

content = content.xpath('string(.)').extract_first() ## 以上是原内容

## 创建个ContentItem对象把我们爬取的东西放进去

item = ContentItem()

item["url"] = response.url

item["content"] = content

item["author"] = "" ## 略

## 这样调用就可以了

## scrapy会把这个item交给我们刚刚写的FilePipeline来处理

yield item3.在設定檔裡指定這個pipeline

3.在設定檔中指定這個pipelineITEM_PIPELINES = { 'miao.pipelines.FilePipeline': 400,

}yield item

的時候都會由經過這個FilePipeline來處理。後面的數字400表示的是優先權。 可以在此配置多個Pipeline,scrapy會根據優先級,把item依序交給各個item來處理,每個處理完的結果會傳遞給下一個pipeline來處理。 可以這樣設定多個pipeline:

ITEM_PIPELINES = {

'miao.pipelines.Pipeline00': 400,

'miao.pipelines.Pipeline01': 401,

'miao.pipelines.Pipeline02': 402,

'miao.pipelines.Pipeline03': 403,

## ...

}透過Middleware——中間件

透過Middleware——中間件

🎜🎜ware🎜透過Middleware——中間件🎜🎜🎜🎜ware🎜透過Middleware——中間件🎜🎜🎜🎜ware🎜透過Middleware——中間件🎜🎜🎜🎜讀等都可以透過Middleware來設定。 🎜🎜🎜0.Middleware的設定🎜🎜🎜與pipeline的配置類似,在setting.py中加入Middleware的名字,例如🎜DOWNLOADER_MIDDLEWARES = {

"miao.middleware.UserAgentMiddleware": 401,

"miao.middleware.ProxyMiddleware": 402,

}import random

agents = [

"Mozilla/5.0 (Windows; U; Windows NT 6.1; en-US) AppleWebKit/532.5 (KHTML, like Gecko) Chrome/4.0.249.0 Safari/532.5",

"Mozilla/5.0 (Windows; U; Windows NT 5.2; en-US) AppleWebKit/532.9 (KHTML, like Gecko) Chrome/5.0.310.0 Safari/532.9",

"Mozilla/5.0 (Windows; U; Windows NT 5.1; en-US) AppleWebKit/534.7 (KHTML, like Gecko) Chrome/7.0.514.0 Safari/534.7",

"Mozilla/5.0 (Windows; U; Windows NT 6.0; en-US) AppleWebKit/534.14 (KHTML, like Gecko) Chrome/9.0.601.0 Safari/534.14",

"Mozilla/5.0 (Windows; U; Windows NT 6.1; en-US) AppleWebKit/534.14 (KHTML, like Gecko) Chrome/10.0.601.0 Safari/534.14",

"Mozilla/5.0 (Windows; U; Windows NT 6.1; en-US) AppleWebKit/534.20 (KHTML, like Gecko) Chrome/11.0.672.2 Safari/534.20",

"Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/534.27 (KHTML, like Gecko) Chrome/12.0.712.0 Safari/534.27",

"Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/535.1 (KHTML, like Gecko) Chrome/13.0.782.24 Safari/535.1",

]

class UserAgentMiddleware(object):

def process_request(self, request, spider):

agent = random.choice(agents)

request.headers["User-Agent"] = agent某些网站不带UA是不让访问的。在miao文件夹下面建立一个middleware.py

import random

agents = [

"Mozilla/5.0 (Windows; U; Windows NT 6.1; en-US) AppleWebKit/532.5 (KHTML, like Gecko) Chrome/4.0.249.0 Safari/532.5",

"Mozilla/5.0 (Windows; U; Windows NT 5.2; en-US) AppleWebKit/532.9 (KHTML, like Gecko) Chrome/5.0.310.0 Safari/532.9",

"Mozilla/5.0 (Windows; U; Windows NT 5.1; en-US) AppleWebKit/534.7 (KHTML, like Gecko) Chrome/7.0.514.0 Safari/534.7",

"Mozilla/5.0 (Windows; U; Windows NT 6.0; en-US) AppleWebKit/534.14 (KHTML, like Gecko) Chrome/9.0.601.0 Safari/534.14",

"Mozilla/5.0 (Windows; U; Windows NT 6.1; en-US) AppleWebKit/534.14 (KHTML, like Gecko) Chrome/10.0.601.0 Safari/534.14",

"Mozilla/5.0 (Windows; U; Windows NT 6.1; en-US) AppleWebKit/534.20 (KHTML, like Gecko) Chrome/11.0.672.2 Safari/534.20",

"Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/534.27 (KHTML, like Gecko) Chrome/12.0.712.0 Safari/534.27",

"Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/535.1 (KHTML, like Gecko) Chrome/13.0.782.24 Safari/535.1",

]

class UserAgentMiddleware(object):

def process_request(self, request, spider):

agent = random.choice(agents)

request.headers["User-Agent"] = agent这里就是一个简单的随机更换UA的中间件,agents的内容可以自行扩充。

2.破网站封IP,我要用代理

比如本地127.0.0.1开启了一个8123端口的代理,同样可以通过中间件配置让爬虫通过这个代理来对目标网站进行爬取。同样在middleware.py中加入:

class ProxyMiddleware(object):

def process_request(self, request, spider):

# 此处填写你自己的代理

# 如果是买的代理的话可以去用API获取代理列表然后随机选择一个

proxy = "http://127.0.0.1:8123"

request.meta["proxy"] = proxy很多网站会对访问次数进行限制,如果访问频率过高的话会临时禁封IP。如果需要的话可以从网上购买IP,一般服务商会提供一个API来获取当前可用的IP池,选一个填到这里就好。

一些常用配置

在settings.py中的一些常用配置

# 间隔时间,单位秒。指明scrapy每两个请求之间的间隔。 DOWNLOAD_DELAY = 5 # 当访问异常时是否进行重试 RETRY_ENABLED = True # 当遇到以下http状态码时进行重试 RETRY_HTTP_CODES = [500, 502, 503, 504, 400, 403, 404, 408] # 重试次数 RETRY_TIMES = 5 # Pipeline的并发数。同时最多可以有多少个Pipeline来处理item CONCURRENT_ITEMS = 200 # 并发请求的最大数 CONCURRENT_REQUESTS = 100 # 对一个网站的最大并发数 CONCURRENT_REQUESTS_PER_DOMAIN = 50 # 对一个IP的最大并发数 CONCURRENT_REQUESTS_PER_IP = 50

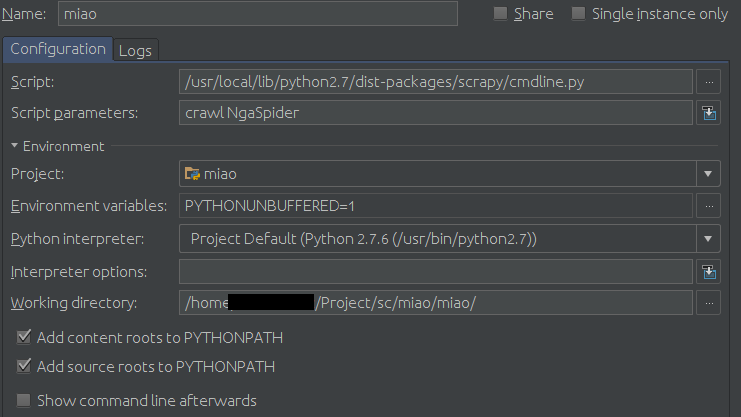

如果非要用Pycharm作为开发调试工具的话可以在运行配置里进行如下配置:

Configuration页面:

Script填你的scrapy的cmdline.py路径,比如我的是

/usr/local/lib/python2.7/dist-packages/scrapy/cmdline.py

然后在Scrpit parameters中填爬虫的名字,本例中即为:

crawl NgaSpider

最后是Working diretory,找到你的settings.py文件,填这个文件所在的目录。

示例:

按小绿箭头就可以愉快地调试了。