一. 前言

在前面的幾篇文章中我介紹如何透過Python分析原始碼爬取部落格、維基百科InfoBox和圖片,文章連結如下:

[python學習] 簡單爬取維基百科程式語言訊息盒

[Python學習] 簡單網路爬蟲抓取部落格文章及想法介紹

[python學習] 簡單爬取圖片網站圖片庫圖片

其中核心程式碼如下:

# coding=utf-8

import urllib

import re

#下载静态HTML网页

url='http://www.csdn.net/'

content = urllib.urlopen(url).read()

open('csdn.html','w+').write(content)

#获取标题

title_pat=r'(?<=<title>).*?(?=</title>)'

title_ex=re.compile(title_pat,re.M|re.S)

title_obj=re.search(title_ex, content)

title=title_obj.group()

print title

#获取超链接内容

href = r'<a href=.*?>(.*?)</a>'

m = re.findall(href,content,re.S|re.M)

for text in m:

print unicode(text,'utf-8')

break #只输出一个url登入後複製

>>>

CSDN.NET - 全球最大中文IT社区,为IT专业技术人员提供最全面的信息传播和服务平台

登录

>>>

登入後複製

## 輸出結果如下:

import os

import urllib

class AppURLopener(urllib.FancyURLopener):

version = "Mozilla/5.0"

urllib._urlopener = AppURLopener()

url = "http://creatim.allyes.com.cn/imedia/csdn/20150228/15_41_49_5B9C9E6A.jpg"

filename = os.path.basename(url)

urllib.urlretrieve(url , filename)登入後複製

# 圖片下載的核心程式碼如下:

##!/usr/bin/python

# -*- coding: utf-8 -*-

from bs4 import BeautifulSoup

html_doc = """

<html><head><title>The Dormouse's story</title></head>

<body>

<p class="title"><b>The Dormouse's story</b></p>

<p class="story">Once upon a time there were three little sisters; and their names were

<a href="http://example.com/elsie" class="sister" id="link1">Elsie</a>,

<a href="http://example.com/lacie" class="sister" id="link2">Lacie</a> and

<a href="http://example.com/tillie" class="sister" id="link3">Tillie</a>;

and they lived at the bottom of a well.</p>

<p class="story">...</p>

"""

#获取BeautifulSoup对象并按标准缩进格式输出

soup = BeautifulSoup(html_doc)

print(soup.prettify())

登入後複製

但是上面這種分析HTML來爬取網站內容的方法存在很多弊端,譬如:

1.正則表達式被HTML源碼所約束,而不是取決於更抽象的結構;網頁結構中很小的改動可能會導致程式的中斷。 2.程式需要根據實際HTML原始碼分析內容,可能會遇到字元實體如&之類的HTML特性,需要指定處理如、圖示超連結、下標等不同內容。 3.正規表示式並不是完全可讀的,更複雜的HTML程式碼和查詢表達式會變得很亂。 正如《Python基礎教學(第2版)》採用兩種解決方案:第一個是使用Tidy(Python庫)的程式和XHTML解析;第二個是使用BeautifulSoup函式庫。

二. 安裝與介紹Beautiful Soup函式庫

Beautiful Soup是用Python寫的一個HTML/XML的解析器,它可以很好的處理不規範標記並產生剖析樹(parse tree)。 它提供簡單又常用的導航navigating,搜尋以及修改剖析樹的操作。它可以大大節省你的程式時間。

正如書中所說「那些糟糕的網頁不是你寫的,你只是試圖從中獲得一些資料。現在你不用關心HTML是什麼樣子的,解析器幫你實現」。

#下載網址:

## http://www#

http://www .php.cn/

http://www.php.cn/

http://www.php.cn/

安裝流程如下圖所示:python setup.py install

## 特定使用方法建議參考中文: http://www.php.cn/

其中BeautifulSoup的用法簡單講解下,使用「愛麗絲夢遊仙境」的官方範例:

#

<html>

<head>

<title>

The Dormouse's story

</title>

</head>

<body>

<p class="title">

<b>

The Dormouse's story

</b>

</p>

<p class="story">

Once upon a time there were three little sisters; and their names were

<a class="sister" href="http://example.com/elsie" id="link1">

Elsie

</a>

,

<a class="sister" href="http://example.com/lacie" id="link2">

Lacie

</a>

and

<a class="sister" href="http://example.com/tillie" id="link3">

Tillie

</a>

;

and they lived at the bottom of a well.

</p>

<p class="story">

...

</p>

</body>

</html>登入後複製

###### ########## 依照標準的縮排格式的結構輸出###如下: ############

'''获取title值'''

print soup.title

# <title>The Dormouse's story</title>

print soup.title.name

# title

print unicode(soup.title.string)

# The Dormouse's story

'''获取<p>值'''

print soup.p

# <p class="title"><b>The Dormouse's story</b></p>

print soup.a

# <a class="sister" href="http://example.com/elsie" id="link1">Elsie</a>

'''从文档中找到<a>的所有标签链接'''

print soup.find_all('a')

# [<a class="sister" href="http://example.com/elsie" id="link1">Elsie</a>,

# <a class="sister" href="http://example.com/lacie" id="link2">Lacie</a>,

# <a class="sister" href="http://example.com/tillie" id="link3">Tillie</a>]

for link in soup.find_all('a'):

print(link.get('href'))

# http://www.php.cn/

# http://www.php.cn/

# http://www.php.cn/

print soup.find(id='link3')

# <a class="sister" href="http://example.com/tillie" id="link3">Tillie</a>登入後複製

######### 以下是BeautifulSoup庫簡單快速入門介紹:(參考:官方文件)############

'''从文档中获取所有文字内容'''

print soup.get_text()

# The Dormouse's story

#

# The Dormouse's story

#

# Once upon a time there were three little sisters; and their names were

# Elsie,

# Lacie and

# Tillie;

# and they lived at the bottom of a well.

#

# ...

登入後複製

登入後複製

######### 若想要取得文章中所有文字內容,程式碼如下:############

'''从文档中获取所有文字内容'''

print soup.get_text()

# The Dormouse's story

#

# The Dormouse's story

#

# Once upon a time there were three little sisters; and their names were

# Elsie,

# Lacie and

# Tillie;

# and they lived at the bottom of a well.

#

# ...

登入後複製

登入後複製

同时在这过程中你可能会遇到两个典型的错误提示:

1.ImportError: No module named BeautifulSoup

当你成功安装BeautifulSoup 4库后,“from BeautifulSoup import BeautifulSoup”可能会遇到该错误。

其中的原因是BeautifulSoup 4库改名为bs4,需要使用“from bs4 import BeautifulSoup”导入。

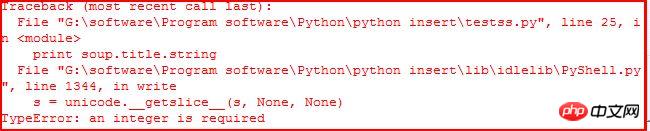

2.TypeError: an integer is required

当你使用“print soup.title.string”获取title的值时,可能会遇到该错误。如下:

它应该是IDLE的BUG,当使用命令行Command没有任何错误。参考:stackoverflow。同时可以通过下面的代码解决该问题:

print unicode(soup.title.string)

print str(soup.title.string)

三. Beautiful Soup常用方法介绍

Beautiful Soup将复杂HTML文档转换成一个复杂的树形结构,每个节点都是Python对象,所有对象可以归纳为4种:Tag、NavigableString、BeautifulSoup、Comment|

1.Tag标签

tag对象与XML或HTML文档中的tag相同,它有很多方法和属性。其中最重要的属性name和attribute。用法如下:

#!/usr/bin/python

# -*- coding: utf-8 -*-

from bs4 import BeautifulSoup

html = """

<html><head><title>The Dormouse's story</title></head>

<body>

<p class="title" id="start"><b>The Dormouse's story</b></p>

"""

soup = BeautifulSoup(html)

tag = soup.p

print tag

# <p class="title" id="start"><b>The Dormouse's story</b></p>

print type(tag)

# <class 'bs4.element.Tag'>

print tag.name

# p 标签名字

print tag['class']

# [u'title']

print tag.attrs

# {u'class': [u'title'], u'id': u'start'}登入後複製

使用BeautifulSoup每个tag都有自己的名字,可以通过.name来获取;同样一个tag可能有很多个属性,属性的操作方法与字典相同,可以直接通过“.attrs”获取属性。至于修改、删除操作请参考文档。

2.NavigableString

字符串常被包含在tag内,Beautiful Soup用NavigableString类来包装tag中的字符串。一个NavigableString字符串与Python中的Unicode字符串相同,并且还支持包含在遍历文档树和搜索文档树中的一些特性,通过unicode()方法可以直接将NavigableString对象转换成Unicode字符串。

print unicode(tag.string)

# The Dormouse's story

print type(tag.string)

# <class 'bs4.element.NavigableString'>

tag.string.replace_with("No longer bold")

print tag

# <p class="title" id="start"><b>No longer bold</b></p>登入後複製

这是获取“The Dormouse's story

”中tag = soup.p的值,其中tag中包含的字符串不能编辑,但可通过函数replace_with()替换。

NavigableString 对象支持遍历文档树和搜索文档树 中定义的大部分属性, 并非全部。尤其是一个字符串不能包含其它内容(tag能够包含字符串或是其它tag),字符串不支持 .contents 或 .string 属性或 find() 方法。

如果想在Beautiful Soup之外使用 NavigableString 对象,需要调用 unicode() 方法,将该对象转换成普通的Unicode字符串,否则就算Beautiful Soup已方法已经执行结束,该对象的输出也会带有对象的引用地址。这样会浪费内存。

3.Beautiful Soup对象

该对象表示的是一个文档的全部内容,大部分时候可以把它当做Tag对象,它支持遍历文档树和搜索文档树中的大部分方法。

注意:因为BeautifulSoup对象并不是真正的HTML或XML的tag,所以它没有name和 attribute属性,但有时查看它的.name属性可以通过BeautifulSoup对象包含的一个值为[document]的特殊实行.name实现——soup.name。

Beautiful Soup中定义的其它类型都可能会出现在XML的文档中:CData , ProcessingInstruction , Declaration , Doctype 。与 Comment 对象类似,这些类都是 NavigableString 的子类,只是添加了一些额外的方法的字符串独享。

4.Command注释

Tag、NavigableString、BeautifulSoup几乎覆盖了html和xml中的所有内容,但是还有些特殊对象容易让人担心——注释。Comment对象是一个特殊类型的NavigableString对象。

markup = "<b><!--Hey, buddy. Want to buy a used parser?--></b>"

soup = BeautifulSoup(markup)

comment = soup.b.string

print type(comment)

# <class 'bs4.element.Comment'>

print unicode(comment)

# Hey, buddy. Want to buy a used parser?

登入後複製

介绍完这四个对象后,下面简单介绍遍历文档树和搜索文档树及常用的函数。

5.遍历文档树

一个Tag可能包含多个字符串或其它的Tag,这些都是这个Tag的子节点。BeautifulSoup提供了许多操作和遍历子节点的属性。引用官方文档中爱丽丝例子:

操作文档最简单的方法是告诉你想获取tag的name,如下:

soup.head# <head><title>The Dormouse's story</title></head>soup.title# <title>The Dormouse's story</title>soup.body.b# <b>The Dormouse's story</b>

登入後複製

注意:通过点取属性的放是只能获得当前名字的第一个Tag,同时可以在文档树的tag中多次调用该方法如soup.body.b获取标签中第一个标签。

如果想得到所有的标签,使用方法find_all(),在前面的Python爬取维基百科等HTML中我们经常用到它+正则表达式的方法。

soup.find_all('a')# [<a class="sister" href="http://example.com/elsie" id="link1">Elsie</a>,# <a class="sister" href="http://example.com/lacie" id="link2">Lacie</a>,# <a class="sister" href="http://example.com/tillie" id="link3">Tillie</a>]

登入後複製

子节点:在分析HTML过程中通常需要分析tag的子节点,而tag的 .contents 属性可以将tag的子节点以列表的方式输出。字符串没有.contents属性,因为字符串没有子节点。

head_tag = soup.head

head_tag

# <head><title>The Dormouse's story</title></head>

head_tag.contents

[<title>The Dormouse's story</title>]

title_tag = head_tag.contents[0]

title_tag

# <title>The Dormouse's story</title>

title_tag.contents

# [u'The Dormouse's story']

登入後複製

通过tag的 .children 生成器,可以对tag的子节点进行循环:

for child in title_tag.children:

print(child)

# The Dormouse's story登入後複製

子孙节点:同样 .descendants 属性可以对所有tag的子孙节点进行递归循环:

for child in head_tag.descendants:

print(child)

# <title>The Dormouse's story</title>

# The Dormouse's story登入後複製

父节点:通过 .parent 属性来获取某个元素的父节点.在例子“爱丽丝”的文档中,标签是标签的父节点,换句话就是增加一层标签。<br/> <span style="color:#ff0000">注意:文档的顶层节点比如<html>的父节点是 BeautifulSoup 对象,BeautifulSoup 对象的 .parent 是None。</span><br/></span></strong></p><div class="code" style="position:relative; padding:0px; margin:0px;"><pre style="overflow-x:auto; overflow-y:hidden; padding:5px; line-height:15.6000003814697px; border-top-width:1px; border-bottom-width:1px; border-style:solid none; border-top-color:rgb(170,204,153); border-bottom-color:rgb(170,204,153); background-color:rgb(238,255,204)">title_tag = soup.titletitle_tag# <title>The Dormouse's story</title>title_tag.parent# <head><title>The Dormouse's story</title></head>title_tag.string.parent# <title>The Dormouse's story</title></pre><div class="contentsignin">登入後複製</div></div><p><strong><span style="font-size:18px"> <span style="color:#ff0000">兄弟节点</span>:因为<b>标签和<c>标签是同一层:他们是同一个元素的子节点,所以<b>和<c>可以被称为兄弟节点。一段文档以标准格式输出时,兄弟节点有相同的缩进级别.在代码中也可以使用这种关系。</span></strong><br/></p><div class="code" style="position:relative; padding:0px; margin:0px;"><pre style="overflow-x:auto; overflow-y:hidden; padding:5px; color:rgb(51,51,51); line-height:15.6000003814697px; border-top-width:1px; border-bottom-width:1px; border-style:solid none; border-top-color:rgb(170,204,153); border-bottom-color:rgb(170,204,153); background-color:rgb(238,255,204)">sibling_soup = BeautifulSoup("<a><b>text1</b><c>text2</c></b></a>")print(sibling_soup.prettify())# <html># <body># <a># <b># text1# </b># <c># text2# </c># </a># </body># </html></pre><div class="contentsignin">登入後複製</div></div><p><strong><span style="font-size:18px"> <span style="color:#ff0000">在文档树中,使用 .next_sibling 和 .previous_sibling 属性来查询兄弟节点。<b>标签有.next_sibling 属性,但是没有.previous_sibling 属性,因为<b>标签在同级节点中是第一个。同理<c>标签有.previous_sibling 属性,却没有.next_sibling 属性:</span></span></strong><br/></p><div class="code" style="position:relative; padding:0px; margin:0px;"><pre style="overflow-x:auto; overflow-y:hidden; padding:5px; color:rgb(51,51,51); line-height:15.6000003814697px; border-top-width:1px; border-bottom-width:1px; border-style:solid none; border-top-color:rgb(170,204,153); border-bottom-color:rgb(170,204,153); background-color:rgb(238,255,204)">sibling_soup.b.next_sibling# <c>text2</c>sibling_soup.c.previous_sibling# <b>text1</b></pre><div class="contentsignin">登入後複製</div></div><p><strong><span style="font-size:18px"> 介绍到这里基本就可以实现我们的BeautifulSoup库爬取网页内容,而网页修改、删除等内容建议大家阅读文档。下一篇文章就再次爬取维基百科的程序语言的内容吧!希望文章对大家有所帮助,如果有错误或不足之处,还请海涵!建议大家阅读官方文档和《Python基础教程》书。</span><br><span style="font-size:18px; color:rgb(51,51,51); font-family:Arial; line-height:26px"> </span><span style="font-size:18px; font-family:Arial; line-height:26px"><span style="color:#ff0000"> (By:Eastmount 2015-3-25 下午6点</span></span><span style="font-size:18px; color:rgb(51,51,51); font-family:Arial; line-height:26px">

</span>http://www.php.cn/<span style="font-family:Arial; color:#ff0000"><span style="font-size:18px; line-height:26px">)</span></span></strong><br></p>

<p></p>

<p><br></p>

<p class="pmark"><br></p>

<p>

</p><p>以上是Python之BeautifulSoup庫安裝及其簡介的詳細內容。更多資訊請關注PHP中文網其他相關文章!</p>

</div>

</div>

<div class="wzconShengming_sp">

<div class="bzsmdiv_sp">本網站聲明</div>

<div>本文內容由網友自願投稿,版權歸原作者所有。本站不承擔相應的法律責任。如發現涉嫌抄襲或侵權的內容,請聯絡admin@php.cn</div>

</div>

</div>

<ins class="adsbygoogle"

style="display:block"

data-ad-format="autorelaxed"

data-ad-client="ca-pub-5902227090019525"

data-ad-slot="2507867629"></ins>

<script>

(adsbygoogle = window.adsbygoogle || []).push({});

</script>

<div class="AI_ToolDetails_main4sR">

<ins class="adsbygoogle"

style="display:block"

data-ad-client="ca-pub-5902227090019525"

data-ad-slot="3653428331"

data-ad-format="auto"

data-full-width-responsive="true"></ins>

<script>

(adsbygoogle = window.adsbygoogle || []).push({});

</script>

<!-- <div class="phpgenera_Details_mainR4">

<div class="phpmain1_4R_readrank">

<div class="phpmain1_4R_readrank_top">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

src="/static/imghw/hotarticle2.png" alt="" />

<h2>熱門文章</h2>

</div>

<div class="phpgenera_Details_mainR4_bottom">

<div class="phpgenera_Details_mainR4_bottoms">

<a href="https://www.php.cn/zh-tw/faq/1796797907.html" title="<🎜>:種植花園 - 完整的突變指南" class="phpgenera_Details_mainR4_bottom_title"><🎜>:種植花園 - 完整的突變指南</a>

<div class="phpgenera_Details_mainR4_bottoms_info">

<span>3 週前</span>

<span>By DDD</span>

</div>

</div>

<div class="phpgenera_Details_mainR4_bottoms">

<a href="https://www.php.cn/zh-tw/faq/1796797130.html" title="<🎜>:泡泡膠模擬器無窮大 - 如何獲取和使用皇家鑰匙" class="phpgenera_Details_mainR4_bottom_title"><🎜>:泡泡膠模擬器無窮大 - 如何獲取和使用皇家鑰匙</a>

<div class="phpgenera_Details_mainR4_bottoms_info">

<span>3 週前</span>

<span>By 尊渡假赌尊渡假赌尊渡假赌</span>

</div>

</div>

<div class="phpgenera_Details_mainR4_bottoms">

<a href="https://www.php.cn/zh-tw/faq/1796796771.html" title="如何修復KB5055612無法在Windows 10中安裝?" class="phpgenera_Details_mainR4_bottom_title">如何修復KB5055612無法在Windows 10中安裝?</a>

<div class="phpgenera_Details_mainR4_bottoms_info">

<span>3 週前</span>

<span>By DDD</span>

</div>

</div>

<div class="phpgenera_Details_mainR4_bottoms">

<a href="https://www.php.cn/zh-tw/faq/1796796926.html" title="北端:融合系統,解釋" class="phpgenera_Details_mainR4_bottom_title">北端:融合系統,解釋</a>

<div class="phpgenera_Details_mainR4_bottoms_info">

<span>3 週前</span>

<span>By 尊渡假赌尊渡假赌尊渡假赌</span>

</div>

</div>

<div class="phpgenera_Details_mainR4_bottoms">

<a href="https://www.php.cn/zh-tw/faq/1796797896.html" title="Mandragora:巫婆樹的耳語 - 如何解鎖抓鉤" class="phpgenera_Details_mainR4_bottom_title">Mandragora:巫婆樹的耳語 - 如何解鎖抓鉤</a>

<div class="phpgenera_Details_mainR4_bottoms_info">

<span>3 週前</span>

<span>By 尊渡假赌尊渡假赌尊渡假赌</span>

</div>

</div>

</div>

<div class="phpgenera_Details_mainR3_more">

<a href="https://www.php.cn/zh-tw/article.html">顯示更多</a>

</div>

</div>

</div> -->

<div class="phpgenera_Details_mainR3">

<div class="phpmain1_4R_readrank">

<div class="phpmain1_4R_readrank_top">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

src="/static/imghw/hottools2.png" alt="" />

<h2>熱AI工具</h2>

</div>

<div class="phpgenera_Details_mainR3_bottom">

<div class="phpmain_tab2_mids_top">

<a href="https://www.php.cn/zh-tw/ai/undresserai-undress" title="Undresser.AI Undress" class="phpmain_tab2_mids_top_img">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

class="lazy" data-src="https://img.php.cn/upload/ai_manual/001/246/273/173411540686492.jpg?x-oss-process=image/resize,m_fill,h_50,w_50" src="/static/imghw/default1.png" alt="Undresser.AI Undress" />

</a>

<div class="phpmain_tab2_mids_info">

<a href="https://www.php.cn/zh-tw/ai/undresserai-undress" title="Undresser.AI Undress" class="phpmain_tab2_mids_title">

<h3>Undresser.AI Undress</h3>

</a>

<p>人工智慧驅動的應用程序,用於創建逼真的裸體照片</p>

</div>

</div>

<div class="phpmain_tab2_mids_top">

<a href="https://www.php.cn/zh-tw/ai/ai-clothes-remover" title="AI Clothes Remover" class="phpmain_tab2_mids_top_img">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

class="lazy" data-src="https://img.php.cn/upload/ai_manual/001/246/273/173411552797167.jpg?x-oss-process=image/resize,m_fill,h_50,w_50" src="/static/imghw/default1.png" alt="AI Clothes Remover" />

</a>

<div class="phpmain_tab2_mids_info">

<a href="https://www.php.cn/zh-tw/ai/ai-clothes-remover" title="AI Clothes Remover" class="phpmain_tab2_mids_title">

<h3>AI Clothes Remover</h3>

</a>

<p>用於從照片中去除衣服的線上人工智慧工具。</p>

</div>

</div>

<div class="phpmain_tab2_mids_top">

<a href="https://www.php.cn/zh-tw/ai/undress-ai-tool" title="Undress AI Tool" class="phpmain_tab2_mids_top_img">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

class="lazy" data-src="https://img.php.cn/upload/ai_manual/001/246/273/173410641626608.jpg?x-oss-process=image/resize,m_fill,h_50,w_50" src="/static/imghw/default1.png" alt="Undress AI Tool" />

</a>

<div class="phpmain_tab2_mids_info">

<a href="https://www.php.cn/zh-tw/ai/undress-ai-tool" title="Undress AI Tool" class="phpmain_tab2_mids_title">

<h3>Undress AI Tool</h3>

</a>

<p>免費脫衣圖片</p>

</div>

</div>

<div class="phpmain_tab2_mids_top">

<a href="https://www.php.cn/zh-tw/ai/clothoffio" title="Clothoff.io" class="phpmain_tab2_mids_top_img">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

class="lazy" data-src="https://img.php.cn/upload/ai_manual/001/246/273/173411529149311.jpg?x-oss-process=image/resize,m_fill,h_50,w_50" src="/static/imghw/default1.png" alt="Clothoff.io" />

</a>

<div class="phpmain_tab2_mids_info">

<a href="https://www.php.cn/zh-tw/ai/clothoffio" title="Clothoff.io" class="phpmain_tab2_mids_title">

<h3>Clothoff.io</h3>

</a>

<p>AI脫衣器</p>

</div>

</div>

<div class="phpmain_tab2_mids_top">

<a href="https://www.php.cn/zh-tw/ai/video-swap" title="Video Face Swap" class="phpmain_tab2_mids_top_img">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

class="lazy" data-src="https://img.php.cn/upload/ai_manual/001/246/273/173414504068133.jpg?x-oss-process=image/resize,m_fill,h_50,w_50" src="/static/imghw/default1.png" alt="Video Face Swap" />

</a>

<div class="phpmain_tab2_mids_info">

<a href="https://www.php.cn/zh-tw/ai/video-swap" title="Video Face Swap" class="phpmain_tab2_mids_title">

<h3>Video Face Swap</h3>

</a>

<p>使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!</p>

</div>

</div>

</div>

<div class="phpgenera_Details_mainR3_more">

<a href="https://www.php.cn/zh-tw/ai">顯示更多</a>

</div>

</div>

</div>

<script src="https://sw.php.cn/hezuo/cac1399ab368127f9b113b14eb3316d0.js" type="text/javascript"></script>

<div class="phpgenera_Details_mainR4">

<div class="phpmain1_4R_readrank">

<div class="phpmain1_4R_readrank_top">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

src="/static/imghw/hotarticle2.png" alt="" />

<h2>熱門文章</h2>

</div>

<div class="phpgenera_Details_mainR4_bottom">

<div class="phpgenera_Details_mainR4_bottoms">

<a href="https://www.php.cn/zh-tw/faq/1796797907.html" title="<🎜>:種植花園 - 完整的突變指南" class="phpgenera_Details_mainR4_bottom_title"><🎜>:種植花園 - 完整的突變指南</a>

<div class="phpgenera_Details_mainR4_bottoms_info">

<span>3 週前</span>

<span>By DDD</span>

</div>

</div>

<div class="phpgenera_Details_mainR4_bottoms">

<a href="https://www.php.cn/zh-tw/faq/1796797130.html" title="<🎜>:泡泡膠模擬器無窮大 - 如何獲取和使用皇家鑰匙" class="phpgenera_Details_mainR4_bottom_title"><🎜>:泡泡膠模擬器無窮大 - 如何獲取和使用皇家鑰匙</a>

<div class="phpgenera_Details_mainR4_bottoms_info">

<span>3 週前</span>

<span>By 尊渡假赌尊渡假赌尊渡假赌</span>

</div>

</div>

<div class="phpgenera_Details_mainR4_bottoms">

<a href="https://www.php.cn/zh-tw/faq/1796796771.html" title="如何修復KB5055612無法在Windows 10中安裝?" class="phpgenera_Details_mainR4_bottom_title">如何修復KB5055612無法在Windows 10中安裝?</a>

<div class="phpgenera_Details_mainR4_bottoms_info">

<span>3 週前</span>

<span>By DDD</span>

</div>

</div>

<div class="phpgenera_Details_mainR4_bottoms">

<a href="https://www.php.cn/zh-tw/faq/1796796926.html" title="北端:融合系統,解釋" class="phpgenera_Details_mainR4_bottom_title">北端:融合系統,解釋</a>

<div class="phpgenera_Details_mainR4_bottoms_info">

<span>3 週前</span>

<span>By 尊渡假赌尊渡假赌尊渡假赌</span>

</div>

</div>

<div class="phpgenera_Details_mainR4_bottoms">

<a href="https://www.php.cn/zh-tw/faq/1796797896.html" title="Mandragora:巫婆樹的耳語 - 如何解鎖抓鉤" class="phpgenera_Details_mainR4_bottom_title">Mandragora:巫婆樹的耳語 - 如何解鎖抓鉤</a>

<div class="phpgenera_Details_mainR4_bottoms_info">

<span>3 週前</span>

<span>By 尊渡假赌尊渡假赌尊渡假赌</span>

</div>

</div>

</div>

<div class="phpgenera_Details_mainR3_more">

<a href="https://www.php.cn/zh-tw/article.html">顯示更多</a>

</div>

</div>

</div>

<div class="phpgenera_Details_mainR3">

<div class="phpmain1_4R_readrank">

<div class="phpmain1_4R_readrank_top">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

src="/static/imghw/hottools2.png" alt="" />

<h2>熱工具</h2>

</div>

<div class="phpgenera_Details_mainR3_bottom">

<div class="phpmain_tab2_mids_top">

<a href="https://www.php.cn/zh-tw/toolset/development-tools/92" title="記事本++7.3.1" class="phpmain_tab2_mids_top_img">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

class="lazy" data-src="https://img.php.cn/upload/manual/000/000/001/58ab96f0f39f7357.jpg?x-oss-process=image/resize,m_fill,h_50,w_72" src="/static/imghw/default1.png" alt="記事本++7.3.1" />

</a>

<div class="phpmain_tab2_mids_info">

<a href="https://www.php.cn/zh-tw/toolset/development-tools/92" title="記事本++7.3.1" class="phpmain_tab2_mids_title">

<h3>記事本++7.3.1</h3>

</a>

<p>好用且免費的程式碼編輯器</p>

</div>

</div>

<div class="phpmain_tab2_mids_top">

<a href="https://www.php.cn/zh-tw/toolset/development-tools/93" title="SublimeText3漢化版" class="phpmain_tab2_mids_top_img">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

class="lazy" data-src="https://img.php.cn/upload/manual/000/000/001/58ab97a3baad9677.jpg?x-oss-process=image/resize,m_fill,h_50,w_72" src="/static/imghw/default1.png" alt="SublimeText3漢化版" />

</a>

<div class="phpmain_tab2_mids_info">

<a href="https://www.php.cn/zh-tw/toolset/development-tools/93" title="SublimeText3漢化版" class="phpmain_tab2_mids_title">

<h3>SublimeText3漢化版</h3>

</a>

<p>中文版,非常好用</p>

</div>

</div>

<div class="phpmain_tab2_mids_top">

<a href="https://www.php.cn/zh-tw/toolset/development-tools/121" title="禪工作室 13.0.1" class="phpmain_tab2_mids_top_img">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

class="lazy" data-src="https://img.php.cn/upload/manual/000/000/001/58ab97ecd1ab2670.jpg?x-oss-process=image/resize,m_fill,h_50,w_72" src="/static/imghw/default1.png" alt="禪工作室 13.0.1" />

</a>

<div class="phpmain_tab2_mids_info">

<a href="https://www.php.cn/zh-tw/toolset/development-tools/121" title="禪工作室 13.0.1" class="phpmain_tab2_mids_title">

<h3>禪工作室 13.0.1</h3>

</a>

<p>強大的PHP整合開發環境</p>

</div>

</div>

<div class="phpmain_tab2_mids_top">

<a href="https://www.php.cn/zh-tw/toolset/development-tools/469" title="Dreamweaver CS6" class="phpmain_tab2_mids_top_img">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

class="lazy" data-src="https://img.php.cn/upload/manual/000/000/001/58d0e0fc74683535.jpg?x-oss-process=image/resize,m_fill,h_50,w_72" src="/static/imghw/default1.png" alt="Dreamweaver CS6" />

</a>

<div class="phpmain_tab2_mids_info">

<a href="https://www.php.cn/zh-tw/toolset/development-tools/469" title="Dreamweaver CS6" class="phpmain_tab2_mids_title">

<h3>Dreamweaver CS6</h3>

</a>

<p>視覺化網頁開發工具</p>

</div>

</div>

<div class="phpmain_tab2_mids_top">

<a href="https://www.php.cn/zh-tw/toolset/development-tools/500" title="SublimeText3 Mac版" class="phpmain_tab2_mids_top_img">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

class="lazy" data-src="https://img.php.cn/upload/manual/000/000/001/58d34035e2757995.png?x-oss-process=image/resize,m_fill,h_50,w_72" src="/static/imghw/default1.png" alt="SublimeText3 Mac版" />

</a>

<div class="phpmain_tab2_mids_info">

<a href="https://www.php.cn/zh-tw/toolset/development-tools/500" title="SublimeText3 Mac版" class="phpmain_tab2_mids_title">

<h3>SublimeText3 Mac版</h3>

</a>

<p>神級程式碼編輯軟體(SublimeText3)</p>

</div>

</div>

</div>

<div class="phpgenera_Details_mainR3_more">

<a href="https://www.php.cn/zh-tw/ai">顯示更多</a>

</div>

</div>

</div>

<div class="phpgenera_Details_mainR4">

<div class="phpmain1_4R_readrank">

<div class="phpmain1_4R_readrank_top">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

src="/static/imghw/hotarticle2.png" alt="" />

<h2>熱門話題</h2>

</div>

<div class="phpgenera_Details_mainR4_bottom">

<div class="phpgenera_Details_mainR4_bottoms">

<a href="https://www.php.cn/zh-tw/faq/java-tutorial" title="Java教學" class="phpgenera_Details_mainR4_bottom_title">Java教學</a>

<div class="phpgenera_Details_mainR4_bottoms_info">

<div class="phpgenera_Details_mainR4_bottoms_infos">

<img src="/static/imghw/eyess.png" alt="" />

<span>1666</span>

</div>

<div class="phpgenera_Details_mainR4_bottoms_infos">

<img src="/static/imghw/tiezi.png" alt="" />

<span>14</span>

</div>

</div>

</div>

<div class="phpgenera_Details_mainR4_bottoms">

<a href="https://www.php.cn/zh-tw/faq/cakephp-tutor" title="CakePHP 教程" class="phpgenera_Details_mainR4_bottom_title">CakePHP 教程</a>

<div class="phpgenera_Details_mainR4_bottoms_info">

<div class="phpgenera_Details_mainR4_bottoms_infos">

<img src="/static/imghw/eyess.png" alt="" />

<span>1425</span>

</div>

<div class="phpgenera_Details_mainR4_bottoms_infos">

<img src="/static/imghw/tiezi.png" alt="" />

<span>52</span>

</div>

</div>

</div>

<div class="phpgenera_Details_mainR4_bottoms">

<a href="https://www.php.cn/zh-tw/faq/laravel-tutori" title="Laravel 教程" class="phpgenera_Details_mainR4_bottom_title">Laravel 教程</a>

<div class="phpgenera_Details_mainR4_bottoms_info">

<div class="phpgenera_Details_mainR4_bottoms_infos">

<img src="/static/imghw/eyess.png" alt="" />

<span>1327</span>

</div>

<div class="phpgenera_Details_mainR4_bottoms_infos">

<img src="/static/imghw/tiezi.png" alt="" />

<span>25</span>

</div>

</div>

</div>

<div class="phpgenera_Details_mainR4_bottoms">

<a href="https://www.php.cn/zh-tw/faq/php-tutorial" title="PHP教程" class="phpgenera_Details_mainR4_bottom_title">PHP教程</a>

<div class="phpgenera_Details_mainR4_bottoms_info">

<div class="phpgenera_Details_mainR4_bottoms_infos">

<img src="/static/imghw/eyess.png" alt="" />

<span>1273</span>

</div>

<div class="phpgenera_Details_mainR4_bottoms_infos">

<img src="/static/imghw/tiezi.png" alt="" />

<span>29</span>

</div>

</div>

</div>

<div class="phpgenera_Details_mainR4_bottoms">

<a href="https://www.php.cn/zh-tw/faq/c-tutorial" title="C# 教程" class="phpgenera_Details_mainR4_bottom_title">C# 教程</a>

<div class="phpgenera_Details_mainR4_bottoms_info">

<div class="phpgenera_Details_mainR4_bottoms_infos">

<img src="/static/imghw/eyess.png" alt="" />

<span>1252</span>

</div>

<div class="phpgenera_Details_mainR4_bottoms_infos">

<img src="/static/imghw/tiezi.png" alt="" />

<span>24</span>

</div>

</div>

</div>

</div>

<div class="phpgenera_Details_mainR3_more">

<a href="https://www.php.cn/zh-tw/faq/zt">顯示更多</a>

</div>

</div>

</div>

</div>

</div>

<div class="Article_Details_main2">

<div class="phpgenera_Details_mainL4">

<div class="phpmain1_2_top">

<a href="javascript:void(0);" class="phpmain1_2_top_title">Related knowledge<img

src="/static/imghw/index2_title2.png" alt="" /></a>

</div>

<div class="phpgenera_Details_mainL4_info">

<div class="phphistorical_Version2_mids">

<a href="https://www.php.cn/zh-tw/faq/1796797869.html" title="PHP和Python:解釋了不同的範例" class="phphistorical_Version2_mids_img">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

src="/static/imghw/default1.png" class="lazy" data-src="https://img.php.cn/upload/article/001/253/068/174490716137257.jpg?x-oss-process=image/resize,m_fill,h_207,w_330" alt="PHP和Python:解釋了不同的範例" />

</a>

<a href="https://www.php.cn/zh-tw/faq/1796797869.html" title="PHP和Python:解釋了不同的範例" class="phphistorical_Version2_mids_title">PHP和Python:解釋了不同的範例</a>

<span class="Articlelist_txts_time">Apr 18, 2025 am 12:26 AM</span>

<p class="Articlelist_txts_p">PHP主要是過程式編程,但也支持面向對象編程(OOP);Python支持多種範式,包括OOP、函數式和過程式編程。 PHP適合web開發,Python適用於多種應用,如數據分析和機器學習。</p>

</div>

<div class="phphistorical_Version2_mids">

<a href="https://www.php.cn/zh-tw/faq/1796797864.html" title="在PHP和Python之間進行選擇:指南" class="phphistorical_Version2_mids_img">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

src="/static/imghw/default1.png" class="lazy" data-src="https://img.php.cn/upload/article/001/253/068/174490706146904.jpg?x-oss-process=image/resize,m_fill,h_207,w_330" alt="在PHP和Python之間進行選擇:指南" />

</a>

<a href="https://www.php.cn/zh-tw/faq/1796797864.html" title="在PHP和Python之間進行選擇:指南" class="phphistorical_Version2_mids_title">在PHP和Python之間進行選擇:指南</a>

<span class="Articlelist_txts_time">Apr 18, 2025 am 12:24 AM</span>

<p class="Articlelist_txts_p">PHP適合網頁開發和快速原型開發,Python適用於數據科學和機器學習。 1.PHP用於動態網頁開發,語法簡單,適合快速開發。 2.Python語法簡潔,適用於多領域,庫生態系統強大。</p>

</div>

<div class="phphistorical_Version2_mids">

<a href="https://www.php.cn/zh-tw/faq/1796796981.html" title="sublime怎麼運行代碼python" class="phphistorical_Version2_mids_img">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

src="/static/imghw/default1.png" class="lazy" data-src="https://img.php.cn/upload/article/202412/09/2024120916311859115.jpg?x-oss-process=image/resize,m_fill,h_207,w_330" alt="sublime怎麼運行代碼python" />

</a>

<a href="https://www.php.cn/zh-tw/faq/1796796981.html" title="sublime怎麼運行代碼python" class="phphistorical_Version2_mids_title">sublime怎麼運行代碼python</a>

<span class="Articlelist_txts_time">Apr 16, 2025 am 08:48 AM</span>

<p class="Articlelist_txts_p">在 Sublime Text 中運行 Python 代碼,需先安裝 Python 插件,再創建 .py 文件並編寫代碼,最後按 Ctrl B 運行代碼,輸出會在控制台中顯示。</p>

</div>

<div class="phphistorical_Version2_mids">

<a href="https://www.php.cn/zh-tw/faq/1796797866.html" title="PHP和Python:深入了解他們的歷史" class="phphistorical_Version2_mids_img">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

src="/static/imghw/default1.png" class="lazy" data-src="https://img.php.cn/upload/article/001/253/068/174490710066424.jpg?x-oss-process=image/resize,m_fill,h_207,w_330" alt="PHP和Python:深入了解他們的歷史" />

</a>

<a href="https://www.php.cn/zh-tw/faq/1796797866.html" title="PHP和Python:深入了解他們的歷史" class="phphistorical_Version2_mids_title">PHP和Python:深入了解他們的歷史</a>

<span class="Articlelist_txts_time">Apr 18, 2025 am 12:25 AM</span>

<p class="Articlelist_txts_p">PHP起源於1994年,由RasmusLerdorf開發,最初用於跟踪網站訪問者,逐漸演變為服務器端腳本語言,廣泛應用於網頁開發。 Python由GuidovanRossum於1980年代末開發,1991年首次發布,強調代碼可讀性和簡潔性,適用於科學計算、數據分析等領域。</p>

</div>

<div class="phphistorical_Version2_mids">

<a href="https://www.php.cn/zh-tw/faq/1796796853.html" title="Python vs. JavaScript:學習曲線和易用性" class="phphistorical_Version2_mids_img">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

src="/static/imghw/default1.png" class="lazy" data-src="https://img.php.cn/upload/article/001/253/068/174473354083140.jpg?x-oss-process=image/resize,m_fill,h_207,w_330" alt="Python vs. JavaScript:學習曲線和易用性" />

</a>

<a href="https://www.php.cn/zh-tw/faq/1796796853.html" title="Python vs. JavaScript:學習曲線和易用性" class="phphistorical_Version2_mids_title">Python vs. JavaScript:學習曲線和易用性</a>

<span class="Articlelist_txts_time">Apr 16, 2025 am 12:12 AM</span>

<p class="Articlelist_txts_p">Python更適合初學者,學習曲線平緩,語法簡潔;JavaScript適合前端開發,學習曲線較陡,語法靈活。 1.Python語法直觀,適用於數據科學和後端開發。 2.JavaScript靈活,廣泛用於前端和服務器端編程。</p>

</div>

<div class="phphistorical_Version2_mids">

<a href="https://www.php.cn/zh-tw/faq/1796798371.html" title="Golang vs. Python:性能和可伸縮性" class="phphistorical_Version2_mids_img">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

src="/static/imghw/default1.png" class="lazy" data-src="https://img.php.cn/upload/article/001/253/068/174499313063650.jpg?x-oss-process=image/resize,m_fill,h_207,w_330" alt="Golang vs. Python:性能和可伸縮性" />

</a>

<a href="https://www.php.cn/zh-tw/faq/1796798371.html" title="Golang vs. Python:性能和可伸縮性" class="phphistorical_Version2_mids_title">Golang vs. Python:性能和可伸縮性</a>

<span class="Articlelist_txts_time">Apr 19, 2025 am 12:18 AM</span>

<p class="Articlelist_txts_p">Golang在性能和可擴展性方面優於Python。 1)Golang的編譯型特性和高效並發模型使其在高並發場景下表現出色。 2)Python作為解釋型語言,執行速度較慢,但通過工具如Cython可優化性能。</p>

</div>

<div class="phphistorical_Version2_mids">

<a href="https://www.php.cn/zh-tw/faq/1796796768.html" title="vscode在哪寫代碼" class="phphistorical_Version2_mids_img">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

src="/static/imghw/default1.png" class="lazy" data-src="https://img.php.cn/upload/article/202407/31/2024073120544824396.jpg?x-oss-process=image/resize,m_fill,h_207,w_330" alt="vscode在哪寫代碼" />

</a>

<a href="https://www.php.cn/zh-tw/faq/1796796768.html" title="vscode在哪寫代碼" class="phphistorical_Version2_mids_title">vscode在哪寫代碼</a>

<span class="Articlelist_txts_time">Apr 15, 2025 pm 09:54 PM</span>

<p class="Articlelist_txts_p">在 Visual Studio Code(VSCode)中編寫代碼簡單易行,只需安裝 VSCode、創建項目、選擇語言、創建文件、編寫代碼、保存並運行即可。 VSCode 的優點包括跨平台、免費開源、強大功能、擴展豐富,以及輕量快速。</p>

</div>

<div class="phphistorical_Version2_mids">

<a href="https://www.php.cn/zh-tw/faq/1796797229.html" title="notepad 怎麼運行python" class="phphistorical_Version2_mids_img">

<img onerror="this.onerror=''; this.src='/static/imghw/default1.png'"

src="/static/imghw/default1.png" class="lazy" data-src="https://img.php.cn/upload/article/202405/29/2024052914541688364.jpg?x-oss-process=image/resize,m_fill,h_207,w_330" alt="notepad 怎麼運行python" />

</a>

<a href="https://www.php.cn/zh-tw/faq/1796797229.html" title="notepad 怎麼運行python" class="phphistorical_Version2_mids_title">notepad 怎麼運行python</a>

<span class="Articlelist_txts_time">Apr 16, 2025 pm 07:33 PM</span>

<p class="Articlelist_txts_p">在 Notepad 中運行 Python 代碼需要安裝 Python 可執行文件和 NppExec 插件。安裝 Python 並為其添加 PATH 後,在 NppExec 插件中配置命令為“python”、參數為“{CURRENT_DIRECTORY}{FILE_NAME}”,即可在 Notepad 中通過快捷鍵“F6”運行 Python 代碼。</p>

</div>

</div>

<a href="https://www.php.cn/zh-tw/be/" class="phpgenera_Details_mainL4_botton">

<span>See all articles</span>

<img src="/static/imghw/down_right.png" alt="" />

</a>

</div>

</div>

</div>

</main>

<footer>

<div class="footer">

<div class="footertop">

<img src="/static/imghw/logo.png" alt="">

<p>公益線上PHP培訓,幫助PHP學習者快速成長!</p>

</div>

<div class="footermid">

<a href="https://www.php.cn/zh-tw/about/us.html">關於我們</a>

<a href="https://www.php.cn/zh-tw/about/disclaimer.html">免責聲明</a>

<a href="https://www.php.cn/zh-tw/update/article_0_1.html">Sitemap</a>

</div>

<div class="footerbottom">

<p>

© php.cn All rights reserved

</p>

</div>

</div>

</footer>

<input type="hidden" id="verifycode" value="/captcha.html">

<script>layui.use(['element', 'carousel'], function () {var element = layui.element;$ = layui.jquery;var carousel = layui.carousel;carousel.render({elem: '#test1', width: '100%', height: '330px', arrow: 'always'});$.getScript('/static/js/jquery.lazyload.min.js', function () {$("img").lazyload({placeholder: "/static/images/load.jpg", effect: "fadeIn", threshold: 200, skip_invisible: false});});});</script>

<script src="/static/js/common_new.js"></script>

<script type="text/javascript" src="/static/js/jquery.cookie.js?1747061248"></script>

<script src="https://vdse.bdstatic.com//search-video.v1.min.js"></script>

<link rel='stylesheet' id='_main-css' href='/static/css/viewer.min.css?2' type='text/css' media='all' />

<script type='text/javascript' src='/static/js/viewer.min.js?1'></script>

<script type='text/javascript' src='/static/js/jquery-viewer.min.js'></script>

<script type="text/javascript" src="/static/js/global.min.js?5.5.53"></script>

<script>

var _paq = window._paq = window._paq || [];

/* tracker methods like "setCustomDimension" should be called before "trackPageView" */

_paq.push(['trackPageView']);

_paq.push(['enableLinkTracking']);

(function () {

var u = "https://tongji.php.cn/";

_paq.push(['setTrackerUrl', u + 'matomo.php']);

_paq.push(['setSiteId', '9']);

var d = document,

g = d.createElement('script'),

s = d.getElementsByTagName('script')[0];

g.async = true;

g.src = u + 'matomo.js';

s.parentNode.insertBefore(g, s);

})();

</script>

<script>

// top

layui.use(function () {

var util = layui.util;

util.fixbar({

on: {

mouseenter: function (type) {

layer.tips(type, this, {

tips: 4,

fixed: true,

});

},

mouseleave: function (type) {

layer.closeAll("tips");

},

},

});

});

document.addEventListener("DOMContentLoaded", (event) => {

// 定义一个函数来处理滚动链接的点击事件

function setupScrollLink(scrollLinkId, targetElementId) {

const scrollLink = document.getElementById(scrollLinkId);

const targetElement = document.getElementById(targetElementId);

if (scrollLink && targetElement) {

scrollLink.addEventListener("click", (e) => {

e.preventDefault(); // 阻止默认链接行为

targetElement.scrollIntoView({

behavior: "smooth"

}); // 平滑滚动到目标元素

});

} else {

console.warn(

`Either scroll link with ID '${scrollLinkId}' or target element with ID '${targetElementId}' not found.`

);

}

}

// 使用该函数设置多个滚动链接

setupScrollLink("Article_Details_main1L2s_1", "article_main_title1");

setupScrollLink("Article_Details_main1L2s_2", "article_main_title2");

setupScrollLink("Article_Details_main1L2s_3", "article_main_title3");

setupScrollLink("Article_Details_main1L2s_4", "article_main_title4");

setupScrollLink("Article_Details_main1L2s_5", "article_main_title5");

setupScrollLink("Article_Details_main1L2s_6", "article_main_title6");

// 可以继续添加更多的滚动链接设置

});

window.addEventListener("scroll", function () {

var fixedElement = document.getElementById("Article_Details_main1Lmain");

var scrollTop = window.scrollY || document.documentElement.scrollTop; // 兼容不同浏览器

var clientHeight = window.innerHeight || document.documentElement.clientHeight; // 视口高度

var scrollHeight = document.documentElement.scrollHeight; // 页面总高度

// 计算距离底部的距离

var distanceToBottom = scrollHeight - scrollTop - clientHeight;

// 当距离底部小于或等于300px时,取消固定定位

if (distanceToBottom <= 980) {

fixedElement.classList.remove("Article_Details_main1Lmain");

fixedElement.classList.add("Article_Details_main1Lmain_relative");

} else {

// 否则,保持固定定位

fixedElement.classList.remove("Article_Details_main1Lmain_relative");

fixedElement.classList.add("Article_Details_main1Lmain");

}

});

</script>

<script>

document.addEventListener('DOMContentLoaded', function() {

const mainNav = document.querySelector('.Article_Details_main1Lmain');

const header = document.querySelector('header');

if (mainNav) {

window.addEventListener('scroll', function() {

const scrollPosition = window.scrollY;

if (scrollPosition > 84) {

mainNav.classList.add('fixed');

} else {

mainNav.classList.remove('fixed');

}

});

}

});

</script>

</body>

</html>

http://www.php.cn/

http://www.php.cn/