python機器學習決策樹詳細介紹

決策樹(Decision Trees ,DTs)是一種無監督的學習方法,用於分類和回歸。

優點:計算複雜度不高,輸出結果易於理解,對中間值缺失不敏感,可以處理不相關的特徵資料

缺點:可能會產生過度匹配的問題

適用資料型別:數值型與標稱型source code下載https://www.manning.com/books/machine-learning-in-action

執行demo

關鍵演算法

尋找分割資料集的最佳特徵

分割資料集

建立分支節點

呼叫函數createBranch並增加回傳結果到分支節點中

return 分支節點對應程式碼

class#class##class#class#class#class#class#class#class#class#class#class#class#class#class#class#class#class#class#class#4class

List

= [example[-1] for example in dataSet] 不是dataset[-1] {dataset倒數第一個元素} ,而這時裡,dataset每一個元素裡的倒數第一元素 if classList.count(classList[0]) == len(classList): 如果傳回分類List count類型一樣,則傳回該類型!在子節點是否可分類如是一類型回傳 否則遞歸

往下分類 return classList[0]#stop splitting when all of the classes are equal## == 1: #stop splitting when there are no more features in dataSet 如果只有一個元素 return majorityCnt(classList) Tope return majorityCnt(classList) Tope return majorityCnt(classList)

ature 尾) 選擇最好的特徵。索引

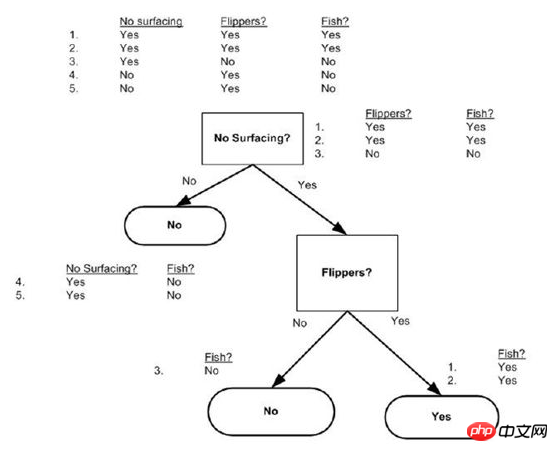

bestFeatLabel = labels[bestFeat ] 而得到這個label flippers 還是no surfaces 呢

myTree = {bestFeatLabel:{}} 該最好分類

featValues = [example[bestFeat] for example in dataSet]

uniqueVals = set(featValues) set是歸類,見 subLabels = labels[:] #copy all of labels, so trees don't mess up existing labels

myTree[bestFeatLabel][value] = createTree(splitData(dataSet, bestFeatLabel][value] = createTree(splitData(dataSet, bestFeatLab, value] = )

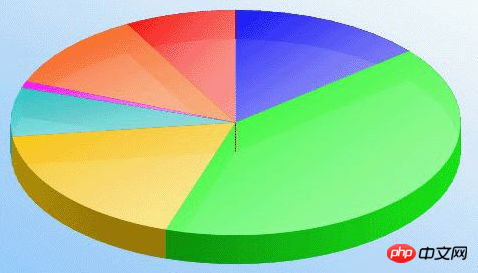

在分割數據集之前之後資訊發生的變化稱為資訊增益,劃分資料集的最大原則是將無序的資料變得更加有序。 這裡理解成切餅原理:

把資訊的複雜度,資訊量用單位熵描述程度。 對應的是餅的密度,如果是均等密度的垂直切餅,

每部分重量g = 總G * 其占大圓比例! 類比地,如果分割後資訊熵一樣, 每個小部分資料的 小h = pro * 總H, 而求和h[i] = H.

然而:我們需要的相反:需要的不是資訊熵一樣,而是不均等,例如上面,上綠的可能是草每餡,黃色是蘋果餡,藍色是紫薯,每個密度不同!

調試過程

calcShannonEnt

log(prob,2) log(1,2) = 0;2^0=1,因為prob

25行for featVec in dataSet: 計頻 for prop

chooseBestFeatureToSplit()

0.9709505944546686 = calcShannonEnt(dataSet) <class '205944546686 = calcShannonEnt(dataSet) <class '2]; ], [1, 1, 'yes'], [1, 0, 'no'], [0, 1, 'no'], [0, 1, 'no']]

#檢測資料集的每個子項是否屬於同一類: 如果值都是a,而result都是y或n 則為一類所以,只是兩個參數輸入

0.5509775004326937 = += prob * calcShannonEnt(subDataSet) 分開的子集後,的機率*香農滴,得到的和,原來的整體的香濃滴比

# 数据越接近,香浓熵值越少,越接近0 ,越不同,越多分逻辑,香浓熵就越大 # 只计算 其dataSet的featVec[-1] 结果标签 def calcShannonEnt(dataSet):

0.4199730940219749 infoGain = baseEntropy - newEntropy

像k鄰近 classify([0, 0], group, labels, 3) 意思是,把新資料[0,0] 按k=3的鄰近演算法在 group,labels資料裡的分類! group與label對應!

所以,是要把每個維度切出來+ 結果標籤 成二維的 一列數組,去比較分類

測試應該是,把前n個維量的值,向量輸入,輸出是yes or no!

一開始看,比較頭暈,條理清楚,理順下思路,看程式碼才易懂!

理解了目標和初始數據,你才明白,原來classList是結果標籤! ,是對應將要分類的dataset的對應結果標籤

而labels 則是特徵名,對應開始的dataset的維度,特徵的名strname

bestFeatLabel 最好分類特徵的維度名稱 是第一維度還是第二,第N

featValues 是bestFeatLabel 的維度下,的值數組。就是這一維度下的組別 用來做新的分類比較。

uniqueVals 用set判斷來是否一類,

例如

dataSet = [[1, 1, 'yes'],[0, 1, 'yes'],[1, 0, 'no' ],[1, 0, 'no'],[0, 0, 'no']]

labels = ['no surfacing','flippers',]

這樣的createTree :{'flippers': {0: 'no', 1: 'yes'}} 直接把no surfacing的維度省略了

以上是python機器學習決策樹詳細介紹的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

熱門話題

如何解決Linux終端中查看Python版本時遇到的權限問題?

Apr 01, 2025 pm 05:09 PM

如何解決Linux終端中查看Python版本時遇到的權限問題?

Apr 01, 2025 pm 05:09 PM

Linux終端中查看Python版本時遇到權限問題的解決方法當你在Linux終端中嘗試查看Python的版本時,輸入python...

在Python中如何高效地將一個DataFrame的整列複製到另一個結構不同的DataFrame中?

Apr 01, 2025 pm 11:15 PM

在Python中如何高效地將一個DataFrame的整列複製到另一個結構不同的DataFrame中?

Apr 01, 2025 pm 11:15 PM

在使用Python的pandas庫時,如何在兩個結構不同的DataFrame之間進行整列複製是一個常見的問題。假設我們有兩個Dat...

如何在10小時內通過項目和問題驅動的方式教計算機小白編程基礎?

Apr 02, 2025 am 07:18 AM

如何在10小時內通過項目和問題驅動的方式教計算機小白編程基礎?

Apr 02, 2025 am 07:18 AM

如何在10小時內教計算機小白編程基礎?如果你只有10個小時來教計算機小白一些編程知識,你會選擇教些什麼�...

Uvicorn是如何在沒有serve_forever()的情況下持續監聽HTTP請求的?

Apr 01, 2025 pm 10:51 PM

Uvicorn是如何在沒有serve_forever()的情況下持續監聽HTTP請求的?

Apr 01, 2025 pm 10:51 PM

Uvicorn是如何持續監聽HTTP請求的? Uvicorn是一個基於ASGI的輕量級Web服務器,其核心功能之一便是監聽HTTP請求並進�...

Python中如何通過字符串動態創建對象並調用其方法?

Apr 01, 2025 pm 11:18 PM

Python中如何通過字符串動態創建對象並調用其方法?

Apr 01, 2025 pm 11:18 PM

在Python中,如何通過字符串動態創建對象並調用其方法?這是一個常見的編程需求,尤其在需要根據配置或運行...

如何在使用 Fiddler Everywhere 進行中間人讀取時避免被瀏覽器檢測到?

Apr 02, 2025 am 07:15 AM

如何在使用 Fiddler Everywhere 進行中間人讀取時避免被瀏覽器檢測到?

Apr 02, 2025 am 07:15 AM

使用FiddlerEverywhere進行中間人讀取時如何避免被檢測到當你使用FiddlerEverywhere...

哪些流行的Python庫及其用途?

Mar 21, 2025 pm 06:46 PM

哪些流行的Python庫及其用途?

Mar 21, 2025 pm 06:46 PM

本文討論了諸如Numpy,Pandas,Matplotlib,Scikit-Learn,Tensorflow,Tensorflow,Django,Blask和請求等流行的Python庫,並詳細介紹了它們在科學計算,數據分析,可視化,機器學習,網絡開發和H中的用途