python爬蟲抓取的資料轉換成 PDF

本文給大家分享的是使用python爬蟲實作把《廖雪峰的Python 教學》轉換成PDF的方法和程式碼,有需要的小夥伴可以參考下

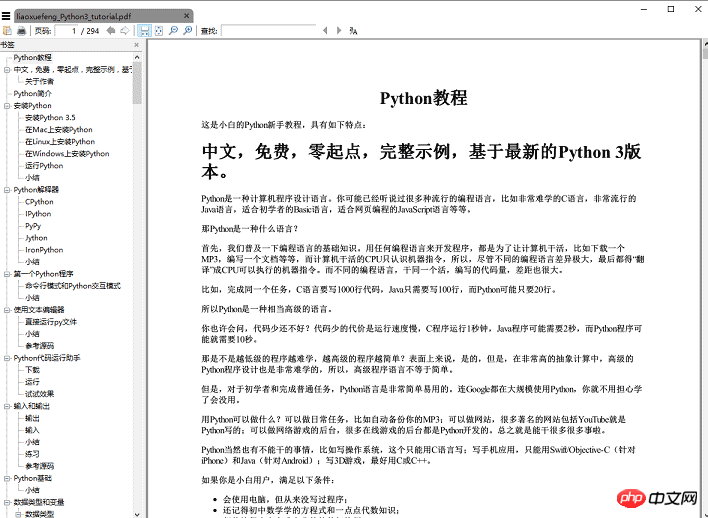

寫爬蟲似乎沒有比用Python 更合適了,Python 社區提供的爬蟲工具多得讓你眼花繚亂,各種拿來就可以直接用的library 分分鐘就可以寫出一個爬蟲出來,今天就琢磨著寫一個爬蟲,將廖雪峰的Python 教程爬下來做成PDF 電子書方便大家離線閱讀。

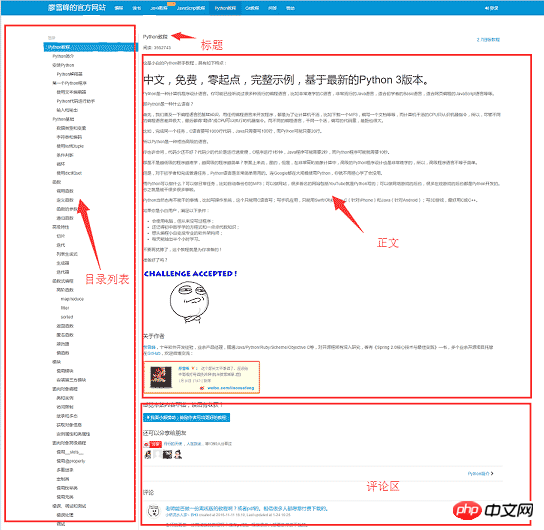

開始寫爬蟲前,我們先來分析一下該網站1的頁面結構,網頁的左側是教程的目錄大綱,每個URL 對應到右邊的一篇文章,右側上方是文章的標題,中間是文章的正文部分,正文內容是我們關心的重點,我們要爬的資料就是所有網頁的正文部分,下方是使用者的評論區,留言區對我們沒什麼用,所以可以忽略它。

工具準備

弄清楚了網站的基本結構後就可以開始準備爬蟲所依賴的工具包了。 requests、beautifulsoup 是爬蟲兩大神器,reuqests 用於網路請求,beautifusoup 用於操作 html 資料。有了這兩把梭子,幹起活來利索,scrapy 這樣的爬蟲框架我們就不用了,小程式派上它有點殺雞用牛刀的意思。此外,既然是把html 檔案轉換成pdf,那麼也要有對應的函式庫支持, wkhtmltopdf 是一個非常好的工具,它可以用適用於多平台的html 到pdf 的轉換, pdfkit 是wkhtmltopdf 的Python封裝包。首先安裝好下面的依賴包,

接著安裝wkhtmltopdf

pip install requests pip install beautifulsoup pip install pdfkit

安裝wkhtmltopdf

##Windows平台直接在wkhtmltopdf 官網2下載穩定版的進行安裝,安裝完成之後把程式的執行路徑加入到系統環境$PATH變數中,否則pdfkit 找不到wkhtmltopdf 就出現錯誤「No wkhtmltopdf executable found」。 Ubuntu 和CentOS 可以直接用命令列進行安裝

$ sudo apt-get install wkhtmltopdf # ubuntu $ sudo yum intsall wkhtmltopdf # centos

爬蟲實作

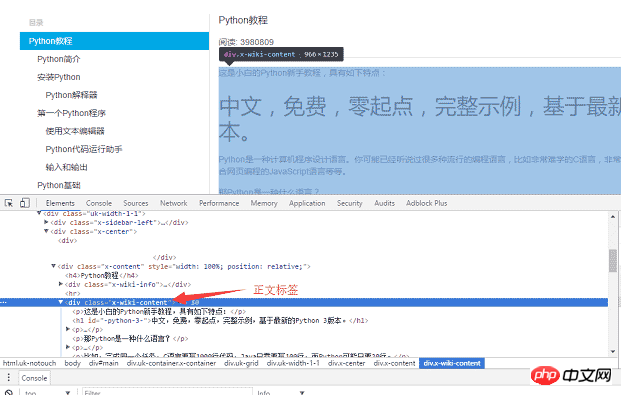

一切準備就緒後就可以上程式碼了,不過寫程式碼之前還是先整理一下思緒。程式的目的是要把所有 URL 對應的 html 正文部分儲存到本機,然後利用 pdfkit 把這些檔案轉換成一個 pdf 檔。我們把任務拆分一下,首先是把某一個 URL 對應的 html 正文儲存到本地,然後找到所有的 URL 執行相同的操作。 用 Chrome 瀏覽器找到頁面正文部分的標籤,按 F12 找到正文對應的 p 標籤:,該 p 是網頁的正文內容。用 requests 把整個頁面載入到本機後,就可以使用 beautifulsoup 運算 HTML 的 dom 元素 來擷取正文內容了。

具體的實作程式碼如下:用 soup.find_all

具體的實作程式碼如下:用 soup.find_all

函數找到正文標籤,然後把正文部分的內容儲存到 a.html 檔案中。

def parse_url_to_html(url):

response = requests.get(url)

soup = BeautifulSoup(response.content, "html5lib")

body = soup.find_all(class_="x-wiki-content")[0]

html = str(body)

with open("a.html", 'wb') as f:

f.write(html)

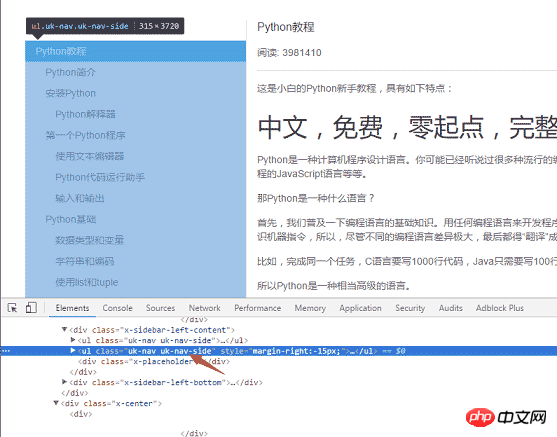

屬性,而真正的目錄清單是第二個。所有的 url 獲取了,url 轉 html 的函數在第一步也寫好了。

def get_url_list():

"""

获取所有URL目录列表

"""

response = requests.get("http://www.liaoxuefeng.com/wiki/0014316089557264a6b348958f449949df42a6d3a2e542c000")

soup = BeautifulSoup(response.content, "html5lib")

menu_tag = soup.find_all(class_="uk-nav uk-nav-side")[1]

urls = []

for li in menu_tag.find_all("li"):

url = "http://www.liaoxuefeng.com" + li.a.get('href')

urls.append(url)

return urlsdef save_pdf(htmls):

"""

把所有html文件转换成pdf文件

"""

options = {

'page-size': 'Letter',

'encoding': "UTF-8",

'custom-header': [

('Accept-Encoding', 'gzip')

]

}

pdfkit.from_file(htmls, file_name, options=options)

總結

總共程式碼量加起來不到50行,不過,且慢,其實上面給的程式碼省略了一些細節,例如,如何取得文章的標題,正文內容的img 標籤使用的是相對路徑,如果要想在pdf 中正常顯示圖片就需要將相對路徑改為絕對路徑,還有保存下來的html 臨時檔案都要刪除,這些細節末葉都放在github上。

【相關推薦】

#

1. Python免費影片教學

##2. 3.以上是python爬蟲抓取的資料轉換成 PDF的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

PHP和Python:解釋了不同的範例

Apr 18, 2025 am 12:26 AM

PHP和Python:解釋了不同的範例

Apr 18, 2025 am 12:26 AM

PHP主要是過程式編程,但也支持面向對象編程(OOP);Python支持多種範式,包括OOP、函數式和過程式編程。 PHP適合web開發,Python適用於多種應用,如數據分析和機器學習。

在PHP和Python之間進行選擇:指南

Apr 18, 2025 am 12:24 AM

在PHP和Python之間進行選擇:指南

Apr 18, 2025 am 12:24 AM

PHP適合網頁開發和快速原型開發,Python適用於數據科學和機器學習。 1.PHP用於動態網頁開發,語法簡單,適合快速開發。 2.Python語法簡潔,適用於多領域,庫生態系統強大。

sublime怎麼運行代碼python

Apr 16, 2025 am 08:48 AM

sublime怎麼運行代碼python

Apr 16, 2025 am 08:48 AM

在 Sublime Text 中運行 Python 代碼,需先安裝 Python 插件,再創建 .py 文件並編寫代碼,最後按 Ctrl B 運行代碼,輸出會在控制台中顯示。

Python vs. JavaScript:學習曲線和易用性

Apr 16, 2025 am 12:12 AM

Python vs. JavaScript:學習曲線和易用性

Apr 16, 2025 am 12:12 AM

Python更適合初學者,學習曲線平緩,語法簡潔;JavaScript適合前端開發,學習曲線較陡,語法靈活。 1.Python語法直觀,適用於數據科學和後端開發。 2.JavaScript靈活,廣泛用於前端和服務器端編程。

PHP和Python:深入了解他們的歷史

Apr 18, 2025 am 12:25 AM

PHP和Python:深入了解他們的歷史

Apr 18, 2025 am 12:25 AM

PHP起源於1994年,由RasmusLerdorf開發,最初用於跟踪網站訪問者,逐漸演變為服務器端腳本語言,廣泛應用於網頁開發。 Python由GuidovanRossum於1980年代末開發,1991年首次發布,強調代碼可讀性和簡潔性,適用於科學計算、數據分析等領域。

Golang vs. Python:性能和可伸縮性

Apr 19, 2025 am 12:18 AM

Golang vs. Python:性能和可伸縮性

Apr 19, 2025 am 12:18 AM

Golang在性能和可擴展性方面優於Python。 1)Golang的編譯型特性和高效並發模型使其在高並發場景下表現出色。 2)Python作為解釋型語言,執行速度較慢,但通過工具如Cython可優化性能。

vscode在哪寫代碼

Apr 15, 2025 pm 09:54 PM

vscode在哪寫代碼

Apr 15, 2025 pm 09:54 PM

在 Visual Studio Code(VSCode)中編寫代碼簡單易行,只需安裝 VSCode、創建項目、選擇語言、創建文件、編寫代碼、保存並運行即可。 VSCode 的優點包括跨平台、免費開源、強大功能、擴展豐富,以及輕量快速。

notepad 怎麼運行python

Apr 16, 2025 pm 07:33 PM

notepad 怎麼運行python

Apr 16, 2025 pm 07:33 PM

在 Notepad 中運行 Python 代碼需要安裝 Python 可執行文件和 NppExec 插件。安裝 Python 並為其添加 PATH 後,在 NppExec 插件中配置命令為“python”、參數為“{CURRENT_DIRECTORY}{FILE_NAME}”,即可在 Notepad 中通過快捷鍵“F6”運行 Python 代碼。