最近開始學Python的爬蟲,是在這個部落格跟著學習的,該部落客用的是Python 2.7版本,而我使用的是3.5版本,很多不相容的地方,不過沒關係,自己改改就好了。

我們想針對網站的內容進行篩選,只取得自己感興趣的部分。例如你想在XX網站把小黃圖篩選出來,打包帶走。這裡只做簡單的實現,以百思不得姐上的段子(純文字)為例。我們想要實現以下功能:

批次下載若干頁段子到本機檔案中

按下任一鍵,開始閱讀下一段子

#導入urllib的相關函式庫,Python 3中應該這樣寫:

import urllib.requestimport urllib.parseimport re

re函式庫是正規表示式(Regular Expression),後面作符合時會用到。

百思不得姐的段子頁面url ='http://www.budejie.com/text/1',這裡結尾數字1代表此為第一頁。透過以下程式碼就能返回網頁內容。

req = urllib.request.Request(url)# 添加headers 使之看起来像浏览器在访问req.add_header('User-Agent', 'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 ' '(KHTML, like Gecko) Chrome/52.0.2743.116 Safari/537.36')

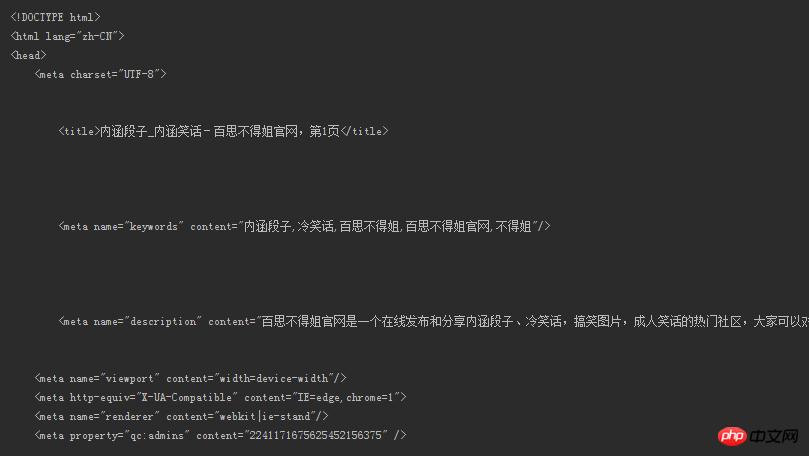

response = urllib.request.urlopen(req)# 得到网页内容,注意必须使用decode()解码html = response.read().decode('utf-8')print(html)的話,就是如下所示的內容:

這能看?段子呢?我們想要的段子呢? !

哦對了headers這樣查看。

按F12,然後...看圖吧

#要篩選符合普通人閱讀的內容(如果還帶著html標籤那還咋讀是不),成功提取出段子,為此我們需要一些既定的模式去和網頁全部內容進行匹配,將模式下匹配成功的對象返回。我們使用強大的正規表示式進行比對(Regular Expression),相關語法可以看這裡。

僅僅針對本例中的網頁內容,先看看我們需要的段子對應了網頁中的什麼內容。

可以看到段子被<div class="j-r-list-c-desc">(我們要的內容)</div> 這樣的標籤所包圍,只需要指定對應規則提取出來即可!上圖可以看出段子正文前後是有很多空格的,需要配對進去。

pattern = re.compile(r'<div class="j-r-list-c-desc">\s+(.*)\s+</div>') result = re.findall(pattern, html)

透過

re函式庫的compile函數制定規則。

\s+可以符合一個或更多的空格

.匹配除開換行符\n外的所有字元。

現在我們得到了配對後的結果,來看。

Bingo!提取出來了不是? !

可是我們發現裡面還有些討厭的<br />。沒關係,寫幾行程式碼的事。這裡就不再展示去掉後的內容,自行腦補哈哈。

for each in content:# 如果某个段子里有<br />if '<br />' in each:# 替换成换行符并输出new_each = re.sub(r'<br />', '\n', each)print(new_each)# 没有就照常输出else:print(each)

這裡

content是我們透過re.findall()傳回的清單。

至此,我們成功得到我們想看的段子了!如果想要下載到本機呢?

透過定義一個save()函數即可,num參數使用者自定,想下載最近100頁的內容都沒問題!裡面還有些變數沒有提到,最後會給出原始碼。

# num是指定网页页数def save(num):# 写方式打开一个文本,把获取的段子列表存放进去with open('a.txt', 'w', encoding='utf-8') as f:

text = get_content(num)# 和上面去掉<br />类似for each in text:if '<br />' in each:

new_each = re.sub(r'<br />', '\n', each)

f.write(new_each)else:

f.write(str(each) + '\n')下載到本機文件後如下圖所示

段子太多,琳瑯滿目。但我們只希望一條條讀。按下鍵盤任意鍵可以切換到下一條,直到讀取到最後一條程序才結束,或者透過設定一個退出鍵隨時退出程序,例如設定q鍵退出。 這裡把全部程式碼給出。

import urllib.requestimport urllib.parseimport re pattern = re.compile(r'\s+(.*)\s+')# 返回指定网页的内容def open_url(url): req = urllib.request.Request(url) req.add_header('User-Agent', 'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 ' '(KHTML, like Gecko) Chrome/52.0.2743.116 Safari/537.36') response = urllib.request.urlopen(req) html = response.read().decode('utf-8')return html# num为用户自定,返回的是所有页的段子列表def get_content(num):# 存放段子的列表text_list = []for page in range(1, int(num)): address = 'http://www.budejie.com/text/' + str(page) html = open_url(address) result = re.findall(pattern, html)# 每一页的result都是一个列表,将里面的内容加入到text_listfor each in result: text_list.append(each)return text_list# num是指定网页页数def save(num):# 写方式打开一个文本,把获取的段子列表存放进去with open('a.txt', 'w', encoding='utf-8') as f: text = get_content(num)# 和上面去掉<br />类似for each in text:if '<br />' in each: new_each = re.sub(r'<br />', '\n', each) f.write(new_each)else: f.write(str(each) + '\n') if __name__ == '__main__':print('阅读过程中按q随时退出') number = int(input('想读几页的内容: ')) content = get_content(number + 1)for each in content:if '<br />' in each: new_each = re.sub(r'<br />', '\n', each)print(new_each)else:print(each)# 用户输入user_input = input()# 不区分大小写的q,输入则退出if user_input == 'q' or user_input == 'Q':break

示範一下,效果是這樣的。

雖然功能很雞肋,不過作為初學我還是很滿意了,有興趣才能深入下去嘛!爬蟲可不只如此而已,以後會學習更進階的功能。

by @sunhaiyu

2016.8.15

以上是Python爬蟲初學之爬取段子的詳細內容。更多資訊請關注PHP中文網其他相關文章!