Python爬蟲之Anaconda環境下創建Scrapy爬蟲框架

在Anaconda環境下如何創建Scrapy 爬蟲框架?這篇文章將為大家介紹關於Anaconda環境下創建Scrapy爬蟲框架專案的步驟,值得一看。

Python爬蟲教學 -31-建立Scrapy 爬蟲框架專案

先說一下,這篇文章是在Anaconda 環境下,所以如果沒有安裝Anaconda 請先到官網下載安裝

Anaconda 下載地址:https://www.anaconda.com/download/

Scrapy 爬蟲框架項目的創建

0.打開【cmd】

1.進入你要使用的Anaconda 環境

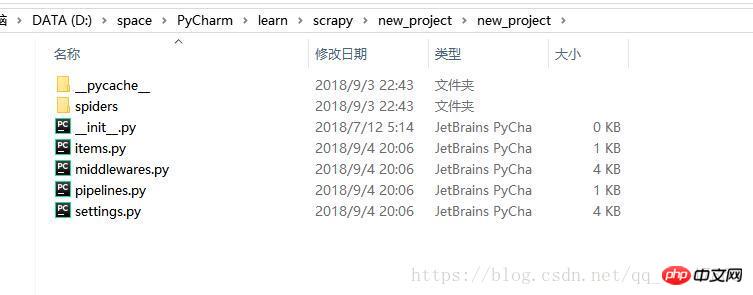

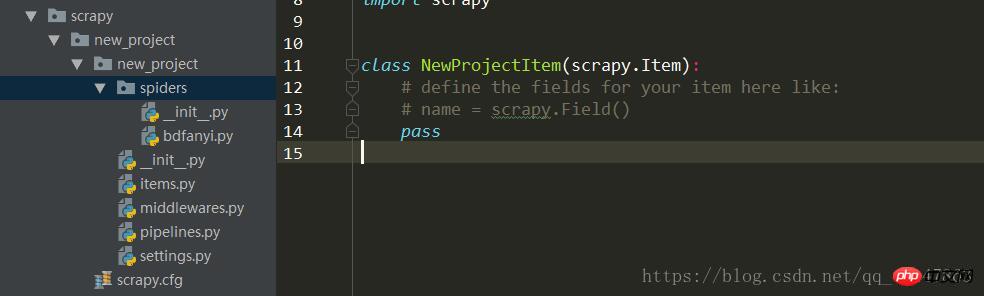

這裡我們就把專案建立好了,分析一下自動產生的檔案的作用

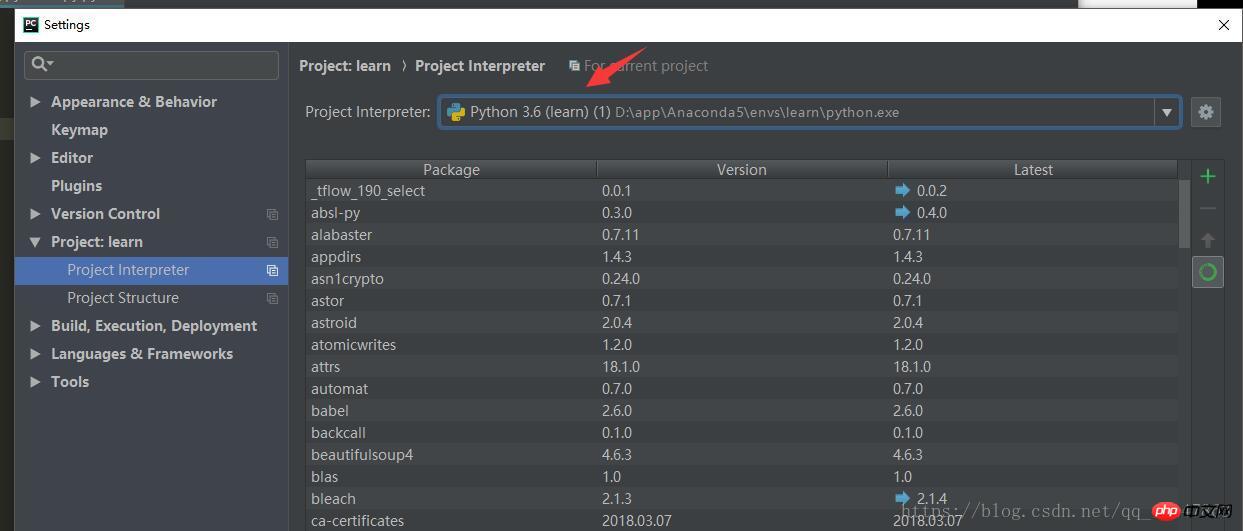

1.環境名稱可以在【Pycharm】的【Settings】下【Project:】下找到

2.使用指令:activate 環境名,例如:

activate learn

3.進入想要存放scrapy 專案的目錄下【注意】

##4.新專案:scrapy startproject xxx專案名,例如:scrapy startproject new_project#5.操作截圖:

##log:日誌記錄

相關推薦:

python爬蟲框架scrapy實例詳解Scrapy爬蟲入門教學四Spider(爬蟲)#使用Python的Scrapy框架編寫web爬蟲的簡單範例以上是Python爬蟲之Anaconda環境下創建Scrapy爬蟲框架的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

如何解決Linux終端中查看Python版本時遇到的權限問題?

Apr 01, 2025 pm 05:09 PM

如何解決Linux終端中查看Python版本時遇到的權限問題?

Apr 01, 2025 pm 05:09 PM

Linux終端中查看Python版本時遇到權限問題的解決方法當你在Linux終端中嘗試查看Python的版本時,輸入python...

如何在使用 Fiddler Everywhere 進行中間人讀取時避免被瀏覽器檢測到?

Apr 02, 2025 am 07:15 AM

如何在使用 Fiddler Everywhere 進行中間人讀取時避免被瀏覽器檢測到?

Apr 02, 2025 am 07:15 AM

使用FiddlerEverywhere進行中間人讀取時如何避免被檢測到當你使用FiddlerEverywhere...

在Python中如何高效地將一個DataFrame的整列複製到另一個結構不同的DataFrame中?

Apr 01, 2025 pm 11:15 PM

在Python中如何高效地將一個DataFrame的整列複製到另一個結構不同的DataFrame中?

Apr 01, 2025 pm 11:15 PM

在使用Python的pandas庫時,如何在兩個結構不同的DataFrame之間進行整列複製是一個常見的問題。假設我們有兩個Dat...

Uvicorn是如何在沒有serve_forever()的情況下持續監聽HTTP請求的?

Apr 01, 2025 pm 10:51 PM

Uvicorn是如何在沒有serve_forever()的情況下持續監聽HTTP請求的?

Apr 01, 2025 pm 10:51 PM

Uvicorn是如何持續監聽HTTP請求的? Uvicorn是一個基於ASGI的輕量級Web服務器,其核心功能之一便是監聽HTTP請求並進�...

如何在10小時內通過項目和問題驅動的方式教計算機小白編程基礎?

Apr 02, 2025 am 07:18 AM

如何在10小時內通過項目和問題驅動的方式教計算機小白編程基礎?

Apr 02, 2025 am 07:18 AM

如何在10小時內教計算機小白編程基礎?如果你只有10個小時來教計算機小白一些編程知識,你會選擇教些什麼�...

如何繞過Investing.com的反爬蟲機制獲取新聞數據?

Apr 02, 2025 am 07:03 AM

如何繞過Investing.com的反爬蟲機制獲取新聞數據?

Apr 02, 2025 am 07:03 AM

攻克Investing.com的反爬蟲策略許多人嘗試爬取Investing.com(https://cn.investing.com/news/latest-news)的新聞數據時,常常�...