Python爬取51cto資料存入MySQL方法詳解

【相關學習推薦:python教學】

#實驗環境

##1.安裝Python 3.7# 51cto 博客页面数据插入mysql数据库

# 导入模块

import re

import bs4

import pymysql

import requests

# 连接数据库账号密码

db = pymysql.connect(host='172.171.13.229',

user='root', passwd='abc123',

db='test', port=3306,

charset='utf8')

# 获取游标

cursor = db.cursor()

def open_url(url):

# 连接模拟网页访问

headers = {

'user-agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) '

'Chrome/57.0.2987.98 Safari/537.36'}

res = requests.get(url, headers=headers)

return res

# 爬取网页内容

def find_text(res):

soup = bs4.BeautifulSoup(res.text, 'html.parser')

# 博客名

titles = []

targets = soup.find_all("a", class_="tit")

for each in targets:

each = each.text.strip()

if "置顶" in each:

each = each.split(' ')[0]

titles.append(each)

# 阅读量

reads = []

read1 = soup.find_all("p", class_="read fl on")

read2 = soup.find_all("p", class_="read fl")

for each in read1:

reads.append(each.text)

for each in read2:

reads.append(each.text)

# 评论数

comment = []

targets = soup.find_all("p", class_='comment fl')

for each in targets:

comment.append(each.text)

# 收藏

collects = []

targets = soup.find_all("p", class_='collect fl')

for each in targets:

collects.append(each.text)

# 发布时间

dates=[]

targets = soup.find_all("a", class_='time fl')

for each in targets:

each = each.text.split(':')[1]

dates.append(each)

# 插入sql 语句

sql = """insert into blog (blog_title,read_number,comment_number, collect, dates)

values( '%s', '%s', '%s', '%s', '%s');"""

# 替换页面 \xa0

for titles, reads, comment, collects, dates in zip(titles, reads, comment, collects, dates):

reads = re.sub('\s', '', reads)

comment = re.sub('\s', '', comment)

collects = re.sub('\s', '', collects)

cursor.execute(sql % (titles, reads, comment, collects,dates))

db.commit()

pass

# 统计总页数

def find_depth(res):

soup = bs4.BeautifulSoup(res.text, 'html.parser')

depth = soup.find('li', class_='next').previous_sibling.previous_sibling.text

return int(depth)

# 主函数

def main():

host = "https://blog.51cto.com/13760351"

res = open_url(host) # 打开首页链接

depth = find_depth(res) # 获取总页数

# 爬取其他页面信息

for i in range(1, depth + 1):

url = host + '/p' + str(i) # 完整链接

res = open_url(url) # 打开其他链接

find_text(res) # 爬取数据

# 关闭游标

cursor.close()

# 关闭数据库连接

db.close()

if __name__ == '__main__':

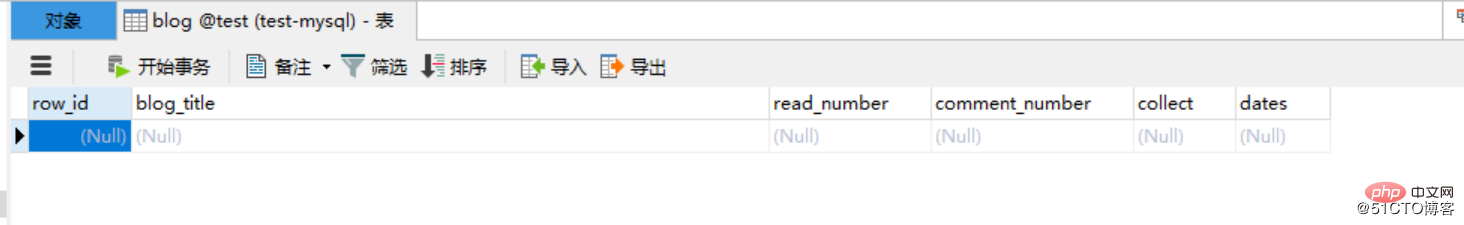

main()CREATE TABLE `blog` ( `row_id` int(11) NOT NULL AUTO_INCREMENT COMMENT '主键', `blog_title` varchar(52) DEFAULT NULL COMMENT '博客标题', `read_number` varchar(26) DEFAULT NULL COMMENT '阅读数量', `comment_number` varchar(16) DEFAULT NULL COMMENT '评论数量', `collect` varchar(16) DEFAULT NULL COMMENT '收藏数量', `dates` varchar(16) DEFAULT NULL COMMENT '发布日期', PRIMARY KEY (`row_id`) ) ENGINE=InnoDB AUTO_INCREMENT=1 DEFAULT CHARSET=utf8;

import re

import bs4

import pymysql

import requests

# 连接数据库

db = pymysql.connect(host='172.171.13.229',

user='root', passwd='abc123',

db='test', port=3306,

charset='utf8')

# 获取游标

cursor = db.cursor()

def open_url(url):

# 连接模拟网页访问

headers = {

'user-agent': 'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) '

'Chrome/57.0.2987.98 Safari/537.36'}

res = requests.get(url, headers=headers)

return res

# 爬取网页内容

def find_text(res):

soup = bs4.BeautifulSoup(res.text, 'html.parser')

# 博客标题

titles = []

targets = soup.find_all("a", class_="tit")

for each in targets:

each = each.text.strip()

if "置顶" in each:

each = each.split(' ')[0]

titles.append(each)

# 阅读量

reads = []

read1 = soup.find_all("p", class_="read fl on")

read2 = soup.find_all("p", class_="read fl")

for each in read1:

reads.append(each.text)

for each in read2:

reads.append(each.text)

# 评论数

comment = []

targets = soup.find_all("p", class_='comment fl')

for each in targets:

comment.append(each.text)

# 收藏

collects = []

targets = soup.find_all("p", class_='collect fl')

for each in targets:

collects.append(each.text)

# 发布时间

dates=[]

targets = soup.find_all("a", class_='time fl')

for each in targets:

each = each.text.split(':')[1]

dates.append(each)

# 插入sql 语句

sql = """insert into blogs (blog_title,read_number,comment_number, collect, dates)

values( '%s', '%s', '%s', '%s', '%s');"""

# 替换页面 \xa0

for titles, reads, comment, collects, dates in zip(titles, reads, comment, collects, dates):

reads = re.sub('\s', '', reads)

reads=int(re.sub('\D', "", reads)) #匹配数字,转换为整型

comment = re.sub('\s', '', comment)

comment = int(re.sub('\D', "", comment)) #匹配数字,转换为整型

collects = re.sub('\s', '', collects)

collects = int(re.sub('\D', "", collects)) #匹配数字,转换为整型

dates = re.sub('\s', '', dates)

cursor.execute(sql % (titles, reads, comment, collects,dates))

db.commit()

pass

# 统计总页数

def find_depth(res):

soup = bs4.BeautifulSoup(res.text, 'html.parser')

depth = soup.find('li', class_='next').previous_sibling.previous_sibling.text

return int(depth)

# 主函数

def main():

host = "https://blog.51cto.com/13760351"

res = open_url(host) # 打开首页链接

depth = find_depth(res) # 获取总页数

# 爬取其他页面信息

for i in range(1, depth + 1):

url = host + '/p' + str(i) # 完整链接

res = open_url(url) # 打开其他链接

find_text(res) # 爬取数据

# 关闭游标

cursor.close()

# 关闭数据库连接

db.close()

#主程序入口

if __name__ == '__main__':

main()CREATE TABLE `blogs` ( `row_id` int(11) NOT NULL AUTO_INCREMENT COMMENT '主键', `blog_title` varchar(52) DEFAULT NULL COMMENT '博客标题', `read_number` int(26) DEFAULT NULL COMMENT '阅读数量', `comment_number` int(16) DEFAULT NULL COMMENT '评论数量', `collect` int(16) DEFAULT NULL COMMENT '收藏数量', `dates` varchar(16) DEFAULT NULL COMMENT '发布日期', PRIMARY KEY (`row_id`) ) ENGINE=InnoDB AUTO_INCREMENT=1 DEFAULT CHARSET=utf8;

#末尾修改为:

if __name__ == '__main__':

main()

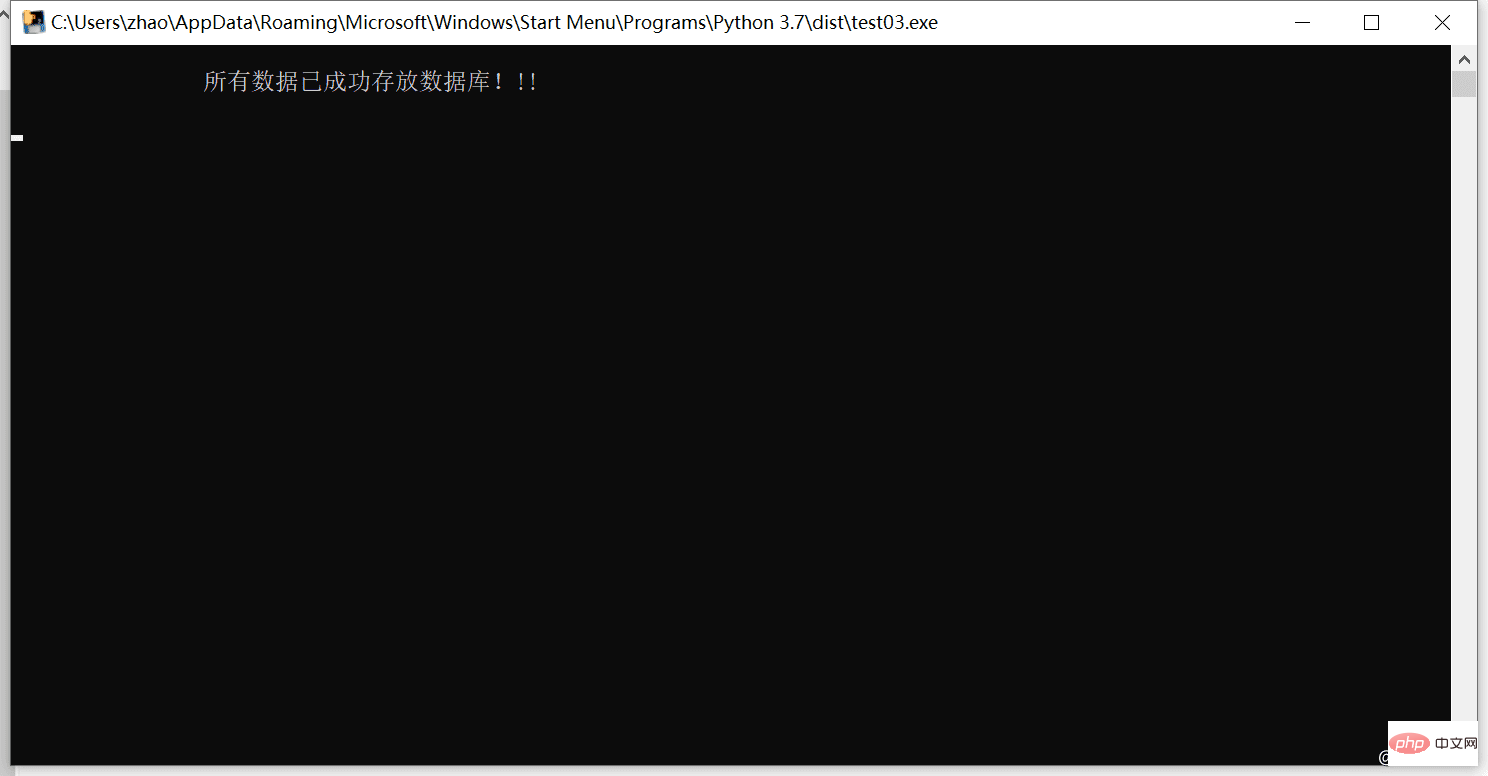

print("\n\t\t所有数据已成功存放数据库!!! \n")

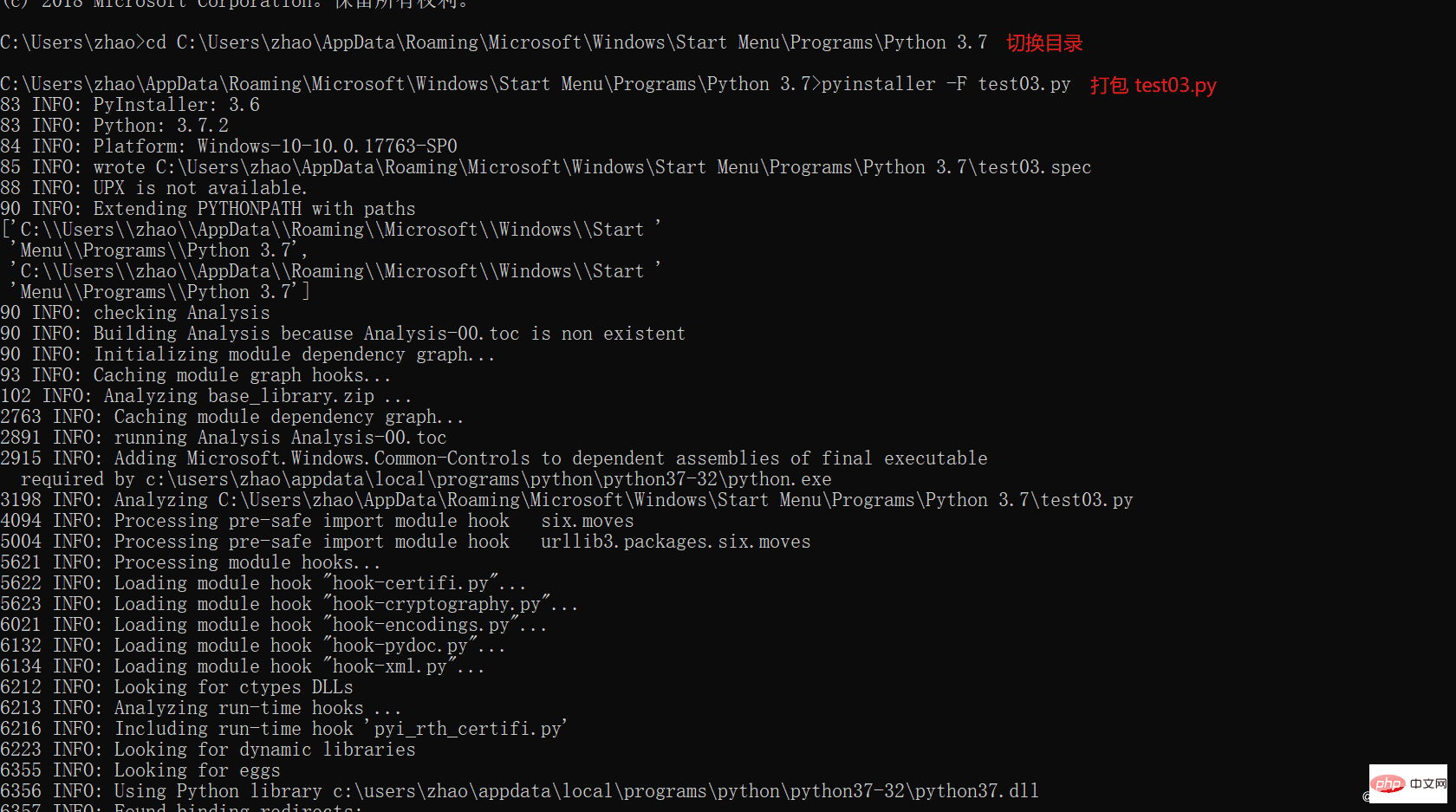

time.sleep(5)pip install pyinstaller -i https://pypi.tuna. tsinghua.edu.cn/simple/

##2.在cmd視窗執行pyinstaller -F test03.py (test03為專案名稱)

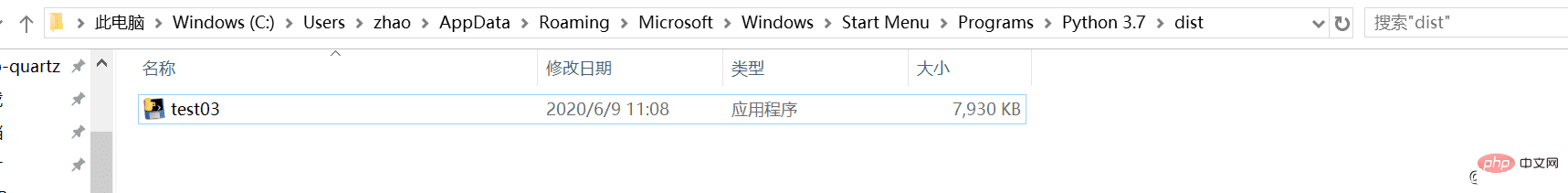

#4.查看exe套件

#4.查看exe套件

在打包後會出現dist目錄,打好套件就在這個目錄裡面

5.運行exe包,查看效果

5.運行exe包,查看效果

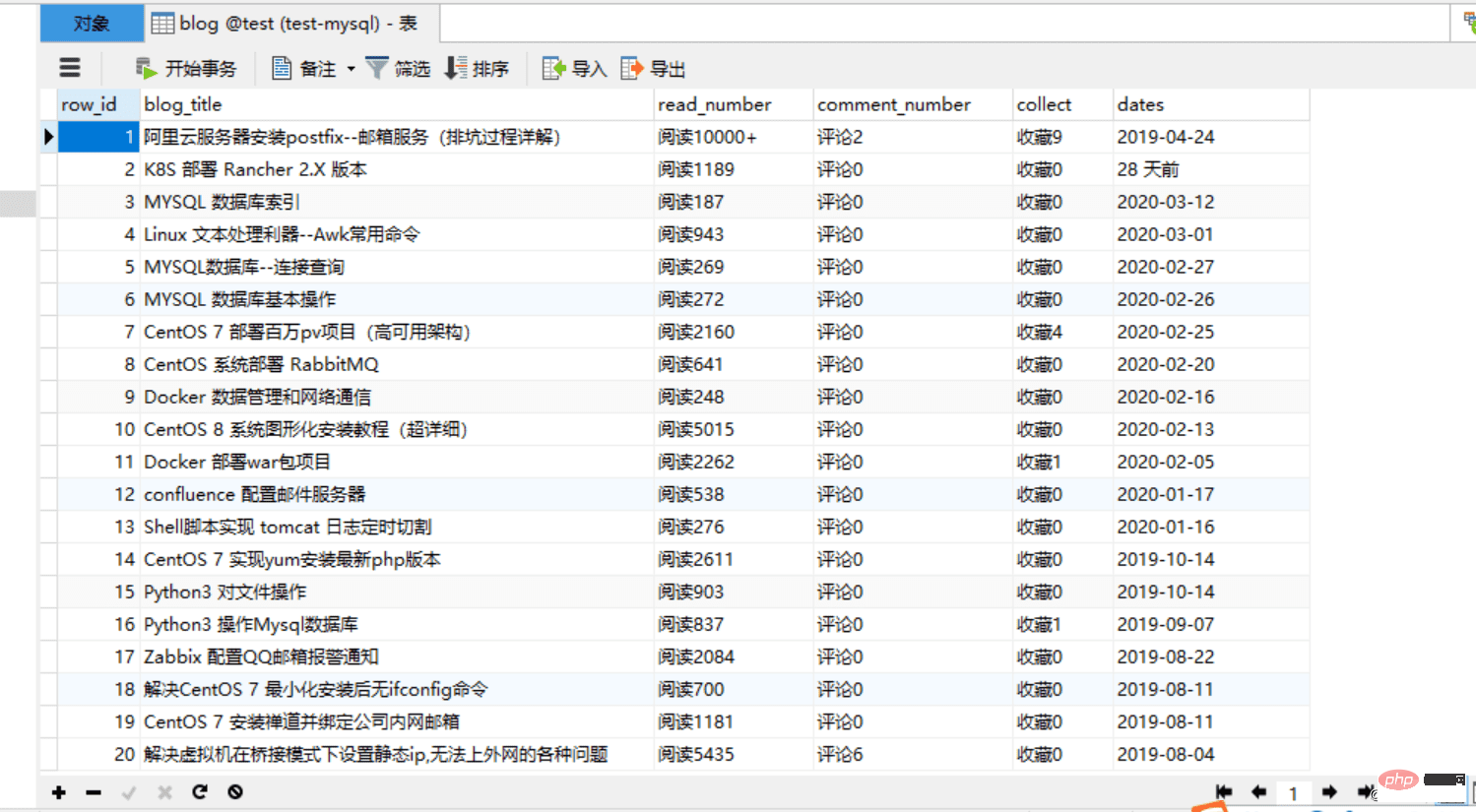

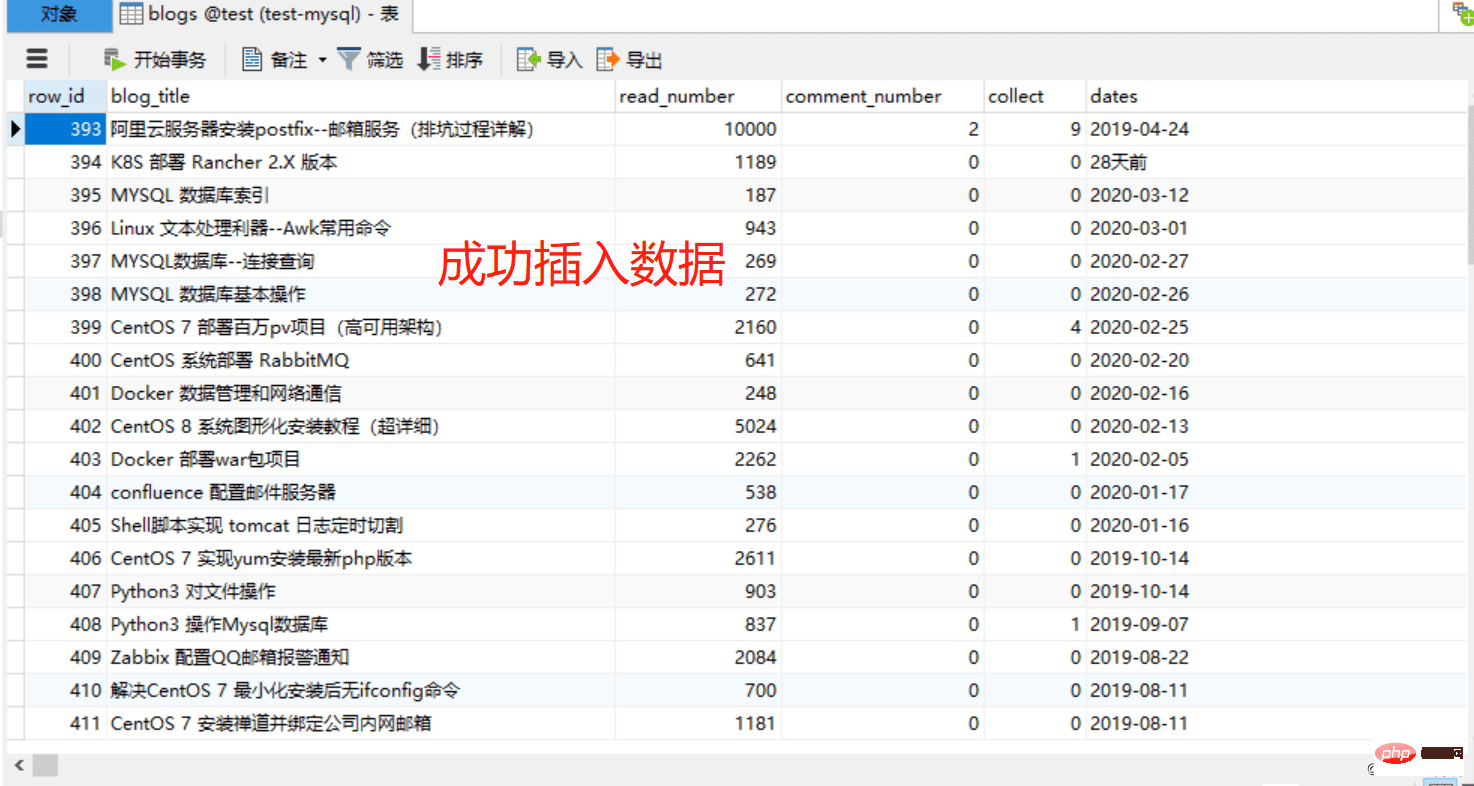

檢查資料庫

檢查資料庫

mysql教學

以上是Python爬取51cto資料存入MySQL方法詳解的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

MySQL和PhpMyAdmin:核心功能和功能

Apr 22, 2025 am 12:12 AM

MySQL和PhpMyAdmin:核心功能和功能

Apr 22, 2025 am 12:12 AM

MySQL和phpMyAdmin是強大的數據庫管理工具。 1)MySQL用於創建數據庫和表、執行DML和SQL查詢。 2)phpMyAdmin提供直觀界面進行數據庫管理、表結構管理、數據操作和用戶權限管理。

Python vs. JavaScript:開發環境和工具

Apr 26, 2025 am 12:09 AM

Python vs. JavaScript:開發環境和工具

Apr 26, 2025 am 12:09 AM

Python和JavaScript在開發環境上的選擇都很重要。 1)Python的開發環境包括PyCharm、JupyterNotebook和Anaconda,適合數據科學和快速原型開發。 2)JavaScript的開發環境包括Node.js、VSCode和Webpack,適用於前端和後端開發。根據項目需求選擇合適的工具可以提高開發效率和項目成功率。

Python vs. C:了解關鍵差異

Apr 21, 2025 am 12:18 AM

Python vs. C:了解關鍵差異

Apr 21, 2025 am 12:18 AM

Python和C 各有優勢,選擇應基於項目需求。 1)Python適合快速開發和數據處理,因其簡潔語法和動態類型。 2)C 適用於高性能和系統編程,因其靜態類型和手動內存管理。

Golang vs. Python:利弊

Apr 21, 2025 am 12:17 AM

Golang vs. Python:利弊

Apr 21, 2025 am 12:17 AM

Golangisidealforbuildingscalablesystemsduetoitsefficiencyandconcurrency,whilePythonexcelsinquickscriptinganddataanalysisduetoitssimplicityandvastecosystem.Golang'sdesignencouragesclean,readablecodeanditsgoroutinesenableefficientconcurrentoperations,t

Laravel vs. Python(與框架):比較分析

Apr 21, 2025 am 12:15 AM

Laravel vs. Python(與框架):比較分析

Apr 21, 2025 am 12:15 AM

Laravel適合團隊熟悉PHP且需功能豐富的項目,Python框架則視項目需求而定。 1.Laravel提供優雅語法和豐富功能,適合需要快速開發和靈活性的項目。 2.Django適合複雜應用,因其“電池包含”理念。 3.Flask適用於快速原型和小型項目,提供極大靈活性。

在MySQL中解釋外鍵的目的。

Apr 25, 2025 am 12:17 AM

在MySQL中解釋外鍵的目的。

Apr 25, 2025 am 12:17 AM

在MySQL中,外鍵的作用是建立表與表之間的關係,確保數據的一致性和完整性。外鍵通過引用完整性檢查和級聯操作維護數據的有效性,使用時需注意性能優化和避免常見錯誤。

比較和對比Mysql和Mariadb。

Apr 26, 2025 am 12:08 AM

比較和對比Mysql和Mariadb。

Apr 26, 2025 am 12:08 AM

MySQL和MariaDB的主要區別在於性能、功能和許可證:1.MySQL由Oracle開發,MariaDB是其分支。 2.MariaDB在高負載環境中性能可能更好。 3.MariaDB提供了更多的存儲引擎和功能。 4.MySQL採用雙重許可證,MariaDB完全開源。選擇時應考慮現有基礎設施、性能需求、功能需求和許可證成本。

SQL與MySQL:澄清兩者之間的關係

Apr 24, 2025 am 12:02 AM

SQL與MySQL:澄清兩者之間的關係

Apr 24, 2025 am 12:02 AM

SQL是一種用於管理關係數據庫的標準語言,而MySQL是一個使用SQL的數據庫管理系統。 SQL定義了與數據庫交互的方式,包括CRUD操作,而MySQL實現了SQL標準並提供了額外的功能,如存儲過程和触發器。