cad模型怎麼導入佈局

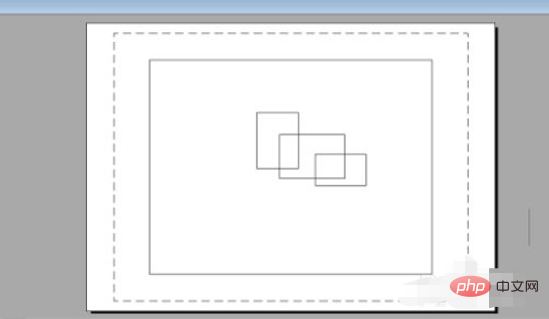

cad模型匯入佈局的方法:先開啟軟體進入佈局空間,並在模型中畫好圖形;然後點擊底部的佈局,滑鼠雙擊佈局內空白處,調整圖形大小和位置;最後滑鼠雙擊佈局外面空白處,空格確定,重複操作練習。

本文操作環境:Windows7系統,autocad2020版本,Dell G3電腦。

cad模型匯入佈局的方法:

1、開啟AutoCAD2007軟體,進入模型佈局空間。

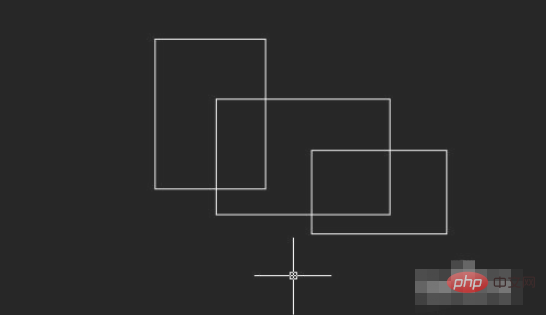

2、之後在模型中畫好圖形。

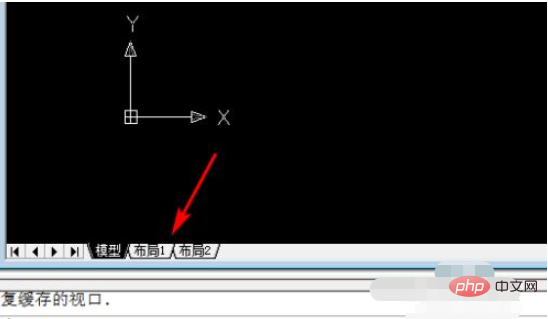

3、點選底部的佈局,系統會將圖形調入佈局介面裡。

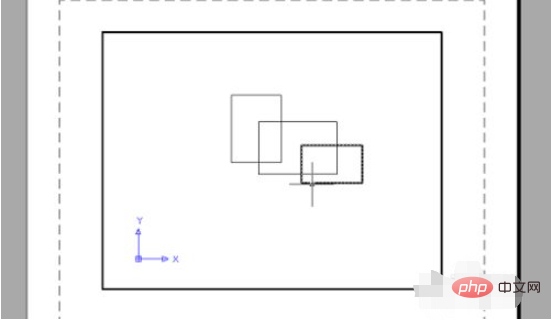

4、滑鼠雙擊佈局內空白處,調整圖形大小和位置。

5、滑鼠雙擊佈局外面空白處,空格確定,重複操作練習。

相關影片推薦:PHP程式設計從入門到精通

以上是cad模型怎麼導入佈局的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

熱門話題

無需OpenAI數據,躋身程式碼大模型榜單! UIUC發表StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

無需OpenAI數據,躋身程式碼大模型榜單! UIUC發表StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

在软件技术的前沿,UIUC张令明组携手BigCode组织的研究者,近日公布了StarCoder2-15B-Instruct代码大模型。这一创新成果在代码生成任务取得了显著突破,成功超越CodeLlama-70B-Instruct,登上代码生成性能榜单之巅。StarCoder2-15B-Instruct的独特之处在于其纯自对齐策略,整个训练流程公开透明,且完全自主可控。该模型通过StarCoder2-15B生成了数千个指令,响应对StarCoder-15B基座模型进行微调,无需依赖昂贵的人工标注数

Yolov10:詳解、部署、應用一站式齊全!

Jun 07, 2024 pm 12:05 PM

Yolov10:詳解、部署、應用一站式齊全!

Jun 07, 2024 pm 12:05 PM

一、前言在过去的几年里,YOLOs由于其在计算成本和检测性能之间的有效平衡,已成为实时目标检测领域的主导范式。研究人员探索了YOLO的架构设计、优化目标、数据扩充策略等,取得了显著进展。同时,依赖非极大值抑制(NMS)进行后处理阻碍了YOLO的端到端部署,并对推理延迟产生不利影响。在YOLOs中,各种组件的设计缺乏全面彻底的检查,导致显著的计算冗余,限制了模型的能力。它提供了次优的效率,以及相对大的性能改进潜力。在这项工作中,目标是从后处理和模型架构两个方面进一步提高YOLO的性能效率边界。为此

binance官方網站網址 幣安官網入口最新正版入口

Dec 16, 2024 pm 06:15 PM

binance官方網站網址 幣安官網入口最新正版入口

Dec 16, 2024 pm 06:15 PM

本文重點介紹幣安官方網站的最新正版入口,包括幣安全球官網、美國官網和學院官網。此外,文章還提供了詳細的存取步驟,包括使用受信任的裝置、輸入正確的網址、仔細檢查網站介面、驗證網站憑證、聯絡客戶支援等,以確保安全可靠地存取幣安平台。

清華接手,YOLOv10問世:效能大幅提升,登上GitHub熱門榜

Jun 06, 2024 pm 12:20 PM

清華接手,YOLOv10問世:效能大幅提升,登上GitHub熱門榜

Jun 06, 2024 pm 12:20 PM

目標偵測系統的標竿YOLO系列,再次獲得了重磅升級。自今年2月YOLOv9發布之後,YOLO(YouOnlyLookOnce)系列的接力棒傳到了清華大學研究人員的手上。上週末,YOLOv10推出的消息引發了AI界的關注。它被認為是電腦視覺領域的突破性框架,以其即時的端到端目標檢測能力而聞名,透過提供結合效率和準確性的強大解決方案,延續了YOLO系列的傳統。論文網址:https://arxiv.org/pdf/2405.14458專案網址:https://github.com/THU-MIG/yo

GoogleGemini 1.5技術報告:輕鬆證明奧數題,Flash版比GPT-4 Turbo快5倍

Jun 13, 2024 pm 01:52 PM

GoogleGemini 1.5技術報告:輕鬆證明奧數題,Flash版比GPT-4 Turbo快5倍

Jun 13, 2024 pm 01:52 PM

今年2月,Google上線了多模態大模型Gemini1.5,透過工程和基礎設施最佳化、MoE架構等策略大幅提升了效能和速度。擁有更長的上下文,更強推理能力,可以更好地處理跨模態內容。本週五,GoogleDeepMind正式發布了Gemini1.5的技術報告,內容涵蓋Flash版等最近升級,該文件長達153頁。技術報告連結:https://storage.googleapis.com/deepmind-media/gemini/gemini_v1_5_report.pdf在本報告中,Google介紹了Gemini1

綜述!全面概括基礎模型對於推動自動駕駛的重要作用

Jun 11, 2024 pm 05:29 PM

綜述!全面概括基礎模型對於推動自動駕駛的重要作用

Jun 11, 2024 pm 05:29 PM

写在前面&笔者的个人理解最近来,随着深度学习技术的发展和突破,大规模的基础模型(FoundationModels)在自然语言处理和计算机视觉领域取得了显著性的成果。基础模型在自动驾驶当中的应用也有很大的发展前景,可以提高对于场景的理解和推理。通过对丰富的语言和视觉数据进行预训练,基础模型可以理解和解释自动驾驶场景中的各类元素并进行推理,为驾驶决策和规划提供语言和动作命令。基础模型可以根据对驾驶场景的理解来实现数据增强,用于提供在常规驾驶和数据收集期间不太可能遇到的长尾分布中那些罕见的可行

不同資料集有不同的Scaling law?而你可用一個壓縮演算法來預測它

Jun 07, 2024 pm 05:51 PM

不同資料集有不同的Scaling law?而你可用一個壓縮演算法來預測它

Jun 07, 2024 pm 05:51 PM

一般而言,訓練神經網路耗費的運算量越大,其效能就越好。在擴大計算規模時,必須要做個決定:是增加模型參數量還是提升資料集大小-必須在固定的計算預算下權衡這兩個因素。增加模型參數量的好處是可以提高模型的複雜度和表達能力,從而更好地擬合訓練資料。然而,過多的參數可能導致過度擬合,使得模型在未見過的數據上表現不佳。另一方面,擴大資料集大小可以提高模型的泛化能力,減少過度擬合問題。我們告訴你們:只要能適當分配參數和數據,就能在固定計算預算下達到效能最大化。之前已有不少研究探索過神經語言模型的Scalingl

套殼醜聞讓史丹佛AI Lab主任怒了!抄襲團隊2人甩鍋1人失蹤、前科經歷被扒,網友:重新認識中國開源模型

Jun 09, 2024 am 09:38 AM

套殼醜聞讓史丹佛AI Lab主任怒了!抄襲團隊2人甩鍋1人失蹤、前科經歷被扒,網友:重新認識中國開源模型

Jun 09, 2024 am 09:38 AM

史丹佛團隊抄襲清華系大模型事件後續來了——Llama3-V團隊承認抄襲,其中兩位來自史丹佛的大學部學生還跟另一位作者切割了。最新致歉推文,由SiddharthSharma(悉達多)和AkshGarg(阿克什)發出。不在其中、來自南加州大學的MustafaAljadery(簡稱老穆)被指是主要過錯方,並且自昨天起人就失踪了:我們希望由老穆首發聲明,但自昨天以來一直無法聯繫到他。悉達多、我(阿克什)和老穆一起發布了Llama3-V,老穆為該專案編寫了程式碼。悉達多和我的角色是幫助他在Medium和T