這篇文章為大家帶來了關於Redis的相關知識,其中主要介紹了一些讓redis效能提升的小技巧,包括了pipeline、開啟IO多線程、避免big key等等,希望對大家有幫助。

推薦學習:Redis教學

Redis 是基於請求-回應模型的TCP伺服器.意味著單次請求 RTT(往返時間),取決於目前網路狀況 。這會導致單一 Redis 請求可能非常快,例如透過本地環路網路卡。可能非常慢,例如處於網路狀況不佳的環境。

另一方面,Redis 每次請求-回應,都涉及到 read 和 write 系統呼叫。甚至會觸發多次 epoll_wait 系統呼叫(Linux 平台)。這導致 Redis 不斷在用戶態和內核態進行切換。

static int connSocketRead(connection *conn, void *buf, size_t buf_len) {

// read 系统调用

int ret = read(conn->fd, buf, buf_len);}static int connSocketWrite(connection *conn, const void *data, size_t data_len) {

// write 系统调用

int ret = write(conn->fd, data, data_len);}int aeProcessEvents(aeEventLoop *eventLoop, int flags) {

// 事件触发,Linux 下为 epoll_wait 系统调用

numevents = aeApiPoll(eventLoop, tvp);}那麼,如何節省往返時間和系統呼叫次數呢?批次處理是一個好的方法。

為此,Redis 提供了 “pipeline”。 pipeline 的原理很簡單,將多個指令打包成「一個指令」發送。 Redis 收到後,解析成多個指令執行。最終將多個結果打包回傳。

「pipeline 可以有效的提升 Redis 效能」。

但是,使用 pipeline 有幾點需要你留意

「pipeline 不能保證原子性」。在一次 pipeline 指令執行期間,可能會執行其它 client 所啟動的指令。請記住,pipeline 只是批量處理命令。想要保證原子性,使用 MULTI 或 Lua 腳本。

「單次 pipeline 指令不宜過多」。使用 pipeline 時,Redis 會將 pipeline 指令的回應結果,暫存在記憶體 Reply buffer 中,等待所有指令執行完畢後回傳。如果 pipeline 指令過多,可能會導致佔用較多記憶體。可以將單一 pipeline 拆分成多個 pipeline。

在「Redis 6」版本以前,Redis 是「單執行緒」 讀取、解析、執行指令的。 Redis 6 開始,引入了 IO 多線程。

IO 執行緒負責讀取指令、解析指令、回傳結果。開啟後可以有效提升 IO 效能。

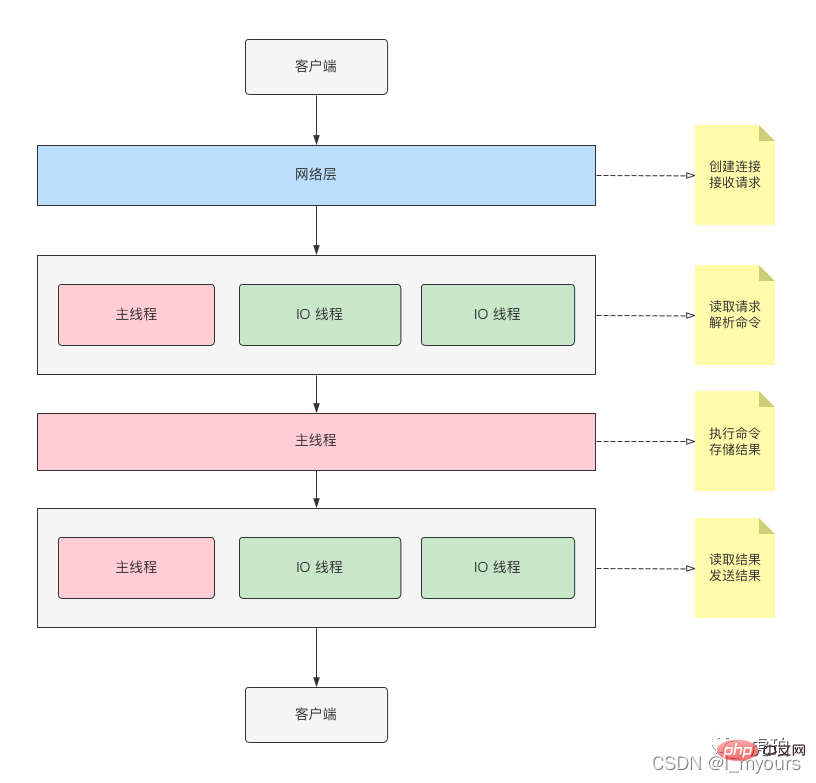

我畫了一張示意圖供你參考

如上圖所示,主執行緒和 IO 執行緒會共同參與指令的讀取、解析以及結果回應。

但執行指令的,為 「主執行緒」。

IO 執行緒預設關閉,你可以修改 redis.conf 以下配置開啟。

io-threads 4 io-threads-do-reads yes

“io-threads” 是 IO 執行緒數(包含主執行緒),我建議你依照機器,設定不同值進行壓測,取最優值。

Redis 執行指令是單一執行緒的,這表示 Redis 操作「big key」有阻塞的風險。

big key 通常指的是 Redis 儲存的 value 過大。包括:

舉個例子,假設我們有一個 200M 大小的 String key,名稱為「foo」。

執行以下命令

127.0.0.1:6379> GET foo

當傳回結果時,Redis 會分配 200m 的內存,並執行 memcpy 拷貝。

void _addReplyProtoToList(client *c, const char *s, size_t len) {

...

if (len) {

/* Create a new node, make sure it is allocated to at

* least PROTO_REPLY_CHUNK_BYTES */

size_t size = len size = zmalloc_usable_size(tail) - sizeof(clientReplyBlock);

tail->used = len;

// 内存拷贝

memcpy(tail->buf, s, len);

listAddNodeTail(c->reply, tail);

c->reply_bytes += tail->size;

closeClientOnOutputBufferLimitReached(c, 1);

}}而 Redis 輸出 buf 為 16k

// server.h#define PROTO_REPLY_CHUNK_BYTES (16*1024) /* 16k output buffer */typedef struct client {

...

char buf[PROTO_REPLY_CHUNK_BYTES];} client;這表示 Redis 無法單次回傳回應數據,需要註冊「可寫事件」,從而觸發多次 write 系統呼叫。

這裡有兩個耗時點:

那麼,如何找出big key 呢?

如果 slow log 出現了簡單指令,如 GET、SET、DEL,大機率是出現了 big key。

127.0.0.1:6379> SLOWLOG GET 3) (integer) 201323 // 单位微妙 4) 1) "GET" 2) "foo"

其次,可以透過 Redis 分析工具來尋找 big key。

$ redis-cli --bigkeys -i 0.1 ... [00.00%] Biggest string found so far '"foo"' with 209715200 bytes -------- summary ------- Sampled 1 keys in the keyspace! Total key length in bytes is 3 (avg len 3.00) Biggest string found '"foo"' has 209715200 bytes 1 strings with 209715200 bytes (100.00% of keys, avg size 209715200.00) 0 lists with 0 items (00.00% of keys, avg size 0.00) 0 hashs with 0 fields (00.00% of keys, avg size 0.00) 0 streams with 0 entries (00.00% of keys, avg size 0.00) 0 sets with 0 members (00.00% of keys, avg size 0.00) 0 zsets with 0 members (00.00% of keys, avg size 0.00)

對於 big key,有以下幾點建議:

1.業務中盡量避免 big key 出現。當出現 big key 時,你要判斷這樣設計是否合理,又或是出現了 bug。

2.將 big key 拆分為多個小 key。

3.使用替代指令。

如果 Redis 版本大於 4.0,可使用 UNLINK 指令取代 DEL。 Redis 版本大於 6.0,可開啟 lazy-free 機制。將釋放記憶體操作,放到後台執行緒執行。

LRANGE、HGETALL 等替換為 LSCAN、HSCAN 分次取得。

但我還是建議在業務中避免 big key。

我們知道 Redis 是「單執行緒」執行指令的。執行時間複雜度高的命令,很可能會阻塞其它請求。

复杂度高的命令和元素数量有关。通常有以下两种场景。

元素太多,消耗 IO 资源。如 HGETALL、LRANGE,时间复杂度为 O(N)。

计算过于复杂,消费 CPU 资源。如 ZUNIONSTORE,时间复杂度为 O(N)+O(M log(M))

Redis 官方手册,标记了命令执行的时间复杂度。建议你在使用不熟悉的命令前,先查看手册,留意时间复杂度。

实际业务中,你应该尽量避免时间复杂度高的命令。如果必须要用,有两点建议

保证操作的元素数量,尽可能少。

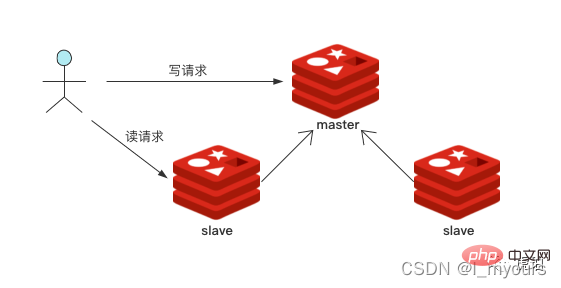

读写分离。复杂命令通常是读请求,可以放到「slave」结点执行。

key 过期或是使用 DEL 删除命令时,Redis 除了从全局 hash 表移除对象外,还会将对象分配的内存释放。当遇到 big key 时,释放内存会造成主线程阻塞。

为此,Redis 4.0 引入了 UNLINK 命令,将释放对象内存操作放入 bio 后台线程执行。从而有效减少主线程阻塞。

Redis 6.0 更进一步,引入了 Lazy-free 相关配置。当开启配置后,key 过期和 DEL 命令内部,会将「释放对象」操作「异步执行」。

void delCommand(client *c) {

delGenericCommand(c,server.lazyfree_lazy_user_del);}void delGenericCommand(client *c, int lazy) {

int numdel = 0, j;

for (j = 1; j argc; j++) {

expireIfNeeded(c->db,c->argv[j]);

// 开启 lazy free 则使用异步删除

int deleted = lazy ? dbAsyncDelete(c->db,c->argv[j]) :

dbSyncDelete(c->db,c->argv[j]);

...

}}建议至少升级到 Redis 6,并开启 Lazy-free。

Redis 通过副本,实现「主-从」运行模式,是故障切换的基石,用来提高系统运行可靠性。也支持读写分离,提高读性能。

你可以部署一个主结点,多个从结点。将读命令分散到从结点中,从而减轻主结点压力,提升性能。

Redis 6.0 开始支持绑定 CPU,可以有效减少线程上下文切换。

CPU 亲和性(CPU Affinity)是一种调度属性,它将一个进程或线程,「绑定」到一个或一组 CPU 上。也称为 CPU 绑定。

设置 CPU 亲和性可以一定程度避免 CPU 上下文切换,提高 CPU L1、L2 Cache 命中率。

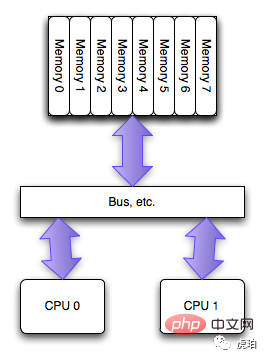

早期「SMP」架构下,每个 CPU 通过 BUS 总线共享资源。CPU 绑定意义不大。

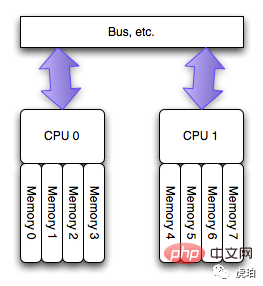

而在当前主流的「NUMA」架构下,每个 CPU 有自己的本地内存。访问本地内存有更快的速度。而访问其他 CPU 内存会导致较大的延迟。这时,CPU 绑定对系统运行速度的提升有较大的意义。

现实中的 NUMA 架构比上图更复杂,通常会将 CPU 分组,若干个 CPU 分配一组内存,称为 「node」。

你可以通过 「numactl -H 」 命令来查看 NUMA 硬件信息。

$ numactl -H available: 2 nodes (0-1)node 0 cpus: 0 2 4 6 8 10 12 14 16 18 20 22 24 26 28 30 32 34 36 38 node 0 size: 32143 MB node 0 free: 26681 MB node 1 cpus: 1 3 5 7 9 11 13 15 17 19 21 23 25 27 29 31 33 35 37 39 node 1 size: 32309 MB node 1 free: 24958 MB node distances: node 0 1 0: 10 21 1: 21 10

上图中可以得知该机器有 40 个 CPU,分组为 2 个 node。

node distances 是一个二维矩阵,表示 node 之间 「访问距离」,10 为基准值。上述命令中可以得知,node 自身访问,距离是 10。跨 node 访问,如 node 0 访问 node 1 距离为 21。说明该机器「跨 node 访问速度」比「node 自身访问速度」慢 2.1 倍。

其实,早在 2015 年,有人提出 Redis 需要支持设置 CPU 亲和性,而当时的 Redis 还没有支持 IO 多线程,该提议搁置。

而 Redis 6.0 引入 IO 多线程。同时,也支持了设置 CPU 亲和性。

我画了一张 Redis 6.0 线程家族供你参考。

上图可分为 3 个模块

Redis 支持分别配置上述模块的 CPU 亲和度。你可以在 redis.conf 找到以下配置(该配置需手动开启)。

# IO 线程(包含主线程)绑定到 CPU 0、2、4、6 server_cpulist 0-7:2 # bio 线程绑定到 CPU 1、3 bio_cpulist 1,3 # aof rewrite 后台进程绑定到 CPU 8、9、10、11 aof_rewrite_cpulist 8-11 # bgsave 后台进程绑定到 CPU 1、10、11 bgsave_cpulist 1,10-11

我在上述机器,针对 IO 线程和主线程,进行如下测试:

首先,开启 IO 线程配置。

io-threads 4 # 主线程 + 3 个 IO 线程io-threads-do-reads yes # IO 线程开启读和解析命令功能

测试如下三种场景:

不开启 CPU 绑定配置。

绑定到不同 node。

「server_cpulist 0,1,2,3」

绑定到相同 node。

「server_cpulist 0,2,4,6」

通过 redis-benchmark 对 get 命令进行基准测试,每种场景执行 3 次。

$ redis-benchmark -n 5000000 -c 50 -t get --threads 4

结果如下:

1.不开启 CPU 绑定配置

throughput summary: 248818.11 requests per second throughput summary: 248694.36 requests per second throughput summary: 249004.00 requests per second

2.绑定不同 node

throughput summary: 248880.03 requests per second throughput summary: 248447.20 requests per second throughput summary: 248818.11 requests per second

3.绑定相同 node

throughput summary: 284414.09 requests per second throughput summary: 284333.25 requests per second throughput summary: 265252.00 requests per second

根据测试结果,绑定到同一个 node,qps 大约提升 15%

使用绑定 CPU,你需要注意以下几点:

Linux 下,你可以使用 「numactl --hardware」 查看硬件布局,确保支持并开启 NUMA。

线程要尽可能分布在 「不同的 CPU,相同的 node」,设置 CPU 亲和度才有效。否则会造成频繁上下文切换和远距离内存访问。

你要熟悉 CPU 架构,做好充分的测试。否则可能适得其反,导致 Redis 性能下降。

Redis 支持两种持久化策略,RDB 和 AOF。

RDB 通过 fork 子进程,生成数据快照,二进制格式。

AOF 是增量日志,文本格式,通常较大。会通过 AOF rewrite 重写日志,节省空间。

除了手动执行「BGREWRITEAOF」命令外,以下 4 点也会触发 AOF 重写

执行「config set appendonly yes」命令

AOF 文件大小比例超出阈值,「auto-aof-rewrite-percentage」

AOF 文件大小绝对值超出阈值,「auto-aof-rewrite-min-size」

主从复制完成 RDB 加载

RDB 和 AOF,都是在主线程中触发执行。虽然具体执行,会通过 fork 交给后台子进程。但 fork 操作,会拷贝进程数据结构、页表等,当实例内存较大时,会影响性能。

AOF 支持以下三种策略。

appendfsync no:由操作系统决定执行 fsync 时机。 对 Linux 来说,通常每 30 秒执行一次 fsync,将缓冲区中的数据刷到磁盘上。如果 Redis qps 过高或写 big key,可能导致 buffer 写满,从而频繁触发 fsync。

appendfsync everysec: 每秒执行一次 fsync。

appendfsync always: 每次「写」会调用一次 fsync,性能影响较大。

AOF 和 RDB 都会对磁盘 IO 造成较高的压力。其中,AOF rewrite 会将 Redis hash 表所有数据进行遍历并写磁盘。对性能会产生一定的影响。

线上业务 Redis 通常是高可用的。如果对缓存数据丢失不敏感。考虑关闭 RDB 和 AOF 以提升性能。

如果无法关闭,有以下几点建议:

RDB 选择业务低峰期做,通常为凌晨。保持单个实例内存不超过 32 G。太大的内存会导致 fork 耗时增加。

AOF 选择 appendfsync no 或者 appendfsync everysec。

AOF auto-aof-rewrite-min-size 配置大一些,如 2G。避免频繁触发 rewrite。

AOF 可以仅在从节点开启,减轻主节点压力。

根据本地测试,不开启 AOF,写性能大约能提升 20% 左右。

Redis 是基于 TCP 协议,请求-响应式服务器。使用短连接会导致频繁的创建连接。

短连接有以下几个慢速操作:

创建连接时,TCP 会执行三次握手、慢启动等策略。

Redis 会触发新建/断开连接事件,执行分配/销毁客户端等耗时操作。

如果你使用的是 Redis Cluster,新建连接时,客户端会拉取 slots 信息初始化。建立连接速度更慢。

所以,相对于性能快速的 Redis,创建连接是十分慢速的操作。

「建议使用连接池,并合理设置连接池大小」。

但使用长连接时,需要留意一点,要有「自动重连」策略。避免因网络异常,导致连接失效,影响正常业务。

SWAP 是内存交换技术。将内存按页,复制到预先设定的磁盘空间上。

内存是快速的,昂贵的。而磁盘是低速的,廉价的。

通常使用 SWAP 越多,系统性能越低。

Redis 是内存数据库,使用 SWAP 会导致性能快速下降。

建议留有足够内存,并关闭 SWAP。

以上就是今天为大家分享的 「提升 Redis 性能的 10 个手段」。

我绘制了思维导图,方便大家记忆。

可以看到,性能优化并不容易,需要我们了解很多底层知识,并做出充分测试。在不同机器、不同系统、不同配置下,Redis 都会有不同的性能表现。

推荐学习:Redis学习教程

以上是總結10點提升Redis效能的小技巧的詳細內容。更多資訊請關注PHP中文網其他相關文章!