全面了解大語言模型,這有一份閱讀清單

了解當代大型語言模型背後的設計、限制和演變,你可以遵循本文的閱讀清單。

大型語言模型已經引起了公眾的注意,短短五年內,Transforme等模型幾乎完全改變了自然語言處理領域。此外,它們也開始在電腦視覺和計算生物學等領域引發革命。

鑑於Transformers對每個人的研究進程都有如此大的影響,本文將為大家介紹一個簡短的閱讀清單,供機器學習研究人員和從業者入門使用。

下面的清單主要是按時間順序展開的,主要是一些學術研究論文。當然,還有許多其他有用的資源。例如:

- Jay Alammar撰寫的《The Illustrated Transformer》

- Lilian Weng撰寫的《The Transformer Family》

- Xavier Amatriain撰寫的《Transformer models: an introduction and catalog — 2023 Edition》

- Andrej Karpathy寫的nanoGPT庫

對主要架構和任務的理解

# 如果你是Transformers、大型語言模型新手,那麼這幾篇文章最適合你。

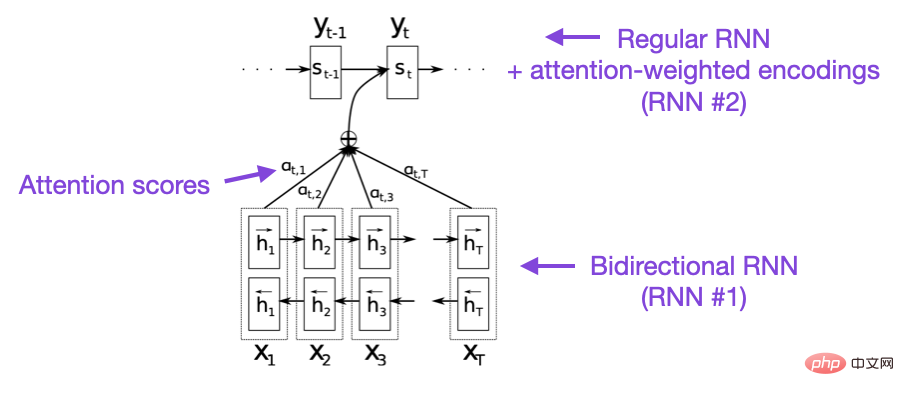

論文1:《Neural Machine Translation by Jointly Learning to Align and Translate》

圖源: https://arxiv.org/abs/1409.0473

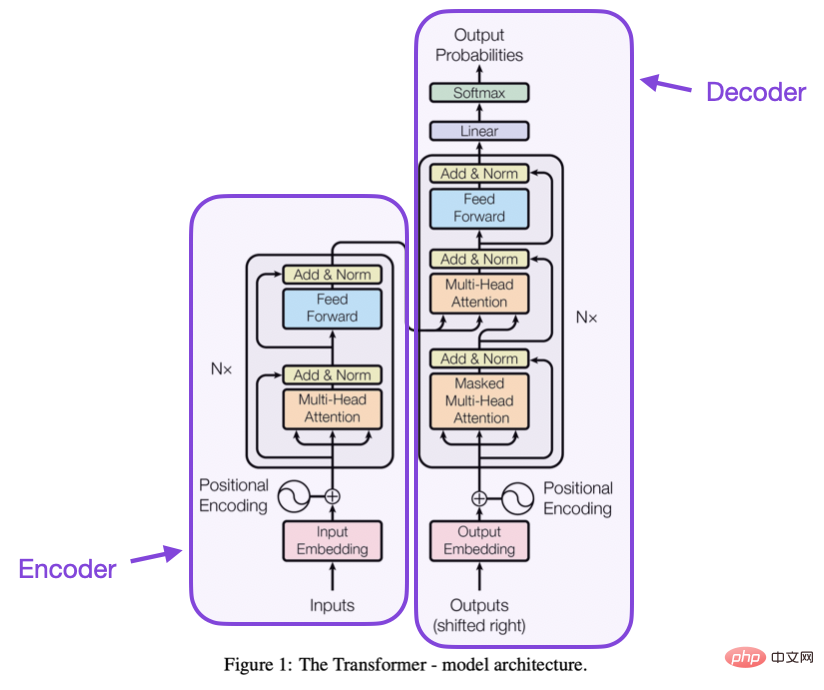

論文2:《Attention Is All You Need 》

圖源:https://arxiv.org/abs/1706.03762

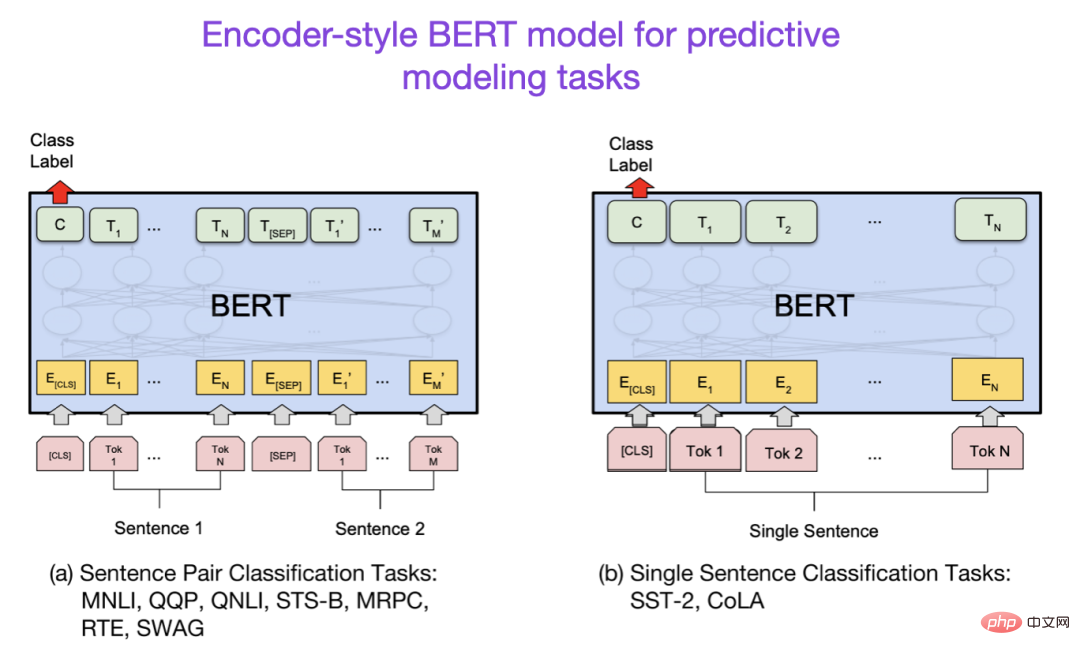

論文3:《BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding》

圖片來源:https://arxiv.org/abs/1810.04805

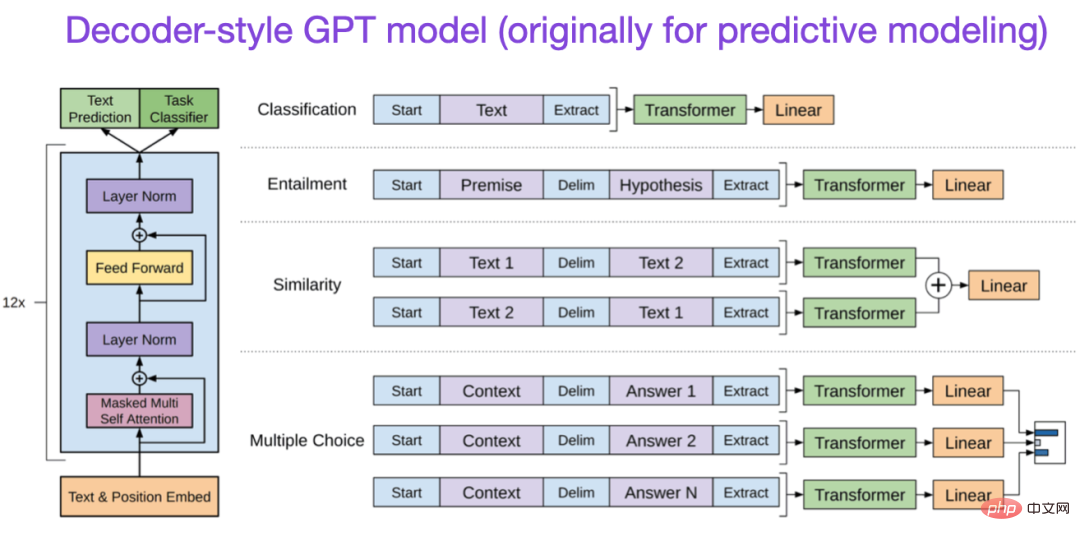

論文4:《Improving Language Understanding by Generative Pre-Training》

論文5:《BART: Denoising Sequence-to-Sequence Pre-training for Natural Language Generation, Translation, and Comprehension》

#論文網址https://arxiv.org/abs/1910.13461.

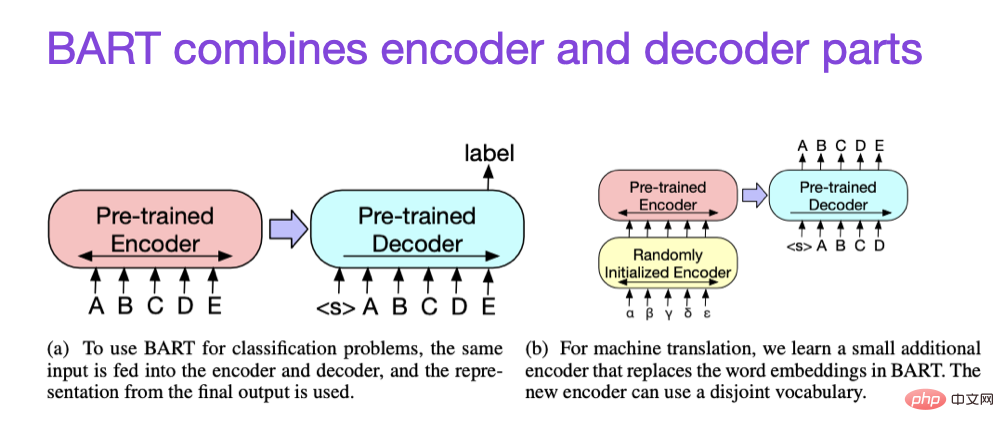

如上所述, BERT型編碼器風格的LLM通常是預測建模任務的首選,而GPT型解碼器風格的LLM更擅長生成文字。為了兩全其美,上面的BART論文結合了編碼器和解碼器部分。

擴展定律與效率提升

如果你想了解更多關於提高Transformer效率的技術,可以參考以下論文

- 論文1:《A Survey on Efficient Training of Transformers》

- 論文網址:https://arxiv.org/abs/2302.01107

- #論文2:《FlashAttention: Fast and Memory-Efficient Exact Attention with IO-Awareness》

- 論文地址:https://arxiv.org/abs/2205.14135

- #論文3:《Cramming: Training a Language Model on a Single GPU in One Day》

- 論文地址:https://arxiv .org/abs/2212.14034

- 論文4:《Training Compute-Optimal Large Language Models》

- 論文地址:https: //arxiv.org/abs/2203.15556

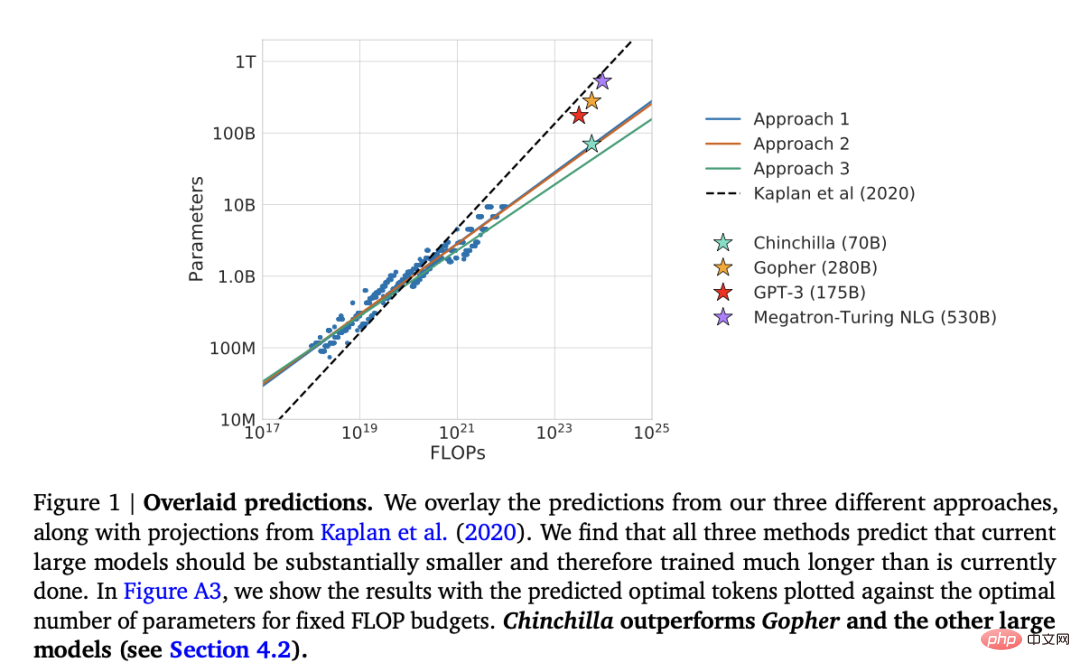

此外,還有論文《Training Compute-Optimal Large Language Models》

論文網址:https://arxiv.org/abs /2203.15556

本文介紹了700億參數的Chinchilla模型,在產生建模任務上優於流行的1750億參數的GPT-3模型。然而,它的主要點睛之處在於,當代大型語言模式訓練嚴重不足。

本文定義了用於大型語言模型訓練的線性scaling law。例如,雖然Chinchilla的大小只有GPT-3的一半,但它的表現優於GPT-3,因為它是在1.4萬億(而不是3000億)token上進行訓練的。換句話說,訓練token的數量和模型大小一樣重要。

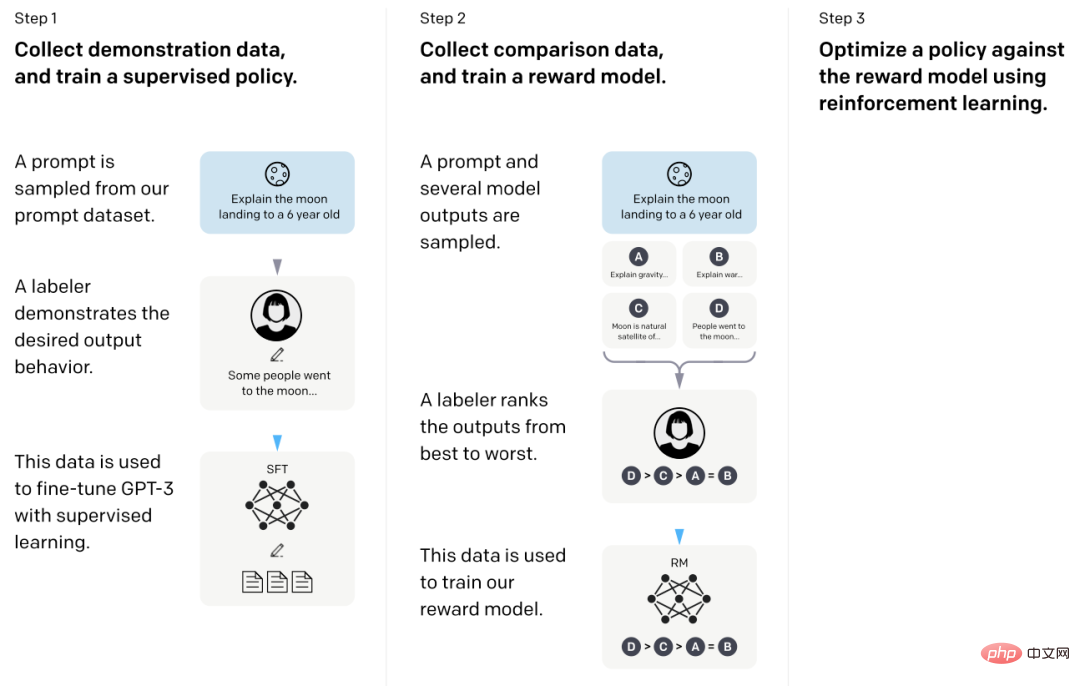

對齊-將大型語言模型朝著預期的目標和興趣引導

##近年來出現了許多相對強大的大型語言模型,它們可以產生真實的文字(例如GPT-3和Chinchilla)。就常用的預訓練範式而言,目前似乎已經達到了一個上限。 為了讓語言模型更能幫助人類,減少錯誤訊息和不良語言,研究人員設計了額外的訓練範式來微調預訓練的基礎模型,包括以下論文。- 論文1:《Training Language Models to Follow Instructions with Human Feedback》

- 論文網址:https://arxiv.org/abs/2203.02155

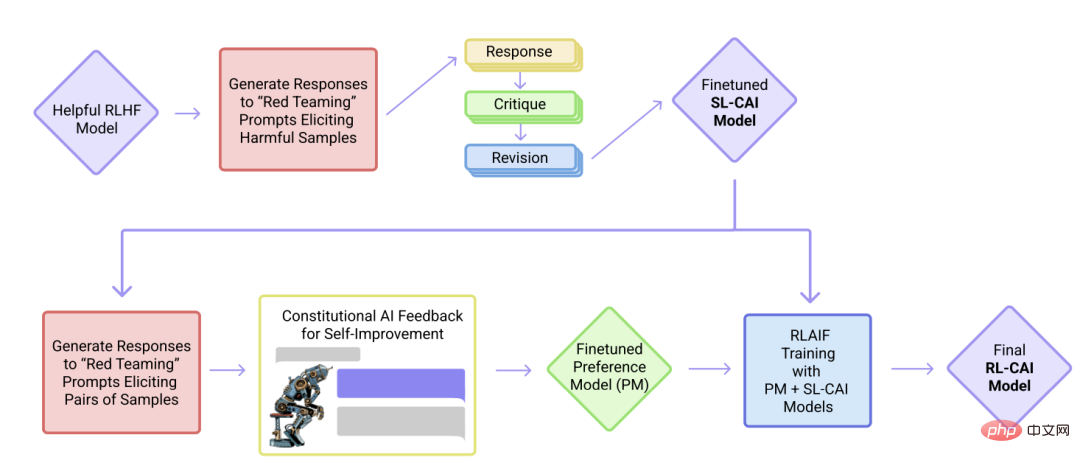

- 論文2:《Constitutional AI: Harmlessness from AI Feedback》

- 論文網址:https://arxiv.org/abs/2212.08073

#在這篇在論文中,研究人員進一步推進了對齊的想法,提出了創建「harmless」的AI系統的訓練機制。研究人員提出了一種基於規則清單(由人類提供)的自訓練機制,而不是直接由人類監督。與上述的InstructGPT論文類似,所提出的方法使用了強化學習方法。

總結

本文對上方表單的排列盡量保持簡潔美觀,建議重點關注前10篇論文,以了解當代大型語言模型背後的設計、限制和演變。

如果想深入閱讀,建議參考上述論文的參考文獻。或者,這裡有一些額外的資源,供讀者進一步研究:

GPT的開源替代方案

- 論文1:《BLOOM: A 176B-Parameter Open-Access Multilingual Language Model》

- 論文網址:https://arxiv.org/abs/2211.05100

- 論文2 :《OPT: Open Pre-trained Transformer Language Models》

- 論文網址:https://arxiv.org/abs/2205.01068

#ChatGPT的替代方案

- 論文1《LaMDA: Language Models for Dialog Applications》

- 論文網址:https://arxiv.org/abs/2201.08239

- #論文2:《Improving alignment of dialogue agents via targeted human judgements》

- 論文地址:https://arxiv.org/abs/2209.14375

- #論文3:《BlenderBot 3: a deployed conversational agent that continually learns to responsibly engage》

- 論文地址:https://arxiv. org/abs/2208.03188

計算生物學中的大型語言模型

- 論文1:《 ProtTrans: Towards Cracking the Language of Life's Code Through Self-Supervised Learning 》

- 論文網址:https://arxiv.org/abs/2007.06225

- 論文2: 《Highly accurate protein structure prediction with AlphaFold》

- 論文地址:https://www.nature.com/articles/s41586-021-03819-2

以上是全面了解大語言模型,這有一份閱讀清單的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

幣圈行情實時數據免費平台推薦前十名發布

Apr 22, 2025 am 08:12 AM

幣圈行情實時數據免費平台推薦前十名發布

Apr 22, 2025 am 08:12 AM

適合新手的加密貨幣數據平台有CoinMarketCap和非小號。 1. CoinMarketCap提供全球加密貨幣實時價格、市值、交易量排名,適合新手與基礎分析需求。 2. 非小號提供中文友好界面,適合中文用戶快速篩選低風險潛力項目。

okx在線 okx交易所官網在線

Apr 22, 2025 am 06:45 AM

okx在線 okx交易所官網在線

Apr 22, 2025 am 06:45 AM

OKX 交易所的詳細介紹如下:1) 發展歷程:2017 年創辦,2022 年更名為 OKX;2) 總部位於塞舌爾;3) 業務範圍涵蓋多種交易產品,支持 350 多種加密貨幣;4) 用戶遍布 200 餘個國家,千萬級用戶量;5) 採用多重安全措施保障用戶資產;6) 交易費用基於做市商模式,費率隨交易量增加而降低;7) 曾獲多項榮譽,如“年度加密貨幣交易所”等。

各大虛擬貨幣交易平台的特色服務一覽

Apr 22, 2025 am 08:09 AM

各大虛擬貨幣交易平台的特色服務一覽

Apr 22, 2025 am 08:09 AM

機構投資者應選擇Coinbase Pro和Genesis Trading等合規平台,關注冷存儲比例與審計透明度;散戶投資者應選擇幣安和火幣等大平台,注重用戶體驗與安全;合規敏感地區的用戶可通過Circle Trade和Huobi Global進行法幣交易,中國大陸用戶需通過合規場外渠道。

大宗交易的虛擬貨幣交易平台排行榜top10最新發布

Apr 22, 2025 am 08:18 AM

大宗交易的虛擬貨幣交易平台排行榜top10最新發布

Apr 22, 2025 am 08:18 AM

選擇大宗交易平台時應考慮以下因素:1. 流動性:優先選擇日均交易量超50億美元的平台。 2. 合規性:查看平台是否持有美國FinCEN、歐盟MiCA等牌照。 3. 安全性:冷錢包存儲比例和保險機制是關鍵指標。 4. 服務能力:是否提供專屬客戶經理和定制化交易工具。

支持多種幣種的虛擬貨幣交易平台推薦前十名一覽

Apr 22, 2025 am 08:15 AM

支持多種幣種的虛擬貨幣交易平台推薦前十名一覽

Apr 22, 2025 am 08:15 AM

優先選擇合規平台如OKX和Coinbase,啟用多重驗證,資產自託管可減少依賴:1. 選擇有監管牌照的交易所;2. 開啟2FA和提幣白名單;3. 使用硬件錢包或支持自託管的平台。

數字貨幣交易app容易上手的推薦top10(025年最新排名)

Apr 22, 2025 am 07:45 AM

數字貨幣交易app容易上手的推薦top10(025年最新排名)

Apr 22, 2025 am 07:45 AM

gate.io(全球版)核心優勢是界面極簡,支持中文,法幣交易流程直觀;幣安(簡版)核心優勢是全球交易量第一,簡版模式僅保留現貨交易;OKX(香港版)核心優勢是界面簡潔,支持粵語/普通話,衍生品交易門檻低;火幣全球站(香港版)核心優勢是老牌交易所,推出元宇宙交易終端;KuCoin(中文社區版)核心優勢是支持800 幣種,界面採用微信式交互;Kraken(香港版)核心優勢是美國老牌交易所,持有香港SVF牌照,界面簡潔;HashKey Exchange(香港持牌)核心優勢是香港知名持牌交易所,支持法

幣圈十大行情網站的使用技巧與推薦2025

Apr 22, 2025 am 08:03 AM

幣圈十大行情網站的使用技巧與推薦2025

Apr 22, 2025 am 08:03 AM

國內用戶適配方案包括合規渠道和本地化工具。 1. 合規渠道:通過OTC平台如Circle Trade進行法幣兌換,境內需通過香港或海外平台。 2. 本地化工具:使用幣圈網獲取中文資訊,火幣全球站提供元宇宙交易終端。

數字貨幣交易所App前十名蘋果版下載入口匯總

Apr 22, 2025 am 09:27 AM

數字貨幣交易所App前十名蘋果版下載入口匯總

Apr 22, 2025 am 09:27 AM

提供各種複雜的交易工具和市場分析。覆蓋 100 多個國家,日均衍生品交易量超 300 億美元,支持 300 多個交易對與 200 倍槓桿,技術實力強大,擁有龐大的全球用戶基礎,提供專業的交易平台、安全存儲解決方案以及豐富的交易對。