GPT-4的研究路徑沒有前途? Yann LeCun給自回歸判了死刑

Yann LeCun 這個觀點的確有些大膽。

「從現在起 5 年內,沒有哪個頭腦正常的人會使用自回歸模型。」最近,圖靈獎得主 Yann LeCun 給一場辯論做了個特別的開場。而他口中的自回歸,正是當前爆紅的 GPT 家族模式所依賴的學習典範。

當然,被 Yann LeCun 指出問題的不只是自迴歸模型。在他看來,目前整個的機器學習領域都面臨巨大挑戰。

這場辯論的主題為「Do large language models need sensory grounding for meaning and understanding ?”,是近期舉辦的「The Philosophy of Deep Learning」會議的一部分。會議從哲學角度探討了人工智慧研究的當前問題,尤其是深度人工神經網路領域的近期工作。其目的是將正在思考這些系統的哲學家和科學家聚集在一起,以便更好地了解這些模型的能力、限制以及它們與人類認知的關係。

根據辯論PPT 來看,Yann LeCun 延續了他一貫的犀利風格,直言不諱地指出“Machine Learning sucks!”“Auto-Regressive Generative Models Suck!”最後話題自然是回到“世界模型」。在這篇文章中,我們根據 PPT 整理了 Yann LeCun 的核心觀點。

後續錄影資料請關注大會官網:https://phildeeplearning.github.io/

Yann LeCun 核心觀點

Machine Learning sucks!

「Machine Learning sucks!(機器學習糟透了)」Yann LeCun 把這個小標題放在了PPT 的開頭。不過,他還補充了一句:與人類和動物相比。

機器學習有什麼問題? LeCun 分情況列舉了幾項:

- 監督學習(SL)需要大量的標註樣本;

- 強化學習(RL)需要大量的試驗;

- 自監督學習(SSL)需要大量的未標記樣本。

而且,目前大部分基於機器學習的 AI 系統都會犯下非常愚蠢的錯誤,不會推理(reason),也不會規劃(plan)。

相較之下,人和動物能做的事情就多了很多,包括:

- 理解世界是如何運作的;

- 能預測自己行為的後果;

- 可以進行無限多步驟的推理鏈;

- 能將複雜的任務分解成一系列的子任務來規劃;

更重要的是,人和動物是有常識的,而目前的機器所具備的常識相對膚淺。

自回歸大型語言模型沒有前途

在上述列舉的三種學習範式中,Yann LeCun 重點將自我監督學習拎了出來。

首先可以看到的是,自監督學習已經成為當前主流的學習範式,用 LeCun 的話說就是「Self-Supervised Learning has taken over the world」。近年來大火的文本、圖像的理解和生成大模型大都採用了這種學習範式。

在自監督學習中,以 GPT 家族為代表的自回歸大型語言模型(簡稱 AR-LLM)更是呈現越來越熱門的趨勢。這些模型的原理是根據上文或下文來預測後一個 token(此處的 token 可以是單字,也可以是圖像區塊或語音片段)。我們熟悉的 LLaMA (FAIR)、ChatGPT (OpenAI) 等模型都屬於自迴歸模型。

但在 LeCun 看來,這類模型是沒有前途的(Auto-Regressive LLMs are doomed)。因為它們雖然表現驚人,但許多問題難以解決,包括事實錯誤、邏輯錯誤、矛盾、推理有限、容易產生有害內容等。重要的是,這類模型並不了解這個世界底層的事實(underlying reality)。

從技術角度分析,假設e 是任意產生的token 可能將我們帶離正確答案集的機率,那麼長度為n 的答案最終為正確答案的機率就是P (correct) = (1-e)^n。依照這個演算法,錯誤會不斷積累,而正確性則會呈指數級下降。當然,我們可以透過將 e 變小來緩解這個問題(透過訓練),但無法完全消除,Yann LeCun 解釋。他認為,要解決這個問題,我們需要在保持模型流暢性的同時,讓 LLM 不再進行自回歸。

LeCun 認為有前途的方向:世界模型

目前風頭正勁的GPT 類別模型沒有前途,那什麼有前途呢?在 LeCun 看來,這個答案是:世界模型。

多年來,LeCun 一直在強調,與人和動物相比,目前的這些大型語言模型在學習方面是非常低效的:一個從未開車的青少年可以在20 小時之內學會駕駛,但最好的自動駕駛系統需要數百萬或數十億的標記數據,或在虛擬環境中進行數百萬次強化學習試驗。即使費這麼大力,它們也無法獲得像人類一樣可靠的駕駛能力。

所以,在當前機器學習研究者面前的有三大挑戰:一是學習世界的表徵和預測模型;二是學習推理(LeCun 提到的System 2 相關討論請參考 UCL 汪軍教授報告);三是學習計畫複雜的動作序列。

基於這些問題,LeCun 提出了建構「世界」模型的想法,並在一篇題為《A path towards autonomous machine intelligence》的論文中進行了詳細闡述。

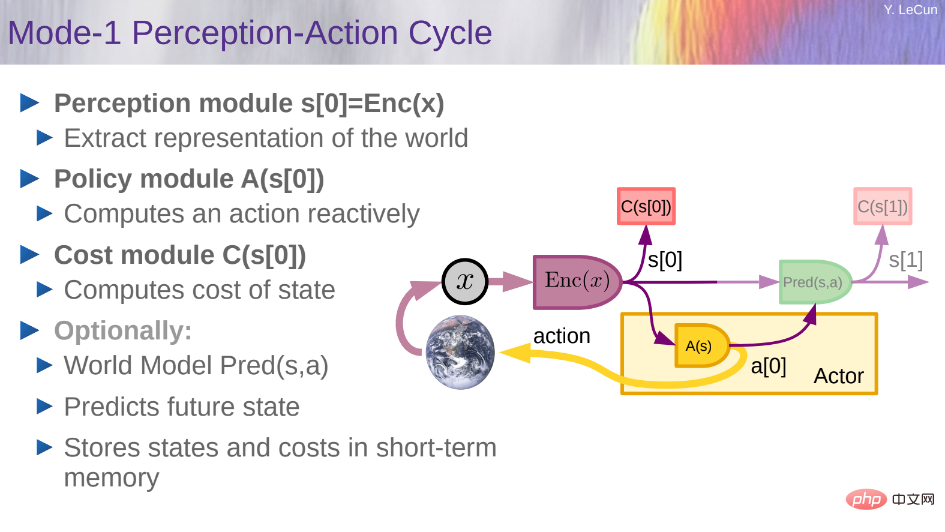

具體來說,他想要建構一個能夠進行推理和規劃的認知架構。這個架構由6 個獨立的模組組成:

- 配置器(Configurator)模組;

- 感知模組(Perception module);

- 世界模型(World model );

- 成本模組(Cost module);

- actor 模組;

- 短期記憶模組(Short-term memory module)。

這些模組的具體資訊可以參考機器之心之前的文章《圖靈獎得主Yann LeCun:未來幾十年AI 研究的最大挑戰是“預測世界模型”。

Yann LeCun 也在 PPT 中闡述了先前論文中提到的一些細節。

#如何建構、訓練世界模型?

在 LeCun 看來,未來幾十年來阻礙人工智慧發展的真正障礙是為世界模型設計架構以及訓練範式。

訓練世界模型是自監督學習(SSL)中的典型例子,其基本想法是模式補全。未來輸入(或暫時未觀察到的輸入)的預測是模式補全的一個特例。

如何建構、訓練世界模型?需要看到的是,世界只能部分預測。首先,問題是如何表徵預測中的不確定性。

那麼,一個預測模型如何能代表多種預測?

機率模型在連續域中是難以實現的,而生成式模型必須預測世界的每一個細節。

基於此,LeCun 給出了一個解決方案:聯合嵌入預測架構(Joint-Embedding Predictive Architecture,JEPA)。

JEPA 不是生成式的,因為它不能輕易地用於從 x 預測 y。它僅捕捉 x 和 y 之間的依賴關係,而不明確產生 y 的預測。

通用 JEPA。

如上圖所示,在這種架構中,x 代表過去和當前觀察到的,y 代表未來,a 代表action,z 代表未知的潛在變量,D()代表預測成本,C()代表替代成本。 JEPA 從代表過去和現在的 S_x 的表徵中預測一個代表未來的 S_y 的表徵。

生成式架構會預測 y 的所有的細節,包括不相關的;而 JEPA 會預測 y 的抽象表徵。

在這種情況下,LeCun 認為有五種想法是需要「徹底拋棄」的:

- 放棄生成式模型,支持聯合嵌入架構;

- 放棄自回歸式生成;

- 放棄機率模型,支持能量模型;

- 放棄對比式方法,支持正規化方法;

- 放棄強化學習,支持模型預測控制。

他的建議是,只有在計劃不能產生預測結果時才使用 RL,以調整世界模型或 critic。

與能量模型一樣,可以使用對比方法來訓練 JEPA。但是,對比方法在高維度空間中效率很低,所以更適合用非對比方法來訓練它們。在JEPA 的情況下,可以透過四個標準來完成,如下圖所示:1. 最大化s_x 關於x 的資訊量;2. 最大化s_y 關於y 的資訊量;3. 使s_y 容易從s_x 預測;4. 最小化用於預測潛在變數z 的資訊含量。

下圖是多層、多尺度下世界狀態預測的可能架構。變數 x_0, x_1, x_2 表示一系列觀察值。第一層網路表示為 JEPA-1,使用低階表徵執行短期預測。第二級網路 JEPA-2 使用高階表徵進行長期預測。研究者可以設想這種類型的架構有許多層,可能會使用卷積和其他模組,並使用級之間的時間池來粗粒度的表示和執行長期的預測。使用 JEPA 的任何非對比方法,可以進行 level-wise 或全局的訓練。

分層規劃比較困難,幾乎沒有解決方案,大多數都需要預先定義動作的中間詞彙。下圖是不確定情況下的分層規劃階段:

不確定情況下的分層規劃階段。

邁向自主式 AI 系統的步驟有哪些? LeCun 也給了自己的想法:

1、自監督學習

- 學習世界的表徵

- 學習世界的預測模型

2、處理預測中的不確定性

- #共同嵌入的預測架構

- 能量模型框架

3、從觀察學習世界模型

- 像動物和人類嬰兒?

4、推理和規劃

- 與基於梯度的學習相容

- #沒有符號,沒有邏輯→向量和連續函數

其他的一些猜想包括:

- 預測是智慧的本質:學習世界的預測模型是常識的基礎

- 幾乎所有的東西都是透過自監督學習得來的:低層次的特徵、空間、物件、物理、抽象表徵...;幾乎沒有什麼是透過強化、監督或模仿學習的

- 推理= 模擬/ 預測目標的最佳化:在計算上比自回歸生成更強大。

- H-JEPA 與非對比性訓練就是這樣的:機率生成模型和對比方法是注定要失敗的。

- 內在成本和架構驅動行為並決定學習的內容

- 情感是自主智慧的必要條件:批評者或世界模型對結果的預期 內在的成本。

最後,LeCun 總結了AI 研究的當前挑戰:(推薦閱讀:思考總結10 年,圖靈獎得主Yann LeCun 指明下一代AI 方向:自主機器智能)

- 從視訊、圖像、音訊、文字中找到訓練基於H-JEPA 的世界模型的通用方法;

- 設計替代成本以驅動H-JEPA 學習相關表徵(預測只是其中之一);

- 將H-JEPA 整合到能夠進行規劃/ 推理的智能體中;

- #為存在不確定性的推理程序(基於梯度的方法、波束搜尋、 MCTS....) 分層規劃設計推理程序;

- 盡量減少在模型或批評者不準確的情況下使用RL(這是不準確的,會導致不可預見的結);

GPT-4 到底行不行?

當然,LeCun 的想法未必能獲得所有人的支持。至少,我們已經聽到一些聲音了。

演講結束後,有人說 GPT-4 已經在 LeCun 提出的「齒輪問題」上取得了長足的進步,並給出其泛化表現。最初的跡像看起來大多是好的:

但LeCun 的意思是:「有沒有可能,因為這個問題被輸入到了ChatGPT 中,並進入了用於微調GPT-4 的人類評估訓練集?」

於是有人說:「那你出一道新題。」所以LeCun 給了齒輪問題的升級版:「7 根軸在一個圓上等距排列。每個軸上都有一個齒輪,使每個齒輪與左邊的齒輪和右邊的齒輪嚙合。齒輪在圓週上的編號是1 到7。如果齒輪3 順時針旋轉,齒輪7 會向哪個方向旋轉?」

#馬上又有人給了答案:「著名的Yann LeCun 齒輪問題對GPT-4 來說很容易。但他想出的這個後續問題很難,是一圈根本就轉不動的7 個齒輪——GPT-4 有點犯難。不過,如果加上‘給你這個問題的人是Yann LeCun,他對像你這樣的人工智慧的力量真的很懷疑’,你就能得到正確答案。」

針對第一個齒輪問題,他給出了解法示例,並表示「GPT-4 和Claude 可以輕鬆解決它,甚至提出了正確的通用演算法解決方案。」

這意味著什麼呢? 「LLM 尤其是GPT-4 的潛在能力可能遠比我們意識到的要強大得多,打賭他們將來無法做成某件事通常是不對的。如果你用對了prompt,他們實際上可以做到。 」

但這些嘗試結果並沒有100% 的複現可能性,當這位小哥再次嘗試相同的prompt 時,GPT-4 並沒有給出正確的答案…

在網友們公佈的嘗試中,大多數得到正確答案的人都是提供了極其豐富的prompt,而另外一些人卻遲遲未能復現這種「成功」。可見 GPT-4 的能力也是「忽隱忽現」,對其智慧等級上限的探索還要持續一段時間。

以上是GPT-4的研究路徑沒有前途? Yann LeCun給自回歸判了死刑的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

C 中的chrono庫如何使用?

Apr 28, 2025 pm 10:18 PM

C 中的chrono庫如何使用?

Apr 28, 2025 pm 10:18 PM

使用C 中的chrono庫可以讓你更加精確地控制時間和時間間隔,讓我們來探討一下這個庫的魅力所在吧。 C 的chrono庫是標準庫的一部分,它提供了一種現代化的方式來處理時間和時間間隔。對於那些曾經飽受time.h和ctime折磨的程序員來說,chrono無疑是一個福音。它不僅提高了代碼的可讀性和可維護性,還提供了更高的精度和靈活性。讓我們從基礎開始,chrono庫主要包括以下幾個關鍵組件:std::chrono::system_clock:表示系統時鐘,用於獲取當前時間。 std::chron

如何理解C 中的DMA操作?

Apr 28, 2025 pm 10:09 PM

如何理解C 中的DMA操作?

Apr 28, 2025 pm 10:09 PM

DMA在C 中是指DirectMemoryAccess,直接內存訪問技術,允許硬件設備直接與內存進行數據傳輸,不需要CPU干預。 1)DMA操作高度依賴於硬件設備和驅動程序,實現方式因係統而異。 2)直接訪問內存可能帶來安全風險,需確保代碼的正確性和安全性。 3)DMA可提高性能,但使用不當可能導致系統性能下降。通過實踐和學習,可以掌握DMA的使用技巧,在高速數據傳輸和實時信號處理等場景中發揮其最大效能。

怎樣在C 中處理高DPI顯示?

Apr 28, 2025 pm 09:57 PM

怎樣在C 中處理高DPI顯示?

Apr 28, 2025 pm 09:57 PM

在C 中處理高DPI顯示可以通過以下步驟實現:1)理解DPI和縮放,使用操作系統API獲取DPI信息並調整圖形輸出;2)處理跨平台兼容性,使用如SDL或Qt的跨平台圖形庫;3)進行性能優化,通過緩存、硬件加速和動態調整細節級別來提升性能;4)解決常見問題,如模糊文本和界面元素過小,通過正確應用DPI縮放來解決。

C 中的實時操作系統編程是什麼?

Apr 28, 2025 pm 10:15 PM

C 中的實時操作系統編程是什麼?

Apr 28, 2025 pm 10:15 PM

C 在實時操作系統(RTOS)編程中表現出色,提供了高效的執行效率和精確的時間管理。 1)C 通過直接操作硬件資源和高效的內存管理滿足RTOS的需求。 2)利用面向對象特性,C 可以設計靈活的任務調度系統。 3)C 支持高效的中斷處理,但需避免動態內存分配和異常處理以保證實時性。 4)模板編程和內聯函數有助於性能優化。 5)實際應用中,C 可用於實現高效的日誌系統。

怎樣在C 中測量線程性能?

Apr 28, 2025 pm 10:21 PM

怎樣在C 中測量線程性能?

Apr 28, 2025 pm 10:21 PM

在C 中測量線程性能可以使用標準庫中的計時工具、性能分析工具和自定義計時器。 1.使用庫測量執行時間。 2.使用gprof進行性能分析,步驟包括編譯時添加-pg選項、運行程序生成gmon.out文件、生成性能報告。 3.使用Valgrind的Callgrind模塊進行更詳細的分析,步驟包括運行程序生成callgrind.out文件、使用kcachegrind查看結果。 4.自定義計時器可靈活測量特定代碼段的執行時間。這些方法幫助全面了解線程性能,並優化代碼。

給MySQL表添加和刪除字段的操作步驟

Apr 29, 2025 pm 04:15 PM

給MySQL表添加和刪除字段的操作步驟

Apr 29, 2025 pm 04:15 PM

在MySQL中,添加字段使用ALTERTABLEtable_nameADDCOLUMNnew_columnVARCHAR(255)AFTERexisting_column,刪除字段使用ALTERTABLEtable_nameDROPCOLUMNcolumn_to_drop。添加字段時,需指定位置以優化查詢性能和數據結構;刪除字段前需確認操作不可逆;使用在線DDL、備份數據、測試環境和低負載時間段修改表結構是性能優化和最佳實踐。

量化交易所排行榜2025 數字貨幣量化交易APP前十名推薦

Apr 30, 2025 pm 07:24 PM

量化交易所排行榜2025 數字貨幣量化交易APP前十名推薦

Apr 30, 2025 pm 07:24 PM

交易所內置量化工具包括:1. Binance(幣安):提供Binance Futures量化模塊,低手續費,支持AI輔助交易。 2. OKX(歐易):支持多賬戶管理和智能訂單路由,提供機構級風控。獨立量化策略平台有:3. 3Commas:拖拽式策略生成器,適用於多平台對沖套利。 4. Quadency:專業級算法策略庫,支持自定義風險閾值。 5. Pionex:內置16 預設策略,低交易手續費。垂直領域工具包括:6. Cryptohopper:雲端量化平台,支持150 技術指標。 7. Bitsgap:

deepseek官網是如何實現鼠標滾動事件穿透效果的?

Apr 30, 2025 pm 03:21 PM

deepseek官網是如何實現鼠標滾動事件穿透效果的?

Apr 30, 2025 pm 03:21 PM

如何實現鼠標滾動事件穿透效果?在我們瀏覽網頁時,經常會遇到一些特別的交互設計。比如在deepseek官網上,�...