零障礙合併兩個模型,大型ResNet模型線性連結只需幾秒,神經網路啟發性新研究

深度學習能夠如此成就,得益於其能夠相對輕鬆地解決大規模非凸優化問題。儘管非凸優化是 NP 困難的,但一些簡單的演算法,通常是隨機梯度下降(SGD)的變體,它們在實際擬合大型神經網路時表現出驚人的有效性。

本文中,來自華盛頓大學的多位學者撰文《 Git Re-Basin: Merging Models modulo Permutation Symmetries 》,他們研究了在深度學習中,SGD 演算法在高維非凸優化問題上的不合理有效性。他們受到三個問題的啟發:

1. 為什麼SGD 在高維非凸深度學習損失landscapes 的優化中表現良好,而在其他非凸優化設定中,如policy 學習、軌跡最佳化和推薦系統的穩健性明顯下降?

2. 局部極小值在哪裡?在初始化權值和最終訓練權值之間進行線性內插時,為什麼損失會平滑、單調地減少?

3. 兩個獨立訓練的模型,它們有不同的隨機初始化和資料批次順序,為何會達到幾乎相同的效能?此外,為什麼它們的訓練損失曲線看起來一樣

論文地址:https://arxiv.org/pdf/2209.04836. pdf

本文認為:在模型訓練中存在一些不變性,這樣一來才會有不同的訓練表現出幾乎相同的表現。

為什麼會這樣呢? 2019 年,Brea 等人注意到神經網路中的隱藏單元具有排列對稱性。簡單的說就是:我們可以交換網路中隱藏層的任兩個單元,而網路功能將保持不變。 2021 年 Entezari 等人推測,這些排列對稱可能允許我們在權值空間中線性連接點,而不會損害損失。

下面我們以論文作者之一的舉例來說明文章主旨,這樣大家會更清楚。

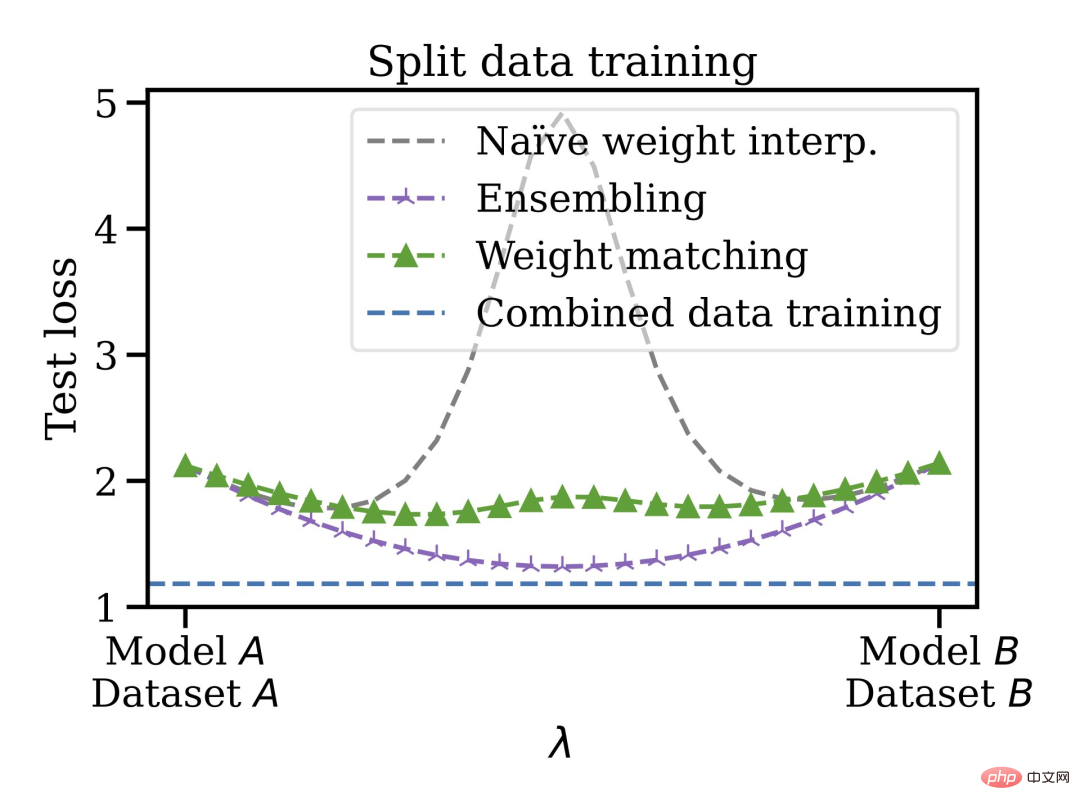

假如說你訓練了一個 A 模型,你的朋友訓練了一個 B 模型,這兩個模型訓練資料可能不同。沒關係,使用本文提出的 Git Re-Basin,你能在權值空間合併這兩個模型 A B,而不會損害損失。

論文作者表示,Git Re-Basin 可適用於任何神經網路(NN),他們首次示範了在兩個獨立訓練(沒有預先訓練)的模型(ResNets)之間,可以零障礙的線性連通。

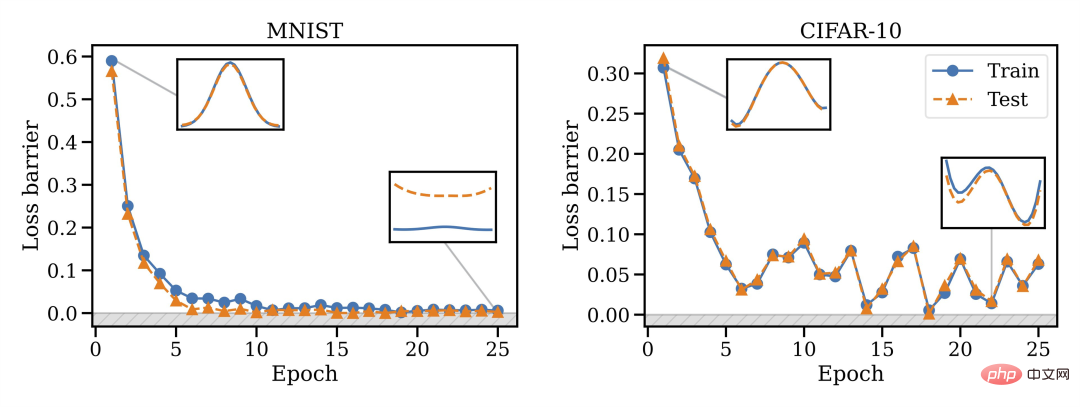

他們發現,合併能力是 SGD 訓練的一個屬性,在初始化時合併是不能工作的,但是會發生相變,因此隨著時間的推移合併將成為可能。

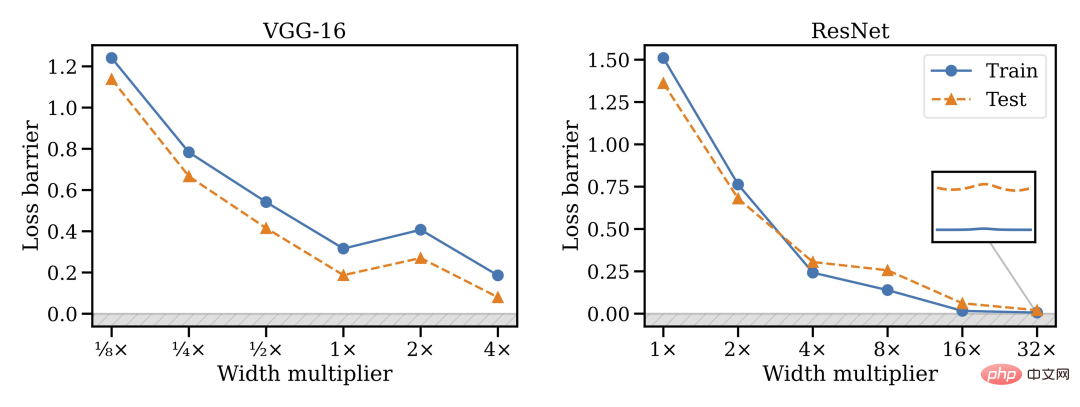

他們也發現,模型寬度與可合併性密切相關,即越寬越好。

此外,並非所有架構都能合併:VGG 似乎比 ResNets 更難合併。

這個合併方法還有其他優點,你可以在不相交和偏差的資料集上訓練模型,然後在權值空間中將它們合併在一起。例如,你有一些數據在美國,一些在歐盟。由於某些原因,不能混合數據。你可以先訓練單獨的模型,然後合併權重,最後再泛化到合併的資料集。

因此,在不需要預訓練或微調的情況下可以混合訓練過的模型。作者表示自己很想知道線性模式連結和模型修補的未來發展方向,可能會應用在聯邦學習、分散式訓練以及深度學習最佳化等領域。

最後也提到,章節 3.2 中的權重匹配演算法只需 10 秒左右即可運行,所以節省了大量時間。論文第 3 章也介紹了 A 模型與 B 模型單元相符的三種方法,對配對演算法還不清楚的小夥伴,可以查看原始論文。

網友評論及作者解疑

這篇論文在推特上引發了熱議,PyTorch 聯合創始人Soumith Chintala 表示如果這項研究可以遷移到更大的設置,則它可以實現的方向會更棒。合併兩個模型(包括權重)可以擴展 ML 模型開發,並可能在開源的共同開發模型中發揮巨大作用。

另有人認為如果排列不變性能夠這樣高效地捕捉大部分等價性,它將為神經網路的理論研究提供啟發。

論文一作、華盛頓大學博士 Samuel Ainsworth 也解答了網友提出的一些問題。

首先有人問,「論文中是否有關於在訓練中針對獨特basin 的任何提示?如果有一種方法可以做到對排列進行抽象,那麼訓練速度可能會更快。」

Ainsworth 回覆稱,這點自己沒有想到。他真的希望能夠以某種方式實現更快地訓練,但目前為止已被證明非常困難。問題在於 SGD 本質上是一種局部搜索,因此利用高階幾何並不是那麼容易。也許分散式訓練是一種可行的方法。

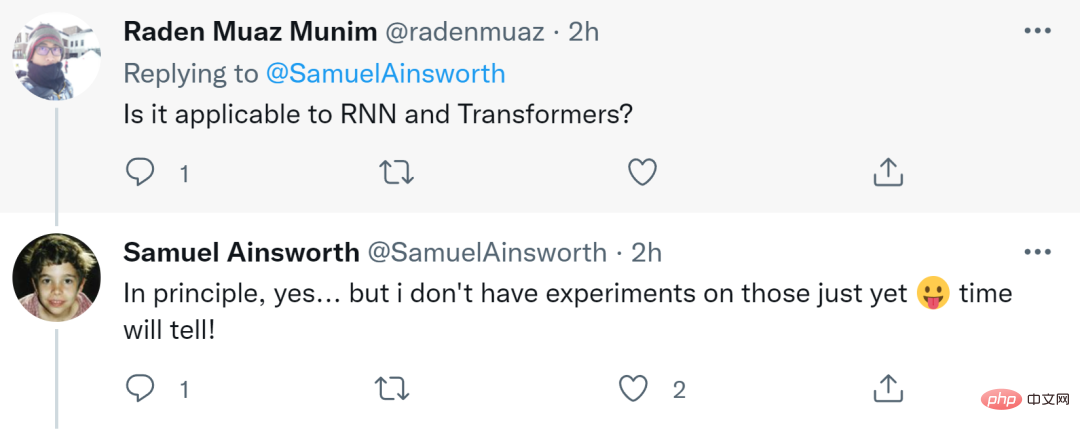

還有人問是否適用於 RNN 和 Transformers? Ainsworth 表示原則上適用,但他還沒有對此進行實驗。時間會證明一切。

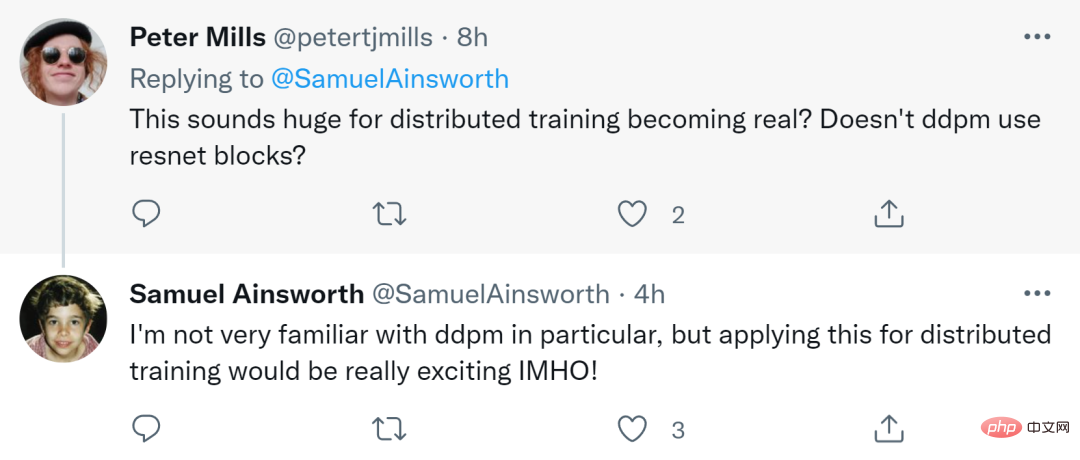

最後有人提出,「這看起來對分散式訓練『成真』非常重要?難道DDPM(去噪擴散機率模型)不使用ResNet 殘差區塊嗎?」

Ainsworth 回覆稱,雖然他自己對DDPM 不是很熟悉,但直言不諱表示將它用於分散式訓練將非常令人興奮。

以上是零障礙合併兩個模型,大型ResNet模型線性連結只需幾秒,神經網路啟發性新研究的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

C 中的chrono庫如何使用?

Apr 28, 2025 pm 10:18 PM

C 中的chrono庫如何使用?

Apr 28, 2025 pm 10:18 PM

使用C 中的chrono庫可以讓你更加精確地控制時間和時間間隔,讓我們來探討一下這個庫的魅力所在吧。 C 的chrono庫是標準庫的一部分,它提供了一種現代化的方式來處理時間和時間間隔。對於那些曾經飽受time.h和ctime折磨的程序員來說,chrono無疑是一個福音。它不僅提高了代碼的可讀性和可維護性,還提供了更高的精度和靈活性。讓我們從基礎開始,chrono庫主要包括以下幾個關鍵組件:std::chrono::system_clock:表示系統時鐘,用於獲取當前時間。 std::chron

如何理解C 中的DMA操作?

Apr 28, 2025 pm 10:09 PM

如何理解C 中的DMA操作?

Apr 28, 2025 pm 10:09 PM

DMA在C 中是指DirectMemoryAccess,直接內存訪問技術,允許硬件設備直接與內存進行數據傳輸,不需要CPU干預。 1)DMA操作高度依賴於硬件設備和驅動程序,實現方式因係統而異。 2)直接訪問內存可能帶來安全風險,需確保代碼的正確性和安全性。 3)DMA可提高性能,但使用不當可能導致系統性能下降。通過實踐和學習,可以掌握DMA的使用技巧,在高速數據傳輸和實時信號處理等場景中發揮其最大效能。

怎樣在C 中處理高DPI顯示?

Apr 28, 2025 pm 09:57 PM

怎樣在C 中處理高DPI顯示?

Apr 28, 2025 pm 09:57 PM

在C 中處理高DPI顯示可以通過以下步驟實現:1)理解DPI和縮放,使用操作系統API獲取DPI信息並調整圖形輸出;2)處理跨平台兼容性,使用如SDL或Qt的跨平台圖形庫;3)進行性能優化,通過緩存、硬件加速和動態調整細節級別來提升性能;4)解決常見問題,如模糊文本和界面元素過小,通過正確應用DPI縮放來解決。

C 中的實時操作系統編程是什麼?

Apr 28, 2025 pm 10:15 PM

C 中的實時操作系統編程是什麼?

Apr 28, 2025 pm 10:15 PM

C 在實時操作系統(RTOS)編程中表現出色,提供了高效的執行效率和精確的時間管理。 1)C 通過直接操作硬件資源和高效的內存管理滿足RTOS的需求。 2)利用面向對象特性,C 可以設計靈活的任務調度系統。 3)C 支持高效的中斷處理,但需避免動態內存分配和異常處理以保證實時性。 4)模板編程和內聯函數有助於性能優化。 5)實際應用中,C 可用於實現高效的日誌系統。

怎樣在C 中測量線程性能?

Apr 28, 2025 pm 10:21 PM

怎樣在C 中測量線程性能?

Apr 28, 2025 pm 10:21 PM

在C 中測量線程性能可以使用標準庫中的計時工具、性能分析工具和自定義計時器。 1.使用庫測量執行時間。 2.使用gprof進行性能分析,步驟包括編譯時添加-pg選項、運行程序生成gmon.out文件、生成性能報告。 3.使用Valgrind的Callgrind模塊進行更詳細的分析,步驟包括運行程序生成callgrind.out文件、使用kcachegrind查看結果。 4.自定義計時器可靈活測量特定代碼段的執行時間。這些方法幫助全面了解線程性能,並優化代碼。

量化交易所排行榜2025 數字貨幣量化交易APP前十名推薦

Apr 30, 2025 pm 07:24 PM

量化交易所排行榜2025 數字貨幣量化交易APP前十名推薦

Apr 30, 2025 pm 07:24 PM

交易所內置量化工具包括:1. Binance(幣安):提供Binance Futures量化模塊,低手續費,支持AI輔助交易。 2. OKX(歐易):支持多賬戶管理和智能訂單路由,提供機構級風控。獨立量化策略平台有:3. 3Commas:拖拽式策略生成器,適用於多平台對沖套利。 4. Quadency:專業級算法策略庫,支持自定義風險閾值。 5. Pionex:內置16 預設策略,低交易手續費。垂直領域工具包括:6. Cryptohopper:雲端量化平台,支持150 技術指標。 7. Bitsgap:

給MySQL表添加和刪除字段的操作步驟

Apr 29, 2025 pm 04:15 PM

給MySQL表添加和刪除字段的操作步驟

Apr 29, 2025 pm 04:15 PM

在MySQL中,添加字段使用ALTERTABLEtable_nameADDCOLUMNnew_columnVARCHAR(255)AFTERexisting_column,刪除字段使用ALTERTABLEtable_nameDROPCOLUMNcolumn_to_drop。添加字段時,需指定位置以優化查詢性能和數據結構;刪除字段前需確認操作不可逆;使用在線DDL、備份數據、測試環境和低負載時間段修改表結構是性能優化和最佳實踐。

C 中的字符串流如何使用?

Apr 28, 2025 pm 09:12 PM

C 中的字符串流如何使用?

Apr 28, 2025 pm 09:12 PM

C 中使用字符串流的主要步驟和注意事項如下:1.創建輸出字符串流並轉換數據,如將整數轉換為字符串。 2.應用於復雜數據結構的序列化,如將vector轉換為字符串。 3.注意性能問題,避免在處理大量數據時頻繁使用字符串流,可考慮使用std::string的append方法。 4.注意內存管理,避免頻繁創建和銷毀字符串流對象,可以重用或使用std::stringstream。