人工智慧領域的創新步伐越來越快,論文數量也呈現爆炸性成長,甚至達到了人力無法閱讀的程度。

在2022年發表的大量論文中,哪些機構的影響力最大?哪些論文比較值得讀?

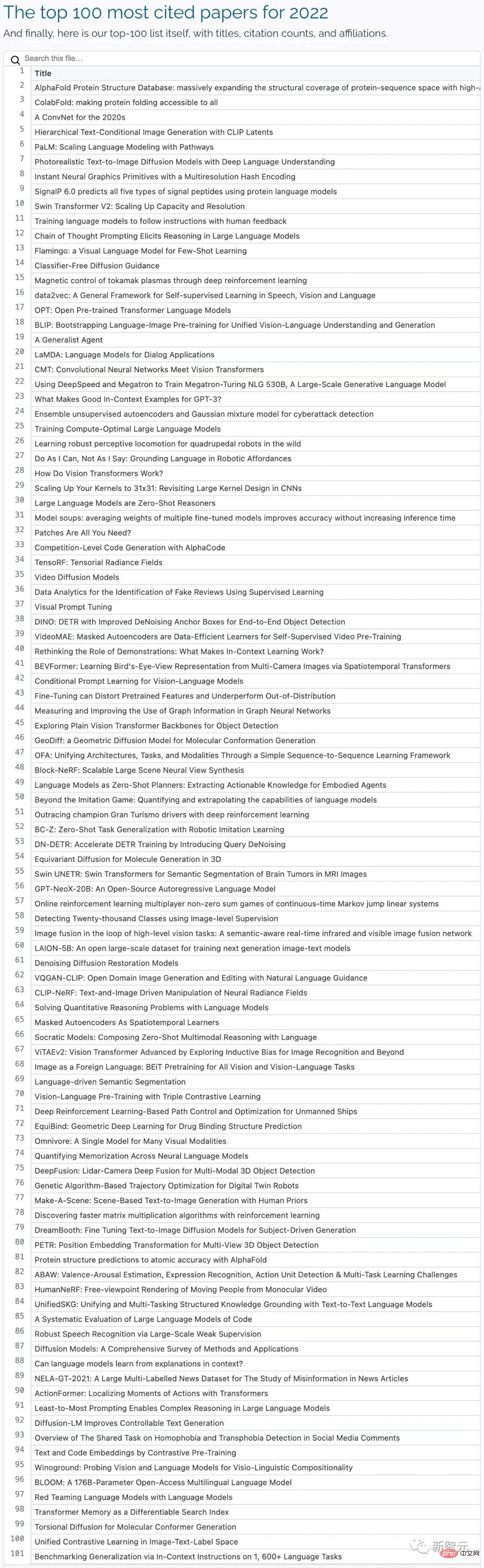

最近外媒Zeta Alpha用經典的引用次數作為評估指標,收集整理了在2022年最高引的100篇論文,並分析了不同國家、機構在過去三年發表的高引論文數量。

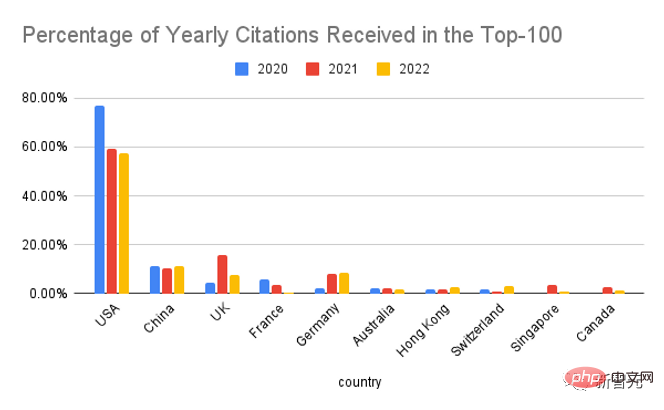

按國家來劃分的話,美國仍然佔據領先地位,不過在Top-100論文中所佔的比例相比2020年來說大幅下降。

中國排行第二,數據相比去年略有上漲;第三位是英國,DeepMind去年產出佔英國總數的69%,超過了前幾年的60%;新加坡和澳洲在AI領域的影響力也超乎分析師的預期。

依照組織來劃分的話,可以看到Google始終是AI領域的最強者,緊隨其後的是Meta、微軟、加州大學柏克萊分校、DeepMind和史丹佛大學,國內排行第一的是清華大學。

身為Meta AI的領導者,Yann LeCun也自豪地宣布Meta在業界的影響力,並表示Meta AI更重視出版質量,而不是出版數量。

#至於同屬於Alphabet的Google和DeepMind在清單中單獨計算的問題,LeCun表示DeepMind一直堅稱它們獨立於Google運營,這很奇怪,Google員工無法存取DeepMind的程式碼庫。

儘管如今人工智慧研究大多由工業界引領,單一學術界產生的影響不大,但由於長尾效應,學術界整體來說還是和工業界持平的,當依照組織類型對資料進行聚合時,可以看到二者的影響力大致是相等的。

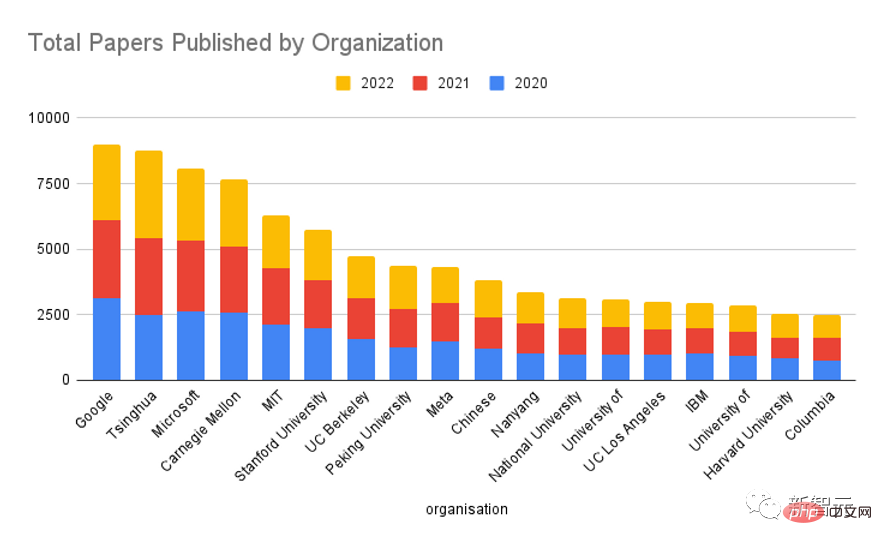

如果回顧過去三年,統計各機構總的研究成果數量,可以看到谷歌仍處於領先地位,但與其他機構相比差距要小得多,值得一提的是,清華大學緊接著Google排行第二。

#OpenAI和DeepMind甚至沒有進入前20名,當然,這些機構發表的文章數量較少,但每篇文章的影響力都很大。

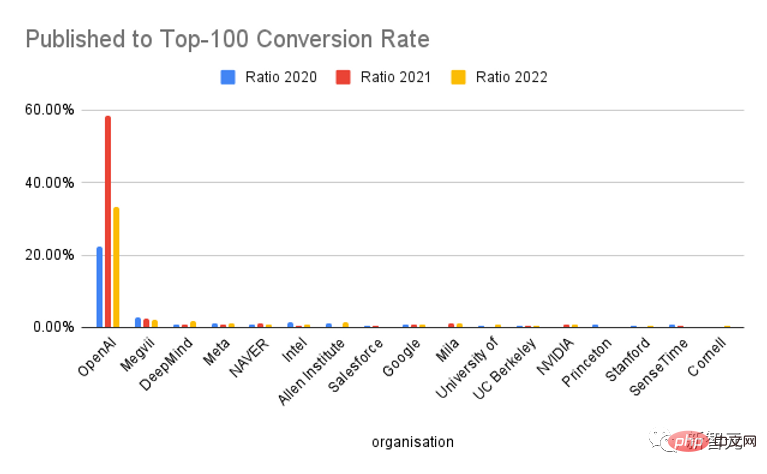

如果按照出版量進入Top-100的比例來看,OpenAI獨樹一幟,在轉化率上遠超其他機構,基本上兩篇論文中就有一篇成為“年度百大論文」。

當然,從ChatGPT的火爆來看,OpenAI確實很擅長行銷,某種程度上促進了引用量的提升,不可否認的是,他們的研究成果品質非常高。

首先在Zeta Alpha平台上收集每年被引用最多的論文,然後手動檢查第一個發表日期(通常是arXiv預印本) 歸類到對應的年份中。

透過挖掘Semantic Scholar上高引的人工智慧論文來補充這個列表,其覆蓋面更廣,而且能夠按引用次數進行排序,主要是從影響力很大的封閉來源出版商(例如《自然》、《愛思唯爾》、《施普林格》和其他雜誌)在那裡獲得額外的論文。

然後將每篇論文在 Google Scholar 上的引用次數作為代表性指標,並根據這個數字對論文進行排序,得出一年內排名前100位的論文。

對於這些論文,使用GPT-3提取作者、他們的附屬機構和國家,並手動檢查這些結果(如果國家在出版物中沒有體現的話,採用該組織總部所在的國家)。

擁有多個機構的作者的論文對每個附屬機構各計數一次。

1. AlphaFold Protein Structure Database: massively expanding the structural coverage of protein-sequence space with high-accuracy models

論文連結:https://academic.oup.com/nar/article/50/D1/D439/6430488

發表機構:歐洲分子生物學實驗室,DeepMind

AlphaFold DB:https:// alphafold.ebi.ac.uk

引用量:1331

##AlphaFold蛋白質結構資料庫AlphaFold DB是一個可公開存取的、廣泛的、高準確度的蛋白質結構預測的資料庫。

在DeepMind的AlphaFold v2.0的支持下,該資料庫使已知蛋白質序列空間的結構覆蓋面得到了空前的擴展。

AlphaFold DB提供了對預測的原子座標、每個殘基和成對的模型置信度估計值以及預測的對齊誤差的程式化存取和互動式視覺化。

AlphaFold DB的初始版本包含了超過36萬個預測結構,涵蓋了21種模式生物的蛋白質組,未來將擴展到UniRef90資料集的大部分(超過1億)代表性序列。

2. ColabFold: making protein folding accessible to all

論文連結:https://www.nature.com/articles/s41592-022-01488-1

程式碼連結:https://github.com/sokrypton/colabfold

#環境連結:https://colabfold.mmseqs.com

引用量:1138

ColabFold透過將MMSEQS2的快速同源搜尋與AlphaFold2或Rosettafold結合,加速了蛋白質結構和複合物的預測。 ColabFold在模型利用率上可以實現40-60倍加速的搜尋和最佳化,能夠在僅具有一個圖形處理單元的伺服器上預測近1000個結構。 ColabFold在Google Colaboratory的基礎上,成為了一個蛋白質折疊的免費且可訪問的平台,也是一個可用的開源軟體。3. A ConvNet for the 2020s#

論文連結:https://arxiv.org/pdf/ 2201.03545.pdf

引用量:835

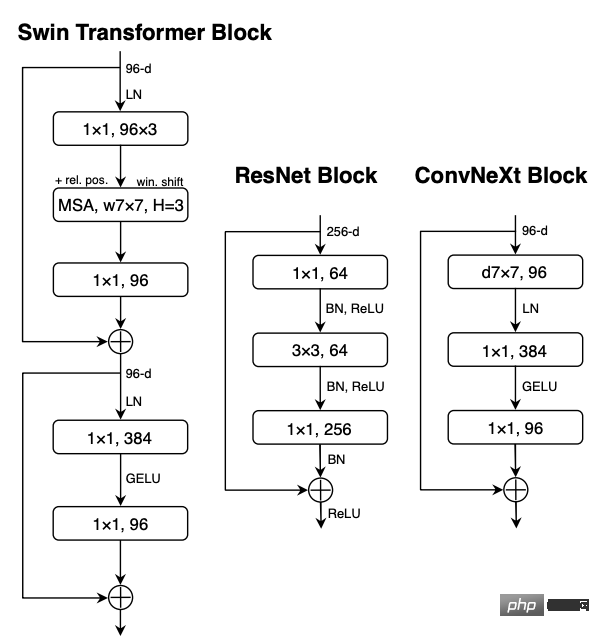

視覺辨識的「Roaring 20s」(咆哮的20年代)始於視覺Transformer(ViTs)的引入,它迅速取代了ConvNets成為最先進的影像分類模型。 另一方面,一個最簡單的ViT在應用於通用電腦視覺任務時仍然面臨一些難題,如物件偵測和語義分割。 層次化Transformer(如Swin Transformers)重新引入了幾個ConvNet先驗,使得Transformer作為通用視覺模型骨幹實際上是可行的,並在各種視覺任務中表現出顯著的性能。然而,這種混合方法的有效性仍然主要歸功於Transformers的內在優勢,而不是Convolutions的內在歸納偏見。

在這項工作中,研究人員重新審視了設計空間,並測試了純ConvNet所能實現的極限。

逐步將一個標準的ResNet「現代化」成ViT的設計,並在這個過程中發現了幾個促成效能差異的關鍵組件,探索後發現了一個稱為ConvNeXt的純ConvNet模型系列。

ConvNeXt完全由標準的ConvNet模組構成,在準確性和可擴展性方面與Transformer不相上下,在COCO檢測和ADE20K分割方面取得了87.8%的ImageNet top-1準確性,並超過了Swin Transformers,同時保持了標準ConvNets的簡單性和效率。

4. Hierarchical Text-Conditional Image Generation with CLIP Latents

論文連結:https://arxiv.org/abs/2204.06125

##引用量:718

##引用量:718

像CLIP這樣的對比式模型(Contrastive models)已經被證明可以學習到穩健的影像表徵,能夠捕捉到語意和風格。 為了利用這些表徵來產生圖像,研究人員提出了一個兩階段的模型:一個給定文字標題生成CLIP圖像embedding的先驗,以及一個以圖像embedding為條件生成圖像的解碼器。

實驗證明可以明確地產生影像表徵能夠提高影像的多樣性,在逼真度和標題的相似性方面損失最小,並且以影像表徵為條件的解碼器也能產生影像的變化,保留其語意和風格,同時改變影像表徵中不存在的非必要細節。此外,CLIP的聯合embedding空間使language-guided下的影像操作能夠以zero-shot的方式進行。 對解碼器使用擴散模型,並對先驗的自回歸和擴散模型進行實驗,發現後者在計算上更有效率,能夠產生更高品質的樣本。

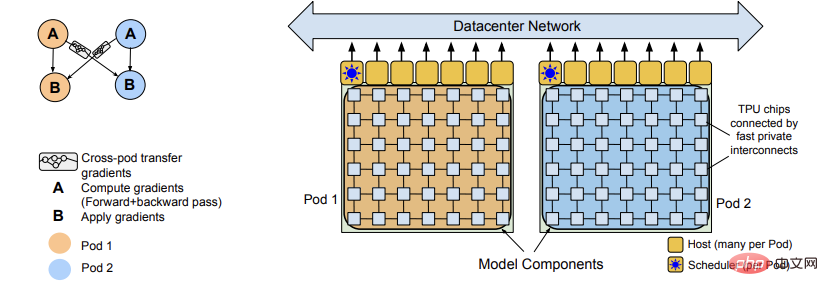

5. PaLM: Scaling Language Modeling with Pathways

##################################### ####論文連結:https://arxiv.org/pdf/2204.02311.pdf#################引用量:426####### ## ####大型語言模型已被證明在各種自然語言任務中使用few-shot學習即可達到更高的性能,大大減少了使模型適應特定應用所需的特定任務訓練實例的數量。 ######為了進一步了解scale對few-shot學習的影響,研究人員訓練了一個5,400億參數、密集活化的Transformer語言模型Pathways Language Model(PaLM)。 ######使用Pathways(一個新的ML系統,能夠在多個TPU Pods上進行高效的訓練)在6144個TPU v4晶片上訓練得到PaLM,透過在數百個語言理解和生成基准上取得最先進的few-shot學習結果證明了scaling的好處。 ######在其中一些任務上,PaLM 540B實現了突破性的性能,在一套多步驟推理任務上超過了微調的最先進水平,並在最近發布的BIG-bench基准上超過了人類的平均性能。 ######大量的BIG-bench任務顯示了模型規模的不連續改進,也意味著當規模擴大到最大的模型時,性能陡然提高。 ######PaLM在多語言任務和原始碼產生方面也有很強的能力,這一點也在一系列基準測試中得到了證明。 #####################此外,研究人員也對偏見和毒性進行了全面的分析,並研究了與模型規模有關的訓練資料記憶程度,最後討論了與大型語言模型有關的倫理考慮,並討論了潛在的緩解策略。 ######2022年國內五強論文############1. Swin Transformer V2: Scaling Up Capacity and Resolution##########

论文链接:https://arxiv.org/pdf/2111.09883.pdf

代码链接:https://github.com/microsoft/Swin-Transformer

引用量:266

大规模的NLP模型已经被证明可以显著提高语言任务的性能,而且没有饱和的迹象,同时还展示了像人类一样的惊人的few-shot能力。

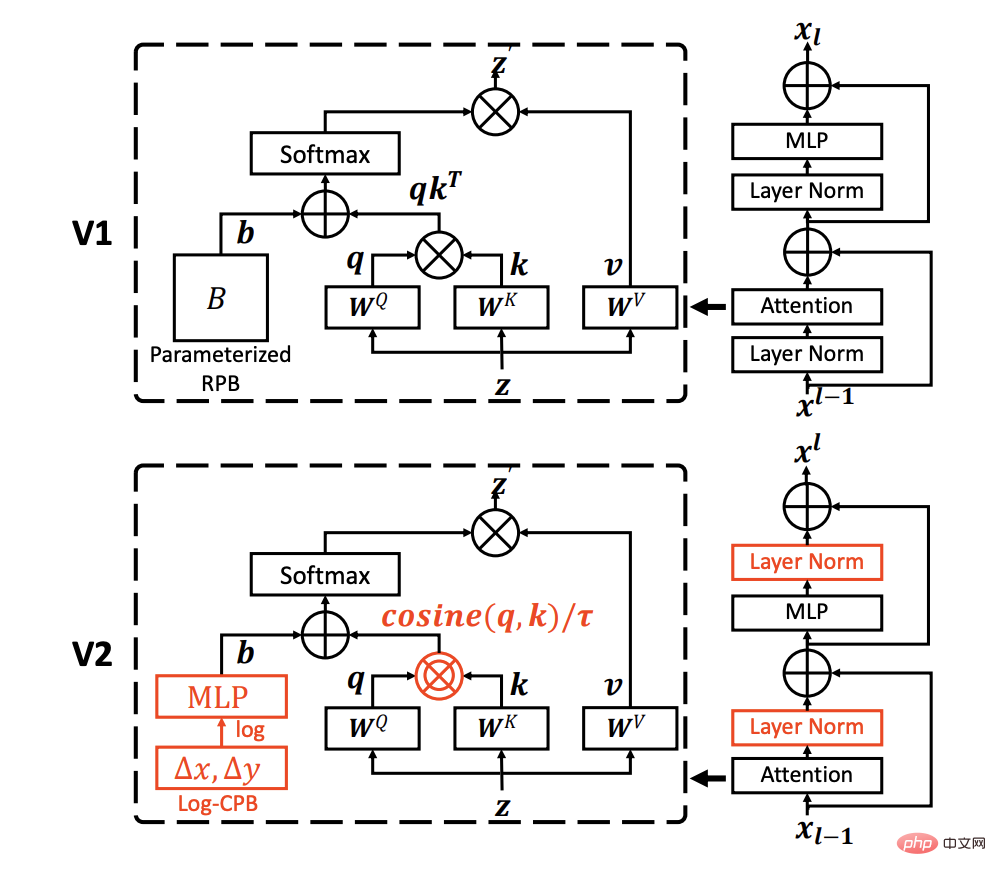

这篇论文旨在探索计算机视觉中的大规模模型,解决了大型视觉模型训练和应用中的三个主要问题,包括训练的不稳定性,预训练和微调之间的分辨率差距,以及对有标签数据的需求。

研究人员提出了三种主要技术:

1)一种与余弦注意相结合的残差-后规范方法,以提高训练的稳定性;

2)一种对数间隔的连续位置偏差方法,以有效地将使用低分辨率图像预训练的模型转移到具有高分辨率输入的下游任务中;

3)一种自监督的预训练方法SimMIM,以减少对大量标记图像的需求。

通过这些技术,成功地训练了一个30亿参数的Swin Transformer V2模型,这是迄今为止最大的稠密视觉模型,并使其能够用高达1,536×1,536分辨率的图像进行训练。

在4个代表性的视觉任务上创造了新的性能记录,包括ImageNet-V2图像分类、COCO物体检测、ADE20K语义分割和Kinetics-400视频动作分类。

同时可以注意到该训练比谷歌的十亿级视觉模型中的训练效率要高得多,所消耗的有标签数据和训练时间要少40倍。

2. Ensemble unsupervised autoencoders and Gaussian mixture model for cyberattack detection

之前的研究采用了具有降维功能的无监督机器学习来进行网络检测,仅限于对高维和稀疏数据进行鲁棒的异常检测。

大多数方法通常假设每个领域的参数是同质的,具有特定的高斯分布,忽视了数据偏度的鲁棒性测试。

论文链接:https://www.sciencedirect.com/science/article/pii/S0306457321003162

引用量:145

这篇论文提出使用连接到高斯混合模型(GMM)的无监督集合自编码器来适应多个领域,无需考虑每个领域的偏度(skewness)。

在集成自编码器的隐藏空间中,利用了基于注意力的潜在表征和重建的最小误差的特征,使用期望最大化(EM)算法来估计GMM中的样本密度,当估计的样本密度超过训练阶段获得的学习阈值时,该样本被识别为与异常有关的离群点。

最后,对集成自编码器和GMM进行联合优化,将目标函数的优化转化为拉格朗日对偶问题,在三个公共数据集上进行的实验验证了所提出的模型的性能与所选择的异常检测基线相比有明显竞争力。

论文共同一作为来自宁波工程学院的安鹏教授和同济大学的Zhiyuan Wang。

安鹏教授目前是宁波工程学院电子与信息工程学院副院长,2000年至2009年就读于清华大学工程物理系,获工学学士学位、工学博士学位;欧洲核子研究中心、意大利国家帕多瓦大学、德国海德堡大学访问学者,中国自动化学会认知计算与系统专业委员会委员、中国人工智能学会认知系统与信息处理专业委员会委员、中国指挥与控制学会青年工作委员会委员;主持并参与国家重点基础研究发展计划(973计划)、国家自然科学基金、国家星火计划项目等多项科研项目。

3. Scaling Up Your Kernels to 31x31: Revisiting Large Kernel Design in CNNs

论文链接:https://arxiv.org/abs/2203.06717

程式碼連結:https://github.com/megvii-research/RepLKNet

引用量:127

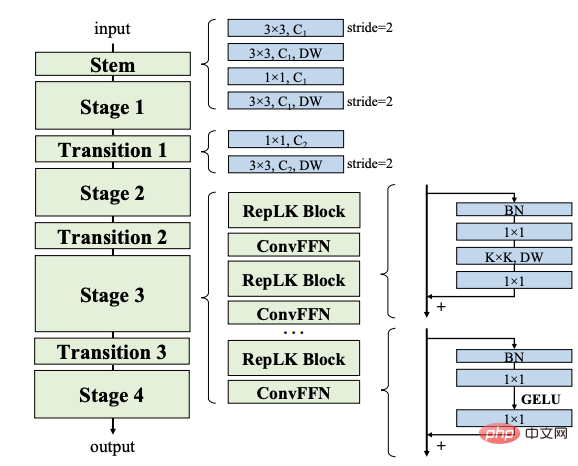

文中回顧了現代卷積神經網路(CNN)中的大核心設計。

受視覺Transformer(ViTs)最新進展的啟發,該論文證明了使用幾個大的捲積內核代替一堆小的內核可能是一個更強大的範例。

研究人員提出了五個指導方針,例如,應用重新參數化的大深度卷積,來設計高效的高性能大內核 CNN。

根據這些指導方針提出了RepLKNet,一個純粹的CNN 架構,其核心大小為31x31,與通常使用的3x3形成對比,RepLKNet大大縮小了CNN 和ViTs 之間的效能差距,例如在ImageNet 和一些典型的下游任務上,以較低的延遲實現了與Swin Transformer 相當或更好的結果。

RepLKNet 對大數據和大模型也表現出很好的可擴展性,在ImageNet 上獲得了87.8% 的最高準確率,在ADE20K 上獲得了56.0% 的mIoU,在具有類似模型大小的最先進技術中是非常有競爭力的。

該研究進一步表明,與小核心 CNN 相比,大核心 CNN 具有更大的有效接收場(receptive fields)和更高的形狀偏差,而不是紋理偏差。

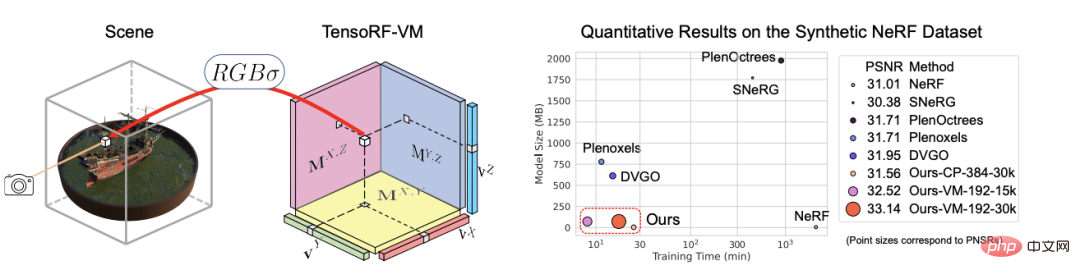

4. TensoRF: Tensorial Radiance Fields

#論文連結:https://arxiv.org/abs/ 2203.09517

引用量:110

文中提出了TensoRF,一種對輻射場(radiance fields)進行建模和重構的新方法。

與純粹使用MLP的NeRF不同,研究人員將場景的輻射場建模為一個4D張量,代表了一個具有每體素多通道特徵(per-voxel multi-channel features)的三維體素網格,其中心思想是將4D場景張量分解為多個緊密的低秩張量成分。

證明了在該框架中應用傳統的CP分解,將張量分解為具有緊湊向量的rank-one components會獲得比普通的NeRF更好的性能。

為了進一步提高效能,文中也引入了一個新的向量-矩陣(VM)分解,放鬆了張量的兩種模式的低秩約束,並將張量分解為緊湊的向量和矩陣因子。

除了更好的渲染質量,該模型與CP和VM分解相比,直接優化每像素特徵的先前和同時進行的工作導致了顯著的記憶體佔用。

實驗證明,與NeRF相比,採用CP分解的TensoRF實現了快速重建(

此外,採用VM分解的TensoRF進一步提高了渲染質量,並超過了以前最先進的方法,同時減少了重建時間(

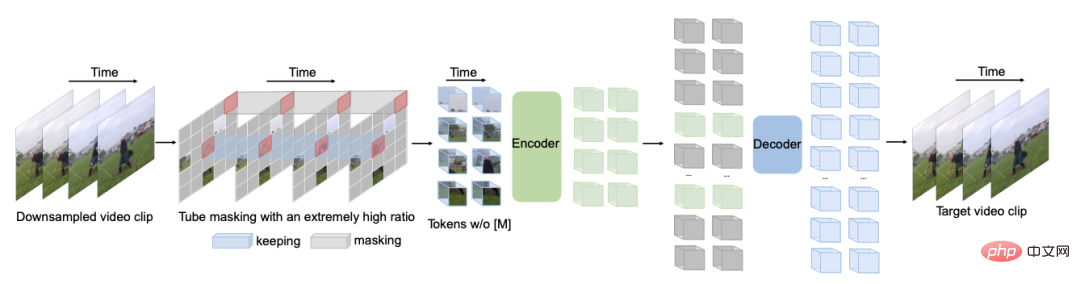

5. VideoMAE: Masked Autoencoders are Data-Efficient Learners for Self-Supervised Video Pre-Training

論文連結:https://arxiv.org/abs/2203.12602

程式碼連結:https://github.com/MCG-NJU/VideoMAE

#引用量:100

#為了在相對較小的資料集上實現更高的效能,通常需要在額外的大規模資料集上預先訓練影片Transformer。

這篇論文顯示視訊遮罩自動編碼器(VideoMAE)是用於自監督視訊預訓練(SSVP)的資料高效學習器。

受到最近的ImageMAE的啟發,研究人員提出了具有極高遮罩比例的客製化視訊管(video tube),這種簡單的設計使視訊重建成為更具挑戰性的自監督任務,從而鼓勵在這個預訓練過程中提取更有效的視訊表徵。

在SSVP上得到了三個重要的發現:

(1)極高比例的遮罩率(即90%到95%)仍能產生VideoMAE的有利表現。時間上冗餘的影片內容使得遮蔽率比影像更高。

(2) VideoMAE在非常小的資料集(即大約3k-4k的影片)上取得了非常高的效能,而沒有使用任何額外的資料。

(3) VideoMAE表明,對於SSVP來說,資料品質比資料數量更重要。

預先訓練和目標資料集之間的領域遷移是一個重要議題。

值得注意的是,VideoMAE與普通的ViT可以在Kinetics-400上達到87.4%,在Something-Something V2上達到75.4%,在UCF101上達到91.3%,在HMDB51上達到62.6%,而無需使用任何額外的資料。

完整百大論文清單

以上是2022年「百強AI論文」出爐:清華緊接著Google排名第二,寧波工程學院成最大黑馬的詳細內容。更多資訊請關注PHP中文網其他相關文章!