最近OpenAI發布的ChatGPT為人工智慧領域注入了一針強心劑,其強大的能力遠超自然語言處理研究者們的預期。

體驗過ChatGPT的使用者很自然地就會提出疑問:初代GPT 3是如何演化成ChatGPT的? GPT 3.5驚人的語言能力又來自哪?

最近來自艾倫人工智慧研究所的研究人員撰寫了一篇文章,試圖剖析ChatGPT 的突現能力(Emergent Ability),並追溯這些能力的來源,並給出了一個全面的技術路線圖以說明GPT-3.5 模型系列以及相關的大型語言模型是如何一步步進化成目前的強大形態。

#原文連結:https://yaofu.notion.site/GPT-3-5-360081d91ec245f29029d37b54573756

#作者符堯是2020年入學的愛丁堡大學博士生,碩士畢業於哥倫比亞大學,本科畢業於北京大學,目前在艾倫人工智慧研究所做研究實習生。他的主要研究方向為人類語言的大規模機率產生模型。

作者彭昊大學畢業於北京大學,博士畢業於華盛頓大學,目前是艾倫人工智慧研究所的Young Investigator,並將於2023年8月加入伊利諾大學厄巴納-香檳分校電腦科學系,擔任助理教授。他的主要研究方向包括使語言 AI 更有效率和更容易理解,以及建立大規模的語言模型。

作者Tushar Khot博士畢業於威斯康辛-麥迪遜大學,目前是艾倫人工智慧研究所的研究科學家。他的主要研究方向為結構化機器推理。

1、2020 版初代GPT-3 與大規模預訓練

#第一代GPT-3展示了三個重要能力:

語言生成:

遵循提示字(prompt),然後產生補全提示字的句子。這也是今天人類與語言模型最普遍的互動方式。

######上下文學習 (in-context learning):###遵循給定任務的幾個範例,然後為新的測試案例產生解決方案。很重要的一點是,GPT-3雖然是個語言模型,但它的論文幾乎沒有談到「語言建模」 (language modeling) —— 作者將他們全部的寫作精力都投入到了對上下文學習的願景上,這才是GPT-3的真正重點。 ###############世界知識:###包括事實性知識 (factual knowledge) 和常識 (commonsense)。 ###############那麼這些能力從何而來呢? ############基本上,以上三種能力都來自於大規模預訓練:在有3000億單字的語料上預訓練擁有1750億參數的模型( 訓練語料的60%來自於2016 - 2019 的C4 22% 來自於WebText2 16% 來自於Books 3%來自於Wikipedia)。其中:######

- 語言產生的能力來自於語言建模的訓練目標 (language modeling)。

- 世界知識來自 3,000 億字的訓練語料庫(不然還能是哪裡呢)。

- 模型的 1750 億參數是為了儲存知識,Liang et al. (2022) 的文章進一步證明了這一點。他們的結論是,知識密集型任務的表現與模型大小息息相關。

- 情境學習的能力來源及為何情境學習可以泛化,仍然難以追溯。直覺上,這種能力可能來自於同一個任務的資料點在訓練時按順序排列在同一個 batch 中。然而,很少有人研究為什麼語言模型預先訓練會促使情境學習,以及為什麼情境學習的行為與微調 (fine-tuning) 如此不同。

令人好奇的是,初代的GPT-3有多強。

其實比較難確定初代 GPT-3(在 OpenAI API 中稱為davinci)到底是「強」還是「弱」。

一方面,它合理地回應了某些特定的查詢,並在許多資料集中達到了還不錯的效能;

另一方面,它在許多任務上的表現不如T5 這樣的小模型(參見其原始論文)。

在今天(2022 年 12 月)ChatGPT 的標準下,很難說初代的 GPT-3 是「智慧的」。 Meta 開源的 OPT 模型試圖復現初代 GPT-3,但它的能力與當今的標準也形成了尖銳的對比。許多測試過 OPT 的人也認為與現在的text-davinci-002相比,模型確實「不咋地」。

儘管如此,OPT 可能是第一代 GPT-3 的一個足夠好的開源的近似模型了(根據 OPT 論文和史丹佛大學的 HELM 評估)。

雖然初代的 GPT-3 可能表面上看起來很弱,但後來的實驗證明,初代 GPT-3 有著非常強的潛力。這些潛能後來被代碼訓練、指令微調 (instruction tuning) 和基於人類回饋的強化學習 (reinforcement learning with human feedback, RLHF) 解鎖,最終體展現出極為強大的突現能力。

二、從2020 年版GPT-3 到2022 年版ChatGPT

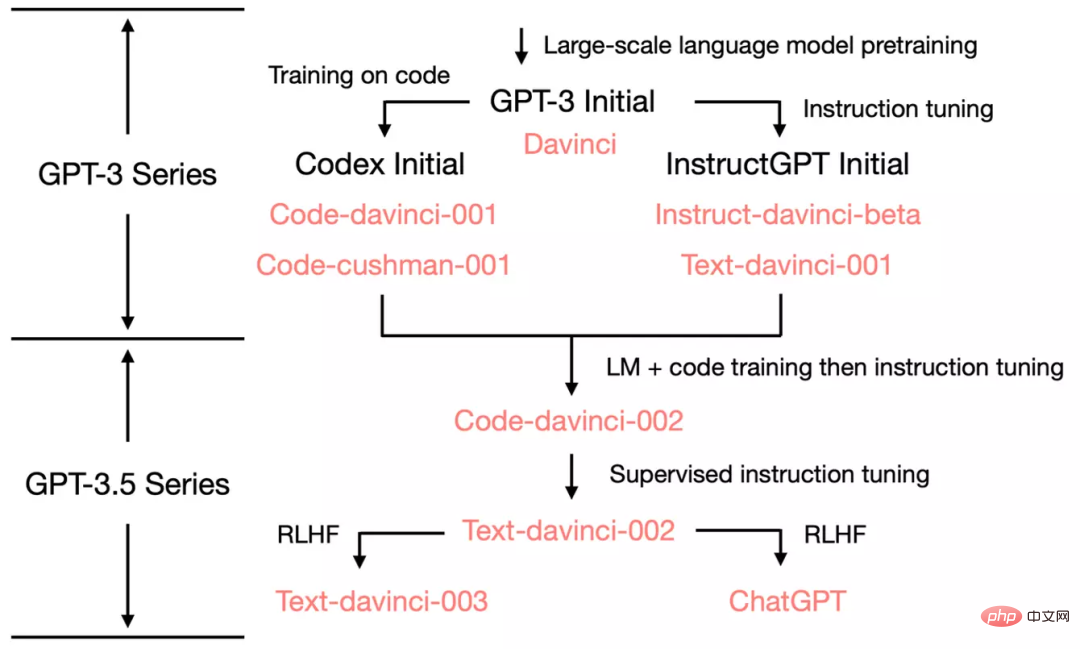

從最初的GPT-3 開始,為了展示OpenAI 是如何發展到ChatGPT的,我們看一下GPT-3.5 的進化樹:

在2020 年7 月,OpenAI 發布了模型索引為的davinci 的初代GPT-3 論文,從此它就開始不斷進化。

在 2021 年 7 月,Codex 的論文發布,其中初始的 Codex 是根據(可能是內部的)120 億參數的 GPT-3 變體進行微調的。後來這個 120 億參數的模型演變成 OpenAI API 中的code-cushman-001。

在2022 年3 月,OpenAI 發布了指令微調(instruction tuning) 的論文,其監督微調(supervised instruction tuning) 的部分對應了davinci-instruct-beta和text- davinci-001。

在 2022 年 4 月至 7 月的,OpenAI 開始對code-davinci-002模型進行 Beta 測試,也稱之為 Codex。然後code-davinci-002、text-davinci-003和ChatGPT 都是從code-davinci-002進行指令微調得到的。詳細資訊請參閱 OpenAI的模型索引文件。

儘管Codex 聽著像是一個只管代碼的模型,但code-davinci-002可能是最強大的針對自然語言的GPT-3.5 變體(優於text- davinci-002和-003)。 code-davinci-002很可能在文字和程式碼上都經過訓練,然後根據指令進行調整(將在下面解釋)。

然後2022 年 5-6 月發布的text-davinci-002是一個基於code-davinci-002的有監督指令微調 (supervised instruction tuned) 模型。在text-davinci-002上面進行指令微調很可能降低了模型的上下文學習能力,但是增強了模型的零樣本能力(將在下面解釋)。

然後是text-davinci-003和ChatGPT,它們都在2022 年11 月發布,是使用的基於人類反饋的強化學習的版本指令微調(instruction tuning with reinforcement learning from human feedback) 模型的兩種不同變體。

text-davinci-003 恢復了(但仍然比code-davinci-002差)一些在text-davinci-002 中丟失的部分上下文學習能力(大概是因為它在微調的時候混入了語言建模) 並進一步改進了零樣本能力(得益於RLHF)。另一方面,ChatGPT 似乎犧牲了幾乎所有的上下文學習的能力來換取建模對話歷史的能力。

總的來說,在2020 - 2021 年期間,在code-davinci-002之前,OpenAI 已經投入了大量的精力透過程式碼訓練和指令微調來增強GPT-3 。當他們完成code-davinci-002時,所有的能力都已經存在了。很可能後續的指令微調,無論是透過監督的版本或強化學習的版本,都會做以下事情(稍後會詳細說明):

- 指令微調不會為模型注入新的能力- 所有的能力都已經存在了。指令微調的作用是解鎖 / 激發這些能力。這主要是因為指令微調的資料量比預訓練資料量少幾個數量級(基礎的能力是透過預訓練注入的)。

- 指令微調將 GPT-3.5 的分化到不同的技能樹。有些更擅長情境學習,如text-davinci-003,有些更擅長對話,如ChatGPT。

-

指令微調透過犧牲表現換取與人類的對齊(alignment)。 OpenAI 的作者在他們的指令微調論文中稱之為「對齊稅」 (alignment tax)。

許多論文都報導了code-davinci-002在基準測試中實現了最佳性能(但模型不一定符合人類期望)。在code-davinci-002上進行指令微調後,模型可以產生更符合人類期望的回饋(或模型與人類對齊),例如:零樣本問答、產生安全和公正的對話回應、拒絕超出模型它知識範圍的問題。

三、Code-Davinci-002和Text-Davinci-002,在程式碼上訓練,在指令上微調

在code-davinci-002和text-davinci-002之前,有兩個中間模型,分別是davinci-instruct-beta 和text-davinci-001。兩者在許多方面都比上述的兩個-002模型差(例如,text-davinci-001 鍊式思考推理能力不強)。

所以我們在本節中重點介紹 -002 型號。

3.1 複雜推理能力的來源和泛化到新任務的能力

我們關注code-davinci-002和text-davinci-002,這兩兄弟是第一版的GPT3.5 模型,一個用於代碼,另一個用於文字。它們表現出了三種重要能力與初代GPT-3 不同的能力:

- #回應人類指令:以前,GPT-3 的輸出主要訓練集中常見的句子。現在的模型會針對指令 / 提示詞產生更合理的答案(而不是相關但無用的句子)。

- 泛化到沒有見過的任務:當用於調整模型的指令數量超過一定的規模時,模型就可以自動在從未見過的新指令上也能產生有效的答案。這種能力對於上線部署至關重要,因為使用者總是會提新的問題,模型得答得出來才行。

- 程式碼產生和程式碼理解:這個能力很顯然,因為模型用程式碼訓練過。

- 利用思考鏈 (chain-of-thought) 進行複雜推理:第一代 GPT3 的模型思考鏈推理的能力很弱甚至沒有。 code-davinci-002 和 text-davinci-002 是兩個擁有足夠強的思考鏈推理能力的模式。

- 思考鏈推理之所以重要,是因為思維鏈可能是解鎖突現能力和超越縮放法則 (scaling laws) 的關鍵。

這些能力從何而來?

與先前的模型相比,兩個主要差異是指令微調和程式碼訓練。具體來說:

- 能夠回應人類指令的能力是指令微調的直接產物。

- 對沒有見過的指令做出回饋的泛化能力是在指令數量超過一定程度之後自動出現的,T0、Flan 和 FlanPaLM 論文進一步證明了這一點。

- 使用思考鏈進行複雜推理的能力很可能是程式碼訓練的一個神奇的副產物。 對此,我們有以下的事實作為一些支持:

- #最初的 GPT-3 沒有接受過程式碼訓練,它不能做思維鏈。

- text-davinci-001 模型,雖然經過了指令微調,但第一版思維鏈論文報告說,它的它思維鏈推理的能力非常弱—— 所以指令微調可能不是思考鏈存在的原因,程式碼訓練才是模型能做思考鏈推理最可能的原因。

- PaLM 有 5% 的程式碼訓練數據,可以做思維鏈。

- Codex論文中的程式碼資料量為 159G ,大約是初代 GPT-3 5700 億訓練資料的28%。 code-davinci-002 及其後續變體可以做思考鏈推理。

- 在 HELM 測試中,Liang et al. (2022) 對不同模型進行了大規模評估。他們發現了針對程式碼訓練的模型具有很強的語言推理能力,包括 120億參數的code-cushman-001.。

- 我們在 AI2 的工作也表明,當配備複雜的思維鏈時,code-davinci-002 在 GSM8K 等重要數學基準上是目前表現最好的模型。

- 直覺來說,過程導向的程式設計(procedure-oriented programming) 跟人類逐步解決任務的過程很類似,物件導向程式設計(object-oriented programming) 跟人類將複雜任務分解為多個簡單任務的過程很類似。

- 以上所有觀察值都是程式碼與推理能力 / 思考鏈 之間的相關性,但不一定是因果性。這種相關性很有趣,但現在還是一個待研究的開放性問題。目前看來,我們沒有非常確鑿的證據證明程式碼就是思考鍊和複雜推理的原因。

-

此外,程式碼訓練另一個可能的副產品是長距離依賴,正如Peter Liu所指出:「語言中的下個詞語預測通常是非常局部的,而程式碼通常需要更長的依賴關係來做一些事情,例如前後括號的匹配或引用遠處的函數定義」。 這裡我想進一步補充的是:由於物件導向程式設計中的類別繼承,程式碼也可能有助於模型建立編碼層次結構的能力。我們將這一假設的檢驗留給未來的工作。

另外還要注意一些細節差異:

#

- text-davinci-002 與code-davinci-002

- ##Code-davinci-002 是基礎模型,text-davinci-002 是指令微調code-davinci-002 的產物(請參閱OpenAI 的文檔)。它在以下資料上作了微調:(一)人工標註的指令和期待的輸出;(二)由人工標註者選擇的模型輸出。

- 當有上下文範例(in-context example) 的時候, Code-davinci-002 更擅長上下文學習;當沒有上下文範例/ 零樣本的時候,text-davinci-002在零樣本任務完成方面表現較好。從這個意義上說,text-davinci-002 更符合人類的期望(因為對一個任務寫上下文範例可能會比較麻煩)。

- OpenAI 不太可能故意犧牲了上下文學習的能力換取零樣本能力 —— 上下文學習能力的降低更多是指令學習的一個副作用,OpenAI 管這叫對齊稅。

- 001 模型(code-cushman-001 和text-davinci-001)v.s. 002 模型(code-davinci-002 和text-davinci- 002)

- 001 模型主要是為了做純程式碼/ 純文字任務;002 模型則深度融合了程式碼訓練和指令微調,程式碼和文字都行。

- Code-davinci-002 可能是第一個深度融合了程式碼訓練和指令微調的模型。證據有:code-cushman-001 可以進行推理但在純文本上表現不佳,text-davinci-001 在純文本上表現不錯但在推理上不大行。 code-davinci-002 則可以同時做到這兩點。

3.2 這些能力是在預訓練之後已經存在還是在之後透過微調注入?

在這個階段,我們已經確定了指令微調和程式碼訓練的關鍵作用。一個重要的問題是如何進一步分析程式碼訓練和指令微調的影響?

具體來說:上述三種能力是否已經存在於初代的GPT-3中,只是透過指令和程式碼訓練觸發 / 解鎖?或者這些能力在初代的 GPT-3 中並不存在,是透過指令和程式碼訓練注入?

如果答案已經在初代的 GPT-3 中,那麼這些能力也應該在 OPT 中。因此,要復現這些能力,或許可以直接透過指令和代碼調整 OPT。

但是,code-davinci-002 也可能不是基於原始的 GPT-3 davinci,而是基於比第一代 GPT-3 更大的模型。如果是這種情況,可能就沒辦法調整 OPT 來復現了。

研究社群需要進一步弄清楚 OpenAI 訓練了什麼樣的模型作為 code-davinci-002 的基礎模型。

我們有以下的假設與證據:

- code-davinci-002的基礎模型可能不是第一代GPT-3 davinci 模型。

- 初代的GPT-3在資料集C4 2016 - 2019 上訓練,而code-davinci-002 訓練集則在延長到2021年才結束。因此 code-davinci-002 有可能在 C4 的 2019-2021 版本上訓練。

- 初代的 GPT-3 有一個大小為 2048 個字的上下文視窗。 code-davinci-002 的上下文視窗則為 8192。 GPT 系列使用絕對位置嵌入 (absolute positional embedding),直接對絕對位置嵌入進行外推而不經過訓練是比較難的,並且會嚴重損害模型的性能(參考 Press et al., 2022)。如果 code-davinci-002 是基於初代GPT-3,那麼OpenAI 是如何擴展上下文視窗的?

- 另一方面,無論基礎模型是初代的GPT-3 或後來訓練的模型, 遵循指令和零樣本泛化的能力都可能已經存在於基礎模型中,後來才透過指令微調來解鎖(而不是注入)。

- 這主要是因為 OpenAI 的論文報告的指令資料量大小只有 77K,比預訓練資料少了幾個數量級。

- 其他指令微調論文進一步證明了資料集大小對模型效能的對比,例如Chung et al. (2022) 的工作中, Flan-PaLM 的指令微調僅為預訓練計算的0.4%。一般來說,指令資料會顯著少於預訓練資料。

- 然而 ,模型的複雜推理能力可能是在預訓練階段透過程式碼資料注入。

- 程式碼資料集的規模與上述指令微調的情況不同。這裡的程式碼資料量夠大,可以佔據訓練資料的重要部分(例如,PaLM 有8% 的程式碼訓練資料)

- 如上所述,在code-davinci-002 之前的模型text-davinci-001 大概沒有在程式碼資料上面微調過,所以它的推理/ 思維鏈能力是非常差的,正如第一版思維鏈論文中所報告的那樣,有時甚至比參數量更小的code-cushman-001 還差。

- 區分程式碼訓練和指令微調效果的最佳方法可能是比較 code-cushman-001、T5 和 FlanT5。

- 因為它們具有相似的模型大小(110億和120億),相似的訓練資料集(C4),它們最大的差異就是有沒有在程式碼上訓練過/ 有沒有做過指令微調。

- 目前還沒有這樣的比較。我們把這個留給未來的研究。

四、text-davinci-003 和ChatGPT,基於人類回饋的強化學習(Reinforcement Learning from Human Feedback, RLHF) 的威力

#在當前階段(2022 年12 月), text-davinci-002、text-davinci-003 和ChatGPT之間幾乎沒有嚴格的統計上的比較,主要是因為:

- #text-davinci-003 和ChatGPT 在撰寫本文時才發布不到一個月。

- ChatGPT 不能透過 OpenAI API 被調用,所以想要在標準基準上測試它很麻煩。

所以在這些模型之間的比較更多是基於研究社區的集體經驗 (統計上不是很嚴格)。不過,我們相信初步的描述性比較仍然可以揭示模型的機制。

我們首先註意到以下text-davinci-002,text-davinci-003 與ChatGPT 之間的比較:

- 所有三個模型都經過指令微調。

- text-davinci-002 是一個經過監督學習指令微調 (supervised instruction tuning) 的模型。

- text-davinci-003 和 ChatGPT 是基於人類回饋的強化學習的指令微調 (Instruction tuning with Reinforcement Learning from Human Feedback RLHF)。這是它們之間最顯著的差異。

這表示大多數新模型的行為都是 RLHF 的產物。

那麼讓我們來看看RLHF 觸發的能力:

- #翔實的回應:text-davinci-003 的生成通常比text-davinci-002長。 ChatGPT 的回應則更加冗長,以至於使用者必須明確要求「用一句話回答我」,才能得到更簡潔的回答。這是 RLHF 的直接產物。

- 公正的回應:ChatGPT 通常對涉及多個實體利益的事件(例如政治事件)給予非常平衡的答案。這也是RLHF的產物。

- 拒絕不當問題:這是內容過濾器和由 RLHF 觸發的模型自身能力的結合,過濾器過濾掉一部分,然後模型再拒絕一部分。

- 拒絕其知識範圍之外的問題:例如,拒絕在2021 年6 月之後發生的新事件(因為它沒在這之後的資料上訓練過)。這是 RLHF 最神奇的部分,因為它使模型能夠隱式地區分哪些問題在其知識範圍內,哪些問題不在其知識範圍內。

有兩件事情值得注意:

- #所有的能力都是模型本來就有的, 而不是透過RLHF 注入的。 RLHF 的作用是觸發 / 解鎖突現能力。這個論點主要來自於資料量大小的比較:因為與預訓練的資料量相比,RLHF 佔用的計算量 / 資料量要少得多。

- 模型知道它不知道什麼不是透過寫規則來實現的, 而是透過RLHF解鎖的。這是一個非常令人驚訝的發現,因為 RLHF 的最初目標是讓模型產生複合人類期望的回答,這更多是讓模型產生安全的句子,而不是讓模型知道它不知道的內容。

幕後發生的事情可能是:

- #ChatGPT: 透過犧牲上下文學習的能力換取建模對話歷史的能力。這是一個基於經驗的觀測結果,因為 ChatGPT 似乎不像 text-davinci-003 那樣受到上下文演示的強烈影響。

- text-davinci-003:恢復了 text-davinci-002 所犧牲的上下文學習能力, 提高零樣本的能力。根據instructGPT的論文,這是來自於強化學習調整階段混入了語言建模的目標(而非 RLHF 本身)。

五、總結當前階段GPT-3.5 的進化歷程

到目前為止,我們已經仔細檢查了沿著進化樹出現的所有能力,下表總結了演化路徑:

#我們可以下結論:

# #############我們可以得出結論:######

- 語言生成能力 基礎世界知識 情境學習都是來自於預訓練(davinci)。

- 儲存大量知識的能力來自 1750 億的參數量。

- 遵循指令和泛化到新任務的能力來自於擴大指令學習中指令的數量(Davinci-instruct-beta)。

- 執行複雜推理的能力很可能來自於程式碼訓練(code-davinci-002)。

- 產生中立、客觀的能力、安全感和翔實的答案來自與人類的對齊。具體來說:

- 如果是監督學習版,得到的模型是text-davinci-002。

- 如果是強化學習版 (RLHF) ,得到的模型是text-davinci-003。

- 無論是有監督還是 RLHF ,模型在許多任務的表現都無法超過 code-davinci-002 ,這種因為對齊而造成效能衰退的現象叫做對齊稅。

- 對話能力也來自於RLHF(ChatGPT),具體來說它犧牲了上下文學習的能力,來換取:

- 建模對話歷史。

- 增加對話訊息量。

- 拒絕模型知識範圍以外的問題。

六、GPT-3.5 目前不能做什麼

#雖然GPT-3.5是自然語言處理研究中的重要一步,但它並沒有完全包含許多研究者(包括AI2)所設想的所有理想屬性。以下是GPT-3.5不具備的某些重要屬性:

- 即時改寫模型的信念:當模型表達對某事的信念時,如果該信念是錯誤的,我們可能很難修正它:

- #我最近遇到的一個例子是:ChatGPT 堅持認為3599 是一個質數,儘管它承認3599 = 59 * 61。另外,請參考Reddit上關於游得最快的海洋哺乳動物的例子。

- 然而,模型信念的強度似乎存在著不同的層次。一個例子是即使我告訴它達斯維達(星際大戰電影中的人物)贏得了2020年大選,模型依舊會認為美國現任總統是拜登。但如果我將選舉年份改為 2024 年,它就會認為總統是達斯維達是 2026 年的總統。

-

形式推理:GPT-3.5系列無法在數學或一階邏輯等形式嚴格的系統中進行推理:

- 在自然語言處理的文獻中,「推理」一詞的定義很多時候不太明確。但如果我們從模糊性的角度來看,例如一些問題 (a) 非常模棱兩可,沒有推理;(b) 有點兒邏輯在裡面,但有些地方也可以模糊;(c) 非常嚴謹,不能有任何歧義。

- 那麼,模型可以很好地進行(b) 類別的帶模糊性的推理,例子有:

- 產生如何做豆腐腦的方法。做豆腐腦的時候,中間很多步驟模糊一點是可以接受的,例如到底是做鹹的還是甜的。只要整體步驟大致正確,做出來的豆腐腦兒就能吃。

- 數學定理的證明思路。證明思路是用語言表達的非正式的逐步解法,其中每一步的嚴格推導可以不用太具體。證明思路常被用到數學教學:只要老師給一個大致正確的整體步驟,學生大概可以明白。然後老師把具體的證明細節當作作業佈置給學生,答案略。

- GPT-3.5 不能進行型別 (c) 的推理(推理不能容忍歧義)。

- 一個例子是嚴格的數學證明,要求中間步驟不能跳,不能模糊,不能錯。

- 但這種嚴格推理到底是應該讓語言模型做還是讓符號系統做還有待討論。一個例子是,與其努力讓 GPT 做三位數加法,不如直接調 Python。

- 從網路檢索:GPT-3.5 系列(暫時)無法直接搜尋網路。

- 但有一篇 WebGPT 論文發表在2021年12月,裡面就讓 GPT 呼叫了搜尋引擎。所以檢索的能力已經在 OpenAI 內部進行測試了。

- 這裡需要區分的一點是,GPT-3.5 的兩個重要但不同的能力是 知識 和 推理。一般來說,如果我們能夠 將知識部分卸載到外部的檢索系統,讓語言模型只專注於推理,這就很不錯了。因為:

- 模型的內部知識總是在某個時間點被切斷。模型始終需要最新的知識來回答最新的問題。

- 回想一下,我們已經討論過 1750 億的參數大量用於儲存知識。如果我們可以將知識卸載到模型之外,那麼模型參數可能會大大減少,最終它甚至可以在手機上運行(瘋狂的想法,但 ChatGPT 已經足夠科幻了,誰知道未來會怎樣呢)。

七、結論

在這篇文章中,我們仔細檢查了GPT-3.5系列的能力範圍,並追溯了它們所有突現能力的來源。

初代GPT-3模型透過預訓練獲得生成能力、世界知識和in-context learning。然後透過instruction tuning的模型分支獲得了遵循指令和能泛化到沒有見過的任務的能力。經過程式碼訓練的分支模型則獲得了程式碼理解的能力,作為程式碼訓練的副產品,模型同時潛在地獲得了複雜推理的能力。

結合這兩個分支,code-davinci-002似乎是具有所有強大能力的最強GPT-3.5模型。接下來透過監督的instruction tuning和 RLHF透過犧牲模型能力換取與人類對齊,即對齊稅。 RLHF 使模型能夠產生更翔實和公正的答案,同時拒絕其知識範圍之外的問題。

我們希望這篇文章能幫助提供一個清晰的GPT評估圖,並引發一些關於語言模型、instruction tuning和code tuning的討論。最重要的是, 我們希望這篇文章可以作為在開源社群內復現GPT-3.5的路線圖。

常見問題

- 這篇文章中的這些說法比較像是假設 (hypothesis) 還是結論 (conclusion)?

- 複雜推理的能力來自於程式碼訓練是我們傾向於相信的假設。

- 對沒有見過的任務泛化能力來自大規模指令學習 是至少 4 篇論文的結論。

- GPT-3.5來自其他大型基礎模型,而不是1750億參數的GPT-3 是有根據的猜測。

- 所有這些能力都已經存在了,透過instruction tuning,無論是有監督學習或強化學習的方式來解鎖而不是注入這些能力是一個強有力的假設,強到你不敢不信。主要是因為instruction tuning資料量比預訓練資料量少了幾個數量級。

- 結論= 許多證據支持這些說法的正確性;假設= 有正面證據但不夠有力;有根據的猜測= 沒有確鑿的證據,但某些因素會指向這個方向

- 為什麼其他模型(如OPT 和BLOOM)沒有那麼強大?

- OPT大概是因為訓練過程太不穩定。

- BLOOM的情況則未知。

#

以上是ChatGPT怎麼突然變得這麼強?華人博士萬字長文深度拆解GPT-3.5能力起源的詳細內容。更多資訊請關注PHP中文網其他相關文章!