近年來大規模視覺 Transformer 的蓬勃發展推動了電腦視覺領域的效能邊界。視覺 Transformer 模型透過擴大模型參數量和訓練資料從而擊敗了卷積神經網路。來自上海人工智慧實驗室、清華、南大、商湯和港中文的研究人員總結了卷積神經網路和視覺 Transformer 之間的差距。從算子層面來看,傳統的 CNNs 算子缺乏長距離依賴和自適應空間聚合能力;從結構層面來看,傳統 CNNs 結構缺乏先進組件。

針對上述技術問題,來自浦江實驗室、清華等機構的研究人員創新地提出了一個基於卷積神經網路的大規模模型,稱為InternImage,它將稀疏動態卷積作為核心算子,透過輸入相關的資訊為條件實現自適應空間聚合。 InternImage 透過減少傳統 CNN 的嚴格歸納偏移實現了從大量數據中學習到更強大、更穩健的大規模參數模式。其有效性在包括影像分類、目標檢測和語義分割等視覺任務上得到了驗證。並在 ImageNet、COCO 和 ADE20K 在內的挑戰性基準資料集中取得了具有競爭力的效果,在同參數量水準的情況下,超過了視覺 Transformer 結構,為影像大模型提供了新的方向。

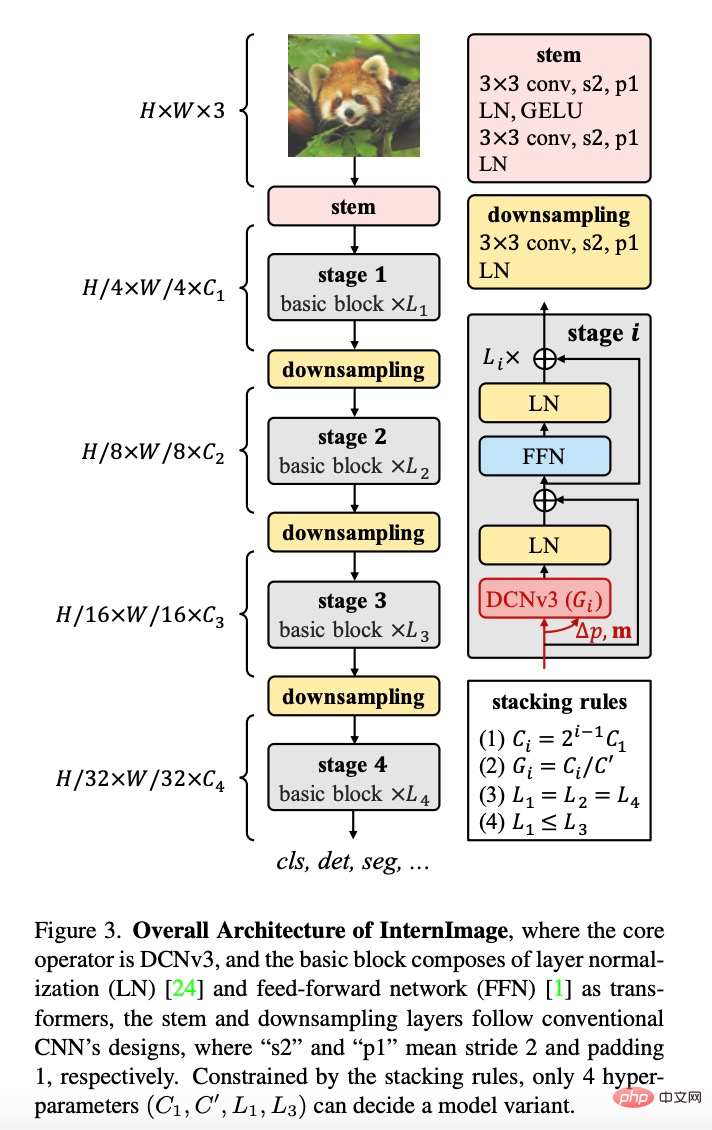

### ######傳統卷積神經網路的限制#########擴大模型的規模是提高特徵表示品質的重要策略,在電腦視覺領域,模型參數量的擴大不僅能夠有效加強深度模型的表徵學習能力,而且能夠實現從海量資料中進行學習和知識獲取。 ViT 和Swin Transformer 首次將深度模型擴大到20 億和30 億參數級別,其單模型在ImageNet 資料集的分類準確率也都突破了90%,遠超傳統CNN 網路和小規模模型,突破了技術瓶頸。但是,傳統的 CNN 模型由於缺乏長距離依賴和空間關係建模能力,無法實現同 Transformer 結構相似的模型規模擴展能力。研究者總結了傳統卷積神經網路與視覺Transformer 的不同之處:#############(1)從算子層面來看,視覺Transformer 的多頭注意力機制具有長距離依賴和自適應空間聚合能力,受益於此,視覺Transformer 可以從海量資料中學到比CNN 網路更強大、更穩健的表徵。 ############(2)從模型架構層面來看,除了多頭注意力機制,視覺Transformer 擁有CNN 網路不具有的更先進的模組,例如Layer Normalization (LN), 前饋神經網路FFN, GELU 等。 ############儘管最近的一些工作嘗試使用大核卷積來獲取長距離依賴,但是在模型尺度和精度方面都與最先進的視覺 Transformer 有著一定距離。 #########可變形卷積網路的進一步拓展#########InternImage 透過重新設計算子和模型結構提升了卷積模型的可擴展性並且緩解了歸納偏置,包括(1)DCNv3 算子,基於DCNv2 算子引入共享投射權重、多組機制和採樣點調變。 (2)基礎模組,融合先進模組作為模型建構的基本模組單元(3)模組堆疊規則,擴展模型時規範化模型的寬度、深度、組數等超參數。 ######

這項工作致力於建立一個能夠有效地擴展到大規模參數的 CNN 模型。首先,重新設計的可變形卷積算子DCNv2 以適應長距離依賴和弱化歸納偏置;然後,將調整後的捲積算子與先進組件結合,建立了基礎單元模組;最後,探索並實現模組的堆疊和縮放規則,以建立一個具有大規模參數的基礎模型,並且可以從海量資料中學習到強大的表徵。

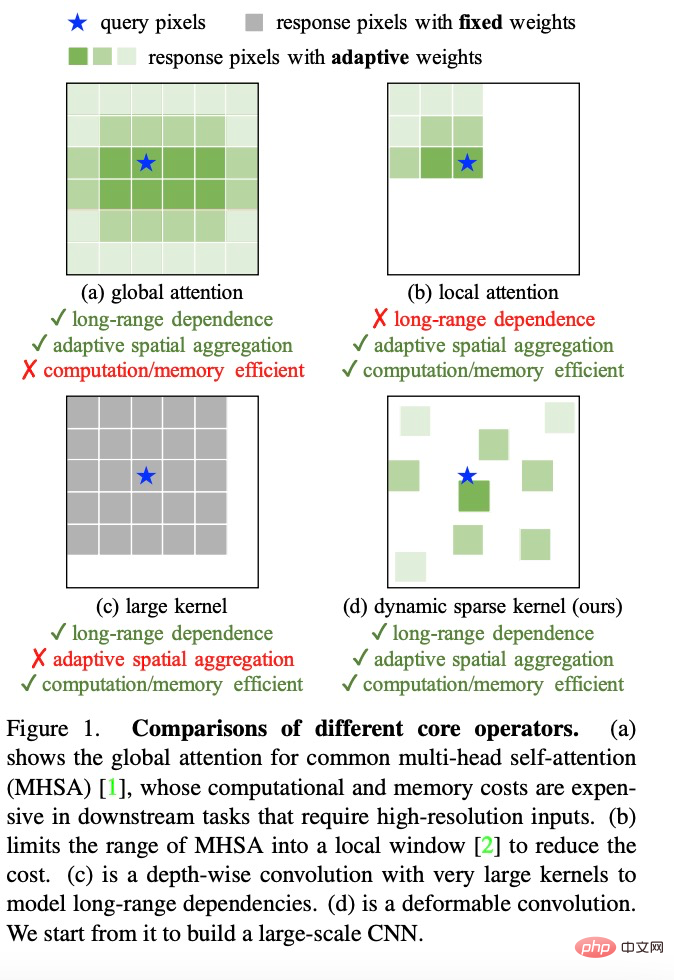

算符層面,研究首先總結了卷積算符與其他主流算子的主要差異。目前主流的Transformer 系列模型主要依靠多頭自註意力機制實現大模型構建,其算子具有長距離依賴性,足以構建遠距離特徵間的連接關係,還具有空間的自適應聚合能力以實現構建像素級別的關係。但這種全域的注意力機制其運算和儲存需求量龐大,很難實現高效訓練和快速收斂。同樣的,局部注意力機制缺乏遠距離特徵依賴。大核密集卷積由於沒有空間聚合能力,而難以克服卷積天然的歸納偏置,不利於擴大模型。因此,InternImage 透過設計動態稀疏卷積算子,達到實現全局注意力效果的同時不過多浪費運算和儲存資源,實現高效訓練。

研究者基於 DCNv2 算子,重新設計調整並提出 DCNv3 算子,具體改進包括以下幾個部分。

(1)共享投射權重。與常規卷積類似,DCNv2 中的不同採樣點具有獨立的投射權重,因此其參數大小與採樣點總數呈線性關係。為了降低參數和記憶體複雜度,借鑒可分離卷積的思路,採用與位置無關的權重代替分組權重,在不同採樣點之間共享投影權重,所有採樣位置依賴性都得以保留。

(2)引入多組機制。多組設計最早是在分組卷積中引入的,並在 Transformer 的多頭自註意力中廣泛使用,它可以與自適應空間聚合配合,有效地提高特徵的多樣性。受此啟發,研究者將空間聚合過程分成若干組,每組都有獨立的採樣偏移量。自此,單一 DCNv3 層的不同群組擁有不同的空間聚合模式,產生豐富的特徵多樣性。

(3)取樣點調變標量歸一化。為了緩解模型容量擴大時的不穩定問題,研究者將歸一化模式設定為逐採樣點的Softmax 歸一化,這不僅使大規模模型的訓練過程更加穩定,而且還構建了所有採樣點的連結關係。

建構DCNv3 算符之後,接下來首先需要規範化模型的基礎模組和其他層的整體細節,然後透過探索這些基礎模組的堆疊策略,建構InternImage。最後,根據所提出模型的擴展規則,建構不同參數量的模型。

基礎模組。與傳統CNN 中廣泛使用的瓶頸結構不同,該研究採用了更接近ViTs 的基礎模組,配備了更先進的組件,包括GELU、層歸一化(LN)和前饋網絡(FFN),這些都被證明在各種視覺任務中更有效率。基礎模組的細節如上圖所示,其中核心算子是 DCNv3,透過將輸入特徵透過一個輕量級的可分離卷積來預測採樣偏壓和調製尺度。對於其他元件,遵循與普通 Transformer 相同的設計。

疊加規則。為了明確區塊堆疊過程,研究提出兩個模組堆疊規則,其中第一條規則是後三個階段的通道數 ,由第一階段的通道數

,由第一階段的通道數 決定,即

決定,即 ;第二條規則是各模組組號與各階段的通道數對應,即

;第二條規則是各模組組號與各階段的通道數對應,即 ;第三,堆疊模式固定為“AABA”,即第1、2 和4 階段的模組堆疊數是相同的

;第三,堆疊模式固定為“AABA”,即第1、2 和4 階段的模組堆疊數是相同的 ,且不大於第3 階段

,且不大於第3 階段 。由此選擇將參數量為30M 等級的模型作為基礎,其具體參數為:Steam 輸出通道數

。由此選擇將參數量為30M 等級的模型作為基礎,其具體參數為:Steam 輸出通道數 為64;分組數為每個階段輸入通道數的1/16,第1、2、4 階段的模組堆疊數

為64;分組數為每個階段輸入通道數的1/16,第1、2、4 階段的模組堆疊數 為 4,第3 階段的模組堆疊數

為 4,第3 階段的模組堆疊數 為18,模型參數為30M。

為18,模型參數為30M。

模型縮放規則。基於上述約束條件下的最優模型,研究規範化了網路模型的兩個縮放維度:即深度D(模組堆疊數)和寬度C(通道數),利用限制因子 和

和 沿著複合係數

沿著複合係數 對深度和寬度進行縮放,即,

對深度和寬度進行縮放,即, ,其中

,其中 #,根據實驗其最佳設定為

#,根據實驗其最佳設定為 。

。

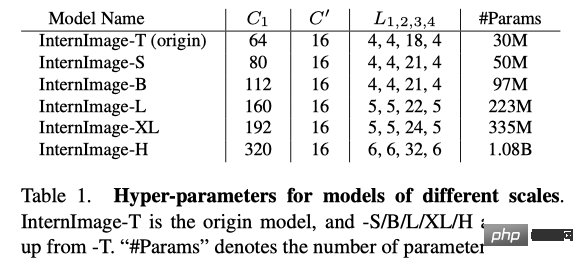

依照此規則,研究建構了不同尺度的模型,即 InternImage-T、S、B、L、XL。具體參數為:

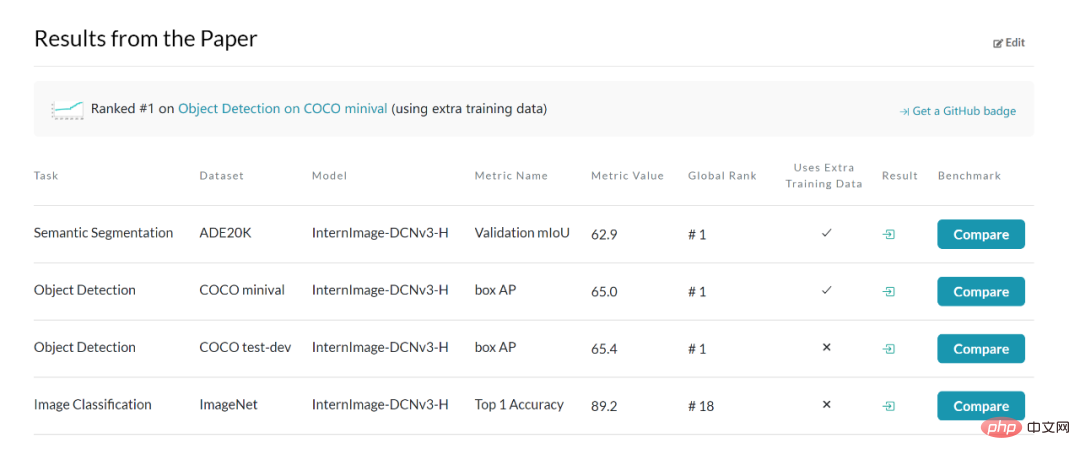

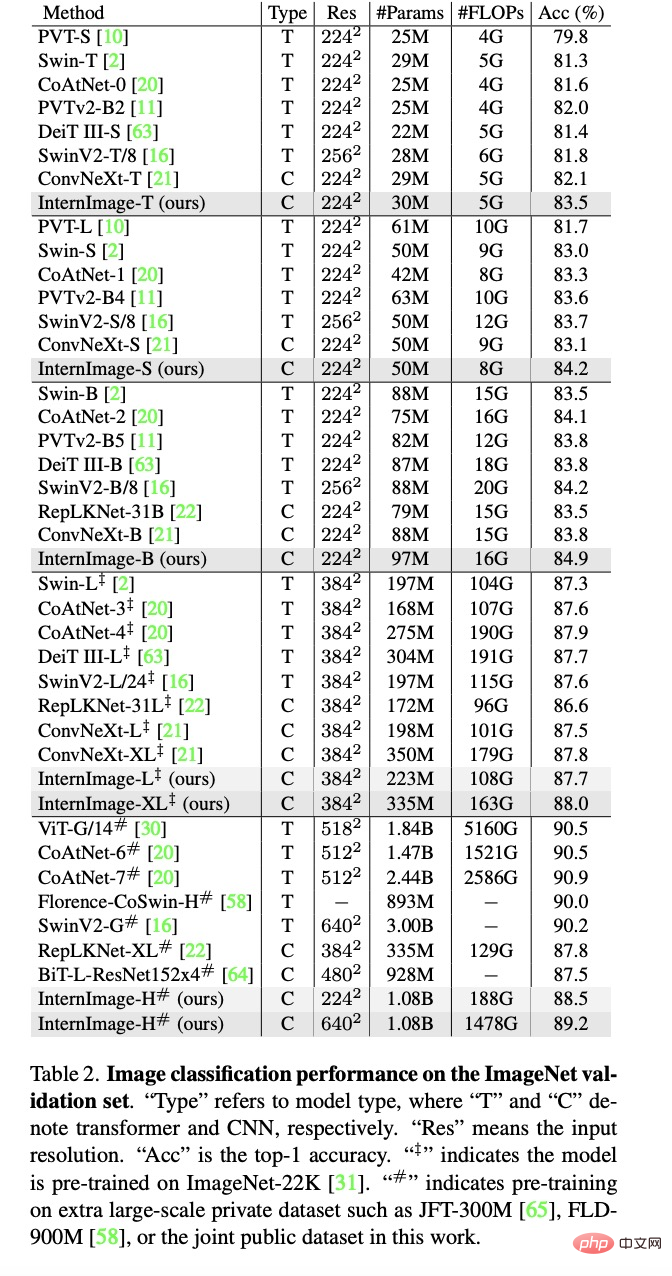

影像分類實驗#:透過使用427M 的公共資料集合:Laion-400M,YFCC15M, CC12M,InternImage-H 在ImageNet-1K 的精確度達到了89.2%。

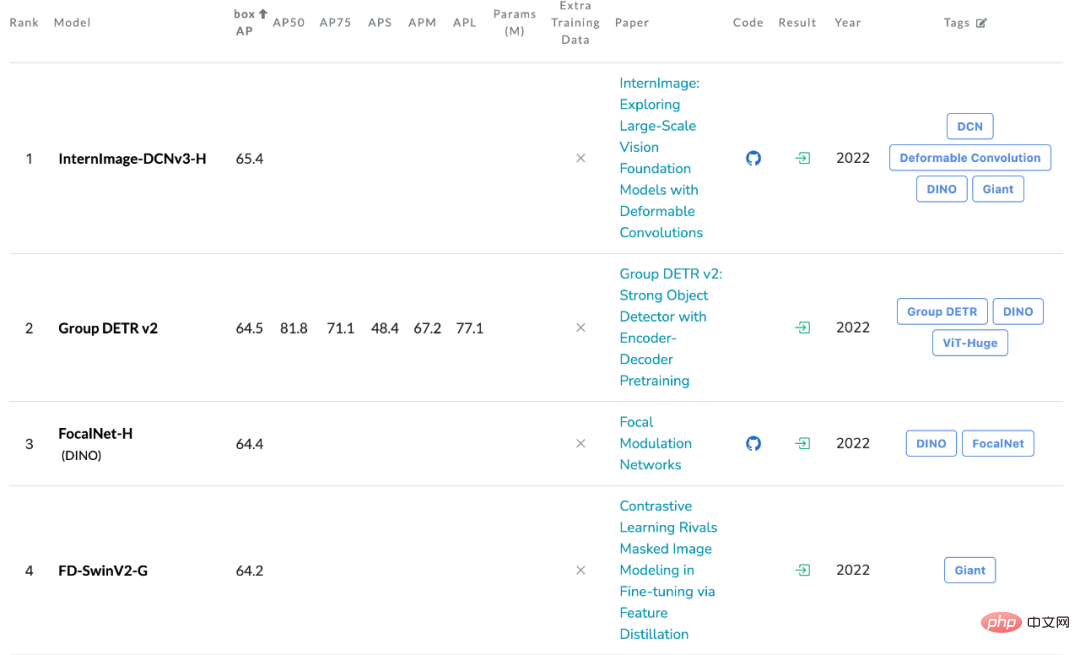

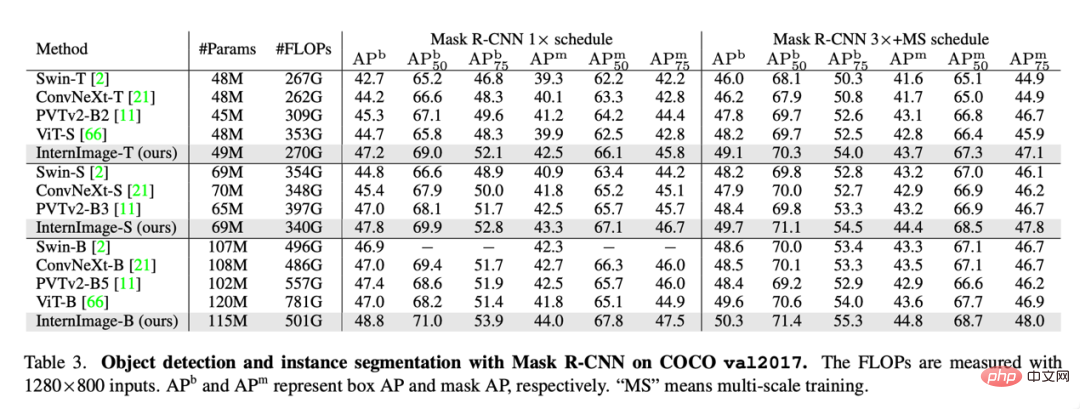

目標偵測#:以最大規模的InternImage-H 為骨幹網絡,並使用DINO 作為基礎檢測框架,在Objects365 資料集上預訓練DINO 檢測器,然後在COCO 上進行微調。該模型在目標偵測任務中達到了 65.4% 的最優結果,突破了 COCO 目標偵測的效能邊界。

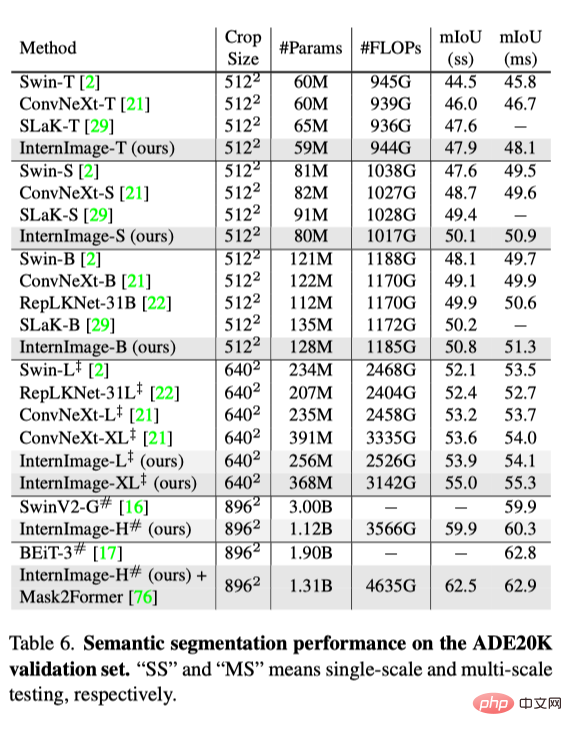

語意分割:在語意分割上,InternImage-H同樣取得了很好的性能,結合Mask2Former 在ADE20K 上取得了目前最高的62.9%。

該研究提出了InternImage,這是一種新的基於CNN 的大規模基礎模型,可以為影像分類、物件偵測和語義分割等多功能視覺任務提供強大的表示。研究者調整靈活的 DCNv2 算子以滿足基礎模型的需求,並以核心算符為核心開發了一系列的 block、stacking 和 scaling 規則。目標偵測和語意分割基準的大量實驗驗證了InternImage 可以獲得與經過大量資料訓練、且精心設計的大規模視覺Transformer 相當或更好的性能,這表明CNN 也是大規模視覺基礎模型研究的一個相當大的選擇。儘管如此,大規模的 CNN 仍處於早期發展階段,研究人員希望 InternImage 可以作為一個很好的起點。

以上是用CNN做基礎模型,可變形卷積InternImage實現檢測分割新紀錄!的詳細內容。更多資訊請關注PHP中文網其他相關文章!