ChiQA-一個基於20萬個真實用戶問題的圖片問答資料集

近年來,隨著問答技術和多模態理解技術的蓬勃發展,視覺問答任務(Visual Question Answering)變得越來越受關注。諸如 VQA、CLEVER、Visual-7W 等大規模視覺問答資料集陸續發布,大大推動了視覺問答任務的迭代發展。然而,目前大部分視覺問答資料都是人工合成問題,如 “她的眼睛是什麼顏色” 這種標註者在看到圖片後虛構設計出的。人工產生的數據會相對簡單、低質甚至有偏。因此,在這項工作中,我們基於 QQ 瀏覽器中用戶真實的問題,提出了一個基於中文的大規模圖片問答資料集:ChiQA。

ChiQA 包含超過 4 萬個真實用戶 query 和超過 20 萬個問題 - 圖像對。數據和一些 baseline 模型已經公佈在GitHub。相關研究已被 CIKM2022 長文錄用。

#論文網址:https://arxiv.org/abs/2208.03030

Github網址:https://github.com/benywon/ChiQA

比較單模態問答任務

ChiQA的三個顯著特性

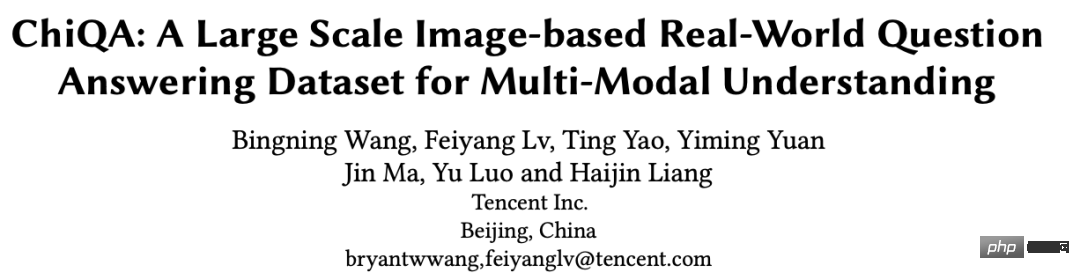

問答系統(Question Answering) 是人工智慧和智慧語言處理中非常重要的任務之一。近年來,隨著大規模資料集(如 SQuAD、NaturalQuestions)的發布以及大規模預訓練語言模型(如 BERT、GPT)的提出,問答任務得到了飛速的發展。然而,目前大部分的問答任務都是單模態的,即問題、資源以及答案都是基於文本。然而,從認知智慧以及實際應用的角度來說,多模態資源如影像在許多時候往往能提供更豐富的資訊和答案。例如,對於一個問題:iPhone13 的尺寸是多少?一個針對 iPhone13 不同型號的尺寸對比圖會更清楚、更直覺。還有一些例子如下圖:

#圖一:一些適合用圖片回答使用者問題的範例

#最近幾年,針對多模態理解的問答資料和任務被相繼提出。如 VQA1.0 和 2.0、CLEVR、GQA 等等。在大部分影像問答資料集中,系統提供一些人工生成或真實的影像給標註者,標註者需要人工寫出一些針對特定屬性或實體的問題。然而,這種資料收集過程不可避免的有許多缺陷:

1)所有的問題都是與影像相關的(image-dependent),即標註者看到圖片之後提出問題。在大規模資料建構過程中,人工生成的問題往往缺乏多樣性,而且往往會因為標註者的主觀因素會產生偏置。在這種先看資源,再提問的資料上訓練的模型往往可以不用看背景資源只看問題而輕易達到非常好的效果;

##2)其次,在傳統在的VQA 數據中,答案往往是一個簡單的實體、關係或簡單對特定區域的描述。然而對於實際的圖像問答任務中,許多文本性答案是不必要的,例如對於問題:“羊駝長什麼樣子”,提供一個冗長的答案描述羊駝的外表顯得非常冗餘。其次,這種簡短的實體描述往往會讓標註者只關注局部關係,而很少注意真正整體結構上的一些資訊;

3)最後,大部分之前的資源往往是專注於英文,在中文領域的圖像問答數據很少。

在这个工作中,针对以上几个问题,我们提出了一个大规模的中文图像问答数据集 - ChiQA(Chinese Image Question Answering)。我们通过手机 QQ 浏览器中用户真实的搜索词出发,通过特定 API 检索到相关的若干张ChiQA-一個基於20萬個真實用戶問題的圖片問答資料集,然后将ChiQA-一個基於20萬個真實用戶問題的圖片問答資料集交由经过专业培训的标注人员进行三级标注,以表示该ChiQA-一個基於20萬個真實用戶問題的圖片問答資料集是否能完美回答(2 分)、部分回答(1 分)以及不能回答(0 分)用户的问题。对于 ChiQA 来说,有三个显著的特点:

- 真实问题,真实ChiQA-一個基於20萬個真實用戶問題的圖片問答資料集:ChiQA 中的ChiQA-一個基於20萬個真實用戶問題的圖片問答資料集来源于随机用户的查询。这些查询是开放域中随机的用户 query,这些 query 非常多样,而且 query 的领域分布非常广泛。这样随机的多样性 query 保证了我们的数据中的问题不会有偏;

- 可回答性:对于问答任务来说,可回答性是一个非常重要的方面。在 ChiQA 中我们不要求标注人员给出最终的答案:因为这样往往会引入一些额外的偏置,比如标注人员的常识。相反的,我们着重于可回答性,即ChiQA-一個基於20萬個真實用戶問題的圖片問答資料集对于问题是否可以回答。这种可回答性可以让 ChiQA 的标注人员既需要理解 query,也需要理解ChiQA-一個基於20萬個真實用戶問題的圖片問答資料集;

- 无偏的:因为随机 query 中也会存在 28 定律,即一些高频或者单一的问题往往会出现很多次,数据中这种简单模式的问题会占据大多数,造成数据中真正跨模态理解的偏置。因此,我们在数据收集过程中引入了两阶段的主动学习过程,在第一阶段随机 query 标注完成后,我们训练了一个简单的模型,然后用这个模型挑选出 "更难" 的一些模型,从而让二阶段的标注数据中数据的丰富度和难度相对更高。

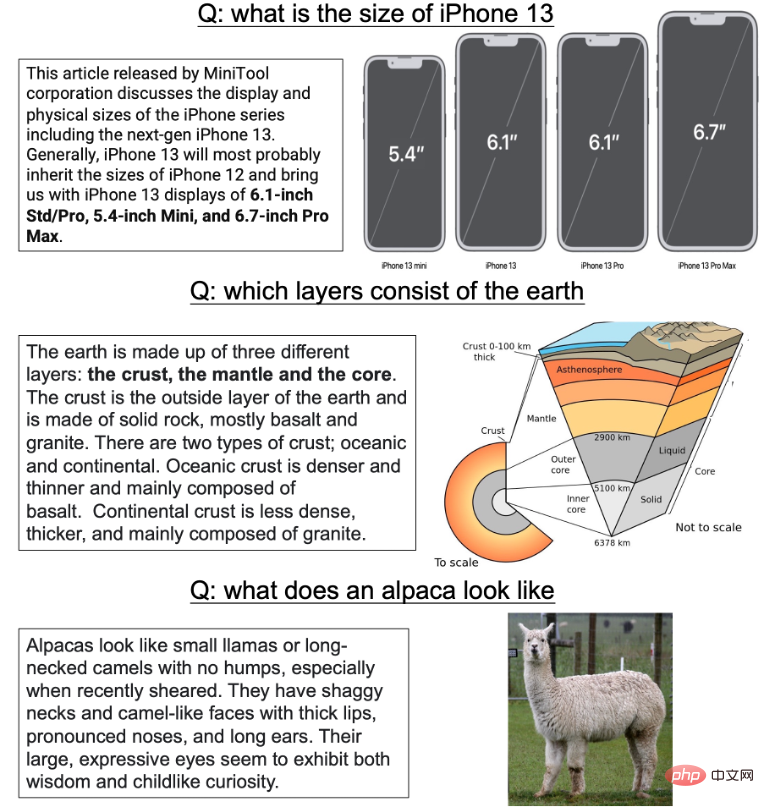

图二:ChiQA 和业界其他一些图像问答数据的对比

最终我们收集了超过 40000 个问题,每个问题都有大约 5 个相关的ChiQA-一個基於20萬個真實用戶問題的圖片問答資料集,即总量超过 20 万的问题 - ChiQA-一個基於20萬個真實用戶問題的圖片問答資料集对。每个问题都有若干张ChiQA-一個基於20萬個真實用戶問題的圖片問答資料集,我们对每个ChiQA-一個基於20萬個真實用戶問題的圖片問答資料集以2-1-0进行三挡打分。

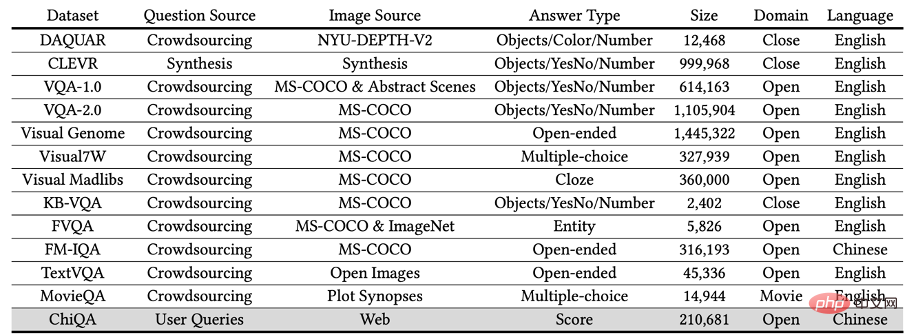

一些 ChiQA 中的例子如下图所示:

图三:ChiQA 中一些样本的示例。

数据收集:所有问题均来源于用户真实查询

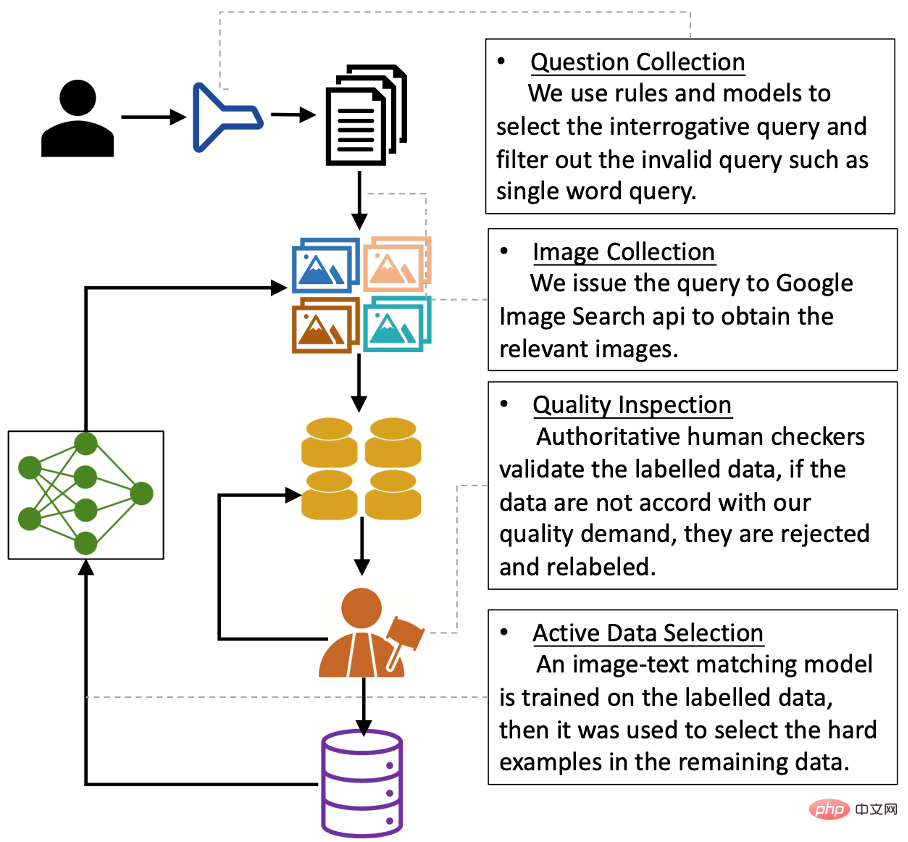

整个数据的收集过程可以分为四步,整体流程图如下:

图四:数据收集过程

对于 ChiQA 来说,其一大特色是所有的问题都来源于用户真实的查询。然而,如果我们随机从搜索引擎用户的搜索日志中采样用户的查询,那么大部分查询都是没有问答意图的。

因此我们首先需要过滤出有问答意图的 query。在这个工作中,我们采用了一种内部构造的弱监督方法训练了一个二分类器,来判定一个 query 是不是有问答意图。人工评测这个意图模型能够达到 90% 的精度以及 80% 的召回。我们通过这个模型对用户的 query 进行采样,得到了大约 7.5 万个经过模型判定具有问答意图的用户 query 进入下一轮。

圖像收集&標註過程和經驗

得到了問題之後,我們將這些問題發送給谷歌提供的開放 API(Google Images API - SerpApi)進行相關圖像檢索。 Google API 對每個 query 會傳回最相關的 100 個影像。為了確保最後資料的質量,我們去掉了那些長度或寬度小於 200 像素的 query以及那些過長或過寬的影像。

得到了原始圖像之後,我們取經過過濾後的前 5 張圖片,並請標註人員標註這個 query 和對應的 5 張圖片。我們內部專門為本任務設計了一個標註介面,如下圖所示。

#圖五:ChiQA 的標註介面

在標註過程中,我們讓標註人員標註三個面向:

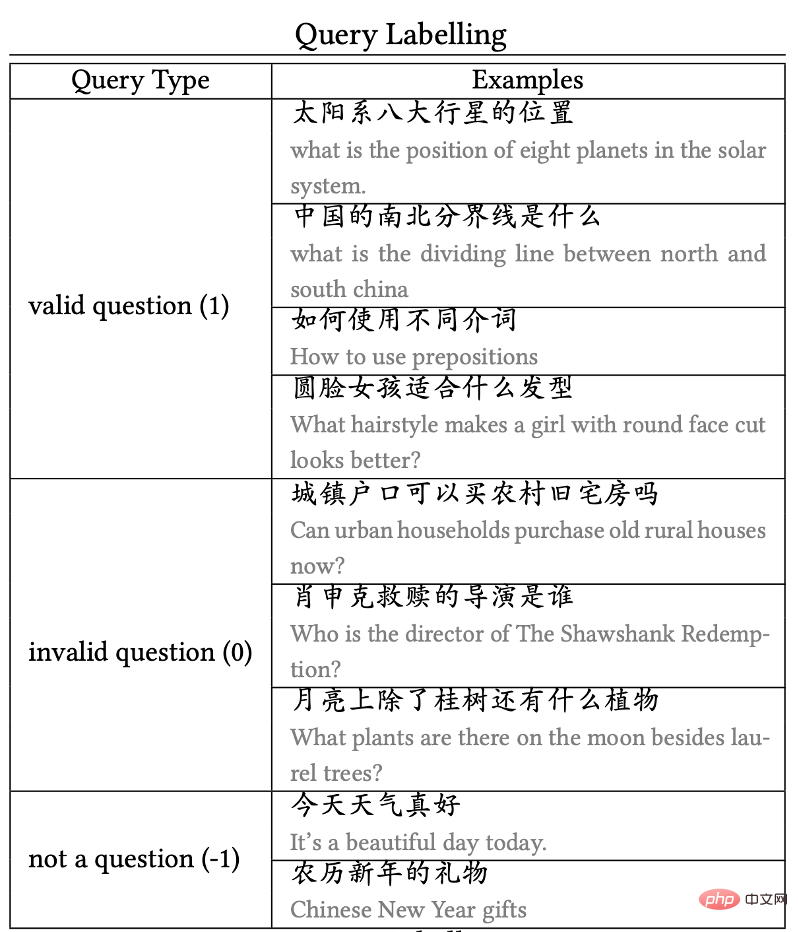

1) 問題標註

由於本工作主要著眼於圖片問答,而事實上在普通的用戶問題中很多都和圖片問答無關(或者很難用圖片來回答)。因此我們先讓標註人員標註這個問題是不是可以算是圖片問答的問題。例如:

如果一個問題是“xxx 和xxx 的差別”,那麼這個問題就會被認為是一個具有圖像問答意圖的問題;

如果一個問題是模糊的、具有歧義的或包含有沒有事實根據推論的觀點,那麼這個問題就會被歸類於無圖像問答意圖,並且不會參與到後續圖片標註的過程中。

一些query 標註的範例如圖6 所示:

圖6: query 標註的範例

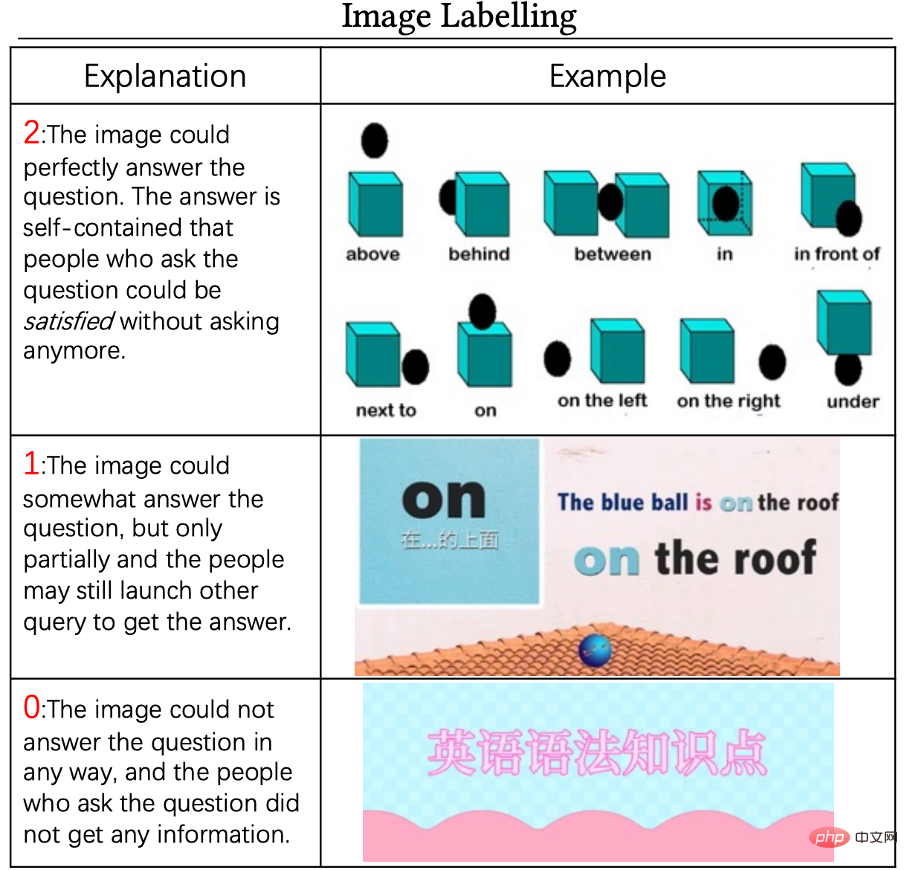

2) 圖片標註

對於上一個有效的query,我們對其5 個候選query 進行標註。標註的標準是三級0-1-2 標註,其中:

0 分錶示這個圖片完全不能用來回答這個問題,2 分錶示這個圖片品質過關並且可以完全獨立的回答這個問題。而 1 分的圖片則介於這兩者之間,表示這個圖片和這個 query 相關,但是卻無法直接回答,用戶可能需要更多的查詢或推理才能得到最終的答案。一些0 分、1 分、2 分的例子如下圖所示:

#圖七:對於問題「如何使用不同介詞”,圖片標註評分的範例

3) 品質控制

我們在整個標註過程中採用了嚴格的品質控制方案。具體來說,我們首先會邀請 3 個品質團隊進行試標註,選擇標註品質最好的那個團隊來標註餘下所有的數據。其次,在標註過程中,我們會將標註資料分批,每一批次的資料我們會採樣其中五分之一的資料進行人工校驗,如果資料的合格率小於90%,那麼這一批次的資料將會被打回重新進行標註,直到資料精度達到90%。

主動學習的資料標註

讓結果更無偏

經過資料收集的工作,我們發現如果隨機對資料進行取樣和標註,那麼資料中往往會存在一些簡單的模式,這種簡單的模式大量存在於資料中可能會對最終的模型造成偏移影響。因此,我們設計了一個主動學習的標註過程。具體來說,我們首先將讓標註人員標註一批數據,這一批數據標註完成之後,我們就用這一批數據訓練一個跨膜態的文本圖像匹配模型。模型訓練完畢之後,我們開始用這個模型來「選擇」 新的樣本:如果模型對這個新的樣本預測非常不確定(即最後分類預測的熵特別大),那麼我們認為這個樣本相對模型較難,因此有較大機率保留到下一輪中間,反之說明模型對這個數據已經很置信了,那麼這個模型以較小的機率保留到下一輪。

我們發現主動學習資料選擇過程確實讓資料集更無偏。我們發現第一階段的標記資料包含一些難以察覺的偏置。例如,包含「的技巧」 字的問題標記為有效問題,但幾乎所有相應的圖像被標記為無法回答(即0 分),因此模型很可能不看圖片直接根據query 中的問題就預測出最終的結果。而這種主動學習的過程降低了這種可能性,這種高置信度且有偏的竅門(shortcut)在下一輪中很難被選擇上,從而降低了這種模式的影響面。

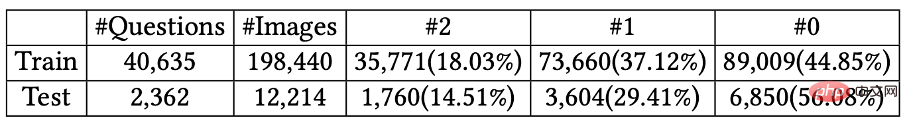

測試集標註

我們隨機從標註數據中篩選出來 2500 個數據,並且讓不同的標註者重新標註。如果標註的結果和先前的結果一樣,則這個數據被保留為測試集,要是不一樣,我們讓一個對任務非常了解的「專家」重新標註這個數據,最終得到了2362 條測試數據以及超過4 萬條訓練資料。訓練集和測試集的統計資訊如下圖所示:

#圖八:ChiQA 中訓練集和測試集的統計信息

資料的推理和分析

在標註完資料之後,我們對ChiQA 中的資料進行統計和分析。

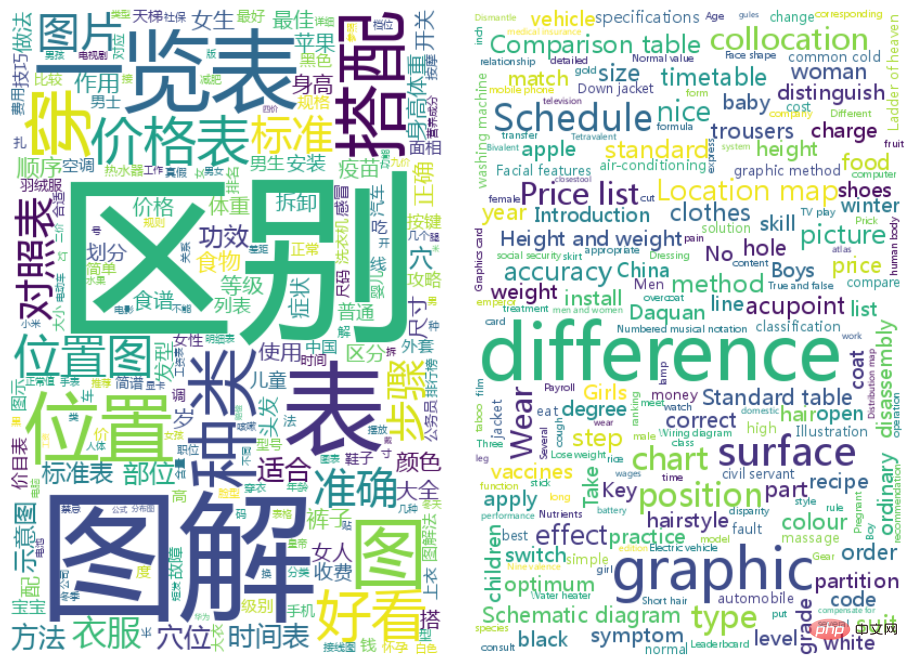

1)query 常用詞分析:

#我們用結巴分詞對query 進行切分,並且將query中的單字按照頻率展示在下面的雲圖上:

#可以看到ChiQA 中最常見的query 是區別、圖解、位置等。這和我們的直覺一樣,因為這些字確實是很適合圖片來回答的問題。

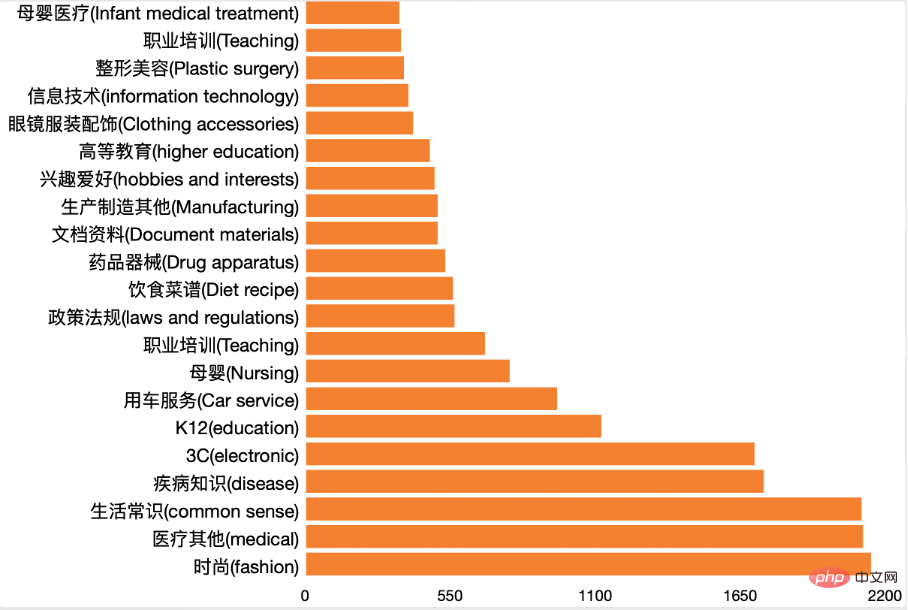

2)領域分析

我們使用內部的一個領域分類的分類器來對所有的query 進行分類,最終的結果如下圖所示:

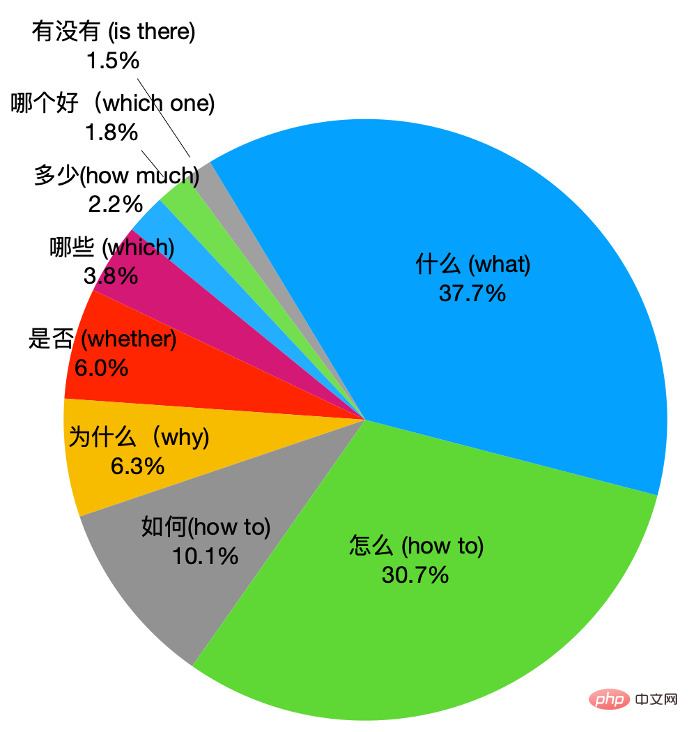

可以看到我們的數據包含有很多種領域的數據,並且沒有某一種領域的數據是佔絕對多數的。這保證了我們的數據分佈是均勻的。其次,我們對問題裡面的疑問詞也進行統計,結果如下圖所示:

#可以看到ChiQA 中what 類別和how to類問題佔了大多數,而其他的一些問題也有相當大的比例。

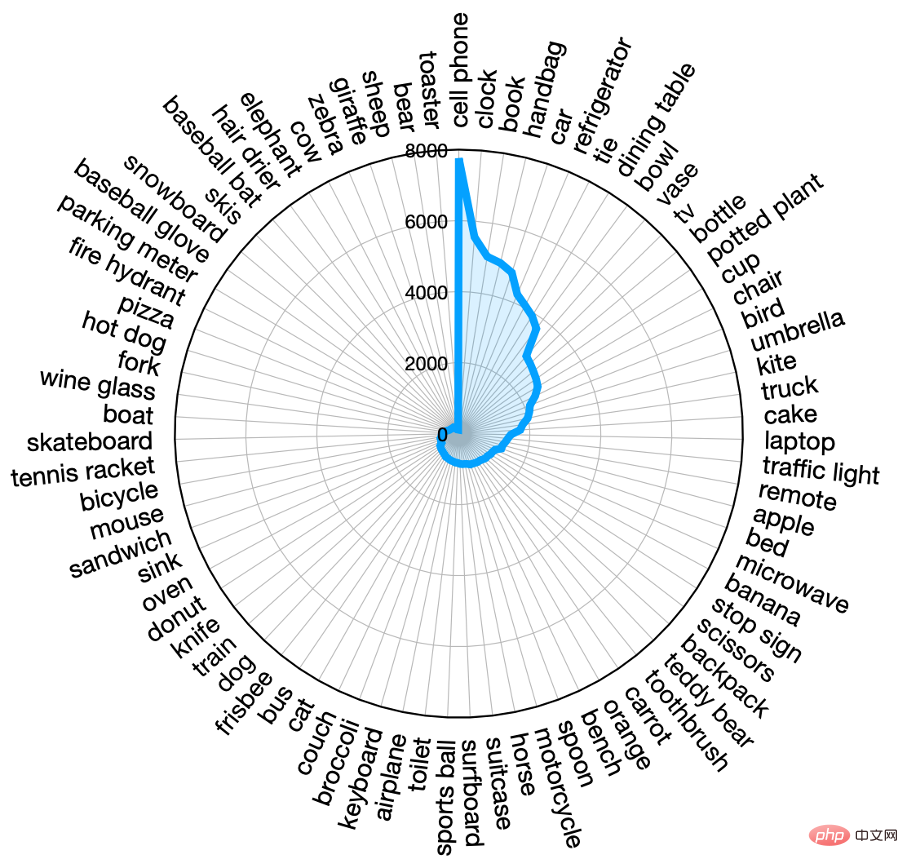

3)影像分析

##########除了問題之外,我們也對 ChiQA 中的圖像進行了分析。由於影像大部分是語言無關的,因此我們採用了一個在業界公認效能比較優良的目標偵測模型 DETR 來挖掘出影像中的實體。 DETR 可以將影像中的實體對應到標準 MS-COCO 定義的實體中,如 「人物」、「狗」 等。我們對ChiQA 中的每個影像挖掘出實體,並將最高頻次的實體分佈展示在下圖中:

可以看到在ChiQA中有超過30 個實體出現了至少1000 次,這顯示出ChiQA 是一個分佈非常均勻並且覆蓋了大部分領域的圖像數據,其中出現次數最多的實體是“人物”、“手機”、“汽車” 等。這個和問題的分佈類似。

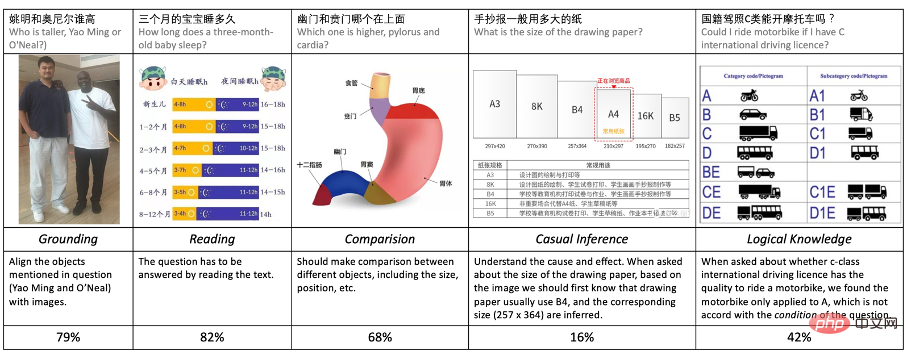

4)推理技能

#為了更好地分析數據,我們也對ChiQA 數據中所需要的推理技能進行了分析。著重分析了5 中需要推理的技能:

- Grouding: 需要模型和系統將問題中提到的實體進行理解和定位

- ##閱讀:需要模型理解圖片中出現的文字部分

- 對比:需要模型比較一些不同的屬性和內容,例如身高、大小等等

- #因果推理:模型需要深層理解問題和圖片中存在的因果部分(即事物發生的原因或造成的結果)

- 邏輯推理:需要模型理解問題或圖片中的一些邏輯比較因素,例如否定、條件等等

#我們隨機採樣了200 條數ChiQA 據並且根據上述5 個標準進行標註,其中某些數據可能需要不只一種推理技能。其結果如下圖所示。

可以看到除了 Grouding 之外,超過 80% 的 ChiQA 資料需要深度理解圖片中的文字和對比關係。這和之前大部分的 VQA 數據很不一樣。其次,有相當多的問題需要邏輯和對比,說明 ChiQA 中的數據具有相當的難度。我們認為對 ChiQA 中推理技能的分析可以幫助我們更好地理解這個數據,並且為後續的模型設計提供一些先驗的指導。

實驗評估指標在ChiQA 資料集中,標註評分有三擋:0,1,2,所以在實驗中我們測試模型排序的指標和普通分類的指標。分為三類:

- NDCG@N:Normalized Discounted Cumulative Gain ##Mean Average Precision(MAP@N):平均精度(MAP@N)

- Accuray / Precision / Recall / F1

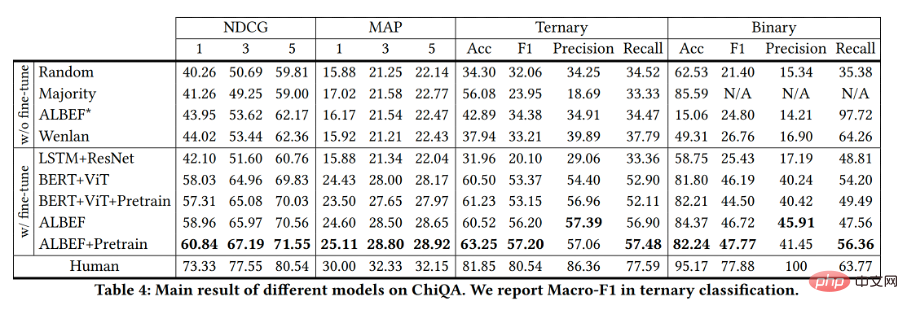

我們在ChiQA 資料集上實驗了多個常用的模型。仿照之前圖片 - 文字匹配的工作,我們先把圖片和文字分別用編碼器進行編碼,然後將它們的表示進行跨模態融合,最後用一個預測層來獲取匹配得分。在下面所列模型中,加♣代表模型經過了預訓練,加♦則表示沒有。

- Random♦:對測試集中的每個數據,在 0、1、2 中隨機選擇一個預測分數,random 模型是作為 ChiQA 上的一個基線模型。

- Majority♦:選擇訓練集中出現最多的標籤作為測試集上所有資料的預測分數。

- LSTM ResNet♦:在文字和視覺的大規模預訓練模型出現前,LSTM 和 ResNet 分別是文字和視覺領域最常用的模型之一。

- Bert ViT♣:我們使用 Bert 模型編碼查詢文本,使用 ViT 模型編碼圖片,其中,Bert 和 ViT 模型都是在大規模無監督資料上預先訓練過的。最後使用 的表示向量進行匹配分數預測。

- ALBEF♣:ALBEF 是一種大規模的視覺和語言表示學習,已經在各種視覺語言任務上展示出較大的改進。

- Pretrain♣:對於中文的跨模態預訓練,我們在悟空資料集上對Bert-ViT和ALBEF進行跨膜態預訓練,預訓練方式和ALBEF類似。悟空資料集是一個包含1億個圖片-文字對的開源跨模態資料。

- Wenlan♣:Wenlan 是一個大規模的多模態預訓練模型,在 3000 萬個文字-圖像對上進行了訓練,模型包含近十億個參數。我們使用他們公開的api服務來獲取文字和圖片的表示向量,並使用兩個向量的Cos相似度作為預測的匹配分數。

- Human:除了上述這些模型,我們也評估了人類在測試集上的預測程度。由於測試集資料較多,我們人工隨機抽樣了 100 個資料進行預測和評估預測指標。

以下是結果顯示:

#上述模型在測試集上的指標如圖所示。我們可以看到,直接應用之前最先進的跨模態方法的效果很差,指標只比隨機評分模型好一點。這意味著 ChiQA 數據更難,僅使用大規模的弱監督對比學習的模型,如 ALBEF*、Wenlan,可能無法區分視覺問答所需的細粒度資訊。此外,這些模型的糟糕表現說明,ChiQA 數據集不同於先前弱監督的圖像 - 文字匹配數據,因為弱監督的圖像 - 文字匹配側重於相關性,而 ChiQA 數據同時要求圖片的可回答性。

最後,在ChiQA 上微調的模型在基線上取得了很大的進步,但與人類的表現仍然相差較遠,所以模型在ChiQA 資料集還有很大的提升空間。

ChiQA在產品裡的應用

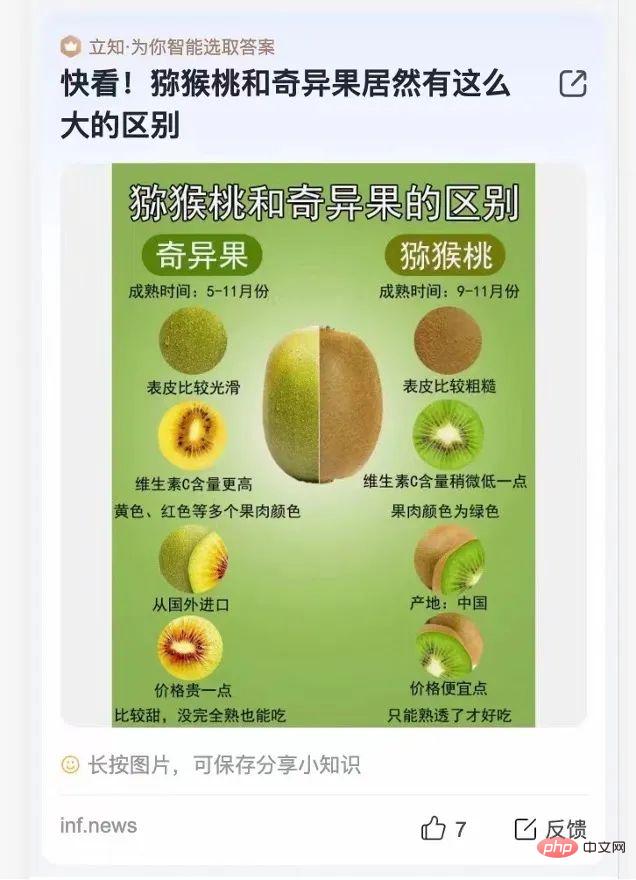

隨著網路的發展,使用者對問答的需求更高,需要係統提供更直覺、便利的答案。特別是最近幾年,多媒體內容愈加的豐富,以圖片、影片為載體的問答內容越來越多的出現在公眾面前。 QQ 瀏覽器實驗室立知團隊在今年 4 月率先在業界推出圖片問答項目,如用戶搜獼猴桃和奇異果的區別,結果會以圖片的形式直觀的展現在用戶面前。如下圖所示:

目前這種可以直接由圖片滿足的問題上線後取得了良好的效果。我們觀察到其使用者行為(如 CTR、換詞率等)相較於傳統的結果有著明顯的改善,說明目前以圖片等為載體的 「新問答」 是一個更能滿足使用者需求的產品業務。

作者團隊介紹

QQ 瀏覽器搜尋技術中心團隊是騰訊PCG 資訊平台與服務線負責搜尋技術研發的團隊,依托騰訊內容生態,透過使用者研究驅動產品創新,提供使用者圖文、資訊、小說、長短視頻、服務等多方位資訊的需求滿足。在演算法方面,以自然語言處理、深度學習、多模態理解與生成、知識計算與應用等技術為基礎,建構內容理解、相關性與排序、多模態搜尋、智慧問答、多語言翻譯、搜尋推薦等技術方向,探索並應用業界先進技術、打造更優秀的用戶搜尋體驗;在工程方面,建置搜尋技術中台工業系統,打磨高效能、高可用、低成本的百億級檢索系統,為騰訊PCG 各內容業務的搜尋場景提供基礎的搜尋引擎服務,目前已支援QQ 瀏覽器、騰訊影片、騰訊新聞、騰訊微視等PCG 多條產品線。

以上是ChiQA-一個基於20萬個真實用戶問題的圖片問答資料集的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

熱門話題

Stable Diffusion 3論文終於發布,架構細節大揭秘,對復現Sora有幫助?

Mar 06, 2024 pm 05:34 PM

Stable Diffusion 3論文終於發布,架構細節大揭秘,對復現Sora有幫助?

Mar 06, 2024 pm 05:34 PM

StableDiffusion3的论文终于来了!这个模型于两周前发布,采用了与Sora相同的DiT(DiffusionTransformer)架构,一经发布就引起了不小的轰动。与之前版本相比,StableDiffusion3生成的图质量有了显著提升,现在支持多主题提示,并且文字书写效果也得到了改善,不再出现乱码情况。StabilityAI指出,StableDiffusion3是一个系列模型,其参数量从800M到8B不等。这一参数范围意味着该模型可以在许多便携设备上直接运行,从而显著降低了使用AI

你是否真正掌握了座標系轉換?自動駕駛離不開的多感測器問題

Oct 12, 2023 am 11:21 AM

你是否真正掌握了座標系轉換?自動駕駛離不開的多感測器問題

Oct 12, 2023 am 11:21 AM

一先導與重點文章主要介紹自動駕駛技術中幾種常用的座標系統,以及他們之間如何完成關聯與轉換,最終建構出統一的環境模型。這裡重點理解自車到相機剛體轉換(外參),相機到影像轉換(內參),影像到像素有單位轉換。 3d向2d轉換會有對應的畸變,平移等。重點:自車座標系相機機體座標系需要被重寫的是:平面座標系像素座標系難點:要考慮影像畸變,去畸變和加畸變都是在像平面上去補償二簡介視覺系統一共有四個座標系:像素平面座標系(u,v)、影像座標系(x,y)、相機座標系()與世界座標系()。每種座標系之間均有聯繫,

自動駕駛與軌跡預測看這篇就夠了!

Feb 28, 2024 pm 07:20 PM

自動駕駛與軌跡預測看這篇就夠了!

Feb 28, 2024 pm 07:20 PM

軌跡預測在自動駕駛中承擔著重要的角色,自動駕駛軌跡預測是指透過分析車輛行駛過程中的各種數據,預測車輛未來的行駛軌跡。作為自動駕駛的核心模組,軌跡預測的品質對於下游的規劃控制至關重要。軌跡預測任務技術堆疊豐富,需熟悉自動駕駛動/靜態感知、高精地圖、車道線、神經網路架構(CNN&GNN&Transformer)技能等,入門難度很高!許多粉絲期望能夠盡快上手軌跡預測,少踩坑,今天就為大家盤點下軌跡預測常見的一些問題和入門學習方法!入門相關知識1.預習的論文有沒有切入順序? A:先看survey,p

DualBEV:大幅超越BEVFormer、BEVDet4D,開卷!

Mar 21, 2024 pm 05:21 PM

DualBEV:大幅超越BEVFormer、BEVDet4D,開卷!

Mar 21, 2024 pm 05:21 PM

這篇論文探討了在自動駕駛中,從不同視角(如透視圖和鳥瞰圖)準確檢測物體的問題,特別是如何有效地從透視圖(PV)到鳥瞰圖(BEV)空間轉換特徵,這一轉換是透過視覺轉換(VT)模組實施的。現有的方法大致分為兩種策略:2D到3D和3D到2D轉換。 2D到3D的方法透過預測深度機率來提升密集的2D特徵,但深度預測的固有不確定性,尤其是在遠處區域,可能會引入不準確性。而3D到2D的方法通常使用3D查詢來採樣2D特徵,並透過Transformer學習3D和2D特徵之間對應關係的注意力權重,這增加了計算和部署的

首個多視角自動駕駛場景影片產生世界模型 | DrivingDiffusion: BEV資料與模擬新思路

Oct 23, 2023 am 11:13 AM

首個多視角自動駕駛場景影片產生世界模型 | DrivingDiffusion: BEV資料與模擬新思路

Oct 23, 2023 am 11:13 AM

作者的一些個人思考在自動駕駛領域,隨著BEV-based子任務/端到端方案的發展,高品質的多視圖訓練資料和相應的模擬場景建立愈發重要。針對當下任務的痛點,「高品質」可以解耦成三個面向:不同維度上的長尾場景:如障礙物資料中近距離的車輛以及切車過程中精準的朝向角,以及車道線資料中不同曲率的彎道或較難收集的匝道/匯入/合流等場景。這些往往靠大量的資料收集和複雜的資料探勘策略,成本高昂。 3D真值-影像的高度一致:當下的BEV資料取得往往受到感測器安裝/標定,高精地圖以及重建演算法本身的誤差影響。這導致了我

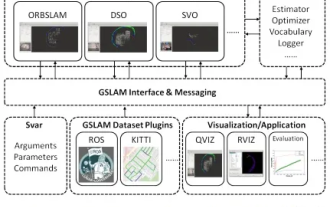

GSLAM | 一個通用的SLAM架構和基準

Oct 20, 2023 am 11:37 AM

GSLAM | 一個通用的SLAM架構和基準

Oct 20, 2023 am 11:37 AM

突然發現了一篇19年的論文GSLAM:AGeneralSLAMFrameworkandBenchmark開源程式碼:https://github.com/zdzhaoyong/GSLAM直接上全文,感受這項工作的品質吧~1摘要SLAM技術最近取得了許多成功,並吸引了高科技公司的關注。然而,如何同一現有或新興演算法的介面,一級有效地進行關於速度、穩健性和可移植性的基準測試仍然是問題。本文,提出了一個名為GSLAM的新型SLAM平台,它不僅提供評估功能,還為研究人員提供了快速開發自己的SLAM系統的有用

為大模型提供全新科學複雜問答基準與評估體系,UNSW、阿貢、芝加哥大學等多家機構共同推出SciQAG框架

Jul 25, 2024 am 06:42 AM

為大模型提供全新科學複雜問答基準與評估體系,UNSW、阿貢、芝加哥大學等多家機構共同推出SciQAG框架

Jul 25, 2024 am 06:42 AM

編輯|ScienceAI問答(QA)資料集在推動自然語言處理(NLP)研究中發揮著至關重要的作用。高品質QA資料集不僅可以用於微調模型,也可以有效評估大語言模型(LLM)的能力,尤其是針對科學知識的理解和推理能力。儘管目前已有許多科學QA數據集,涵蓋了醫學、化學、生物等領域,但這些數據集仍有一些不足之處。其一,資料形式較為單一,大多數為多項選擇題(multiple-choicequestions),它們易於進行評估,但限制了模型的答案選擇範圍,無法充分測試模型的科學問題解答能力。相比之下,開放式問答

《我的世界》化身AI小鎮,NPC居民角色扮演如同真人

Jan 02, 2024 pm 06:25 PM

《我的世界》化身AI小鎮,NPC居民角色扮演如同真人

Jan 02, 2024 pm 06:25 PM

請留意,這個方塊人正在緊鎖眉頭,思考著面前幾位「不速之客」的身份。原來她陷入了危險境地,意識到這一點後,她迅速展開腦力搜索,尋找解決問題的策略。最終,她決定先逃離現場,然後儘快尋求幫助,並立即採取行動。同時,對面的人也在進行著與她相同的思考……在《我的世界》中出現了這樣一個場景,所有的角色都由人工智慧控制。他們每個人都有著獨特的身份設定,例如之前提到的女孩就是一個年僅17歲但聰明又勇敢的快遞員。他們擁有記憶和思考能力,在這個以《我的世界》為背景的小鎮中像人類一樣生活。驅動他們的,是一款全新的、