在機器學習領域,有種說法叫做“世上沒有免費的午餐”,簡而言之,它是指沒有任何一種算法能在每個問題上都能有最好的效果,這個理論在監督學習方面體現得尤為重要。

舉個例子來說,你不能說神經網路永遠比決策樹好,反之亦然。模型運行被許多因素左右,例如資料集的大小和結構。

因此,你應該根據你的問題嘗試許多不同的演算法,同時使用資料測試集來評估效能並選出最優項。

當然,你嘗試的演算法必須和你的問題相切合,其中的門道便是機器學習的主要任務。打個比方,如果你想打掃房子,你可能會用到吸塵器、掃帚或拖把,但你絕對不會拿把鏟子開始挖坑吧。

對於渴望了解機器學習基礎知識的機器學習新人來說,這兒有份資料科學家使用的十大機器學習演算法, 為你介紹這十大演算法的特性,便於大家更好地理解和應用,快來看看。

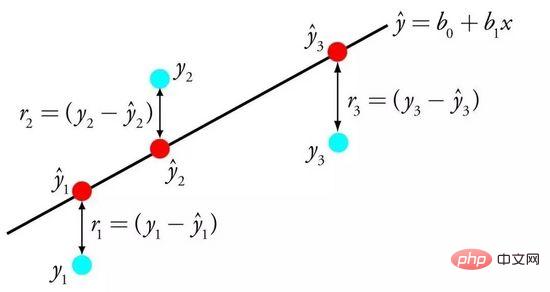

線性迴歸可能是統計和機器學習中最知名、最容易理解的演算法之一。

由於預測建模主要關注最小化模型的誤差,或以可解釋性為代價來做出最準確的預測。 我們會從許多不同領域借用、重複使用和盜用演算法,其中涉及一些統計知識。

線性迴歸以等式表示,透過找到輸入變數的特定權重(B),來描述輸入變數(x)與輸出變數(y)之間的線性關係。

Linear Regression

給定輸入x,我們將預測y,線性迴歸學習演算法的目標是找出係數B0和B1的值。

可以使用不同的技術從資料中學習線性迴歸模型,例如用於普通最小二乘和梯度下降最佳化的線性代數解。

線性迴歸已經存在了200多年,並且已經進行了廣泛的研究。 如果可能的話,使用這種技術時的一些經驗法則是去除非常相似(相關)的變數並從資料中移除雜訊。 這是一種快速簡單的技術和良好的第一種演算法。

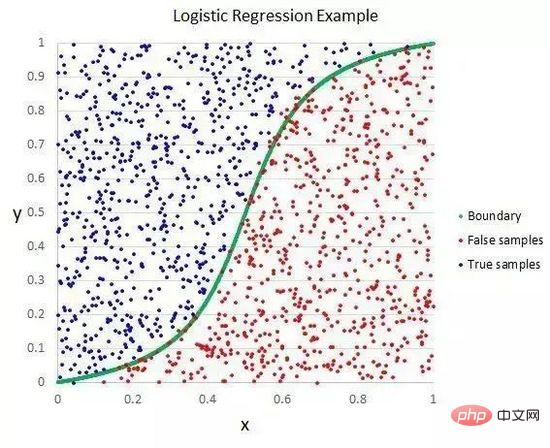

邏輯迴歸是機器學習從統計領域借鏡的另一種技術。 這是二分類問題的專用方法(兩個類別值的問題)。

邏輯迴歸與線性迴歸類似,這是因為兩者的目標都是找出每個輸入變數的權重值。 與線性迴歸不同的是,輸出的預測值得使用稱為邏輯函數的非線性函數進行轉換。

邏輯函數看起來像一個大S,並能將任何值轉換為0到1的範圍內。這很有用,因為我們可以將對應規則應用於邏輯函數的輸出上,把值分類為0和1(例如,如果IF小於0.5,那麼 輸出1)並預測類別值。

Logistic Regression

由於模型的特有學習方式,透過邏輯迴歸所做的預測也可以用來計算屬於類別0或類別1的機率。這對於需要給出許多基本原理的問題十分有用。

就像線性迴歸一樣,當你移除與輸出變數無關的屬性以及彼此非常相似(相關)的屬性時,邏輯迴歸確實會更好。 這是一個快速學習且有效處理二元分類問題的模型。

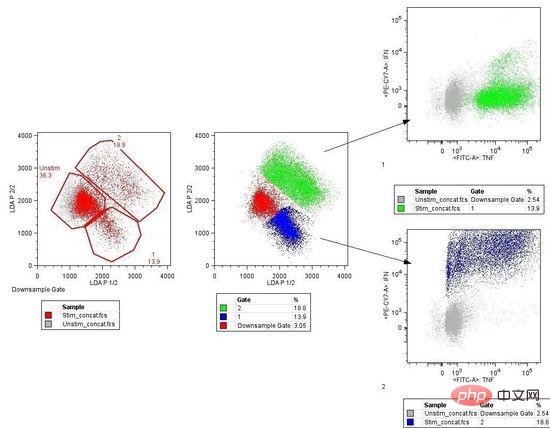

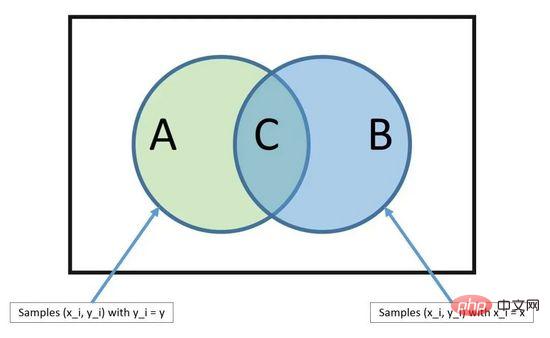

傳統的邏輯迴歸僅限於二分類問題。 如果你有兩個以上的類,那麼線性判別分析演算法(Linear Discriminant Analysis,簡稱LDA)是首選的線性分類技術。

LDA的表示非常簡單。 它由你的資料的統計屬性組成,根據每個類別進行計算。 對於單一輸入變量,這包括:

每個類別的平均值。

跨所有類別計算的變異數。

Linear Discriminant Analysis

#LDA透過計算每個類別的判別值並對具有最大值的類別進行預測來進行。此技術假定資料具有高斯分佈(鐘形曲線),因此最好先手動從資料中移除異常值。這是分類預測建模問題中的一種簡單而強大的方法。

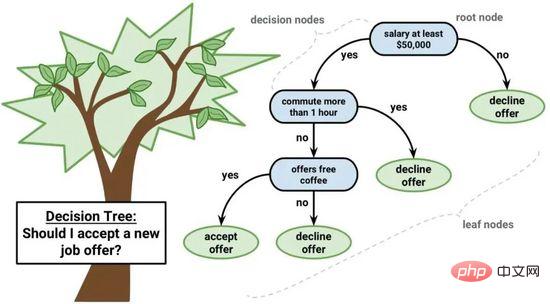

決策樹是機器學習的重要演算法。

決策樹模型可用二元樹表示。對,就是來自演算法和資料結構的二元樹,沒什麼特別。 每個節點代表單一輸入變數(x)和該變數上的左右孩子(假定變數是數字)。

Decision Tree

樹的葉節點包含用於進行預測的輸出變數(y)。 預測是透過遍歷樹進行的,當達到某一葉節點時停止,並輸出該葉節點的類別值。

決策樹學習速度快,預測速度快。 對於許多問題也經常預測準確,而且你不需要為資料做任何特殊準備。

樸素貝葉斯是一種簡單但極為強大的預測建模演算法。

模型由兩種類型的機率組成,可以直接從你的訓練資料中計算出來:1)每個類別的機率; 2)給定的每個x值的類別的條件機率。 一旦計算出來,機率模型就可以用來使用貝葉斯定理對新資料進行預測。 當你的資料是數值時,通常假設高斯分佈(鐘形曲線),以便可以輕鬆估計這些機率。

Bayes Theorem

樸素貝葉斯被稱為樸素的原因,在於它假設每個輸入變數是獨立的。 這是一個強硬的假設,對於真實數據來說是不切實際的,但該技術對於大範圍內的複雜問題仍非常有效。

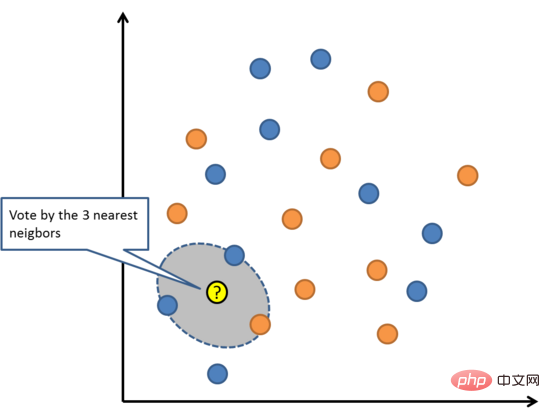

KNN演算法非常簡單且非常有效。 KNN的模型以整個訓練資料集表示。 是不是特簡單?

透過搜尋整個訓練集內K個最相似的實例(鄰居),並對這些K個實例的輸出變數進行匯總,來預測新的資料點。 對於迴歸問題,新的點可能是平均輸出變量,對於分類問題,新的點可能是眾數類別值。

成功的訣竅在於如何確定資料實例之間的相似性。如果你的屬性都是相同的比例,最簡單的方法就是使用歐幾里德距離,它可以根據每個輸入變數之間的差異直接計算。

K-Nearest Neighbors

KNN可能需要大量的記憶體或空間來儲存所有的數據,但只有在需要預測時才會執行計算(或學習)。 你也可以隨時更新和管理你的訓練集,以保持預測的準確性。

距離或緊密度的概念可能會在高維環境(大量輸入變數)下崩潰,這會對演算法造成負面影響。這類事件被稱為維度詛咒。它也暗示了你應該只使用那些與預測輸出變數最相關的輸入變數。

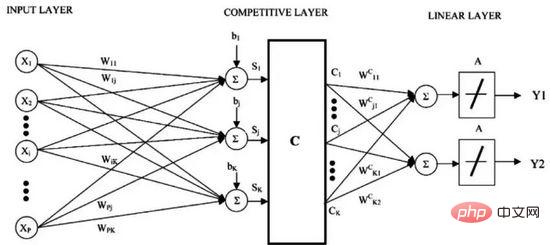

K-近鄰的缺點是你需要維持整個訓練資料集。 學習向量量化演算法(或簡稱LVQ)是一種人工神經網路演算法,讓你掛起任意訓練實例並準確地學習他們。

Learning Vector Quantization

LVQ以codebook向量的集合表示。開始時隨機選擇向量,然後多次迭代,適應訓練資料集。 在學習之後,codebook向量可以像K-近鄰一樣用來預測。 透過計算每個codebook向量與新資料實例之間的距離來找到最相似的鄰居(最佳匹配),然後返回最佳匹配單元的類別值或在回歸情況下的實際值作為預測。 如果你把資料限制在相同範圍(如0到1之間),則可以得到最佳結果。

如果你發現KNN在您的資料集上給出了很好的結果,請嘗試使用LVQ來減少儲存整個訓練資料集的記憶體需求。

支援向量機也許是最受歡迎和討論的機器學習演算法之一。

超平面是分割輸入變數空間的線。 在SVM中,會選出一個超平面以將輸入變數空間中的點依其類別(0類或1類)進行分離。在二維空間中可以將其視為一條線,所有的輸入點都可以被這條線完全分開。 SVM學習演算法就是要找出能讓超平面對類別有最佳分離的係數。

Support Vector Machine

超平面和最近的資料點之間的距離稱為邊界,有最大邊界的超平面是最佳之選。同時,只有這些離得近的資料點才會和超平面的定義和分類器的構造有關,這些點稱為支援向量,他們支援或定義超平面。在具體實踐中,我們會用到最佳化演算法來找出能最大化邊界的係數值。

SVM可能是最強大的即用分類器之一,在你的資料集上值得一試。

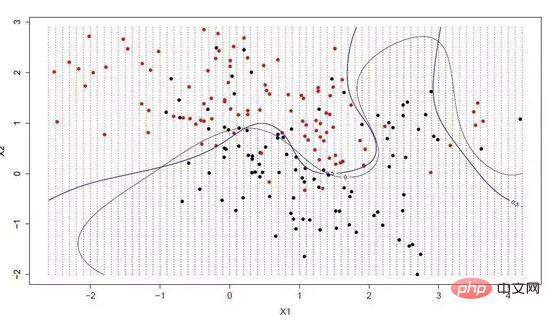

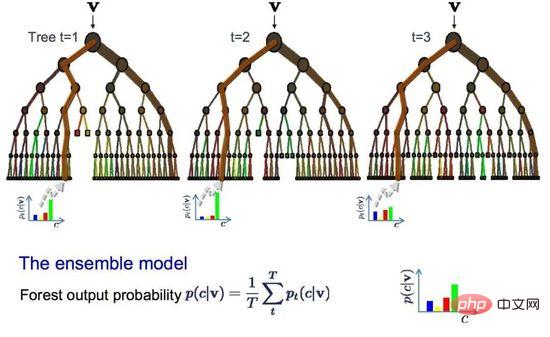

隨機森林是最受歡迎和最強大的機器學習演算法之一。 它是一種被稱為Bootstrap Aggregation或Bagging的整合機器學習演算法。

bootstrap是一種強大的統計方法,用於從資料樣本中估計某一數量,例如平均值。 它會抽取大量樣本數據,計算平均值,然後平均所有平均值,以便更準確地估算真實平均值。

在bagging中使用了相同的方法,但最常用到的是決策樹,而不是估計整個統計模型。它會訓練資料進行多重抽樣,然後為每個資料樣本建立模型。當你需要對新資料進行預測時,每個模型都會進行預測,並對預測結果進行平均,以便更好地估計真實的輸出值。

Random Forest

隨機森林是決策樹的一種調整,相對於選擇最佳分割點,隨機森林透過引入隨機性來實現次優分割。

因此,為每個資料樣本創建的模型之間的差異性會更大,但就自身意義來說依然準確無誤。結合預測結果可以更好地估計正確的潛在輸出值。

如果你使用高方差演算法(如決策樹)來獲得良好結果,那麼加上這個演算法後效果會更好。

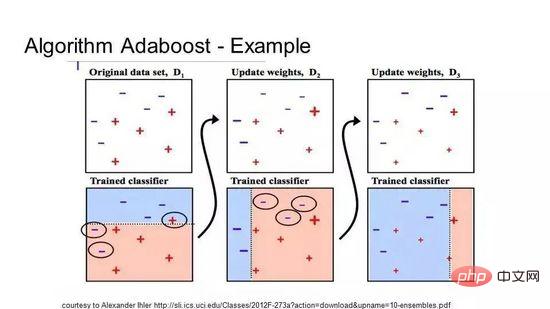

Boosting是一種從一些弱分類器中建立一個強分類器的整合技巧。 它先由訓練資料建立一個模型,然後建立第二個模型來嘗試修正第一個模型的錯誤。 不斷添加模型,直到訓練集完美預測或已經添加到數量上限。

AdaBoost是為二分類開發的第一個真正成功的Boosting演算法,同時也是理解Boosting的最佳起點。 目前基於AdaBoost而建構的演算法中最著名的就是隨機梯度boosting。

AdaBoost

AdaBoost常與短決策樹一起使用。 在創建第一棵樹之後,每個訓練實例在樹上的表現都決定了下一棵樹需要在這個訓練實例上投入多少關注。難以預測的訓練資料會被賦予更多的權重,而易於預測的實例被賦予較少的權重。 模型依序依序創建,每個模型的更新都會影響序列中下一棵樹的學習效果。在建完所有樹之後,演算法對新資料進行預測,並且透過訓練資料的準確程度來加權每棵樹的效能。

因為演算法極為注重錯誤修正,所以一個沒有異常值的整潔資料十分重要。

初學者在面對各種各樣的機器學習演算法時提出的一個典型問題是「我應該使用哪種演算法?」問題的答案取決於許多因素,其中包括:

即使是一位經驗豐富的資料科學家,在嘗試不同的演算法之前,也無法知道哪種演算法會表現最好。 雖然還有很多其他的機器學習演算法,但這些演算法是最受歡迎的演算法。 如果你是機器學習的新手,這是一個很好的學習起點。

以上是圖解最常用的十大機器學習演算法!的詳細內容。更多資訊請關注PHP中文網其他相關文章!