ICLR盲審階段就被評審讚不絕口的論文:會是Transformer架構的一大創新嗎?

尽管取得了很多显著的成就,但训练深度神经网络(DNN)的实践进展在很大程度上独立于理论依据。大多数成功的现代 DNN 依赖残差连接和归一化层的特定排列,但如何在新架构中使用这些组件的一般原则仍然未知,并且它们在现有架构中的作用也依然未能完全搞清楚。

残差架构是最流行和成功的,最初是在卷积神经网络(CNN)的背景下开发的,后来自注意力网络中产生了无处不在的 transformer 架构。残差架构之所以取得成功,一种原因是与普通 DNN 相比具有更好的信号传播能力,其中信号传播指的是几何信息通过 DNN 层的传输,并由内核函数表示。

最近,使用信号传播原则来训练更深度的 DNN 并且残差架构中没有残差连接和 / 或归一化层的参与,成为了社区感兴趣的领域。原因有两个:首先验证了残差架构有效性的信号传播假设,从而阐明对 DNN 可解释性的理解;其次这可能会实现超越残差范式的 DNN 可训练性的一般原则和方法。

对于 CNN,Xiao et al. (2018)的工作表明,通过更好初始化提升的信号传播能够高效地训练普通深度网络,尽管与残差网络比速度显著降低。Martens et al. (2021) 的工作提出了 Deep Kernel Shaping (DKS),使用激活函数转换来控制信号传播,使用 K-FAC 等强二阶优化器在 ImageNet 上实现了普通网络和残差网络的训练速度相等。Zhang et al. (2022) 的工作将 DKS 扩展到了更大类的激活函数,在泛化方面也实现了接近相等。

信号传播中需要分析的关键量是 DNN 的初始化时间内核,或者更准确地说,是无限宽度限制下的近似内核。对于多层感知机(MLP)以及使用 Delta 初始化的 CNN,该内核可以编写为仅包含 2D 函数的简单层递归,以便于进行直接分析。跨层 transformer 的内核演化更加复杂,因此 DKS 等现有方法不适用 transformer 或实际上任何包含自注意力层的架构。

在 MLP 中,信号传播是通过查看(一维)内核的行为来判断的,而 transformer 中的信号传播可以通过查看(高维)内核矩阵在网络层中的演化来判断。

该研究必须避免一种情况:对角线元素随深度增加快速增长或收缩,这与不受控制的激活范数有关,可能导致饱和损失或数值问题。避免秩崩溃(rank collapse)对于深度 transformer 的可训练性是必要的,而是否可以训练深度无残差 transformer 仍是一个悬而未决的问题。

ICLR 2023 盲审阶段的这篇论文解决了这个问题,首次证明了无需残差连接或归一化层时也可能成功训练深度 transformer。为此,他们研究了深度无残差 transformer 中的信号传播和秩崩溃问题,并推导出三种方法来阻止它们。具体而言,方法中使用了以下组合:参数初始化、偏置矩阵和位置相关的重缩放,并强调了 transformer 中信号传播特有的几种复杂性,包括与位置编码和因果掩蔽的交互。研究者实证证明了他们的方法可以生成可训练的深度无残差 transformer。

在实验部分,在 WikiText-103 和 C4 数据集上,研究者展示了使用他们主要的方法——指数信号保持注意力(Exponential Signal Preserving Attention, E-SPA),可以通过延长大约五倍的训练时间使得标准 transformer 与文中无残差 transformer 的训练损失相当。此外通过将这一方法与残差连接结合,研究者还表明无归一化层的 transformer 能够实现与标准 transformer 相当的训练速度。

论文地址:https://openreview.net/pdf?id=NPrsUQgMjKK

对于这篇论文,Google AI 首席工程师 Rohan Anil 认为是 Transformer 架构向前迈出的一大步,还是一个基础性的改进。

建構無捷徑可訓練的深層Transformer

#迄今為止,修正Transformer 秩崩潰(rank collapse)的唯一策略依賴於殘差連接,該方式跳過了自註意力層固有的可訓練性問題。與此相反,該研究直接解決這個問題。首先透過注意力層更能理解訊號傳播,然後根據見解(insights)進行修改,以在深度 transformer 中實現對忠實訊號的傳輸,無論是否使用殘差連接,都可以對訊號進行訓練。

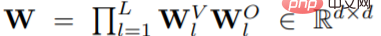

具體而言,首先,該研究對僅存在註意力的深度vanilla transformer 進行了一下簡單設置,之後他們假設該transformer 具有單一頭(h = 1)設置或具有多頭設置,其中註意力矩陣A 在不同頭之間不會變化。如果區塊l≤L 初始化時有註意力矩陣A_l,則最終區塊的表示形式為X_L:

對於上式而言,如果 和

和 採用正交初始化,那麼

採用正交初始化,那麼 就可以在初始化時正交。

就可以在初始化時正交。

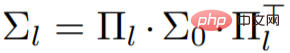

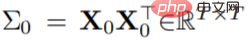

在上述假設下,如果採用 表示跨位置輸入核矩陣,經過一些簡化處理後,可以得到以下公式:

表示跨位置輸入核矩陣,經過一些簡化處理後,可以得到以下公式:

從這個簡化公式(深度僅注意力transformer 中的核矩陣)中,可以確定(A_l)_l 的三個要求:

-

#必須在每個區塊中表現良好,避免退化情況,如秩崩潰和爆炸/ 消失的對角線值;

#必須在每個區塊中表現良好,避免退化情況,如秩崩潰和爆炸/ 消失的對角線值;

- A_l 必須是元素非負∀l;

- A_l 應該是下三角∀l,以便與因果掩碼注意力相容。

在接下來的3.1 和3.2 節中,研究專注於尋找滿足上述需求的注意力矩陣,他們提出了3 種方法E-SPA、U- SPA 和Value-Skipinit,每種方法都用來控制transformer 的注意力矩陣,即使在很深的深度也能實現忠實的訊號傳播。此外,3.3 節示範如何修改 softmax 注意力以實現這些注意力矩陣。

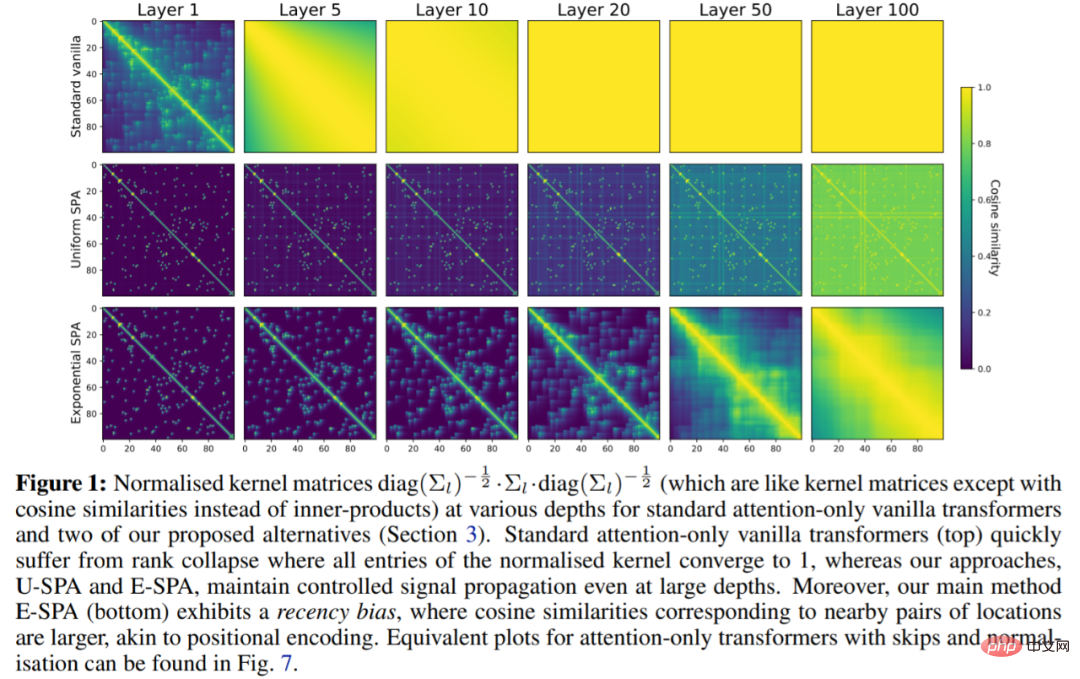

下圖中,該研究對提出的兩個SPA 方案進行了驗證,U-SPA 和E-SPA,結果顯示即使在網路較深時也能成功地避免僅注意vanilla transformers 中的秩崩潰現象。

實驗

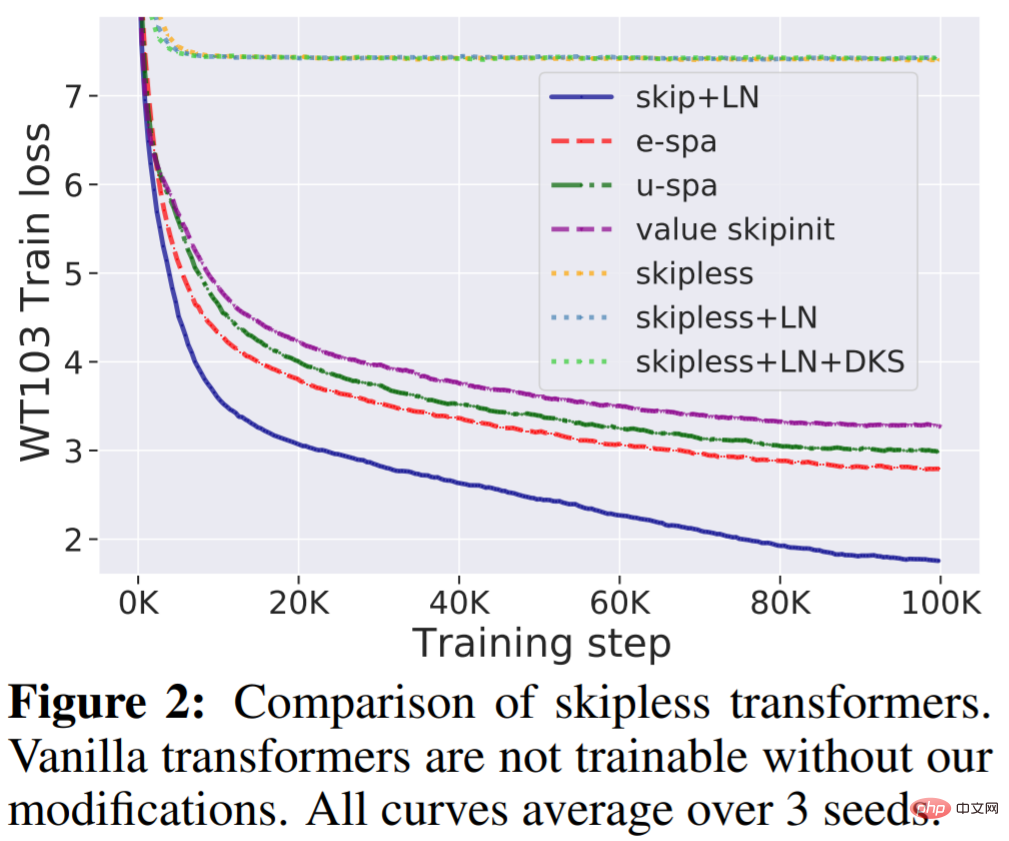

WikiText-103 基線:首先,該研究驗證了沒有殘差連接的標準深度transformer 是不可訓練的,即使它們有歸一化層(LN) 和transformed 激活,但本文的方法可以解決這個問題。如圖 2 所示,可以清楚地看到,從標準 transformer 中移除殘差連接使其不可訓練,訓練損失穩定在 7.5 左右。如圖 1 所示,標準 transformer 遭受了秩崩潰。

另一方面,研究提出的 E-SPA 方法優於 U-SPA 和 Value-Skipinit。然而,與本文無殘差方法相比,具有殘差和 LN 的預設 transformer 仍然保持訓練速度優勢。

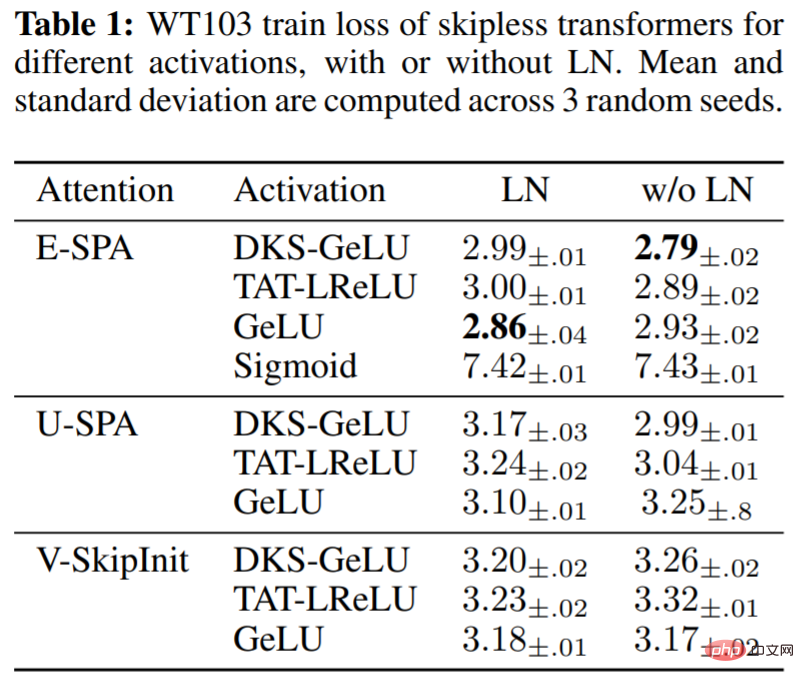

在表 1 中,研究使用提出的方法評估了 MLP 區塊中不同活化函數的影響,以及 LN 在無殘差 transformer 的使用。可以看到在深度為 36 處,本文方法針對一系列激活實現了良好的訓練性能:DKS-transformed GeLU、TAT-transformed Leaky ReLU 以及 untransformed GeLU ,但不是 untransformed Sigmoid。透過實驗也看到,層歸一化對於訓練速度而言相對不重要,甚至在使用 SPA 時對 transformed activation 的活化有害,因為 SPA 已經具有控制激活規範的內建機制。

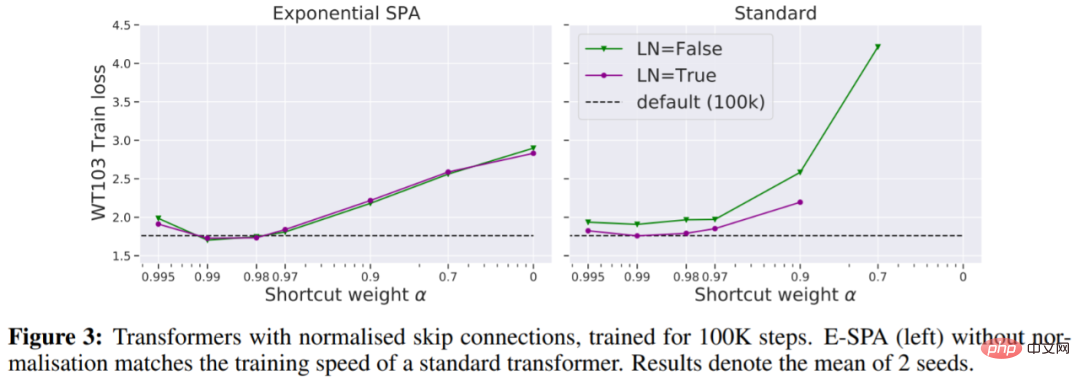

在圖3 中,我們看到一個不需要更多迭代就能匹配預設transformer 訓練損失的方法是使用歸一化殘差連接。

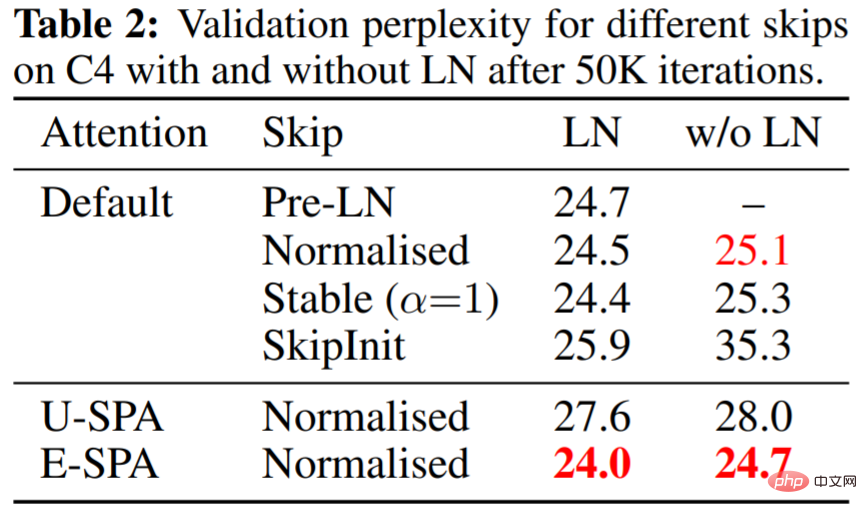

表 2 顯示有歸一化殘差和 LN 的 E-SPA 優於預設的 PreLN transformer。

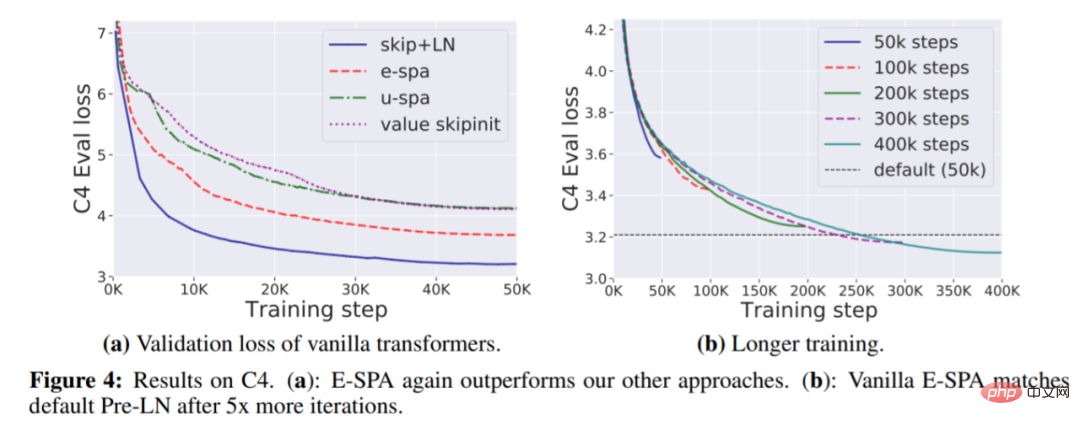

下圖4(a)顯示E-SPA 再次優於其他方法;4(b)顯示訓練損失差距可以透過簡單地增加訓練時間來消除。

以上是ICLR盲審階段就被評審讚不絕口的論文:會是Transformer架構的一大創新嗎?的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

熱門話題

開源!超越ZoeDepth! DepthFM:快速且精確的單目深度估計!

Apr 03, 2024 pm 12:04 PM

開源!超越ZoeDepth! DepthFM:快速且精確的單目深度估計!

Apr 03, 2024 pm 12:04 PM

0.這篇文章乾了啥?提出了DepthFM:一個多功能且快速的最先進的生成式單目深度估計模型。除了傳統的深度估計任務外,DepthFM還展示了在深度修復等下游任務中的最先進能力。 DepthFM效率高,可以在少數推理步驟內合成深度圖。以下一起來閱讀這項工作~1.論文資訊標題:DepthFM:FastMonocularDepthEstimationwithFlowMatching作者:MingGui,JohannesS.Fischer,UlrichPrestel,PingchuanMa,Dmytr

拋棄編碼器-解碼器架構,用擴散模型做邊緣偵測效果更好,國防科大提出DiffusionEdge

Feb 07, 2024 pm 10:12 PM

拋棄編碼器-解碼器架構,用擴散模型做邊緣偵測效果更好,國防科大提出DiffusionEdge

Feb 07, 2024 pm 10:12 PM

目前的深度邊緣檢測網路通常採用編碼器-解碼器架構,其中包含上下採樣模組,以更好地提取多層次的特性。然而,這種結構限制了網路輸出準確且細緻的邊緣檢測結果。針對這個問題,一篇AAAI2024的論文給了新的解決方案。論文題目:DiffusionEdge:DiffusionProbabilisticModelforCrispEdgeDetection作者:葉雲帆(國防科技大學),徐凱(國防科技大學),黃雨行(國防科技大學),易任嬌(國防科技大學),蔡志平(國防科技大學)論文連結:https ://ar

通義千問再開源,Qwen1.5帶來六種體量模型,表現超越GPT3.5

Feb 07, 2024 pm 10:15 PM

通義千問再開源,Qwen1.5帶來六種體量模型,表現超越GPT3.5

Feb 07, 2024 pm 10:15 PM

趕在春節前,通義千問大模型(Qwen)的1.5版上線了。今天上午,新版本的消息引發了AI社群關注。新版大機型包括六個型號尺寸:0.5B、1.8B、4B、7B、14B和72B。其中,最強版本的效能超越了GPT3.5和Mistral-Medium。此版本包含Base模型和Chat模型,並提供多語言支援。阿里通義千問團隊表示,相關技術也已經上線到了通義千問官網和通義千問App。除此之外,今天Qwen1.5的發布還有以下一些重點:支援32K上下文長度;開放了Base+Chat模型的checkpoint;

大模型也能切片,微軟SliceGPT讓LLAMA-2運算效率大增

Jan 31, 2024 am 11:39 AM

大模型也能切片,微軟SliceGPT讓LLAMA-2運算效率大增

Jan 31, 2024 am 11:39 AM

大型語言模型(LLM)通常擁有數十億參數,經過數萬億token的資料訓練。然而,這樣的模型訓練和部署成本都非常昂貴。為了降低運算需求,人們常常採用各種模型壓縮技術。這些模型壓縮技術一般可分為四類:蒸餾、張量分解(包括低秩因式分解)、剪枝、量化。剪枝方法已經存在一段時間,但許多方法需要在剪枝後進行恢復微調(RFT)以保持性能,這使得整個過程成本高昂且難以擴展。蘇黎世聯邦理工學院和微軟的研究者提出了一個解決這個問題的方法,名為SliceGPT。此方法的核心思想是透過刪除權重矩陣中的行和列來降低網路的嵌

你好,電動Atlas!波士頓動力機器人復活,180度詭異動作嚇到馬斯克

Apr 18, 2024 pm 07:58 PM

你好,電動Atlas!波士頓動力機器人復活,180度詭異動作嚇到馬斯克

Apr 18, 2024 pm 07:58 PM

波士頓動力Atlas,正式進入電動機器人時代!昨天,液壓Atlas剛「含淚」退出歷史舞台,今天波士頓動力就宣布:電動Atlas上崗。看來,在商用人形機器人領域,波士頓動力是下定決心要跟特斯拉硬剛一把了。新影片放出後,短短十幾小時內,就已經有一百多萬觀看。舊人離去,新角色登場,這是歷史的必然。毫無疑問,今年是人形機器人的爆發年。網友銳評:機器人的進步,讓今年看起來像人類的開幕式動作、自由度遠超人類,但這真不是恐怖片?影片一開始,Atlas平靜地躺在地上,看起來應該是仰面朝天。接下來,讓人驚掉下巴

更新版 Point Transformer:更有效率、更快速、更強大!

Jan 17, 2024 am 08:27 AM

更新版 Point Transformer:更有效率、更快速、更強大!

Jan 17, 2024 am 08:27 AM

原標題:PointTransformerV3:Simpler,Faster,Stronger論文連結:https://arxiv.org/pdf/2312.10035.pdf程式碼連結:https://github.com/Pointcept/PointTransformerV3作者單位:HKUSHAILabMPIPKUMIT論文想法:本文無意在注意力機制內尋求創新。相反,它側重於利用規模(scale)的力量,克服點雲處理背景下準確性和效率之間現有的權衡。從3D大規模表示學習的最新進展中汲取靈感,

快手版Sora「可靈」開放測試:生成超120s視頻,更懂物理,複雜運動也能精準建模

Jun 11, 2024 am 09:51 AM

快手版Sora「可靈」開放測試:生成超120s視頻,更懂物理,複雜運動也能精準建模

Jun 11, 2024 am 09:51 AM

什麼?瘋狂動物城被國產AI搬進現實了?與影片一同曝光的,是一款名為「可靈」全新國產影片生成大模型。 Sora利用了相似的技術路線,結合多項自研技術創新,生產的影片不僅運動幅度大且合理,還能模擬物理世界特性,具備強大的概念組合能力與想像。數據上看,可靈支持生成長達2分鐘的30fps的超長視頻,分辨率高達1080p,且支援多種寬高比。另外再劃個重點,可靈不是實驗室放出的Demo或影片結果演示,而是短影片領域頭部玩家快手推出的產品級應用。而且主打一個務實,不開空頭支票、發布即上線,可靈大模型已在快影

追趕Gemini Pro,提升推理、OCR能力的LLaVA-1.6太強了

Feb 01, 2024 pm 04:51 PM

追趕Gemini Pro,提升推理、OCR能力的LLaVA-1.6太強了

Feb 01, 2024 pm 04:51 PM

在去年4月,威斯康辛大學麥迪遜分校、微軟研究院和哥倫比亞大學的研究者們共同發布了LLaVA(LargeLanguageandVisionAssistant)。儘管LLaVA只是用一個小的多模態指令資料集進行訓練,但在一些樣本上展現了與GPT-4非常相似的推理結果。然後在10月,他們推出了LLaVA-1.5,透過對原始LLaVA進行簡單修改,在11個基準測試中刷新了SOTA。這次升級的結果非常令人振奮,為多模態AI助理領域帶來了新的突破。研究團隊宣布推出LLaVA-1.6版本,針對推理、OCR和