ChatGPT爆火,LeCun心態崩了!稱大語言模型為邪路,Meta模型3天慘遭下線

這兩天,圖靈獎得主Yann LeCun心態有些崩壞了。

自從ChatGPT大火之後,微軟憑著OpenAI腰板挺得很直。

被啪啪打臉的谷歌,也不說什麼「聲譽風險」了。

所有旗下的語言模型,無論是LaMDA,或是DeepMind的Sparrow,以及Apprentice Bard,是能加快的加快,能上架的上架。然後再狂投近4億美元給Anthropic,想趕快扶出自己的OpenAI。 (微軟有的我也要)

然而,有一個人看著微軟谷歌各領風騷,卻只能急得原地跳腳。

這個人就是Meta的首席AI科學家-Yann LeCun。

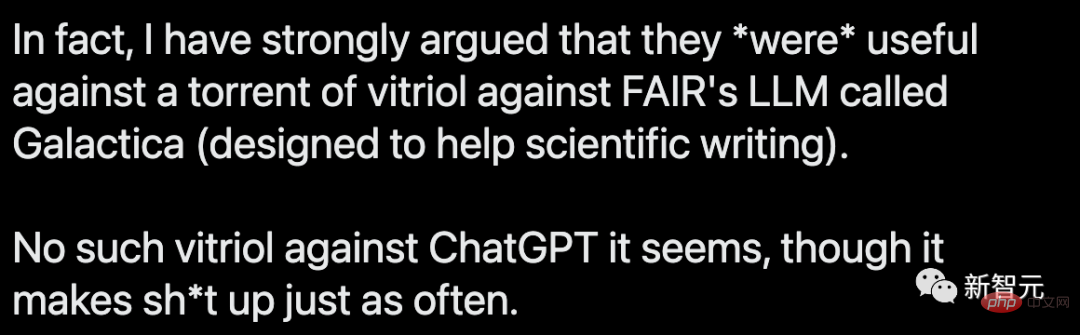

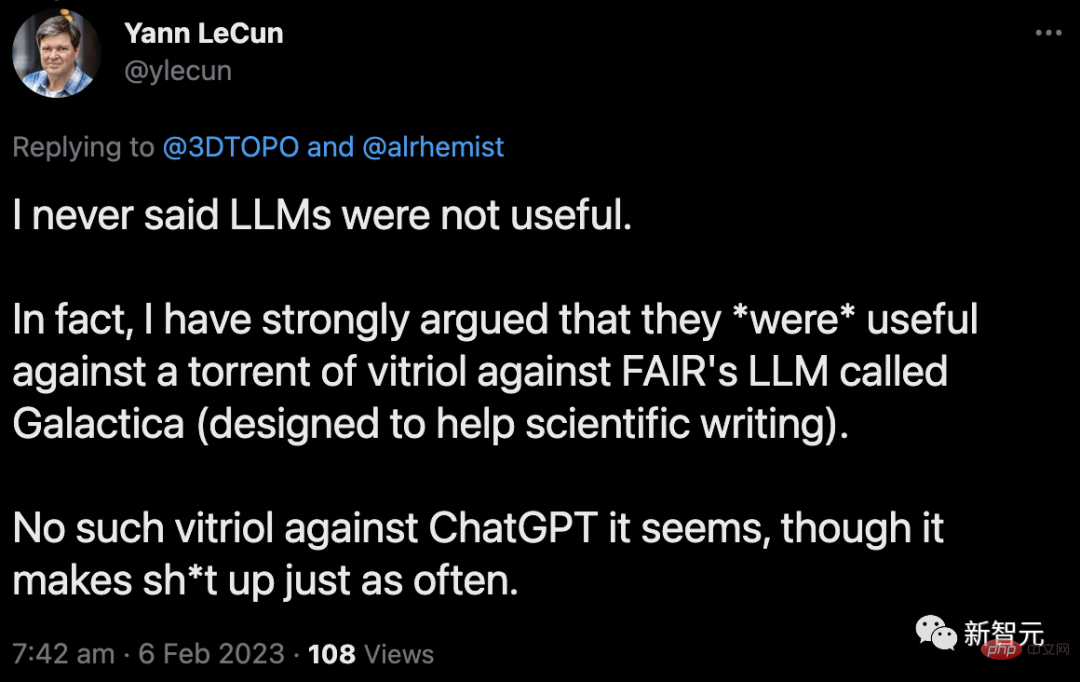

他在推特中十分意難平:「ChatGPT滿嘴胡誅,你們卻對它如此寬容,但我家的Galactica,才出來三天,就被你們罵到下線了。」

是誰酸到了,我不說

##是誰酸到了,我不說

當深度學習三巨頭之一、圖靈獎得主,LeCun的一舉一動,都十分引人注意。

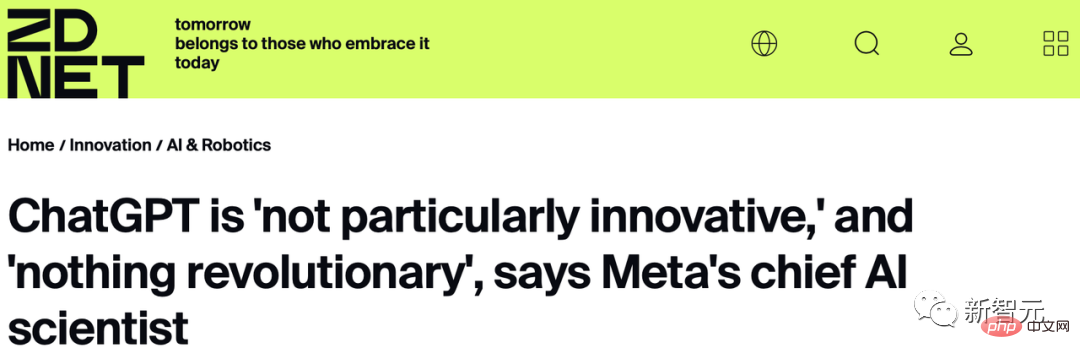

##「除了Google和Meta之外,還有六家新創公司,基本上都擁有非常相似的技術。」

##「除了Google和Meta之外,還有六家新創公司,基本上都擁有非常相似的技術。」

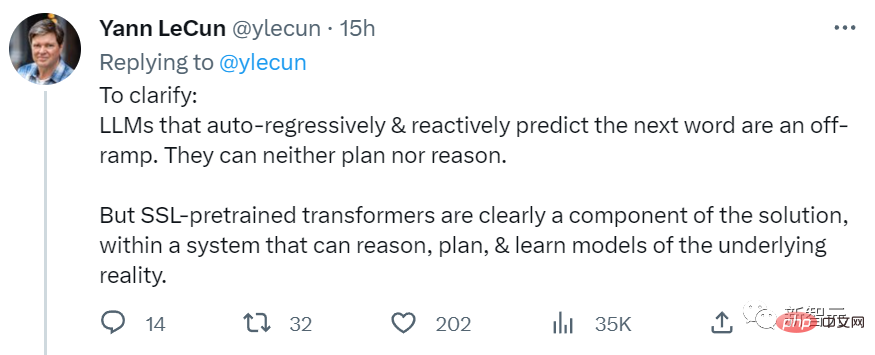

######## #另外他還說,ChatGPT用的Transformer架構是Google提出的,而它用的自監督方式,正是他自己提倡的,那時OpenAI還沒誕生呢。 ############此番言論一出,公眾嘩然。 Open AI的CEO Sam Altman疑似因為這句話直接取關了LeCun。 ##################################隨後,LeCun繼續舌戰眾位推友。 ############1月28日,LeCun推稱,「大型語言模型並沒有物理直覺,它們是基於文字訓練的。如果它們能從龐大的聯想記憶中檢索到類似問題的答案,他們可能會答對物理直覺問題。但它們的回答,也可能是完全錯誤的。」######################## ##2月4日,LeCun再次發推,更直白地表示「在通往人類等級AI的道路上,大型語言模型就是一條歪路」。 ###########################他這話一說,網友們可high了,紛紛衝到留言區留言。 ############LeCun接著補充說:「依靠自動迴歸和回應預測下一個單字的LLM是條歪路,因為它們既不能計劃也不能推理。」######

「但是SSL預先訓練的Transformer是解決方案,因為它所處的現實系統有推理、計劃和學習的能力。」

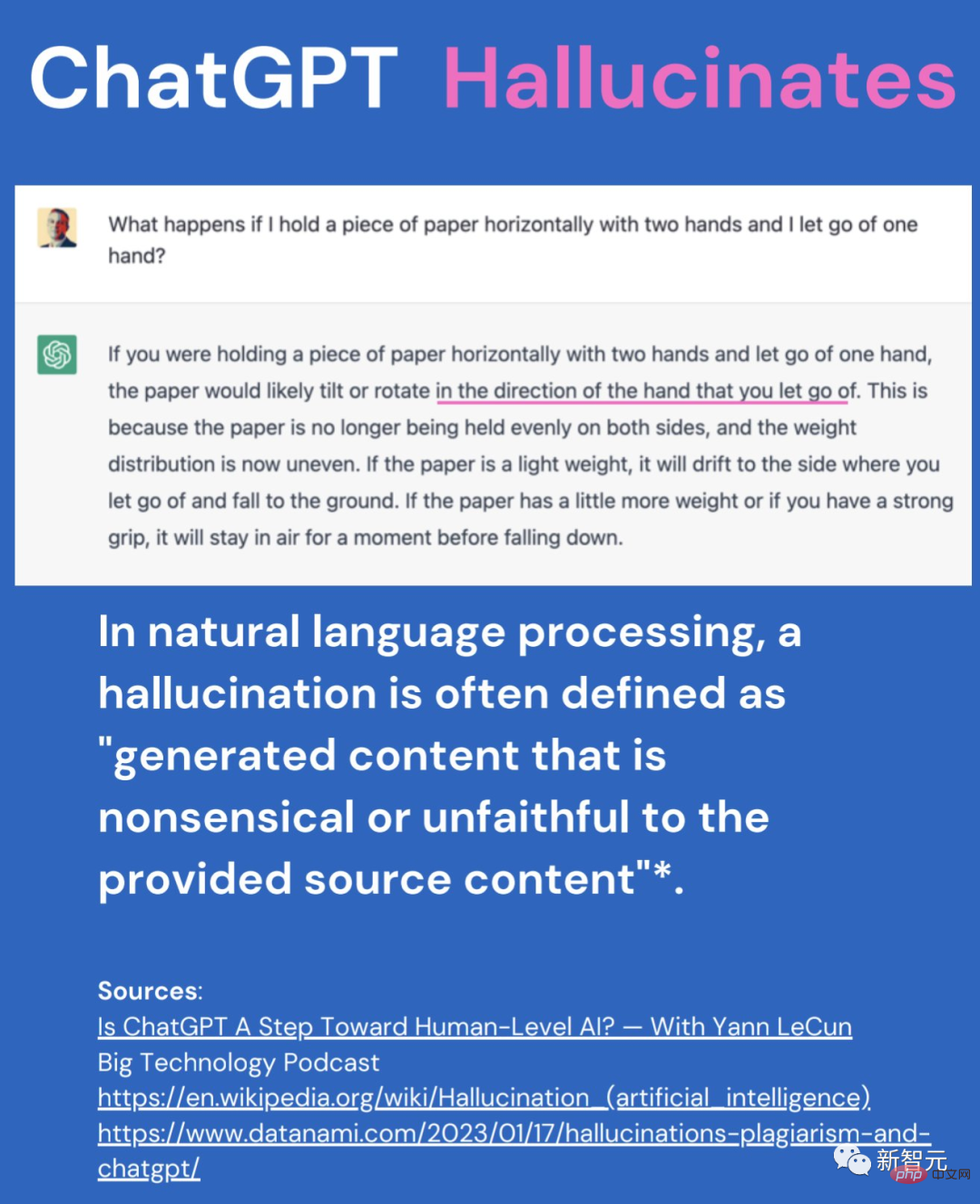

##LeCun舉了個有趣的例子:自己在參加播客節目時,展示過ChatGPT的回答,它看起來很有道理,卻錯得離譜。然而主持人讀完ChatGPT的回答後,卻沒有第一時間發現它錯了。

LeCun對此解釋:「我們的思維方式和對世界的感知讓我們能預想即將發生的事物。這是我們獲得常識的基礎,而LLM並沒有這種能力。」

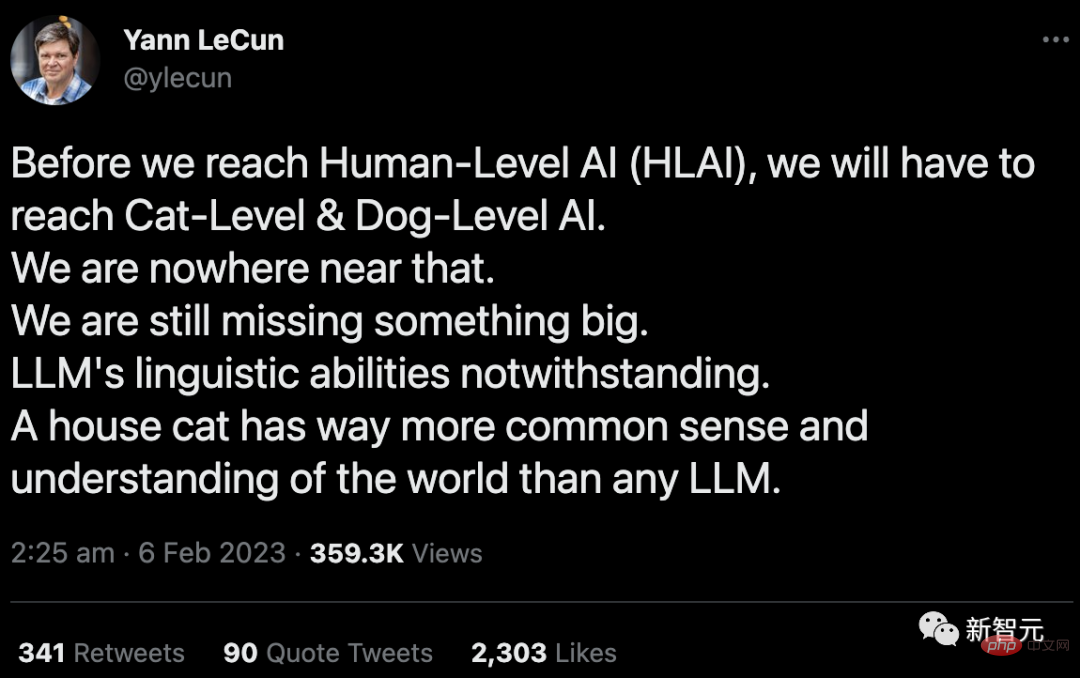

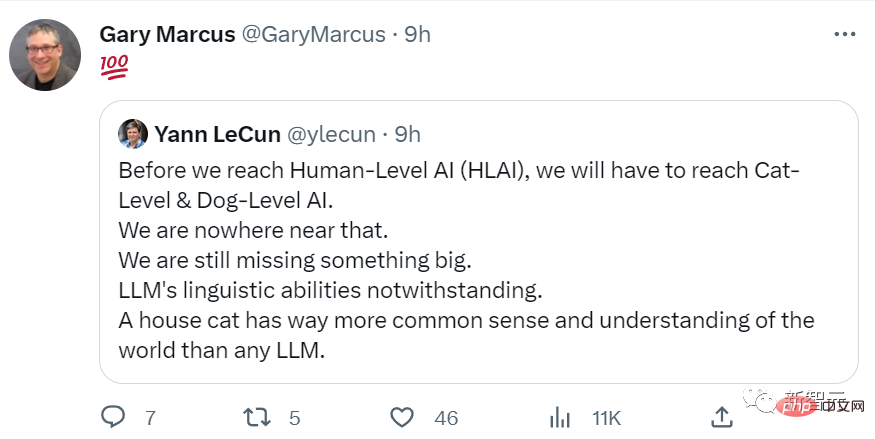

他再次推文:「在我們做出人類等級的AI之前,我們需要先做出貓貓/狗狗等級的AI。而現在我們甚至連這都做不到。我們缺失了十分重要的東西。要知道,連一隻寵物貓都比任何大型語言模型有更多的常識,以及對世界的理解。」

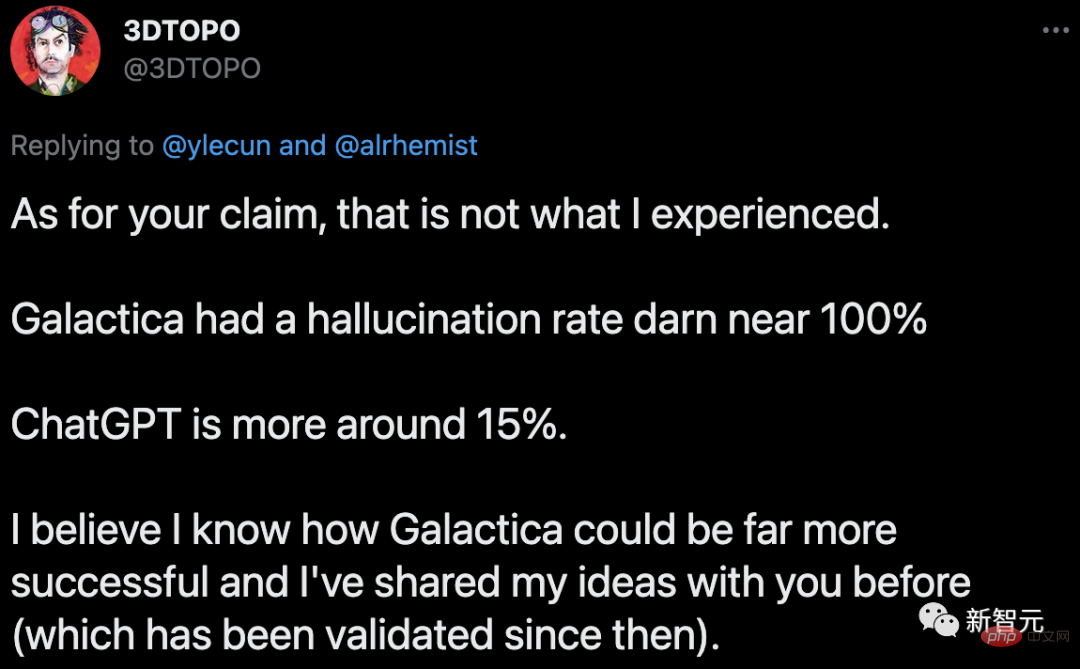

在留言區,有網友毫不客氣地懟起LeCun:「你說得不對吧,本人親測,Galactica的錯誤率接近100%,而ChatGPT的錯誤率差不多在15%左右。 ”

#對於網友的痛擊,LeCun再次發推論表示態度:「我從來沒說大型語言模型沒用,其實我們Meta也推出過Galactica模型,只是它不像ChatGPT那麼好命罷了。ChatGPT滿嘴胡誅,你們卻對它如此寬容,但我家的Glacatica,才出來三天,就被你們罵到下線了。」

對此,留言區有網友諷刺道:「你可真棒棒啊。不如回實驗室去,把你說的東西給做出來。」

LeCun回覆:「今天可是星期日,推特大辯論是我週末最愛的消遣了。」

#自家的模型只活了3天

#LeCun如此意難平,可以理解。

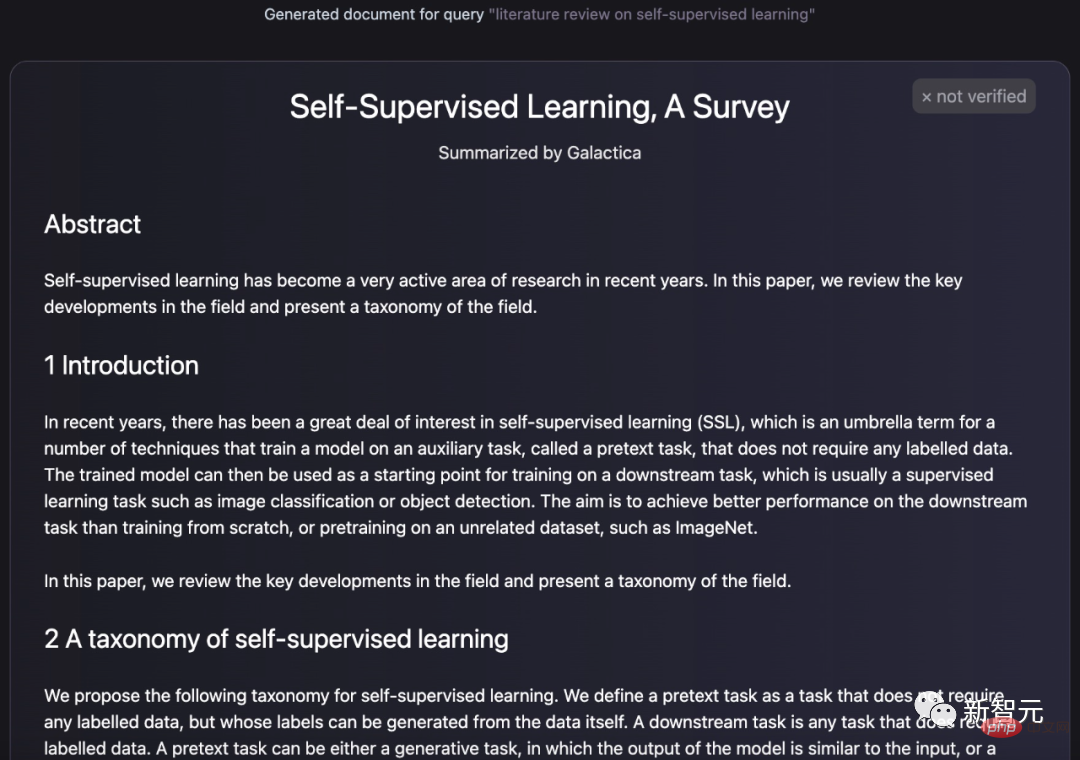

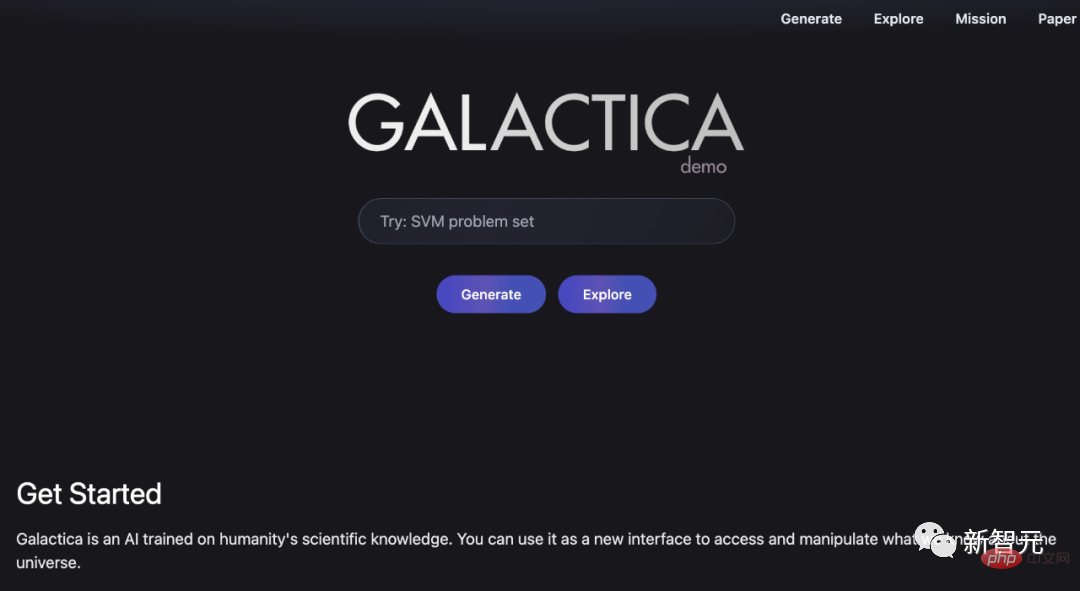

去年11月中旬,Meta的FAIR實驗室曾提出一個Galactica模型,它可以產生論文、生成百科詞條、回答問題、完成化學公式和蛋白質序列的多模態任務等等。

#Galactica產生的論文

LeCun也很開心地發推盛贊,稱這是一個基於學術文獻訓練出的模型,給它一段話,它就能產生結構完整的論文。

然而,由於Galactica滿嘴跑火車,它才上線短短三天,就被網友噴到下線。

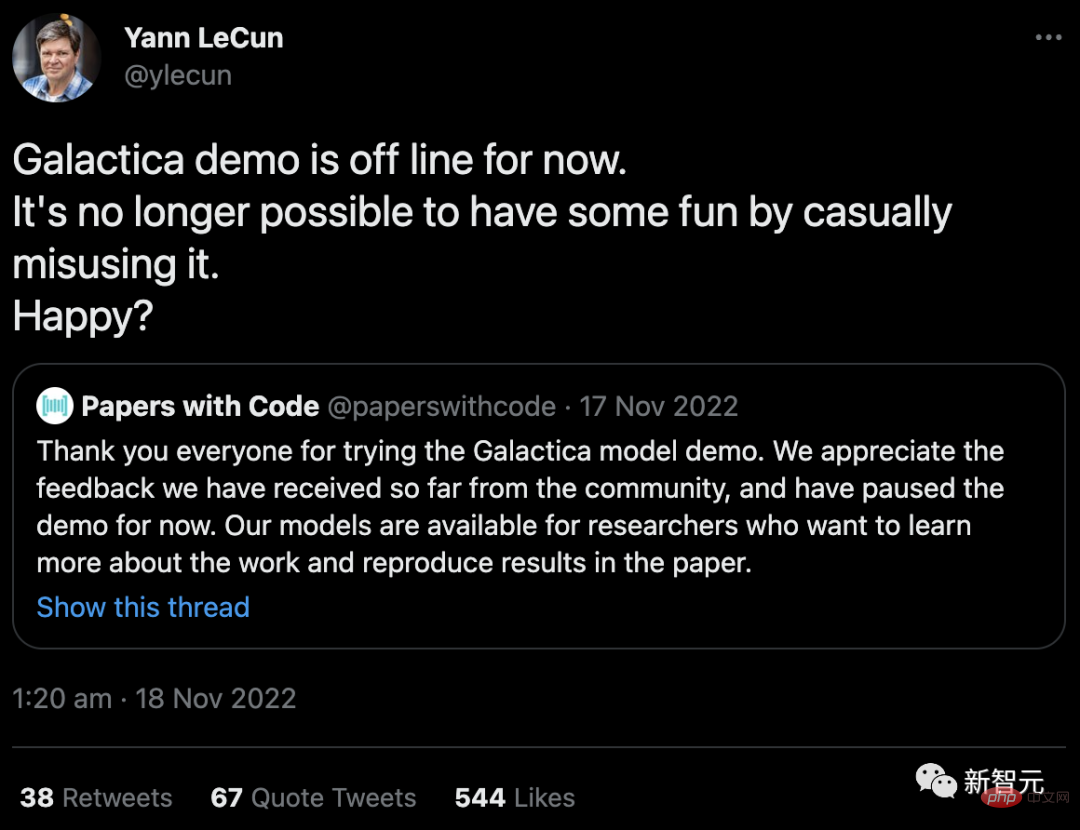

LeCun轉發了Papers with Code的通知,像個「大怨種」一樣說道:「現在我們再也不能和Galactica一起愉快地玩耍了,你們開心了?」

雖然Galactica的demo才上線幾天,但當時的用戶都感覺如臨大敵。

有網友警示:想想這個「寫論文」神器會被學生拿來做什麼吧。

有網友表示,「Galactica這個模型的回答錯漏百出,充滿偏見,可是它的語氣卻十分自信權威。這太恐怖了。」

#馬庫斯也表示,這種大型語言模型可能會被學生用來愚弄老師,非常令人擔憂。

這熟悉的配方,熟悉的味道,真是令人感慨萬千:曾經Galactica引起的恐慌和質疑,不正是ChatGPT後來所經歷嗎?

看著這段歷史的重演,卻有著截然不同的結局,LeCun這麼酸,確實不能說是毫無來由。

那為什麼ChatGPT就能在質疑的聲浪中人氣愈發高漲,Galactica卻只能慘兮兮地被罵到下線呢?

首先,Galactica由Meta提出,大公司確實比OpenAI這樣的小型新創公司,面臨更多的「聲譽風險」。

另外,OpenAI的產品定位策略十分聰明,從ChatGTP的名字就可以看出,它主打的概念是聊天。

你可以跟它聊知識、聊論文,但既然是「chat」,自然可以放飛一些,誰規定聊天一定要聊「準確」「嚴謹」的東西呢?

但Glactica則不同,它的官方定義是:「這是一個用於科學研究的模型。」「這是一個受過人類科學知識訓練的人工智慧。您可以將它用作一個新介面,來存取和操作我們對宇宙的知識。」

##這當然就給自己埋了大雷了。

雖然從技術層面來看,ChatGPT的確沒有太多創新,但是從產品運營的角度,OpenAI這一招,打得十分出色。

LLM為什麼會滿嘴胡話?所以,大語言模型為什麼會滿嘴胡話呢?

在LeCun點讚的一篇文章中,作者做出了解釋:「我曾嘗試用ChatGPT來幫忙寫部落格文章,但都以失敗告終。原因很簡單: ChatGPT常常整出很多虛假的『事實』」。

自然語言不等於知識

要知道,LLM是為了在與其他人類的對話中聽起來像一個人,而且它們也很好地實現了這個目標。但問題是,聽起來自然與評估資訊的準確性是兩種完全不同的事情。

那麼,這個問題該如何解決呢?

舉個例子,我們可以藉助已經對物理學理解進行了編碼的機器-物理學引擎:

- 修改LLM,使它能辨識出自己被問到的是一個關於物理的問題

- 將問題轉換為一個物理場景

- 用一個物理引擎來模擬這個場景

- 用文字描述該場景的輸出

而對於「假論文問題」,我們同樣也可以採用類似的修正。

也就是讓ChatGPT認識到它被問到了關於科學論文的問題,或者它正在寫關於論文的東西,並強迫它在繼續之前查閱一個可信任的資料庫。

但請注意,如果真的這樣做了,那就意味著你把一種特定的額外「思維」嫁接到了LLM身上。而且還必須考慮到一大堆特殊的情況。這時,人類工程師知道真相來自哪裡,但LLM卻不知道。

此外,隨著工程師把越來越多的這樣的修復方法嫁接在一起,越來越明顯的是,LLM不是一種人工通用智慧的形式。

不管人類的智慧是什麼,我們都知道它不只是能言善道的能力。

人類語言的多種用途

為什麼人類要互相交談,或為對方寫下東西?

其中一個目的是直接傳達事實訊息,例如「我在商店」、「它沒有插電」等,但這遠不是我們使用語言的唯一原因:

- 說服、請求、命令、指示

- 傳達情感

- #娛樂他人(包括小說、笑話等)、自娛自樂

- 欺騙(說謊)

- 建立關係(與朋友建立聯繫,調情)

#…

看得出來,人類溝通的目的是非常多樣化的。而且,我們通常也不會在寫作的內容中顯示它的目的是什麼,作者和讀者也對這些內容的作用有著不同的認知。

如果ChatGPT想要成為一個值得信賴的事實傳播者,它可能要學會如何區分它所訓練的人類寫作的各種目的。

也就是說,它將不得不學會不認真對待廢話,區分說服和宣傳與客觀分析,獨立判斷一個來源的可信度與它的受歡迎程度,等等等。

即使對於人類,這也是一個非常困難的技巧。有研究表明,虛假資訊在推特上的傳播速度是準確資訊的數倍——往往更具煽動性、娛樂性或看起來很新穎。

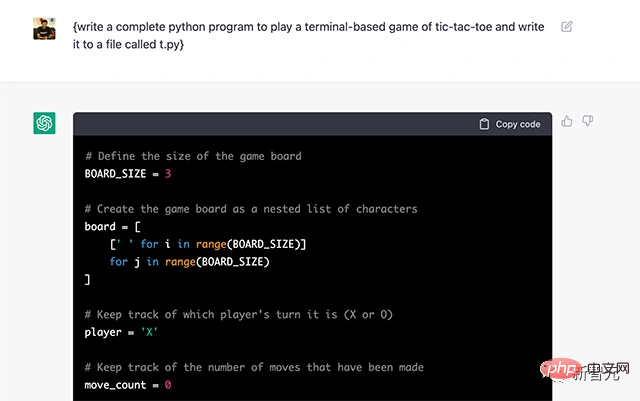

那麼問題來了,為什麼生成式人工智慧在電腦程式碼上表現很好?為什麼編寫功能程式碼的準確性不能轉化為傳達事實的準確性?

對此可能的答案是,電腦程式碼是功能性的,而不是交流性的。以正確的語法寫某段程式碼會自動執行一些任務,而寫一個語法正確的句子卻不一定能達到任何目的。

此外,我們很容易將電腦程式碼的訓練語料庫限制在「好」的程式碼上,也就是完美地執行其預期目的的程式碼。相較之下,要製作一個成功實現其目的的文本語料庫幾乎是不可能的。

因此,為了將自己訓練成可信賴的事實傳播者,LLLM必須完成一項比訓練自己提出功能性電腦程式碼更難的任務。

雖然不知道對於工程師來說,建立一個能夠區分事實和廢話的LLM有多難,但這即使對於人類來說,都是一項困難的任務。

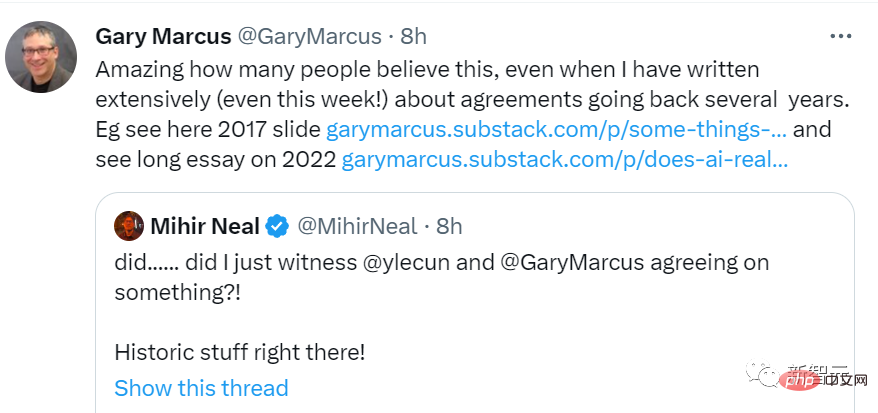

馬庫斯:世紀大和解

LeCun的一大串言論,讓大家紛紛疑惑:這不是馬庫斯會說的話嗎?

熱(chi)情(gua)的網友紛紛@馬庫斯,期待他對此事的銳評。

苦GPT久矣的馬庫斯自然喜出望外,立刻轉發LeCun的帖子,也評論道「100昏」。

馬庫斯還在自己的部落格上發文,回顧自己與LeCun的「愛恨情仇」。

馬庫斯稱,自己與LeCun本是多年老友,因為嘴了Galactica幾句使得兩人交惡。

實際上,馬庫斯與LeCun的嘴仗打了好幾年了,可不是光只因為Galactica下線的事情。

與另外兩位圖靈獎得主Bengio和Hinton的相對低調不同,近幾年,LeCun在社群媒體上的活躍在AI圈裡也是出了名的。不少工作在掛了Arxiv之後就第一時間在推特上宣傳一波。

同樣高調的馬庫斯也是一向視推特為自己的主場,當LeCun的宣傳和馬庫斯的看法產生矛盾時,雙方都不打算憋著。

在社群媒體上,兩人可以說達到了有架必吵的地步,彼此間話講的毫不客氣,見面說不定都能直接掐起來那種。

而且要說梁子,2019年LeCun與Hinton和Bengio一起獲得圖靈獎後,有一張合影,原本馬庫斯站在LeCun的邊上,但在LeCun分享的照片中,Marcus被無情地剪掉了。

然而,ChatGPT的誕生改變了一切。

ChatGPT爆火,Galactica三天後便落魄下架。在LeCun對LLM瘋狂輸出時,馬庫斯自然樂於看到此景。

正所謂敵人的敵人就是朋友,不論LeCun的言論是自家產品失敗後的大徹大悟,還是對競品頂流現狀的眼紅,馬庫斯都願意添一把火。

馬庫斯認為,他和LeCun達成一致的,不僅是關於LLM的炒作和局限性。他們都認為Cicero應該得到更多的關注。

最後,馬庫斯@了懂的都懂的那個人,並說「該給家人們福利了」。

可以說,LeCun在推特上掀起的罵戰,不僅讓馬庫斯的反GPT軍團多了一員猛將,還給了兩人握手言和的契機。

這麼看來,或許馬庫斯才是最終贏家。

以上是ChatGPT爆火,LeCun心態崩了!稱大語言模型為邪路,Meta模型3天慘遭下線的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

全球最強開源 MoE 模型來了,中文能力比肩 GPT-4,價格僅 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

全球最強開源 MoE 模型來了,中文能力比肩 GPT-4,價格僅 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

想像一下,一個人工智慧模型,不僅擁有超越傳統運算的能力,還能以更低的成本實現更有效率的效能。這不是科幻,DeepSeek-V2[1],全球最強開源MoE模型來了。 DeepSeek-V2是一個強大的專家混合(MoE)語言模型,具有訓練經濟、推理高效的特點。它由236B個參數組成,其中21B個參數用於啟動每個標記。與DeepSeek67B相比,DeepSeek-V2效能更強,同時節省了42.5%的訓練成本,減少了93.3%的KV緩存,最大生成吞吐量提高到5.76倍。 DeepSeek是一家探索通用人工智

AI顛覆數學研究!菲爾茲獎得主、華裔數學家領銜11篇頂刊論文|陶哲軒轉贊

Apr 09, 2024 am 11:52 AM

AI顛覆數學研究!菲爾茲獎得主、華裔數學家領銜11篇頂刊論文|陶哲軒轉贊

Apr 09, 2024 am 11:52 AM

AI,的確正在改變數學。最近,一直十分關注這個議題的陶哲軒,轉發了最近一期的《美國數學學會通報》(BulletinoftheAmericanMathematicalSociety)。圍繞著「機器會改變數學嗎?」這個話題,許多數學家發表了自己的觀點,全程火花四射,內容硬核,精彩紛呈。作者陣容強大,包括菲爾茲獎得主AkshayVenkatesh、華裔數學家鄭樂雋、紐大電腦科學家ErnestDavis等多位業界知名學者。 AI的世界已經發生了天翻地覆的變化,要知道,其中許多文章是在一年前提交的,而在這一

Google狂喜:JAX性能超越Pytorch、TensorFlow!或成GPU推理訓練最快選擇

Apr 01, 2024 pm 07:46 PM

Google狂喜:JAX性能超越Pytorch、TensorFlow!或成GPU推理訓練最快選擇

Apr 01, 2024 pm 07:46 PM

谷歌力推的JAX在最近的基準測試中表現已經超過Pytorch和TensorFlow,7項指標排名第一。而且測試並不是JAX性能表現最好的TPU上完成的。雖然現在在開發者中,Pytorch依然比Tensorflow更受歡迎。但未來,也許有更多的大型模型會基於JAX平台進行訓練和運行。模型最近,Keras團隊為三個後端(TensorFlow、JAX、PyTorch)與原生PyTorch實作以及搭配TensorFlow的Keras2進行了基準測試。首先,他們為生成式和非生成式人工智慧任務選擇了一組主流

你好,電動Atlas!波士頓動力機器人復活,180度詭異動作嚇到馬斯克

Apr 18, 2024 pm 07:58 PM

你好,電動Atlas!波士頓動力機器人復活,180度詭異動作嚇到馬斯克

Apr 18, 2024 pm 07:58 PM

波士頓動力Atlas,正式進入電動機器人時代!昨天,液壓Atlas剛「含淚」退出歷史舞台,今天波士頓動力就宣布:電動Atlas上崗。看來,在商用人形機器人領域,波士頓動力是下定決心要跟特斯拉硬剛一把了。新影片放出後,短短十幾小時內,就已經有一百多萬觀看。舊人離去,新角色登場,這是歷史的必然。毫無疑問,今年是人形機器人的爆發年。網友銳評:機器人的進步,讓今年看起來像人類的開幕式動作、自由度遠超人類,但這真不是恐怖片?影片一開始,Atlas平靜地躺在地上,看起來應該是仰面朝天。接下來,讓人驚掉下巴

替代MLP的KAN,被開源專案擴展到卷積了

Jun 01, 2024 pm 10:03 PM

替代MLP的KAN,被開源專案擴展到卷積了

Jun 01, 2024 pm 10:03 PM

本月初,來自MIT等機構的研究者提出了一種非常有潛力的MLP替代方法—KAN。 KAN在準確性和可解釋性方面表現優於MLP。而且它能以非常少的參數量勝過以更大參數量運行的MLP。例如,作者表示,他們用KAN以更小的網路和更高的自動化程度重現了DeepMind的結果。具體來說,DeepMind的MLP有大約300,000個參數,而KAN只有約200個參數。 KAN與MLP一樣具有強大的數學基礎,MLP基於通用逼近定理,而KAN基於Kolmogorov-Arnold表示定理。如下圖所示,KAN在邊上具

時間序列預測 NLP大模型新作:為時序預測自動產生隱式Prompt

Mar 18, 2024 am 09:20 AM

時間序列預測 NLP大模型新作:為時序預測自動產生隱式Prompt

Mar 18, 2024 am 09:20 AM

今天我想分享一個最新的研究工作,這項研究來自康乃狄克大學,提出了一種將時間序列資料與自然語言處理(NLP)大模型在隱空間上對齊的方法,以提高時間序列預測的效果。此方法的關鍵在於利用隱空間提示(prompt)來增強時間序列預測的準確性。論文標題:S2IP-LLM:SemanticSpaceInformedPromptLearningwithLLMforTimeSeriesForecasting下載網址:https://arxiv.org/pdf/2403.05798v1.pdf1、問題背景大模型

FisheyeDetNet:首個以魚眼相機為基礎的目標偵測演算法

Apr 26, 2024 am 11:37 AM

FisheyeDetNet:首個以魚眼相機為基礎的目標偵測演算法

Apr 26, 2024 am 11:37 AM

目標偵測在自動駕駛系統當中是一個比較成熟的問題,其中行人偵測是最早得以部署演算法之一。在多數論文當中已經進行了非常全面的研究。然而,利用魚眼相機進行環視的距離感知相對來說研究較少。由於徑向畸變大,標準的邊界框表示在魚眼相機當中很難實施。為了緩解上述描述,我們探索了擴展邊界框、橢圓、通用多邊形設計為極座標/角度表示,並定義一個實例分割mIOU度量來分析這些表示。所提出的具有多邊形形狀的模型fisheyeDetNet優於其他模型,並同時在用於自動駕駛的Valeo魚眼相機資料集上實現了49.5%的mAP

特斯拉機器人進廠打工,馬斯克:手的自由度今年將達到22個!

May 06, 2024 pm 04:13 PM

特斯拉機器人進廠打工,馬斯克:手的自由度今年將達到22個!

May 06, 2024 pm 04:13 PM

特斯拉機器人Optimus最新影片出爐,已經可以在工廠裡打工了。正常速度下,它分揀電池(特斯拉的4680電池)是這樣的:官方還放出了20倍速下的樣子——在小小的「工位」上,揀啊揀啊揀:這次放出的影片亮點之一在於Optimus在廠子裡完成這項工作,是完全自主的,全程沒有人為的干預。而且在Optimus的視角之下,它還可以把放歪了的電池重新撿起來放置,主打一個自動糾錯:對於Optimus的手,英偉達科學家JimFan給出了高度的評價:Optimus的手是全球五指機器人裡最靈巧的之一。它的手不僅有觸覺