再掀強化學習變革! DeepMind提出「演算法蒸餾」:可探索的預訓練強化學習Transformer

在當下的序列建模任務上,Transformer可謂是最強大的神經網路架構,並且經過預先訓練的Transformer模型可以將prompt作為條件或上下文學習(in-context learning)適應不同的下游任務。

大型預訓練Transformer模型的泛化能力已經在多個領域得到驗證,如文字補全、語言理解、圖像生成等等。

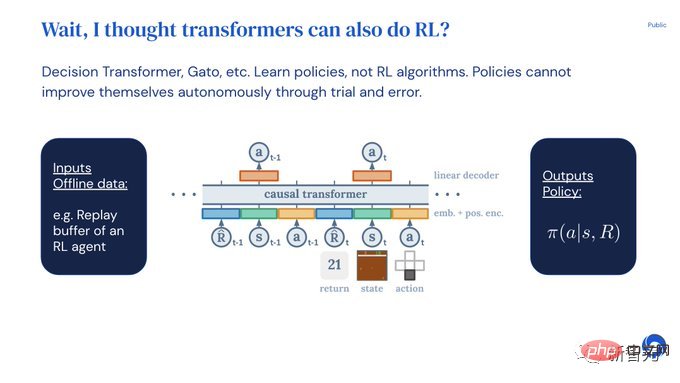

從去年開始,已經有相關工作證明,透過將離線強化學習(offline RL)視為一個序列預測問題,那麼模型就可以從離線資料中學習策略。

但目前的方法要麼是從不包含學習的資料中學習策略(如透過蒸餾固定的專家策略),要麼是從包含學習的資料(如智能體的重放緩衝區)中學習,但由於其context太小,以至於無法捕捉到策略提升。

DeepMind的研究人員透過觀察發現,原則上強化學習演算法訓練中學習的順序性(sequential nature)可以將強化學習過程本身建模為一個「因果序列預測問題」。

具體來說,如果一個Transformer的上下文足夠長到可以包含由於學習更新而產生的策略改進,那它應該不僅能夠表示一個固定的策略,而且能夠通過關注之前episodes的狀態、行動和獎勵表示為一個策略提升算子(policy improvement operator)。

這也提供了一種技術上的可行性,任何RL演算法都可以透過模仿學習蒸餾成一個足夠強大的序列模型,並將其轉化為一個in- context RL演算法。

基於此,DeepMind提出了演算法蒸餾(Algorithm Distillation, AD) ,透過建立因果序列模型將強化學習演算法提取到神經網路中。

論文連結:https://arxiv.org/pdf/2210.14215.pdf

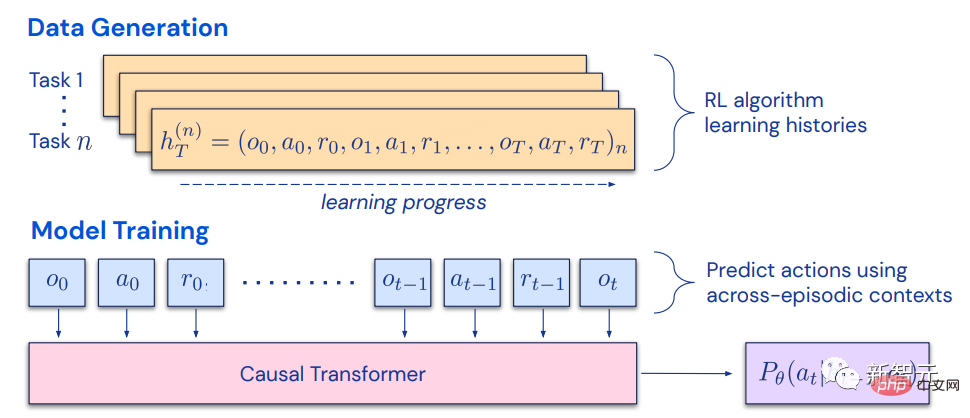

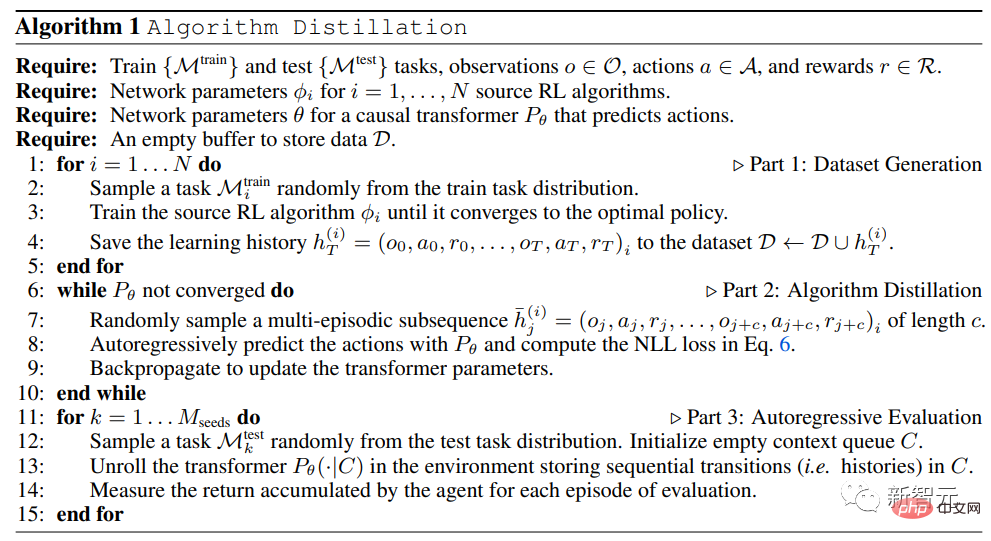

#演算法蒸餾將學習強化學習視為一個跨episode的序列預測問題,透過源RL演算法產生一個學習歷史資料集,然後根據學習歷史作為上下文,透過自回歸預測行為來訓練因果Transformer 。

與蒸餾後學習(post-learning)或專家序列的序列策略預測結構不同,AD能夠在不更新其網路參數的情況下完全在上下文中改進其策略。

- Transfomer收集自己的數據,並在新任務上最大化獎勵;

- ##無prompting或微調;

- 在權重凍結的情況下,Transformer可探索、利用和最大化上下文的返回(return)!諸如Gato類的專家蒸餾(Expert Distillation)方法無法探索,也無法最大化返回。

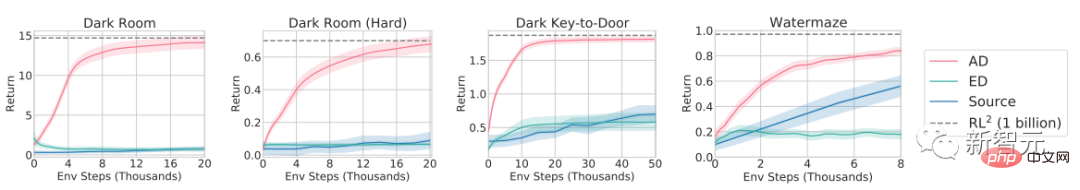

實驗結果證明了AD可以在稀疏獎勵、組合任務結構和基於像素觀察的各種環境中進行強化學習,並且AD學習的資料效率(data- efficient)比產生來源資料的RL演算法更高。

AD也是第一個透過對具有模仿損失(imitation loss)的離線資料進行序列建模來展示in-context強化學習的方法。

演算法蒸餾2021年,有研究人員首先發現Transformer可以透過模仿學習從離線RL資料中學習單一任務策略,隨後又被擴展為可以在同域和跨域設定中提取多任務策略。

這些工作為提取通用的多任務策略提出了一個很有前景的範式:首先收集大量不同的環境互動資料集,然後透過序列建模從資料中提取一個策略。

把透過模仿學習從離線RL資料學習策略的方法也稱之為離線策略蒸餾,或簡稱為策略蒸餾(Policy Distillation, PD)。

儘管PD的想法非常簡單,而且十分易於擴展,但PD有一個重大的缺陷:產生的策略並沒有從與環境的額外互動中得到提升。

例如,MultiGame Decision Transformer(MGDT)學習了一個可以玩大量Atari遊戲的返回條件策略,而Gato透過上下文推斷任務,學習了一個在不同環境中解決任務的策略,但這兩種方法都無法透過試誤來改善其策略。

MGDT透過微調模型的權重使變壓器適應新的任務,而Gato則需要專家的示範提示才能適應新的任務。

簡而言之,Policy Distillation方法學習政策而非強化學習演算法。

研究人員假設Policy Distillation不能透過試誤來改進的原因是,它在沒有顯示學習進展的資料上進行訓練。

演算法蒸餾(AD)透過優化一個RL演算法的學習歷史上的因果序列預測損失來學習內涵式策略改進算子的方法。

AD包含兩個組成部分:

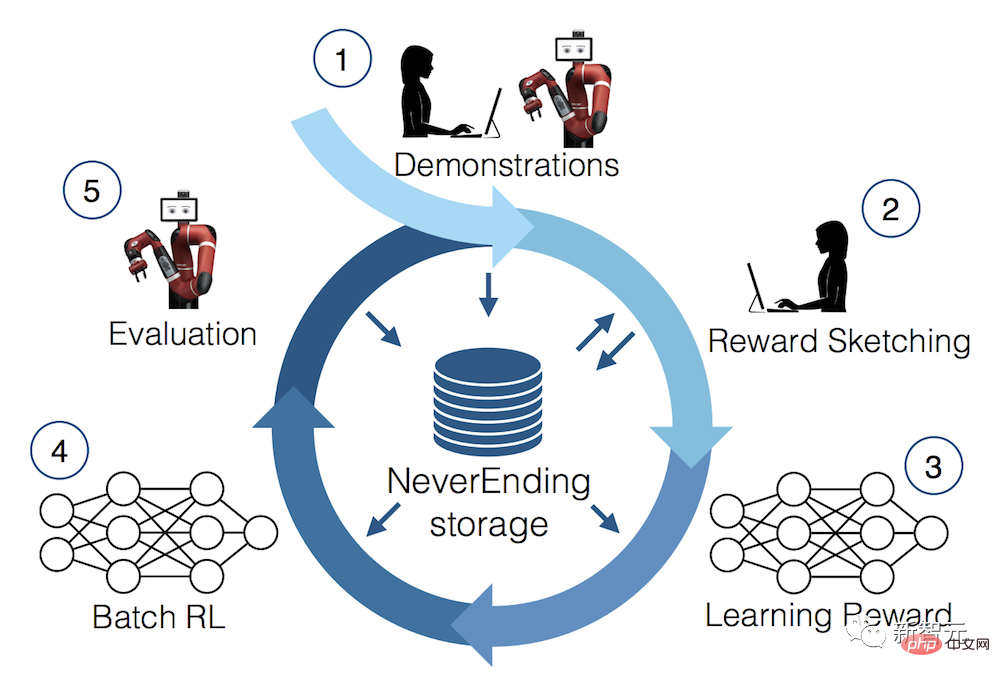

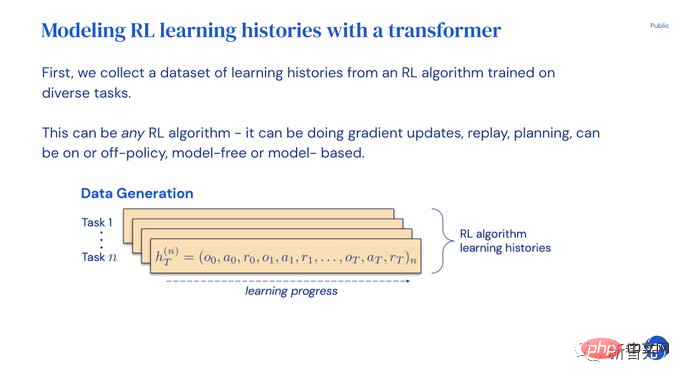

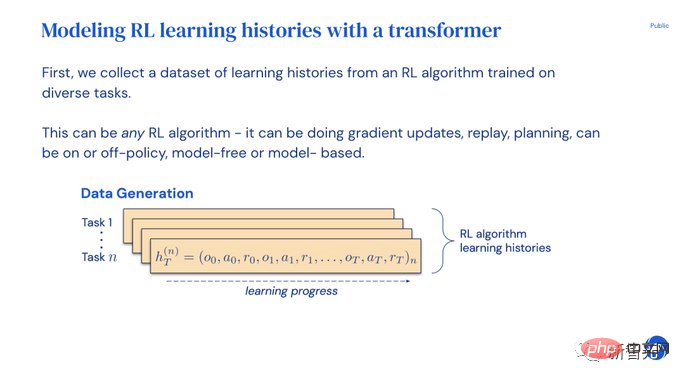

1、透過儲存一個RL演算法在許多單獨任務上的訓練歷史,產生一個大型的多任務資料集;

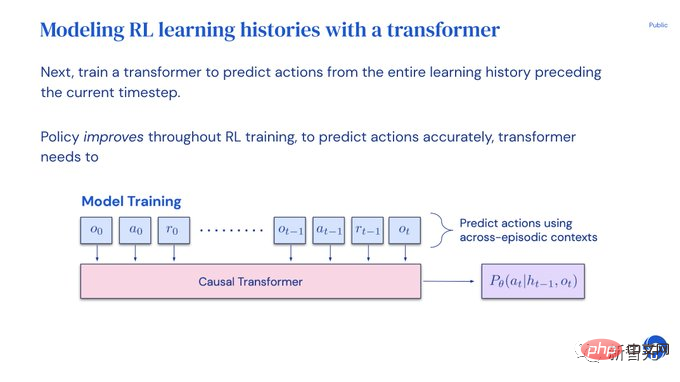

2、將Transformer使用前面的學習歷史作為其背景對行動進行因果構建模。

由於策略在來源RL演算法的整個訓練過程中不斷改進,AD必須得學習如何改進算子,才能準確模擬訓練歷史中任何給定點的行動。

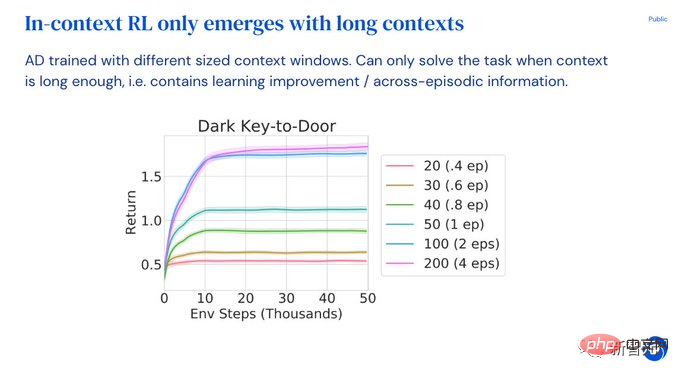

最重要的是,Transformer的上下文大小必須足夠大(即跨週期),以捕捉訓練資料的改進。

在實驗部分,為了探討AD在in-context RL能力的優勢,研究人員把重點放在預訓練後不能通過zero -shot 泛化解決的環境上,即要求每個環境支援多種任務,且模型無法輕易地從觀察中推斷出任務的解決方案。同時episodes需要夠短以便可以訓練跨episode的因果Transformer。

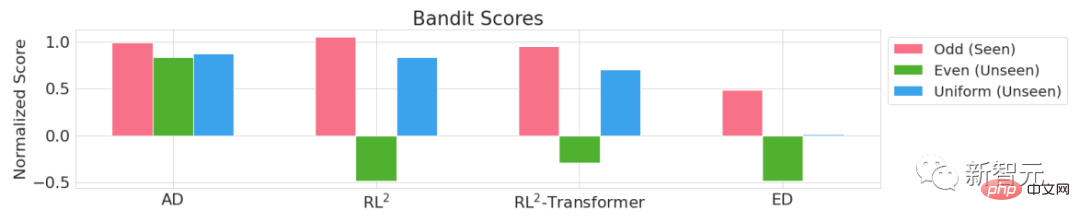

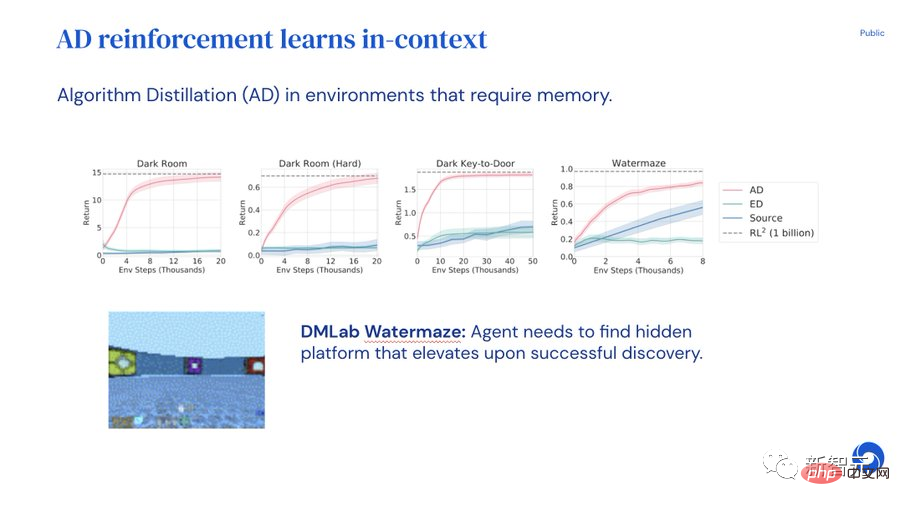

在四個環境Adversarial Bandit、Dark Room、Dark Key-to-Door、DMLab Watermaze的實驗結果中可以看到,透過模仿基於梯度的RL演算法,使用具有足夠大上下文的因果Transformer,AD可以完全在上下文中強化學習新任務。

AD能夠進行in-context中的探索、時間上的信用分配和泛化,AD學習的演算法比產生Transformer訓練的來源數據的演算法更有數據效率。

PPT講解

為了方便論文理解,論文的一作Michael Laskin在推特上發表了一份ppt講解。

演算法蒸餾的實驗表明,Transformer可以透過試誤自主改善模型,並且不用更新權重,無需提示、也無需微調。單一Transformer可以收集自己的數據,並在新任務上將獎勵最大化。

儘管目前已經有很多成功的模型展示了Transformer如何在上下文中學習,但Transformer還沒有被證明可以在上下文中強化學習。

為了適應新的任務,開發者要麼需要手動指定一個提示,要麼需要調整模型。

如果Transformer可以適應強化學習,做到開箱即用豈不美哉?

但Decision Transformers或Gato只能從離線資料學習策略,無法透過重複實驗自動改進。

使用演算法蒸餾(AD)的預訓練方法產生的Transformer可以在上下文中強化學習。

首先訓練一個強化學習演算法的多個副本來解決不同的任務和保存學習歷史。

一旦收集學習歷史的資料集,就可以訓練一個Transformer來預測先前的學習歷史的行動。

由於策略在歷史上有所改進,因此準確地預測行動將會迫使Transformer對策略提升進行建模。

整個過程就是這麼簡單,Transformer只是透過模仿動作來訓練,沒有像常見的強化學習模型所用的Q值,沒有長的操作-動作-獎勵序列,也沒有像DTs 那樣的回傳條件。

在上下文中,強化學習沒有額外開銷,然後透過觀察 AD 是否能最大化新任務的獎勵來評估模型。

Transformer探索、利用、並最大化返回在上下文時,它的權重是凍結的!

另一方面,專家蒸餾(最類似Gato)無法探索,也無法最大化回報。

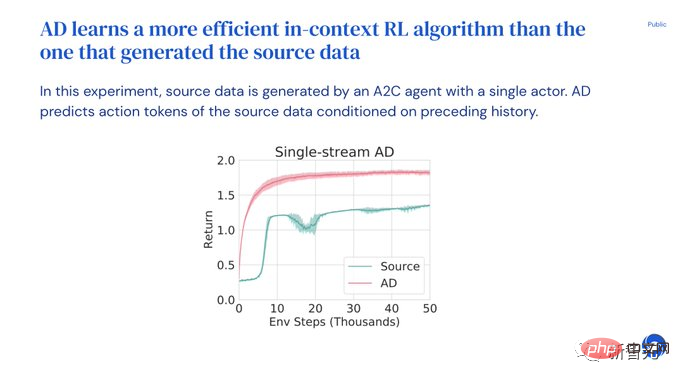

AD 可以提取任何RL 演算法,研究人員嘗試了UCB、DQNA2C,一個有趣的發現是,在上下文RL 演算法學習中,AD更有數據效率。

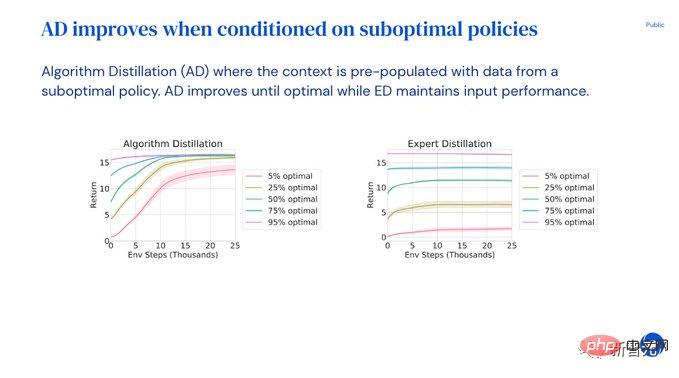

使用者也可以輸入prompt和次優的demo,模型會自動進行策略提升,直到獲得最佳解!

而專家蒸餾ED只能維持次優的demo表現。

只有當Transformer的上下文夠長,跨越多個episode時,上下文RL才會出現。

AD需要一個足夠長的歷史,以進行有效的模型改進和identify任務。

透過實驗,研究人員得出以下結論:

- ##Transformer可以在上下文中進行RL

- 帶AD 的上下文RL 演算法比基於梯度的源RL 演算法更有效

- AD提升了次優策略

- in-context強化學習產生於長上下文的模仿學習 #

以上是再掀強化學習變革! DeepMind提出「演算法蒸餾」:可探索的預訓練強化學習Transformer的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

熱門話題

拋棄編碼器-解碼器架構,用擴散模型做邊緣偵測效果更好,國防科大提出DiffusionEdge

Feb 07, 2024 pm 10:12 PM

拋棄編碼器-解碼器架構,用擴散模型做邊緣偵測效果更好,國防科大提出DiffusionEdge

Feb 07, 2024 pm 10:12 PM

目前的深度邊緣檢測網路通常採用編碼器-解碼器架構,其中包含上下採樣模組,以更好地提取多層次的特性。然而,這種結構限制了網路輸出準確且細緻的邊緣檢測結果。針對這個問題,一篇AAAI2024的論文給了新的解決方案。論文題目:DiffusionEdge:DiffusionProbabilisticModelforCrispEdgeDetection作者:葉雲帆(國防科技大學),徐凱(國防科技大學),黃雨行(國防科技大學),易任嬌(國防科技大學),蔡志平(國防科技大學)論文連結:https ://ar

開源!超越ZoeDepth! DepthFM:快速且精確的單目深度估計!

Apr 03, 2024 pm 12:04 PM

開源!超越ZoeDepth! DepthFM:快速且精確的單目深度估計!

Apr 03, 2024 pm 12:04 PM

0.這篇文章乾了啥?提出了DepthFM:一個多功能且快速的最先進的生成式單目深度估計模型。除了傳統的深度估計任務外,DepthFM還展示了在深度修復等下游任務中的最先進能力。 DepthFM效率高,可以在少數推理步驟內合成深度圖。以下一起來閱讀這項工作~1.論文資訊標題:DepthFM:FastMonocularDepthEstimationwithFlowMatching作者:MingGui,JohannesS.Fischer,UlrichPrestel,PingchuanMa,Dmytr

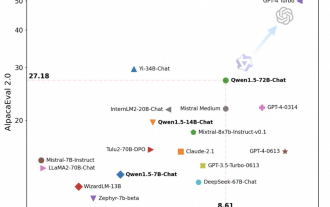

通義千問再開源,Qwen1.5帶來六種體量模型,表現超越GPT3.5

Feb 07, 2024 pm 10:15 PM

通義千問再開源,Qwen1.5帶來六種體量模型,表現超越GPT3.5

Feb 07, 2024 pm 10:15 PM

趕在春節前,通義千問大模型(Qwen)的1.5版上線了。今天上午,新版本的消息引發了AI社群關注。新版大機型包括六個型號尺寸:0.5B、1.8B、4B、7B、14B和72B。其中,最強版本的效能超越了GPT3.5和Mistral-Medium。此版本包含Base模型和Chat模型,並提供多語言支援。阿里通義千問團隊表示,相關技術也已經上線到了通義千問官網和通義千問App。除此之外,今天Qwen1.5的發布還有以下一些重點:支援32K上下文長度;開放了Base+Chat模型的checkpoint;

大模型也能切片,微軟SliceGPT讓LLAMA-2運算效率大增

Jan 31, 2024 am 11:39 AM

大模型也能切片,微軟SliceGPT讓LLAMA-2運算效率大增

Jan 31, 2024 am 11:39 AM

大型語言模型(LLM)通常擁有數十億參數,經過數萬億token的資料訓練。然而,這樣的模型訓練和部署成本都非常昂貴。為了降低運算需求,人們常常採用各種模型壓縮技術。這些模型壓縮技術一般可分為四類:蒸餾、張量分解(包括低秩因式分解)、剪枝、量化。剪枝方法已經存在一段時間,但許多方法需要在剪枝後進行恢復微調(RFT)以保持性能,這使得整個過程成本高昂且難以擴展。蘇黎世聯邦理工學院和微軟的研究者提出了一個解決這個問題的方法,名為SliceGPT。此方法的核心思想是透過刪除權重矩陣中的行和列來降低網路的嵌

你好,電動Atlas!波士頓動力機器人復活,180度詭異動作嚇到馬斯克

Apr 18, 2024 pm 07:58 PM

你好,電動Atlas!波士頓動力機器人復活,180度詭異動作嚇到馬斯克

Apr 18, 2024 pm 07:58 PM

波士頓動力Atlas,正式進入電動機器人時代!昨天,液壓Atlas剛「含淚」退出歷史舞台,今天波士頓動力就宣布:電動Atlas上崗。看來,在商用人形機器人領域,波士頓動力是下定決心要跟特斯拉硬剛一把了。新影片放出後,短短十幾小時內,就已經有一百多萬觀看。舊人離去,新角色登場,這是歷史的必然。毫無疑問,今年是人形機器人的爆發年。網友銳評:機器人的進步,讓今年看起來像人類的開幕式動作、自由度遠超人類,但這真不是恐怖片?影片一開始,Atlas平靜地躺在地上,看起來應該是仰面朝天。接下來,讓人驚掉下巴

追趕Gemini Pro,提升推理、OCR能力的LLaVA-1.6太強了

Feb 01, 2024 pm 04:51 PM

追趕Gemini Pro,提升推理、OCR能力的LLaVA-1.6太強了

Feb 01, 2024 pm 04:51 PM

在去年4月,威斯康辛大學麥迪遜分校、微軟研究院和哥倫比亞大學的研究者們共同發布了LLaVA(LargeLanguageandVisionAssistant)。儘管LLaVA只是用一個小的多模態指令資料集進行訓練,但在一些樣本上展現了與GPT-4非常相似的推理結果。然後在10月,他們推出了LLaVA-1.5,透過對原始LLaVA進行簡單修改,在11個基準測試中刷新了SOTA。這次升級的結果非常令人振奮,為多模態AI助理領域帶來了新的突破。研究團隊宣布推出LLaVA-1.6版本,針對推理、OCR和

超級智能體生命力覺醒!可自我更新的AI來了,媽媽再也不用擔心資料瓶頸難題

Apr 29, 2024 pm 06:55 PM

超級智能體生命力覺醒!可自我更新的AI來了,媽媽再也不用擔心資料瓶頸難題

Apr 29, 2024 pm 06:55 PM

哭死啊,全球狂煉大模型,一網路的資料不夠用,根本不夠用。訓練模型搞得跟《飢餓遊戲》似的,全球AI研究者,都在苦惱怎麼才能餵飽這群資料大胃王。尤其在多模態任務中,這問題尤其突出。一籌莫展之際,來自人大系的初創團隊,用自家的新模型,率先在國內把「模型生成數據自己餵自己」變成了現實。而且還是理解側和生成側雙管齊下,兩側都能產生高品質、多模態的新數據,對模型本身進行數據反哺。模型是啥?中關村論壇上剛露面的多模態大模型Awaker1.0。團隊是誰?智子引擎。由人大高瓴人工智慧學院博士生高一鑷創立,高

快手版Sora「可靈」開放測試:生成超120s視頻,更懂物理,複雜運動也能精準建模

Jun 11, 2024 am 09:51 AM

快手版Sora「可靈」開放測試:生成超120s視頻,更懂物理,複雜運動也能精準建模

Jun 11, 2024 am 09:51 AM

什麼?瘋狂動物城被國產AI搬進現實了?與影片一同曝光的,是一款名為「可靈」全新國產影片生成大模型。 Sora利用了相似的技術路線,結合多項自研技術創新,生產的影片不僅運動幅度大且合理,還能模擬物理世界特性,具備強大的概念組合能力與想像。數據上看,可靈支持生成長達2分鐘的30fps的超長視頻,分辨率高達1080p,且支援多種寬高比。另外再劃個重點,可靈不是實驗室放出的Demo或影片結果演示,而是短影片領域頭部玩家快手推出的產品級應用。而且主打一個務實,不開空頭支票、發布即上線,可靈大模型已在快影