智慧座艙人機互動發展淺析

目前,汽车不仅在动力源、驱动方式和驾驶体验上发生了变化,驾驶舱也告别了传统的枯燥机械和电子空间,智能化水平飙升,成为继家庭和办公室以外人们生活之后的“第三空间”。通过人脸;指纹识别、语音 / 手势交互、多屏联动等高新技术,使当今汽车智能座舱在环境感知、信息采集和处理方面的能力显著增强,成为人类驾驶的“智能助手”。

智能座舱告别简单的电子化,进入智能助理阶段的显著标志之一是人与驾驶舱的相互作用从被动式进入主动式,这种“被动的”和“主动的”是以驾驶舱本身为中心定义的。过去的信息交流主要由人发起,现在人和机器都可以启动,人和机器的交互水平已经成为定义智能座舱产品水平的重要标志。

人机交互发展背景

从电脑与手机的历史可以折射出机械与人互动方法的发展脉络,并从繁杂到单纯简约从抽象的动作到自然的互动。未来最主要的人机交互发展趋势,便是将机械由被动响应进入了主动式交互。沿着这种趋势的延长线来看,人与机器相互作用的终极目标是将机器拟人化,使人与机器的相互作用像人与人的交流一样自然顺畅。也就是说,人机交互的历史就是人从适应机器到通过机械适应人的历史。

智能座舱的发展也有类似的过程。随着电子技术的进展和车主的期望,汽车内外的电子信号和功能也越来越多,以便让车主降低对注意力资源的浪费,从而降低行车分气,汽车互动方法也因此而逐步改变:物理旋钮 / 键盘——数字触摸屏——语言操控—自然状态互动。

自然交互是下一代人机交互方式的理想模型

什么是自然交互?

简而言之,即通过动作、目光追踪、语言等实现交流。这里的意识模态更具体地说类似于人的 " 感知 ",其形态中混合着各种感知,并对应了人的视野、聆听、触觉、嗅觉、味觉等五大感知。相应的信息介质包括各种传感器,例如声音、视频、文字和红外、压力、雷达。智能汽车实质上就是一个载人机器人,其最关键的二个功能就是自己控制的以及与人互动的功能,没有其中之一,将无法高效的工作于人。所以,一种智慧的人机交互系统是十分必要的。

自然交互的实现方式

座舱内融合了越来越多的传感器,传感器提高了形态多样化、数据丰富性和准确性的能力。一方面使驾驶舱内的计算力需求飞跃,另一方面也提供了更好的感知能力支持。这一趋势使更丰富的驾驶舱场景创新、更好的互动体验成为可能。其中,视觉处理是驾驶舱人机交互技术的关键。而且融合技术才是真正王道,比如在嘈杂条件下的语音识别时,光靠麦克风是没有的。人在这种情况下能选择性地听某人讲话,不仅靠耳朵,还靠眼睛。因此,通过视觉上确定音源并阅读唇语,能够得到比单纯的声音识别更好的效果。如果传感器是人的五感,那么计算力便是一个自动交互的人脑,AI 算法把视觉与语音结合到一起,通过各种认知方法,能够进行人脸、动作、姿态、语音等多种信号的辨识。由此,可以实现更智能的人的目标交互,包括眼球追踪、语音识别、口语识别联动和驾驶员的疲劳状态检测等。

座舱人员交互的设计通常需要通过边缘运算,而非云运算来完成。三点:安全性、实时性和隐私安全性。云计算依赖于网络,对于智能汽车来说,依赖于无线网络无法保证其连接的可靠性。同时,数据传输延迟不可控,不能保证交互平滑。要确保面向自动运行安全域的完整用户体验,破局之道在于边缘计算。

但是,個人資訊安全也是面臨的問題之一。駕駛室內的私密空間,安全性保障方面特別明顯。現在的個人化聲音辨識主要都是依靠在雲端上實現的,裡面的聲紋等私人生物資訊能夠更方便的顯示私人識別資訊。而利用在汽車端的邊緣 AI 設計,就能夠把圖片、聲音等私人生物訊息,轉變成汽車語意訊息,再上傳到雲端,從而有效地保障了汽車的個人資訊安全。

自動駕駛時代,互動智能必須跟駕駛智慧相符

在可預期的未來,無人機協同飛行將成為一個長期存在的現象,座艙的無人機互動成為人掌握主動飛行技能的第一個介面。目前,智慧駕駛領域面臨進化不均衡的問題,人機互動程度落後於自動駕駛水準的提升,造成自主行車問題的頻出,阻礙自動駕駛的發展。人機互動合作行為的特徵是人的操作迴路。所以,人機互動功能必須和自動駕駛功能保持一致。否則將導致嚴重的預期功能安全風險,絕大多數自動駕駛致命事件與此有關。一旦人機互動介面可以提供自己行車的認知結果,可以進一步了解自動駕駛系統的能量邊界這將大大有助於提高 L-Class 自動駕駛功能的接受度。

當然,目前智慧座艙的互動方式主要是手機安卓生態的延申,主要是透過主機螢幕支援。現在的顯示器也越來越大,而這其實是由於低優先順序的功能佔用了高優先功能的空間,帶來額外的訊號幹擾,影響運作安全。在未來,雖然實體顯示器仍然存在,但我相信在未來,取而代之的將是自然人機互動 AR-HUD。

如果把智慧駕駛系統發展到 L四以上,人將從枯燥疲勞的駕駛中解放出來,汽車也將成為 " 人的第三生活空間 "。這樣,未來駕駛室內的娛樂區和安全功能區(人機互動和自動操縱)的位置會改變,安全區則變成為主控制區。自動駕駛是汽車與環境的互動,人與人的互動是人與汽車的互動,兩者融為一體,完成人、車、環境三者的協同,形成完整的駕駛閉環。

第二,自動對話方式AR-HUD 的對話介面更加安全,在用語言或手勢溝通的情形下,可以避免對駕駛者視線的轉移,從而提高了行駛安全。在駕駛艙大螢幕上根本就無法實現這一點,而 ARHUD 則能夠在顯示自動行駛感知訊號的同時規避了這一問題。

第三,自然交談方法是一個隱性的、簡潔的、具有感情的自然交談方法。你不能過度佔有車內寶貴的實體空間,但你可以隨時隨地陪伴自在者周圍。所以,未來智慧行車和智慧駕駛艙的域內結合是一種更安全的發展方式,最後發展的是汽車中央的系統。

人機互動實戰原理

#觸控互動

早期的中控台螢幕只是顯示收音機的訊息,大部分面積都容納了超多的實體互動按鈕,這些按鈕基本上都是透過觸覺互動來實現與人類的溝通。

隨著智慧互動的發展,出現了中央控制的大螢幕,實體互動按鈕開始逐漸減少。中控大螢幕越來越大,佔據越來越重要的位置。中控台的實體按鍵已經減少到沒有了,此時乘員已經無法用觸覺與人進行交互,但在這個階段逐漸轉變為視覺交互,人們不再用觸覺與人進行溝通,而是主要用視覺進行操作。但如果只用視覺與智慧座艙的人類對話,人們將絕對不方便。特別是在駕駛過程中,90% 的人類視覺注意力必須投入到路況的觀察中,才能長期將視線投入畫面之上,與智慧座艙對話。

語音互動

(1)語音互動的原理。

自然語音的理解-語音辨識-語音轉換語音。

(2)語音互動所需的場景。

語音控制的場景應用主要有二個要素,一是能夠取代在觸控螢幕上沒有提示的功能,與人機介面自然對話,二是最小化了人機介面手動控制所帶來的影響,提高安全性。

第一,當你下班回家的時候,你想在開車的過程中快速控制車輛,查詢信息,查詢空調、座椅等。在長途旅行中,中途調查服務區和加油站,調查行程。第二個是用語音把一切連結起來。車上的音樂、子螢幕娛樂都能迅速喚起。所以我們要做的就是快速控制車輛。

首先是對汽車實現快速操控,基本功能包括調整車內氛圍燈光、調整音量、調控車內空調溫度控制、調整車窗、調整後視鏡,快速控制車輛的本意是讓駕駛者更快速地控制車輛,減少分心有助於增加安全運轉係數。遠端語言互動是實現整個系統的重要入口,因為系統必須了解駕駛者的語音指令,提供智慧導航。我們不僅能夠被動接受任務,而且還能夠為您提供關於目的地介紹和日程安排等的附加服務。

接著,是車輛和駕駛員的監視,在實時運行中,能夠隨時詢問輪胎壓力、箱的溫度、冷卻劑、發動機油等車輛的性能和車輛的狀態。即時資訊查詢有助於駕駛員提前處理資訊。當然到達警戒臨界點的時候也要即時注意。除了對內監控外當然也需要對外監控,生物辨識和語音監控的混合監控可以監控駕駛者的情緒。在適當的時候提醒駕駛人打起精神來避免交通事故的發生。以及長時間行駛的疲勞聲音的注意事項。最後,在多媒體娛樂方面,開車的場景、播放音樂和廣播是最高頻的操作和需求。除了簡單的播放、暫停、歌曲切換等功能外,還等待著收藏、帳號註冊、播放歷史的開啟、播放順序的切換、現場互動等個人化功能的開發。

容納錯誤

#語音對話中必須允許容錯機制。基本的容錯也按場景處理。一是聽不懂,此時讓用戶再說一遍,二是聽了但沒有處理問題的能力,三是識別為錯誤訊息,這可以再確認。

人臉辨識

(1)人臉辨識的原理。

駕駛艙的人臉特徵辨識技術一般包含以下三個面向:人臉特徵檢查、模式辨識。隨著互聯網整體資訊的生物化,多平台輸入人臉信息,汽車作為萬物互聯的一個重點,隨著更多移動終端使用場景移動到車內,帳戶註冊、身份認證需要在車內進行。

(2)人臉辨識使用場景。

行駛前,必須上車驗證車主訊息,註冊應用程式 ID。行走中,臉部辨識是行走中閉眼疲勞的主要工作場景,電話提醒,無眼前,打哈欠。

單純的互動可以讓駕駛者更不方便。例如,僅憑語音,容易發生誤指令、單純觸控操作,駕駛無法滿足 3 秒的原則。只有語音、手勢、視覺等多種互動方式融合在一起,智慧系統才能更準確、方便、安全地在各種場景中與駕駛者溝通。

人機互動挑戰與未來

人機互動的挑戰

理想的自然互動是從使用者感受入手,創造安全、順暢、可預見的互動感受。但不管人生如何豐富,總要腳踏實地的從事實出發,目前的挑戰依然很多。

目前自然互動的誤認仍然很嚴重,全工況、全天候的可靠性、準確性還遠遠不夠。因此,在手勢辨識中,依賴視覺的手勢辨識率目前仍很低,所以必須研發各種演算法來提升辨識的精度與速率。無意中打手勢,或許會被人誤認為是命令動作,但其實這只是無數誤認之一,在移動情況下,對光線的投射、振動、遮擋等都是重大技術的問題。因此,配合運轉場景,採用多感測器融合驗證方式、聲音確認等方式,為了降低誤辨識率,需要綜合性地加持各種技術手段。其次,目前自然互動的流暢性問題仍是目前必須克服的困難,要求更先進的感測器、更強大的能力、更高效率的運算。同時,自然的語言處理能力與意圖表達仍處於起步階段,還需演算法技術的深入研究。

未來,座艙人機互動走向虛擬世界與情緒連結

消費者願意為汽車移動之外附加的智慧化功能買單的原因之一是對話和體驗。我們在上面提到,未來智慧座艙的發展是以人為本的,它將在人們的生活中演變成第三個空間。

這種人機互動絕不是簡單的呼叫回應,而是多通道、多層次、多模式的交流感覺。從乘員視角,未來的智慧座艙人機互動系統將以智慧語言為主要溝通手段,並以觸控、手勢、動態、表情等為輔助溝通手段,解放乘員手與眼睛,以減少駕駛人操控風險。

隨著駕駛艙內感測器的增加,人機互動服務物件以駕駛員為中心轉移到全車乘客是一種確定性趨勢。智慧座艙建構虛擬空間,人與人的自然互動將帶來全新的沉浸式擴充實境娛樂體驗。強大的配置,結合駕駛艙強大的互動設備,可以建造車內的元宇宙,提供各種沉浸式遊戲。智慧座艙可能是原太空的好載體。

人機的自然互動也帶來情感上的聯繫,駕駛艙成為人的伴侶,更聰明的伴侶,學習車主的行為、習慣、偏好,感知駕駛艙內的環境,結合車輛目前的位置,在需要時積極提供資訊和功能提示。隨著人工智慧的發展,在我們有生之年,有機會看到人類的情感連結逐漸參與我們的個人生活中,確保科技向善,也許是那時我們必須面對的另一個重大問題。但無論如何,科技都會朝這個方向發展。

智慧座艙人機互動總結

在當前慘烈的汽車產業競爭中,人工智慧座艙系統已然變成了實現整機廠功能差異性的關鍵問題,因為駕駛艙人機互動系統和人的溝通行為、語言文化等都息息相關,所以需要高度本地化。智慧車輛人機互動是中國智慧車輛企業品牌升級的重要突破口,也是中國智慧車輛科技引導世界技術發展趨勢的突破口。

這些互動和互動的整合,未來將提供更全面的沉浸體驗,繼續推動新的互動方式和技術的成熟,期望從目前的體驗提升功能演化為未來智慧座艙的必備功能。未來智慧座艙互動技術無論是基本安全需求或是更深層的歸屬感、自我實現心理需求,都有望涵蓋多種多樣的旅遊需求。

以上是智慧座艙人機互動發展淺析的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

熱門話題

Windows 11 上的智慧型應用程式控制:如何開啟或關閉它

Jun 06, 2023 pm 11:10 PM

Windows 11 上的智慧型應用程式控制:如何開啟或關閉它

Jun 06, 2023 pm 11:10 PM

智慧型應用程式控制是Windows11中非常有用的工具,可幫助保護你的電腦免受可能損害資料的未經授權的應用程式(如勒索軟體或間諜軟體)的侵害。本文將解釋什麼是智慧型應用程式控制、它是如何運作的,以及如何在Windows11中開啟或關閉它。什麼是Windows11中的智慧型應用控制?智慧型應用程式控制(SAC)是Windows1122H2更新中引入的新安全功能。它與MicrosoftDefender或第三方防毒軟體一起運行,以阻止可能不必要的應用,這些應用程式可能會減慢設備速度、顯示意外廣告或執行其他意外操作。智慧應用

五官亂飛,張嘴、瞪眼、挑眉,AI都能模仿到位,影片詐騙要防不住了

Dec 14, 2023 pm 11:30 PM

五官亂飛,張嘴、瞪眼、挑眉,AI都能模仿到位,影片詐騙要防不住了

Dec 14, 2023 pm 11:30 PM

好強大的AI模仿能力,真的防不住,完全防不住。現在AI的發展已經達到這種程度了嗎?你前腳讓自己的五官亂飛,後腳,一模一樣的表情就被復現出來,瞪眼、挑眉、噘嘴,不管多麼誇張的表情,都模仿的非常到位。加大難度,讓眉毛挑的再高些,眼睛睜的再大些,甚至連嘴型都是歪的,虛擬人物頭像也能完美復現表情。當你在左邊調整參數時,右邊的虛擬頭像也會相應地改變動作給嘴巴、眼睛一個特寫,模仿的不能說完全相同,只能說表情一模一樣(最右邊)。這項研究來自慕尼黑工業大學等機構,他們提出了GaussianAvatars,這種

MotionLM:多智能體運動預測的語言建模技術

Oct 13, 2023 pm 12:09 PM

MotionLM:多智能體運動預測的語言建模技術

Oct 13, 2023 pm 12:09 PM

本文經自動駕駛之心公眾號授權轉載,轉載請洽出處。原標題:MotionLM:Multi-AgentMotionForecastingasLanguageModeling論文連結:https://arxiv.org/pdf/2309.16534.pdf作者單位:Waymo會議:ICCV2023論文想法:對於自動駕駛車輛安全規劃來說,可靠地預測道路代理未來行為是至關重要的。本研究將連續軌跡表示為離散運動令牌序列,並將多智能體運動預測視為語言建模任務。我們提出的模型MotionLM有以下幾個優點:首

你知道程式設計師再過幾年會沒落?

Nov 08, 2023 am 11:17 AM

你知道程式設計師再過幾年會沒落?

Nov 08, 2023 am 11:17 AM

《ComputerWorld》雜誌曾經寫過一篇文章,說“編程到1960年就會消失”,因為IBM開發了一種新語言FORTRAN,這種新語言可以讓工程師寫出他們所需的數學公式,然後提交給電腦運行,所以程式設計就會終結。圖片又過了幾年,我們聽到了一種新說法:任何業務人員都可以使用業務術語來描述自己的問題,告訴電腦要做什麼,使用這種叫做COBOL的程式語言,公司不再需要程式設計師了。後來,據說IBM開發了一門名為RPG的新程式語言,可以讓員工填寫表格並產生報告,因此大部分企業的程式設計需求都可以透過它來完成圖

一文聊聊SLAM技術在自動駕駛的應用

Apr 09, 2023 pm 01:11 PM

一文聊聊SLAM技術在自動駕駛的應用

Apr 09, 2023 pm 01:11 PM

定位在自動駕駛中佔據不可取代的地位,而且未來有著可期的發展。目前自動駕駛中的定位都是依賴RTK配合高精地圖,這為自動駕駛的落地增加了不少成本與難度。試想一下人類開車,並非需要知道自己的全局高精定位及周圍的詳細環境,有一條全局導航路徑並配合車輛在該路徑上的位置,也就足夠了,而這裡牽涉到的,便是SLAM領域的關鍵技術。什麼是SLAMSLAM (Simultaneous Localization and Mapping),也稱為CML (Concurrent Mapping and Localiza

GR-1傅利葉智慧通用人形機器人即將開始預售!

Sep 27, 2023 pm 08:41 PM

GR-1傅利葉智慧通用人形機器人即將開始預售!

Sep 27, 2023 pm 08:41 PM

身高1.65米,體重55公斤,全身44個自由度,能夠快速行走、敏捷避障、穩健上下坡、抗衝擊幹擾的人形機器人,現在可以帶回家了!傅利葉智慧的通用人形機器人GR-1已開啟預售機器人大講堂傅利葉智慧FourierGR-1通用人形機器人現已開放預售。 GR-1擁有高度仿生的軀幹構型和擬人化的運動控制,全身44個自由度,具備行走、避障、越障、上下坡、抗干擾、適應不同路面等運動能力,是通用人工智慧的理想載體。官網預售頁:www.fftai.cn/order#FourierGR-1#傅利葉智能需要改寫的內

華為將在智慧穿戴領域推出玄璣感知系統 可根據心率評估用戶情緒狀態

Aug 29, 2024 pm 03:30 PM

華為將在智慧穿戴領域推出玄璣感知系統 可根據心率評估用戶情緒狀態

Aug 29, 2024 pm 03:30 PM

近日,華為宣布將於9月推出搭載玄璣感知系統的全新智慧穿戴新品,預計為華為的最新智慧手錶。該新品將整合先進的情緒健康監測功能,玄璣感知系統以其六大特性——準確性、全面性、快速性、靈活性、開放性和延展性——為用戶提供全方位的健康評估。系統採用超感知模組,優化了多通道光路架構技術,大幅提升了心率、血氧和呼吸速率等基礎指標的監測精度。此外,玄璣感知系統也拓展了以心率資料為基礎的情緒狀態研究,不僅限於生理指標,還能評估使用者的情緒狀態和壓力水平,並支持超過60項運動健康指標監測,涵蓋心血管、呼吸、神經、內分泌、

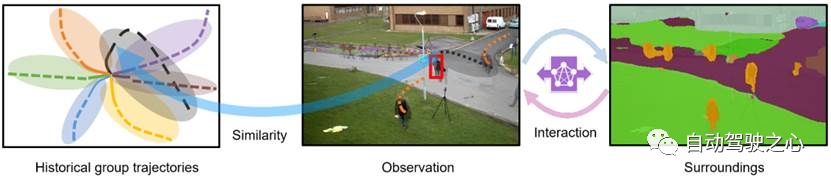

行人軌跡預測有哪些有效的方法和普遍的Base方法?頂會論文分享!

Oct 17, 2023 am 11:13 AM

行人軌跡預測有哪些有效的方法和普遍的Base方法?頂會論文分享!

Oct 17, 2023 am 11:13 AM

軌跡預測近兩年風頭正猛,但大都聚焦於車輛軌跡預測方向,自動駕駛之心今天就為大家分享頂會NeurIPS上關於行人軌跡預測的演算法—SHENet,在受限場景中人類的移動模式通常在一定程度上符合有限的規律。基於這個假設,SHENet透過學習隱含的場景規律來預測一個人的未來軌跡。文章已經授權自動駕駛之心原創!作者的個人理解由於人類運動的隨機性和主觀性,目前預測一個人的未來軌跡仍然是一個具有挑戰性的問題。然而,由於場景限制(例如平面圖、道路和障礙物)以及人與人或人與物體的互動性,在受限場景中人類的移動模式通