部署國產ChatGPT僅需6G顯存! ChatYuan模型開放下載:業界首個功能對話開源中文大模型

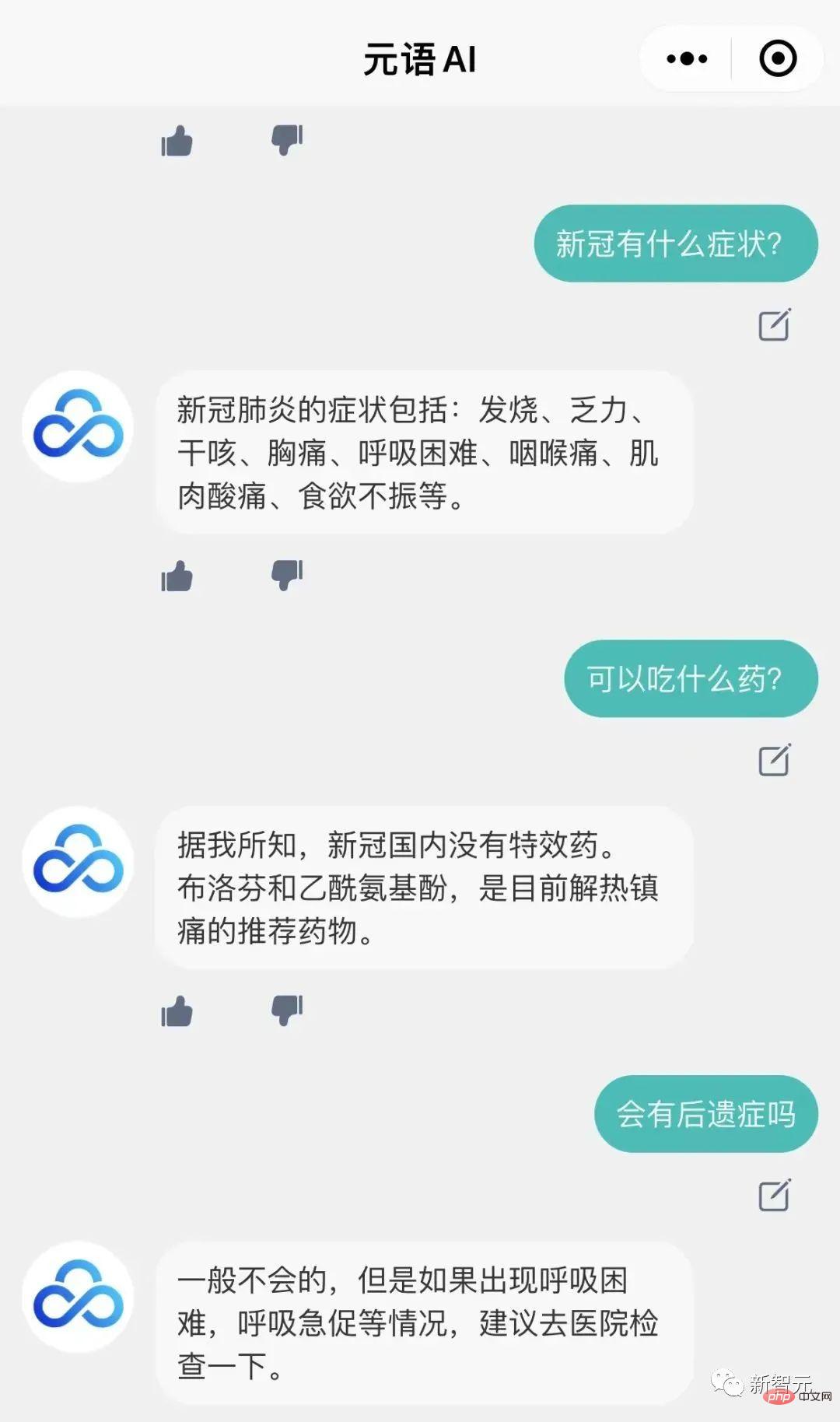

前段時間,元語智慧開發團隊訓練了一個類似ChatGPT的功能型對話大模型ChatYuan,並在網頁版中開放了試玩介面。

現在你也可以在自己的機器上部署一個ChatYuan了!

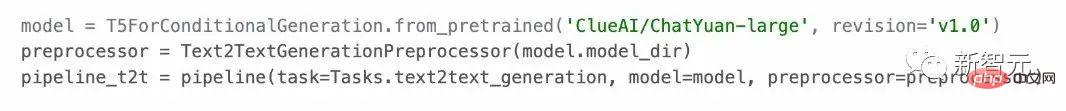

模型可用於問答場景,能夠結合上下文做對話、做各種生成任務,包括創意寫作,也能回答法律、新冠等領域類問題。

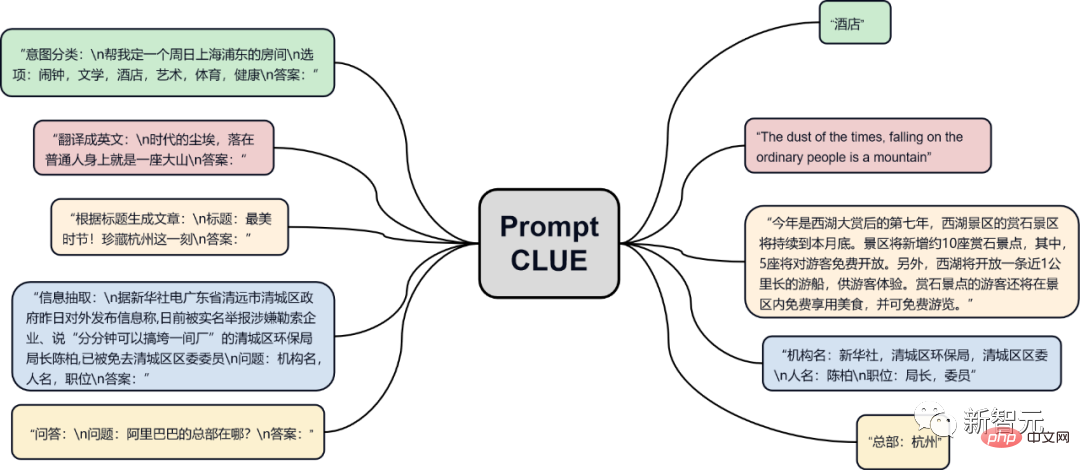

並且在全中文任務中支援零樣本學習,使用者可以透過提供prompt的方式來使用,支援文字產生、資訊擷取和理解大類下近30多種中文任務。

ChatYuan基於PromptCLUE-large結合數億個功能問答和多輪對話資料進一步訓練得到,模型參數量7.7億,顯存6G左右,一張民用顯示卡即可載入使用,目前模型已開放下載。

PromptCLUE在1000億token中文語料上預先訓練,累計學習1.5兆中文token,並且在數百種任務上進行Prompt任務式訓練。

針對理解類別任務,如分類、情緒分析、抽取等,可以自訂標籤體系;針對多種生成任務,可以進行採樣自由生成。

如何使用

1. Github

專案網址:https://github.com/clue-ai/ChatYuan

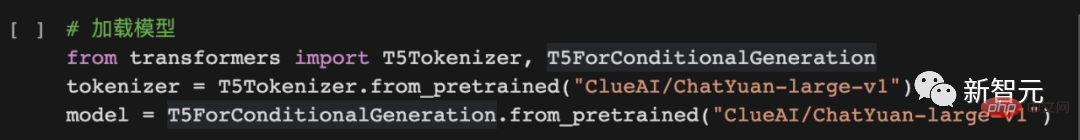

#2. Huggingface

#專案位址:https://huggingface.co/ClueAI/ChatYuan- large-v1

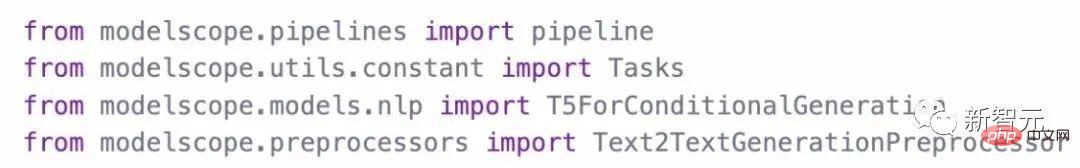

3. ModelScope

#使用模型進行預測推理方法:

############################################## ##4. PaddlePaddle###############################專案網址:###https://aistudio.baidu.com /aistudio/projectdetail/5404182#########模式位址:https://huggingface.co/ClueAI/ChatYuan-large-v1-paddle

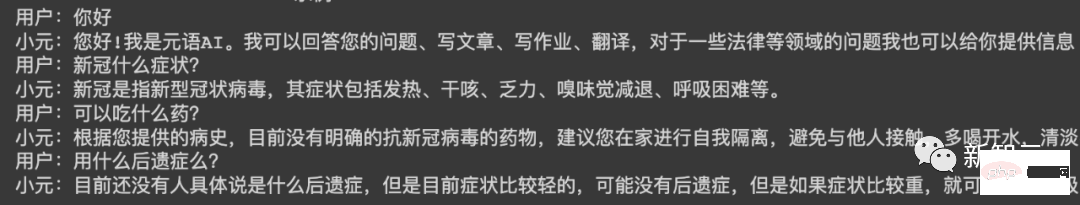

使用自有資料訓練模型

1. 組織資料

將資料組織成統一的格式,由兩部分構成:輸入( Input)和輸出(Output)。

針對單輪問答或產生:

##輸入文字

##輸出(Output):系統需要預測的文本,如下圖中「小元」後的內容。

針對多輪對話:

輸出(Output):系統需要預測的文本,如下圖中「小元」後的內容。

單輪對話資料格式:

#多輪對話資料格式:

#2. 訓練模型

訓練程式碼可以參考:

#使用pCLUE資料集進行訓練、預測和效果驗證, pytorch實作-線上colab。

Github專案:https://colab.research.google.com/drive/1lEyFhEfoc-5Z5xqpEKkZt_iMaojH1MP_ ?usp=sharing

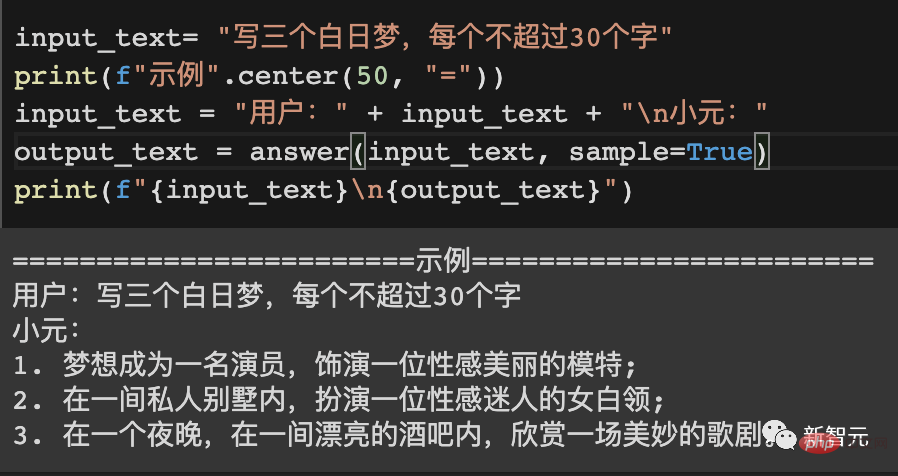

舉例#==========範例1======= ===

使用者:

#你能幹嘛

小元:

您好!我是元語AI。我可以回答您的問題、寫文章、寫作業、翻譯,對於一些法律等領域的問題我也可以提供你資訊。

==========範例2==========

#用戶:

寫一首詩歌,關於冬天

小元:

冬夜寂靜冷,

雲在天邊飄,

冰封白雪上,

寒冷像一場雪。

######雪花融化成冰,############像那雪花飄灑,############在寒冷的冬天,############感受春天的喜悅。 ############冬日裡,############風雪漸消,############一片寂靜,### ###把快樂和溫暖帶回家。

==========範例3==========

#使用者:

學前教育專業職位實習中,在學生方面會存在問題,請提出改進措施。 800字

小元:

#在學前教育專業工作實習中,學生方面會存在一些問題,如學生缺乏專業知識、缺乏合作意識、缺乏基本的責任感等等,需要我們採取措施,來解決這些問題。

首先,在實習過程中,我們需要培養學生的團隊意識,加強學生與老師之間的合作,加強與家長之間的溝通,並提高他們的溝通能力。另外,我們也需要加強學生的獨立性,讓學生學習獨立思考,學會和老師、家長溝通,培養獨立自主。

此外,在日常的工作中,我們也要提供學生適當的機會和機會,讓學生多接觸社會、多參與社會活動,加深他們對社會、學校的認識,培養他們主動、積極和創新的精神。

最後,我們還需要重視學生在實習中出現的問題,尤其是學生缺乏合作,有依賴心理,不懂得分享,有拖延行為等,這些學生應該引起我們的重視,制定合理的改進措施,改善這些問題。

技術與訓練過程

ChatYuan是在PromptCLUE基礎上進一步訓練所獲得的模型。它去掉了文字理解、資訊擷取類別任務,加強了問答、對話和各種生成式任務的學習和訓練;

針對多輪對話容易受到情境的干擾,加入了抗干擾數據使得模型可以在必要時忽略無關的上下文;加入了用戶反饋數據的學習,使得模型不僅具有一定的通用語言理解能力、特定任務上的生成能力,也能更好的響應用戶的意圖。

PromptCLUE的學習過程

- 三大統一:統一模型架構(text-to-text),統一任務形式(prompt),統一應用方式(zero-shot/few-shot)(T0)

- 大規模預訓練:在t5-large版基礎上,使用數百G中文語料,訓練了100萬步,累積訓練了1.5萬億個中文字詞級別token

- 大規模任務數據:使用了16種任務類型,數百種任務,累積億級任務資料

- 混合預訓練:一方面將下游任務作為預訓練語料,另一方面將下游任務和預訓練語料一起訓練,減少任務災難遺忘以及縮短預訓練和下游任務的距離,更好的適應下游任務(ExT5)

- 混合採樣:針對眾多數據量差異極大的任務,採用在每個訓練batch內對所有的任務進行依照比例採樣,根據任務的資料量進行平滑採樣,並且同時限制任務資料量採樣池的上限。平滑採樣可以減少任務訓練有偏危害,在每一batch內訓練可以減少異質任務之間訓練負遷移的情況(T5)

- 分階段訓練:一方面指在預訓練分階段,涉及訓練序列長度的分階段(128和512),加快預訓練速度(Bert);另一方面,在下游訓練分階段, 涉及學習率和序列長度的變化以及遞減式對下游任務的資料量限制,更好的適應下游的不同任務。

- 增加語言模型的訓練:參考t5.1.1, 除了使用Span Corrpution建構的方式進行無監督訓練,同時在使用prefix LM的方式訓練,增強生成任務的能力(LM adapted)

- 增加對模型的encoder以及decoder的訓練:根據下游任務資料分別建構Data_text,Data_target預訓練資料語料,加入到預訓練中,分別增強模型的encoder理解能力和decoder的生成能力(見UIE)

- 重新建構模型中文字典:使用sentencepiece在千億token上學習並建立模型字典,更符合中文語言習慣

後續工作

##目前版本可以進行問答、對話和各種創意性寫作或文本生成,相對於線上的版本,它的意圖理解和生成能力在一些場合還有比較大的提升空間;它也還不能較好實現推理或複雜的任務。之後,會根據回饋進一步改進現有版本。

以上是部署國產ChatGPT僅需6G顯存! ChatYuan模型開放下載:業界首個功能對話開源中文大模型的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

十個推薦開源免費文字標註工具

Mar 26, 2024 pm 08:20 PM

十個推薦開源免費文字標註工具

Mar 26, 2024 pm 08:20 PM

文字標註工作是將標籤或標記與文字中特定內容相對應的工作。其主要目的是為文本提供額外的信息,以便進行更深入的分析和處理,尤其是在人工智慧領域。文字標註對於人工智慧應用中的監督機器學習任務至關重要。用於訓練AI模型,有助於更準確地理解自然語言文本訊息,並提高文本分類、情緒分析和語言翻譯等任務的表現。透過文本標註,我們可以教導AI模型識別文本中的實體、理解上下文,並在出現新的類似數據時做出準確的預測。本文主要推薦一些較好的開源文字標註工具。 1.LabelStudiohttps://github.com/Hu

15個值得推薦的開源免費圖片標註工具

Mar 28, 2024 pm 01:21 PM

15個值得推薦的開源免費圖片標註工具

Mar 28, 2024 pm 01:21 PM

圖像標註是將標籤或描述性資訊與圖像相關聯的過程,以賦予圖像內容更深層的含義和解釋。這個過程對於機器學習至關重要,它有助於訓練視覺模型以更準確地識別圖像中的各個元素。透過為圖像添加標註,使得電腦能夠理解圖像背後的語義和上下文,從而提高對圖像內容的理解和分析能力。影像標註的應用範圍廣泛,涵蓋了許多領域,如電腦視覺、自然語言處理和圖視覺模型具有廣泛的應用領域,例如,輔助車輛識別道路上的障礙物,幫助疾病的檢測和診斷透過醫學影像識別。本文主要推薦一些較好的開源免費的圖片標註工具。 1.Makesens

ChatGPT 現在允許免費用戶使用 DALL-E 3 產生每日限制的圖像

Aug 09, 2024 pm 09:37 PM

ChatGPT 現在允許免費用戶使用 DALL-E 3 產生每日限制的圖像

Aug 09, 2024 pm 09:37 PM

DALL-E 3 於 2023 年 9 月正式推出,是比其前身大幅改進的車型。它被認為是迄今為止最好的人工智慧圖像生成器之一,能夠創建具有複雜細節的圖像。然而,在推出時,它不包括

手機怎麼安裝chatgpt

Mar 05, 2024 pm 02:31 PM

手機怎麼安裝chatgpt

Mar 05, 2024 pm 02:31 PM

安裝步驟:1、在ChatGTP官網或手機商店下載ChatGTP軟體;2、開啟後在設定介面中,選擇語言為中文;3、在對局介面中,選擇人機對局並設定中文相譜;4 、開始後在聊天視窗中輸入指令,即可與軟體互動。

建議:優秀JS開源人臉偵測辨識項目

Apr 03, 2024 am 11:55 AM

建議:優秀JS開源人臉偵測辨識項目

Apr 03, 2024 am 11:55 AM

人臉偵測辨識技術已經是一個比較成熟且應用廣泛的技術。而目前最廣泛的網路應用語言非JS莫屬,在Web前端實現人臉偵測辨識相比後端的人臉辨識有優勢也有弱勢。優點包括減少網路互動、即時識別,大大縮短了使用者等待時間,提高了使用者體驗;弱勢是:受到模型大小限制,其中準確率也有限。如何在web端使用js實現人臉偵測呢?為了實現Web端人臉識別,需要熟悉相關的程式語言和技術,如JavaScript、HTML、CSS、WebRTC等。同時也需要掌握相關的電腦視覺和人工智慧技術。值得注意的是,由於Web端的計

阿里7B多模態文件理解大模型拿下新SOTA

Apr 02, 2024 am 11:31 AM

阿里7B多模態文件理解大模型拿下新SOTA

Apr 02, 2024 am 11:31 AM

多模態文件理解能力新SOTA!阿里mPLUG團隊發布最新開源工作mPLUG-DocOwl1.5,針對高解析度圖片文字辨識、通用文件結構理解、指令遵循、外部知識引入四大挑戰,提出了一系列解決方案。話不多說,先來看效果。複雜結構的圖表一鍵識別轉換為Markdown格式:不同樣式的圖表都可以:更細節的文字識別和定位也能輕鬆搞定:還能對文檔理解給出詳細解釋:要知道,“文檔理解”目前是大語言模型實現落地的一個重要場景,市面上有許多輔助文檔閱讀的產品,有的主要透過OCR系統進行文字識別,配合LLM進行文字理

1.3ms耗時!清華最新開源行動裝置神經網路架構 RepViT

Mar 11, 2024 pm 12:07 PM

1.3ms耗時!清華最新開源行動裝置神經網路架構 RepViT

Mar 11, 2024 pm 12:07 PM

论文地址:https://arxiv.org/abs/2307.09283代码地址:https://github.com/THU-MIG/RepViTRepViT在移动端ViT架构中表现出色,展现出显著的优势。接下来,我们将探讨本研究的贡献所在。文中提到,轻量级ViTs通常比轻量级CNNs在视觉任务上表现得更好,这主要归功于它们的多头自注意力模块(MSHA)可以让模型学习全局表示。然而,轻量级ViTs和轻量级CNNs之间的架构差异尚未得到充分研究。在这项研究中,作者们通过整合轻量级ViTs的有效

單卡跑Llama 70B快過雙卡,微軟硬生把FP6搞到A100哩 | 開源

Apr 29, 2024 pm 04:55 PM

單卡跑Llama 70B快過雙卡,微軟硬生把FP6搞到A100哩 | 開源

Apr 29, 2024 pm 04:55 PM

FP8和更低的浮點數量化精度,不再是H100的「專利」了!老黃想讓大家用INT8/INT4,微軟DeepSpeed團隊在沒有英偉達官方支援的條件下,硬生在A100上跑起FP6。測試結果表明,新方法TC-FPx在A100上的FP6量化,速度接近甚至偶爾超過INT4,而且比後者擁有更高的精度。在此基礎之上,還有端到端的大模型支持,目前已經開源並整合到了DeepSpeed等深度學習推理框架中。這項成果對大模型的加速效果也是立竿見影──在這種框架下用單卡跑Llama,吞吐量比雙卡還要高2.65倍。一名