如何以緊湊型語音表徵打造高性能語音合成系統

小紅書多媒體智慧演算法團隊和香港中文大學首次共同提出了基於多階段多碼本緊湊型語音表徵的高效能語音合成方案 MSMC-TTS。基於向量量化變分自編碼器(VQ-VAE)的特徵分析器採用若干碼本對聲學特徵進行階段式編碼,形成一組具有不同時間解析度的隱序列集合。這些隱序列可以由多階段預測器從文字中預測獲得,並且透過神經聲碼器轉換成目標音訊。該方案,對比基於Mel-Spectrogram的Fastspeech 基線系統,音質和自然度有明顯的改善。該工作現已總結成論文 “A Multi-Stage Multi-Codebook VQ-VAE Approach to High-Performance Neural TTS”,並被語音領域會議 INTERSPEECH 2022 接收。

一、背景介紹

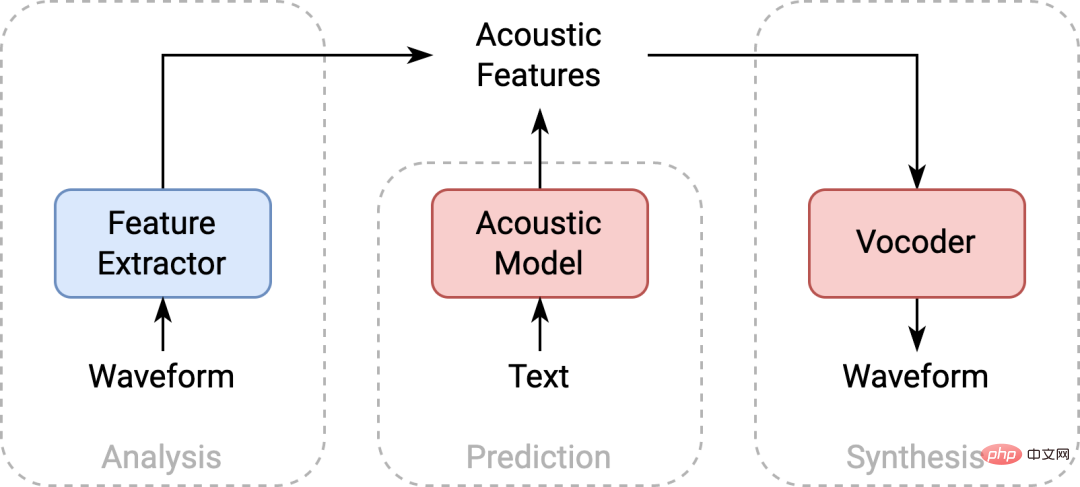

語音合成(Text-to-Speech, 簡稱TTS)是將文字轉化為語音的一種技術,被廣泛應用於視訊配音、影音內容創作、智慧人機互動等產品中。主流語音合成系統後端的聲學建模技術通常包括特徵提取器,聲學模型和聲碼器三個部分。 TTS 通常會對基於訊號處理獲得的聲學特徵(例如梅爾譜Mel Spectrogram)進行聲學建模,但受限於模型的擬合能力,預測得到的聲學特徵和真實數據在分佈上存在一定差異,這導致在真實資料上訓練的聲碼器難以從預測特徵中產生高品質音訊。

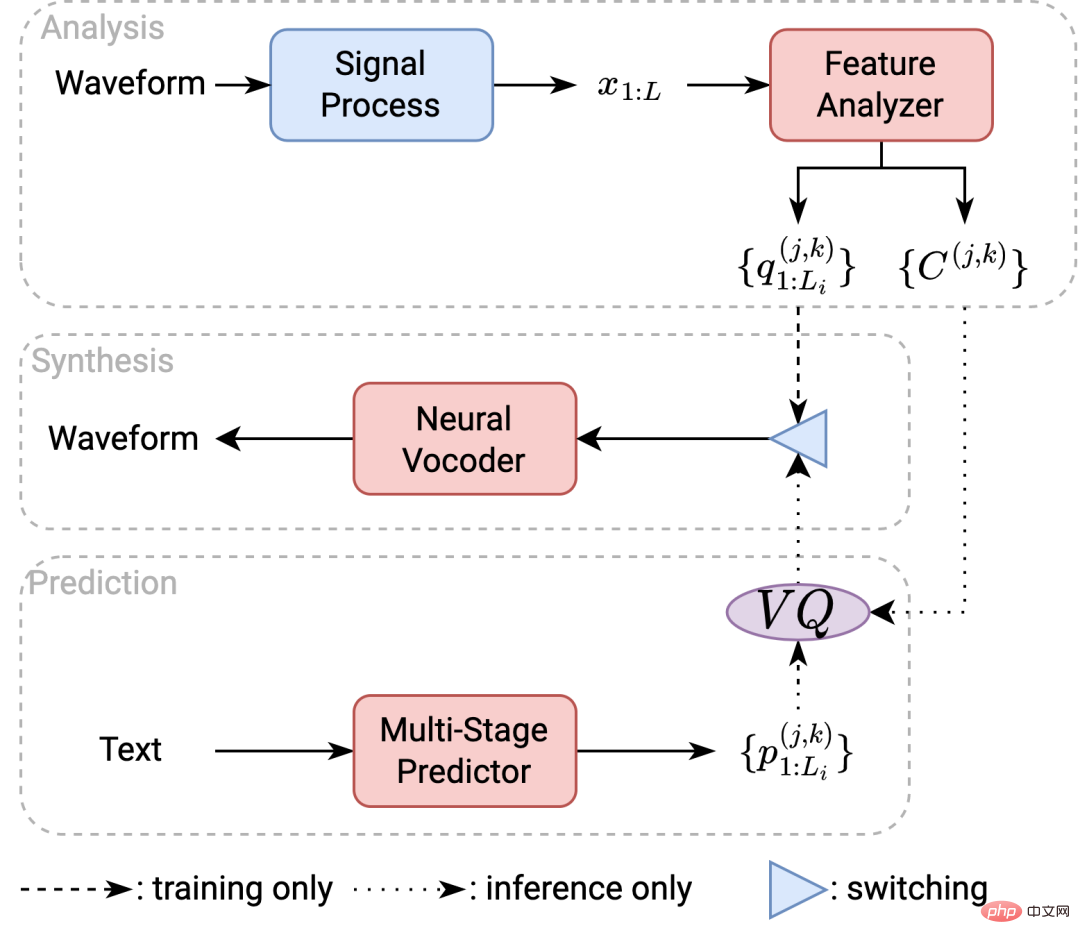

TTS 系統框架圖

針對這一難題,學界使用了更複雜的模型結構和更新穎的生成式演算法以減少預測誤差和縮小分佈差異。而本工作另闢蹊徑,以緊湊型語音表徵為出發點來考慮問題。對語音合成來說,1)聲學特徵良好的緊湊性能夠保證更為準確的模型預測結果和更魯棒的波形生成;2)聲學特徵良好的完備性能夠保證更好地重構語音信號。基於這兩點考慮,本文提出採用向量量化變分自編碼器(VQ-VAE)從目標資料中挖掘出更好的緊湊型表示。

二、表徵學習 MSMC VQ-VAE

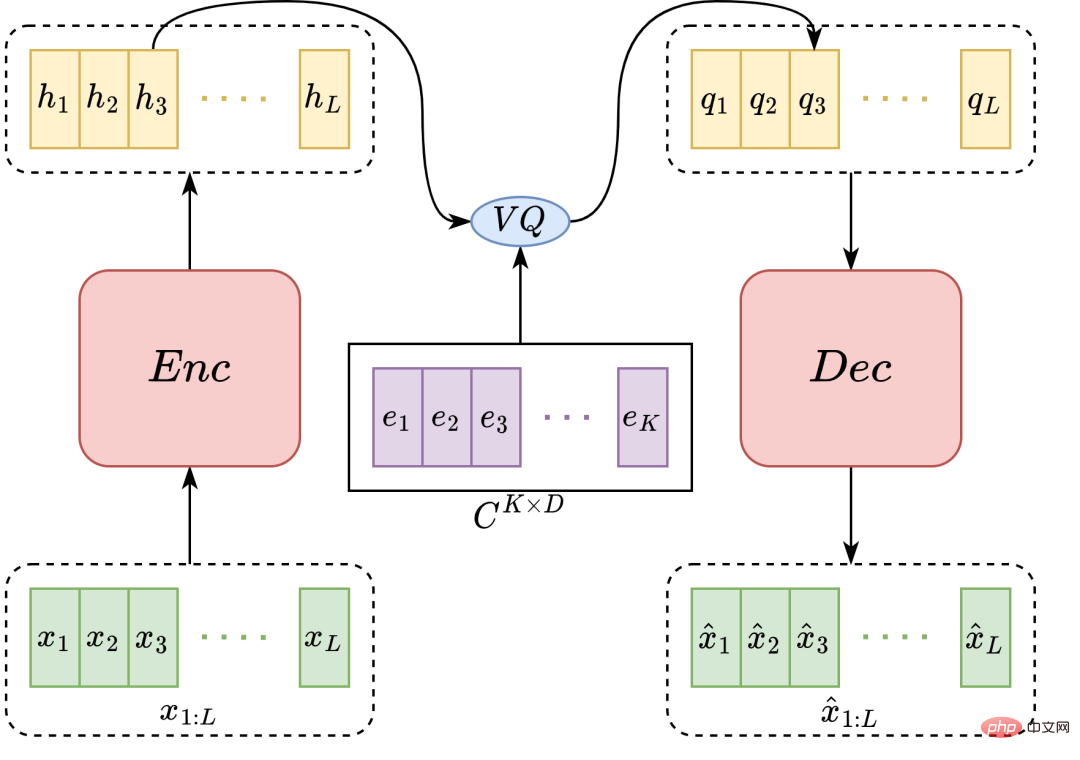

VQ-VAE 包含編碼器與解碼器。編碼器將輸入聲學特徵序列加工為隱序列並以對應碼本進行量化。而解碼器把經過量化的序列恢復為原始聲學特徵序列。這種量化序列作為離散化表徵具有較好的緊湊性(特徵參數量較少)。其中量化程度越高,即碼本容量越小,特徵緊湊程度越高。但這也造成了資訊壓縮,使特徵完備度變差。為了確保足夠的完備性,一般都會使用更多的碼字。但隨著碼本容量的增加,碼本更新所需的資料量以及訓練次數將呈指數級遞增,這使得 VQ-VAE 難以透過增大碼本來有效增強表徵完備性。針對此問題,本文提出多頭向量量化(MHVQ)方法。

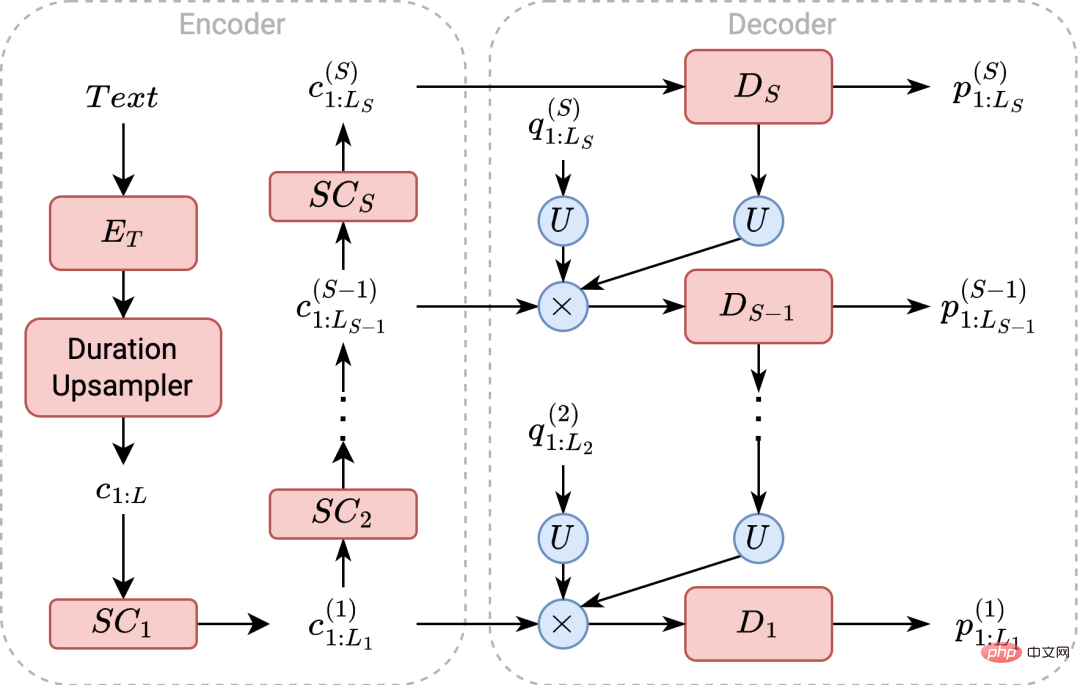

VQ-VAE 模型結構圖

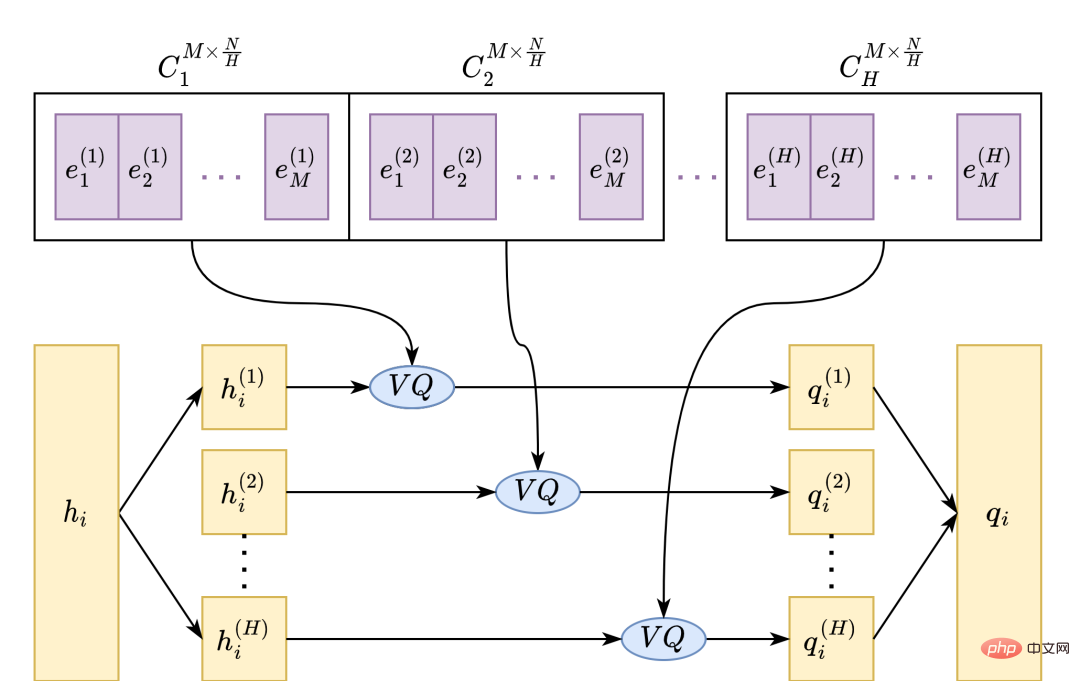

MHVQ 將單一碼本依特徵維度方向均分為若干個子碼本。量化時也將每個輸入向量相等地切割成若干個子向量,並分別以對應子碼本量化,最終拼接成輸出向量。這樣我們就能更有效地提高碼本利用率及表徵容量,而無需增加碼本參數量。例如,要讓壓縮率減少1倍,碼字本來要增加到原碼本數的平方。採用 MHVQ 後,只要把碼本切分成兩部分就可以達到相同的壓縮率。因此,本方法能夠更有效地調節量化表徵的完備性。

MHVQ 範例圖

另外在對語音序列進行量化時,語音特徵中蘊含的各類訊息都有不同程度地遺失。這些資訊在時間粒度上是不一樣的,如粗粒度的音色,發音風格等,以及細粒度的音調,發音細節等。在任何時間尺度上過度壓縮訊息都可能使語音品質遭到一定程度的破壞。為了緩解這個問題,本工作提出了一種多時間尺度的語音建模方法。如圖所示,聲學特徵序列透過若干個編碼器將聲學特徵序列階段式編碼至不同時間尺度,然後再透過解碼器端逐層量化,解碼得到若干個具有不同時間解析度的量化序列。這類序列集合構成的表徵, 即為本工作提出的多階段多碼本表徵。

多階段建模範例圖

#三、聲學建模MSMC-TTS

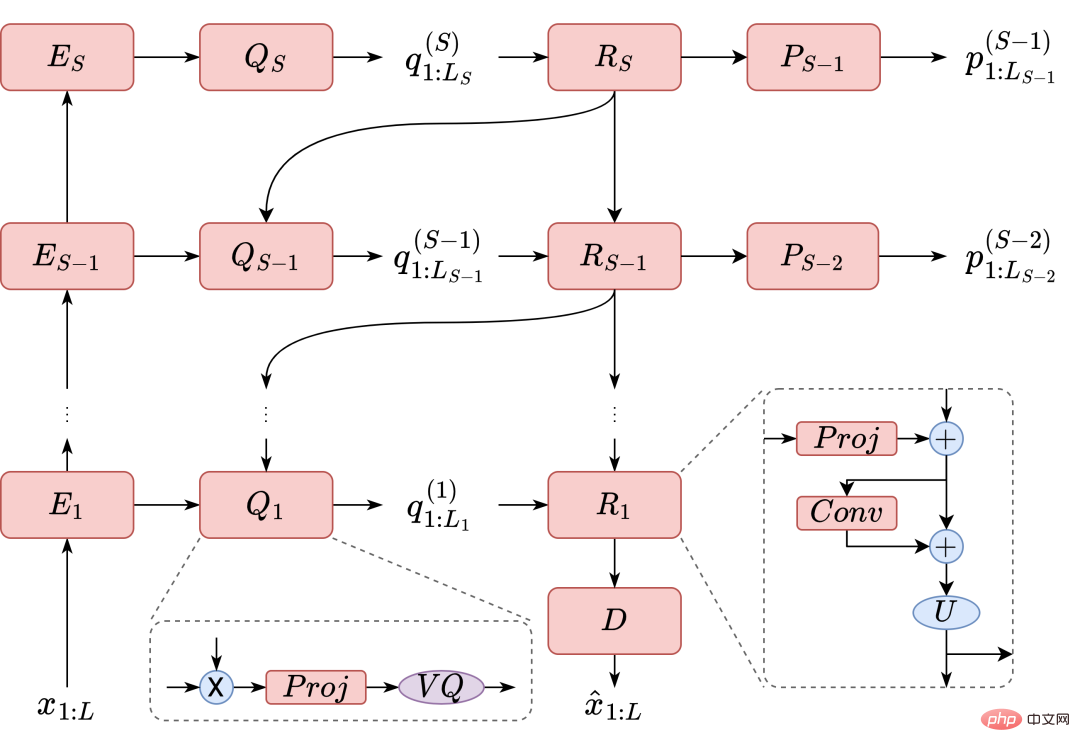

針對多階段多碼本表徵MSMCR ,本論文提出了對應的TTS 系統,即MSMC-TTS 系統。系統包括分析、合成和預測3個部分。在系統訓練中,此系統先對分析模組進行訓練。訓練集中的音訊經過訊號處理後轉換為高完備性聲學特徵(如本次工作中所使用的 Mel-Spectrogram 特徵)。利用這些聲學特徵對基於 MSMC-VQ-VAE 的特徵分析器進行訓練,訓練結束時將其轉換為對應的MSMCR,再對聲學模型及神經聲碼器進行訓練。解碼過程中,此系統利用聲學模型從文字中預測 MSMCR,然後利用神經聲碼器產生目標音訊。

MSMC-TTS 系統框架圖

本工作也提出一種多階段預測器來適應MSMCR 建模。該模型是以 FastSpeech 為基礎實現的,但在解碼器端有所不同。該模型首先對文字進行編碼,並根據預測時長資訊對文字上採樣。然後再將序列降採樣至 MSMCR 對應的各個時間解析度。這些序列將由不同解碼器由低解析度向高分辨率逐級解碼量化。同時將低解析度量化序列傳送給下一階段的解碼器以協助預測。最後將預測所得 MSMCR 送入神經聲碼器中產生目標音訊。

多階段預測器結構圖

對多階段預測器進行訓練與推論時,本工作選擇直接在連續空間預測目標表徵。此方法能較好地顧及向量間及碼字間在線性連續空間上的距離關係。訓練準則除了採用常用於 TTS 建模的 MSE 損失函數外,還使用了 “triplet loss” 以迫使預測向量遠離非目標碼字並靠近目標碼字。透過將兩種損失函數項組合,該模型能夠更好地預測目標碼字。

四、實驗效果

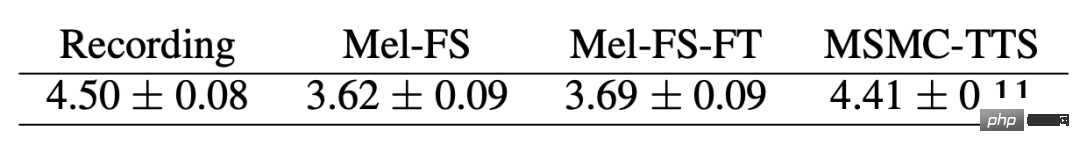

本工作在公開的英文單說話人資料集 Nancy (Blizzard Challenge 2011) 上進行實驗。我們組織了主觀意見得分測試 (MOS)對 MSMC-TTS 合成效果進行評估。實驗結果顯示:原始錄音為 4.50 分的情況下, MSMC-TTS 的得分為 4.41分,基線系統 Mel-FS(Mel-Spectrogram based FastSpeech)為 3.62 分。我們對基線系統的聲碼器進行調優,使其與Mel-FS輸出特徵相適配,結果為 3.69 分。此對比結果證明了文中所提方法對 TTS 系統的顯著改善作用。

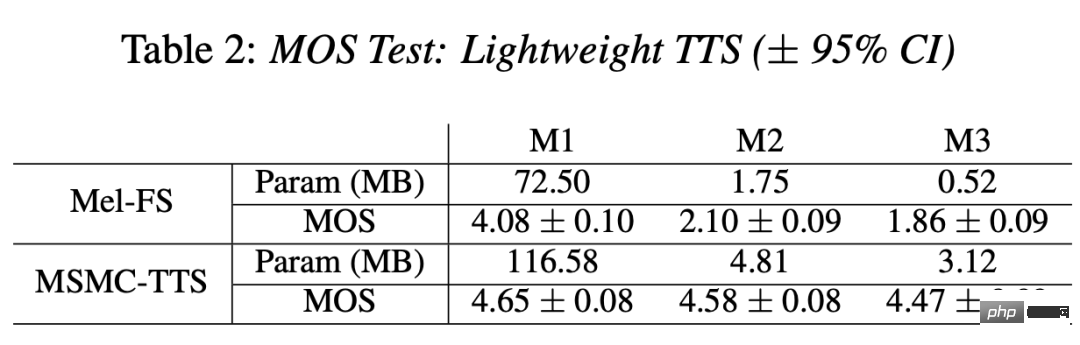

另外我們也進一步討論了建模複雜度對於 TTS 的效能影響。由 M1 至 M3 模型參數量呈倍數下降, Mel-FS 合成效果降至 1.86 分。反觀 MSMC-TTS, 參數量減少並未對合成品質造成顯著的影響。當聲學模型參數量為 3.12 MB 時, MOS 仍可保持 4.47 分。這既證明了以緊湊型特徵為基礎的 MSMC-TTS 建模複雜度需求較低,同時也展示了此方法應用於輕量級 TTS 系統的潛力。

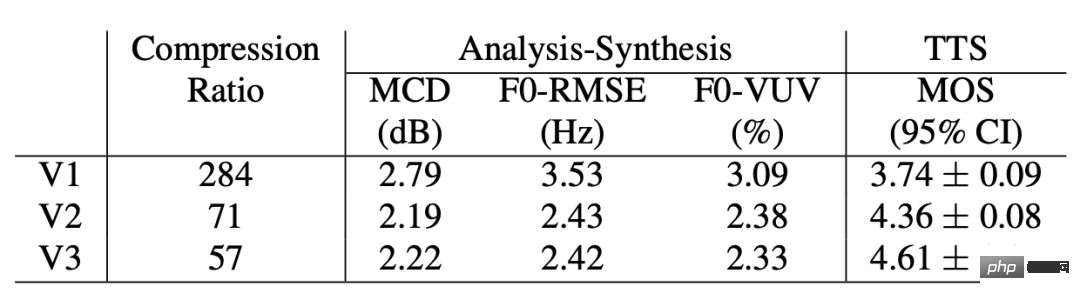

最後我們在不同MSMCR 基礎上進行了MSMC-TTS 比較,以探討MHVQ 與多階段建模對TTS 的影響。其中 V1 系統採用單階段單碼本的表徵, V2 系統基於 V1 採用 4-head 向量量化, V3 系統則基於 V2 採用兩階段建模。首先,V1 系統所使用的表徵擁有最高的特徵壓縮比,但在分析合成實驗中表現出最低的完備性,同時在 TTS 實驗中表現出最差的合成品質。經過 MHVQ 增強完備性, V2 系統在 TTS 效果上也得到了明顯提升。 V3 所使用的多階段表徵雖然沒有展現進一步完備性的提升,但是在 TTS 上展現出了最佳的效果,無論是韻律自然度還是音頻質量均有明顯改善。這進一步顯示多階段建模、多尺度資訊保留在MSMC-TTS 中具有重要意義。

五、總結

該工作從研究緊湊型語音表徵角度出發,提出一套新的高性能 TTS(MSMC-TTS)建模方法。系統從音訊中擷取多階段多碼本表徵,以取代傳統聲學特徵。輸入文字可被多階段預測器轉換為這種由多個時間解析度不同的序列組成的語音表徵,並透過神經聲碼器轉換到目標語音訊號。實驗結果表明,相較於主流的基於 Mel-Spectrogram 的 FastSpeech 系統,該系統展示出了更優秀的合成質量,以及對建模複雜度更低的要求。

六、作者資訊

郭浩瀚:小紅書多媒體智慧演算法團隊實習生。本碩畢業於西北工業大學,期間在 ASLP 實驗室學習,師從謝磊教授。現博士就讀香港中文大學 HCCL 實驗室,師從蒙美玲教授。迄今為止,作為一作,先後在 ICASSP、INTERSPEECH、SLT 國際語音會議上發表論文六篇。

解奉龍:小紅書多媒體智慧演算法團隊語音技術負責人。曾在ICASSP、INTERSPEECH、SPEECHCOM等語音領域會議及期刊發表論文十餘篇, 長期擔任ICASSP、INTERSPEECH等主要語音會議的審稿人,主要研究方向為語音訊號處理與建模。

以上是如何以緊湊型語音表徵打造高性能語音合成系統的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

常用的AI激活函數解析:Sigmoid、Tanh、ReLU和Softmax的深度學習實踐

Dec 28, 2023 pm 11:35 PM

常用的AI激活函數解析:Sigmoid、Tanh、ReLU和Softmax的深度學習實踐

Dec 28, 2023 pm 11:35 PM

激活函數在深度學習中扮演著至關重要的角色,它們能夠為神經網路引入非線性特性,使得網路能夠更好地學習並模擬複雜的輸入輸出關係。正確選擇和使用激活函數對於神經網路的性能和訓練效果有著重要的影響本文將介紹四種常用的激活函數:Sigmoid、Tanh、ReLU和Softmax,從簡介、使用場景、優點、缺點和優化方案五個維度進行探討,為您提供關於激活函數的全面理解。 1.Sigmoid函數SIgmoid函數公式簡介:Sigmoid函數是常用的非線性函數,可以將任何實數映射到0到1之間。它通常用於將不歸一

Python中使用BERT進行情感分析的方法及步驟

Jan 22, 2024 pm 04:24 PM

Python中使用BERT進行情感分析的方法及步驟

Jan 22, 2024 pm 04:24 PM

BERT是由Google在2018年提出的一種預先訓練的深度學習語言模式。全稱為BidirectionalEncoderRepresentationsfromTransformers,它基於Transformer架構,具有雙向編碼的特性。相較於傳統的單向編碼模型,BERT在處理文字時能夠同時考慮上下文的訊息,因此在自然語言處理任務中表現出色。它的雙向性使得BERT能夠更好地理解句子中的語義關係,從而提高了模型的表達能力。透過預訓練和微調的方法,BERT可以用於各種自然語言處理任務,如情緒分析、命名

潛藏空間嵌入:解釋與示範

Jan 22, 2024 pm 05:30 PM

潛藏空間嵌入:解釋與示範

Jan 22, 2024 pm 05:30 PM

潛在空間嵌入(LatentSpaceEmbedding)是將高維度資料對應到低維度空間的過程。在機器學習和深度學習領域中,潛在空間嵌入通常是透過神經網路模型將高維輸入資料映射為一組低維向量表示,這組向量通常被稱為「潛在向量」或「潛在編碼」。潛在空間嵌入的目的是捕捉資料中的重要特徵,並將其表示為更簡潔和可理解的形式。透過潛在空間嵌入,我們可以在低維空間中對資料進行視覺化、分類、聚類等操作,從而更好地理解和利用資料。潛在空間嵌入在許多領域中都有廣泛的應用,如影像生成、特徵提取、降維等。潛在空間嵌入的主要

超越ORB-SLAM3! SL-SLAM:低光、嚴重抖動和弱紋理場景全搞定

May 30, 2024 am 09:35 AM

超越ORB-SLAM3! SL-SLAM:低光、嚴重抖動和弱紋理場景全搞定

May 30, 2024 am 09:35 AM

寫在前面今天我們探討下深度學習技術如何改善在複雜環境中基於視覺的SLAM(同時定位與地圖建構)表現。透過將深度特徵提取和深度匹配方法相結合,這裡介紹了一種多功能的混合視覺SLAM系統,旨在提高在諸如低光條件、動態光照、弱紋理區域和嚴重抖動等挑戰性場景中的適應性。我們的系統支援多種模式,包括拓展單目、立體、單目-慣性以及立體-慣性配置。除此之外,也分析如何將視覺SLAM與深度學習方法結合,以啟發其他研究。透過在公共資料集和自採樣資料上的廣泛實驗,展示了SL-SLAM在定位精度和追蹤魯棒性方面優

超強!深度學習Top10演算法!

Mar 15, 2024 pm 03:46 PM

超強!深度學習Top10演算法!

Mar 15, 2024 pm 03:46 PM

自2006年深度學習概念被提出以來,20年快過去了,深度學習作為人工智慧領域的一場革命,已經催生了許多具有影響力的演算法。那麼,你所認為深度學習的top10演算法有哪些呢?以下是我心目中深度學習的頂尖演算法,它們在創新、應用價值和影響力方面都佔有重要地位。 1.深度神經網路(DNN)背景:深度神經網路(DNN)也叫多層感知機,是最普遍的深度學習演算法,發明之初由於算力瓶頸而飽受質疑,直到近些年算力、數據的爆發才迎來突破。 DNN是一種神經網路模型,它包含多個隱藏層。在該模型中,每一層將輸入傳遞給下一層,並

一文搞懂:AI、機器學習與深度學習的連結與區別

Mar 02, 2024 am 11:19 AM

一文搞懂:AI、機器學習與深度學習的連結與區別

Mar 02, 2024 am 11:19 AM

在當今科技日新月異的浪潮中,人工智慧(ArtificialIntelligence,AI)、機器學習(MachineLearning,ML)與深度學習(DeepLearning,DL)如同璀璨星辰,引領著資訊科技的新浪潮。這三個詞彙經常出現在各種前沿討論和實際應用中,但對於許多初涉此領域的探索者來說,它們的具體含義及相互之間的內在聯繫可能仍籠罩著一層神秘面紗。那讓我們先來看看這張圖。可以看出,深度學習、機器學習和人工智慧之間存在著緊密的關聯和遞進關係。深度學習是機器學習的一個特定領域,而機器學習

從基礎到實踐,回顧Elasticsearch 向量檢索發展史

Oct 23, 2023 pm 05:17 PM

從基礎到實踐,回顧Elasticsearch 向量檢索發展史

Oct 23, 2023 pm 05:17 PM

1.引言向量檢索已成為現代搜尋和推薦系統的核心組件。透過將複雜的物件(例如文字、圖像或聲音)轉換為數值向量,並在多維空間中進行相似性搜索,它能夠實現高效的查詢匹配和推薦。從基礎到實踐,回顧Elasticsearch向量檢索發展史_elasticsearchElasticsearch作為一款流行的開源搜尋引擎,在向量檢索方面的發展也一直備受關注。本文將回顧Elasticsearch向量檢索的發展歷史,重點介紹各階段的特性與進展。以史為鑑,方便大家建立起Elasticsearch向量檢索的全量

AlphaFold 3 重磅問世,全面預測蛋白質與所有生命分子相互作用及結構,準確度遠超以往水平

Jul 16, 2024 am 12:08 AM

AlphaFold 3 重磅問世,全面預測蛋白質與所有生命分子相互作用及結構,準確度遠超以往水平

Jul 16, 2024 am 12:08 AM

编辑|萝卜皮自2021年发布强大的AlphaFold2以来,科学家们一直在使用蛋白质结构预测模型来绘制细胞内各种蛋白质结构的图谱、发现药物,并绘制每种已知蛋白质相互作用的「宇宙图」。就在刚刚,GoogleDeepMind发布了AlphaFold3模型,该模型能够对包括蛋白质、核酸、小分子、离子和修饰残基在内的复合物进行联合结构预测。AlphaFold3的准确性对比过去许多专用工具(蛋白质-配体相互作用、蛋白质-核酸相互作用、抗体-抗原预测)有显著提高。这表明,在单个统一的深度学习框架内,可以实现