ChatGPT真的是「通才」嗎?楊笛一等人給它來了個摸底考試

论文链接:https://arxiv.org/pdf/2302.06476.pdf

大型语言模型(LLM)已经被证明能够解决各种自然语言处理(NLP)任务,而且对于给定的下游任务,它们不依赖任何训练数据,借助适当的 prompt 就能实现模型调整。这种根据指令执行新任务的能力可以被视为迈向通用人工智能的重要一步。

尽管目前的 LLM 在某些情况下取得了不错的性能,但在 zero-shot 学习中仍然容易出现各种错误。此外,prompt 的格式可以产生实质性的影响。例如,在 prompt 中添加「Let’s think step by step」,模型性能就能得到显著提升。这些限制说明当前的 LLM 并不是真正的通用语言系统。

近日,OpenAI 发布的 ChatGPT LLM 在 NLP 社区引发极大关注。ChatGPT 是通过「人类反馈强化学习(RLHF)」训练 GPT-3.5 系列模型而创建的。RLHF 主要包括三个步骤:使用监督学习训练语言模型;根据人类偏好收集比较数据并训练奖励模型;使用强化学习针对奖励模型优化语言模型。通过 RLHF 训练,人们观察到 ChatGPT 在各个方面都具有令人印象深刻的能力,包括对人类输入生成高质量的响应、拒绝不适当的问题以及根据后续对话自我纠正先前的错误。

虽然 ChatGPT 显示出强大的对话能力,但与现有的 LLM 相比,NLP 社区仍然不清楚 ChatGPT 是否获得了更好的 zero-shot 泛化能力。为了填补这一研究空白,研究者们通过在涵盖 7 个代表性任务类别的大量 NLP 数据集上对 ChatGPT 进行评估,系统地研究了它的 zero-shot 学习能力。这些任务包括推理(reasoning)、自然语言推断(natural language inference)、问答(阅读理解)、对话、摘要、命名实体识别和情感分析。借助广泛的实验,研究者旨在回答以下问题:

- ChatGPT 是一个通用的 NLP 任务求解器吗?ChatGPT 在哪些类型的任务上表现良好?

- 如果 ChatGPT 在某些任务上落后于其他模型,那原因是什么?

为了回答这些问题,作者根据实验结果比较了 ChatGPT 和最先进的 GPT-3.5 模型 (text-davinci-003) 的性能。此外,他们还报告了 FLAN、T0 和 PaLM 等近期工作的 zero-shot、微调或 few-shot 微调结果。

主要结论

作者表示,据他们所知,这是第一次有人对 ChatGPT 在各种 NLP 任务上的 zero-shot 能力进行研究,旨在提供 ChatGPT 的初步概况。他们的主要发现如下:

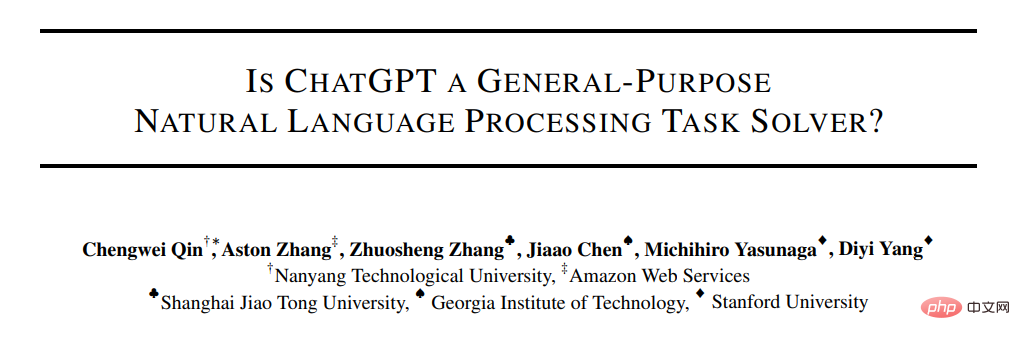

- 雖然ChatGPT 作為一個通才模型顯示了一些可以執行多個任務的能力,但它通常比針對給定任務進行微調的模型表現要差(見圖1 和第4.3 節) 。

- ChatGPT 的卓越推理(reasoning)能力在算術推理任務中得到了實驗證實(第 4.2.1 節)。然而,ChatGPT 在常識、符號和邏輯推理任務中的表現通常不如 GPT-3.5,例如透過產生不確定的反應可以看出來(第 4.2.2 節)。

- ChatGPT 在偏向推理能力的自然語言推論任務(第4.2.3 節)和問答(閱讀理解)任務(第4.2.4 節)方面優於GPT-3.5 ,例如確定文本對中的邏輯關係。具體來說,ChatGPT 更擅長處理與事實一致的文本(即,更擅長對蘊含而不是非蘊含進行分類)。

- ChatGPT 在對話任務方面優於 GPT-3.5(第 4.2.5 節)。

- 在摘要任務方面,ChatGPT 會產生更長的摘要,比 GPT-3.5 表現差。然而,在 zero-shot 指令中明確限制摘要長度會損害摘要質量,從而導致性能降低(第 4.2.6 節)。

- 儘管顯示出作為通才模型的前景,但 ChatGPT 和 GPT-3.5 在某些任務上都面臨挑戰,例如序列標註(第 4.2.7 節)。

- ChatGPT 的情緒分析能力接近 GPT-3.5(第 4.2.8 節)。

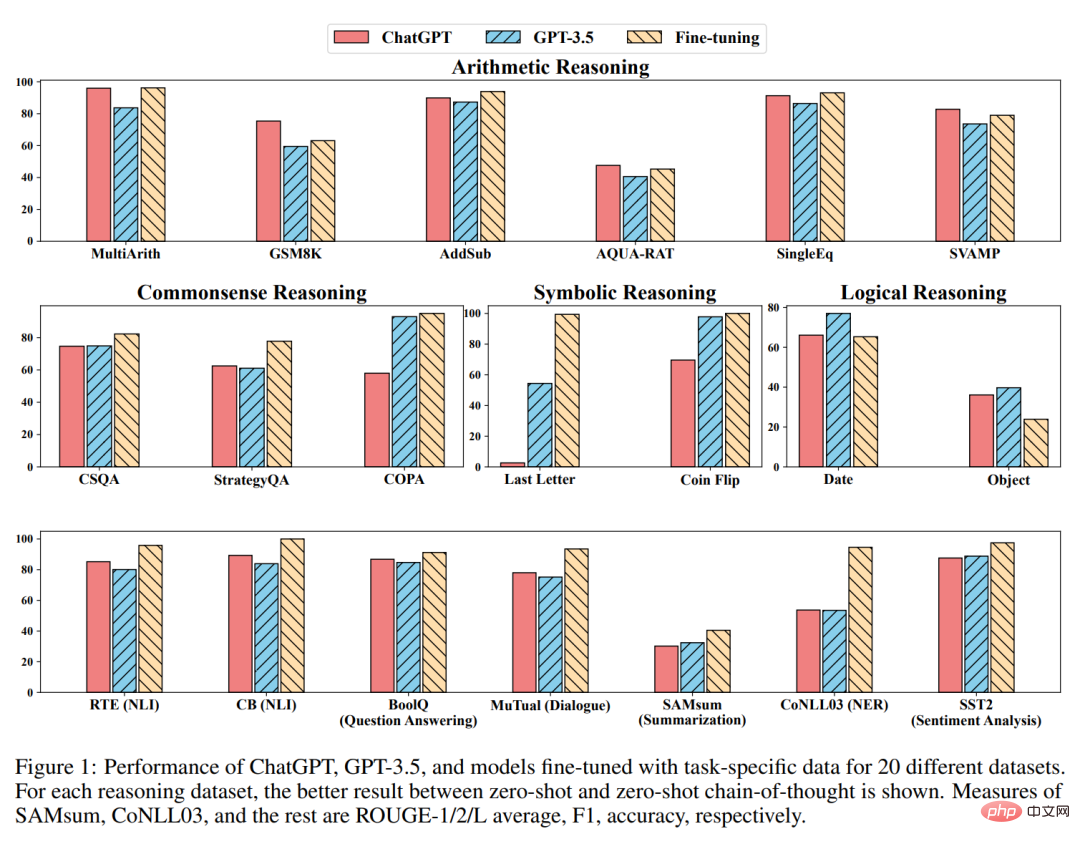

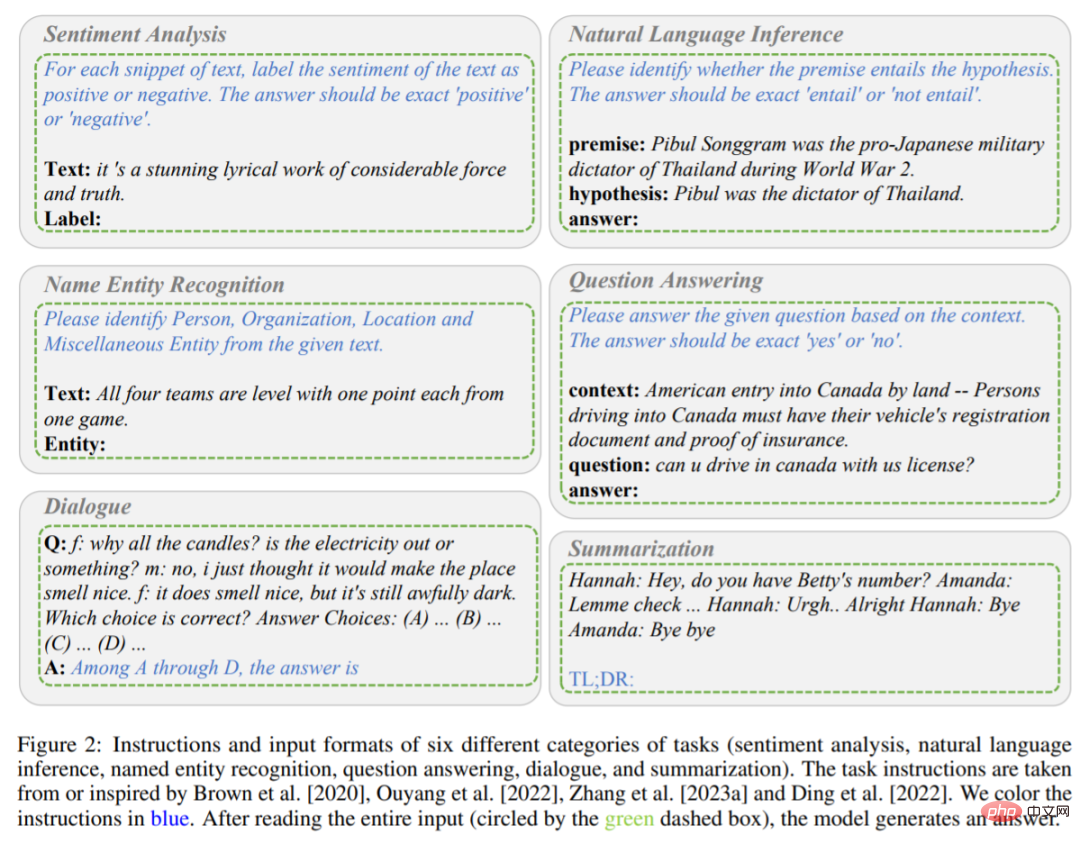

#如前所述,該研究主要比較了ChatGPT 和GPT-3.5 (textdavinci-003) 在不同任務下的zero-shot 學習表現。具體而言,他們將任務指令 P 和測試問題 X 作為輸入,模型以 f 表示,然後產生目標文字 Y = f (P, X) 來解決測試問題。不同任務的指令和輸入格式如圖 2 和圖 3 所示。

#包含六種任務(情緒分析、自然語言推理、命名實體辨識、問答、對話和摘要)的指示和輸入格式。指令為藍色字體。

#推理任務說明。

舉例來說,當模型執行情緒分析任務時,任務指令P 將文字所包含的情緒標記為正面或消極,則輸出的答案為積極或消極。當模型在閱讀了指令 P 和輸入內容 X(內容為一部具有相當力量和真實性的令人驚嘆的抒情作品)後,該模型經過判斷,有望輸出 Y 積極。

與上述單階段 prompting 方法不同的是,研究使用兩階段 prompting(Kojima 等人提出),來完成 zero-shot-CoT。

第一階段採取「讓模型一步一步思考(Let’s think step by step)」,指令 P_1 誘導模型產生基本原理 R。

第二階段採用第一步產生的基本原理 R 以及原始輸入 X 和指令 P_1 作為新的輸入,引導模型產生最終答案。

之後一個新的指令 P_2 作為提取答案的觸發語句。所有任務指令均取自 Brown、Ouyang、Zhang 等人研究,或受其啟發。最後要注意的是,每次對 ChatGPT 進行新的查詢時,都要提前清除對話,以避免前面範例的影響。

實驗

實驗用 20 個不同的資料集來評估 ChatGPT 和 GPT-3.5,涵蓋 7 個類別任務。

算術推理

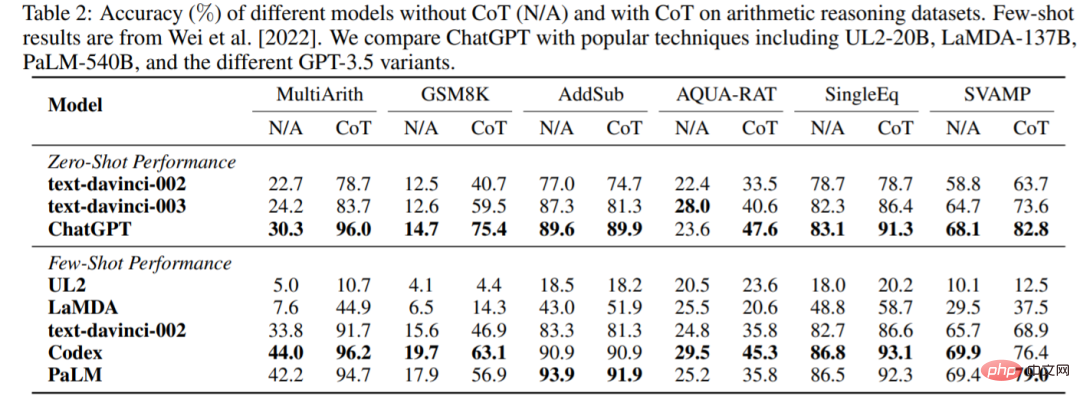

ChatGPT 和 GPT-3.5 在沒有或有 CoT 的情況下,在六個算術推理資料集上的準確率如表 2 所示。在沒有 CoT 的實驗中,ChatGPT 在其中 5 個資料集上的表現優於 GPT-3.5,顯示了其強大的算術推理能力。

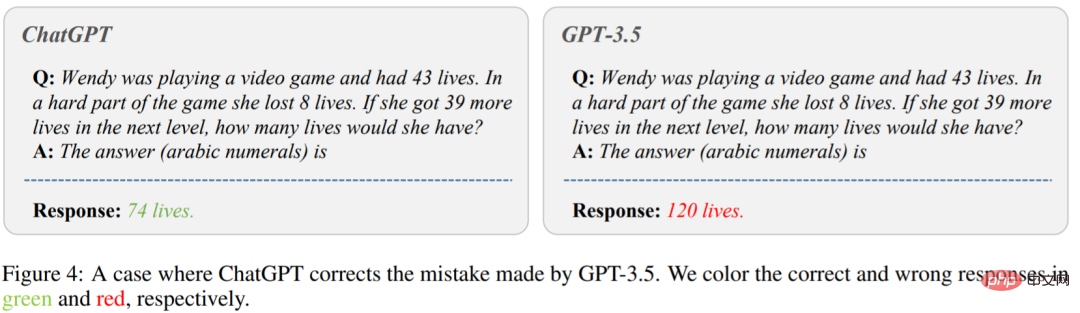

圖 4 顯示了 GPT-3.5 給出錯誤答案的情況。在圖的左側,問「溫迪在玩電子遊戲,有43 條命。在遊戲的艱難部分,她失去了8 條生命。如果她在下一關多得到39 條命,她會有多少條命?」ChatGPT 給了正確答案。然而,GPT-3.5 產生了一個錯誤的答案。可以看出,在使用 CoT 時,ChatGPT 的表現都比 GPT-3.5 好得多。

#常識、符號與邏輯推理

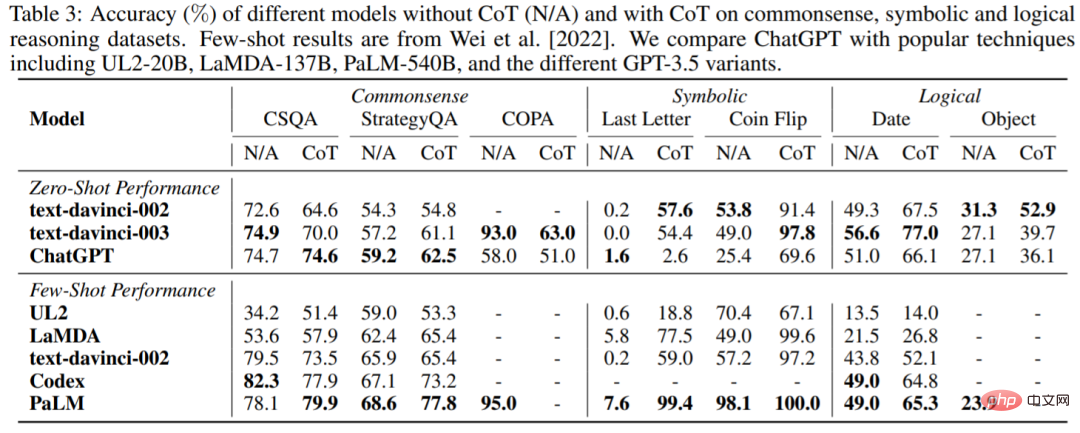

#表3 報告了ChatGPT 與流行LLM 在常識、符號和邏輯推理資料集上的準確率。可以得到如下觀察結果:首先,使用 CoT 可能並不總是在常識推理任務中提供更好的性能,常識推理任務可能需要更細粒度的背景知識。其次,與算術推理不同,ChatGPT 在許多情況下的表現都比 GPT-3.5 差,顯示 GPT-3.5 的相應能力更強。

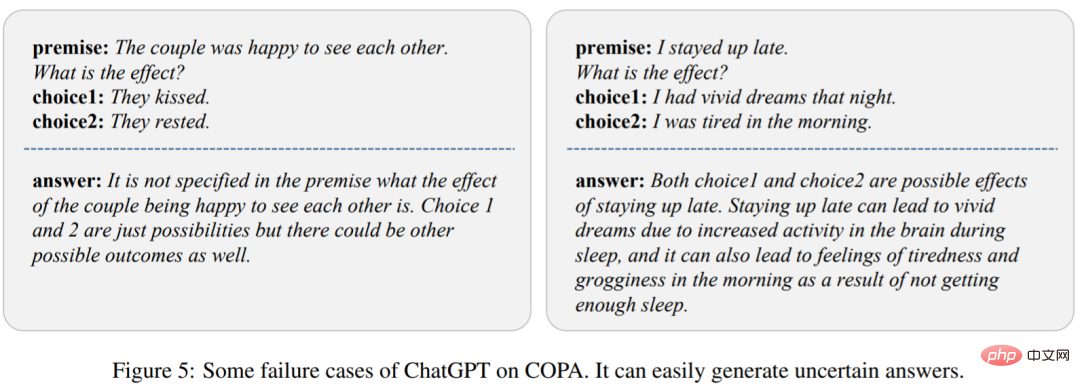

為了分析原因,研究在圖 5 中展示了 ChatGPT 的幾個失敗案例。我們可以觀察到 ChatGPT 很容易產生不確定的反應,導致表現不佳。

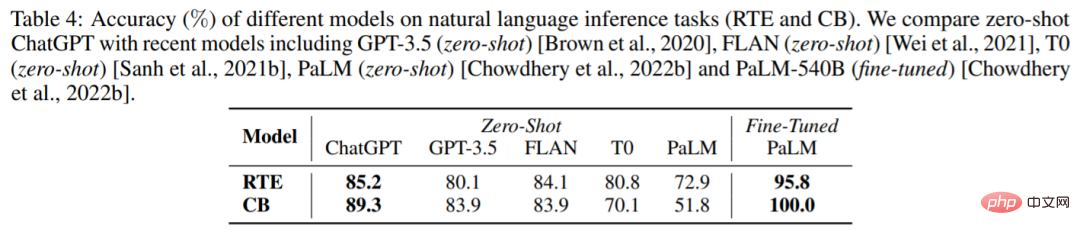

#自然語言推理

表4 展示了不同模型在兩個自然語言推理任務上的結果:RTE 和CB。我們可以看到,在 zero-shot 設定下,ChatGPT 可以取得比 GPT-3.5、FLAN、T0 和 PaLM 更好的效能。這證明 ChatGPT 在 NLP 推理任務中,具有較好的 zero-shot 表現。

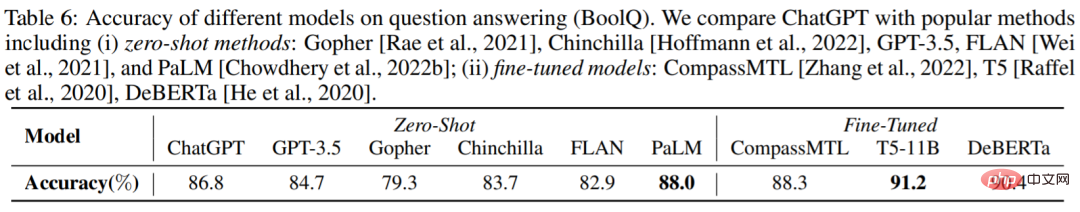

#問答

表6 報告了不同模型在BoolQ 資料集的準確率,ChatGPT 優於GPT-3.5 。這表明 ChatGPT 可以更好地處理推理任務。

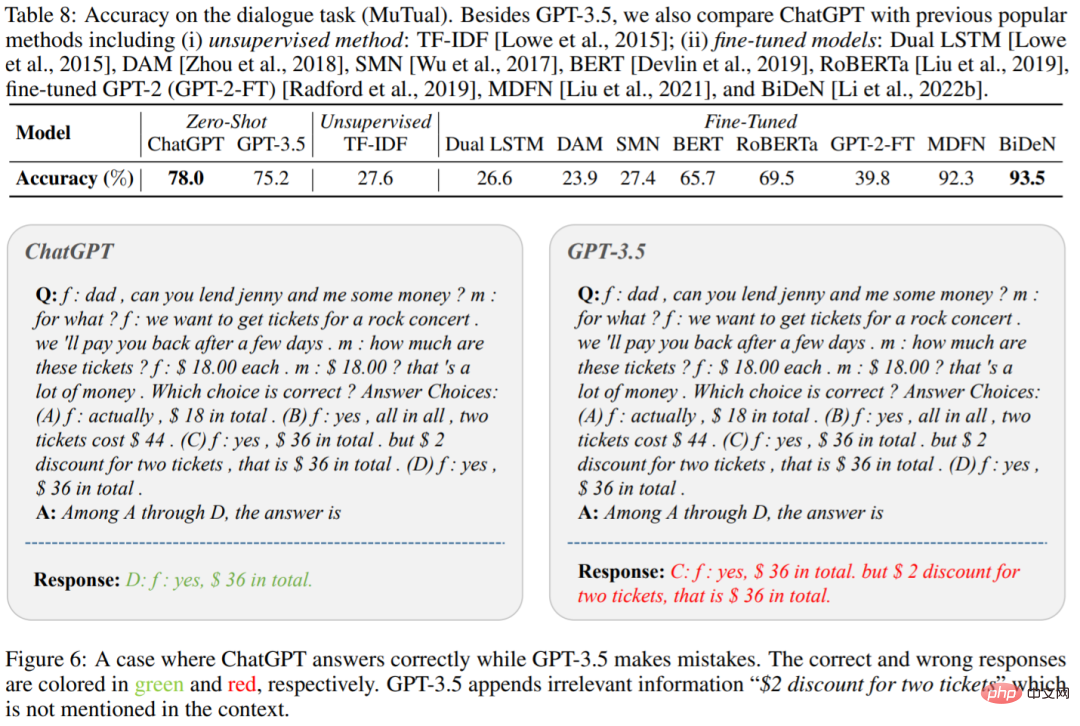

#對話

#表8 中顯示了ChatGPT 和GPT-3.5 在MuTual 資料集(多輪對話推理)上的準確率。正如預期的那樣,ChatGPT 大大優於 GPT-3.5。

圖 6 為一個具體的範例,我們可以看到 ChatGPT 能夠更有效地對給定的上下文進行推理。這再次印證了 ChatGPT 超強的推理能力。

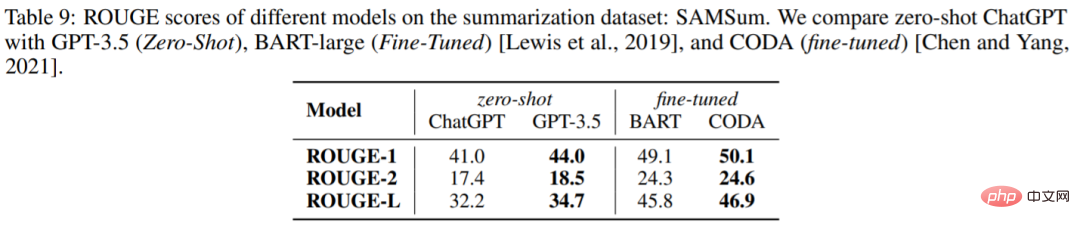

#產生摘要##

表 9 報告 ChatGPT 和 GPT-3.5 在 SAMSum 資料集上的 ROUGE 得分,令人驚訝的是,ChatGPT 在所有指標上都不如 GPT-3.5。

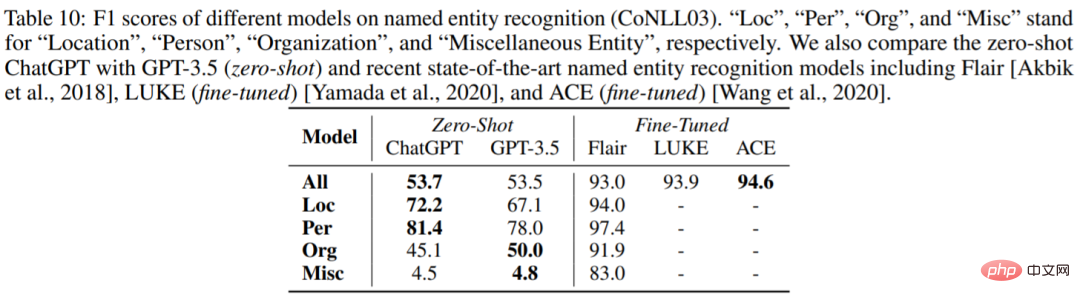

#命名實體識別

表10 報告了ChatGPT 和GPT-3.5 在CoNLL03 上的zero-shot 效能。我們可以看到 ChatGPT 和 GPT-3.5 的整體表現非常相似。

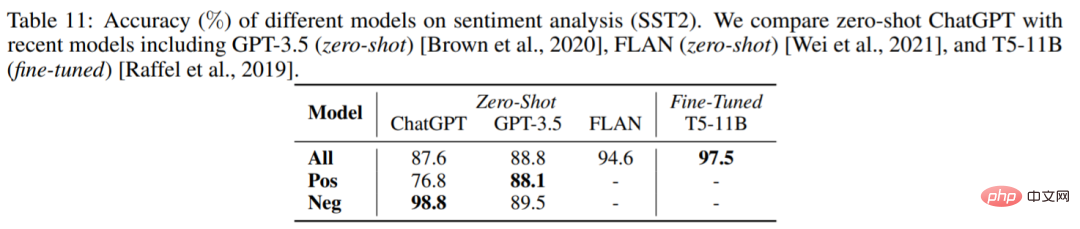

#情緒分析

#表11 比較了不同模型在情緒分析資料集SST2 上的準確率。令人驚訝的是,ChatGPT 的表現比 GPT-3.5 差了約 1%。

#如需了解更多內容,請參考原論文。

以上是ChatGPT真的是「通才」嗎?楊笛一等人給它來了個摸底考試的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

ChatGPT 現在允許免費用戶使用 DALL-E 3 產生每日限制的圖像

Aug 09, 2024 pm 09:37 PM

ChatGPT 現在允許免費用戶使用 DALL-E 3 產生每日限制的圖像

Aug 09, 2024 pm 09:37 PM

DALL-E 3 於 2023 年 9 月正式推出,是比其前身大幅改進的車型。它被認為是迄今為止最好的人工智慧圖像生成器之一,能夠創建具有複雜細節的圖像。然而,在推出時,它不包括

手機怎麼安裝chatgpt

Mar 05, 2024 pm 02:31 PM

手機怎麼安裝chatgpt

Mar 05, 2024 pm 02:31 PM

安裝步驟:1、在ChatGTP官網或手機商店下載ChatGTP軟體;2、開啟後在設定介面中,選擇語言為中文;3、在對局介面中,選擇人機對局並設定中文相譜;4 、開始後在聊天視窗中輸入指令,即可與軟體互動。

ChatGPT與Python的完美結合:打造智慧客服聊天機器人

Oct 27, 2023 pm 06:00 PM

ChatGPT與Python的完美結合:打造智慧客服聊天機器人

Oct 27, 2023 pm 06:00 PM

ChatGPT與Python的完美結合:打造智慧客服聊天機器人引言:在當今資訊時代,智慧客服系統已成為企業與客戶之間重要的溝通工具。而為了提供更好的客戶服務體驗,許多企業開始轉向採用聊天機器人的方式來完成客戶諮詢、問題解答等任務。在這篇文章中,我們將介紹如何使用OpenAI的強大模型ChatGPT和Python語言結合,來打造一個智慧客服聊天機器人,以提高

如何使用ChatGPT和Java開發智慧聊天機器人

Oct 28, 2023 am 08:54 AM

如何使用ChatGPT和Java開發智慧聊天機器人

Oct 28, 2023 am 08:54 AM

在這篇文章中,我們將介紹如何使用ChatGPT和Java開發智慧聊天機器人,並提供一些具體的程式碼範例。 ChatGPT是由OpenAI開發的困境預測轉換(GenerativePre-trainingTransformer)的最新版本,它是一種基於神經網路的人工智慧技術,可以理解自然語言並產生人類類似的文本。使用ChatGPT,我們可以輕鬆地創建自適應的聊天

如何使用ChatGPT PHP建構智慧客服機器人

Oct 28, 2023 am 09:34 AM

如何使用ChatGPT PHP建構智慧客服機器人

Oct 28, 2023 am 09:34 AM

如何使用ChatGPTPHP建構智慧客服機器人引言:隨著人工智慧技術的發展,機器人在客服領域的應用越來越廣泛。使用ChatGPTPHP建構智慧客服機器人,可以幫助企業提供更有效率、更個人化的客戶服務。本文將介紹如何使用ChatGPTPHP建構智慧客服機器人,並提供具體的程式碼範例。一、安裝ChatGPTPHP要使用ChatGPTPHP建構智慧客服機器人

學通考試能小窗嗎? -學習通考能用剪切板嗎?

Mar 18, 2024 pm 05:31 PM

學通考試能小窗嗎? -學習通考能用剪切板嗎?

Mar 18, 2024 pm 05:31 PM

學通考試能小窗嗎?學習通的課程考試懸浮窗是會被偵測到的。因為後台的監考老師有即時監控考生畫面的權限。在這個學習通考虛擬課堂中,學生不光能聽到教師的講課內容,還可以與教師進行問答與討論,同時,學生和教師之間可以彼此看到對方,就像真實課堂中面對面一樣真切。在學習通這個考試課堂中,還有電子白板、畫筆等諸多工具可供教學活動中使用,而文檔共享使教師可將預先準備的課件內容分發給全體學生,這種非常實用的數據共享功能使線上教學功能比實際課堂教學更方便且強大。學通考試能用剪切板嗎?在學習通考系統中,剪

ChatGPT和Python的完美結合:打造即時聊天機器人

Oct 28, 2023 am 08:37 AM

ChatGPT和Python的完美結合:打造即時聊天機器人

Oct 28, 2023 am 08:37 AM

ChatGPT與Python的完美結合:打造即時聊天機器人導言:隨著人工智慧技術的快速發展,聊天機器人在各個領域中扮演著越來越重要的角色。聊天機器人可以幫助用戶提供即時且個人化的協助,同時也為企業提供高效率的客戶服務。本文將介紹如何使用OpenAI的ChatGPT模型和Python語言結合,打造一個即時聊天機器人,並提供具體的程式碼範例。一、ChatGPT

chatgpt國內可以使用嗎

Mar 05, 2024 pm 03:05 PM

chatgpt國內可以使用嗎

Mar 05, 2024 pm 03:05 PM

chatgpt在國內可以使用,但不能註冊,港澳也不行,用戶想要註冊的話,可以使用國外的手機號碼進行註冊,注意註冊過程中要將網路環境切換成國外ip。