基於Diffusion Model的影像生成

Part 01

● 發展歷史 ●

1.1 起源

1.1 起源

2015年在Deep Unsupervised Learning using Nonequilibrium Thermodynamics 這篇文章中提出,當時的生成模型例如VAE,有一個很大的難點,就是這類模型是先定義了條件分佈,然後再定義變分後驗去適配,最後會導致需要同時優化條件分佈和變分後驗,然而這是很困難的。如果我們可以定義一個簡單的過程,把資料分佈映射到標準高斯,「生成器」的任務就變成了簡單的擬合這個過程的逆過程的每一小步,這,就是diffusion model的核心思想。然而這篇文章當時並沒有掀起什麼波瀾。

1.2 發展

#時間來到2020年,基於前人的思想,提出了DDPM模型(Denoising Diffusion Probabilistic Models),相對於基礎的擴散模型,作者結合了擴散模型和去噪分數,來引導訓練以及採樣的過程,帶來了生成圖像樣本適量的提升,使其在訓練更簡單穩定的條件下,最後的結果可以和GAN模型相當。

圖2-DDPM的產生結果

然而DDPM模型也並非完美無缺,由於擴散過程是一個馬爾科夫鏈,其缺點就是需要比較大的擴散步數才可以獲得比較良好的效果,這導致了樣本生成很慢。

於是繼DDPM之後,時間來到2021年,Song等人提出了DDIM(Denoising Diffusioin Implicit Model),其改造了DDPM的擴散過程的採樣方法,將傳統的馬可夫擴散過程推廣到了非馬可夫過程,可以用更小的採樣步數來加速樣本生成,大大的提高了效率。

1.3 爆發

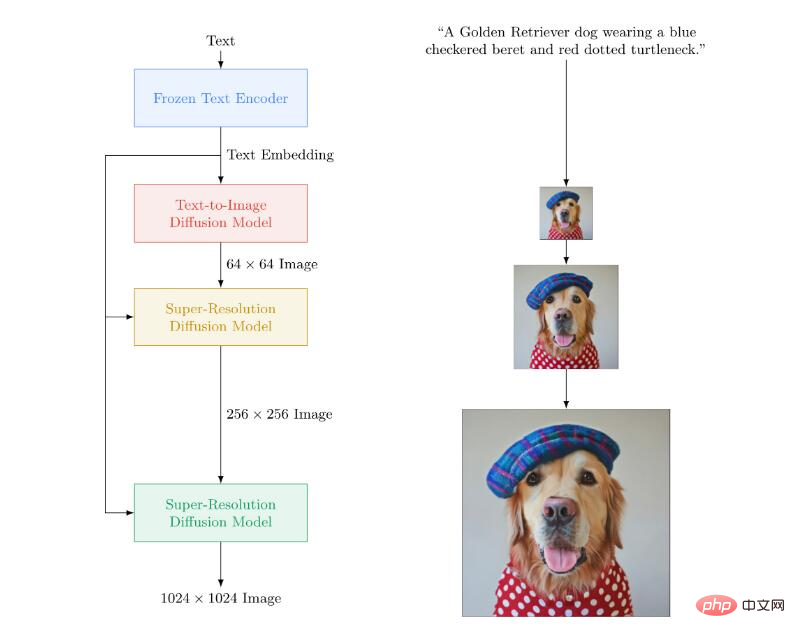

#2022年,Google基於擴散模型推出了新的AI系統,可以將文字描述轉為逼真影像。

#2022年,Google基於擴散模型推出了新的AI系統,可以將文字描述轉為逼真影像。

#圖3

############################## ###########################################################################由Google給出的原理圖可以看出,輸入的文字首先經過編碼,然後由一個文字轉圖像的擴散模型轉化為64*64的小圖,進一步的,利用超分辨率擴散模型對小圖進行處理,在進一步的迭代過程中提升影像的分辨率,得到最後的生成結果-一張1024*1024的最終影像。這個神奇的過程就像是大家使用中所感受到的一樣,輸入了一段文字——一隻穿著紅色點點高領衫,戴著藍色方格帽子的金毛狗狗,然後程式就自動生成了上面你所看到的狗狗圖片。 ##########另一款熱度頗高的現象級應用——novalAI,這本來是一個致力於AI寫作的網站,基於當前火熱的圖像生成,它結合網絡上的圖片資源,訓練了一個專注於二次元的圖像生成模型,從效果上看已經初具人類畫手的水平。

#圖5

除了傳統的輸入文字從而產出圖片之外,它還支援輸入圖片作為參考,可以讓AI基於已知的圖片基礎上產生新的圖片,一定程度上解決了AI生成結果不可控的問題。

Part 02#●

原則闡述●

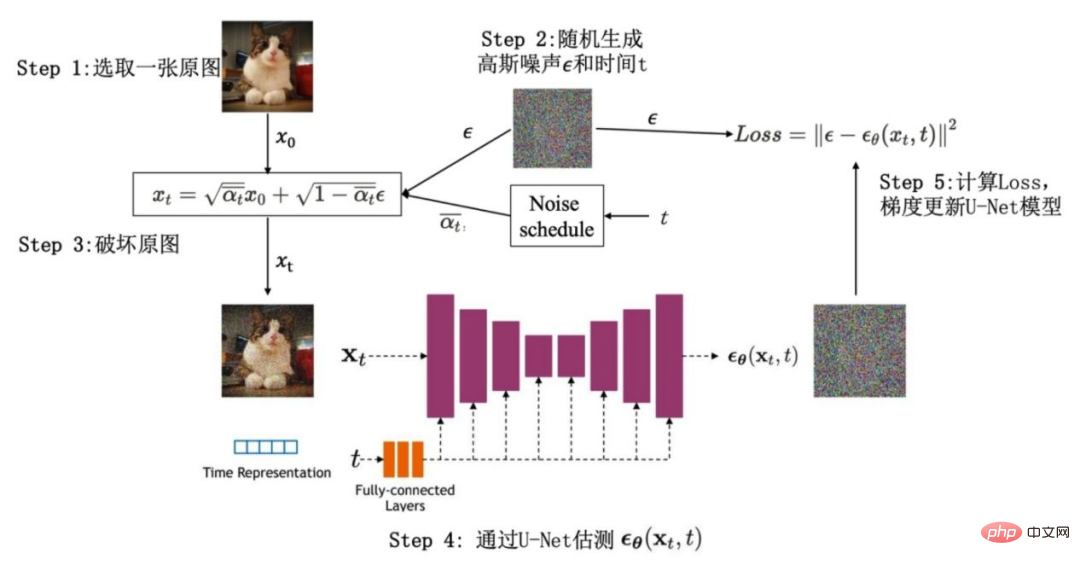

那麼,如此強大的AI技術,其工作過程到底是怎樣的呢?這裡我們以比較經典的DDPM模型作為例子給出簡單的過程:2.1 前向過程##前向過程是一個往圖片上加雜訊的過程,目的是為了建構訓練樣本GT。

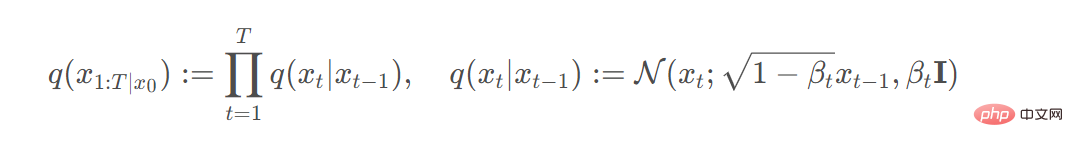

對於給定的初始資料分佈x0~q(x),我們逐步在資料分佈中加入高斯噪聲,這個過程有T次,每一步的結果是x1,x2,...,xt,雜訊的標準差表示為#,則加噪過程可以表述為:

#如前文所述,這是一個馬爾科夫鏈過程。最終會使得資料趨向於各向同性的高斯分佈。

2.2 逆擴散過程

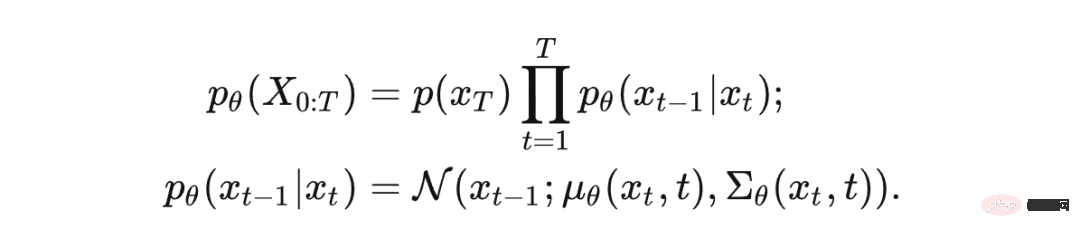

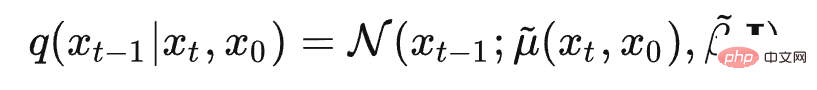

#逆向過程是去雜訊的過程,如果得知 ,就可以從完全的標準高斯分佈中還原出x0, 經過證明如果

,就可以從完全的標準高斯分佈中還原出x0, 經過證明如果 滿足高斯分佈且

滿足高斯分佈且

夠小,那麼仍然是一個高斯分佈,然後

夠小,那麼仍然是一個高斯分佈,然後 #無法簡單推論得到,所以我們利用一個參數為

#無法簡單推論得到,所以我們利用一個參數為 的深度學習模型去預測它,所以有:

的深度學習模型去預測它,所以有:

如果得知x0,則透過貝葉斯公式有:

##2.3 訓練過程

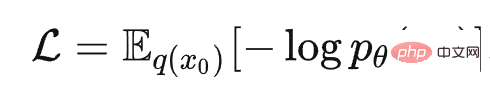

##2.3 訓練過程 如果對於機器學習有所了解的讀者應該知道,所有模型的訓練都是為了能夠最優化模型的參數,從而得到可靠的均值和方差,我們最大化模型預測分佈的對數似然,即:

如果對於機器學習有所了解的讀者應該知道,所有模型的訓練都是為了能夠最優化模型的參數,從而得到可靠的均值和方差,我們最大化模型預測分佈的對數似然,即:

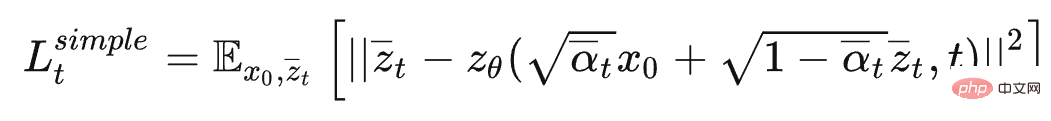

經過一系列的推導, DDPM模型得到了最後的loss函數表達:

經過一系列的推導, DDPM模型得到了最後的loss函數表達:

- 總結訓練的過程:

-

#1.

獲取輸入的x0, 從1...T中隨機取樣一個t

獲取輸入的x0, 從1...T中隨機取樣一個t - #2.從標準高斯分佈取樣一個雜訊

#3. 計算損失並迭代最小化損失函數

計算損失並迭代最小化損失函數

##Part 03

● 總結

##● ########################################################################################################## ####擴散模型已經展示出了巨大的潛力,其相對於VAE模型不需要對準後驗分佈,也不需要像GAN那樣訓練額外的判別器,在包括計算機視覺,生物信息學,語音處理等方面都有應用,其在圖像生成方面的應用,將助力於提升圖像創作的效率,可能讓AI生成根據條件生成若干圖片,人類對其結果進行篩選和修改會是將來2D繪畫領域的新的工作模式,這可能會很大程度上提升2D數位資產的生產效率。 ##########然而伴隨著AI技術的發展,總是會有一些爭議,圖像生成領域也不例外,除了AI技術本身的問題,如生成的圖片結構錯誤,不合理之外,也伴隨著一些法律上的糾紛,例如AI作品本身的版權問題。技術的問題可以透過技術本身的發展來解決,我們有理由相信隨著AI技術的發展,圖像生成最後會達到一個很高的水平,這會消滅大部分低端的繪畫相關的工作,極大的解放人類的生產力。版權問題可能還是需要政府部門對於相關產業的發展投入足夠多的關注,完善相關的政策和製度,需要我們對於新興的領域有更多的思考,從而讓AI技術更好的服務於我們。

參考文獻

#https://www.php.cn/link/3799b2e805a7fa8b076fc020574a73b2

##https://www.php.cn/link/6872937617af85db5a39a5243e858d1f

################################################################ #################https://www.php.cn/link/831da40e5907987235ebe5616446e083############################################################################# ##########以上是基於Diffusion Model的影像生成的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

C 中的chrono庫如何使用?

Apr 28, 2025 pm 10:18 PM

C 中的chrono庫如何使用?

Apr 28, 2025 pm 10:18 PM

使用C 中的chrono庫可以讓你更加精確地控制時間和時間間隔,讓我們來探討一下這個庫的魅力所在吧。 C 的chrono庫是標準庫的一部分,它提供了一種現代化的方式來處理時間和時間間隔。對於那些曾經飽受time.h和ctime折磨的程序員來說,chrono無疑是一個福音。它不僅提高了代碼的可讀性和可維護性,還提供了更高的精度和靈活性。讓我們從基礎開始,chrono庫主要包括以下幾個關鍵組件:std::chrono::system_clock:表示系統時鐘,用於獲取當前時間。 std::chron

如何理解C 中的DMA操作?

Apr 28, 2025 pm 10:09 PM

如何理解C 中的DMA操作?

Apr 28, 2025 pm 10:09 PM

DMA在C 中是指DirectMemoryAccess,直接內存訪問技術,允許硬件設備直接與內存進行數據傳輸,不需要CPU干預。 1)DMA操作高度依賴於硬件設備和驅動程序,實現方式因係統而異。 2)直接訪問內存可能帶來安全風險,需確保代碼的正確性和安全性。 3)DMA可提高性能,但使用不當可能導致系統性能下降。通過實踐和學習,可以掌握DMA的使用技巧,在高速數據傳輸和實時信號處理等場景中發揮其最大效能。

怎樣在C 中處理高DPI顯示?

Apr 28, 2025 pm 09:57 PM

怎樣在C 中處理高DPI顯示?

Apr 28, 2025 pm 09:57 PM

在C 中處理高DPI顯示可以通過以下步驟實現:1)理解DPI和縮放,使用操作系統API獲取DPI信息並調整圖形輸出;2)處理跨平台兼容性,使用如SDL或Qt的跨平台圖形庫;3)進行性能優化,通過緩存、硬件加速和動態調整細節級別來提升性能;4)解決常見問題,如模糊文本和界面元素過小,通過正確應用DPI縮放來解決。

C 中的實時操作系統編程是什麼?

Apr 28, 2025 pm 10:15 PM

C 中的實時操作系統編程是什麼?

Apr 28, 2025 pm 10:15 PM

C 在實時操作系統(RTOS)編程中表現出色,提供了高效的執行效率和精確的時間管理。 1)C 通過直接操作硬件資源和高效的內存管理滿足RTOS的需求。 2)利用面向對象特性,C 可以設計靈活的任務調度系統。 3)C 支持高效的中斷處理,但需避免動態內存分配和異常處理以保證實時性。 4)模板編程和內聯函數有助於性能優化。 5)實際應用中,C 可用於實現高效的日誌系統。

給MySQL表添加和刪除字段的操作步驟

Apr 29, 2025 pm 04:15 PM

給MySQL表添加和刪除字段的操作步驟

Apr 29, 2025 pm 04:15 PM

在MySQL中,添加字段使用ALTERTABLEtable_nameADDCOLUMNnew_columnVARCHAR(255)AFTERexisting_column,刪除字段使用ALTERTABLEtable_nameDROPCOLUMNcolumn_to_drop。添加字段時,需指定位置以優化查詢性能和數據結構;刪除字段前需確認操作不可逆;使用在線DDL、備份數據、測試環境和低負載時間段修改表結構是性能優化和最佳實踐。

怎樣在C 中測量線程性能?

Apr 28, 2025 pm 10:21 PM

怎樣在C 中測量線程性能?

Apr 28, 2025 pm 10:21 PM

在C 中測量線程性能可以使用標準庫中的計時工具、性能分析工具和自定義計時器。 1.使用庫測量執行時間。 2.使用gprof進行性能分析,步驟包括編譯時添加-pg選項、運行程序生成gmon.out文件、生成性能報告。 3.使用Valgrind的Callgrind模塊進行更詳細的分析,步驟包括運行程序生成callgrind.out文件、使用kcachegrind查看結果。 4.自定義計時器可靈活測量特定代碼段的執行時間。這些方法幫助全面了解線程性能,並優化代碼。

量化交易所排行榜2025 數字貨幣量化交易APP前十名推薦

Apr 30, 2025 pm 07:24 PM

量化交易所排行榜2025 數字貨幣量化交易APP前十名推薦

Apr 30, 2025 pm 07:24 PM

交易所內置量化工具包括:1. Binance(幣安):提供Binance Futures量化模塊,低手續費,支持AI輔助交易。 2. OKX(歐易):支持多賬戶管理和智能訂單路由,提供機構級風控。獨立量化策略平台有:3. 3Commas:拖拽式策略生成器,適用於多平台對沖套利。 4. Quadency:專業級算法策略庫,支持自定義風險閾值。 5. Pionex:內置16 預設策略,低交易手續費。垂直領域工具包括:6. Cryptohopper:雲端量化平台,支持150 技術指標。 7. Bitsgap:

deepseek官網是如何實現鼠標滾動事件穿透效果的?

Apr 30, 2025 pm 03:21 PM

deepseek官網是如何實現鼠標滾動事件穿透效果的?

Apr 30, 2025 pm 03:21 PM

如何實現鼠標滾動事件穿透效果?在我們瀏覽網頁時,經常會遇到一些特別的交互設計。比如在deepseek官網上,�...

獲取輸入的x0, 從1...T中隨機取樣一個t

獲取輸入的x0, 從1...T中隨機取樣一個t