跟男友約會也要問語言模型? Nature:提idea,總結筆記,GPT-3竟成當代「科學研究民工」

讓一隻猴子在打字機上隨機地按鍵,只要給足夠長的時間,莎士比亞全集也能敲出來。

那要是一隻懂文法和語意的猴子呢?答案是連科研都能幫你做!

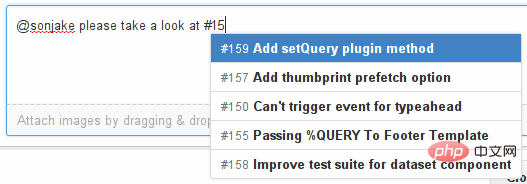

語言模型的發展勢頭十分迅猛,幾年前還只能在輸入法上對下一個要輸入的字進行自動補全,今天就已經可以幫助研究人員分析和撰寫科學論文、生成程式碼了。

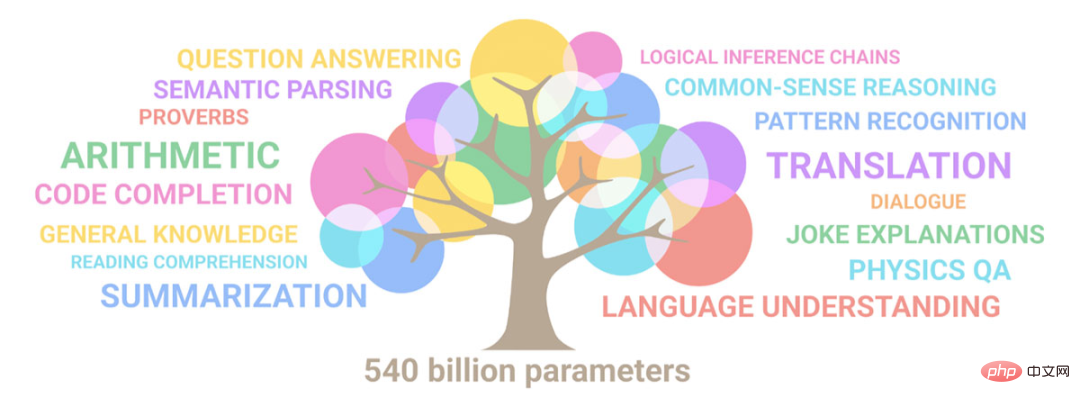

大型語言模型(LLM)的訓練一般需要大量的文字資料作為支撐。

2020年,OpenAI發布了擁有1750億參數的GPT-3模型,寫詩、做數學題,幾乎生成模型能做的,GPT-3已然做到極致,即便到了今天,GPT-3仍然是許多語言模型要拿來比較和超越的基線。

GPT-3發布後,很快在Twitter和其他社群媒體上引發熱議,大量研究人員對這種詭異的「類人寫作」方式感到驚訝。

GPT-3發佈線上服務後,使用者可以隨意輸入文本,並讓模型返回下文,每處理750個單字的收費最低僅為0.0004美元,堪稱物美價廉。

最近Nature專欄科技專題上發布了一篇文章,沒想到除了幫忙寫小作文,這些語言模型還能幫你「做科研」!

讓機器幫你思考

冰島大學雷克雅維克分校的電腦科學家Hafsteinn Einarsson表示:我幾乎每天都會用到GPT-3,例如給論文摘要進行修改。

Einarsson在6月份的一次會議上準備文案時,雖然GPT-3提了很多無用的修改建議,但也有一些有幫助的,比如“使研究問題在摘要的開頭更明確」,而這類問題你自己看手稿時根本不會意識到,除非你讓別人幫你看,而這個別人為什麼不能是「GPT-3」呢?

語言模型甚至可以幫助你改進實驗設計!

在另一個專案中,Einarsson想使用Pictionary遊戲在參與者中收集語言資料。

在給了遊戲的描述後,GPT-3給了一些遊戲的修改建議。理論上講,研究人員也可以要求對實驗方案進行新的嘗試。

有些研究人員也會使用語言模型來產生論文標題或使文字更易讀。

史丹佛大學電腦科學教授的博士生Mina Lee的使用方法是,給GPT-3輸入「使用這些關鍵字,產生一篇論文標題」等作為提示,模型就會幫你擬定幾個標題。

有部分章節如果需要重寫的話,她還會用到以色列特拉維夫AI21實驗室發布的人工智慧寫作助手Wordtune,只需要點擊「Rewrite」,就能轉換出多個版本的重寫段落,然後仔細挑選即可。

Lee也會要求GPT-3為生活中的一些事提供建議,例如詢問「如何把男友介紹給她的父母」時,GPT-3建議去海邊的一家餐館。

位於紐約布魯克林的科技新創公司Scite的電腦科學家Domenic Rosati使用Generate語言模式對自己的思路進行重新組織。

連結:https://cohere.ai/generate

Generate由加拿大的一家NLP公司Cohere開發,模型的工作流程與GPT-3非常相似。

只需要輸入筆記,或只是隨便說點idea,最後加上「總結一下」或是「把它變成一個抽象概念」,模型就會自動幫你整理思路。

何必親自寫程式?

OpenAI 的研究人員對 GPT-3進行了大量的文字訓練,包括書籍、新聞故事、維基百科條目和軟體程式碼。

後來,團隊注意到GPT-3可以像補全普通文字一樣對程式碼進行補全。

研究人員創建了一個名為Codex 的演算法的微調版本,使用來自程式碼共享平台GitHub上超過150G 的文本上進行訓練;目前GitHub 現在已經將Codex 整合到Copilot的服務中,可以輔助使用者編寫程式碼。

位於華盛頓州西雅圖的艾倫人工智慧研究所AI2的電腦科學家Luca Soldaini說,他們辦公室裡至少有一半的人都在用Copilot

Soldaini表示,Copilot最適合重複性程式設計的場景。例如他有一個專案涉及到編寫處理PDF的模板程式碼,Copilot直接就給補全了。

不過Copilot補全的內容也會常常出錯,最好在一些自己熟悉的語言上使用。

文獻檢索

語言模型最成熟的應用場景可能就是搜尋和總結文獻了。

AI2開發的Semantic Scholar搜尋引擎使用了TLDR的語言模型對每篇論文給出了一個類似Twitter長度的描述。

該搜尋引擎涵蓋了大約2億篇論文,其中大部分來自生物醫學和電腦科學。

TLDR的開發是基於Meta更早發布的BART模型,然後AI2的研究人員在人寫摘要的基礎上對模型進行了微調。

以今天的標準,TLDR並不是大型語言模型,因為它只包含大約4億個參數,而GPT-3的最大版本包含1750億。

TLDR在AI2開發的擴充科學論文應用程式Semantic Reader中也有應用。

當使用者使用Semantic Reader中的文內引用時,會彈出一個包含TLDR摘要的資訊框。

Semantic Scholar的科學家Dan Weld表示,我們的想法是利用語言模型來提升閱讀體驗。

當語言模型產生文字摘要時,模型有可能會產生一些文章中不存在的事實,研究人員將這種問題稱之為「幻覺」,但實際上語言模型純粹是在編造或說謊。

TLDR 在真實性檢定中表現較好,論文作者對TLDR的準確度評分為2.5分(滿分3分)。

Weld表示,TLDR更真實是因為摘要只有大約20個字的長度,也可能是因為演算法不會將沒有出現在正文中的單字放入摘要中。

在搜尋工具方面,2021年在加州舊金山的機器學習非營利組織Ought推出了Elicit ,如果用戶問它「mindfulness對決策的影響是什麼?」它會輸出一個包含十篇論文的表格。

使用者可以要求軟體在列中填寫摘要和元資料等內容,以及關於研究參與者、方法和結果的信息,然後使用包括GPT-3在內的工具從論文中提取或產生這些信息。

馬裡蘭大學帕克分校的Joel Chan的研究方向為人機交互,每當他開始一個新計畫的時候都會使用Elicit搜尋相關論文。

斯德哥爾摩卡羅琳學院的神經系統科學家Gustav Nilsonne也利用Elicit找到了一些可以添加到總結分析中的數據的論文,用這個工具可以找到在其他搜尋中沒有發現的文件。

不斷進化的模型

AI2的原型為LLM提供了一種未來的感覺。

有時研究人員在閱讀科學論文的摘要後會有疑問,但還沒有時間閱讀全文。

AI2的一個團隊也開發了一個工具,可以在NLP領域回答這些問題。

模型先要求研究者閱讀NLP論文的摘要,然後詢問相關問題(例如「分析了哪五個對話屬性?」)

#研究小組隨後要求其他研究人員在閱讀完整部論文後回答這些問題。

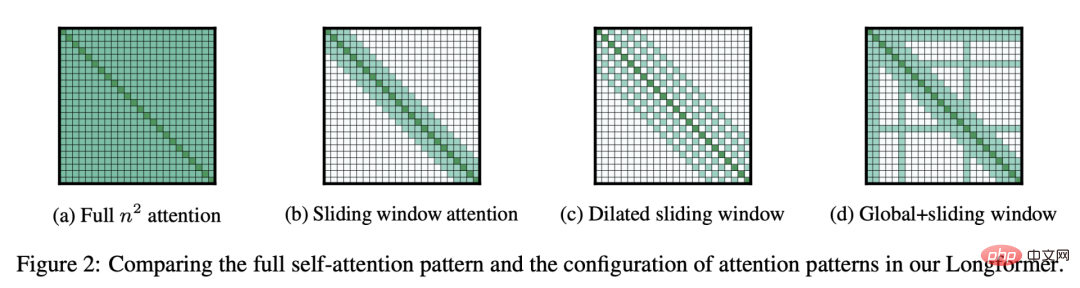

AI2訓練了另一個版本的Longformer語言模型,輸入為完整的論文,然後利用收集的資料集產生關於其他論文不同問題的答案。

ACCoRD模型可以為150個與NLP相關的科學概念產生定義和類比。

MS2是一個包含470,000個醫學文檔和20,000個多文檔摘要的資料集,用MS2微調BART後,研究人員就能夠提出一個問題和一組文檔,並生成一個簡短的元分析摘要。

2019年,AI2對Google2018年創建的語言模型BERT 進行了微調,在Semantic Scholar的論文上創建了擁有1.1億個參數的SciBERT

#Scite使用人工智慧創建了一個科學搜尋引擎,進一步對SciBERT進行了微調,以便當其搜尋引擎列出引用目標論文的論文時,將這些論文歸類為支援、對比或以其他方式提到該論文。

Rosati表示這種細微差別有助於人們識別科技文獻中的限製或差距。

AI2的SPECTER模型也是基於SciBERT,它將論文簡化為緊湊的數學表示。

Weld 說,會議組織者使用 SPECTER 將提交的論文與同行評審者匹配,Semantic Scholar使用它根據用戶的庫推薦論文。

#在希伯來大學和AI2的電腦科學家Tom Hope說他們有研究計畫透過微調語言模型來確定有效的藥物組合、基因和疾病之間的聯繫,以及在COVID-19研究中的科學挑戰和方向。

但是,語言模型能否提供更深入的洞察力,甚至是發現能力呢?

今年5月,Hope 和Weld 與微軟首席科學官Eric Horvitz共同撰寫了一篇評論,列出了實現這一目標的挑戰,包括教授模型以「(推斷)重組兩個概念的結果」。

Hope表示,這基本和 OpenAI 的DALL · E 2圖像生成模型「產生一張貓飛入太空的圖片是一回事」,但是我們怎麼能走向結合抽象的、高度複雜的科學概念呢?

這是個開放性問題。

時至今日,大型語言模型已經對研究產生了實實在在的影響,如果人們還沒有開始使用這些大型語言模型輔助工作,他們就會錯過這些機會。

參考資料:

https://www.nature.com/articles/d41586-022-03479-w

以上是跟男友約會也要問語言模型? Nature:提idea,總結筆記,GPT-3竟成當代「科學研究民工」的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

全球最強開源 MoE 模型來了,中文能力比肩 GPT-4,價格僅 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

全球最強開源 MoE 模型來了,中文能力比肩 GPT-4,價格僅 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

想像一下,一個人工智慧模型,不僅擁有超越傳統運算的能力,還能以更低的成本實現更有效率的效能。這不是科幻,DeepSeek-V2[1],全球最強開源MoE模型來了。 DeepSeek-V2是一個強大的專家混合(MoE)語言模型,具有訓練經濟、推理高效的特點。它由236B個參數組成,其中21B個參數用於啟動每個標記。與DeepSeek67B相比,DeepSeek-V2效能更強,同時節省了42.5%的訓練成本,減少了93.3%的KV緩存,最大生成吞吐量提高到5.76倍。 DeepSeek是一家探索通用人工智

Google狂喜:JAX性能超越Pytorch、TensorFlow!或成GPU推理訓練最快選擇

Apr 01, 2024 pm 07:46 PM

Google狂喜:JAX性能超越Pytorch、TensorFlow!或成GPU推理訓練最快選擇

Apr 01, 2024 pm 07:46 PM

谷歌力推的JAX在最近的基準測試中表現已經超過Pytorch和TensorFlow,7項指標排名第一。而且測試並不是JAX性能表現最好的TPU上完成的。雖然現在在開發者中,Pytorch依然比Tensorflow更受歡迎。但未來,也許有更多的大型模型會基於JAX平台進行訓練和運行。模型最近,Keras團隊為三個後端(TensorFlow、JAX、PyTorch)與原生PyTorch實作以及搭配TensorFlow的Keras2進行了基準測試。首先,他們為生成式和非生成式人工智慧任務選擇了一組主流

AI顛覆數學研究!菲爾茲獎得主、華裔數學家領銜11篇頂刊論文|陶哲軒轉贊

Apr 09, 2024 am 11:52 AM

AI顛覆數學研究!菲爾茲獎得主、華裔數學家領銜11篇頂刊論文|陶哲軒轉贊

Apr 09, 2024 am 11:52 AM

AI,的確正在改變數學。最近,一直十分關注這個議題的陶哲軒,轉發了最近一期的《美國數學學會通報》(BulletinoftheAmericanMathematicalSociety)。圍繞著「機器會改變數學嗎?」這個話題,許多數學家發表了自己的觀點,全程火花四射,內容硬核,精彩紛呈。作者陣容強大,包括菲爾茲獎得主AkshayVenkatesh、華裔數學家鄭樂雋、紐大電腦科學家ErnestDavis等多位業界知名學者。 AI的世界已經發生了天翻地覆的變化,要知道,其中許多文章是在一年前提交的,而在這一

替代MLP的KAN,被開源專案擴展到卷積了

Jun 01, 2024 pm 10:03 PM

替代MLP的KAN,被開源專案擴展到卷積了

Jun 01, 2024 pm 10:03 PM

本月初,來自MIT等機構的研究者提出了一種非常有潛力的MLP替代方法—KAN。 KAN在準確性和可解釋性方面表現優於MLP。而且它能以非常少的參數量勝過以更大參數量運行的MLP。例如,作者表示,他們用KAN以更小的網路和更高的自動化程度重現了DeepMind的結果。具體來說,DeepMind的MLP有大約300,000個參數,而KAN只有約200個參數。 KAN與MLP一樣具有強大的數學基礎,MLP基於通用逼近定理,而KAN基於Kolmogorov-Arnold表示定理。如下圖所示,KAN在邊上具

你好,電動Atlas!波士頓動力機器人復活,180度詭異動作嚇到馬斯克

Apr 18, 2024 pm 07:58 PM

你好,電動Atlas!波士頓動力機器人復活,180度詭異動作嚇到馬斯克

Apr 18, 2024 pm 07:58 PM

波士頓動力Atlas,正式進入電動機器人時代!昨天,液壓Atlas剛「含淚」退出歷史舞台,今天波士頓動力就宣布:電動Atlas上崗。看來,在商用人形機器人領域,波士頓動力是下定決心要跟特斯拉硬剛一把了。新影片放出後,短短十幾小時內,就已經有一百多萬觀看。舊人離去,新角色登場,這是歷史的必然。毫無疑問,今年是人形機器人的爆發年。網友銳評:機器人的進步,讓今年看起來像人類的開幕式動作、自由度遠超人類,但這真不是恐怖片?影片一開始,Atlas平靜地躺在地上,看起來應該是仰面朝天。接下來,讓人驚掉下巴

特斯拉機器人進廠打工,馬斯克:手的自由度今年將達到22個!

May 06, 2024 pm 04:13 PM

特斯拉機器人進廠打工,馬斯克:手的自由度今年將達到22個!

May 06, 2024 pm 04:13 PM

特斯拉機器人Optimus最新影片出爐,已經可以在工廠裡打工了。正常速度下,它分揀電池(特斯拉的4680電池)是這樣的:官方還放出了20倍速下的樣子——在小小的「工位」上,揀啊揀啊揀:這次放出的影片亮點之一在於Optimus在廠子裡完成這項工作,是完全自主的,全程沒有人為的干預。而且在Optimus的視角之下,它還可以把放歪了的電池重新撿起來放置,主打一個自動糾錯:對於Optimus的手,英偉達科學家JimFan給出了高度的評價:Optimus的手是全球五指機器人裡最靈巧的之一。它的手不僅有觸覺

FisheyeDetNet:首個以魚眼相機為基礎的目標偵測演算法

Apr 26, 2024 am 11:37 AM

FisheyeDetNet:首個以魚眼相機為基礎的目標偵測演算法

Apr 26, 2024 am 11:37 AM

目標偵測在自動駕駛系統當中是一個比較成熟的問題,其中行人偵測是最早得以部署演算法之一。在多數論文當中已經進行了非常全面的研究。然而,利用魚眼相機進行環視的距離感知相對來說研究較少。由於徑向畸變大,標準的邊界框表示在魚眼相機當中很難實施。為了緩解上述描述,我們探索了擴展邊界框、橢圓、通用多邊形設計為極座標/角度表示,並定義一個實例分割mIOU度量來分析這些表示。所提出的具有多邊形形狀的模型fisheyeDetNet優於其他模型,並同時在用於自動駕駛的Valeo魚眼相機資料集上實現了49.5%的mAP

牛津大學最新! Mickey:3D中的2D影像匹配SOTA! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

牛津大學最新! Mickey:3D中的2D影像匹配SOTA! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

寫在前面項目連結:https://nianticlabs.github.io/mickey/給定兩張圖片,可以透過建立圖片之間的對應關係來估計它們之間的相機姿態。通常,這些對應關係是二維到二維的,而我們估計的姿態在尺度上是不確定的。一些應用,例如隨時隨地實現即時增強現實,需要尺度度量的姿態估計,因此它們依賴外部的深度估計器來恢復尺度。本文提出了MicKey,這是一個關鍵點匹配流程,能夠夠預測三維相機空間中的度量對應關係。透過學習跨影像的三維座標匹配,我們能夠在沒有深度測試的情況下推斷度量相對