Google、MIT「迭代共同認證」視訊問答模型:SOTA效能,算力少用80%

影片是一種無所不在的媒體內容來源,涉及人們日常生活的許多方面。越來越多的現實世界的視訊應用,如視訊字幕、內容分析和視訊問答(VideoQA),都依賴能夠將視訊內容與文字或自然語言聯繫起來的模型。

其中,視訊問答模型尤其具有挑戰性,因為它需要同時掌握語義訊息,例如場景中的目標,以及時間訊息,例如事物如何移動和互動。這兩種訊息都必須在擁有特定意圖的自然語言問題的背景下進行。 此外,由於影片有許多幀,處理全部的幀來學習時空訊息,可能在計算上成本過高。

論文連結:https://arxiv.org/pdf/2208.00934.pdf 為了解決這個問題,在“Video Question Answering with Iterative Video-Text Co-Tokenization”一文中,谷歌和MIT的研究人員介紹了一種視頻-文本學習的新方法,稱為“迭代共同標記”,能夠有效地融合空間、時間和語言訊息,用於視訊問答的訊息處理。

#這種方法是多流的,用獨立的骨幹模型處理不同規模的視頻,產生捕捉不同特徵的視頻表示,例如高空間分辨率或長時間的視頻。 模型應用「共同認證」模組,從視訊串流與文字的整合中學習有效表示。模型計算效率很高,只需67GFLOPs,比以前的方法至少低了50%,同時比其他SOTA的模型有更好的性能。

影片-文字迭代

此模型的主要目標是從影片和文字(即使用者問題)產生特徵,共同允許它們的對應輸入進行互動。第二個目標是以有效的方式做到這一點,這對影片來說非常重要,因為它們包含幾十到幾百幀的輸入。

該模型學會了將視訊-語言的共同輸入標記為較小的標記集,以聯合且有效地代表兩種模式。在標記化時,研究人員使用兩種模式來產生一個聯合的緊湊表示,該表示被送入一個轉換層以產生下一級的表示。

這裡的一個挑戰,也是跨模態學習中的典型問題,就是視訊影格往往不直接對應相關的文字。研究人員透過增加兩個可學習的線性層來解決這個問題,在標記化之前,統一視覺和文字特徵維度。這樣一來,研究人員就可以讓影片和文字都能限制影片標記的學習方式。

此外,單一的標記化步驟不允許兩個模式之間的進一步互動。為此,研究人員使用這個新的特徵表示與視訊輸入特徵互動,並產生另一組標記化的特徵,然後將其送入下一個轉換器層。 這個迭代過程中會創造新的特徵或標記,表示對兩種模式的聯合表示的不斷改進。最後,這些特徵被輸入到生成文字輸出的解碼器中。

依照影片品質評估的慣例,在對個別影片品質評估資料集進行微調之前,研究人員對模型進行預訓練。 在這項工作中,研究人員使用基於語音識別的文本自動註釋的視頻,使用HowTo100M數據集,而不是在大型VideoQA數據集上預先訓練。這種較弱的預訓練資料仍然使研究人員的模型能夠學習影片-文字特徵。

高效視訊問答的實現

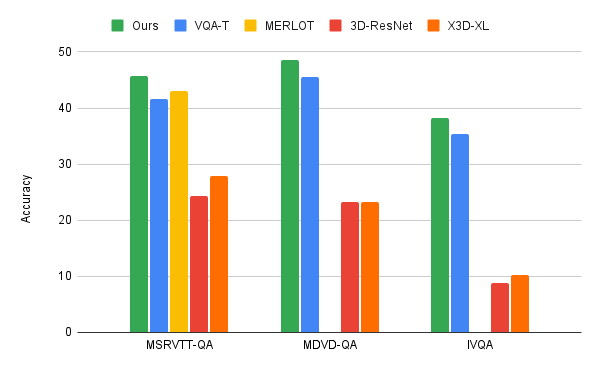

研究人員將視訊語言迭代共同認證演算法應用於三個主要的VideoQA基準,MSRVTT-QA、MSVD-QA和IVQA ,並證明這種方法比其他最先進的模型取得了更好的結果,同時模型不至於過大。另外,迭代式共同標記學習在影片-文字學習任務上對算力的需求也更低。

此模型只使用67GFLOPS算力,是3D-ResNet影片模型與文字時所需算力(360GFLOP )的六分之一,是X3D模型效率的兩倍以上。並且產生了高度準確的結果,精度超過了最先進的方法。

多流視訊輸入

對於VideoQA或其他一些涉及視訊輸入的任務,研究人員發現,多串流輸入對於更準確地回答有關空間和時間關係的問題很重要。

研究人員利用三個不同解析度和幀率的視訊串流:一個低解析度、高幀率的輸入視訊串流(每秒32幀,空間解析度64x64,記作32x64x64);一個高解析度、低幀率的影片(8x224x224);以及一個介於兩者之間的(16x112x112)。

儘管有三個資料流需要處理的資訊顯然更多,但由於採用了迭代共同標記方法,因此獲得了非常高效的模型。同時,這些額外的資料流允許提取最相關的資訊。

例如,如下圖所示,與特定活動相關的問題在分辨率較低但幀率較高的視訊輸入中會產生較高的激活,而與一般活動相關的問題可以從幀數很少的高解析度輸入中得到答案。

#這個演算法的另一個好處是,標記化會根據所問問題的不同而改變。

結論

研究人員提出了一種新的視訊語言學習方法,它著重於跨視訊-文字模式的共同學習。研究人員解決了視訊問題回答這一重要而具有挑戰性的任務。研究人員的方法既高效又準確,儘管效率更高,但卻優於目前最先進的模型。

Google研究人員的方法模型規模適度,可以透過更大的模型和資料獲得進一步的效能改進。研究人員希望,這項工作能引發更多視覺語言學習的研究,以實現與基於視覺的媒體的更多無縫互動。

以上是Google、MIT「迭代共同認證」視訊問答模型:SOTA效能,算力少用80%的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

全球最強開源 MoE 模型來了,中文能力比肩 GPT-4,價格僅 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

全球最強開源 MoE 模型來了,中文能力比肩 GPT-4,價格僅 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

想像一下,一個人工智慧模型,不僅擁有超越傳統運算的能力,還能以更低的成本實現更有效率的效能。這不是科幻,DeepSeek-V2[1],全球最強開源MoE模型來了。 DeepSeek-V2是一個強大的專家混合(MoE)語言模型,具有訓練經濟、推理高效的特點。它由236B個參數組成,其中21B個參數用於啟動每個標記。與DeepSeek67B相比,DeepSeek-V2效能更強,同時節省了42.5%的訓練成本,減少了93.3%的KV緩存,最大生成吞吐量提高到5.76倍。 DeepSeek是一家探索通用人工智

AI顛覆數學研究!菲爾茲獎得主、華裔數學家領銜11篇頂刊論文|陶哲軒轉贊

Apr 09, 2024 am 11:52 AM

AI顛覆數學研究!菲爾茲獎得主、華裔數學家領銜11篇頂刊論文|陶哲軒轉贊

Apr 09, 2024 am 11:52 AM

AI,的確正在改變數學。最近,一直十分關注這個議題的陶哲軒,轉發了最近一期的《美國數學學會通報》(BulletinoftheAmericanMathematicalSociety)。圍繞著「機器會改變數學嗎?」這個話題,許多數學家發表了自己的觀點,全程火花四射,內容硬核,精彩紛呈。作者陣容強大,包括菲爾茲獎得主AkshayVenkatesh、華裔數學家鄭樂雋、紐大電腦科學家ErnestDavis等多位業界知名學者。 AI的世界已經發生了天翻地覆的變化,要知道,其中許多文章是在一年前提交的,而在這一

Google狂喜:JAX性能超越Pytorch、TensorFlow!或成GPU推理訓練最快選擇

Apr 01, 2024 pm 07:46 PM

Google狂喜:JAX性能超越Pytorch、TensorFlow!或成GPU推理訓練最快選擇

Apr 01, 2024 pm 07:46 PM

谷歌力推的JAX在最近的基準測試中表現已經超過Pytorch和TensorFlow,7項指標排名第一。而且測試並不是JAX性能表現最好的TPU上完成的。雖然現在在開發者中,Pytorch依然比Tensorflow更受歡迎。但未來,也許有更多的大型模型會基於JAX平台進行訓練和運行。模型最近,Keras團隊為三個後端(TensorFlow、JAX、PyTorch)與原生PyTorch實作以及搭配TensorFlow的Keras2進行了基準測試。首先,他們為生成式和非生成式人工智慧任務選擇了一組主流

你好,電動Atlas!波士頓動力機器人復活,180度詭異動作嚇到馬斯克

Apr 18, 2024 pm 07:58 PM

你好,電動Atlas!波士頓動力機器人復活,180度詭異動作嚇到馬斯克

Apr 18, 2024 pm 07:58 PM

波士頓動力Atlas,正式進入電動機器人時代!昨天,液壓Atlas剛「含淚」退出歷史舞台,今天波士頓動力就宣布:電動Atlas上崗。看來,在商用人形機器人領域,波士頓動力是下定決心要跟特斯拉硬剛一把了。新影片放出後,短短十幾小時內,就已經有一百多萬觀看。舊人離去,新角色登場,這是歷史的必然。毫無疑問,今年是人形機器人的爆發年。網友銳評:機器人的進步,讓今年看起來像人類的開幕式動作、自由度遠超人類,但這真不是恐怖片?影片一開始,Atlas平靜地躺在地上,看起來應該是仰面朝天。接下來,讓人驚掉下巴

替代MLP的KAN,被開源專案擴展到卷積了

Jun 01, 2024 pm 10:03 PM

替代MLP的KAN,被開源專案擴展到卷積了

Jun 01, 2024 pm 10:03 PM

本月初,來自MIT等機構的研究者提出了一種非常有潛力的MLP替代方法—KAN。 KAN在準確性和可解釋性方面表現優於MLP。而且它能以非常少的參數量勝過以更大參數量運行的MLP。例如,作者表示,他們用KAN以更小的網路和更高的自動化程度重現了DeepMind的結果。具體來說,DeepMind的MLP有大約300,000個參數,而KAN只有約200個參數。 KAN與MLP一樣具有強大的數學基礎,MLP基於通用逼近定理,而KAN基於Kolmogorov-Arnold表示定理。如下圖所示,KAN在邊上具

特斯拉機器人進廠打工,馬斯克:手的自由度今年將達到22個!

May 06, 2024 pm 04:13 PM

特斯拉機器人進廠打工,馬斯克:手的自由度今年將達到22個!

May 06, 2024 pm 04:13 PM

特斯拉機器人Optimus最新影片出爐,已經可以在工廠裡打工了。正常速度下,它分揀電池(特斯拉的4680電池)是這樣的:官方還放出了20倍速下的樣子——在小小的「工位」上,揀啊揀啊揀:這次放出的影片亮點之一在於Optimus在廠子裡完成這項工作,是完全自主的,全程沒有人為的干預。而且在Optimus的視角之下,它還可以把放歪了的電池重新撿起來放置,主打一個自動糾錯:對於Optimus的手,英偉達科學家JimFan給出了高度的評價:Optimus的手是全球五指機器人裡最靈巧的之一。它的手不僅有觸覺

FisheyeDetNet:首個以魚眼相機為基礎的目標偵測演算法

Apr 26, 2024 am 11:37 AM

FisheyeDetNet:首個以魚眼相機為基礎的目標偵測演算法

Apr 26, 2024 am 11:37 AM

目標偵測在自動駕駛系統當中是一個比較成熟的問題,其中行人偵測是最早得以部署演算法之一。在多數論文當中已經進行了非常全面的研究。然而,利用魚眼相機進行環視的距離感知相對來說研究較少。由於徑向畸變大,標準的邊界框表示在魚眼相機當中很難實施。為了緩解上述描述,我們探索了擴展邊界框、橢圓、通用多邊形設計為極座標/角度表示,並定義一個實例分割mIOU度量來分析這些表示。所提出的具有多邊形形狀的模型fisheyeDetNet優於其他模型,並同時在用於自動駕駛的Valeo魚眼相機資料集上實現了49.5%的mAP

DualBEV:大幅超越BEVFormer、BEVDet4D,開卷!

Mar 21, 2024 pm 05:21 PM

DualBEV:大幅超越BEVFormer、BEVDet4D,開卷!

Mar 21, 2024 pm 05:21 PM

這篇論文探討了在自動駕駛中,從不同視角(如透視圖和鳥瞰圖)準確檢測物體的問題,特別是如何有效地從透視圖(PV)到鳥瞰圖(BEV)空間轉換特徵,這一轉換是透過視覺轉換(VT)模組實施的。現有的方法大致分為兩種策略:2D到3D和3D到2D轉換。 2D到3D的方法透過預測深度機率來提升密集的2D特徵,但深度預測的固有不確定性,尤其是在遠處區域,可能會引入不準確性。而3D到2D的方法通常使用3D查詢來採樣2D特徵,並透過Transformer學習3D和2D特徵之間對應關係的注意力權重,這增加了計算和部署的