只要和ChatGPT聊聊天,它就能幫你呼叫10萬個HuggingFace模型!

這是抱抱臉最新上線的功能HuggingFace Transformers Agents,一推出就獲得極大關注:

<code>from transformers import OpenAiAgentagent = OpenAiAgent(model="text-davinci-003", api_key="<your_api_key>")</your_api_key></code>

<code>from huggingface_hub import loginlogin("<your_token>")</your_token></code><code>from transformers import HfAgent# Starcoderagent = HfAgent("https://api-inference.huggingface.co/models/bigcode/starcoder")# StarcoderBase# agent = HfAgent("https://api-inference.huggingface.co/models/bigcode/starcoderbase")# OpenAssistant# agent = HfAgent(url_endpoint="https://api-inference.huggingface.co/models/OpenAssistant/oasst-sft-4-pythia-12b-epoch-3.5")</code>

目前,Transformers Agents已經整合了一套預設AI模型,透過呼叫以下Transformer函式庫中的AI模型來完成:

1、視覺文件理解模型Donut。只要提供一個圖片格式的檔案(包括PDF轉換成的圖片),就能利用它來回答有關該文件的問題。

例如問“TRRF科學諮詢委員會會議將在哪裡舉行”,Donut就會給出答案:

2、文字問答模型Flan-T5。給定長文章和一個問題,它就能回答各種文字問題,幫你做閱讀理解。

3、零樣本視覺語言模型BLIP。它可以直接理解圖像中的內容,並對圖像進行文字說明。

4、多模態模型ViLT。它可以理解並回答給定圖像中的問題,

5、多模態圖像分割模型CLIPseg。只要提供一個模型和提示詞,系統就能根據提示詞分割出影像中指定的內容(mask)。

6、自動語音辨識模型Whisper。它可以自動辨識一段錄音中的文字,並完成轉錄。

7、語音合成模型SpeechT5。用於文字轉語音。

8、自編碼語言模型BART。除了可以自動將一段文字內容分類,還能做文字摘要。

9、200種語言翻譯模型NLLB。除了常見語言外,還能翻譯一些較不常見的語言,包括寮語和卡姆巴語等。

透過呼叫上面這些AI模型,包括圖像問答、文件理解、圖像分割、錄音轉文字、翻譯、起標題、文字轉語音、文字分類在內的任務都可以完成。

除此之外,抱抱臉還“夾帶私貨”,包含了一些Transformer庫以外的模型,包括從網頁下載文字、文生圖、圖生圖、文生影片:

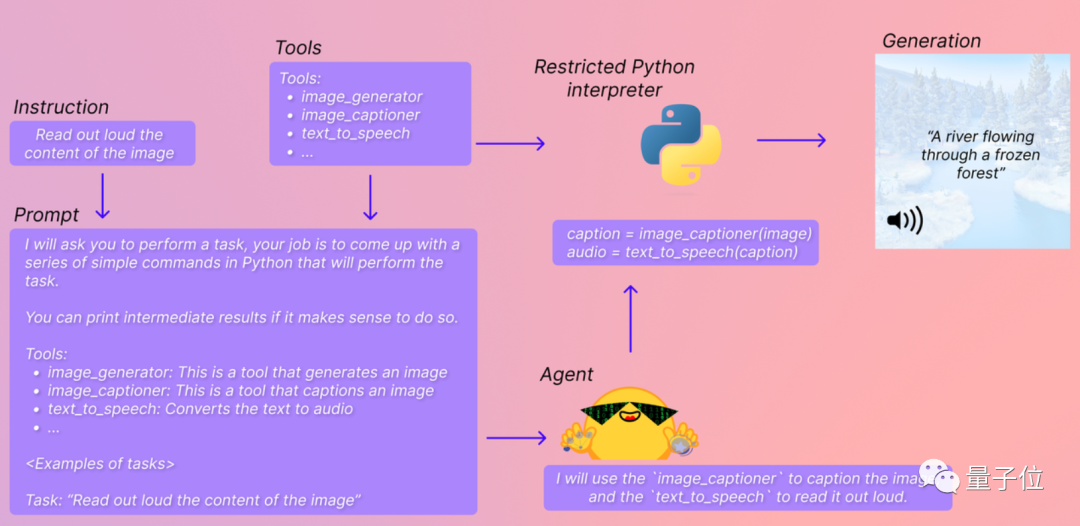

這些模型不僅能單獨調用,還可以混合在一起使用,例如要求大模型“生成並描述一張好看的海狸照片”,它就會分別呼叫「文生圖」和「圖片理解」AI模型。

當然,如果我們不想用這些預設AI模型,想設定一套更好用的“工具整合包”,也可以依照步驟自行設定。

對於Transformers Agents,也有網友指出,有點像是LangChain agents的「平替」:

你試過這兩個工具了嗎?感覺哪個比較好用?

參考連結:[1]https://twitter.com/huggingface/status/1656334778407297027[2]https://huggingface.co/docs/transformers/transformers_agents

#以上是讓ChatGPT調用10萬+開源AI模型! HuggingFace新功能爆火:大模型可隨取隨用多模態AI工具的詳細內容。更多資訊請關注PHP中文網其他相關文章!