ChatGPT應用爆火,安全的大數據底座何處尋?

毫無疑問,AIGC正在為人類社會帶來一場深刻的變革。

而剝離其令人眼花撩亂的華麗外表,運行的核心離不開海量的數據支持。

ChatGPT的「入侵」已經引起了各行各業對內容抄襲的擔憂,以及網路資料安全意識的提高。

雖然AI技術是中立的,但並不能成為規避責任與義務的理由。

最近,英國情報機構——英國政府通訊總部(GCHQ)警告稱,ChatGPT和其他人工智慧聊天機器人將是一個新的安全威脅。

儘管ChatGPT的概念出現沒有多久,但對網路安全和資料安全帶來威脅的問題已經成為業界關注的焦點。

對於目前還處於發展初期的ChatGPT,如此擔憂是否杞人憂天?

安全威脅或正在發生

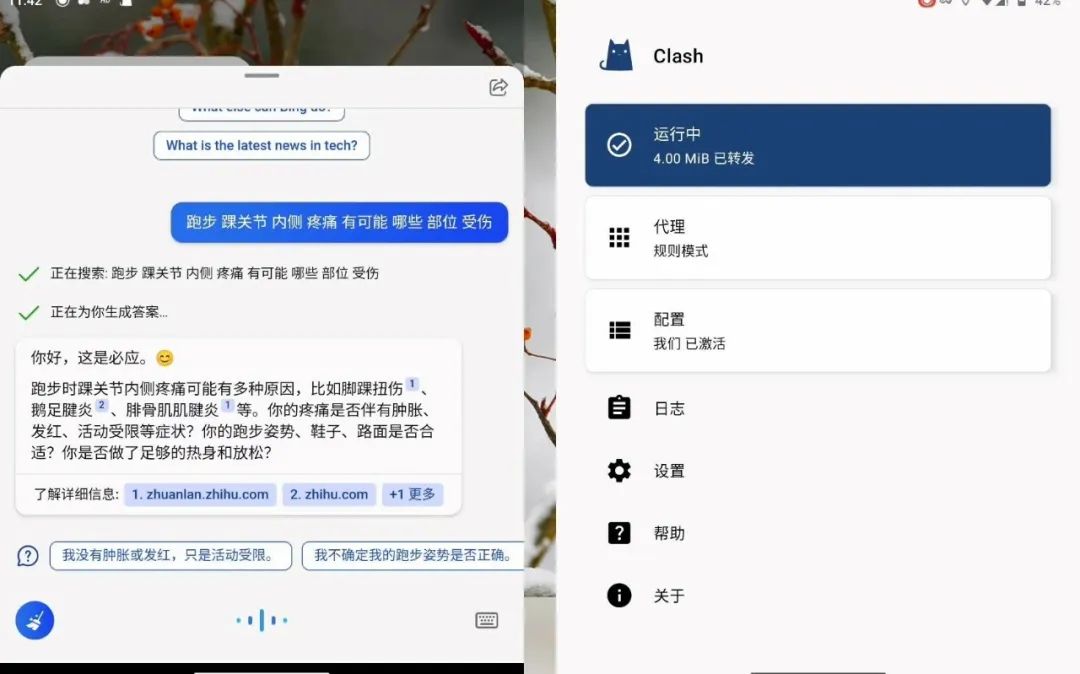

去年年底,新創公司OpenAI推出ChatGPT,之後,其投資商微軟於今年推出了基於ChatGPT技術開發的聊天機器人“必應聊天(Bing Chat)」。

由於這類軟體能夠提供酷似人類的對話,目前這項服務已風靡全球。

GCHQ的網路安全部門指出,提供AI聊天機器人的公司可以看到用戶輸入的查詢內容,就ChatGPT而言,其開發商OpenAI就能夠看到這些。

ChatGPT透過大量文字語料庫進行訓練,其深度學習能力很大程度上依賴背後的資料。

出於對資訊外洩的擔憂,目前已有多家公司和機構發布「ChatGPT禁令」。

倫敦金融城律師事務所Mishcon de Reya禁止其律師將客戶資料輸入ChatGPT,因為擔心在法律上享有隱私特權的資料可能會被洩露。

國際顧問公司埃森哲警告其全球70萬名員工,出於類似的原因,不要使用ChatGPT,因為擔心客戶的機密資料最終會落入他人之手。

英國電腦晶片公司Arm的母公司日本軟銀集團同樣警告其員工,不要向人工智慧聊天機器人輸入公司人員的身份資訊或機密資料。

今年2月,摩根大通成為第一家在工作場所限制使用ChatGPT的華爾街投入行動。

花旗集團和高盛集團緊跟在後,前者禁止員工在整個公司範圍內存取ChatGPT,後者則限制員工在交易大廳使用該產品。

而在更早些時候,亞馬遜和微軟為防備員工在使用ChatGPT的過程中洩密,禁止他們向其分享敏感數據,因為這些資訊可能會被用作進一步迭代的訓練資料。

事實上,這些人工智慧聊天機器人背後是大型語言模型(LLM),用戶的這些查詢內容將會被儲存起來,並且會在未來某個時候被用於開發LLM服務或模型。

這意味著,LLM提供者能夠讀取到相關查詢,並可能以某種方式將它們合併到未來的版本中。

儘管LLM運營商應該採取措施保護數據,但不能完全排除未經授權存取的可能性。因此,企業需要確保他們有嚴格的政策,提供技術性支持,來監控LLM的使用,以最大限度地降低資料暴露的風險。

另外,儘管ChatGPT本身尚不具備直接攻擊網路安全和資料安全的能力,但是由於它具有自然語言生成和理解的能力,可以被用於偽造虛假資訊、攻擊社交工程等方面。

此外,攻擊者還可以使用自然語言來讓ChatGPT產生對應的攻擊程式碼、惡意軟體程式碼、垃圾郵件等。

因此,AI可以讓那些原本沒有能力發動攻擊的人基於AI生成攻擊,並且大幅提高攻擊成功率。

在自動化、AI、「攻擊即服務」等技術和模式加持下,網路安全攻擊呈現暴漲趨勢。

在ChatGPT火熱之前,已經發生了多次駭客使用AI技術進行的網路攻擊。

事實上,人工智慧被用戶調教「帶偏節奏」的案例並不鮮見,6年前,微軟推出智慧聊天機器人Tay,上線時,Tay表現得彬彬有禮,但不到24小時,其就被不良用戶“帶壞”,出言不遜、髒話不斷,言語甚至涉及種族主義、色情、納粹,充滿歧視、仇恨和偏見,只好被下線結束了短暫的生命。

另一方面,距離使用者更近的風險是,使用者在使用ChatGPT等AI工具時,可能會不經意地將私密資料輸入到雲端模型,這些資料可能會成為訓練數據,也可能成為提供給他人答案的一部分,從而導致資料外洩和合規風險。

AI應用要打好安全底座

ChatGPT作為大語言模型,其核心邏輯事實上是海量資料的收集、加工、處理和運算結果的輸出。

總的來說,這幾個環節可能會在技術要素、組織管理、數位內容三個方面伴生相關風險。

雖然ChatGPT表示,儲存訓練和運行模型所需的資料會嚴格遵守隱私和安全政策,但未來可能出現網路攻擊和資料爬取等現象,仍有不可忽視的資料安全隱患。

特別是涉及國家核心資料、地方和產業重要資料以及個人隱私資料的抓取、處理以及合成使用等過程,需平衡資料安全保護與流動共享。

除了資料與隱私外洩隱患外,AI技術還存在著資料偏見、虛假資訊、模型的難解釋性等問題,可能會導致誤解和不信任。

風口已至,AIGC浪潮奔湧而來,在前景向好的大背景下,關口前移,建立資料安全防護牆也至關重要。

尤其是當AI技術逐漸完善,它既能成為生產力進步的強大抓手,又易淪為黑產犯罪的工具。

奇安信威脅情報中心監測數據顯示,2022年1月份-10月份,超過950億條的中國境內機構數據在海外被非法交易,其中有570多億條是個人資訊。

因此,如何確保資料儲存、運算、流通過程中的安全問題,是數位經濟發展的大前提。

從整體來看,應該堅持頂層設計與產業發展並進,在《網路安全法》的基礎上,要細化風險與責任分析體系,確立安全問責機制。

同時,監理機關可進行常態化監查工作,安全領域企業協同發力,建構全流程資料安全保障體系。

對於資料合規和資料安全的問題,特別是在《資料安全法》推出後,資料隱私越來越重要。

如果在應用AI技術的過程中無法保證資料安全和合規,可能會對企業造成很大風險。

特別是中小企業對資料隱私安全的知識比較匱乏,不知道如何保護資料不會受到安全威脅。

資料安全合規並不是某個部門的事情,而是整個企業最為重要的事情。

企業要對員工進行培訓,讓他們意識到每個使用數據的人,都有義務保護數據,包括IT人員、AI部門、數據工程師、開發人員、使用報表的人等,人和技術要結合在一起。

面對前述潛藏風險,監管方和相關企業如何從制度和技術層面加強AIGC領域的資料安全保護?

相較於直接針對用戶終端採取限制使用等監管措施,明確要求AI技術研發企業遵循科技倫理原則會更具成效,因為這些企業能夠在技術層面限定用戶的使用範圍。

在製度層面,需要結合AIGC底層技術所需資料的特性和作用,建立健全資料分類分級保護制度。

例如,可依據資料主體、資料處理程度、資料權利屬性等面向對訓練資料集中的資料進行分類管理,根據資料對資料權利主體的價值,以及資料一旦遭到竄改、破壞等對資料主體的危害程度進行分級。

在資料分類分級的基礎上,建立與資料類型和安全性等級相符的資料保護標準與共享機制。

目光投向企業,還需加快推動「隱私運算」技術在AIGC領域的應用。

這類技術能夠讓多個資料擁有者在不暴露資料本身的前提下,透過共享SDK或開放SDK權限的方式,在進行資料的共享、互通、計算、建模,在確保AIGC能夠正常提供服務的同時,保證資料不會外洩給其他參與者。

此外,全流程合規管理的重要性癒加凸顯。

企業首先應關注其所運用的資料資源是否符合法律法規要求,其次要確保演算法和模型運作的全流程合規,企業的創新研發也應最大限度地滿足社會公眾的倫理期待。

同時,企業應制定內部管理規範,設立相關的監督部門,對AI技術應用場景的各個環節進行資料監督,確保資料來源合法、處理合法、輸出合法,從而保障自身的合規性。

AI應用程式的關鍵在於部署方式與成本間的考量,但必須注意的是,如果沒有做好安全合規、隱私保護,對企業來說或將蘊含“更大風險點」。

AI是把雙面刃,用得好讓企業如虎添翼;用不好疏忽了安全、隱私和合規,會給企業帶來更大損失。

因此,在AI應用前,需要建構更穩固的“資料底座”,正所謂,行穩方能致遠。

以上是ChatGPT應用爆火,安全的大數據底座何處尋?的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

熱門話題

ChatGPT 現在允許免費用戶使用 DALL-E 3 產生每日限制的圖像

Aug 09, 2024 pm 09:37 PM

ChatGPT 現在允許免費用戶使用 DALL-E 3 產生每日限制的圖像

Aug 09, 2024 pm 09:37 PM

DALL-E 3 於 2023 年 9 月正式推出,是比其前身大幅改進的車型。它被認為是迄今為止最好的人工智慧圖像生成器之一,能夠創建具有複雜細節的圖像。然而,在推出時,它不包括

位元組跳動剪映推出 SVIP 超級會員:連續包年 499 元,提供多種 AI 功能

Jun 28, 2024 am 03:51 AM

位元組跳動剪映推出 SVIP 超級會員:連續包年 499 元,提供多種 AI 功能

Jun 28, 2024 am 03:51 AM

本站6月27日訊息,剪映是由位元組跳動旗下臉萌科技開發的一款影片剪輯軟體,依託於抖音平台且基本面向該平台用戶製作短影片內容,並相容於iOS、安卓、Windows 、MacOS等作業系統。剪映官方宣布會員體系升級,推出全新SVIP,包含多種AI黑科技,例如智慧翻譯、智慧劃重點、智慧包裝、數位人合成等。價格方面,剪映SVIP月費79元,年費599元(本站註:折合每月49.9元),連續包月則為59元每月,連續包年為499元每年(折合每月41.6元) 。此外,剪映官方也表示,為提升用戶體驗,向已訂閱了原版VIP

微調真的能讓LLM學到新東西嗎:引入新知識可能讓模型產生更多的幻覺

Jun 11, 2024 pm 03:57 PM

微調真的能讓LLM學到新東西嗎:引入新知識可能讓模型產生更多的幻覺

Jun 11, 2024 pm 03:57 PM

大型語言模型(LLM)是在龐大的文字資料庫上訓練的,在那裡它們獲得了大量的實際知識。這些知識嵌入到它們的參數中,然後可以在需要時使用。這些模型的知識在訓練結束時被「具體化」。在預訓練結束時,模型實際上停止學習。對模型進行對齊或進行指令調優,讓模型學習如何充分利用這些知識,以及如何更自然地回應使用者的問題。但是有時模型知識是不夠的,儘管模型可以透過RAG存取外部內容,但透過微調使用模型適應新的領域被認為是有益的。這種微調是使用人工標註者或其他llm創建的輸入進行的,模型會遇到額外的實際知識並將其整合

為大模型提供全新科學複雜問答基準與評估體系,UNSW、阿貢、芝加哥大學等多家機構共同推出SciQAG框架

Jul 25, 2024 am 06:42 AM

為大模型提供全新科學複雜問答基準與評估體系,UNSW、阿貢、芝加哥大學等多家機構共同推出SciQAG框架

Jul 25, 2024 am 06:42 AM

編輯|ScienceAI問答(QA)資料集在推動自然語言處理(NLP)研究中發揮著至關重要的作用。高品質QA資料集不僅可以用於微調模型,也可以有效評估大語言模型(LLM)的能力,尤其是針對科學知識的理解和推理能力。儘管目前已有許多科學QA數據集,涵蓋了醫學、化學、生物等領域,但這些數據集仍有一些不足之處。其一,資料形式較為單一,大多數為多項選擇題(multiple-choicequestions),它們易於進行評估,但限制了模型的答案選擇範圍,無法充分測試模型的科學問題解答能力。相比之下,開放式問答

SOTA性能,廈大多模態蛋白質-配體親和力預測AI方法,首次結合分子表面訊息

Jul 17, 2024 pm 06:37 PM

SOTA性能,廈大多模態蛋白質-配體親和力預測AI方法,首次結合分子表面訊息

Jul 17, 2024 pm 06:37 PM

編輯|KX在藥物研發領域,準確有效地預測蛋白質與配體的結合親和力對於藥物篩選和優化至關重要。然而,目前的研究並沒有考慮到分子表面訊息在蛋白質-配體相互作用中的重要作用。基於此,來自廈門大學的研究人員提出了一種新穎的多模態特徵提取(MFE)框架,該框架首次結合了蛋白質表面、3D結構和序列的信息,並使用交叉注意機制進行不同模態之間的特徵對齊。實驗結果表明,該方法在預測蛋白質-配體結合親和力方面取得了最先進的性能。此外,消融研究證明了該框架內蛋白質表面資訊和多模態特徵對齊的有效性和必要性。相關研究以「S

佈局 AI 等市場,格芯收購泰戈爾科技氮化鎵技術和相關團隊

Jul 15, 2024 pm 12:21 PM

佈局 AI 等市場,格芯收購泰戈爾科技氮化鎵技術和相關團隊

Jul 15, 2024 pm 12:21 PM

本站7月5日消息,格芯(GlobalFoundries)於今年7月1日發布新聞稿,宣布收購泰戈爾科技(TagoreTechnology)的功率氮化鎵(GaN)技術及智慧財產權組合,希望在汽車、物聯網和人工智慧資料中心應用領域探索更高的效率和更好的效能。隨著生成式人工智慧(GenerativeAI)等技術在數位世界的不斷發展,氮化鎵(GaN)已成為永續高效電源管理(尤其是在資料中心)的關鍵解決方案。本站引述官方公告內容,在本次收購過程中,泰戈爾科技公司工程師團隊將加入格芯,進一步開發氮化鎵技術。 G

SK 海力士 8 月 6 日將展示 AI 相關新品:12 層 HBM3E、321-high NAND 等

Aug 01, 2024 pm 09:40 PM

SK 海力士 8 月 6 日將展示 AI 相關新品:12 層 HBM3E、321-high NAND 等

Aug 01, 2024 pm 09:40 PM

本站8月1日消息,SK海力士今天(8月1日)發布博文,宣布將出席8月6日至8日,在美國加州聖克拉拉舉行的全球半導體記憶體峰會FMS2024,展示諸多新一代產品。未來記憶體和儲存高峰會(FutureMemoryandStorage)簡介前身是主要面向NAND供應商的快閃記憶體高峰會(FlashMemorySummit),在人工智慧技術日益受到關注的背景下,今年重新命名為未來記憶體和儲存高峰會(FutureMemoryandStorage),以邀請DRAM和儲存供應商等更多參與者。新產品SK海力士去年在

SearchGPT:開放人工智慧用自己的人工智慧搜尋引擎挑戰谷歌

Jul 30, 2024 am 09:58 AM

SearchGPT:開放人工智慧用自己的人工智慧搜尋引擎挑戰谷歌

Jul 30, 2024 am 09:58 AM

開放人工智慧終於進軍搜尋領域。這家舊金山公司最近宣布了一款具有搜尋功能的新人工智慧工具。 The Information 於今年 2 月首次報導,該新工具被恰當地稱為 SearchGPT,並具有 c