LLM推理3倍速!微軟發布LLM Accelerator:用參考文本實現無損加速

隨著人工智慧技術的快速發展,ChatGPT、New Bing、GPT-4 等新產品和新技術陸續發布,基礎大模型在許多應用中將發揮日益重要的作用。

目前的大語言模型大多是自迴歸模型。自迴歸是指模型在輸出時往往採用逐字輸出的方式,即在輸出每個字時,模型需要將先前輸出的字作為輸入。而這種自回歸模式通常在輸出時限制並行加速器的充分利用。

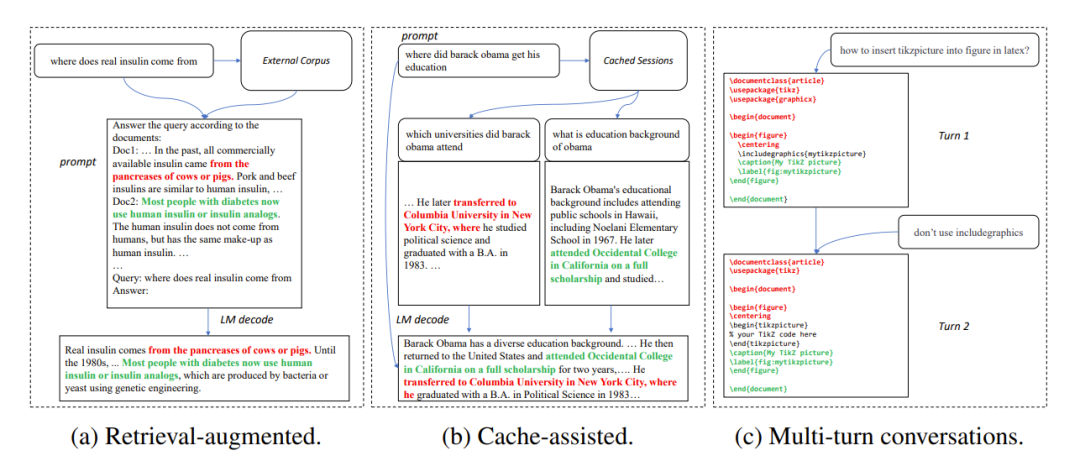

在許多應用場景中,大模型的輸出常常與一些參考文本有很大的相似性,例如在以下三個常見的場景中:

#1. 檢索增強的生成

#New Bing 等檢索應用在回應使用者輸入的內容時,會先傳回一些與使用者輸入相關的訊息,然後用語言模型總結檢索出的信息,再回答使用者輸入的內容。在這種場景中,模型的輸出往往包含大量檢索結果中的文字片段。

2. 在使用快取的產生

#大規模部署語言模型的過程中,歷史的輸入輸出會被緩存。在處理新的輸入時,檢索應用會在快取中尋找相似的輸入。因此,模型的輸出往往和快取中對應的輸出有很大的相似性。

3. 多輪對話中的生成

#在使用ChatGPT 等應用程式時,使用者傾向於根據模型的輸出一再提出修改要求。在這種多輪對話的場景下,模型的多次輸出往往只有少量的變化,重複度較高。

#圖1:大模型的輸出與參考文字存在相似性的常見場景

基於上述觀察,研究員以參考文本與模型輸出的重複性作為突破自回歸瓶頸的著力點,希望可以提高並行加速器利用率,加速大語言模型推理,進而提出了一種利用輸出與參考文本的重複性來實現一步輸出多個字的方法LLM Accelerator。

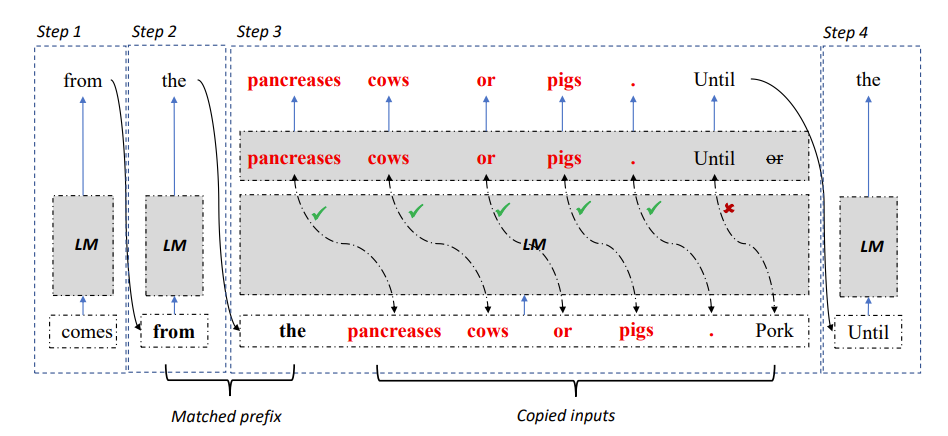

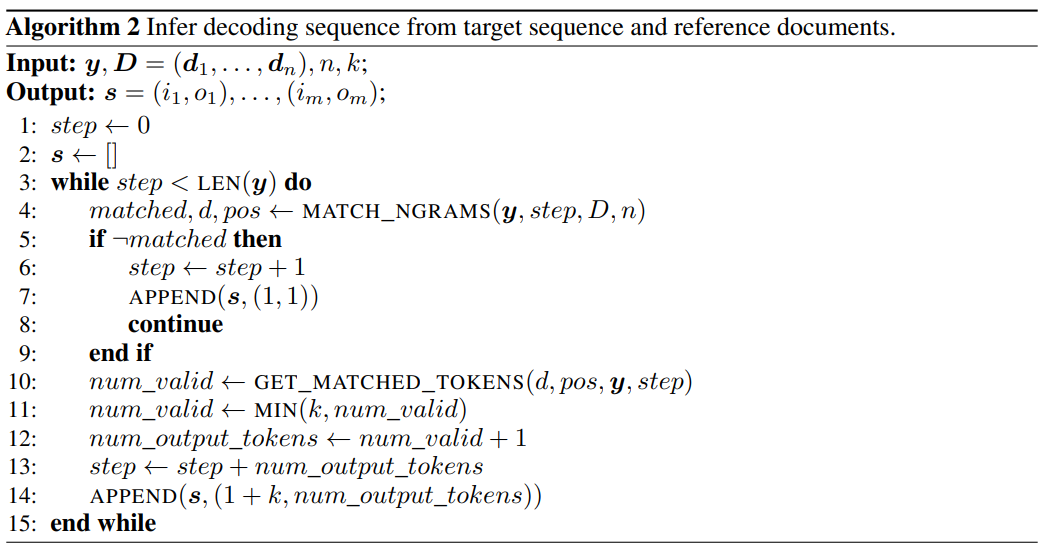

##圖2:LLM Accelerator 解碼演算法

具體來說,在每一步解碼時,讓模型先匹配已有的輸出結果與參考文本,如果發現某個參考文本與已有的輸出相符,那麼模型很可能順延已有的參考文本繼續輸出。

因此,研究員們將參考文本的後續詞也作為輸入加入模型中,從而使得一個解碼步驟可以輸出多個詞。

為了確保輸入輸出準確,研究員們進一步比較了模型輸出的字詞與從參考文件輸入的字詞。如果兩者不一致,那麼不正確的輸入輸出結果將被捨棄。

以上方法能夠保證解碼結果與基準方法完全一致,並且可以提高每個解碼步驟的輸出詞數,從而實現大模型推理的無損加速。

LLM Accelerator 無需額外輔助模型,簡單易用,可輕鬆部署到各種應用情境中。

論文連結:https://arxiv.org/pdf/2304.04487.pdf

#########項目連結:https://github.com/microsoft/LMOps################使用LLM Accelerator,有兩個超參數需要調整。 ######一是觸發匹配機制所需的輸出與參考文本的匹配詞數:匹配詞數越長往往越準確,可以更好地保證從參考文本拷貝的詞是正確的輸出,減少不必要的觸發和計算;更短的匹配,解碼步驟更少,潛在加速更快。

二是每次拷貝詞的數量:拷貝詞數越多,加速潛力越大,但也可能造成更多不正確的輸出被捨棄,浪費運算資源。研究員透過實驗發現,更激進的策略(匹配單字觸發,一次拷貝15到20個詞)往往能夠取得更好的加速比。

為了驗證 LLM Accelerator 的有效性,研究員們在檢索增強和快取輔助生成方面進行了實驗,利用 MS-MARCO 段落檢索資料集建構了實驗樣本。

在檢索增強實驗中,研究員使用檢索模型對每個查詢返回10個最相關的文檔,然後拼接到查詢後作為模型輸入,將這10個文檔作為參考文本。

在快取輔助生成實驗中,每個查詢產生四個相似的查詢,然後用模型輸出對應的查詢作為參考文字。

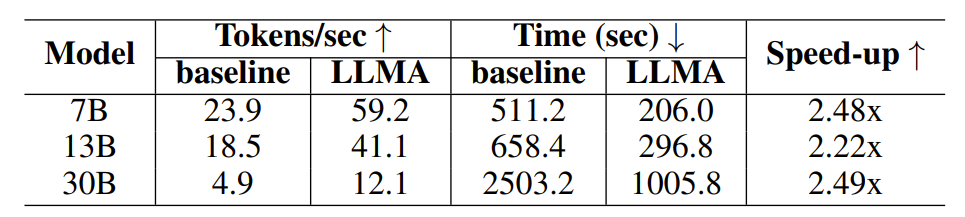

表1:檢索增強的生成場景下的時間比較

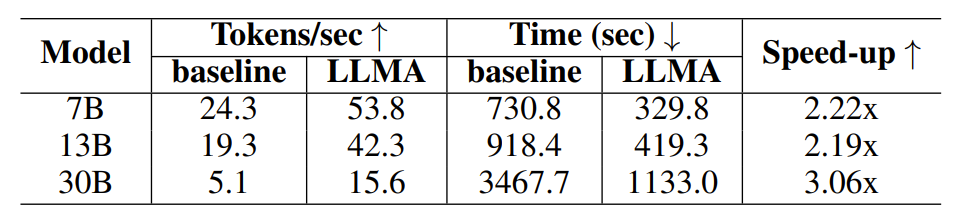

#表2:使用快取的生成場景下的時間比較

研究員使用透過OpenAI 介面得到的Davinci-003 模型的輸出結果作為目標輸出,以獲得高品質的輸出。在得到所需輸入、輸出和參考文本後,研究員們在開源的 LLaMA 語言模型上進行了實驗。

由於LLaMA 模型的輸出與Davinci-003 輸出不一致,因此研究員們採用了目標導向的解碼方法來測試理想輸出(Davinci-003 模型結果)結果下的加速比。

研究員們利用演算法2得到了貪婪解碼時產生目標輸出所需的解碼步驟,並強制 LLaMA 模型按照得到的解碼步驟進行解碼。

圖3:利用演算法2得到了貪婪解碼時產生目標輸出所需的解碼步驟

對於參數量為7B 和13B 的模型,研究員在單一32G NVIDIA V100 GPU 上進行實驗;對於參數量為30B 的模型,在四塊相同的GPU上進行實驗。所有的實驗均採用了半精度浮點數,解碼均為貪婪解碼,且批次大小為1。

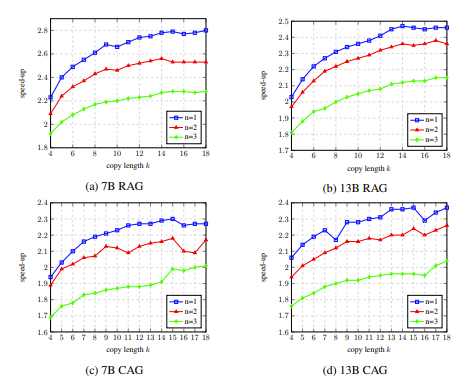

實驗結果表明,LLM Accelerator 在不同模型大小(7B,13B,30B)與不同的應用場景中(檢索增強、快取輔助)都取得了兩到三倍的加速比。

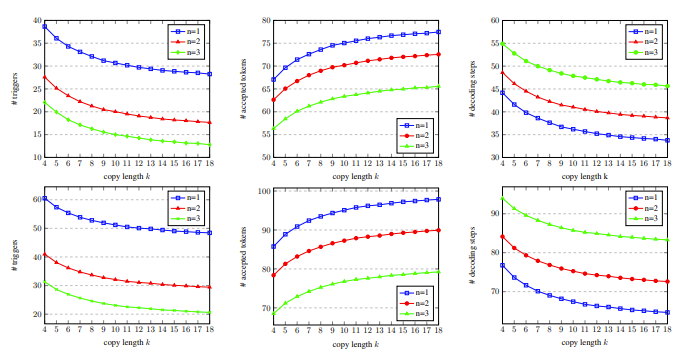

進一步實驗分析發現,LLM Accelertator 能顯著減少所需的解碼步驟,並且加速比與解碼步驟的減少比例呈正相關。

更少的解碼步驟一方面意味著每個解碼步驟產生的輸出詞數更多,可以提高GPU 運算的運算效率;另一方面,對於需要多卡並行的30B模型,這意味著更少的多卡同步,從而達到更快的速度提升。

在消融實驗中,在開發集上對LLM Accelertator 的超參數進行分析的結果顯示,匹配單字(即觸發拷貝機制)時,一次拷貝15到20個單字時的加速比可達到最大(圖4所示)。

在圖5中我們可以看出,匹配詞數為1能更多地觸發拷貝機制,並且隨著拷貝長度的增加,每個解碼步驟接受的輸出詞增加,解碼步驟減少,從而達到更高的加速比。

圖4:消融實驗中,在開發集上對LLM Accelertator 的超參數的分析結果

#圖5:在開發集上,具有不同匹配詞數n 和拷貝詞數k 的解碼步驟統計數據

LLM Accelertator 是微軟亞洲研究院自然語言計算組在大語言模型加速系列工作的一部分,未來,研究員們將持續對相關問題進行更深入的探索。

以上是LLM推理3倍速!微軟發布LLM Accelerator:用參考文本實現無損加速的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

微軟bing國際版入口地址(bing搜尋引擎入口)

Mar 14, 2024 pm 01:37 PM

微軟bing國際版入口地址(bing搜尋引擎入口)

Mar 14, 2024 pm 01:37 PM

必應(Bing)是微軟公司推出的網路搜尋引擎,搜尋功能非常強大,分了國內版和國際版兩個入口。這兩個版本入口在哪呢?怎麼訪問國際版呢?下面就來看看詳細內容。 必應中國版網址入口:https://cn.bing.com/ 必應國際版網址入口:https://global.bing.com/ 必應國際版怎麼存取? 1、先輸入開啟必應的網址入口:https://www.bing.com/ 2、可以看到有國內版跟國際版的選項,我們只需要選擇國際版,輸入關鍵字即可。

微軟發布 Win11 八月累積更新:提高安全性、優化鎖定螢幕等

Aug 14, 2024 am 10:39 AM

微軟發布 Win11 八月累積更新:提高安全性、優化鎖定螢幕等

Aug 14, 2024 am 10:39 AM

本站8月14日訊息,在今天的8月補丁星期二活動日中,微軟發布了適用於Windows11系統的累積更新,包括針對22H2和23H2的KB5041585更新,面向21H2的KB5041592更新。上述設備安裝8月累積更新之後,本站附上版本號變更如下:21H2設備安裝後版本號升至Build22000.314722H2設備安裝後版本號升至Build22621.403723H2設備安裝後版本號升至Build22631.4037面向Windows1121H2的KB5041585更新主要內容如下:改進:提高了

Microsoft Edge升級:自動儲存密碼功能遭禁? !用戶驚了!

Apr 19, 2024 am 08:13 AM

Microsoft Edge升級:自動儲存密碼功能遭禁? !用戶驚了!

Apr 19, 2024 am 08:13 AM

4月18日消息,近日,一些使用Canary頻道的MicrosoftEdge瀏覽器的用戶反映,在升級到最新版本後,他們發現自動保存密碼的選項被禁用了。經過調查,這是瀏覽器升級後的微調,而非功能被取消。在使用Edge瀏覽器造訪網站前,使用者回饋說瀏覽器會彈出一個視窗詢問是否希望儲存網站的登入密碼。選擇儲存後,下次登入時,Edge會自動填入已儲存的帳號和密碼,為使用者提供了極大的便利。但最近的更新類似於微調,修改了預設設定。使用者需要在選擇儲存密碼後,再手動在設定中開啟自動填入已儲存的帳號和密碼

微軟 Win11 壓縮為 7z、TAR 檔案的功能已從 24H2 下放到 23H2/22H2 版本

Apr 28, 2024 am 09:19 AM

微軟 Win11 壓縮為 7z、TAR 檔案的功能已從 24H2 下放到 23H2/22H2 版本

Apr 28, 2024 am 09:19 AM

本站4月27日消息,微軟本月初向Canary和Dev頻道發布了Windows11Build26100預覽版更新,預估會成為Windows1124H2更新的候選RTM版本。新版本中最主要的變化在於檔案總管、整合Copilot、編輯PNG檔案元資料、建立TAR和7z壓縮檔案等等。 @PhantomOfEarth發現,微軟已經將24H2版本(Germanium)部分功能下放到23H2/22H2(Nickel)版本中,例如創建TAR和7z壓縮檔。如示意圖所示,Windows11將支援原生建立TAR

微軟全螢幕彈窗催促:Windows 10用戶抓緊時間升級到Windows 11

Jun 06, 2024 am 11:35 AM

微軟全螢幕彈窗催促:Windows 10用戶抓緊時間升級到Windows 11

Jun 06, 2024 am 11:35 AM

6月3日訊息,微軟正在積極向所有Windows10用戶發送全螢幕通知,鼓勵他們升級到Windows11作業系統。這項舉措涉及了那些硬體配置並不支援新系統的設備。自2015年起,Windows10已經佔了近70%的市場份額,穩坐Windows作業系統的霸主地位。然而,市佔率遠超過82%的市場份額,佔有率遠超過2021年問世的Windows11。儘管Windows11已經推出已近三年,但其市場滲透率仍顯緩慢。微軟已宣布,將於2025年10月14日後終止對Windows10的技術支持,以便更專注於

微軟Edge瀏覽器更新:新增「放大影像」功能,提升使用者體驗

Mar 21, 2024 pm 01:40 PM

微軟Edge瀏覽器更新:新增「放大影像」功能,提升使用者體驗

Mar 21, 2024 pm 01:40 PM

3月21日消息,微軟近日對其MicrosoftEdge瀏覽器進行了更新,新增了一個實用的「放大影像」功能。現在,用戶在使用Edge瀏覽器時,只需右鍵點擊圖片,便可在彈出的選單中輕鬆找到這項新功能。更方便的是,使用者還可以將遊標停留在圖片上方,然後雙擊Ctrl鍵,即可快速呼出放大影像的功能。根據小編的了解,最新發布的MicrosoftEdge瀏覽器已經在Canary頻道進行了新功能測試。該瀏覽器的穩定版中也已經正式推出了實用的「放大影像」功能,為用戶提供了更便利的圖片瀏覽體驗。外國科技媒體也對此

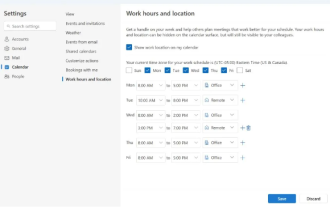

微軟推出新版Outlook for Windows:行事曆功能全面升級

Apr 27, 2024 pm 03:44 PM

微軟推出新版Outlook for Windows:行事曆功能全面升級

Apr 27, 2024 pm 03:44 PM

在4月27日的消息中,微軟公司宣布即將發布新版OutlookforWindows客戶端的測試。此次更新主要聚焦於優化行事曆功能,旨在提升使用者的工作效率,進一步簡化日常工作流程。新版OutlookforWindows客戶端的改進點在於其更強大的行事曆管理功能。現在,使用者能夠更方便地分享個人的工作時間與地點訊息,使得會議規劃更有效率。此外,Outlook還新增了人性化設置,讓用戶設定會議自動提前結束或推遲開始,為用戶提供了更多的靈活性,無論是換會議室、稍作休息還是享受一杯咖啡,都能輕鬆安排。根據

微軟計畫2024年下半年在Windows 11中淘汰NTLM,全面轉向Kerberos認證

Jun 09, 2024 pm 04:17 PM

微軟計畫2024年下半年在Windows 11中淘汰NTLM,全面轉向Kerberos認證

Jun 09, 2024 pm 04:17 PM

2024年下半年,微軟安全官方部落格發布了一則訊息,回應安全社群的呼籲。本公司計畫在2024年下半年發布的Windows11中淘汰NTLANManager(NTLM)認證協議,以提升安全性。根據先前的解釋,微軟先前已經有過類似的動作。去年10月12日,微軟在一份官方新聞稿中就已經提出了一個過渡計劃,旨在逐步淘汰NTLM身份驗證方式,並推動更多企業和用戶轉向使用Kerberos。為了幫助那些可能在關閉NTLM驗證後遇到硬連線(hardwired)應用程式和服務問題的企業,微軟提供了IAKerb和