最近幾個月,微軟一直忙於在自身的許多產品和服務中建立生成式 AI,包括搜尋引擎 Bing、瀏覽器 Edge、GitHub 和 Office 生產力套件。

在今天凌晨舉行的微軟 Build 2023 大會上,這些成果終於出來了,而且更進了一步:微軟 AI 宇宙越來越完備了。

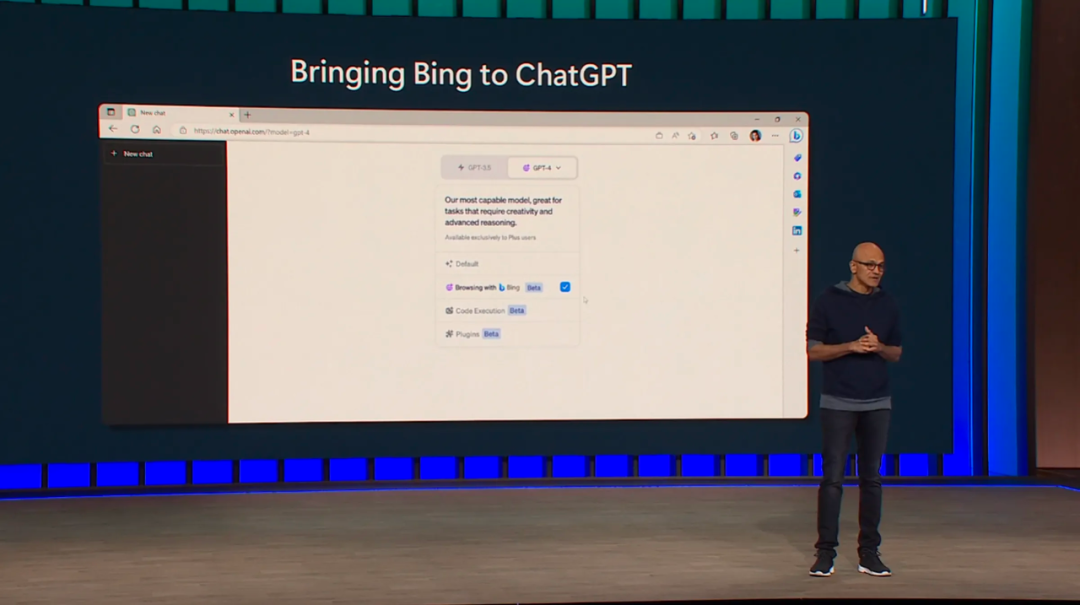

今年的微軟 Build 大會主題高度集中於 AI。微軟CEO 薩提亞・納德拉先是討論了這些年來的平台轉變並回憶了技術變革,然後直接公佈:「我們為開發者宣布了50 多項更新,從將Bing 引入ChatGPT 到Windows Copilot,再到具有通用擴展性的新Copilot Stack、Azure AI Studio 以及新數據分析平台Microsoft Fabric。」

##接下來,微軟連續發布了這些重要更新,與一般使用者更相關的變更包括:在Windows 11 和Edge 中新增了CoPilot 體驗,以及OpenAI ChatGPT 的新Bing AI 和Copilot 外掛程式。

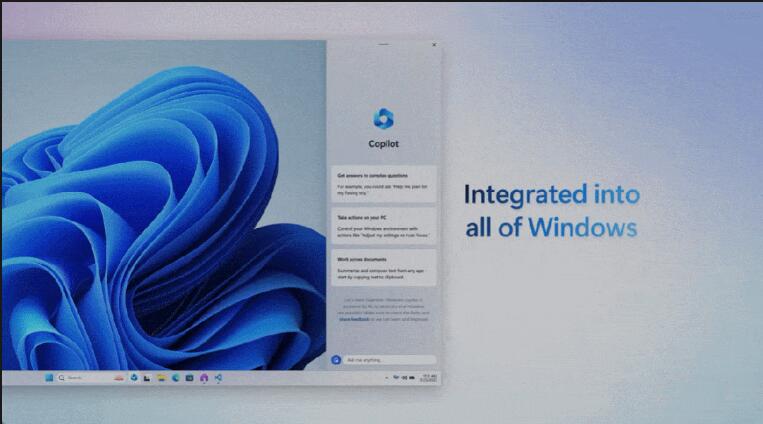

Copilot 登陸 Windows 11這次微軟發布了 Windows Copilot,成為第一個為用戶提供集中式 AI 協助的 PC 平台。 Windows Copilot 與 Bing Chat 和第一 / 三方插件一起使用,使用戶可以專注於將自己的想法變為現實,完成複雜的專案和協作,而不用花費精力尋找、啟動和跨多個應用程式來工作。

Windows Copilot 呼叫和使用起來非常簡單。開啟後,Windows Copilot 就變成了一個整合在作業系統中的側邊欄工具,幫助使用者完成各種任務。

微軟表示,Windows Copilot 將成為高效的個人助理,幫助用戶採取行動、自訂設定並無縫地連結到自己喜愛的應用程式.

此外Windows 的許多功能,包括複製/ 貼上、Snap Assist、截圖和個人化,都可以透過Windows Copilot 變得更好用。例如,使用者不僅可以複製 / 貼上,還能要求 Windows Copilot 重寫、總結或解釋內容。

同時,就像使用 Bing Chat 一樣,使用者可以向 Windows Copilot 詢問一系列從簡單到複雜的問題。例如我想打電話給自己在塞浦路斯的家人,可以快速查看當地時間,以確保不會在半夜叫醒他們。如果我想計劃去塞浦路斯探望他們,則可以讓 Windows Copilot 查詢航班和住宿。

微軟表示,Windows Copilot 將於6 月開始公開測試,之後陸續向現有Windows 11用戶推送。

ChatGPT 預設必應搜尋自從Bing 宣布接入ChatGPT 以來,Bing 用戶已經參與了超過5 億次聊天,使用Bing Image Creator 創建了超過2億張圖像,而Bing 行動應用程式的每日下載量自發布以來增長了8 倍。

在這場大會上,Bing 迎來了三個關鍵更新:將Bing 搜尋整合到ChatGPT,與OpenAI 和新的插件合作夥伴建立一個共同的插件平台,以及擴大Bing Chat 在整個微軟Copilot 中的整合。

「今天的更新為開發者創造了更大的機會,也為人們創造了更神奇的體驗,因為我們在繼續進行搜尋的轉型。」

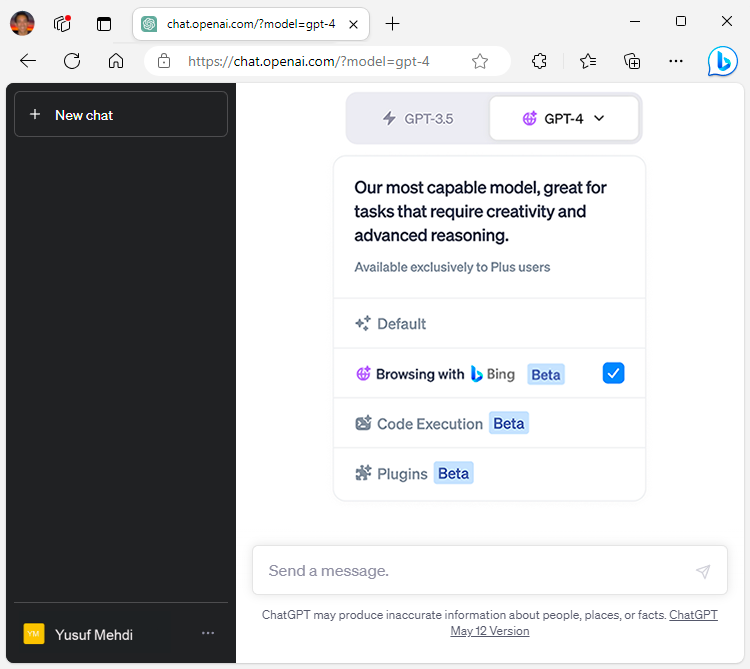

其中一個值得關注的變化是,Bing 將成為ChatGPT 的預設搜尋引擎外掛。納德拉也展示了它將如何運作:

「這只是我們計劃與OpenAI 的合作夥伴一起將Bing 的最佳體驗帶入ChatGPT 體驗的開始。」納德拉表示。

微軟表示,ChatGPT 接入新必應後,可透過網路存取提供更及時、更新的答案。 ChatGPT Plus 訂閱者可以立即體驗這項功能。

ChatGPT 中預設必應搜尋

##加速建立必應生態系統並使用插件增強效能

微軟和OpenAI 將透過互通性來支援和發展AI 插件生態系統。這意味著開發人員現在可以使用一個平台來建立和提交適用於消費者和企業的插件,包括 ChatGPT、Bing、Dynamics 365 Copilot、Microsoft 365 Copilot 和 Windows Copilot。

作為該共享外掛平台的一部分,必應正在增加對各種外掛程式的支援。除了先前已經宣布的 OpenTable 和 Wolfram Alpha 外掛以外,微軟又宣布將 Expedia、Instacart、Kayak、Klarna、Redfin、TripAdvisor 和 Zillow 加入必應生態系統。

借助直接內建在聊天系統中的插件,必應會根據使用者的對話提出相關建議。例如,使用者可以使用 OpenTable 外掛程式來詢問餐廳等相關話題。此外,微軟還表示此類功能將能夠在行動端上的必應應用程式中使用,這將大幅擴展應用程式場景。

此外,數十家企業正成為Bing Chat 外掛程式的合作夥伴:

#必須外掛程式

同時,開發人員現在可以使用插件將他們的應用和服務整合到Microsoft 365 Copilot 中。適用於 Microsoft 365 Copilot 的插件包括 ChatGPT 和 Bing 插件,以及 Teams 訊息擴充和 Power Platform connector。

將Bing 整合到Copilot

同時,隨著Windows Copilot 的發布,微軟也將Bing Chat 的強大功能整合到了Windows 11 中。 Windows Copilot 和 Bing Chat(包括與 Bing 和 OpenAI 共享的插件平台)配合使用,將使這些插件透過 Windows 上的應用程式增強。這將比以往任何時候都更容易獲得個人化答案、相關建議並採取快速行動。

除了 Windows 之外,微軟還將其通用插件平台原生整合到了 Edge 瀏覽器中,使它成為首個整合 AI 搜尋的瀏覽器。

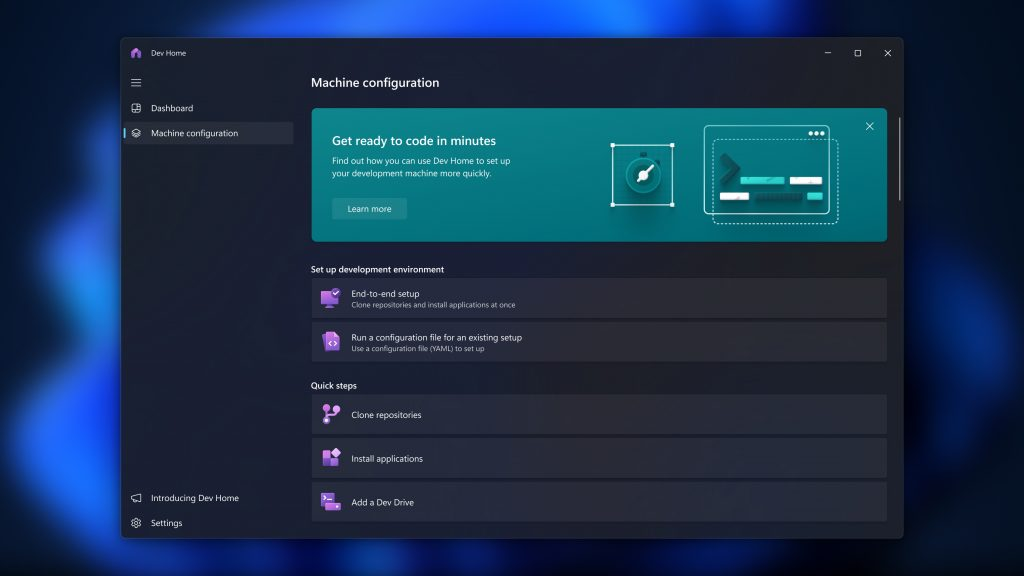

我們知道,開發人員在工作中需要不斷地處理手動開發設置,不僅頻繁點擊,還要進行多個工具登入、導航次優的檔案系統和上下文切換。所有這些都會嚴重影響他們的開發效率。

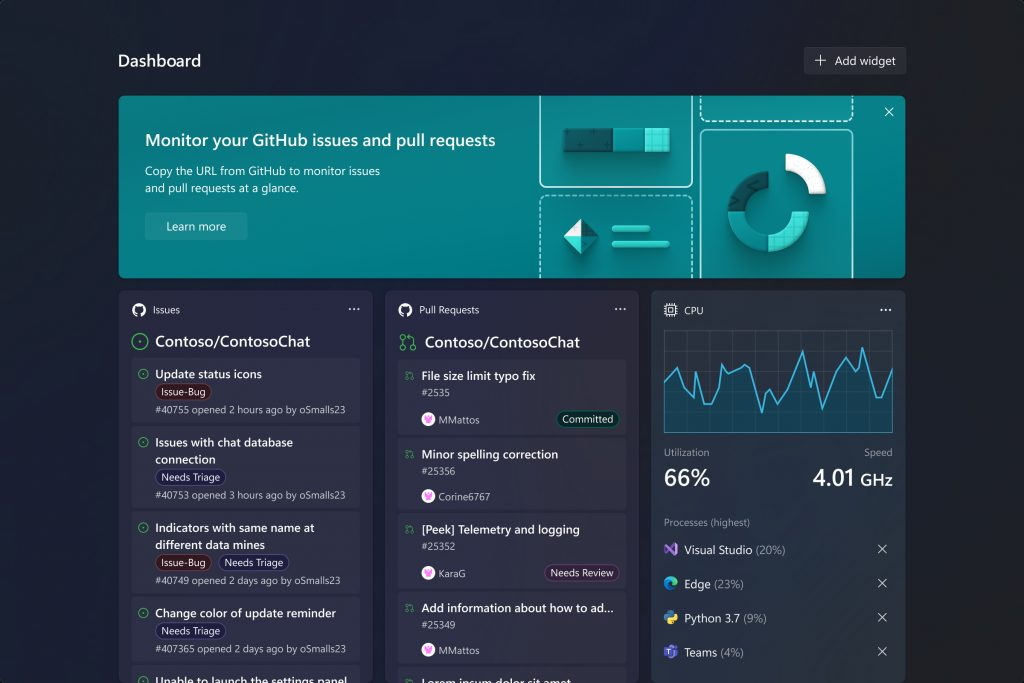

因此,為了提升開發人員的工作效率,微軟在 Windows 11 中推出新的生產力夥伴 Dev Home。目前已經提供了Dev Home 預覽版,其WinGet 配置功能用於實現更簡單快速的設定、Dev Drive 功能用於增強檔案系統功能、新增自訂控制面板用於在一個地方追蹤所有工作流程和任務。這些都可以簡化開發人員的工作流程。

Dev Home 可以輕鬆連結到 GitHub,方便地安裝自己需要的工具和套件。

Dev Home 也可以使用 Microsoft Dev Box 和 GitHub Codespaces 在雲端上設定使用者編碼環境。總而言之,透過為開發人員設計的 Dev Home,微軟提供了一個終極生產力夥伴,讓他們可以專注於自己最擅長的事情 —— 編寫程式碼。

Dev home 網址:https://github.com/microsoft/DevHome

WinGet 配置無人值守且可靠的開發機器設定

使用新的WinGet 配置,開發人員只需點擊幾下就可以準備好編碼。這種無人值守、可靠且可重複的機制使開發人員可以跳過設定新機器或啟動新專案的手動工作,消除了下載正確版本的軟體、套件、工具和框架以及應用程式設定的煩惱。設定時間可以從幾天縮短至幾小時。

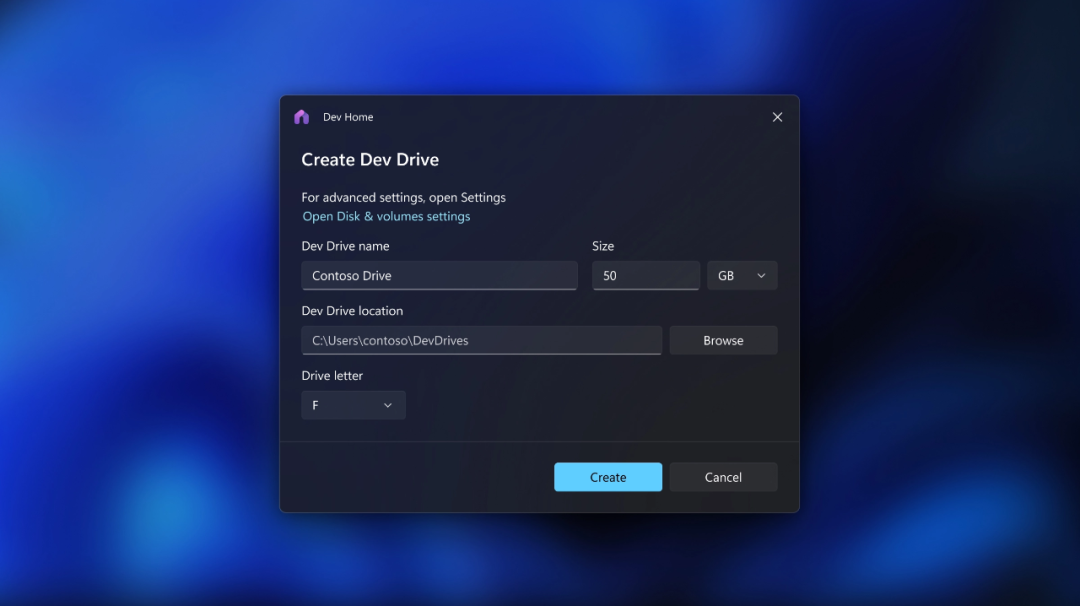

Dev Drive:為開發人員量身打造新儲存磁碟區

使用者經常遇到這種情況,即需要處理包含數千個檔案和目錄的儲存庫,這對I/O 操作(例如建置)提出了挑戰。現在,微軟推出了一種新型儲存卷 Dev Drive,兼具效能與安全兩大特性,專為開發人員量身打造。

Dev Drive 是基於 Resilient File System,在檔案 I/O 場景的建置時間方面提供了高達 30% 的檔案系統改進。

Dev Home 使得在環境設定過程中設定 Dev Drive 非常簡單。它非常適合託管專案原始碼、工作資料夾和套件快取。微軟將於本週稍晚提供 Dev Drive 的預覽版。

在Dev Home 中有效追蹤使用者工作流程

Dev Home 還可以幫助用戶管理正在運行的項目,透過添加GitHub 小部件來有效地追蹤所有編碼任務或發出的請求、以及追蹤CPU 和GPU 效能。此外,微軟正在與 Team Xbox 合作,將 GDK 整合到 Dev Home,使其更容易開始遊戲創作。

GitHub Copilot X 加持的Windows Terminal

GitHub Copilot 的用戶將能夠透過inline 和實驗性聊天體驗使用自然語言AI 模型來推薦命令、解釋error,並在Terminal 應用程式中採取行動。

此外,微軟也在 WinDBG 等開發人員工具中試驗 GitHub Copilot 支援的 AI 功能,幫助使用者提高工作效率。 GitHub Copilot Chat 候補名單現已開放,微軟即將開啟這些功能的存取權限。

此外,微軟繼續投資於重要的工具,使應用程式的建構更加民主化,以適應人工智慧新時代。無論用戶是在 x86/x64 還是 Arm64 上進行開發,微軟都希望用戶能夠輕鬆地在雲端運算和邊緣運算中為 Windows 應用程式帶來 AI 驅動的體驗。

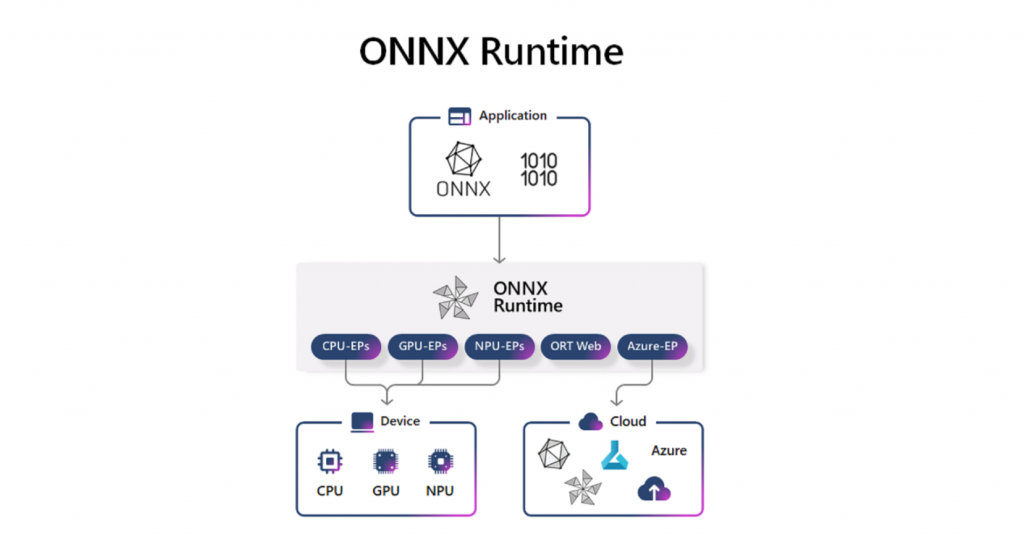

去年在Build 上,微軟宣布了一個新的開發模式Hybrid Loop,可以跨Azure 和客戶端設備實現混合AI 場景。同樣的,在今天 Build 上,微軟表示其願景已經實現,使用 ONNX Runtime 作為 Windows AI 和 Olive 的網關,微軟創建的工具鏈減輕了用戶在優化各種 Windows 和其他設備模型時的負擔。透過 ONNX Runtime,第三方開發人員可以存取微軟內部使用的工具,以便在 Windows 或跨 CPU、GPU、NPU 或與 Azure 混合的其他裝置上執行 AI 模型。

在運行模型時,ONNX Runtime 現在支援在裝置上或雲端執行相同的API,支援混合推理場景,此外,使用者應用程式可以使用本機資源,並在需要時切換到雲端。透過新的 Azure EP 預覽版,使用者可以連接到部署在 AzureML 中的模型,甚至可以連接到 Azure OpenAI 服務。只需幾行程式碼,使用者就可以指定雲端點並定義何時使用雲端的標準。由此,使用者可以更好地控製成本,因為 Azure EP 允許使用者可以靈活地選擇在雲端使用較大的模型或在運行時使用較小的本地模型。

使用者還可以使用 Olive 為不同的硬體最佳化模型,Olive 是一個可擴展的工具鏈,結合了用於模型壓縮、最佳化和編譯的尖端技術。基於此,使用者可以跨 Windows、iOS、Android 和 Linux 等平台使用 ONNX Runtime。

總結而言,ONNX Runtime 和 Olive 都有助於加快將 AI 模型部署到應用程式中的速度。 ONNX Runtime 使用戶可以更輕鬆地在 Windows 和其他平台上建立令人驚嘆的 AI 體驗,同時減少工程工作量並提高效能。

微軟為Microsoft Store 發布了多項新功能,與AI 技術相關的包括:

以上僅是為期多天的 build 開發者大會第一天 keynote 中的內容,而後續還有更多內容將會陸續發布。

從中我們可以看到,微軟聯手 OpenAI,意圖打造出一個 AI 大宇宙,既改造升級自己的產品又輻射影響整個科技社群。

也許,這波 AI 浪潮也才剛開始。

以上是Windows Copilot登場,ChatGPT預設用必應搜索,微軟聯手OpenAI的大宇宙來了的詳細內容。更多資訊請關注PHP中文網其他相關文章!