大模型時代來了!數安風險如何因應?小蠻腰AI高峰會專家支招

ChatGPT等大語言模型爆火背後原因是什麼?為哪些行業產業帶來福音?潛在泡棉風險在哪裡? 5月25日至26日,在2023小蠻腰科技大會分論壇-「邁向智慧時代,實現文明躍遷」AIGC專場高峰會上,20餘位AI領域的研究者、實務者,共同探討AIGC應用與商業新典範、各產業領域發展新路徑,以及潛在資料安全風險、倫理議題。

在26日高峰會現場的新書發布儀式上,《大模型時代》作者、曾任阿里巴巴資深產品專家兼事業部副總經理、矽谷AI新創公司聯合創辦人兼營運長龍志勇接受南都訪談時坦言,生成式AI要走先規範、後發展模式,應對大模型潛在泡沫風險既有技術手段,如大模型自我評估、合規演算法審核等,又有人工流程,更重要的是產業要對問題的解決難度、週期有合理的預期,才能避免過度樂觀所帶來的風險。

大模型掀起新一輪智力革命與產業重構

#ChatGPT等生成式人工智慧幕後真正的智慧“大腦”,正是大語言模型!基於生成式預訓練大模型的技術突破,帶來面向個人、深入產業的多重應用,引發新一輪智力革命與產業重構,建構全新的腦機協作關係。

大模型時代已經來臨!龍志勇透露,《大模型時代》對技術、應用和產業變化進行深入分析、闡述,生動形象解釋ChatGPT大模型背後的原理,描繪大模型將如何驅動社會進入智能革命和腦機協作時代,並總結企業在自身業務中應用大模型的注意事項與方法論,為個人、企業因應變革提出建議。據其稱,大模型在知識工作、商業企業、創意娛樂等領域已具體應用,主要帶來兩種創新:漸進式創新、顛覆性創新。

在高峰會現場主題演講中,人工智慧科學家劉志毅也提到,人工智慧賦能經濟社會發展各領域,下游各領域的產業升級對大模型需求持續走高。根據計算2022年中國人工智慧產業市場規模為3.7億元,預計2027年將達15.37億元,預計在下游製造、交通、金融、醫療等多領域不斷滲透,實現大規模落地應用。

《大模型時代》在5月26日「邁向智慧時代,實現文明躍遷」2023AIGC專場高峰會上發布。

生成式人工智慧帶來信任侵蝕等風險

不過,隨著大模型的廣泛應用,潛在泡沫也隨之湧現。三星引進ChatGPT不到20天,就被揭露機密資料外洩。人們對於AI變臉、AI繪畫等技術所帶來的法律風險、倫理問題和資料安全問題越來越關注。

談到「大模型時代的AI科技創新與倫理治理」時,劉志毅表示,生成式人工智慧確實存在一定風險,如果在擴展規模時沒有考慮、緩解這些風險,可能會減緩轉型速度。訓練模型持續更新以提升效能,可能會引起對敏感資料、隱私以及安全性的擔憂。參與生成式人工智慧的開發、消費、討論和監管的所有人都應努力管理信任侵蝕、長期的員工失業風險、偏見和歧視、資料隱私和智慧財產權的保護等風險。

劉志毅接受南都訪問時分享自己三點看法。他說,一是AI技術會自然進入國民經濟、社會系統各領域,所在風險就會擴大,因為技術本身是黑盒的,如深度神經網絡,透過技術、演算法的計算,沒人知道它每一步怎麼達到,是不透明、不可解釋的,就存在風險。二是AI技術很多時候與數位世界創造有關。例如深度偽造,包括偽造聲音、影像,就是把實體身份變成數位身份,數位經濟越發達的國家,越需要這些技術支撐,依賴性越強,但帶來的風險也越大。三是我國非常強調應用場景與生態,這些應用場景落地必然是創新的,必然會帶來風險,而這些風險隨著場景創新而擴大,因此會前置性做監管,例如國家網信辦發布《生成式人工智慧服務管理辦法(徵求意見稿)》、科技部發布的《關於加強科技倫理治理的意見》等,都是前置性去考慮一些風險。

《大模型時代》作者、曾任阿里巴巴資深產品專家兼事業部副總經理、矽谷AI新創公司聯合創辦人兼營運長龍志勇在新書發布儀式上發言。

對大模型演算法可靠性、透明度提出要求

“資料隱私確實是GPT大模型的重要問題”,龍志勇接受南都採訪時表示,最近OpenAI在美國應對質詢時提前做了這方面準備工作,例如在ChatGPT中提供了關閉聊天記錄的個人選項,使用者可以拒絕大模型使用自己的隱私資料進行訓練;針對企業客戶,OpenAI將提供企業私有部署的模型,避免企業擔憂自家的微調訓練資料被大模型共享給了競爭對手,這些措施大概率會被國內大模型所採納。

對於如何應對大模型潛在泡沫風險,如何平衡生成式人工智慧的強規範、促發展的關係,龍志勇坦言,生成式AI要走先規範、後發展的模式。大模型的服務提供者作為AI生成物的法律責任的主要承擔者,要對AIGC內容的正確性、價值取向負責,其合規壓力還是相當大的,這屬於強規範,「在《北京市促進通用人工智慧創新發展的若干措施》文件中,提到鼓勵生成式AI在科研等非面向公眾服務領域實現向上向善應用,在中關村核心區先行先試,進行包容審慎的監管試點,我認為就屬於一種積極的、在規範和發展之間求得平衡的訊號」。

他提到,監管機構的想法要求大型演算法在可靠性和透明度方面要做出改進。在《大模型時代》中發出了警告,指出潛在的產業泡沫風險,其中一個關鍵因素是大模型的可靠性和透明度問題。 Ilya,OpenAI的首席科學家認為,大型模式幻覺和資訊偽造是阻礙GPT在各產業應用的主要障礙。而幻覺問題之所以難以根除,首先是因為大模型的訓練目標、方法導致,其次是AI自深度學習年代就開始具備的黑箱屬性,不透明,無法在模型中定位具體問題所在。考慮到大模型新能力的湧現機制也不透明、不可預測,大模型產業需要在失控中追求可控,在規範中求得發展,這是最大的挑戰。

出品:南都大數據研究院

研究員:袁炯賢

以上是大模型時代來了!數安風險如何因應?小蠻腰AI高峰會專家支招的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

熱門話題

大模型App騰訊元寶上線!混元再升級,打造可隨身攜帶的全能AI助理

Jun 09, 2024 pm 10:38 PM

大模型App騰訊元寶上線!混元再升級,打造可隨身攜帶的全能AI助理

Jun 09, 2024 pm 10:38 PM

5月30日,騰訊宣布旗下混元大模型全面升級,基於混元大模型的App「騰訊元寶」正式上線,蘋果及安卓應用程式商店皆可下載。相較於先前測試階段的混元小程式版本,面向工作效率場景,騰訊元寶提供了AI搜尋、AI總結、AI寫作等核心能力;面向日常生活場景,元寶的玩法也更加豐富,提供了多個特色AI應用,並新增了創建個人智能體等玩法。 「騰訊做大模型不爭一時之先。」騰訊雲副總裁、騰訊混元大模型負責人劉煜宏表示:「過去的一年,我們持續推進騰訊混元大模型的能力爬坡,在豐富、海量的業務場景中打磨技術,同時洞察用戶的真實需求

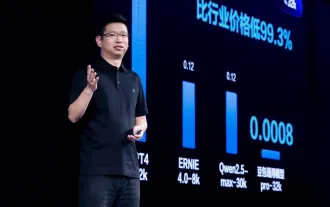

位元組跳動豆包大模型發布,火山引擎全端 AI 服務協助企業智慧轉型

Jun 05, 2024 pm 07:59 PM

位元組跳動豆包大模型發布,火山引擎全端 AI 服務協助企業智慧轉型

Jun 05, 2024 pm 07:59 PM

火山引擎總裁譚待企業要做好大模型落地,面臨模型效果、推理成本、落地難度的三大關鍵挑戰:既要有好的基礎大模型做支撐,解決複雜難題,也要有低成本的推理服務讓大模型廣泛應用,還要更多工具、平台和應用程式幫助企業做好場景落地。 ——譚待火山引擎總裁01.豆包大模型首次亮相大使用量打磨好模型模型效果是AI落地最關鍵的挑戰。譚待指出,只有大的使用量,才能打磨出好模型。目前,豆包大模型日均處理1,200億tokens文字、生成3,000萬張圖片。為助力企業做好大模型場景落地,位元組跳動自主研發的豆包大模型將透過火山

利用昇腾AI技术,秦岭·秦川交通大模型助力西安打造智慧交通创新中心

Oct 15, 2023 am 08:17 AM

利用昇腾AI技术,秦岭·秦川交通大模型助力西安打造智慧交通创新中心

Oct 15, 2023 am 08:17 AM

“高度复杂、碎片化程度高、跨领域”一直是交通行业数智化升级路上的首要痛点。近日,由中科视语、西安市雁塔区政府、西安未来人工智能计算中心联合打造的参数规模千亿级的“秦岭·秦川交通大模型”,面向智慧交通领域,为西安及其周边地区打造智慧交通创新支点。“秦岭·秦川交通大模型”结合西安当地海量开放场景下的交通生态数据、中科视语自研的原创先进算法以及西安未来人工智能计算中心昇腾AI的强大算力,为路网监测、应急指挥、养护管理、公众出行等智慧交通全场景带来数智化变革。交通管理在不同城市有不同的特点,不同道路的交

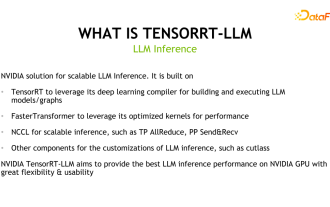

揭露NVIDIA大模型推理架構:TensorRT-LLM

Feb 01, 2024 pm 05:24 PM

揭露NVIDIA大模型推理架構:TensorRT-LLM

Feb 01, 2024 pm 05:24 PM

一、TensorRT-LLM的產品定位TensorRT-LLM是NVIDIA為大型語言模型(LLM)所開發的可擴展推理方案。它基於TensorRT深度學習編譯框架建構、編譯和執行計算圖,並藉鑒了FastTransformer中高效的Kernels實作。此外,它還利用NCCL實現設備間的通訊。開發者可以根據技術發展和需求差異,客製化算子以滿足特定需求,例如基於cutlass開發客製化的GEMM。 TensorRT-LLM是NVIDIA官方推理方案,致力於提供高效能並不斷完善其實用性。 TensorRT-LL

對標GPT-4!中國移動九天大模型通過雙備案

Apr 04, 2024 am 09:31 AM

對標GPT-4!中國移動九天大模型通過雙備案

Apr 04, 2024 am 09:31 AM

4月4日消息,日前,國家網信辦公佈已備案大模型清單,中國移動「九天自然語言交互大模型」名列其中,標誌著中國移動九天AI大模型可正式對外提供生成式人工智慧服務。中國移動表示,這是同時透過國家「生成式人工智慧服務備案」和「境內深度合成服務演算法備案」雙備案的首個央企研發的大模型。據介紹,九天自然語言交互大模型具有產業能力增強、安全可信、支援全端國產化等特點,已形成90億、139億、570億、千億等多種參數量版本,可靈活部署於雲、邊、端不同場

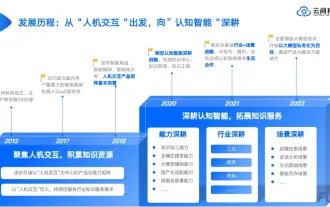

工業知識圖譜進階實戰

Jun 13, 2024 am 11:59 AM

工業知識圖譜進階實戰

Jun 13, 2024 am 11:59 AM

一、背景簡介首先來介紹雲問科技的發展歷程。雲問科技公...2023年,正是大模型盛行的時期,很多企業認為已經大模型之後圖譜的重要性大大降低了,之前研究的預置的資訊化系統也都不重要了。不過隨著RAG的推廣、資料治理的盛行,我們發現更有效率的資料治理和高品質的資料是提升私有化大模型效果的重要前提,因此越來越多的企業開始重視知識建構的相關內容。這也推動了知識的建構和加工開始向更高層次發展,其中有許多技巧和方法可以挖掘。可見一個新技術的出現,並不是將所有的舊技術打敗,也有可能將新技術和舊技術相互融合後

新測試基準發布,最強開源Llama 3尷尬了

Apr 23, 2024 pm 12:13 PM

新測試基準發布,最強開源Llama 3尷尬了

Apr 23, 2024 pm 12:13 PM

如果試題太簡單,學霸和學渣都能考90分,拉不開差距……隨著Claude3、Llama3甚至之後GPT-5等更強模型發布,業界急需一款更難、更有區分度的基準測試。大模型競技場背後組織LMSYS推出下一代基準測試Arena-Hard,引起廣泛關注。 Llama3的兩個指令微調版本實力到底如何,也有了最新參考。與先前大家分數都相近的MTBench相比,Arena-Hard區分度從22.6%提升到87.4%,孰強孰弱一目了然。 Arena-Hard利用競技場即時人類數據構建,與人類偏好一致率也高達89.1%

小米位元組聯手!小愛同學接入豆包大模型:手機、SU7已搭載

Jun 13, 2024 pm 05:11 PM

小米位元組聯手!小愛同學接入豆包大模型:手機、SU7已搭載

Jun 13, 2024 pm 05:11 PM

6月13日消息,根據字節旗下「火山引擎」公眾號介紹,小米旗下人工智慧助理「小愛同學」與火山引擎達成合作,雙方基於豆包大模型實現更智慧的AI互動體驗。據悉,位元組跳動打造的豆包大模型,每日能夠高效處理數量多達1200億個的文本tokens、生成3000萬張內容。小米借助豆包大模型提升自身模型的學習與推理能力,打造出全新的“小愛同學”,不僅更加精準地把握用戶需求,還以更快的響應速度和更全面的內容服務。例如,當使用者詢問複雜的科學概念時,&ldq