OpenAI創辦人Sam Altman最新訪談:GPT-3 或開源,縮放法則加速建構AGI

大數據摘要出品

「我們非常缺乏GPU」

在最近的一次訪談中,OpenAI的掌舵人Sam Altman 如此回應主持人提出關於「不滿的便是API的可靠性和速度」。

這次訪談來自人工智慧的新創公司Humanloop 的CEO Raza Habib,他在推特上整理了這次訪談的重點。

推特網址:

https://twitter.com/dr_cintas/status/1664281914948337664

#在這次訪談中,Altman也公佈了最近兩年的GPT計劃,例如2023年的計劃是降低GPT-4的成本,以及提高響應速度,其他還包括:

1.更長的上下文窗口,可能會支援100w的token;

2.微調API,幫助開發人員更好的開發;

3.支援會話狀態的API,即支援會話狀態的API。

2024年的計畫中提到讓GPT-4支持多模態,之所以延後到2024年,就是因為太缺GPU了。

在訪談中,Altman 也提到他們一直在考慮是否開源GPT-3,毋容置疑開源是非常重要的。同時,他也表達了現在的AI模型並沒有那麼危險,雖然對未來的模型進行監管非常重要,但是禁止開發是一個非常大的錯誤觀點。

Raza Habib原本將這次訪談的更多詳細資訊公佈到了Humanloop,但文摘菌今早查看,網頁已經404了。根據國內微博@寶玉xp翻譯,他也提到了關於大模型未來發展的縮放法則:

OpenAI的內部數據表明,模型性能的縮放法則繼續有效,使模型更大將繼續產生性能。 OpenAI已將模型的規模擴大數百萬倍,因此無法繼續維持縮放速度,這種做法在未來將無法持續。這並不意味著OpenAI不會繼續嘗試使模型更大,只是意味著它們可能每年只會增加一倍或兩倍,而不是增加許多個數量級。

縮放繼續有效的事實對AGI開發的時間軸有重要的影響。縮放假設是我們可能已經有了建構AGI所需的大部分零件,剩下的大部分工作將是將現有的方法擴展到更大的模型和更大的資料集。如果縮放的時代結束了,那麼我們可能應該預期AGI會更遠。縮放法則繼續有效強烈暗示了更短的時間線。

顯然,縮放法則是通往AGI的最快路徑。

什麼是縮放法則?

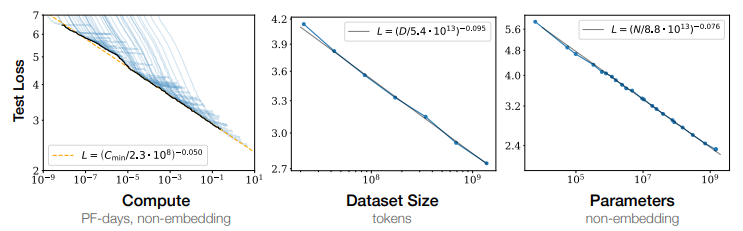

縮放法則,英文名稱Scaling Laws,是一種現象描述,大意是指:語言模型的效果與參數量、資料量、計算量基本上呈平滑的冪定律。

換句話說,隨著模型的參數量(Parameters)、參與訓練的資料量(Tokens)以及訓練過程累積的計算量(FLOPS)的指數性增大, 模型在測試集上的Loss 就線性降低,也意味著模型的效果越好。

圖示:當沒有被其他兩個因素限制時,實證表現與每個單獨因素都呈現冪律關係。

在2022 年,DeepMind 在 ScalingLaw 裡又做了進一步分析。研究透過定量的實驗驗證,語言模型訓練資料大小,應該和模型參數量大小等比放大。在計算總量不變的情況下,模型訓練的效果在參數量和訓練資料量當中有個最優平衡點,曲線下面的最低點是在參數規模和訓練資料量當中有個非常好的折中點。

OpeaAI的成功和GPT-4

OpenAI最初是一個非營利性人工智慧研究實驗室,2016年獲得了薩姆•奧爾特曼和埃隆•馬斯克10億美元的資助。

2019年OpenAI轉型為獲利性人工智慧研究實驗室,以吸收投資者的資金。

在實驗室支持其研究的資金已所剩無幾的時候,微軟又宣布將在實驗室投資10億美元。

OpenAI推出的GPT系列,每個版本都能引起業界狂歡,在微軟Build 2023開發者大會上,OpenAI的創始人Andrej Karpthy做了演講:State of GPT(GPT的現狀),表示他們一直把大模型當作「人腦」來訓練。

Andrej提到,可以把當前LLM大語言模型比喻為人類思考模式的系統一(快系統),這是相對於反應慢但具有更長線推理的系統二(慢系統)而言。

「系統一是一個快速的自動過程,我認為有點對應於LLM,只是對標記進行抽樣。

系統二是大腦中較慢的、經過深思熟慮的計劃部分。

而prompt工程,基本上是希望讓LLM恢復一些我們大腦中具有的能力。」

Andrej Karpthy也提到,GPT-4 是一個了不起的人工製品,他非常感謝它的存在。它在很多領域都有大量的知識,它可以做數學、程式碼等等,所有這些功能都觸手可及。

而CEO Altman 表示,在早期的時候,GPT-4 非常慢,還有bug,很多事情做得不好。但是,最早期的電腦也是這樣,它們仍然指向了我們生活中將要變得非常重要的東西的道路,儘管需要幾十年的時間才能發展。

如此看來,OpenAI是一家堅持夢想的機構,並且想把事情做到極致的公司。

如同微軟亞洲研究院前副院長、瀾舟科技創辦人周明在一次訪談中所提到的:

#OpenAI最大的功績是把各方面做到極致,是整合創新的典範。

世界上有幾類人,有人就是要研究底層創新。有的是在底層創新上做應用,一般的應用是解決單一任務。可以重寫成:另一種做法是實現整合創新,將所有工作、應用和演算法集中在一個大型平台上,從而創造里程碑。 OpenAI 恰好整合創新做得非常好。

參考:

###https://mp.weixin.qq.com/s/p42pBVyjZws8XsstDoR2Jw https://mp.weixin.qq.com/s/zmEGzm1cdXupNoqZ65h7yg https://weibo.com/1727858283/4907695679472174?wm=3333_2001&from=10D593089689309000 5679472174&s_channel=4 https://humanloop.com/blog/openai- plans?cnotallow=bd9e76a5f41a6d847de52fa275480e22###以上是OpenAI創辦人Sam Altman最新訪談:GPT-3 或開源,縮放法則加速建構AGI的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

如何快速查看numpy版本

Jan 19, 2024 am 08:23 AM

如何快速查看numpy版本

Jan 19, 2024 am 08:23 AM

Numpy是Python中一個重要的數學庫,它提供了高效的數組操作和科學計算函數,被廣泛應用於數據分析、機器學習、深度學習等領域。在使用numpy過程中,我們經常需要查看numpy的版本號,以便確定目前環境所支援的功能。本文將介紹如何快速查看numpy版本,並提供具體的程式碼範例。方法一:使用numpy自帶的__version__屬性numpy模組自帶一個__

如何查看maven版本

Jan 17, 2024 pm 05:06 PM

如何查看maven版本

Jan 17, 2024 pm 05:06 PM

查看maven版本的方法:1、使用命令列;2、檢視環境變數;3、使用IDE;4、檢視pom.xml檔。詳細介紹:1、使用命令列,在命令列中輸入"mvn -v"或"mvn --version",然後按回車,這將顯示Maven的版本資訊以及Java的版本資訊;2、查看環境變量,在某些系統上,可以查看環境變數來找到Maven的版本信息,在命令列中輸入命令,然後回車等等。

大模型一對一戰鬥75萬輪,GPT-4奪冠,Llama 3位列第五

Apr 23, 2024 pm 03:28 PM

大模型一對一戰鬥75萬輪,GPT-4奪冠,Llama 3位列第五

Apr 23, 2024 pm 03:28 PM

關於Llama3,又有測試結果新鮮出爐-大模型評測社群LMSYS發布了一份大模型排行榜單,Llama3位列第五,英文單項與GPT-4並列第一。圖片不同於其他Benchmark,這份榜單的依據是模型一對一battle,由全網測評者自行命題並評分。最終,Llama3取得了榜單中的第五名,排在前面的是GPT-4的三個不同版本,以及Claude3超大杯Opus。而在英文單項榜單中,Llama3反超了Claude,與GPT-4打成了平手。對於這一結果,Meta的首席科學家LeCun十分高興,轉發了推文並

Linux下更新curl版本教程!

Mar 07, 2024 am 08:30 AM

Linux下更新curl版本教程!

Mar 07, 2024 am 08:30 AM

在Linux下更新curl版本,您可以按照以下步驟進行操作:檢查目前curl版本:首先,您需要確定目前系統中安裝的curl版本。開啟終端,並執行以下指令:curl--version該指令將顯示目前curl的版本資訊。確認可用的curl版本:在更新curl之前,您需要確定可用的最新版本。您可以造訪curl的官方網站(curl.haxx.se)或相關的軟體來源,尋找最新版本的curl。下載curl原始碼:使用curl或瀏覽器,下載您選擇的curl版本的原始碼檔案(通常為.tar.gz或.tar.bz2

查看麒麟作業系統版本和核心版本

Feb 21, 2024 pm 07:04 PM

查看麒麟作業系統版本和核心版本

Feb 21, 2024 pm 07:04 PM

查看麒麟作業系統版本和核心版本在麒麟作業系統中,了解如何檢視系統版本和核心版本是進行系統管理和維護的基礎。查看麒麟作業系統版本方法一:使用/etc/.kyinfo檔案要查看麒麟作業系統的版本,您可以檢視/etc/.kyinfo檔案。此檔案包含了作業系統的版本資訊。執行以下指令:cat/etc/.kyinfo此指令將顯示作業系統的詳細版本資訊。方法二:使用/etc/issue檔案另一個檢視作業系統版本的方法是透過檢視/etc/issue檔案。這個文件同樣提供了版本信息,但可能不如.kyinfo文件

如何輕鬆查看Oracle的安裝版本

Mar 07, 2024 am 11:27 AM

如何輕鬆查看Oracle的安裝版本

Mar 07, 2024 am 11:27 AM

如何輕鬆查看Oracle的安裝版本,需要具體程式碼範例作為一款被廣泛應用於企業級資料庫管理系統的軟體,Oracle資料庫具有許多版本和不同的安裝方式。在日常工作中,我們經常需要查看Oracle資料庫的安裝版本,以便進行相應的操作和維護。本文將介紹如何輕鬆查看Oracle的安裝版本,並給出具體的程式碼範例。方法一:透過SQL查詢在Oracle資料庫中,我們可以通

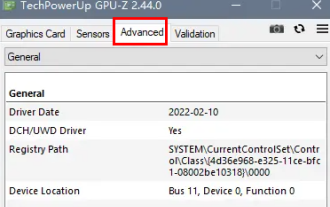

dp介面怎麼看1.2還是1.4

Feb 06, 2024 am 10:27 AM

dp介面怎麼看1.2還是1.4

Feb 06, 2024 am 10:27 AM

DP介面是電腦裡面重要的介面線,有很多使用者在使用電腦的時候,想要知道怎麼樣可以查看DP介面是1.2還是1.4的,其實只需要在GPU-Z中就可以看。 dp介面怎麼看1.2還是1.4:1、先在GPU-Z中選擇「Advanced」。 2.再看“Advanced”下面“General”中的“Monitor1”,可以看“LinkRate(current)”和“Lanes(current)”這兩項。 3.最後如果顯示8.1Gbps×4,就是DP1.3版本以上,一般都是DP1.4,如果是5.4Gbps×4,則

更新pip版本的簡單步驟:1分鐘內完成

Jan 27, 2024 am 09:45 AM

更新pip版本的簡單步驟:1分鐘內完成

Jan 27, 2024 am 09:45 AM

一分鐘搞定:如何更新pip版本,需要具體程式碼範例隨著Python的快速發展,pip成為了Python套件管理的標準工具。然而,隨著時間的推移,pip版本也不斷更新,為了能夠使用最新的功能和修復可能的安全漏洞,更新pip版本是非常重要的。本文將介紹如何在一分鐘內快速更新pip,並提供具體的程式碼範例。首先,我們需要打開命令列視窗。在Windows系統中,可以使用