田淵棟新作:打開1層Transformer黑盒,注意力機制沒那麼神秘

Transformer架構已經橫掃了包括自然語言處理、電腦視覺、語音、多模態等多個領域,不過目前只是實驗效果非常驚艷,對Transformer工作原理的相關研究仍然十分有限。

其中最大謎團在於,Transformer為什麼只依靠一個「簡單的預測損失」就能從梯度訓練動態(gradient training dynamics)中湧現出高效的表徵?

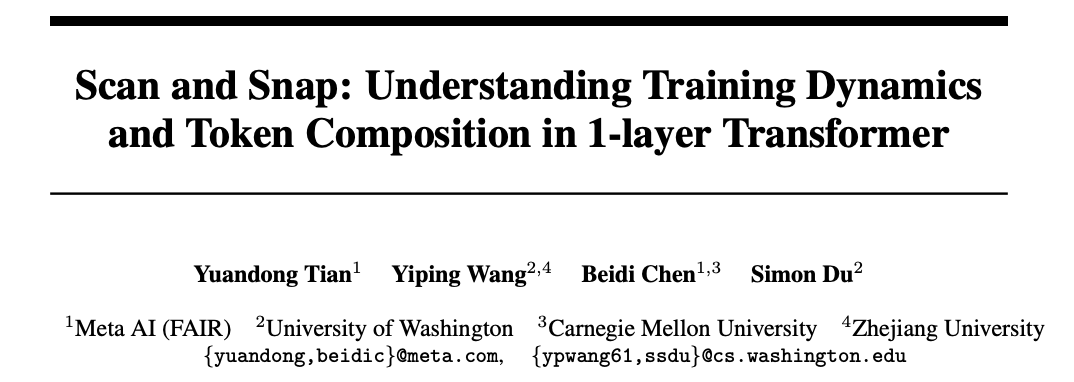

最近田徑棟博士公佈了團隊的最新研究成果,以數學嚴格方式,分析了1層Transformer(一個自註意力層加一個解碼器層)在下一個token預測任務上的SGD訓練動態。

論文連結:https://arxiv.org/abs/2305.16380

#這篇論文打開了自註意力層如何組合輸入token動態過程的黑盒子,並揭示了潛在的歸納偏見的性質。

具體來說,在沒有位置編碼、長輸入序列、以及解碼器層比自註意力層學習更快的假設下,研究人員證明了自註意力就是一個判別式掃描演算法(discriminative scanning algorithm):

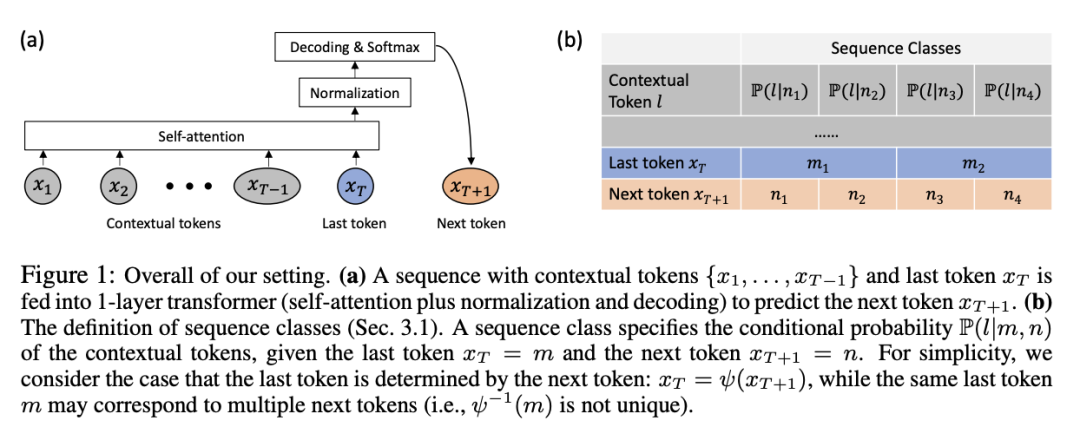

從均勻分佈的注意力(uniform attention)開始,對於要預測的特定下一個token,模型逐漸關注不同的key token,而較少關注那些出現在多個next token窗口中的常見token

#對於不同的token,模型會逐漸降低注意力權重,遵循訓練集中的key token和query token之間從低到高共現的順序。

有趣的是,這個過程不會導致贏家通吃,而是由兩層學習率控制的相變而減速,最後變成(幾乎)固定的token組合,在合成和真實世界的數據上也驗證了這種動態。

田淵棟博士是Meta人工智慧研究院研究員、研究經理,圍棋AI專案負責人,其研究方向為深度增強學習及其在遊戲中的應用,以及深度學習模型的理論分析。先後於2005年及2008年取得上海交通大學本碩學位,2013年獲得美國卡內基美隆大學機器人研究所博士學位。

曾獲2013年國際電腦視覺大會(ICCV)馬爾獎提名(Marr Prize Honorable Mentions),ICML2021傑出論文榮譽提名獎。

曾在博士畢業後發布《博士五年總結》系列,從研究方向選擇、閱讀積累、時間管理、工作態度、收入和可持續的職業發展等方面對博士生涯總結心得和體會。

揭秘1層Transformer

基於Transformer架構的預訓練模型通常只包含非常簡單的監督任務,例如預測下一個單字、填空等,但卻可以為下游任務提供非常豐富的表徵,實在令人費解。

之前的工作雖然已經證明了Transformer本質上就是一個通用近似器(universal approximator),但先前常用的機器學習模型,例如kNN、核SVM、多層感知機等其實也是通用近似器,這種理論無法解釋這兩類模型在效能上的巨大差距。

研究人員認為,了解Transformer的訓練動態(training dynamics)是很重要的,也就是說,在訓練過程中,可學習參數是如何隨時間變化的。

文章首先以嚴謹數學定義的方式,形式化描述了1層無位置編碼Transformer的SGD在下一個token預測(GPT系列模型常用的訓練範式)上的訓練動態。

1層的Transformer包含一個softmax自註意力層和預測下一個token的解碼器層。

在假設序列很長,而且解碼器的學習速度比自註意力層快的情況下,證明了訓練期間自註意力的動態行為:

1. 頻率偏差Frequency Bias

##模型會逐漸關注那些與query token大量共現的key token,而對那些共現較少的token降低注意力。

2. 判別偏差Discrimitive Bias

##模型更關注那些在下一個要預測的token中唯一出現的獨特token,而對那些在多個下一個token中出現的通用token失去興趣。這兩個特性表明,自註意力隱式地運行著一種判別式掃描(discriminative scanning)的演算法,並存在歸納偏差(inductive bias),即偏向於經常與query token共同出現的獨特的key token

此外,雖然自註意力層在訓練過程中趨向於變得更加稀疏,但正如頻率偏差所暗示的,模型因為訓練動態中的相變(phase transition),所以不會崩潰為獨熱(one hot)。

研究結果進一步表明,相變的開始是由學習率控制的:大的學習率會產生稀疏的注意力模式,而在固定的自註意力學習率下,大的解碼器學習率會導致更快的相變和密集的注意力模式。

研究人員將工作中發現的SGD動態命名為掃描(scan)和snap:

掃描階段:自註意力集中在key tokens上,即不同的、經常與下一個預測token同時出現的token;其他所有token的注意力都下降。

snap階段:注意力全中幾乎凍結,token組合固定。

以上是田淵棟新作:打開1層Transformer黑盒,注意力機制沒那麼神秘的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

C 中的chrono庫如何使用?

Apr 28, 2025 pm 10:18 PM

C 中的chrono庫如何使用?

Apr 28, 2025 pm 10:18 PM

使用C 中的chrono庫可以讓你更加精確地控制時間和時間間隔,讓我們來探討一下這個庫的魅力所在吧。 C 的chrono庫是標準庫的一部分,它提供了一種現代化的方式來處理時間和時間間隔。對於那些曾經飽受time.h和ctime折磨的程序員來說,chrono無疑是一個福音。它不僅提高了代碼的可讀性和可維護性,還提供了更高的精度和靈活性。讓我們從基礎開始,chrono庫主要包括以下幾個關鍵組件:std::chrono::system_clock:表示系統時鐘,用於獲取當前時間。 std::chron

如何理解C 中的DMA操作?

Apr 28, 2025 pm 10:09 PM

如何理解C 中的DMA操作?

Apr 28, 2025 pm 10:09 PM

DMA在C 中是指DirectMemoryAccess,直接內存訪問技術,允許硬件設備直接與內存進行數據傳輸,不需要CPU干預。 1)DMA操作高度依賴於硬件設備和驅動程序,實現方式因係統而異。 2)直接訪問內存可能帶來安全風險,需確保代碼的正確性和安全性。 3)DMA可提高性能,但使用不當可能導致系統性能下降。通過實踐和學習,可以掌握DMA的使用技巧,在高速數據傳輸和實時信號處理等場景中發揮其最大效能。

怎樣在C 中處理高DPI顯示?

Apr 28, 2025 pm 09:57 PM

怎樣在C 中處理高DPI顯示?

Apr 28, 2025 pm 09:57 PM

在C 中處理高DPI顯示可以通過以下步驟實現:1)理解DPI和縮放,使用操作系統API獲取DPI信息並調整圖形輸出;2)處理跨平台兼容性,使用如SDL或Qt的跨平台圖形庫;3)進行性能優化,通過緩存、硬件加速和動態調整細節級別來提升性能;4)解決常見問題,如模糊文本和界面元素過小,通過正確應用DPI縮放來解決。

C 中的實時操作系統編程是什麼?

Apr 28, 2025 pm 10:15 PM

C 中的實時操作系統編程是什麼?

Apr 28, 2025 pm 10:15 PM

C 在實時操作系統(RTOS)編程中表現出色,提供了高效的執行效率和精確的時間管理。 1)C 通過直接操作硬件資源和高效的內存管理滿足RTOS的需求。 2)利用面向對象特性,C 可以設計靈活的任務調度系統。 3)C 支持高效的中斷處理,但需避免動態內存分配和異常處理以保證實時性。 4)模板編程和內聯函數有助於性能優化。 5)實際應用中,C 可用於實現高效的日誌系統。

怎樣在C 中測量線程性能?

Apr 28, 2025 pm 10:21 PM

怎樣在C 中測量線程性能?

Apr 28, 2025 pm 10:21 PM

在C 中測量線程性能可以使用標準庫中的計時工具、性能分析工具和自定義計時器。 1.使用庫測量執行時間。 2.使用gprof進行性能分析,步驟包括編譯時添加-pg選項、運行程序生成gmon.out文件、生成性能報告。 3.使用Valgrind的Callgrind模塊進行更詳細的分析,步驟包括運行程序生成callgrind.out文件、使用kcachegrind查看結果。 4.自定義計時器可靈活測量特定代碼段的執行時間。這些方法幫助全面了解線程性能,並優化代碼。

給MySQL表添加和刪除字段的操作步驟

Apr 29, 2025 pm 04:15 PM

給MySQL表添加和刪除字段的操作步驟

Apr 29, 2025 pm 04:15 PM

在MySQL中,添加字段使用ALTERTABLEtable_nameADDCOLUMNnew_columnVARCHAR(255)AFTERexisting_column,刪除字段使用ALTERTABLEtable_nameDROPCOLUMNcolumn_to_drop。添加字段時,需指定位置以優化查詢性能和數據結構;刪除字段前需確認操作不可逆;使用在線DDL、備份數據、測試環境和低負載時間段修改表結構是性能優化和最佳實踐。

量化交易所排行榜2025 數字貨幣量化交易APP前十名推薦

Apr 30, 2025 pm 07:24 PM

量化交易所排行榜2025 數字貨幣量化交易APP前十名推薦

Apr 30, 2025 pm 07:24 PM

交易所內置量化工具包括:1. Binance(幣安):提供Binance Futures量化模塊,低手續費,支持AI輔助交易。 2. OKX(歐易):支持多賬戶管理和智能訂單路由,提供機構級風控。獨立量化策略平台有:3. 3Commas:拖拽式策略生成器,適用於多平台對沖套利。 4. Quadency:專業級算法策略庫,支持自定義風險閾值。 5. Pionex:內置16 預設策略,低交易手續費。垂直領域工具包括:6. Cryptohopper:雲端量化平台,支持150 技術指標。 7. Bitsgap:

C 中的字符串流如何使用?

Apr 28, 2025 pm 09:12 PM

C 中的字符串流如何使用?

Apr 28, 2025 pm 09:12 PM

C 中使用字符串流的主要步驟和注意事項如下:1.創建輸出字符串流並轉換數據,如將整數轉換為字符串。 2.應用於復雜數據結構的序列化,如將vector轉換為字符串。 3.注意性能問題,避免在處理大量數據時頻繁使用字符串流,可考慮使用std::string的append方法。 4.注意內存管理,避免頻繁創建和銷毀字符串流對象,可以重用或使用std::stringstream。