套娃不可取:研究人員證實用AI生成的結果訓練AI將導致模型退化

IT之家 6 月 14 日消息,IT之家的小伙伴們可能都有設想過,如果用 AI 生成的結果來訓練 AI,進行“套娃式訓練”,能得到什麼樣的結果?目前還真有研究團隊對此進行了觀察記錄,詳細論文及得出的結果發表在了 arXiv 上。

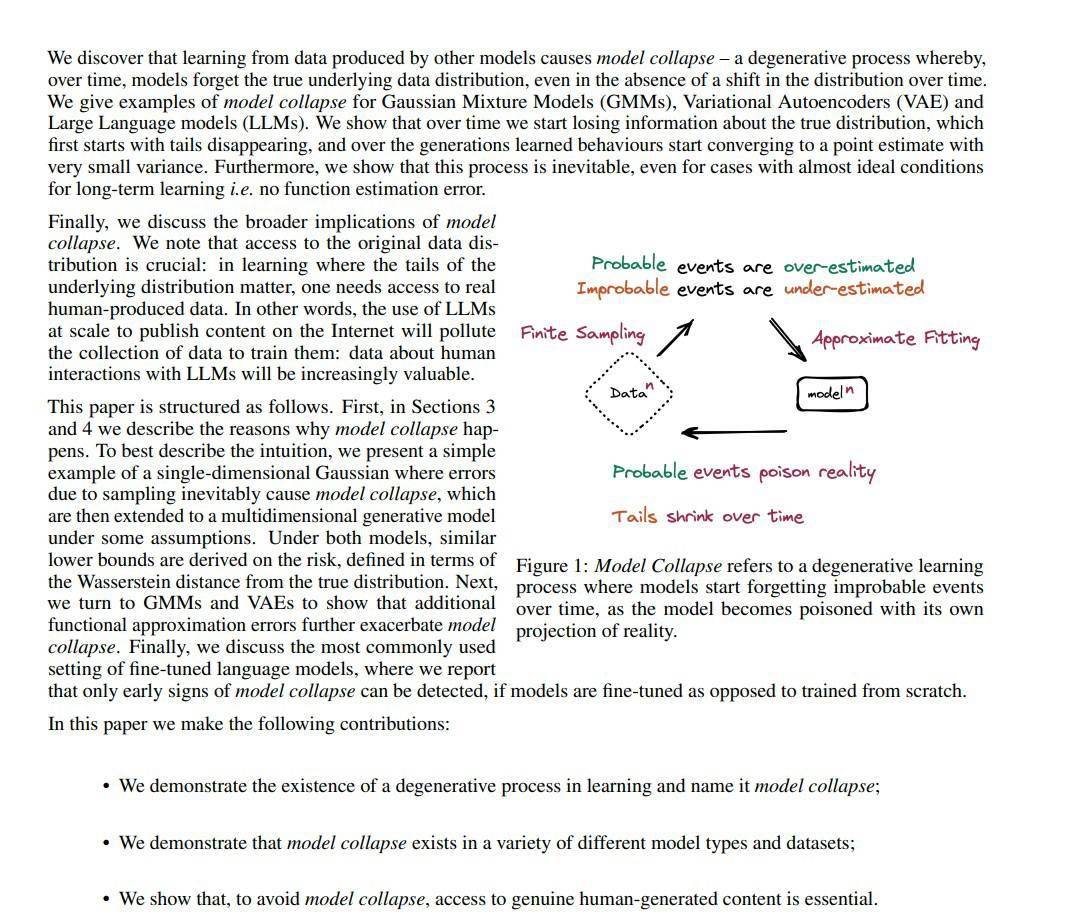

一句話總結—— “在訓練中使用模型生成的內容,將導致後續生成的模型出現不可逆轉的缺陷”,說人話就是研究人員發現“用AI 生成的結果訓練AI,只會讓模型變得越來越差」。

▲ 圖表來源 arXiv

據悉,研究人員專門研究了AI 生成模型的機率分佈,主要圍繞著「文字到文字」和「圖像到圖像」展開,最終得出結論:「由於每個模型生成的結果都具有一定的特點,因此用AI 生成的模型訓練AI,隨著時間的推移,後者會忘記真正的底層資料分佈。」

▲ 圖表來源 arXiv

論文的主要作者之一Ilia Shumailov 同時表示「隨著時間的推移,產生資料中的錯誤(IT之家註:例如虛假舉例)會迫使AI 進一步錯誤地感知現實,我們驚訝地觀察到模型崩潰發生的速度相當快,模型可以迅速忘記他們最初從中學習的大部分原始數據。」

但小夥伴可能會有所疑問,如果將 AI 產生的結果經過人工潤飾後再投入模型訓練,是否可以避免模型「退化」?

答案是否定的,研究人員發現“模型退化過程是不可避免的”,因此即使對於“經過潤色後理想化的 AI 輸出內容”,模型在長期學習後,也會出現一定的退化現象。

對於任何大模型而言,由於其學習數據過多,它們都將不可避免地接觸到其他AI 生成的數據,因此研究人員表示“應引入AI 鑑定來挑出可能存在錯誤的學習數據”以提升模型的學習能力與準確性。

以上是套娃不可取:研究人員證實用AI生成的結果訓練AI將導致模型退化的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

AI Hentai Generator

免費產生 AI 無盡。

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

熱門話題

centos關機命令行

Apr 14, 2025 pm 09:12 PM

centos關機命令行

Apr 14, 2025 pm 09:12 PM

CentOS 關機命令為 shutdown,語法為 shutdown [選項] 時間 [信息]。選項包括:-h 立即停止系統;-P 關機後關電源;-r 重新啟動;-t 等待時間。時間可指定為立即 (now)、分鐘數 ( minutes) 或特定時間 (hh:mm)。可添加信息在系統消息中顯示。

如何檢查CentOS HDFS配置

Apr 14, 2025 pm 07:21 PM

如何檢查CentOS HDFS配置

Apr 14, 2025 pm 07:21 PM

檢查CentOS系統中HDFS配置的完整指南本文將指導您如何有效地檢查CentOS系統上HDFS的配置和運行狀態。以下步驟將幫助您全面了解HDFS的設置和運行情況。驗證Hadoop環境變量:首先,確認Hadoop環境變量已正確設置。在終端執行以下命令,驗證Hadoop是否已正確安裝並配置:hadoopversion檢查HDFS配置文件:HDFS的核心配置文件位於/etc/hadoop/conf/目錄下,其中core-site.xml和hdfs-site.xml至關重要。使用

CentOS上GitLab的備份方法有哪些

Apr 14, 2025 pm 05:33 PM

CentOS上GitLab的備份方法有哪些

Apr 14, 2025 pm 05:33 PM

CentOS系統下GitLab的備份與恢復策略為了保障數據安全和可恢復性,CentOS上的GitLab提供了多種備份方法。本文將詳細介紹幾種常見的備份方法、配置參數以及恢復流程,幫助您建立完善的GitLab備份與恢復策略。一、手動備份利用gitlab-rakegitlab:backup:create命令即可執行手動備份。此命令會備份GitLab倉庫、數據庫、用戶、用戶組、密鑰和權限等關鍵信息。默認備份文件存儲於/var/opt/gitlab/backups目錄,您可通過修改/etc/gitlab

CentOS上PyTorch的GPU支持情況如何

Apr 14, 2025 pm 06:48 PM

CentOS上PyTorch的GPU支持情況如何

Apr 14, 2025 pm 06:48 PM

在CentOS系統上啟用PyTorchGPU加速,需要安裝CUDA、cuDNN以及PyTorch的GPU版本。以下步驟將引導您完成這一過程:CUDA和cuDNN安裝確定CUDA版本兼容性:使用nvidia-smi命令查看您的NVIDIA顯卡支持的CUDA版本。例如,您的MX450顯卡可能支持CUDA11.1或更高版本。下載並安裝CUDAToolkit:訪問NVIDIACUDAToolkit官網,根據您顯卡支持的最高CUDA版本下載並安裝相應的版本。安裝cuDNN庫:前

docker原理詳解

Apr 14, 2025 pm 11:57 PM

docker原理詳解

Apr 14, 2025 pm 11:57 PM

Docker利用Linux內核特性,提供高效、隔離的應用運行環境。其工作原理如下:1. 鏡像作為只讀模板,包含運行應用所需的一切;2. 聯合文件系統(UnionFS)層疊多個文件系統,只存儲差異部分,節省空間並加快速度;3. 守護進程管理鏡像和容器,客戶端用於交互;4. Namespaces和cgroups實現容器隔離和資源限制;5. 多種網絡模式支持容器互聯。理解這些核心概念,才能更好地利用Docker。

centos安裝mysql

Apr 14, 2025 pm 08:09 PM

centos安裝mysql

Apr 14, 2025 pm 08:09 PM

在 CentOS 上安裝 MySQL 涉及以下步驟:添加合適的 MySQL yum 源。執行 yum install mysql-server 命令以安裝 MySQL 服務器。使用 mysql_secure_installation 命令進行安全設置,例如設置 root 用戶密碼。根據需要自定義 MySQL 配置文件。調整 MySQL 參數和優化數據庫以提升性能。

CentOS下GitLab的日誌如何查看

Apr 14, 2025 pm 06:18 PM

CentOS下GitLab的日誌如何查看

Apr 14, 2025 pm 06:18 PM

CentOS系統下查看GitLab日誌的完整指南本文將指導您如何查看CentOS系統中GitLab的各種日誌,包括主要日誌、異常日誌以及其他相關日誌。請注意,日誌文件路徑可能因GitLab版本和安裝方式而異,若以下路徑不存在,請檢查GitLab安裝目錄及配置文件。一、查看GitLab主要日誌使用以下命令查看GitLabRails應用程序的主要日誌文件:命令:sudocat/var/log/gitlab/gitlab-rails/production.log此命令會顯示produc

CentOS上PyTorch的分佈式訓練如何操作

Apr 14, 2025 pm 06:36 PM

CentOS上PyTorch的分佈式訓練如何操作

Apr 14, 2025 pm 06:36 PM

在CentOS系統上進行PyTorch分佈式訓練,需要按照以下步驟操作:PyTorch安裝:前提是CentOS系統已安裝Python和pip。根據您的CUDA版本,從PyTorch官網獲取合適的安裝命令。對於僅需CPU的訓練,可以使用以下命令:pipinstalltorchtorchvisiontorchaudio如需GPU支持,請確保已安裝對應版本的CUDA和cuDNN,並使用相應的PyTorch版本進行安裝。分佈式環境配置:分佈式訓練通常需要多台機器或單機多GPU。所