騰訊混元大模型正式亮相,我們搶先試了它的生產力

國內首批大型模型備案上週獲批,開始向全社會開放服務,標誌著大型模型進入了規模應用的新階段。在先前發布應用程式的公司中,一些科技巨頭似乎還沒有行動

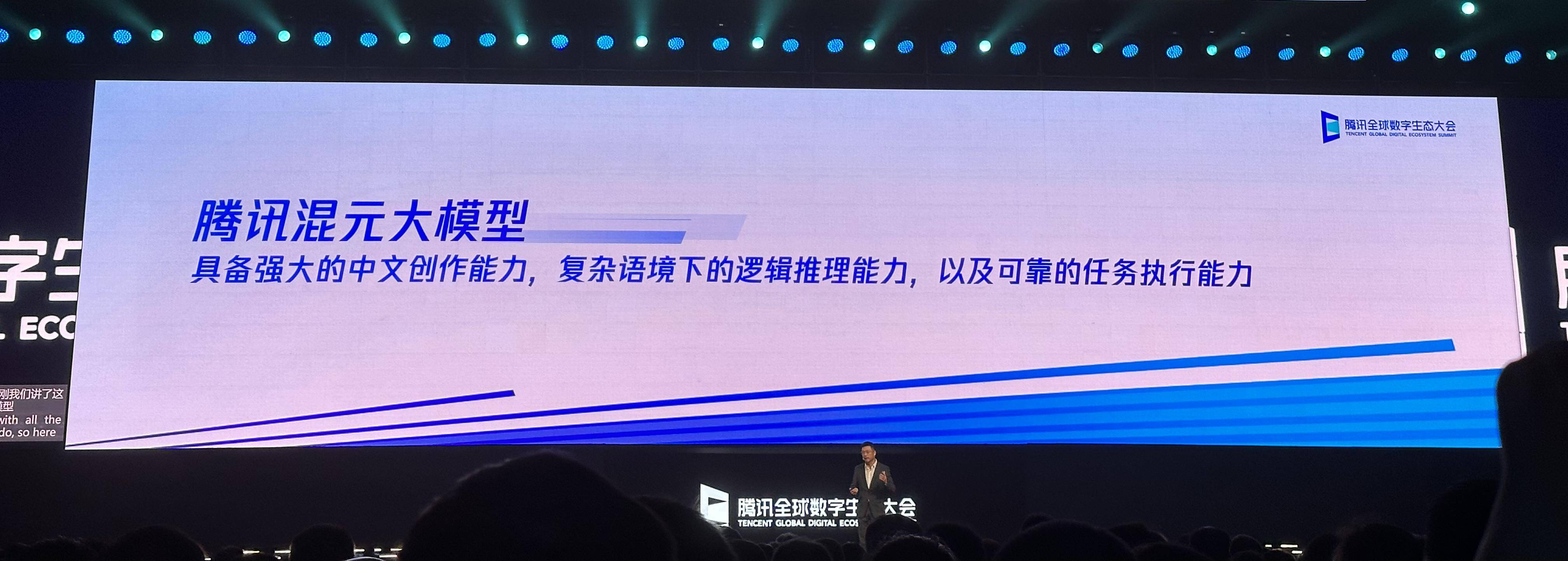

在2023年9月7日,騰訊在騰訊全球數位生態大會上正式公開了混元大模型,並向外界開放了騰訊雲

作為一個超千億參數的大模型,混元使用的預訓練語料超過兩萬億token,憑藉多項獨有的技術能力獲得了強大的中文創作能力、複雜語境下的邏輯推理能力,以及可靠的任務執行能力。

騰訊集團副總裁蔣傑表示:「騰訊混元大模型是從第一個token 開始從零訓練的,我們掌握了從模型演算法到機器學習框架,再到AI 基礎設施的全鏈路自研技術。」

打開大模型,全部都是生產力

騰訊一直表示在大模型的相關方向上早已有所佈局,專案研究一直有秩序地推進。

這個大模型的等級不是「新技術」是什麼?在大會上,蔣傑透露了一些基本訊息,透過直接詢問混元大模型。它的參數量達到了千億級,訓練所使用的數據截止到今年7月。此外,騰訊也表示大模型的知識將每月更新一次

在現場展示的內容包括騰訊混元大模型小程式、騰訊文檔中的AI助理以及騰訊會議AI助理的功能

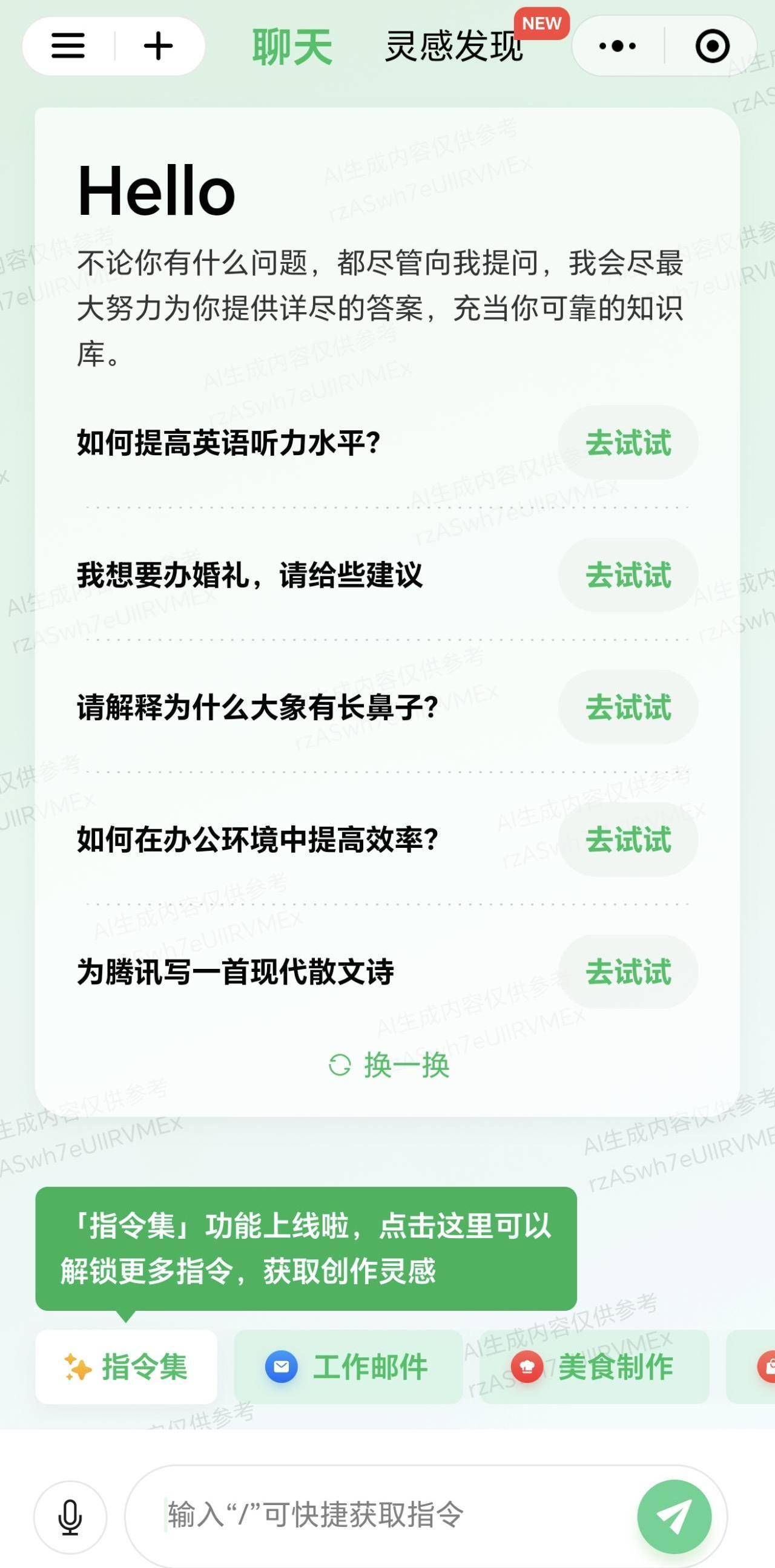

本站第一時間獲得測試資格嘗試了一番,首先是微信小程式。

當我們進入小程式時,我們驚訝地發現其中的內容不亞於其他大型應用程式。在這裡,我們可以發現一些靈感,看看混元能夠提供哪些功能

從生產力、生活、娛樂到程式開發,它開放的能力可謂非常全面了,符合一個千億級大模型的身份。那麼混元真的能有效完成這些任務嗎?

我需要準備一份PPT,我已經確定了主題,但我不知道從哪裡開始寫。我向混元大模型提問,只用了幾秒鐘,AI就給出了一個包含七個部分的大綱,每個部分還包含了細分的要點

輸入一篇arXiv 上9 月份谷歌提交的論文《RLAIF: Scaling Reinforcement Learning from Human Feedback with AI Feedback》摘要和介紹部分,長長的好幾段,很多大模型根本不支持這麼多輸入內容,混元大模型直接進行了總結順便翻譯成中文。

大概意思是,人工智慧可以取代人類在大規模模型訓練中的強化學習回饋(RLHF)的作用

一個到了實用階段的大模型,是可以幫我們寫程式的。現在我們給AI 一段程式碼,讓它解釋一下其中看不懂也沒有註解清楚的內容:

它詳細解釋了平方根倒數演算法裡面數字的意義(不過對註釋理解得不太透徹)。或許過不了多久,我們做開發的時候就離不開大模型了。

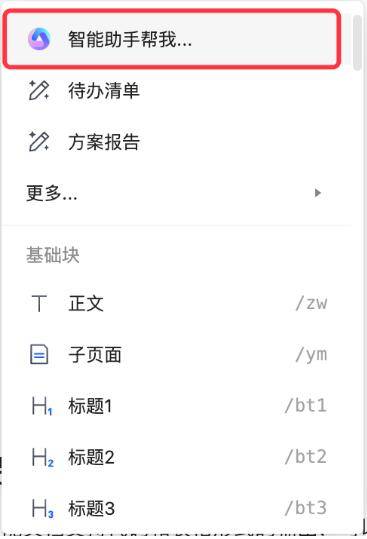

然後是騰訊文件。很多人已經把 GPT-4 等大模型工具用在了自己的工作流程中,混元大模型在騰訊文件推出的智慧助理功能中已有應用。在 PC 端新建智慧型文檔,輸入 “/”,就能依需求實現內容產生、翻譯、潤飾等操作。

接著輸入自然語言指令,大模型的生成能力就可以幫你在騰訊文件中進行長文本總結歸納:

寫論文時,它似乎是非常有用的

當然,如果你給了一個主題,它能進行文本創作,你再選定生成內容的一部分,AI 也可以多次細化編輯。寫完了還能一鍵翻譯:

此外,表格的資料計算和圖表生成也都是一句話的事。

目前這些功能正在內測階段,將在成熟後面向使用者開放。

在騰訊會議中,混元大模型的應用可以幫助你在會議中不再分心。例如,你可以隨時向AI助理詢問剛才發言的內容,或是詢問那兩個人之間的爭論是關於什麼。 AI可以將內容悄悄總結成簡短的幾句話,並清晰地列出一二三條

#當然,開完會後,混元大模型也可以更快速、更全面地總結會議內容,並標註好待辦事項

已經涵蓋了騰訊超過50個業務

蔣傑總結了混元大模型的三大特點:具備強大的中文創作能力、複雜脈絡下的邏輯推理能力、可靠的任務執行能力。

目前不少業界大模型在場景中的應用依然有限,主要問題集中在容錯率高,只適用於任務簡單的休閒場景。騰訊在演算法層面進行了一系列自研創新,提高了模型可靠性和成熟度。

騰訊集團副總裁蔣傑在活動中露面

針對大模型容易「胡言亂語」的問題,騰訊優化了預訓練演算法及策略,透過自研的「探真」技術,讓混元大模型的「幻覺」相比主流開源大模型降低了30-50%。

「業界的做法是提供搜尋增強,知識圖譜等『外掛』來提升大模型開卷考試的能力。這種方式增加了模型的知識,但在實際應用中存在著許多局限性,」蔣傑表示。 「混元大模型在開發初期就考慮完全不依賴外界資料的方式,進行了大量研究嘗試,我們找到的預訓練方法,很大程度上解決了幻覺的問題。」

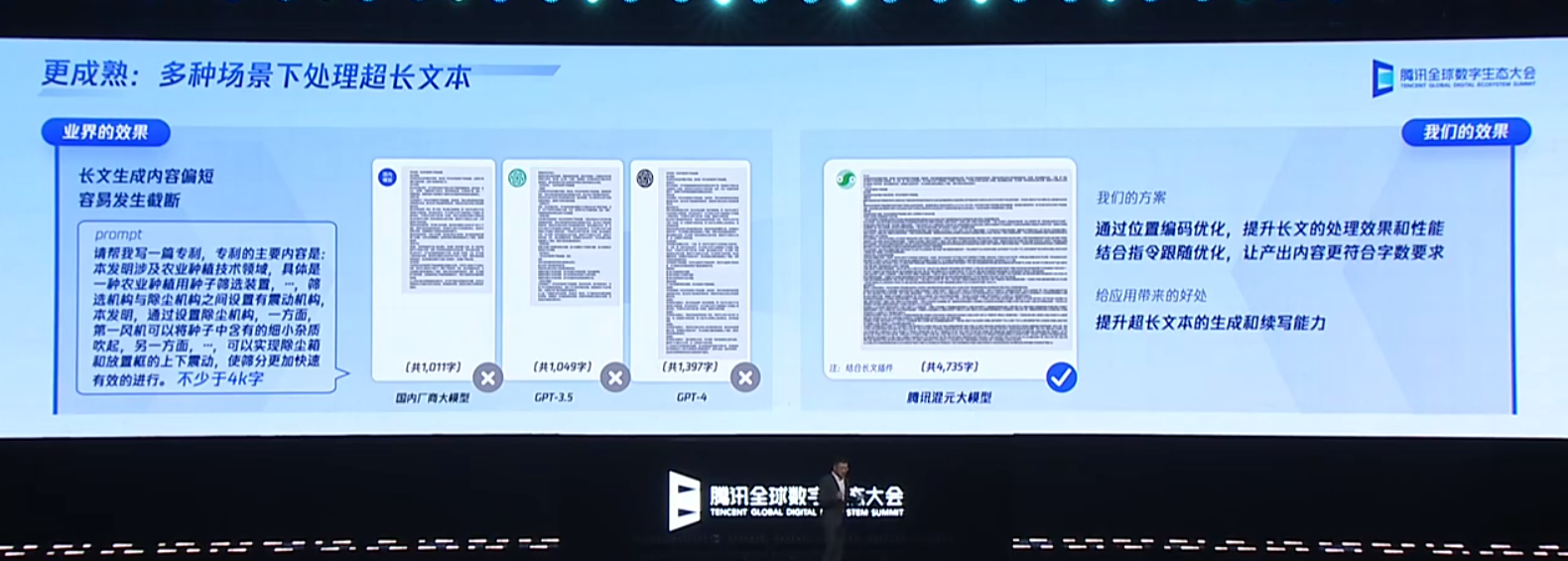

騰訊還利用強化學習的方法,讓模型學會辨識陷阱問題,並透過位置編碼的最佳化,提升了模型處理超長文字的效果與表現。在邏輯方面,騰訊提出了思維鏈的新策略,使得大型模型能夠像人一樣結合實際應用場景進行推理和決策

騰訊混元大模型能夠理解上下文的含義,具有長文記憶能力,可以流暢地進行專業領域的多輪對話。除此之外,它還能進行文學創作、文本摘要、角色扮演等內容創作,做到充分理解用戶意圖,並高效、準確的給出有時效性的答复。這樣的技術落地之後,才能真正提升生產力。

需要重新寫的內容是:寫一篇4000字的文章,GPT-4無法滿足要求,但是混元大模型可以做到

在中國信通院《大規模預訓練模型技術和應用的評估方法》的標準符合性測試中,混元大模型共測評66 個能力項,在「模型開發」和「模型能力」兩個領域的綜合評價獲得了當前最高分。在主流的評測集 MMLU、CEval 和 AGI-eval 上,混元大模型均有優異的表現,特別是在中文的理科、高考題和數學等子項上表現突出。

建構大模型的意義在於產業應用。據了解,騰訊內部已有超過50個業務和產品接觸並測試了騰訊混元大模型,包括騰訊雲、騰訊廣告、騰訊遊戲、騰訊金融科技、騰訊會議、騰訊文件、微信搜一搜、QQ瀏覽器等,並取得了初步效果。騰訊的程式設計師們已經開始使用大模型工具提高開發效率了

此外,騰訊還透過自研機器學習框架Angel,使模型的訓練速度相比業界主流框架提升1 倍,推理速度比業界主流框架提升1.3 倍。

用於建立大型模型的基礎設施也沒有拉下。先前騰訊曾表示已於今年初建置了大規模算力中心,近期 MiniMax 和百川智慧旗下的大模型都使用了騰訊的算力。

騰訊也努力將產業數據與自身能力結合,利用外部客戶的產業化數據來解決特定產業的問題,並與實體產業結合,不斷推動大型模式的社會、經濟利益和商業價值

「根據公開數據顯示,國內已有130 個大模型發布。其中既有通用模型也有專業領域模型。混元作為通用模型能夠支持騰訊內部的大部分業務,今天我展示的幾個深度接入的業務都有很大的用戶量。大模型已在我們的核心領域獲得了深度應用,」蔣傑說。 「我大模型首先是服務企業本身,其次是透過騰訊雲對外開放。」

在開放給客戶使用時,混元大模型將作為騰訊雲端模式即服務 MaaS 的底座。客戶既可以直接呼叫混元 API,也能將混元作為基座模型,為不同的產業場景建構專屬應用。

可見,騰訊在大模型領域的策略講究的是一個穩字:專注打好基礎,不急於拿出半成品展示。而這一出手,就展現出了過硬的實力。

大模型的發展仍在持續進行,正如蔣傑所說:「毫不誇張地說,騰訊已經全面擁抱大模型。我們的能力一直在不斷演進,相信AIGC的潛力是無限的,我們已經踏上了這條道路。」

以上是騰訊混元大模型正式亮相,我們搶先試了它的生產力的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

DeepMind機器人打乒乓球,正手、反手溜到飛起,全勝人類初學者

Aug 09, 2024 pm 04:01 PM

DeepMind機器人打乒乓球,正手、反手溜到飛起,全勝人類初學者

Aug 09, 2024 pm 04:01 PM

但可能打不過公園裡的老大爺?巴黎奧運正在如火如荼地進行中,乒乓球項目備受關注。同時,機器人打乒乓球也取得了新突破。剛剛,DeepMind提出了第一個在競技乒乓球比賽中達到人類業餘選手等級的學習型機器人智能體。論文地址:https://arxiv.org/pdf/2408.03906DeepMind這個機器人打乒乓球什麼程度呢?大概和人類業餘選手不相上下:正手反手都會:對手採用多種打法,機器人也能招架得住:接不同旋轉的發球:不過,比賽激烈程度似乎不如公園老大爺對戰。對機器人來說,乒乓球運動

首配機械爪!元蘿蔔亮相2024世界機器人大會,發布首個走進家庭的西洋棋機器人

Aug 21, 2024 pm 07:33 PM

首配機械爪!元蘿蔔亮相2024世界機器人大會,發布首個走進家庭的西洋棋機器人

Aug 21, 2024 pm 07:33 PM

8月21日,2024世界機器人大會在北京隆重召開。商湯科技旗下家用機器人品牌「元蘿蔔SenseRobot」家族全系產品集體亮相,並最新發布元蘿蔔AI下棋機器人-國際象棋專業版(以下簡稱「元蘿蔔國象機器人」),成為全球首個走進家庭的西洋棋機器人。作為元蘿蔔的第三款下棋機器人產品,全新的國象機器人在AI和工程機械方面進行了大量專項技術升級和創新,首次在家用機器人上實現了透過機械爪拾取立體棋子,並進行人機對弈、人人對弈、記譜複盤等功能,

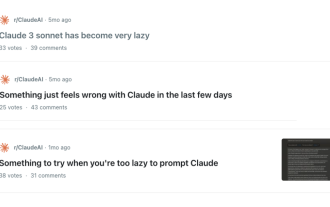

Claude也變懶了!網友:學會給自己放假了

Sep 02, 2024 pm 01:56 PM

Claude也變懶了!網友:學會給自己放假了

Sep 02, 2024 pm 01:56 PM

開學將至,該收心的不只即將開啟新學期的同學,可能還有AI大模型。前段時間,Reddit擠滿了吐槽Claude越來越懶的網友。 「它的水平下降了很多,經常停頓,甚至輸出也變得很短。在發布的第一周,它可以一次性翻譯整整4頁文稿,現在連半頁都輸出不了!」https:// www.reddit.com/r/ClaudeAI/comments/1by8rw8/something_just_feels_wrong_with_claude_in_the/在一個名為“對Claude徹底失望了的帖子裡”,滿滿地

世界機器人大會上,這家承載「未來養老希望」的國產機器人被包圍了

Aug 22, 2024 pm 10:35 PM

世界機器人大會上,這家承載「未來養老希望」的國產機器人被包圍了

Aug 22, 2024 pm 10:35 PM

在北京舉行的世界機器人大會上,人形機器人的展示成為了現場絕對的焦點,在星塵智能的展台上,由於AI機器人助理S1在一個展區上演揚琴、武術、書法三台大戲,能文能武,吸引了大量專業觀眾和媒體的駐足。在有彈性的琴弦上優雅的演奏,讓S1展現出速度、力度、精準度兼具的精細操作與絕對掌控。央視新聞對「書法」背後的模仿學習和智慧控制進行了專題報道,公司創始人來傑解釋到,絲滑動作的背後,是硬體側追求最好力控和最仿人身體指標(速度、負載等),而是在AI側則採集人的真實動作數據,讓機器人遇強則強,快速學習進化。而敏捷

騰訊 2025 校招啟動:畢業時間從一年拓寬至兩年

Aug 07, 2024 pm 08:17 PM

騰訊 2025 校招啟動:畢業時間從一年拓寬至兩年

Aug 07, 2024 pm 08:17 PM

本站8月7日消息,昨日騰訊2025校園招募正式啟動,繼2024年實習生招募、「青雲計畫」AI大模型招募專案後再次發出「擴招」訊號:不僅招募規模相較前兩年有較大增長,面向人群的畢業時間範圍也進一步擴大。據介紹,騰訊2025年校園招募開放技術、產品、市場、設計、職能5個大類70餘種職缺。今年的騰訊校園招募將有多處變化,校招面向人群的畢業時間範圍從一年拓寬至兩年。畢業時間為2024年1月至2025年12月的同學(中國大陸/內地以畢業證為準,中國港澳台及海外地區以學位證為準)均可透過騰訊招聘官網及「騰訊

ACL 2024獎項發表:華科大破解甲骨文最佳論文之一、GloVe時間檢驗獎

Aug 15, 2024 pm 04:37 PM

ACL 2024獎項發表:華科大破解甲骨文最佳論文之一、GloVe時間檢驗獎

Aug 15, 2024 pm 04:37 PM

本屆ACL大會,投稿者「收穫滿滿」。為期六天的ACL2024正在泰國曼谷舉辦。 ACL是計算語言學和自然語言處理領域的頂級國際會議,由國際計算語言學協會組織,每年舉辦一次。一直以來,ACL在NLP領域的學術影響力都名列第一,它也是CCF-A類推薦會議。今年的ACL大會已是第62屆,接收了400餘篇NLP領域的前沿工作。昨天下午,大會公佈了最佳論文等獎項。此次,最佳論文獎7篇(兩篇未公開)、最佳主題論文獎1篇、傑出論文獎35篇。大會也評出了資源論文獎(ResourceAward)3篇、社會影響力獎(

李飛飛團隊提出ReKep,讓機器人具備空間智能,還能整合GPT-4o

Sep 03, 2024 pm 05:18 PM

李飛飛團隊提出ReKep,讓機器人具備空間智能,還能整合GPT-4o

Sep 03, 2024 pm 05:18 PM

視覺與機器人學習的深度融合。當兩隻機器手絲滑地互相合作疊衣服、倒茶、將鞋子打包時,加上最近老上頭條的1X人形機器人NEO,你可能會產生一種感覺:我們似乎開始進入機器人時代了。事實上,這些絲滑動作正是先進機器人技術+精妙框架設計+多模態大模型的產物。我們知道,有用的機器人往往需要與環境進行複雜精妙的交互,而環境則可被表示成空間域和時間域上的限制。舉個例子,如果要讓機器人倒茶,那麼機器人首先需要抓住茶壺手柄並使之保持直立,不潑灑出茶水,然後平穩移動,一直到讓壺口與杯口對齊,之後以一定角度傾斜茶壺。這

鴻蒙智行享界S9全場景新品發表會,多款重磅新品齊發

Aug 08, 2024 am 07:02 AM

鴻蒙智行享界S9全場景新品發表會,多款重磅新品齊發

Aug 08, 2024 am 07:02 AM

今天下午,鸿蒙智行正式迎来了新品牌与新车。8月6日,华为举行鸿蒙智行享界S9及华为全场景新品发布会,带来了全景智慧旗舰轿车享界S9、问界新M7Pro和华为novaFlip、MatePadPro12.2英寸、全新MatePadAir、华为毕昇激光打印机X1系列、FreeBuds6i、WATCHFIT3和智慧屏S5Pro等多款全场景智慧新品,从智慧出行、智慧办公到智能穿戴,华为全场景智慧生态持续构建,为消费者带来万物互联的智慧体验。鸿蒙智行:深度赋能,推动智能汽车产业升级华为联合中国汽车产业伙伴,为