一文帶你了解騰訊自主研發的一般大語言模式-混元大模型

2023年9月7日上午,在騰訊全球數位生態大會上,騰訊集團高級執行副總裁、騰訊雲與智慧產業事業群CEO湯道生宣布,騰訊將進入「全面擁抱大模型」時代,並同時宣布,騰訊自主研發的通用大語言模式-混元,正式向產業亮相。根據騰訊官方表示,混元大模型的中文能力已經超過GPT3.5

發布後混元大模型將作為騰訊雲MaaS服務的底座,用戶可以透過騰訊雲官網進行體驗,並且支援直接呼叫 API 接口,也可將混元作為基底模型,並在公有雲上根據企業的實際需求進行自訂調整。

一、混幣大模型簡介

二、計費方面

騰訊混元大模型將為已在白名單中實名認證的騰訊雲企業帳號提供累計10萬個免費調用令牌的額度。企業開通服務後即可使用相應的免費額度。這樣大家可以先體驗一下,確認是否滿足自己的需求,再考慮後續的計費成本

目前介面的價格仍然相當合理。當企業免費額度用完後,將以以下價格計費:騰訊混元大模型高級版每1000個token收費0.14元。 (相當於1個token約等於1個中文漢字或3個英文字母,總體而言,1毛四可以完成大約兩三次的接口調用)

#付費方式採用後付費日結模式,用戶提交開通申請並通過後即可依服務規則使用服務,騰訊雲官方會將依實際使用量進行計費,並直接帳號中扣除相應等額金額。

三、運算能力

根據官方消息,騰訊混元大模型目前擁有超千億參數規模,預訓練語料超2萬億tokens,畢竟是國內大廠具有非常強大的中文理解、創作、邏輯推理等能力。

圖片

圖片

四、目前接取的生態場景

騰訊集團副總裁蔣傑在接受媒體採訪時表示,目前騰訊雲、騰訊廣告、騰訊遊戲、騰訊金融科技、騰訊會議、騰訊文檔、微信搜一搜、QQ瀏覽器等超過50個騰訊業務及產品,均已接入騰訊混元大模型測試,並取得初步效果,未來發展前景非常可觀。

五、混元大模型優勢

在多個場景下,騰訊混元大模型已經能夠處理超長文本,透過位置編碼優化技術,混元大模型對於長文處理效果和性能都提升了。而混元大模型還具有辨識「陷阱」的能力,簡單來說就是透過強化學習方法拒絕被「誘導」。

舉個簡單的例子:當使用者可能提出難以回答甚至無法回答的問題時,針對這類安全引導類別問題的拒絕率可以提高20%。這樣可以大幅減少錯誤和無效回答的情況,使得騰訊AI大模型本身回答的內容更可信。這也是騰訊AI大模型的一個亮點

#六、 混元大模型典型應用-騰訊混元助手

圖片

圖片

以上是一文帶你了解騰訊自主研發的一般大語言模式-混元大模型的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

大模型App騰訊元寶上線!混元再升級,打造可隨身攜帶的全能AI助理

Jun 09, 2024 pm 10:38 PM

大模型App騰訊元寶上線!混元再升級,打造可隨身攜帶的全能AI助理

Jun 09, 2024 pm 10:38 PM

5月30日,騰訊宣布旗下混元大模型全面升級,基於混元大模型的App「騰訊元寶」正式上線,蘋果及安卓應用程式商店皆可下載。相較於先前測試階段的混元小程式版本,面向工作效率場景,騰訊元寶提供了AI搜尋、AI總結、AI寫作等核心能力;面向日常生活場景,元寶的玩法也更加豐富,提供了多個特色AI應用,並新增了創建個人智能體等玩法。 「騰訊做大模型不爭一時之先。」騰訊雲副總裁、騰訊混元大模型負責人劉煜宏表示:「過去的一年,我們持續推進騰訊混元大模型的能力爬坡,在豐富、海量的業務場景中打磨技術,同時洞察用戶的真實需求

位元組跳動豆包大模型發布,火山引擎全端 AI 服務協助企業智慧轉型

Jun 05, 2024 pm 07:59 PM

位元組跳動豆包大模型發布,火山引擎全端 AI 服務協助企業智慧轉型

Jun 05, 2024 pm 07:59 PM

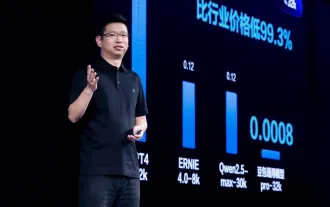

火山引擎總裁譚待企業要做好大模型落地,面臨模型效果、推理成本、落地難度的三大關鍵挑戰:既要有好的基礎大模型做支撐,解決複雜難題,也要有低成本的推理服務讓大模型廣泛應用,還要更多工具、平台和應用程式幫助企業做好場景落地。 ——譚待火山引擎總裁01.豆包大模型首次亮相大使用量打磨好模型模型效果是AI落地最關鍵的挑戰。譚待指出,只有大的使用量,才能打磨出好模型。目前,豆包大模型日均處理1,200億tokens文字、生成3,000萬張圖片。為助力企業做好大模型場景落地,位元組跳動自主研發的豆包大模型將透過火山

工業知識圖譜進階實戰

Jun 13, 2024 am 11:59 AM

工業知識圖譜進階實戰

Jun 13, 2024 am 11:59 AM

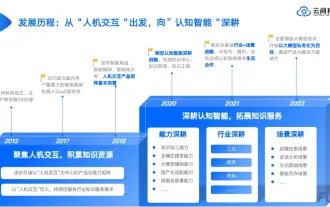

一、背景簡介首先來介紹雲問科技的發展歷程。雲問科技公...2023年,正是大模型盛行的時期,很多企業認為已經大模型之後圖譜的重要性大大降低了,之前研究的預置的資訊化系統也都不重要了。不過隨著RAG的推廣、資料治理的盛行,我們發現更有效率的資料治理和高品質的資料是提升私有化大模型效果的重要前提,因此越來越多的企業開始重視知識建構的相關內容。這也推動了知識的建構和加工開始向更高層次發展,其中有許多技巧和方法可以挖掘。可見一個新技術的出現,並不是將所有的舊技術打敗,也有可能將新技術和舊技術相互融合後

對標GPT-4!中國移動九天大模型通過雙備案

Apr 04, 2024 am 09:31 AM

對標GPT-4!中國移動九天大模型通過雙備案

Apr 04, 2024 am 09:31 AM

4月4日消息,日前,國家網信辦公佈已備案大模型清單,中國移動「九天自然語言交互大模型」名列其中,標誌著中國移動九天AI大模型可正式對外提供生成式人工智慧服務。中國移動表示,這是同時透過國家「生成式人工智慧服務備案」和「境內深度合成服務演算法備案」雙備案的首個央企研發的大模型。據介紹,九天自然語言交互大模型具有產業能力增強、安全可信、支援全端國產化等特點,已形成90億、139億、570億、千億等多種參數量版本,可靈活部署於雲、邊、端不同場

GPT Store都開不下去,這家國產平台怎麼敢走這條路的? ?

Apr 19, 2024 pm 09:30 PM

GPT Store都開不下去,這家國產平台怎麼敢走這條路的? ?

Apr 19, 2024 pm 09:30 PM

注意看,這個男人把超1000種大模型接入,讓你可插拔無縫切換使用。最近也上線了可視化的AI工作流程:給你一個直覺的拖放介面,拖拖、拉拉、拽拽,就能在無限畫布上編排自己個兒的Workflow。正所謂兵貴神速,量子位聽說,這個AIWorkflow上線不到48小時,就已經有用戶配出了100多個節點的個人工作流程。不賣關子,今天要聊的是LLMOps公司Dify,及其CEO張路宇。張路宇也是Dify的創辦人。投入創業前,有11年的網路經驗。搞產品設計,懂專案管理,也對SaaS有點自己的獨到見解。後來他

新測試基準發布,最強開源Llama 3尷尬了

Apr 23, 2024 pm 12:13 PM

新測試基準發布,最強開源Llama 3尷尬了

Apr 23, 2024 pm 12:13 PM

如果試題太簡單,學霸和學渣都能考90分,拉不開差距……隨著Claude3、Llama3甚至之後GPT-5等更強模型發布,業界急需一款更難、更有區分度的基準測試。大模型競技場背後組織LMSYS推出下一代基準測試Arena-Hard,引起廣泛關注。 Llama3的兩個指令微調版本實力到底如何,也有了最新參考。與先前大家分數都相近的MTBench相比,Arena-Hard區分度從22.6%提升到87.4%,孰強孰弱一目了然。 Arena-Hard利用競技場即時人類數據構建,與人類偏好一致率也高達89.1%

騰訊QQ NT架構版本記憶體最佳化進展公佈,聊天場景控制在300M內

Mar 05, 2024 pm 03:52 PM

騰訊QQ NT架構版本記憶體最佳化進展公佈,聊天場景控制在300M內

Mar 05, 2024 pm 03:52 PM

據了解,騰訊QQ桌面用戶端進行了一系列的大刀闊斧的改革。針對用戶關於高記憶體佔用、超大安裝包、啟動緩慢等問題,QQ技術團隊在記憶體上進行了專案最佳化,取得了階段性進展。日前,QQ技術團隊在InfoQ平台發布了一篇介紹文章,分享了其在記憶體上進行專案優化的階段性進展。據介紹,新版QQ在記憶體上的挑戰主要表現在以下4個面向:產品形態:由1個複雜的大面板(100+複雜程度不等的模組)和一系列獨立功能視窗構成。視窗與渲染進程一一對應,視窗進程數很大程度影響Electron的記憶體佔用。對於那個複雜的大面板,一旦沒有

騰訊 2025 校招啟動:畢業時間從一年拓寬至兩年

Aug 07, 2024 pm 08:17 PM

騰訊 2025 校招啟動:畢業時間從一年拓寬至兩年

Aug 07, 2024 pm 08:17 PM

本站8月7日消息,昨日騰訊2025校園招募正式啟動,繼2024年實習生招募、「青雲計畫」AI大模型招募專案後再次發出「擴招」訊號:不僅招募規模相較前兩年有較大增長,面向人群的畢業時間範圍也進一步擴大。據介紹,騰訊2025年校園招募開放技術、產品、市場、設計、職能5個大類70餘種職缺。今年的騰訊校園招募將有多處變化,校招面向人群的畢業時間範圍從一年拓寬至兩年。畢業時間為2024年1月至2025年12月的同學(中國大陸/內地以畢業證為準,中國港澳台及海外地區以學位證為準)均可透過騰訊招聘官網及「騰訊