強化學習中的演算法選擇問題

強化學習中的演算法選擇問題,需要具體程式碼範例

強化學習是一種透過智能體與環境的互動學習最優策略的機器學習領域。在強化學習中,選擇適合的演算法對於學習效果至關重要。在本文中,我們將探討強化學習中的演算法選擇問題,並提供具體程式碼範例。

在強化學習中有許多演算法可以選擇,例如Q-Learning、Deep Q Network(DQN)、Actor-Critic等。選擇合適的演算法取決於問題的複雜性、狀態空間和動作空間的大小,以及計算資源的可用性等因素。

首先,我們來看一個簡單的強化學習問題,也就是迷宮問題。在這個問題中,智能體需要找到從起點到終點的最短路徑。我們可以用Q-Learning演算法來解決這個問題。以下是一個範例程式碼:

import numpy as np

# 创建迷宫

maze = np.array([

[1, 1, 1, 1, 1, 1, 1, 1, 1, 1],

[1, 0, 0, 1, 0, 0, 0, 1, 0, 1],

[1, 0, 0, 1, 0, 0, 0, 1, 0, 1],

[1, 0, 0, 0, 0, 1, 1, 0, 0, 1],

[1, 0, 1, 1, 1, 0, 0, 0, 0, 1],

[1, 0, 0, 0, 1, 0, 0, 0, 1, 1],

[1, 1, 1, 1, 1, 1, 1, 1, 1, 1]

])

# 定义Q表格

Q = np.zeros((maze.shape[0], maze.shape[1], 4))

# 设置超参数

epochs = 5000

epsilon = 0.9

alpha = 0.1

gamma = 0.6

# Q-Learning算法

for episode in range(epochs):

state = (1, 1) # 设置起点

while state != (6, 8): # 终点

x, y = state

possible_actions = np.where(maze[x, y] == 0)[0] # 可能的动作

action = np.random.choice(possible_actions) # 选择动作

next_state = None

if action == 0:

next_state = (x - 1, y)

elif action == 1:

next_state = (x + 1, y)

elif action == 2:

next_state = (x, y - 1)

elif action == 3:

next_state = (x, y + 1)

reward = -1 if next_state == (6, 8) else 0 # 终点奖励为0,其他状态奖励为-1

Q[x, y, action] = (1 - alpha) * Q[x, y, action] + alpha * (reward + gamma * np.max(Q[next_state]))

state = next_state

print(Q)以上程式碼中的Q-Learning演算法透過更新Q表格來學習最優策略。 Q表格的維度與迷宮的維度相對應,其中每個元素表示智能體在特定狀態下進行不同動作的收益。

除了Q-Learning,還可以使用其他演算法來解決更複雜的強化學習問題。例如,當問題的狀態空間和動作空間較大時,可以使用深度強化學習演算法,如DQN。以下是一個簡單的DQN範例程式碼:

import torch

import torch.nn as nn

import torch.optim as optim

import random

# 创建神经网络

class DQN(nn.Module):

def __init__(self, input_size, output_size):

super(DQN, self).__init__()

self.fc1 = nn.Linear(input_size, 16)

self.fc2 = nn.Linear(16, output_size)

def forward(self, x):

x = torch.relu(self.fc1(x))

x = self.fc2(x)

return x

# 定义超参数

input_size = 4

output_size = 2

epochs = 1000

batch_size = 128

gamma = 0.99

epsilon = 0.2

# 创建经验回放内存

memory = []

capacity = 10000

# 创建神经网络和优化器

model = DQN(input_size, output_size)

optimizer = optim.Adam(model.parameters(), lr=0.001)

# 定义经验回放函数

def append_memory(state, action, next_state, reward):

memory.append((state, action, next_state, reward))

if len(memory) > capacity:

del memory[0]

# 定义训练函数

def train():

if len(memory) < batch_size:

return

batch = random.sample(memory, batch_size)

state_batch, action_batch, next_state_batch, reward_batch = zip(*batch)

state_batch = torch.tensor(state_batch, dtype=torch.float)

action_batch = torch.tensor(action_batch, dtype=torch.long)

next_state_batch = torch.tensor(next_state_batch, dtype=torch.float)

reward_batch = torch.tensor(reward_batch, dtype=torch.float)

current_q = model(state_batch).gather(1, action_batch.unsqueeze(1))

next_q = model(next_state_batch).max(1)[0].detach()

target_q = reward_batch + gamma * next_q

loss = nn.MSELoss()(current_q, target_q.unsqueeze(1))

optimizer.zero_grad()

loss.backward()

optimizer.step()

# DQN算法

for episode in range(epochs):

state = env.reset()

total_reward = 0

while True:

if random.random() < epsilon:

action = env.action_space.sample()

else:

action = model(torch.tensor(state, dtype=torch.float)).argmax().item()

next_state, reward, done, _ = env.step(action)

append_memory(state, action, next_state, reward)

train()

state = next_state

total_reward += reward

if done:

break

if episode % 100 == 0:

print("Episode: ", episode, " Total Reward: ", total_reward)

print("Training finished.")以上程式碼中的DQN演算法使用了一個神經網路來近似Q函數,透過在環境中進行互動來訓練網絡,從而學習最優策略。

透過上述程式碼範例,我們可以看到在強化學習中,可以根據問題的特徵選擇不同的演算法來解決。 Q-Learning適用於狀態空間較小且動作空間較小的問題,而DQN則適用於複雜的問題,其中狀態空間和動作空間較大。

然而,在實際應用中,選擇演算法並不是一件容易的事。根據問題的特點,我們可以嘗試不同的演算法,並根據結果來選擇最適合的演算法。在選擇演算法時,還需要注意演算法的收斂性、穩定性和計算複雜性等因素,並根據具體需求進行權衡。

總之,在強化學習中,演算法選擇是關鍵的一環。透過合理地選擇演算法,並且根據特定問題進行調優和改進,我們可以在實際應用中取得更好的強化學習效果。

以上是強化學習中的演算法選擇問題的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

使用Panda-Gym的機器臂模擬實現Deep Q-learning強化學習

Oct 31, 2023 pm 05:57 PM

使用Panda-Gym的機器臂模擬實現Deep Q-learning強化學習

Oct 31, 2023 pm 05:57 PM

強化學習(RL)是一種機器學習方法,它允許代理透過試誤來學習如何在環境中表現。行為主體會因為採取行動導致預期結果而獲得獎勵或懲罰。隨著時間的推移,代理人會學會採取行動,以使得其預期回報最大化RL代理通常使用馬可夫決策過程(MDP)進行訓練,MDP是為順序決策問題建模的數學框架。 MDP由四個部分組成:狀態:環境的可能狀態的集合。動作:代理人可以採取的一組動作。轉換函數:在給定當前狀態和動作的情況下,預測轉換到新狀態的機率的函數。獎勵函數:為每次轉換分配獎勵給代理的函數。代理的目標是學習策略函數,

強化學習中的獎勵函數設計問題

Oct 09, 2023 am 11:58 AM

強化學習中的獎勵函數設計問題

Oct 09, 2023 am 11:58 AM

強化學習中的獎勵函數設計問題引言強化學習是一種透過智能體與環境的互動來學習最優策略的方法。在強化學習中,獎勵函數的設計對於智能體的學習效果至關重要。本文將探討強化學習中的獎勵函數設計問題,並提供具體程式碼範例。獎勵函數的作用及目標獎勵函數是強化學習中的重要組成部分,用來評估智能體在某一狀態下所獲得的獎勵值。它的設計有助於引導智能體透過選擇最優行動來最大化長期累

C++中的深度強化學習技術

Aug 21, 2023 pm 11:33 PM

C++中的深度強化學習技術

Aug 21, 2023 pm 11:33 PM

深度強化學習技術是人工智慧領域備受關注的一個分支,目前在贏得多個國際競賽的同時也被廣泛應用於個人助理、自動駕駛、遊戲智慧等領域。而在實現深度強化學習的過程中,C++作為一種高效率、優秀的程式語言,在硬體資源有限的情況下尤其重要。深度強化學習,顧名思義,結合了深度學習和強化學習兩個領域的技術。簡單理解,深度學習是指透過建立多層神經網絡,從數據中學習特徵並進行決策

如何使用 Go 語言進行深度強化學習研究?

Jun 10, 2023 pm 02:15 PM

如何使用 Go 語言進行深度強化學習研究?

Jun 10, 2023 pm 02:15 PM

深度強化學習(DeepReinforcementLearning)是一種結合了深度學習和強化學習的先進技術,被廣泛應用於語音辨識、影像辨識、自然語言處理等領域。 Go語言作為一門快速、有效率、可靠的程式語言,可以為深度強化學習研究提供幫助。本文將介紹如何使用Go語言進行深度強化學習研究。一、安裝Go語言和相關函式庫在開始使用Go語言進行深度強化學習

使用Actor-Critic的DDPG強化學習演算法控制雙關節機械手臂

May 12, 2023 pm 09:55 PM

使用Actor-Critic的DDPG強化學習演算法控制雙關節機械手臂

May 12, 2023 pm 09:55 PM

在本文中,我們將介紹在Reacher環境中訓練智慧代理控制雙關節機械手臂,這是一種使用UnityML-Agents工具包開發的基於Unity的模擬程式。我們的目標是高精準度的到達目標位置,所以這裡我們可以使用專為連續狀態和動作空間設計的最先進的DeepDeterministicPolicyGradient(DDPG)演算法。現實世界的應用程式機械手臂在製造業、生產設施、空間探索和搜救行動中發揮關鍵作用。控制機械手臂的高精度和靈活性是非常重要的。透過採用強化學習技術,可以使這些機器人系統即時學習並調整其行

再掀強化學習變革! DeepMind提出「演算法蒸餾」:可探索的預訓練強化學習Transformer

Apr 12, 2023 pm 06:58 PM

再掀強化學習變革! DeepMind提出「演算法蒸餾」:可探索的預訓練強化學習Transformer

Apr 12, 2023 pm 06:58 PM

在當下的序列建模任務上,Transformer可謂是最強大的神經網路架構,並且經過預先訓練的Transformer模型可以將prompt作為條件或上下文學習(in-context learning)適應不同的下游任務。大型預訓練Transformer模型的泛化能力已經在多個領域得到驗證,例如文字補全、語言理解、圖像生成等等。從去年開始,已經有相關工作證明,透過將離線強化學習(offline RL)視為序列預測問題,那麼模型就可以從離線資料中學習策略。但目前的方法要不是從不包含學習的數據中學習策略

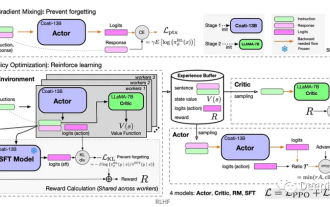

如何運用強化學習來提升快手用戶留存?

May 07, 2023 pm 06:31 PM

如何運用強化學習來提升快手用戶留存?

May 07, 2023 pm 06:31 PM

短視頻推薦系統的核心目標是透過提升用戶留存,牽引DAU成長。因此留存是各APP的核心業務優化指標之一。然而留存是使用者和系統多次互動後的長期回饋,很難分解到單一item或單一list,因此傳統的point-wise和list-wise模型難以直接優化留存。強化學習(RL)方法透過和環境互動的方式優化長期獎勵,適合直接優化用戶留存。此工作將留存優化問題建模成一個無窮視野請求粒度的馬爾科夫決策過程(MDP),使用者每次請求推薦系統決策一個動作(action),用於聚合多個不同的短期回饋預估(觀看時長、

強化學習再登Nature封面,自動駕駛安全驗證新典範大幅減少測試里程

Mar 31, 2023 pm 10:38 PM

強化學習再登Nature封面,自動駕駛安全驗證新典範大幅減少測試里程

Mar 31, 2023 pm 10:38 PM

引入密集強化學習,以 AI 驗證 AI。自動駕駛汽車 (AV) 技術的快速發展,使得我們正處於交通革命的風口浪尖,其規模是自一個世紀前汽車問世以來從未見過的。自動駕駛技術具有顯著提高交通安全性、機動性和永續性的潛力,因此引起了工業界、政府機構、專業組織和學術機構的共同關注。在過去 20 年裡,自動駕駛汽車的發展取得了長足的進步,尤其是隨著深度學習的出現更是如此。到 2015 年,開始有公司宣布他們將在 2020 之前量產 AV。不過到目前為止,並且沒有 level 4 等級的 AV 可以在市場