雲端智慧駕駛三維重建優秀實踐

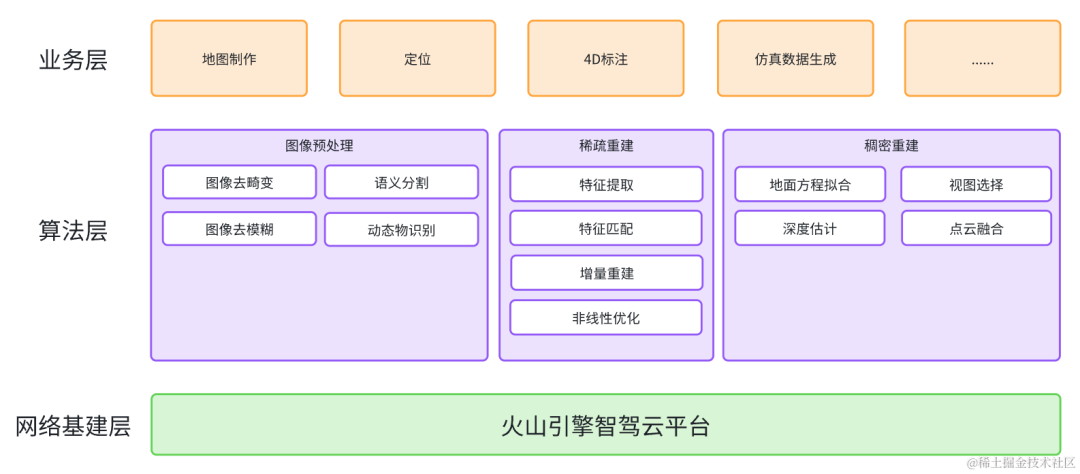

智慧駕駛技術的不斷發展,正在改變我們的出行方式和交通系統。作為其中的關鍵技術,三維重建在智慧駕駛系統中扮演著重要的角色。除去車端本身的感知、重建演算法,自動駕駛技術的落地與發展需要龐大的雲端重建能力支撐,火山引擎多媒體實驗室透過業界領先的自研三維重建技術,結合強大的雲端平台資源與能力,協助相關技術在雲端大規模重建、自動標註、真實感模擬等場景的落地與應用。

本文重點介紹火山引擎多媒體實驗室三維重建技術在動態、靜態場景的以及結合先進光場重建技術的原理與實踐,幫助大家能更好的了解和認識雲上智能三維重建如何服務智慧駕駛領域,協助產業發展。

一、技術挑戰與困難

駕駛場景重建需要對道路環境做點雲級的三維重建,與傳統的三維重建技術應用場景相比,駕駛場景重建技術有以下困難:

- 車輛運轉過程中的環境因素複雜且不可控,不同天氣、光照、車速、路況等都會對車載感測器收集到的資料造成影響,這對重建技術的魯棒性帶來了挑戰。

- 道路場景中經常會出現特徵退化和紋理缺失的情況,例如相機獲取到視覺特徵不豐富的圖像信息,或者激光雷達獲取到相似性較高的場景結構信息,同時,路面作為重建中的關鍵要素之一,色彩單一且缺乏足夠的紋理訊息,這對重建技術提出了更高的要求。

- 車載感測器數量較多,常見的有相機、光達、毫米波雷達、慣導、GPS定位系統、輪速計等等,如何將多感測器的資料融合起來得到更精確的重建結果,對重建技術提出了挑戰。

- 道路中存在運動車輛、非機動車輛、行人等動態物體,會對傳統重建演算法帶來挑戰,如何剔除動態物體對靜態場景重建帶來幹擾,同時對動態物體的位置、大小、速度進行估計,也是專案的困難之一。

二、駕駛場景重建技術介紹

自動駕駛領域的重建演算法通常會採用光達、相機為主,GPS、慣導為輔的技術路線。光達可以直接獲取高精度的測距信息,能夠快速得到場景結構,透過預先進行的光達-相機聯合標定,相機所獲得的影像能夠為雷射點雲賦予色彩、語意等資訊。同時,GPS和慣導可以進行輔助定位,減少重建過程中因為特徵退化而出現的漂移現象。但是,由於多線雷射雷達售價較高,通常用於工程車輛,而在量產車上很難得到規模化的使用。

對此,火山引擎多媒體實驗室自研了一套純視覺的駕駛場景重建技術,包括靜態場景重建、動態物體重建和神經輻射場重建技術,能夠區分場景中的動靜態物體,還原出靜態場景的稠密點雲,並突出路面、指示牌、紅綠燈等關鍵要素;能夠對場景中運動物體的位置、大小、朝向和速度進行有效的估計,用於後續的4D標註;能夠在在靜態場景重建的基礎上,使用神經輻射場對場景進行重建和復現,實現自由視角的漫遊,可用於場景編輯和模擬渲染。這套技術解決方案不依賴光達,且能夠達到分米級的相對誤差,以最小的硬體成本實現接近光達的重建效果。

2.1 靜態場景重建技術:剔除動態幹擾、還原靜態場景

視覺重建技術以多視角幾何作為基礎的理論依據,要求待重建的場景或物件具有幀間一致性,即在不同影像影格中處於靜止狀態,因此需要在重建過程中剔除動態物體。根據場景中的不同要素的重要性,在稠密點雲中需要去除無關緊要的點雲,而保留一些關鍵要素點雲,因此需要事先對影像進行語義分割。 對此, 火山引擎 多媒體實驗室結合AI技術與多視角幾何基本原理,搭建了一套先進的穩健、精確完整視覺重建演算法框架。重建過程包括三個關鍵步驟 :影像預處理、稀疏重建和稠密重建 。

車用相機拍攝過程中處在運動狀態,由於曝光時間的存在,擷取的影像中會隨著車速提高而出現嚴重的運動模糊現象。另外,出於節約頻寬和儲存空間考慮,傳輸過程中會對影像進行不可逆的有損壓縮,造成畫質的進一步降低。為此, 火山引擎多媒體實驗室使用了端到端的神經網路對影像進行去模糊處理,能夠在抑制運動模糊現象的同時對影像品質進行提升。去模糊前後的對比如下圖。

去模糊前(左) 去模糊後(右)

為了區分出動態物體,火山引擎多媒體實驗室使用了基於光流的動態物體辨識技術,能夠得到像素等級的動態物體遮罩。在之後的靜態場景重建過程中,落在動態物區域上的特徵點將被剔除,只有靜態的場景和物件將會保留。

光流(左) 運動物體(右)

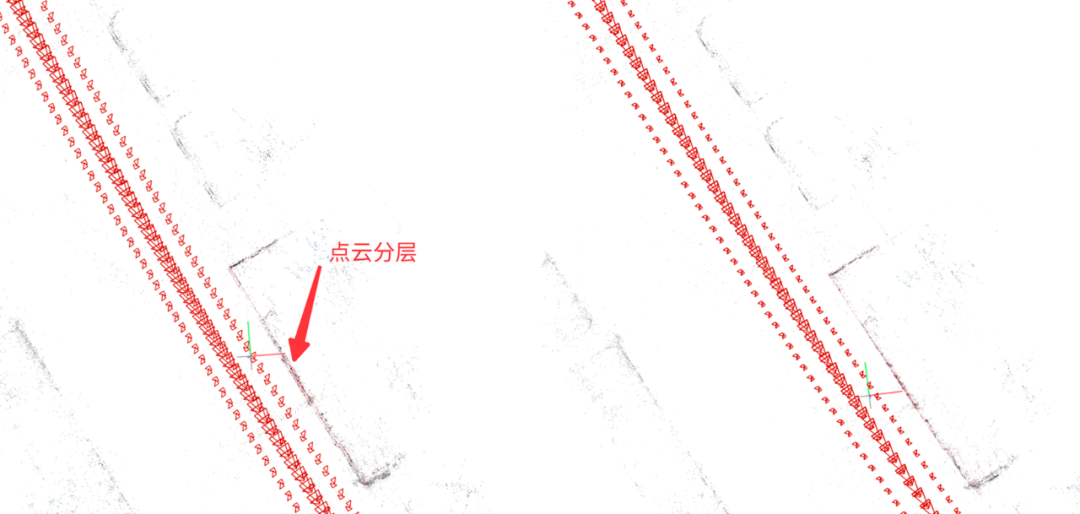

稀疏重建過程中需要同時計算相機的位置、朝向和場景點雲,常用的有SLAM演算法(Simultaneous localization and mapping)和SFM演算法(Structure from Motion,簡稱SfM)。在不要求即時性的情況下,SFM演算法能夠得到更高的重建精度。但是,傳統的SFM演算法通常將每台相機當作獨立相機來處理,而車輛上通常會在前後左右不同方向佈置多個相機,這些相機之間的相對位置其實是固定不變的(忽略車輛振動帶來的細微變化)。如果忽略相機與相機之間的相對位置約束,計算出來的各相機位姿誤差會比較大。另外,當遮擋比較嚴重時,個別相機的位姿會難以計算。對此,火山引擎多媒體實驗室自研了基於相機組整體的SFM演算法,能夠利用相機之間的先驗相對位姿約束,以相機組作為整體來計算位姿,同時使用了GPS加慣導的融合定位結果對相機組中心位置進行約束,可有效提高位姿估計的成功率和準確率,並能改善不同相機間的點雲不一致現象,減少點雲分層現象。

傳統SFM(左) 相機組SFM(右)

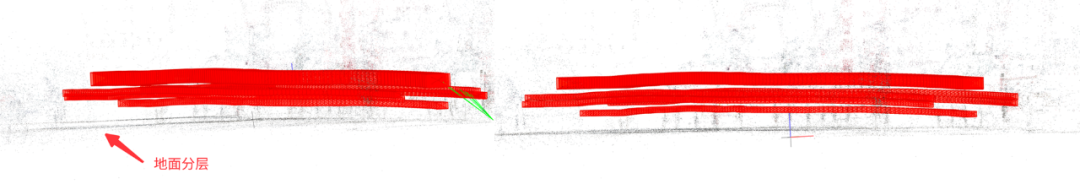

#由於地面色彩單一、紋理缺失,傳統的視覺重建很難還原出完整的地面,但是地面上存在車道線、箭頭、文字/標識等關鍵要素,因此火山引擎多媒體實驗室採用了二次曲面來擬合地面,輔助進行地面區域的深度估計和點雲融合。和平面擬合相比,二次曲面更貼合實際道路場景,因為實際的路面往往不是理想平面。以下是分別以平面方程式和二次曲面方程式來擬合地面的效果比較。

平面方程式(左) 二次曲面方程式(右)

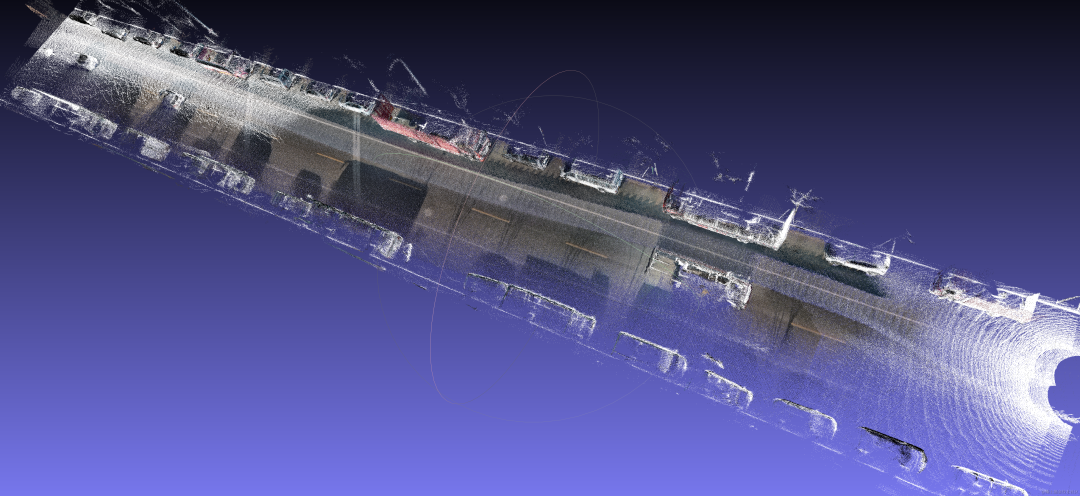

將雷射點雲視為真值,並將視覺重建結果與之疊加,可以直觀地衡量重建點雲的準確性。從下圖可以看到,重建點雲和真值點雲貼合度非常高,經過測量得到重建結果的相對誤差在15cm左右。

火山引擎多媒體實驗室重建結果(彩色)與真值點雲(白色)

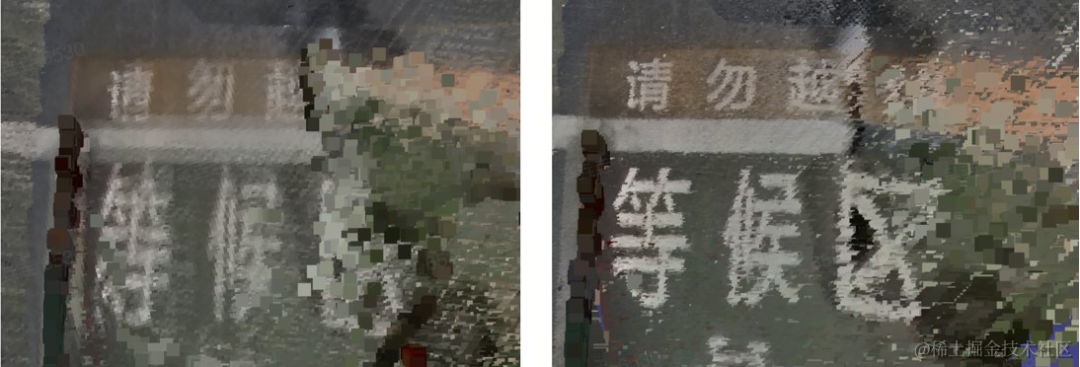

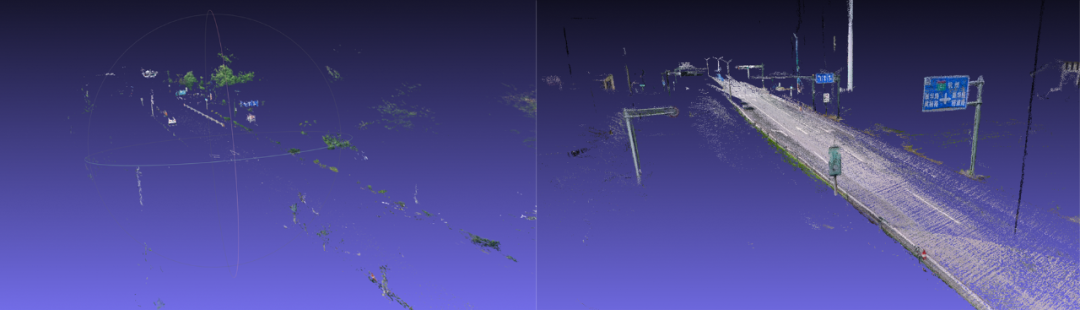

以下是火山引擎多媒體實驗室視覺重建演算法與某主流商業重建軟體的效果比較。可以看到,和商業軟體相比,火山引擎多媒體實驗室的自研演算法重建效果更好、更完整,場景中的路牌、紅綠燈、電線桿,以及路面上車道線、箭頭等還原度非常高,而商業軟體的重建點雲非常稀疏,且路面大範圍缺失。

某主流商業軟體(左) 火山引擎多媒體實驗室演算法(右)

#2.2 動態重建技術:

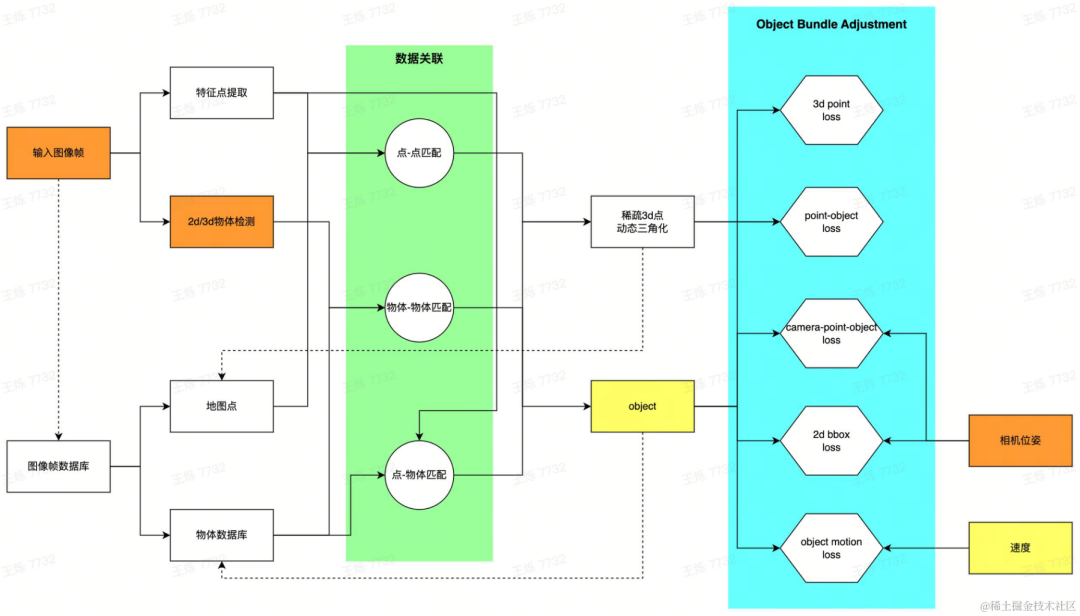

在影像上對物體進行3d標註十分困難,需要藉助於點雲,當車輛只有視覺感測器時,取得場景中目標物體的完整點雲十分困難。特別是動態物體,無法使用傳統的三維重建技術來取得其稠密點雲。為提供運動物體的表達,服務於4d標註,使用3d bounding box(以下簡稱3d bbox)對動態物體進行表示,透過自研動態重建演算法取得每一時刻場景中動態物體的3d bbox姿態、大小、速度等,從而補全動態物體重建能力。

動態重建pipeline

#對車輛擷取的每個影像,先擷取場景中的動態目標,產生3d bbox的初步提議,提供兩種方式:使用2d目標偵測,透過相機位姿估計對應的3d bbox;直接使用3d目標偵測。兩種方式針對不同數據可以靈活進行選擇,2d檢測泛化性好,3d檢測可以獲得更好的初值。同時,對影像動態區域內部的特徵點進行擷取。在取得單幀影像初始3d bbox提議及特徵點後,建立多幀間資料關聯:透過自研多目標追蹤演算法建立物體匹配,並透過特徵匹配技術對影像特徵進行匹配。取得匹配關係後,將有共視關係的影像幀建立為局部地圖,建構最佳化問題求解全域一致的目標bbox估計。具體地,透過特徵點的匹配以及動態三角化技術,恢復動態3d點;對車輛運動建模,聯合優化物體、3d點、相機之間的觀測,從而獲得最優估計的動態物體3d bbox。

2d產生3d(左二) 3d目標偵測範例

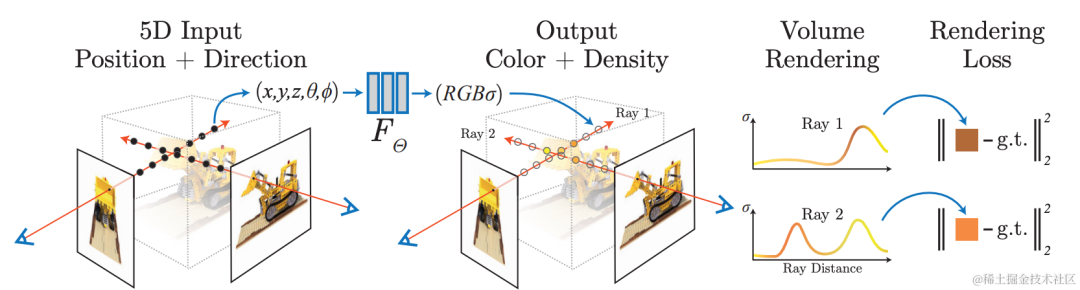

NeRF #重建:真實感渲染、自由視角

使用神經網路進行隱式重建,利用可微渲染模型,從現有視圖中學習如何渲染新視角下的影像,從而實現照片級逼真的影像渲染, 即神經輻射場(NeRF)技術。同時,隱式重建具有可編輯、查詢連續空間的特性,可用於自動駕駛場景中自動標註、模擬資料建置等任務。使用NeRF技術對場景進行重建是非常有價值的。

動態物/影子剔除,填補#

以上是雲端智慧駕駛三維重建優秀實踐的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

雲端運算巨頭掀起法律戰:亞馬遜狀告諾基亞專利侵權

Jul 31, 2024 pm 12:47 PM

雲端運算巨頭掀起法律戰:亞馬遜狀告諾基亞專利侵權

Jul 31, 2024 pm 12:47 PM

本站7月31日消息,科技巨頭亞馬遜於週二在美國特拉華州聯邦法院起訴了芬蘭電信公司諾基亞,指控其侵犯了亞馬遜十幾項與雲端運算技術相關的專利。 1.亞馬遜在訴訟中表示,諾基亞濫用了亞馬遜雲端運算服務(AWS)的相關技術,包括雲端運算基礎設施、安全性和效能方面的技術,來加強其自身的雲端服務產品。訴狀稱,亞馬遜於2006年推出了AWS,其開創性的雲端運算技術早在2000年代初期就開始研發。 「亞馬遜是雲端運算領域的先驅,現在諾基亞卻在未經許可的情況下使用亞馬遜的專利雲端運算創新成果,」訴狀寫道。亞馬遜要求法院發布禁令,阻

支持無圖城市NOA,長城魏牌藍山智駕版6月可望正式販售

May 09, 2024 pm 09:10 PM

支持無圖城市NOA,長城魏牌藍山智駕版6月可望正式販售

May 09, 2024 pm 09:10 PM

2024年5月9日消息,据报道,今年北京国际汽车展览上,长城汽车旗下魏牌推出了一款新车型——蓝山智驾版,吸引了众多参观者的目光。据“懂车帝视线”透露,这款备受瞩目的新车有望于今年6月正式登陆市场。蓝山智驾版在设计上继续沿用了在售蓝山DHT-PHEV的经典外观,但在智能驾驶感知方面进行了显著的升级。最为引人注目的是,车顶上安装了一个瞭望塔式的激光雷达,同时,车辆还配备了3个毫米波雷达和12个超声波雷达,以及11个高清视觉感知摄像头,总共达到了27个辅助驾驶传感器,大大增强了车辆的环境感知能力。根据

全新大眾邁騰B9即將上市,全面升級引領智慧駕駛新潮流

May 09, 2024 pm 05:50 PM

全新大眾邁騰B9即將上市,全面升級引領智慧駕駛新潮流

May 09, 2024 pm 05:50 PM

2007年5月9日消息,自2007年登录中国市场后,大众迈腾借其源于德国原型车的精湛工艺和全面性能,已在中国累积销售超过200万辆汽车,赢得了广大消费者的认可。近期,备受期待的全新一代大众迈腾(B9迈腾)将于6月正式登场,带来一场全方位的升级革新。全新迈腾在外观设计和内饰布局上均进行了大刀阔斧的改革。最显著的变化在于,新车型采纳了大疆前沿的智能驾驶技术,显著提升了自动驾驶和辅助驾驶的智能化水平。在外观设计方面,新款迈腾更加细长的前大灯设计,结合贯穿式灯带和发光LOGO,打造出更加宽阔的车头视觉效

隨著人工智慧時代需求的成長,AWS、微軟、Google繼續投資雲端運算

May 06, 2024 pm 04:22 PM

隨著人工智慧時代需求的成長,AWS、微軟、Google繼續投資雲端運算

May 06, 2024 pm 04:22 PM

到2024年為止,三大雲端運算巨頭的成長沒有任何放緩跡象,亞馬遜、微軟和谷歌在雲端運算領域的收入都比往任何時候都多。這三家雲端供應商最近公佈了財報,它們都延續了多年的持續收入成長策略。 4月25日,Google和微軟均公佈了業績。 Alphabet2024財年第一季,Google雲端營收為95.7億美元,年增28%。微軟的雲端收入為351億美元,年增23%。 4月30日,亞馬遜網路服務(AWS)報告營收為250億美元,年增17%,位列三大巨頭之列。雲端運算提供者有很多值得高興的事情,三大市場領導者的成長率在過去

PHP REST API與雲端運算平台的整合

Jun 04, 2024 pm 03:52 PM

PHP REST API與雲端運算平台的整合

Jun 04, 2024 pm 03:52 PM

PHPRESTAPI與雲端運算平台的整合優勢:可擴充性、可靠性、彈性。步驟:1.建立GCP專案和服務帳號。 2.安裝GoogleAPIPHP函式庫。 3.初始化GCP客戶端函式庫。 4.開發RESTAPI端點。最佳實務:使用快取、處理錯誤、限制請求速率、使用HTTPS。實戰案例:上傳檔案到GoogleCloudStorageusingCloudStorage客戶端程式庫。

Golang 技術在雲端運算領域的應用替代方案

May 09, 2024 pm 03:36 PM

Golang 技術在雲端運算領域的應用替代方案

May 09, 2024 pm 03:36 PM

Golang雲端運算替代方案包括:Node.js(輕量級、事件驅動)、Python(易用、資料科學能力)、Java(穩定、高效能)和Rust(安全、並發)。選擇最合適的替代方案取決於應用程式需求、生態系統、團隊技能和可擴展性。

比亞迪秦L DM-i首發亮相,中階轎車市場再掀波瀾

May 09, 2024 pm 06:07 PM

比亞迪秦L DM-i首發亮相,中階轎車市場再掀波瀾

May 09, 2024 pm 06:07 PM

2024年北京國際車展將首次亮相全新的中階轎車—秦L。這款車在內外都擁有全新的設計理念,配備第五代秦PLUSDM-i混動系統,成功吸引了眾多眼球,其市場定位也相較於目前市面上的秦PLUSDM-i有所提升。根據最新的資料部分,秦L+已經開放預定,並將於5月29日正式上市。新車將提供五個版本供消費者選擇,包括120KM卓越型、120KM超越型、120KM領先型、80KM超越型以及80KM領先型。預計售價將在12-15萬元之間。秦L+秦在外觀上提供了四種顏色選擇,包括潤玉白、建窯紫、冰珀青和茶晶灰

C++雲端運算最佳實務:部署、管理和擴展性考量

Jun 01, 2024 pm 05:51 PM

C++雲端運算最佳實務:部署、管理和擴展性考量

Jun 01, 2024 pm 05:51 PM

為了實現C++雲端應用程式的有效部署,最佳實務包括:容器化部署,使用Docker等容器。採用CI/CD,自動化發布流程。使用版本控制,管理程式碼變更。實施日誌記錄和監控,追蹤應用程式運行狀況。使用自動擴展,優化資源利用率。利用雲端管理服務,管理應用程式基礎架構。採用水平伸縮和垂直伸縮,根據需求調整應用程式容量。