重寫內容如下:機器之心報道

編輯:陳萍、大盤雞

LeCun 表示,絕大多數學術同業都非常支持開放式 AI 研發,但還是有反對者。

對於人工智慧風險的問題,各方專家的意見並不一致。有人發起了一封聯名信,呼籲人工智慧實驗室立即停止研究,深度學習的重要人物Geoffrey Hinton和Yoshua Bengio等都支持這個觀點

就在近幾日,Bengio、Hinton 等再發聯名信《在快速發展的時代管理人工智慧風險》,呼籲在開發AI 系統之前,研究者應該採取緊急治理措施,將安全和道德實踐納入重點,呼籲各國政府應該採取行動,管理AI 帶來的風險。

重寫後的內容為: 在文中提及了一些緊急的治理措施,例如讓國家機構參與其中,以避免人們濫用人工智慧。為了有效地監管,政府需要全面了解人工智慧的發展。監管機構應採取一系列措施,如模型註冊、有效保護舉報人的權益,以及對模型開發和超級電腦使用進行監控等。監管機構還需在部署之前對先進的人工智慧系統進行評估,以了解其潛在危險功能

不僅如此,時間再往前一點,今年五月,美國非營利組織人工智慧安全中心發表了一份聲明,警告人工智慧應被視為與流行病一樣存在滅絕人類的風險,支持該聲明的人同樣包括Hinton、Bengio 等人。

今年 5 月,為了暢所欲言地談論人工智慧帶來的風險,Hinton 也辭去了在谷歌的工作。在紐約時報的採訪中,他表示:「大多數人認為這(AI 危害)還很遙遠。我過去也認為這還很遙遠,可能是30 到50 年甚至更長的時間。但顯然,我現在不這麼想了。」

在 Hinton 等人看來,管理人工智慧帶來的風險是一項緊迫的任務

儘管如此,尤安·勒孔作為深度學習三巨頭之一,對於人工智慧的發展持有非常樂觀的態度。他對於簽署關於人工智慧風險的聯名信基本上持反對態度,認為人工智慧的發展並沒有構成對人類的威脅

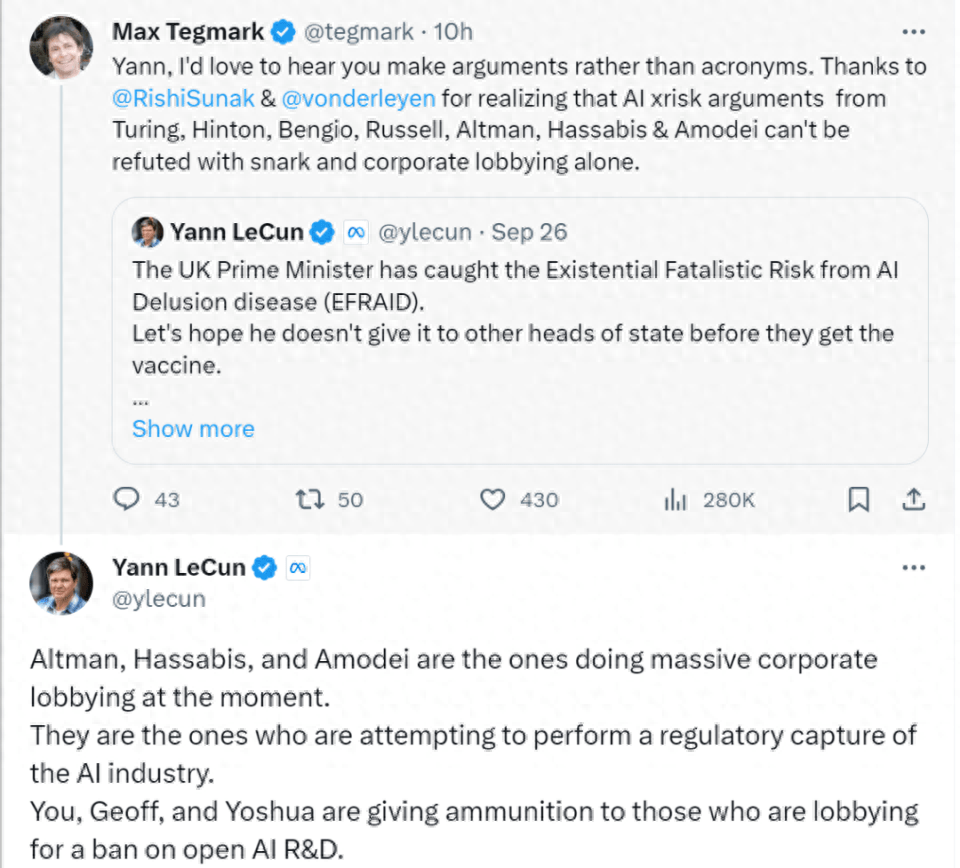

剛剛, LeCun 在與 X 用戶的交流中,對網友的一些關於 AI 風險的問題給了答案。

這位網友詢問了LeCun對文章《‘This is his climate change’: The experts helping Rishi Sunak seal his legacy》的看法。文章認為,Hinton、Bengio等人共同發表的聲明改變了人們對人工智慧的看法。從把人工智慧視為輔助工具,轉變為將其視為潛在威脅。文章接著表示,近幾個月來,英國觀察家發現越來越多的人對人工智慧會造成世界末日的擔憂。今年三月,英國政府公佈了一份白皮書,承諾不會扼殺人工智慧創新。但光是兩個月,英國就開始討論對人工智慧設定限制,並敦促美國加入其全球人工智慧規則計畫

請將內容重新撰寫成中文,不需要出現原句

要改寫的內容是:https://www.telegraph.co.uk/business/2023/09/23/artificial-intelligence-safety-summit-sunak-ai-experts/

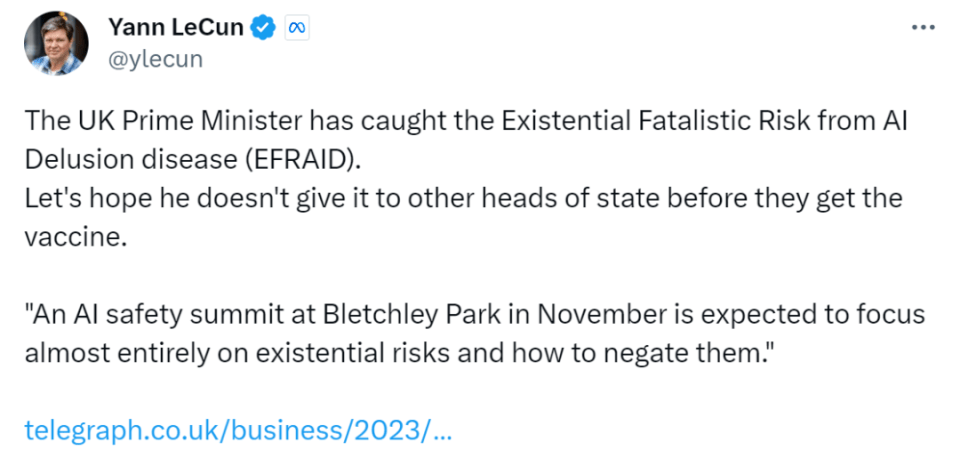

LeCun 對這篇文章的反應是這樣的,他不希望英國對 AI 有宿命論風險的擔憂傳播給其他國家。

之後,就有了我們前面提到的 LeCun 與 X 用戶的交流,以下是 LeCun 的全部回答:

「Altman、Hassabis 以及Amodei 正在進行大規模的企業遊說。他們正嘗試對AI 產業進行監管。而你、Geoff,還有Yoshua 正在給那些遊說禁止開放AI 研究的人提供『彈藥』。

假如你們的宣傳活動成功,不可避免地會導致我們所認為的災難結果:少數公司將掌控人工智慧

絕大多數學術同業都非常支持開放式 AI 研發。很少人相信你所鼓吹的末日場景。你、Yoshua、Geoff 和 Stuart 是唯一的例外。

和許多人一樣,我非常支持開放式 AI 平台,因為我相信各種力量的結合:人們的創造力、民主、市場力量和產品法規。我也知道,生產安全且受我們控制的 AI 系統是可能的。我已經為此提出了具體建議。這一切都將促使人們做正確的事。

AI並不是憑空產生的,它是我們無法控制的自然現象,但事實並非如此。它的進步是由我們所認識的每一個人所推動的。我們和他們都有能力創造出「正確的事物」。要求對研發進行監管,其實隱含了這樣的假設:這些人和他們所服務的組織都是無能、魯莽、自我毀滅或邪惡的。但事實並非如此

我已經提出了很多論點來證明你所害怕的末日場景是荒謬的。在此我就不再贅述了。但主要的一點是,如果強大的人工智慧系統是由目標(包括護欄)驅動的,那麼它們就會是安全可控的,因為它們設定了這些護欄和目標。 (目前的自迴歸語言模型並不是目標驅動的,所以我們不要從自迴歸語言模型的弱點來推斷)

關於開源這項事項,你的活動將產生與你追求的完全相反的效果。未來,人工智慧系統將成為人類知識和文化的寶庫,我們需要的是開源和免費的平台,以便每個人都能為其做出貢獻。只有開放的平台才能反映人類全部知識和文化,這就要求對這些平台的貢獻是眾包的,類似維基百科。如果平台不開放,這樣做是行不通的

如果開放原始碼的 AI 平台被監管,那麼另一種情況將一定發生,那就是少數公司將控制 AI 平台,進而控制人們的全部數位依賴。這對民主意味著什麼?這對文化多樣性意味著什麼?這是讓我徹夜難眠的原因。 ”

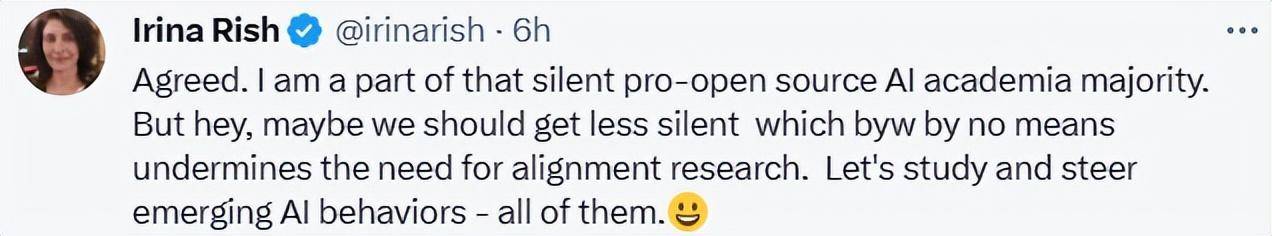

在 LeCun 長推文的下方,也有許多人「聲援」他的觀點。

蒙特婁大學電腦科學與運籌學系教授Irina Rish是Mila-Quebec AI研究所的核心成員。她認為,支持開源AI的研究人員不應該再保持沉默,而應該在新興AI的發展中發揮引領作用

e/acc創辦人 Beff Jezos 也在評論區中表示,這樣的評論是重要的,也是人們所需要的。

網友表示,一開始,討論安全問題可以豐富大家對未來科技的想像,但是聳人聽聞的科幻小說不應當導致壟斷政策的出現。

播客主持人 Lex Fridman 對這場辯論有更多的期待。

關於 AI 風險的問題討論也將影響 AI 的未來發展。當一個觀點搶佔風頭時,人們會盲目跟隨。只有雙方能不斷地進行理性探討,才能真正看清 AI 的「真面目」。

以上是圖靈獎得主吵起來了,LeCun:Bengio、Hinton等AI滅絕論是荒謬的的詳細內容。更多資訊請關注PHP中文網其他相關文章!