影像塗哪就動哪! Gen-2新功能「神筆馬良」爆火,網友:急急

AI能夠產生視頻,已經發展到了這個階段了? !

對著一張照片隨手一刷,就能讓被選中的目標動起來!

明明是一輛靜止的卡車,但一經刷過,它立刻飛速啟動,連光影都完美地再現

這張照片本來只是一張火災照片,但現在只需隨手一刷,火焰就能沖天而起,熱度撲面而來

如果繼續這樣下去,就很難分辨照片和實拍影片了!

這是Runway為AI視訊軟體Gen-2打造的全新功能,透過一塗一刷的操作,可以使影像中的物件動起來,其逼真程度不亞於神筆馬良

雖然只是個功能預熱,不過效果一出就在網上爆火:

#看得網友一個個變身急急國王,直呼“等不及想要嘗試一波」:

Runway同時也發布了更多功能預熱效果,我們一起來看看吧

照片變視頻,指哪就動哪

這個Runway新出的功能,叫做運動筆刷(Motion Brush)。

顧名思義,只需要用這個筆刷對著畫面中的任意物件「塗」一下,就能讓他們動起來。

不僅可以是靜止的人,連裙擺和頭部的動作都表現得非常自然

還可以是流動的液體如瀑布,連霧氣都能還原:

或是一根還沒熄滅的煙:

一團正在眾人面前燃燒的篝火:

更大塊的背景也能做成動態的,甚至改變畫面的光影效果,例如正在飛速移動的烏雲:

當然,以上所述只是Runway的明確聲明,他們主動告訴你他們對照片進行了某些處理

下面這些沒有塗抹痕蹟的視頻,更是幾乎完全看不出有AI修飾的成分在裡面:

一連串效果炸出,也導致功能還沒正式放出來,網友已經迫不及待了。

有很多人試圖弄清楚這個功能是如何實現的。還有一些網友更關注這個功能什麼時候發布,希望能直接在321上找到連結(手排狗頭)

可以期待一下了,確實有不少好消息

除此之外,Runway還推出了其他新功能

最近一連串的AI生成進展似乎都在表明,視頻生成領域似乎真要迎來技術大爆發了。

AI生成视频真要崛起了?

在这几天内,有一些网友发现了文生动画软件Animatediff的一种新的热门玩法

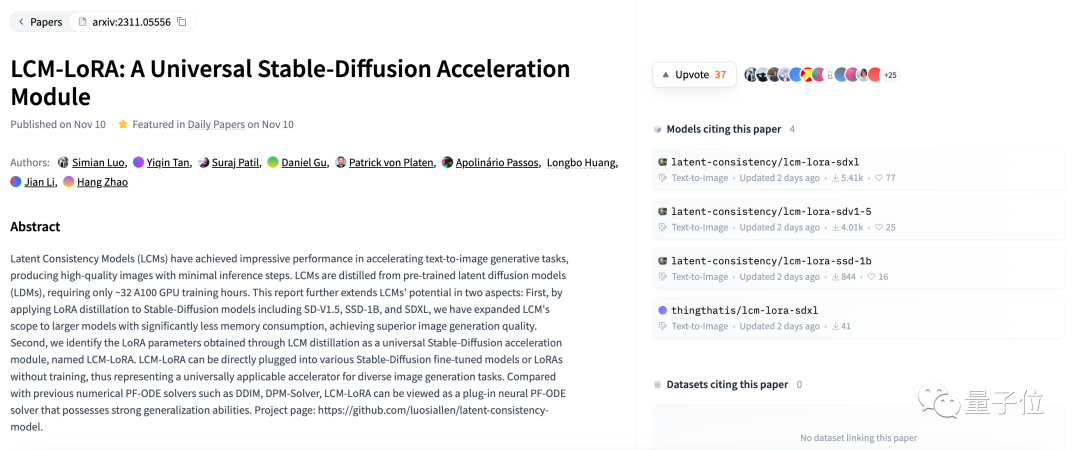

只需要结合最新的研究LCM-LORA,生成16帧的动画视频只需要7秒钟的时间。

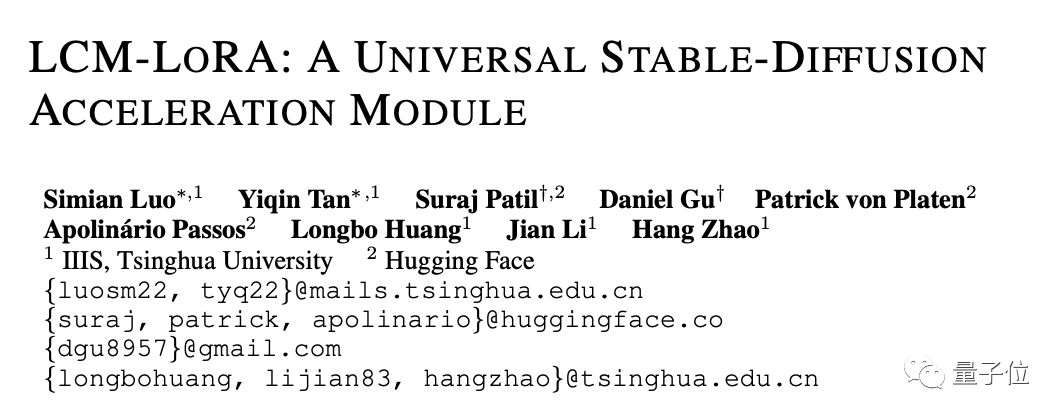

LCM-LORA是华大和Hugging Face最新推出的AI图片生成技术,能够显著提高Stable Diffusion的图片生成速度

其中,LCM(Latent Consistency Models)是基于今年早些时候OpenAI的“一致性模型”提出来的一种图像生成新方法,能快速生成768×768的高分辨率图片。

但LCM不兼容现有模型,因此清华和抱抱脸的成员又新出了一版LCM-LORA模型,可以兼容所有Stable Diffusion模型,加速出图速度。

结合Animatediff软件,生成一个这样的动画只需要7秒钟左右:

目前LCM-LORA已经在抱抱脸上开源。

你感觉最近的AI视频生成进展如何,距离可用上还有多远?

参考链接:

[1]https://twitter.com/runwayml/status/1723033256067489937。

[2]https://twitter.com/op7418/status/1723016460220735748。

以上是影像塗哪就動哪! Gen-2新功能「神筆馬良」爆火,網友:急急的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

最佳AI藝術生成器(免費付款)創意項目

Apr 02, 2025 pm 06:10 PM

最佳AI藝術生成器(免費付款)創意項目

Apr 02, 2025 pm 06:10 PM

本文回顧了AI最高的藝術生成器,討論了他們的功能,對創意項目的適用性和價值。它重點介紹了Midjourney是專業人士的最佳價值,並建議使用Dall-E 2進行高質量的可定製藝術。

開始使用Meta Llama 3.2 -Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

開始使用Meta Llama 3.2 -Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

Meta的Llama 3.2:多模式和移動AI的飛躍 Meta最近公佈了Llama 3.2,這是AI的重大進步,具有強大的視覺功能和針對移動設備優化的輕量級文本模型。 以成功為基礎

Chatgpt 4 o可用嗎?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 o可用嗎?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4當前可用並廣泛使用,與諸如ChatGpt 3.5(例如ChatGpt 3.5)相比,在理解上下文和產生連貫的響應方面取得了重大改進。未來的發展可能包括更多個性化的間

最佳AI聊天機器人比較(Chatgpt,Gemini,Claude&更多)

Apr 02, 2025 pm 06:09 PM

最佳AI聊天機器人比較(Chatgpt,Gemini,Claude&更多)

Apr 02, 2025 pm 06:09 PM

本文比較了諸如Chatgpt,Gemini和Claude之類的頂級AI聊天機器人,重點介紹了其獨特功能,自定義選項以及自然語言處理和可靠性的性能。

頂級AI寫作助理來增強您的內容創建

Apr 02, 2025 pm 06:11 PM

頂級AI寫作助理來增強您的內容創建

Apr 02, 2025 pm 06:11 PM

文章討論了Grammarly,Jasper,Copy.ai,Writesonic和Rytr等AI最高的寫作助手,重點介紹了其獨特的內容創建功能。它認為Jasper在SEO優化方面表現出色,而AI工具有助於保持音調的組成

選擇最佳的AI語音生成器:評論的頂級選項

Apr 02, 2025 pm 06:12 PM

選擇最佳的AI語音生成器:評論的頂級選項

Apr 02, 2025 pm 06:12 PM

本文評論了Google Cloud,Amazon Polly,Microsoft Azure,IBM Watson和Discript等高級AI語音生成器,重點介紹其功能,語音質量和滿足不同需求的適用性。

如何訪問獵鷹3? - 分析Vidhya

Mar 31, 2025 pm 04:41 PM

如何訪問獵鷹3? - 分析Vidhya

Mar 31, 2025 pm 04:41 PM

獵鷹3:革命性的開源大語模型 Falcon 3是著名的獵鷹系列LLMS系列中的最新迭代,代表了AI技術的重大進步。由技術創新研究所(TII)開發

構建AI代理的前7個代理抹布系統

Mar 31, 2025 pm 04:25 PM

構建AI代理的前7個代理抹布系統

Mar 31, 2025 pm 04:25 PM

2024年見證了從簡單地使用LLM進行內容生成的轉變,轉變為了解其內部工作。 這種探索導致了AI代理的發現 - 自主系統處理任務和最少人工干預的決策。 Buildin